Anthropic Academy 课程全集(中文版)

本文档包含 Anthropic Skilljar 平台上 13 门课程的完整中文翻译。 翻译来源:Anthropic 官方课程平台 anthropic.skilljar.com

目录

入门与素养

- Claude 101 入门指南 — 从零开始学习使用 Claude(13 节)

- AI 素养:框架与基础 — 学会高效、安全、负责任地与 AI 系统协作(15 节)

- 教育者 AI 素养 — 面向教育工作者的 AI 协作技能培训(5 节)

- 学生 AI 素养 — 面向学生的 AI 协作技能培训(6 节)

- 非营利组织 AI 素养 — 面向非营利组织的 AI 素养与实践指南(10 节)

- 教授 AI 素养 — 面向教师的 AI 素养教学方法论(8 节)

开发者工具

- Agent Skills 入门 — 学习创建和管理 Claude Code 技能(6 节)

- 使用 Anthropic API 构建应用 — Claude API 开发完整教程:从基础到高级(96 节)

- Claude 与 Google Vertex AI — 在 Google Cloud 平台上使用 Claude(93 节)

- Claude Code 实战 — Claude Code 编程助手完整实战教程(21 节)

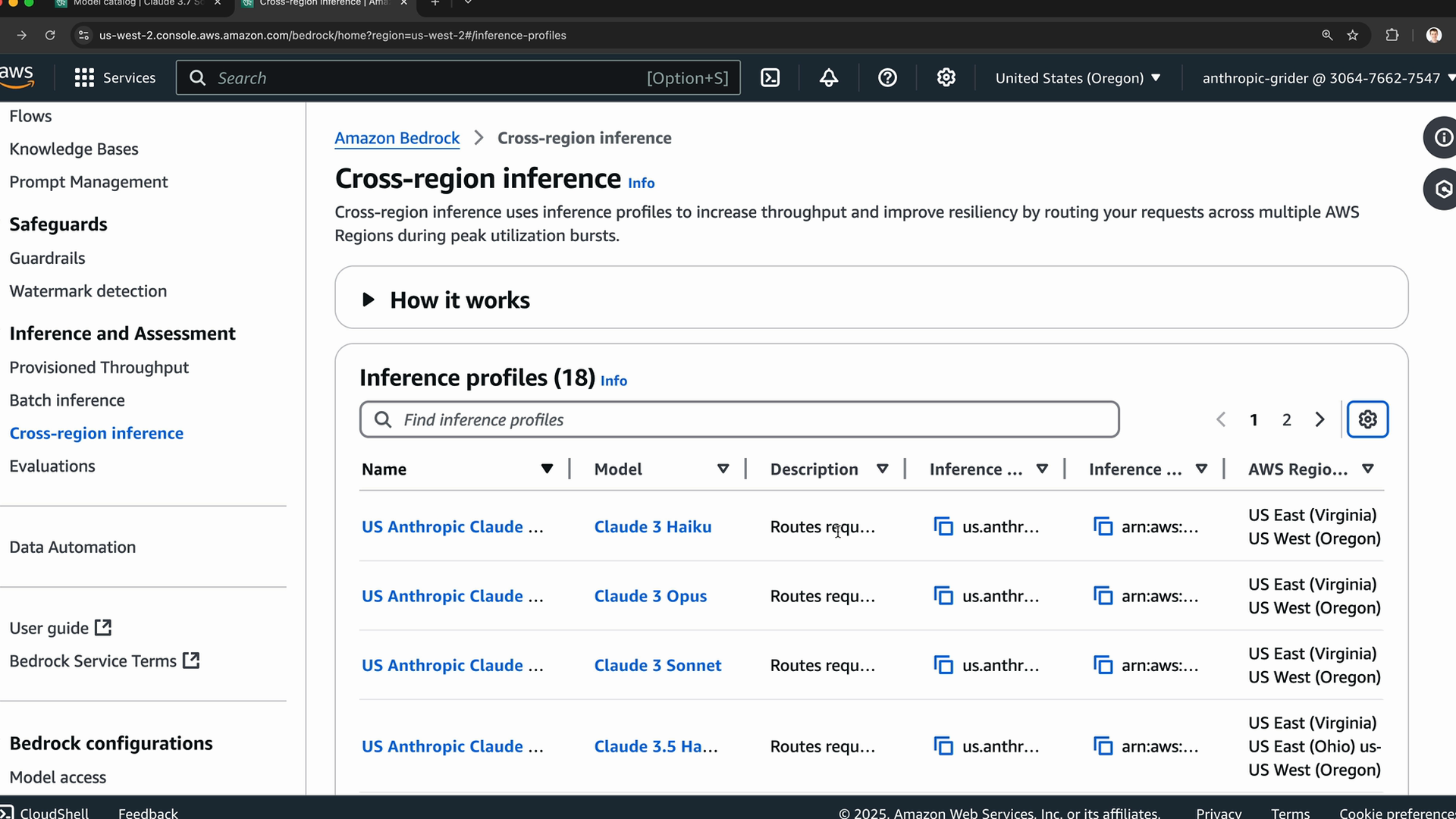

- Claude 与 Amazon Bedrock — 在 AWS Bedrock 上使用 Claude(83 节)

- 模型上下文协议(MCP)入门 — MCP 开发完整教程(14 节)

- MCP 高级主题 — 模型上下文协议进阶开发(15 节)

第 1 课:Claude 101 入门指南

从零开始学习使用 Claude 课程链接:Claude 101 入门指南 | 共 13 节课

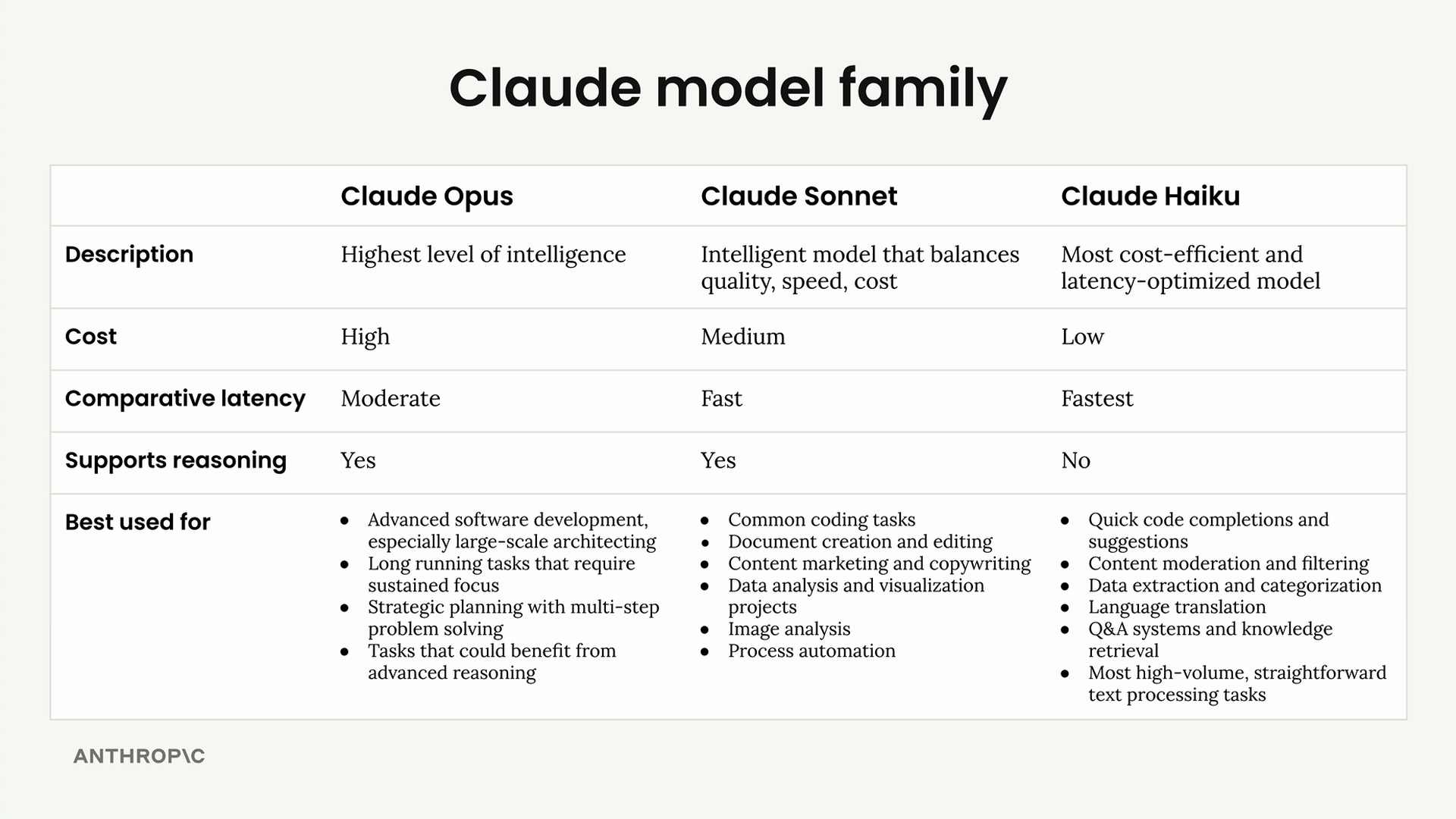

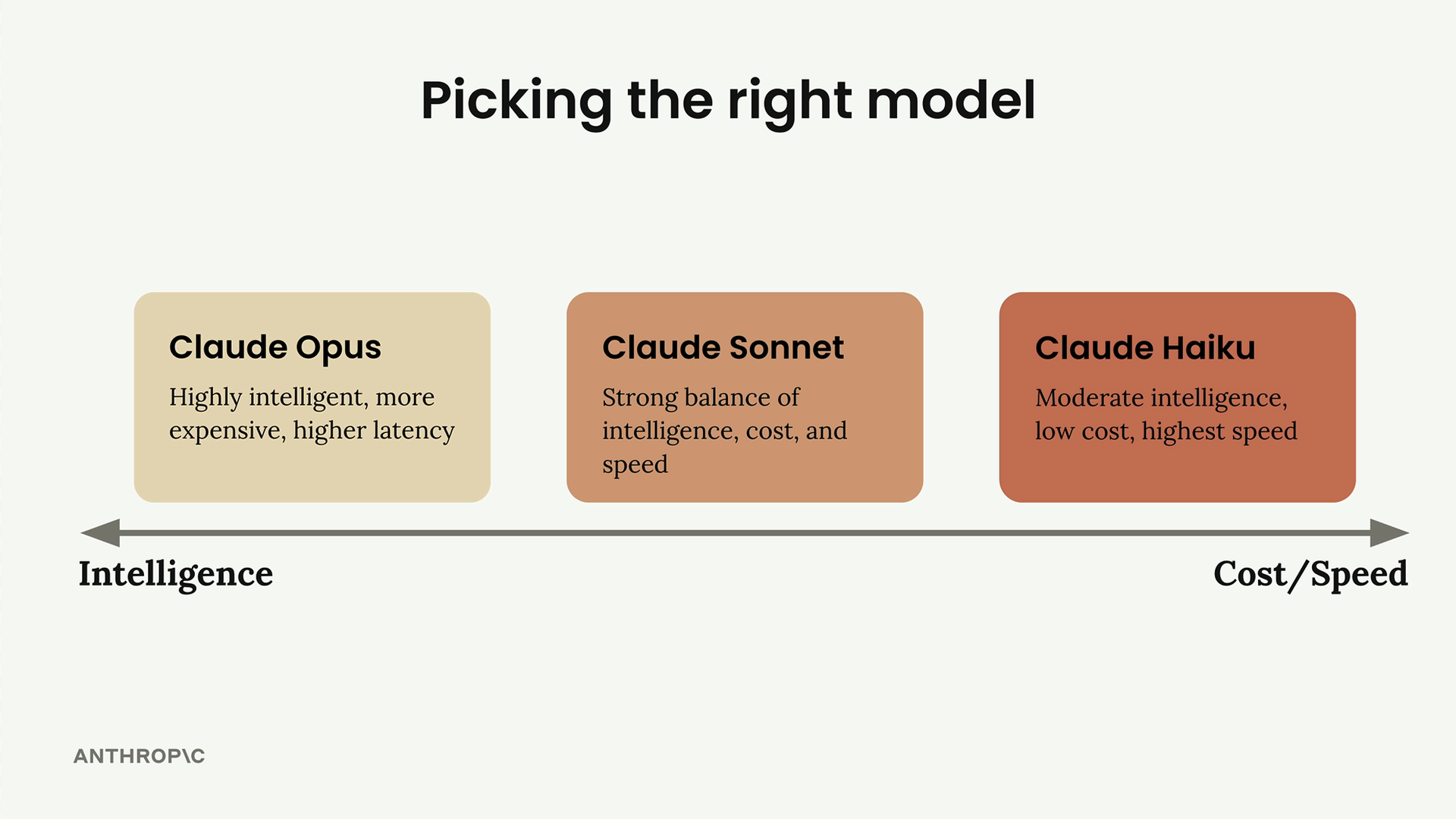

Claude 模型概览

Claude 共有三个模型系列,分别针对不同的优先级进行了优化:

Opus = 智能程度最高的模型,适用于需要深度推理和规划的复杂、多步骤任务。其权衡之处在于成本和延迟(latency)较高。

Sonnet = 一款均衡型模型,在智能、速度和成本效益方面表现良好。具备强大的编码能力和精确的代码编辑功能。是大多数实际应用场景的最佳选择。

Haiku = 速度最快的模型,为速度和成本效益而优化。不具备 Opus/Sonnet 那样的推理能力。最适合实时用户交互和高吞吐量处理。

选择框架:若智能优先 → Opus。若速度优先 → Haiku。若需求均衡 → Sonnet。

通用方法 = 在同一应用中根据具体任务需求使用多个模型,而非选择单一模型。

所有模型共享核心能力:文本生成、编码、图像分析。主要区别在于优化重点不同。

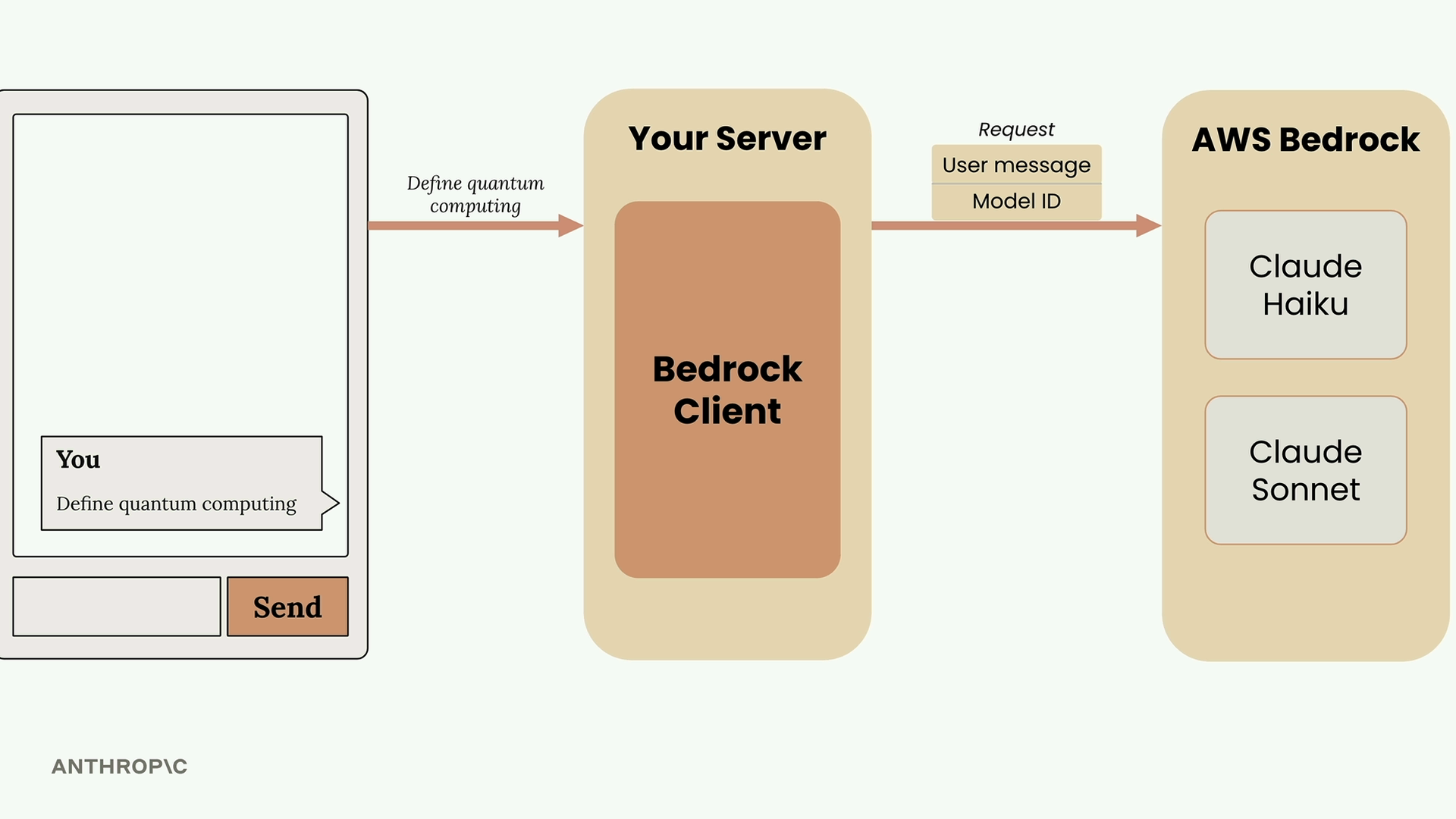

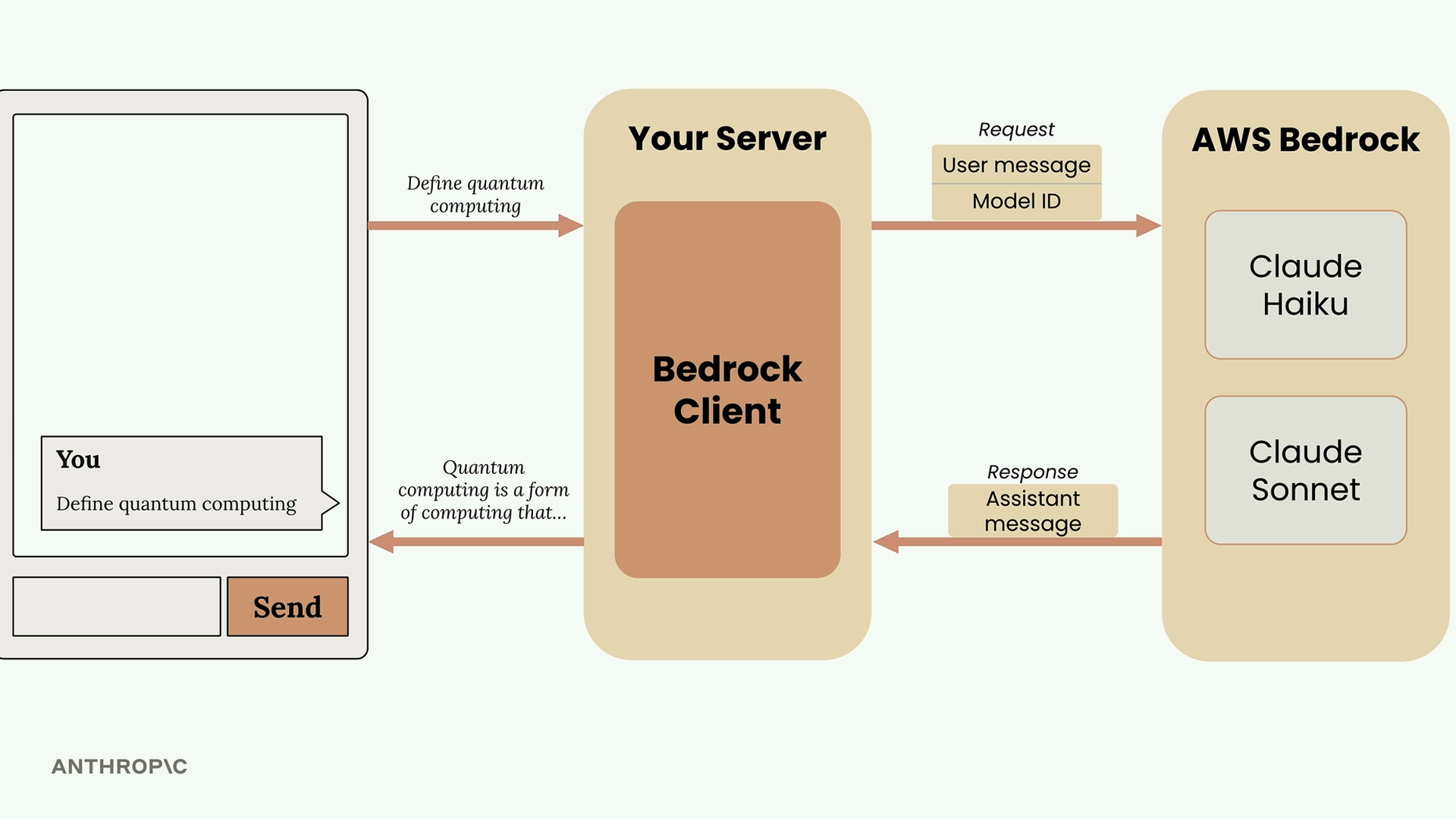

访问 API

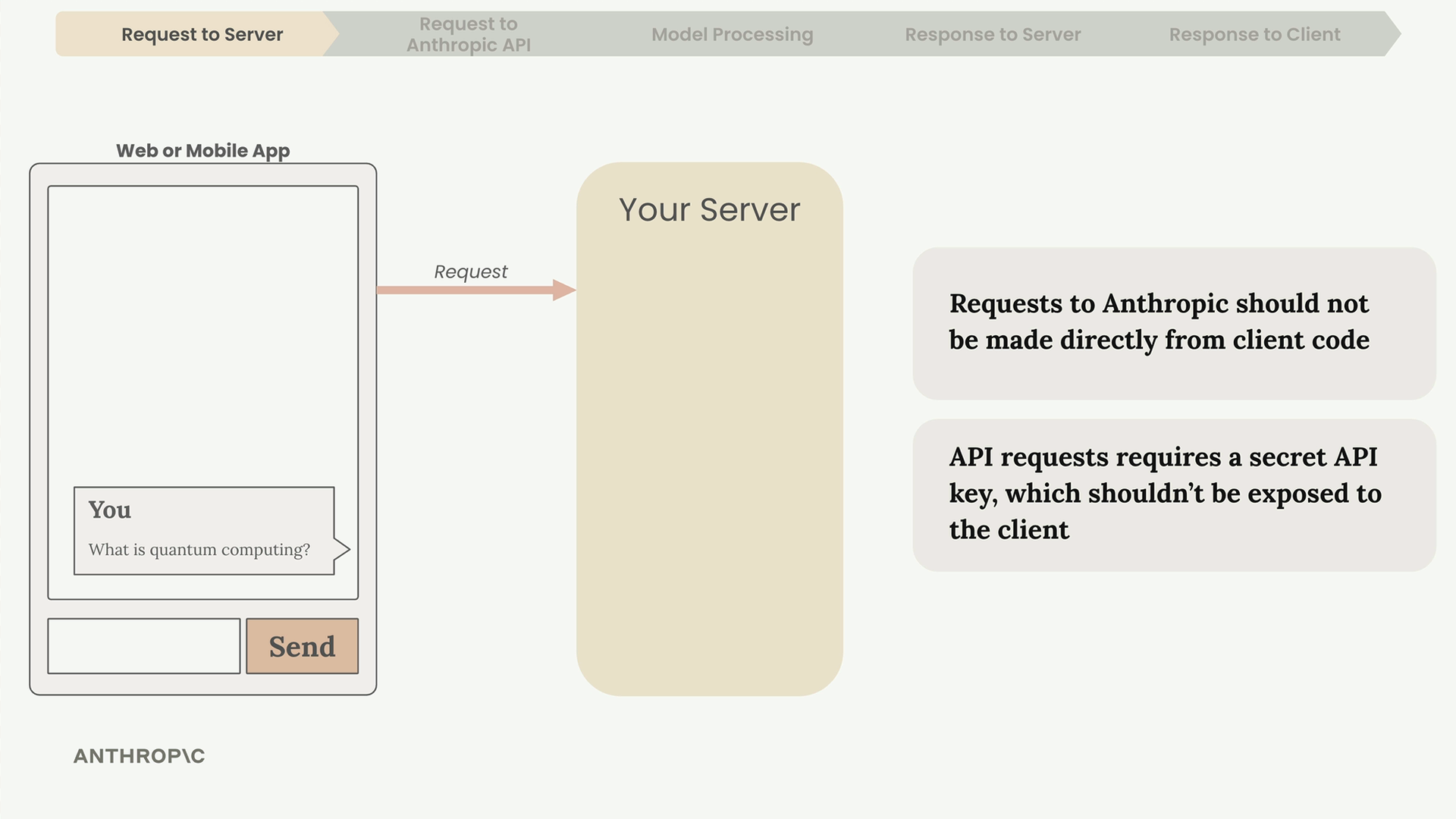

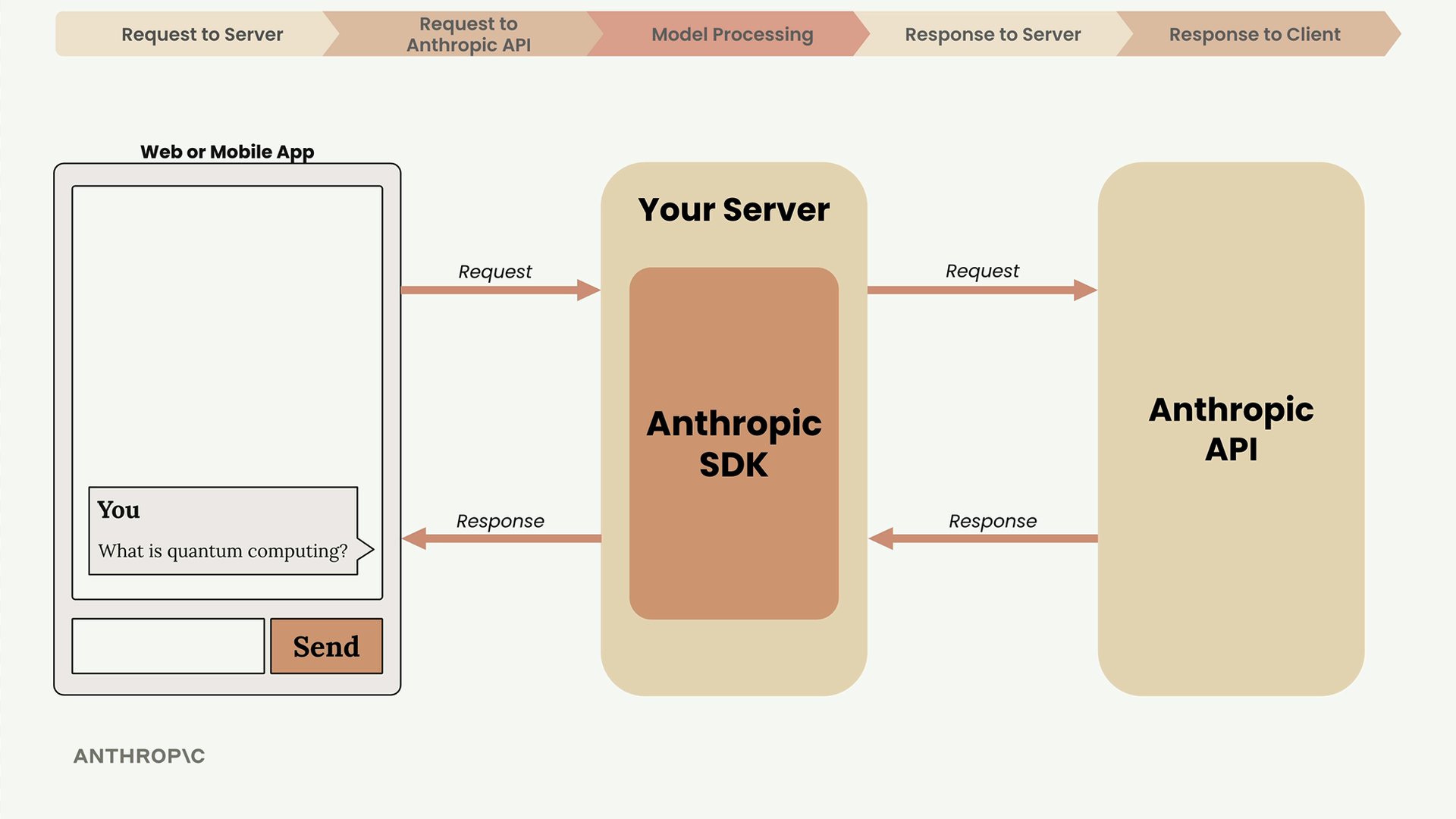

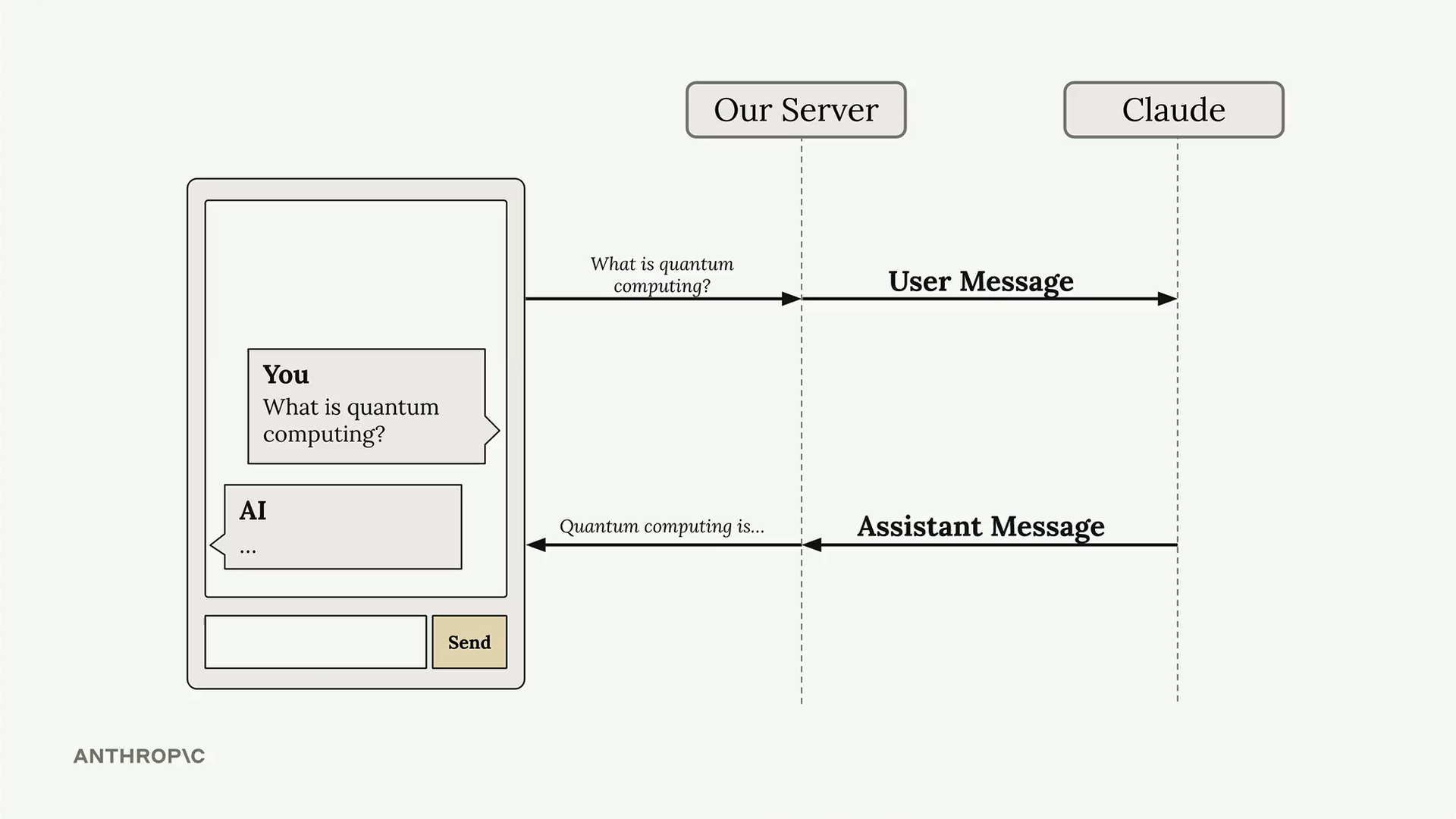

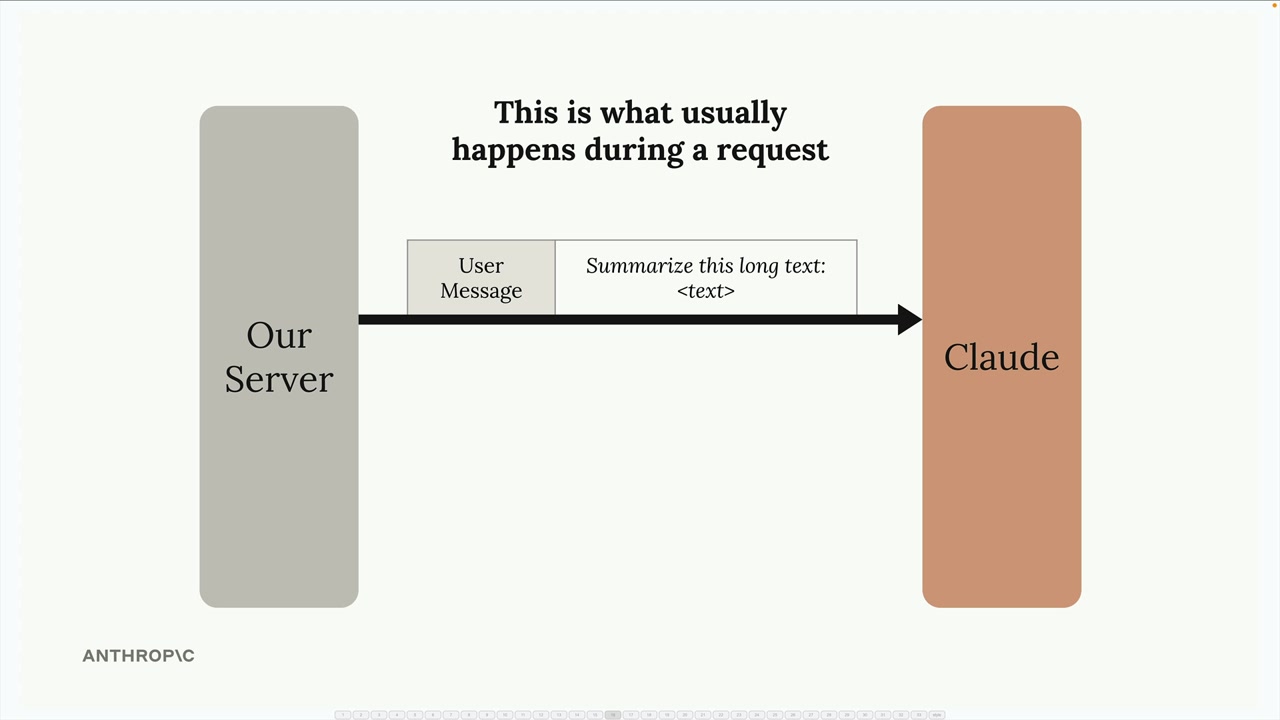

API Access Flow (API 访问流程) = 从用户输入到显示响应的 5 步流程。

第 1 步:客户端将用户文本发送至开发者的服务器(切勿直接从客户端应用访问 Anthropic API,以保护 API 密钥的私密性)。

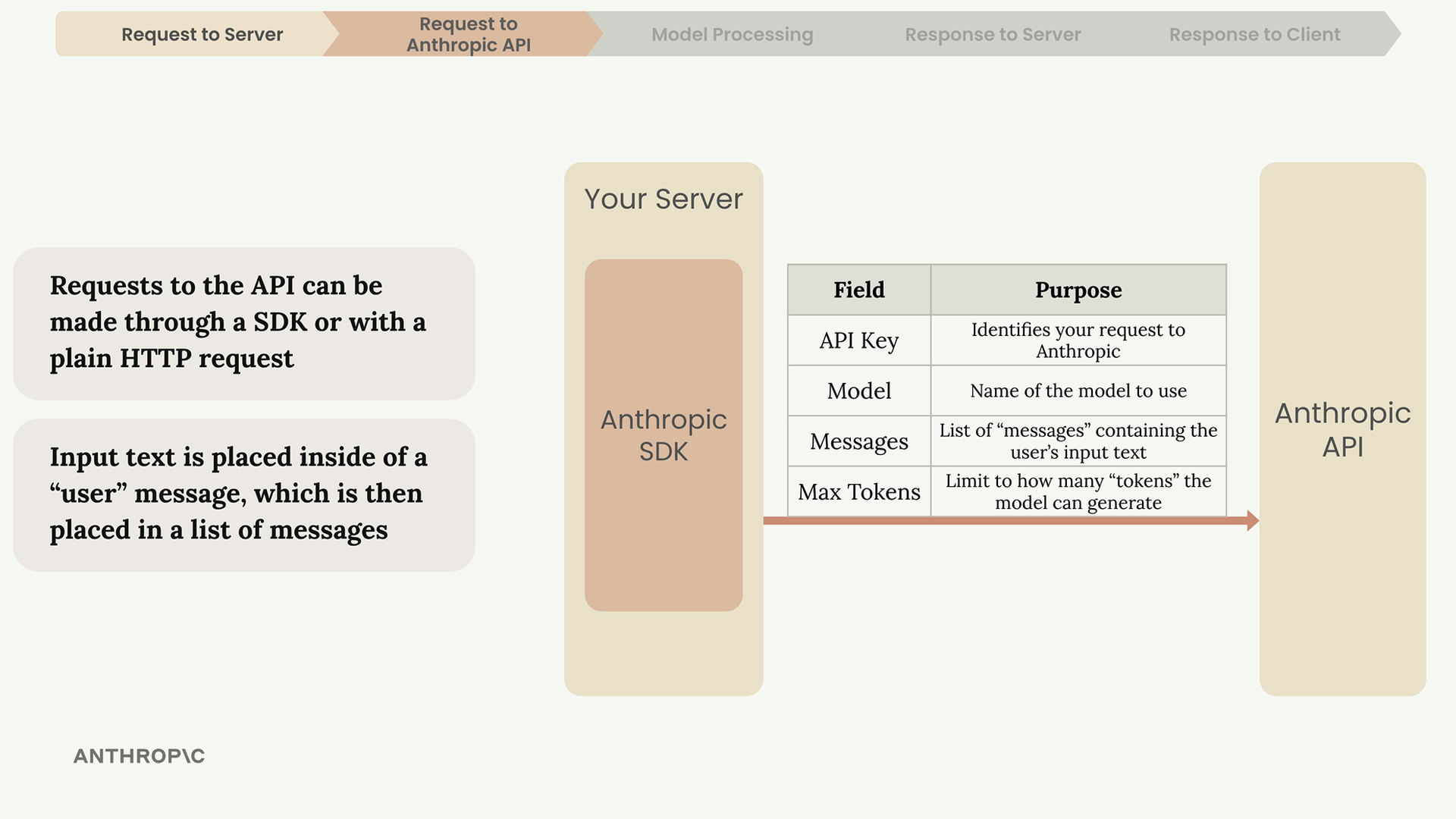

第 2 步:服务器使用 SDK(Python、TypeScript、JavaScript、Go、Ruby)或纯 HTTP 请求向 Anthropic API 发出请求。必需参数 = API 密钥 + 模型名称 + 消息列表 + max_tokens(最大生成词元数)限制。

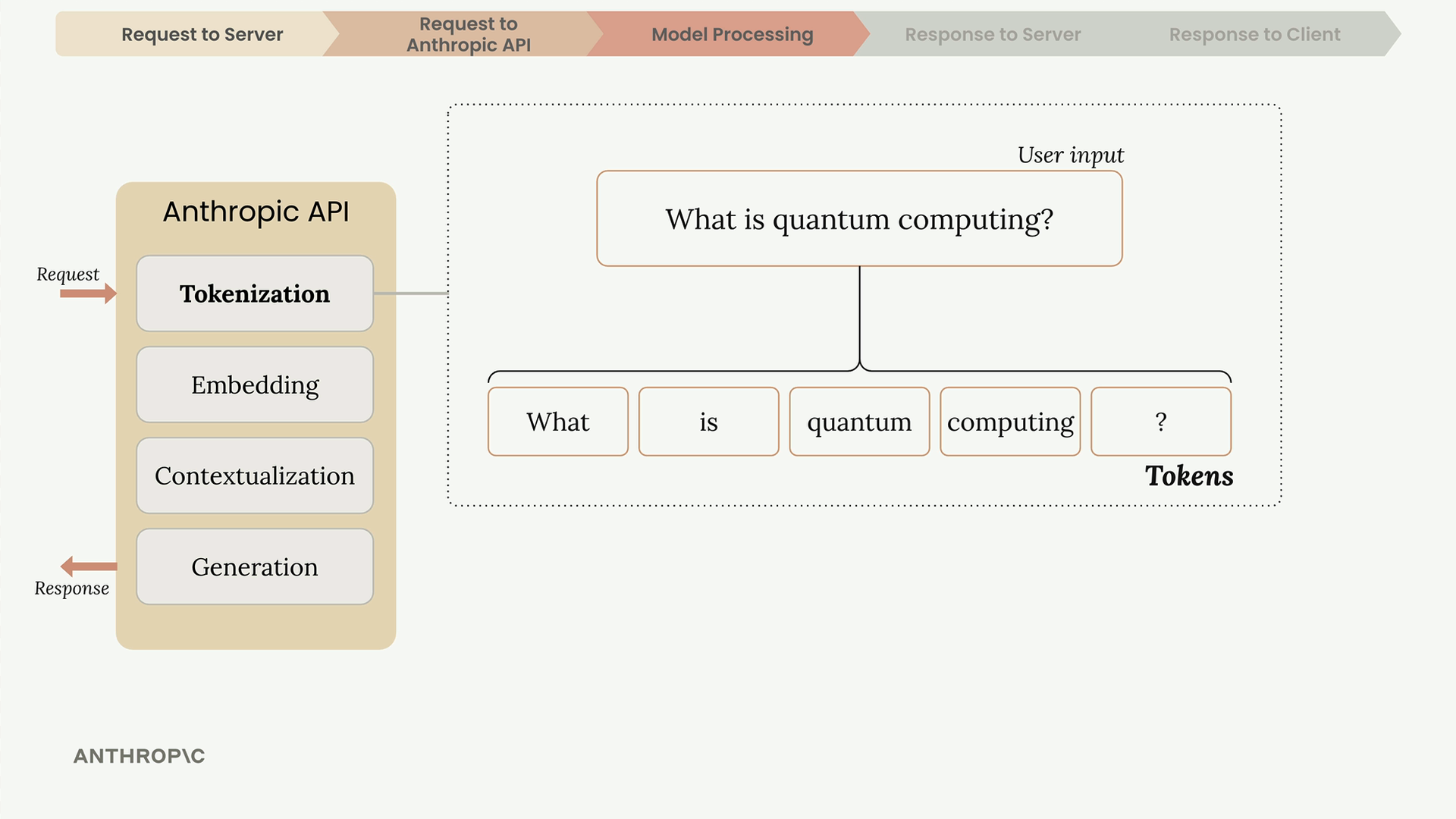

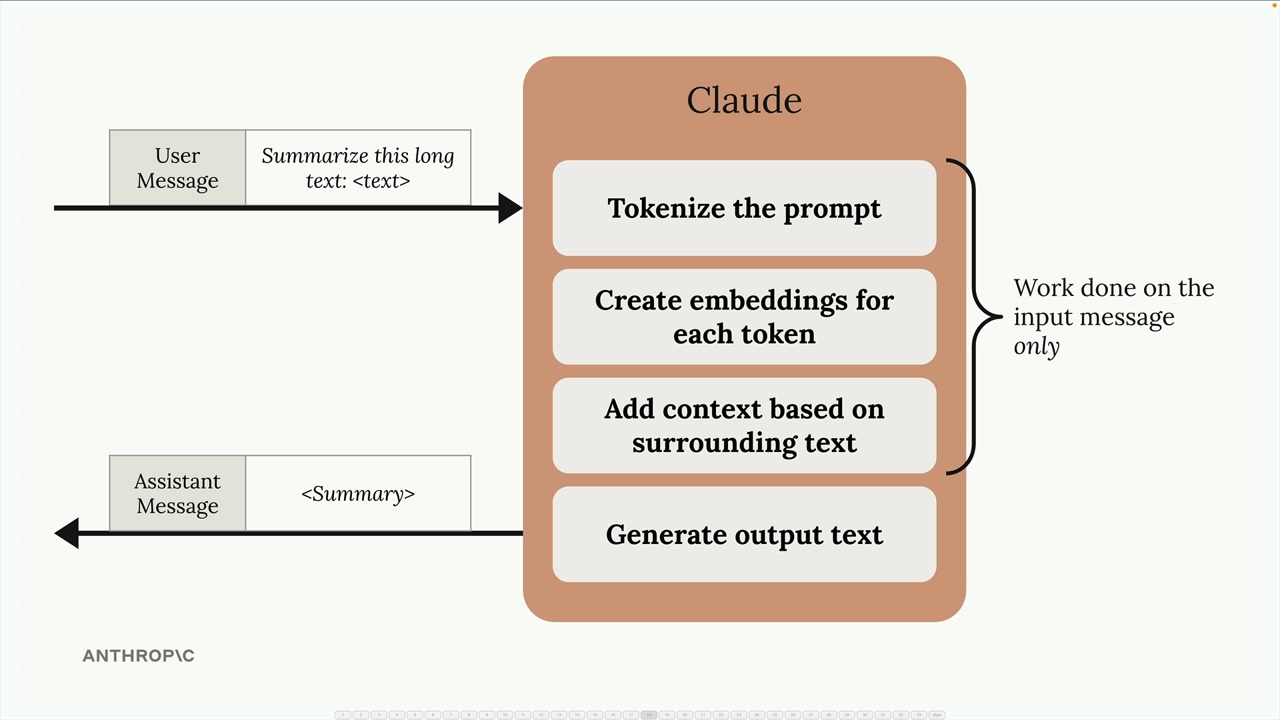

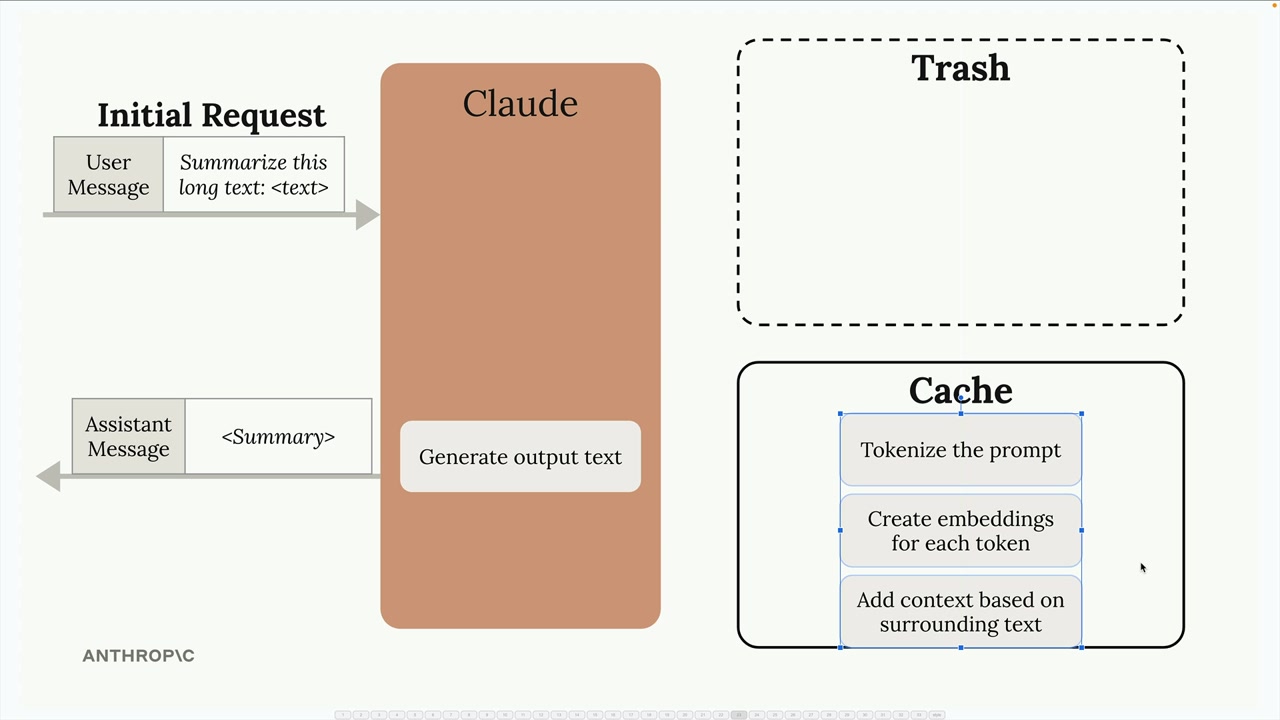

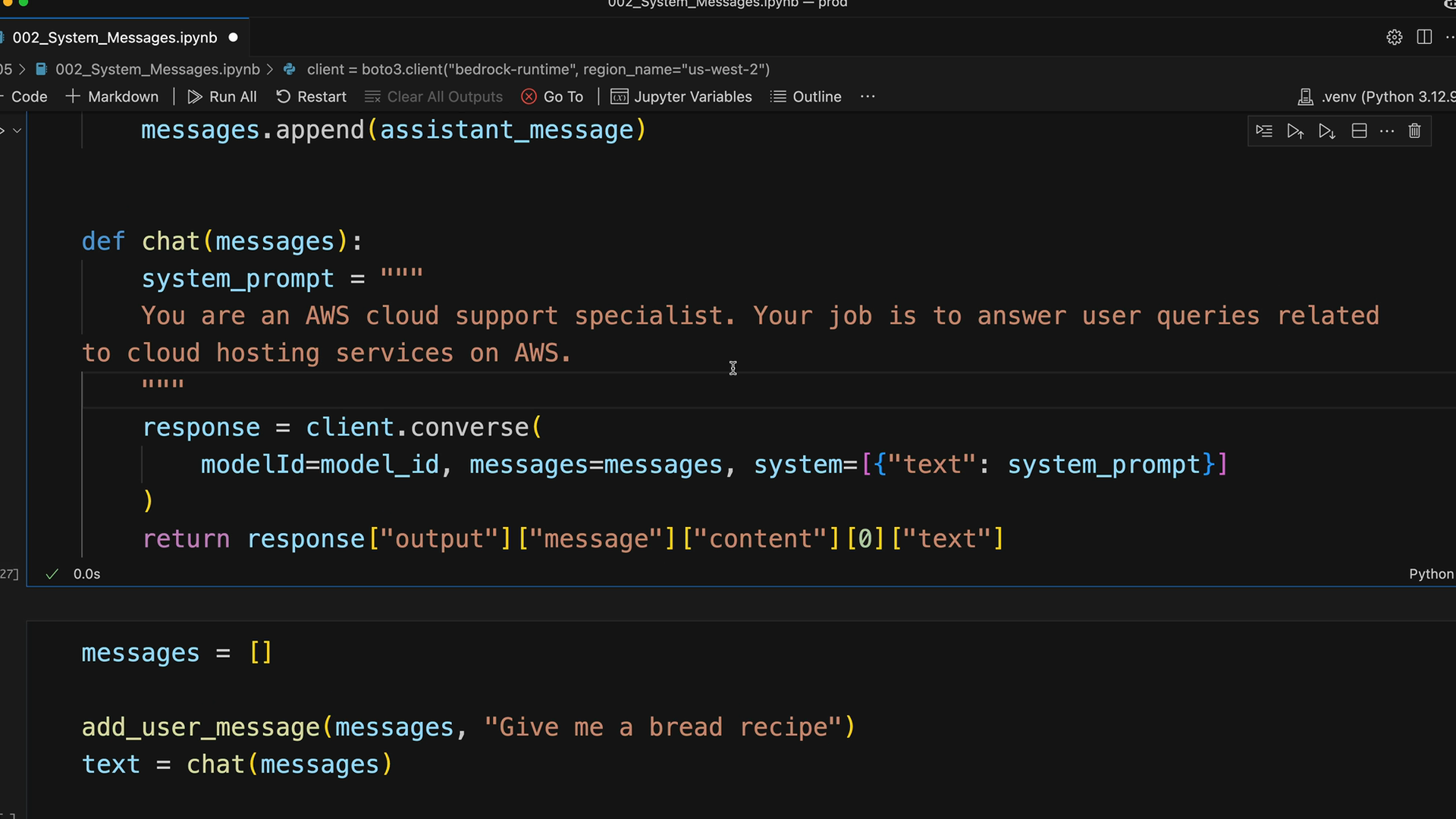

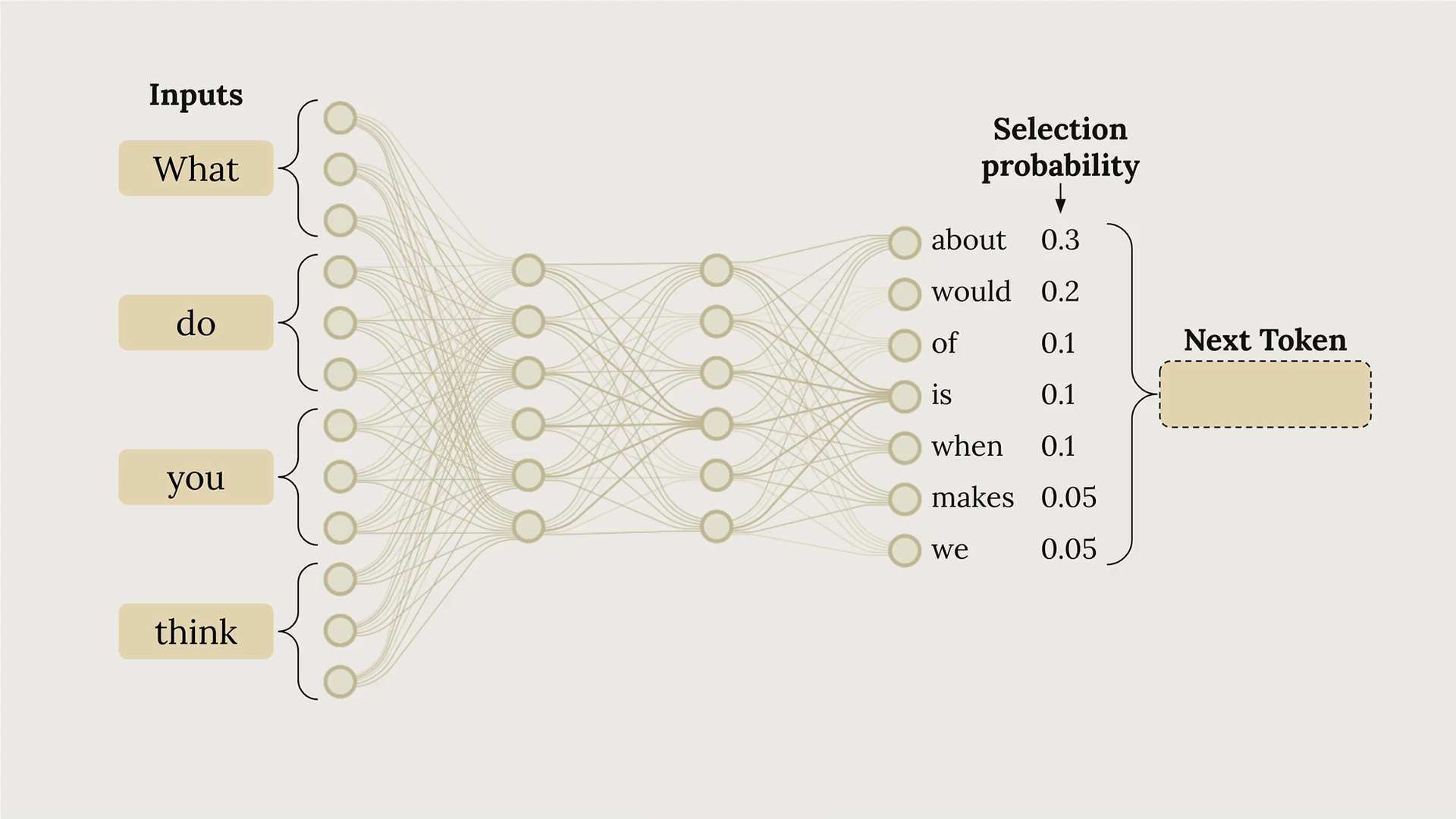

第 3 步:文本生成过程有 4 个阶段:

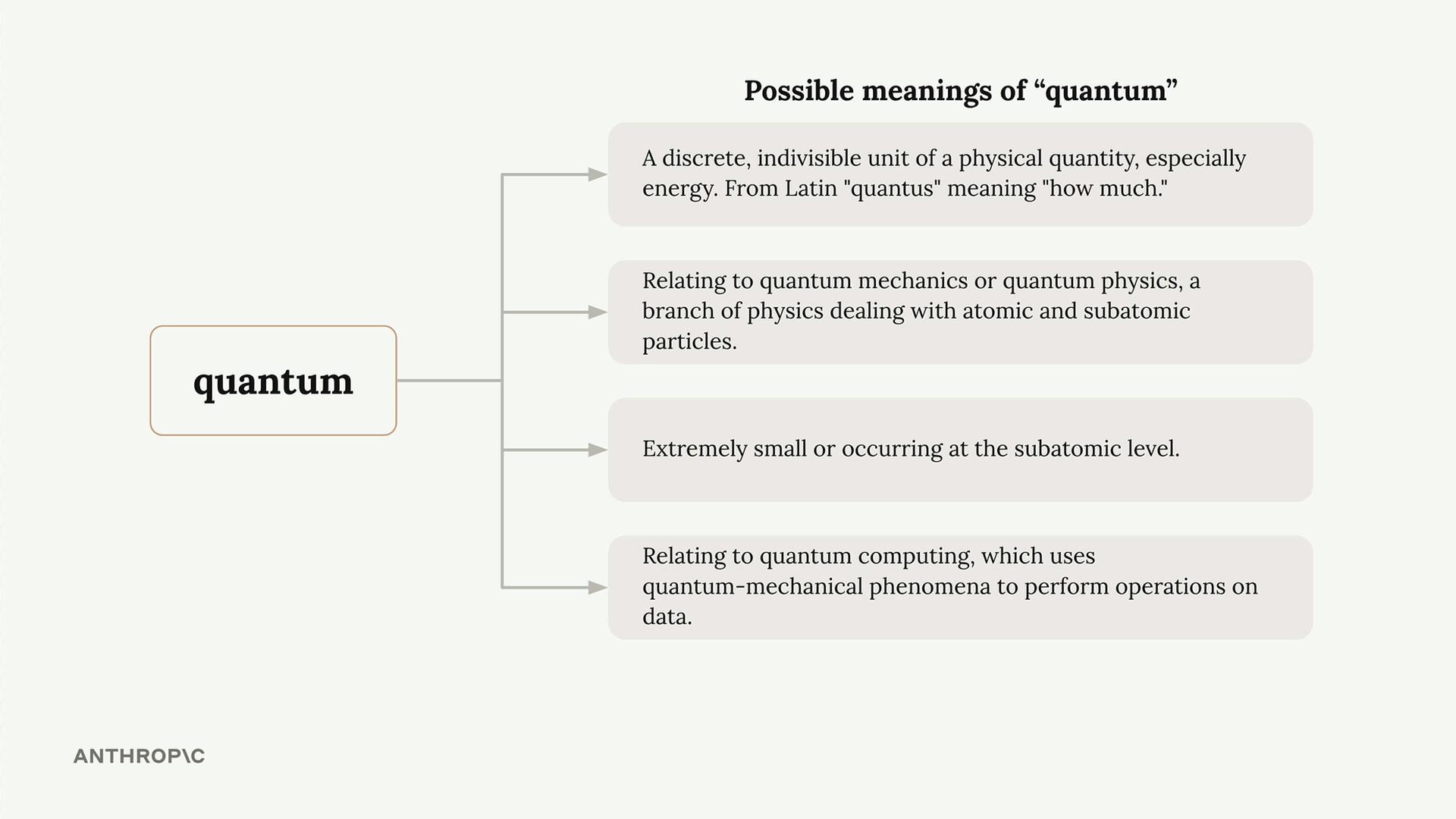

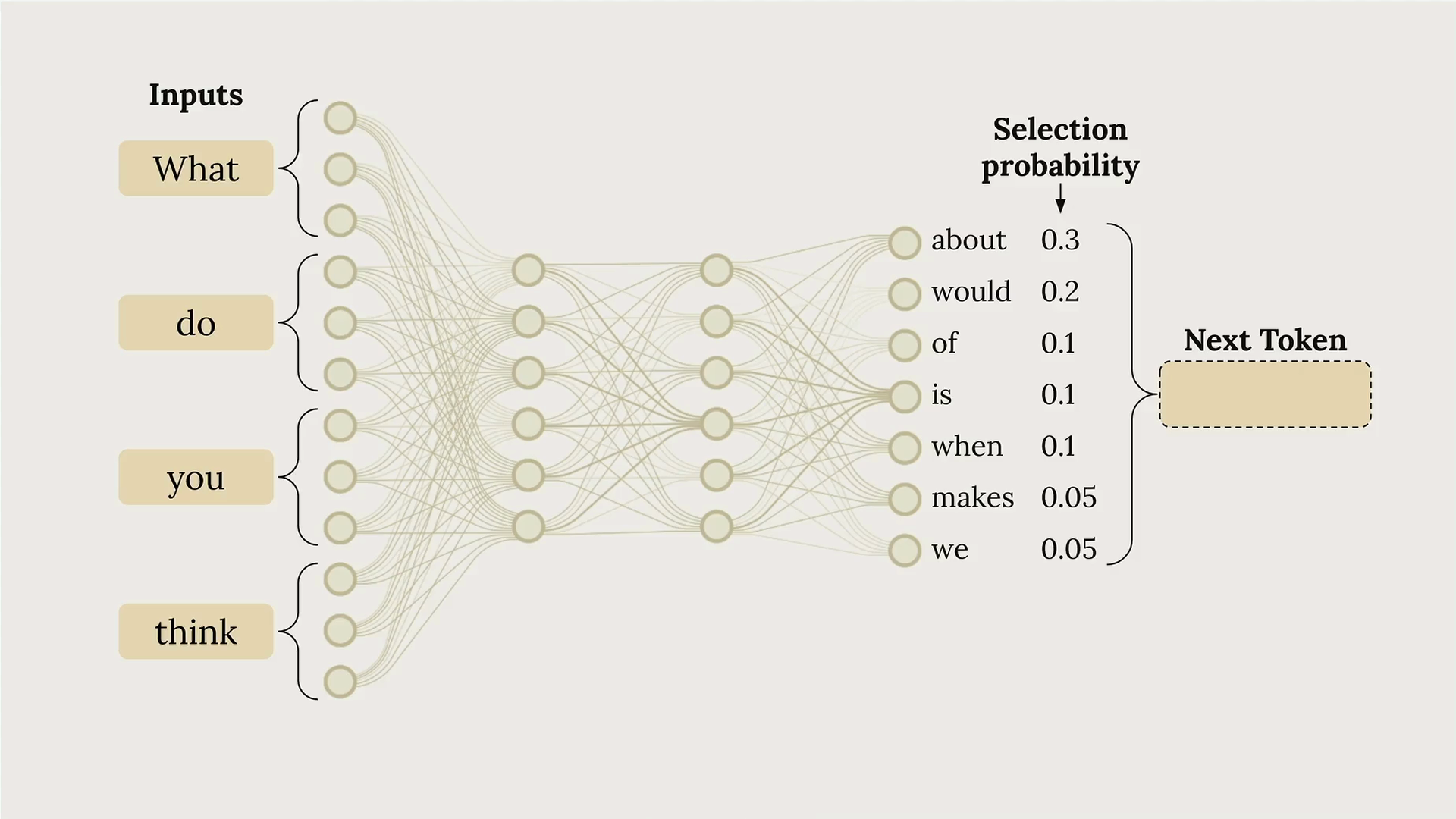

- Tokenization (分词) = 将输入拆分为词元(单词/单词的一部分/符号/空格)。

- Embedding (嵌入) = 将词元转换为代表所有可能词义的数字列表。

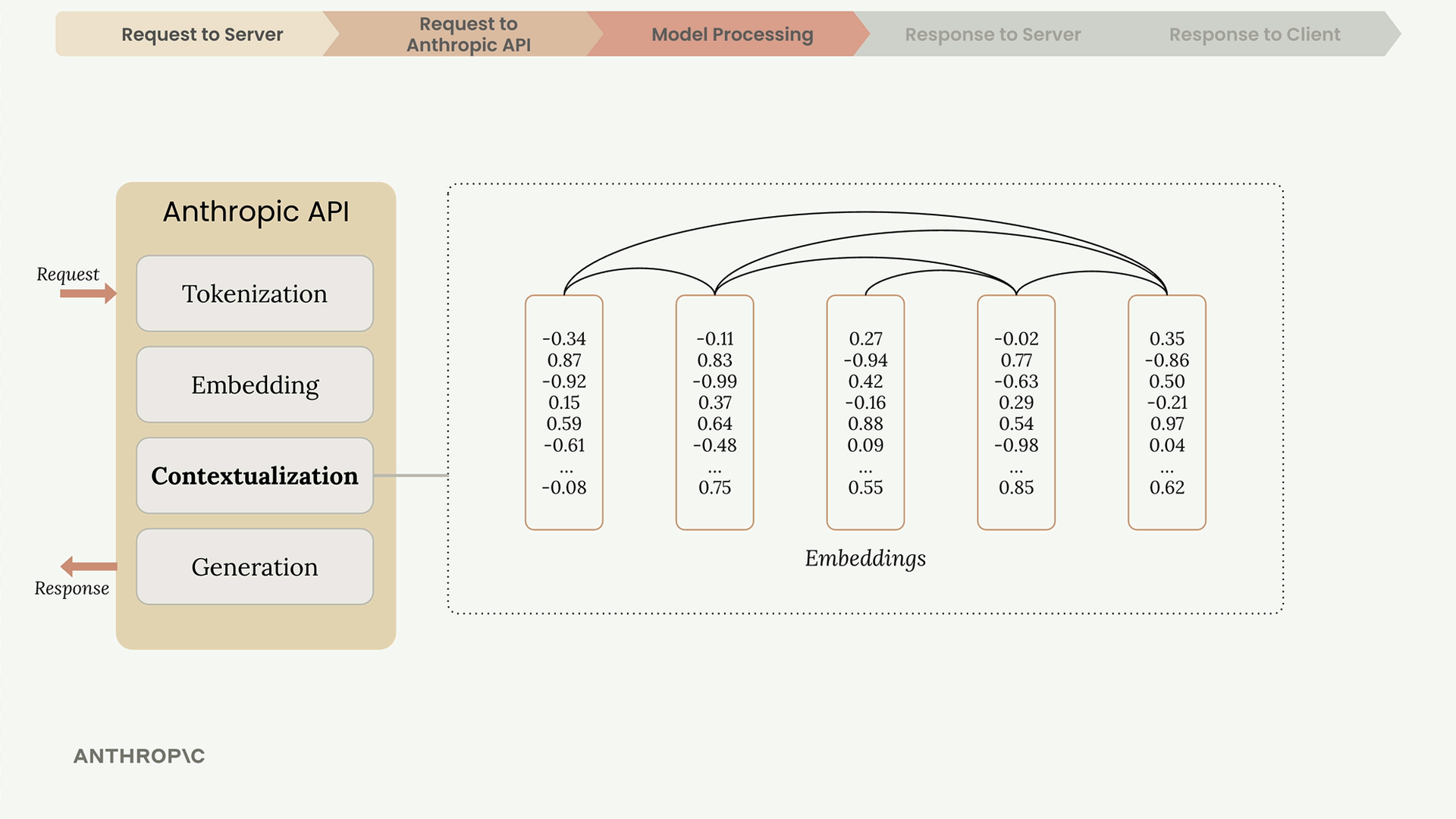

- Contextualization (上下文关联) = 根据相邻词元调整嵌入,以确定精确含义。

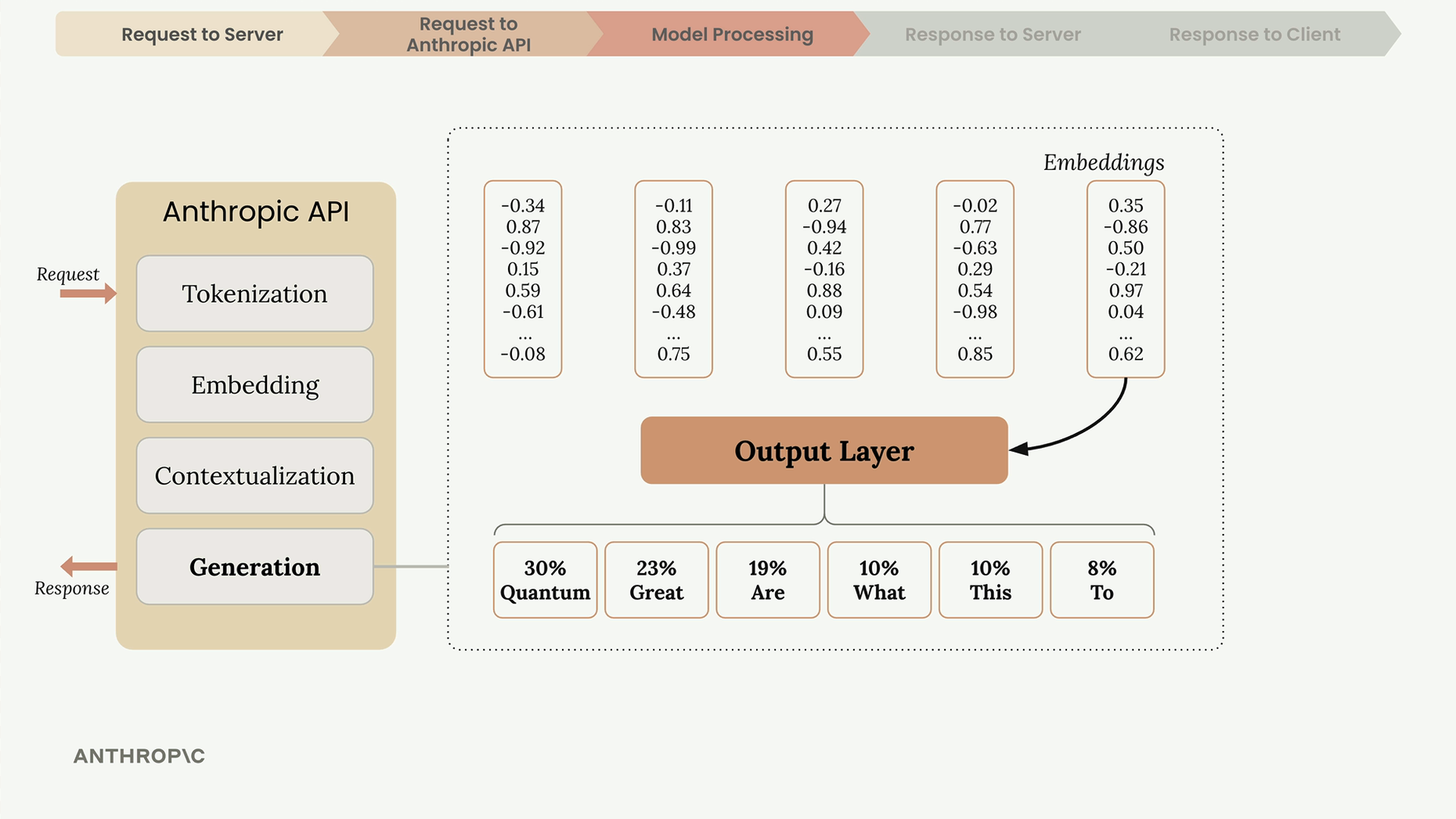

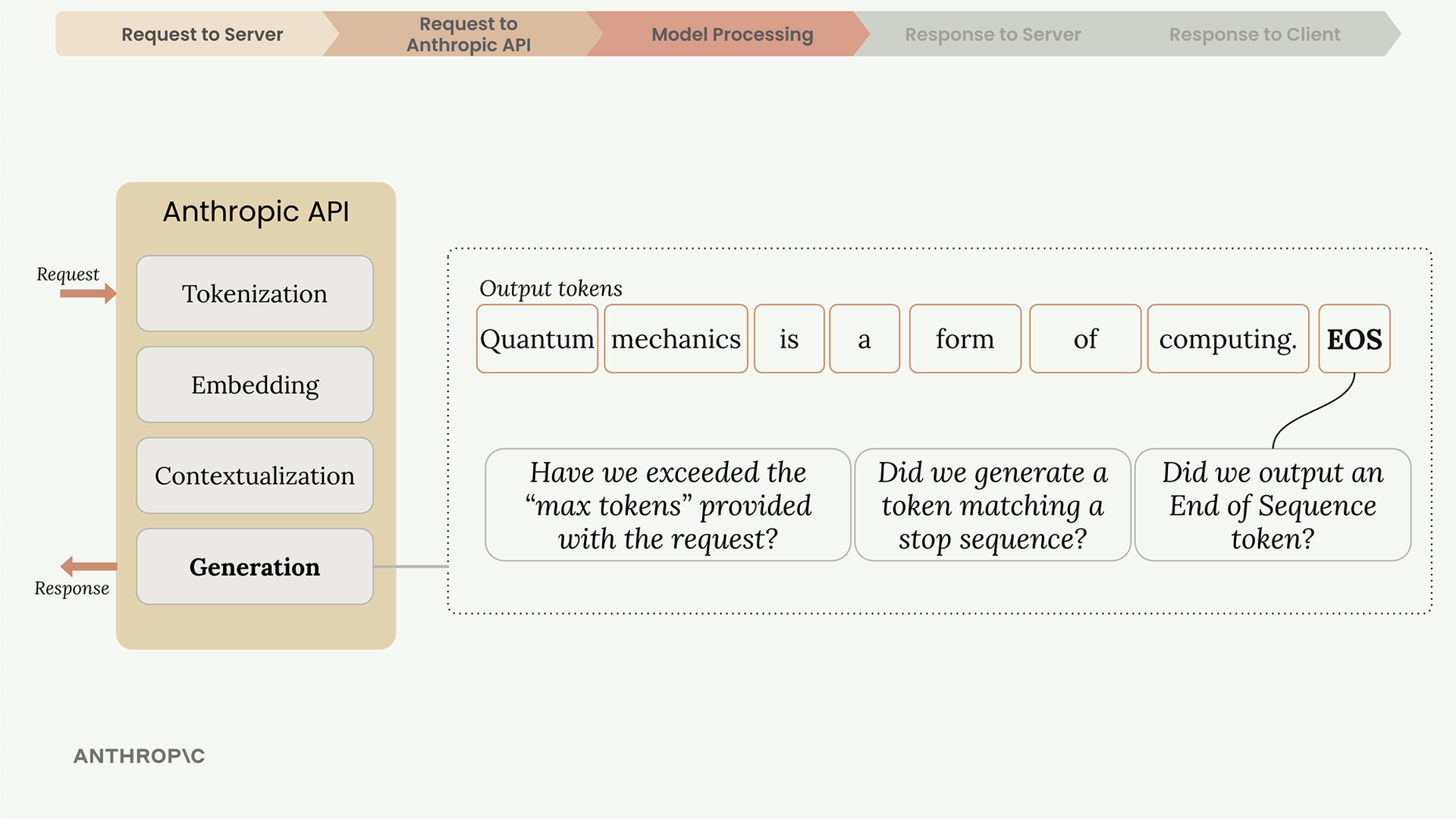

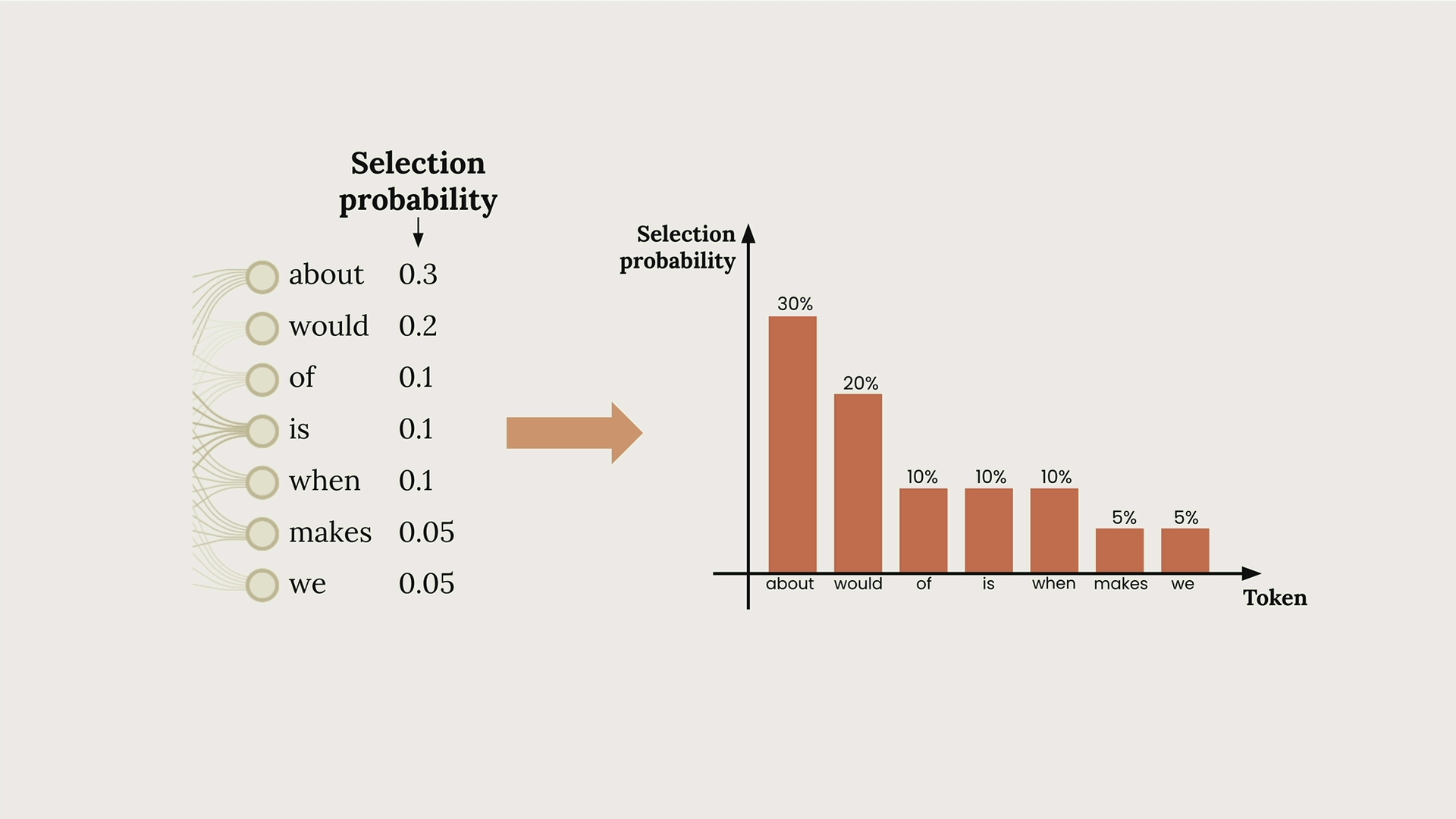

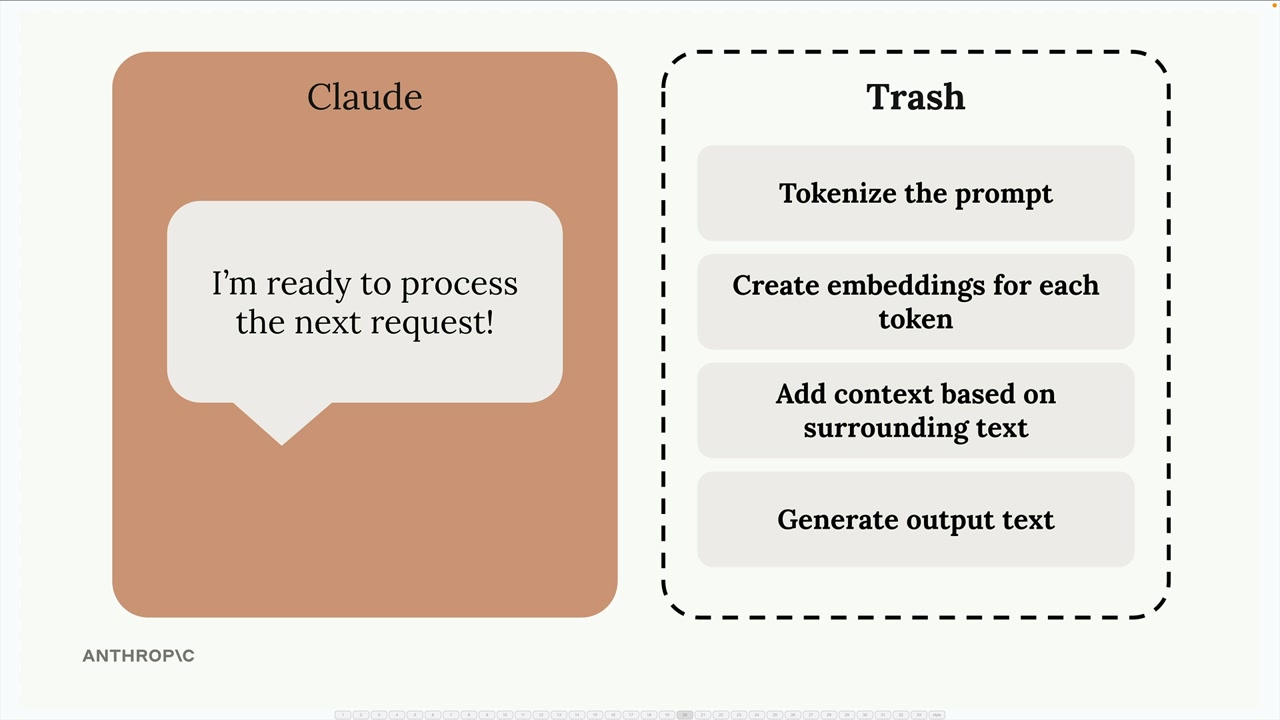

- Generation (生成) = 输出层为下一个词生成概率,模型根据概率 + 随机性进行选择,添加所选词,然后重复此过程。

第 4 步:当达到 max_tokens 或生成特殊的 end_of_sequence token (序列结束标志) 时,模型停止。

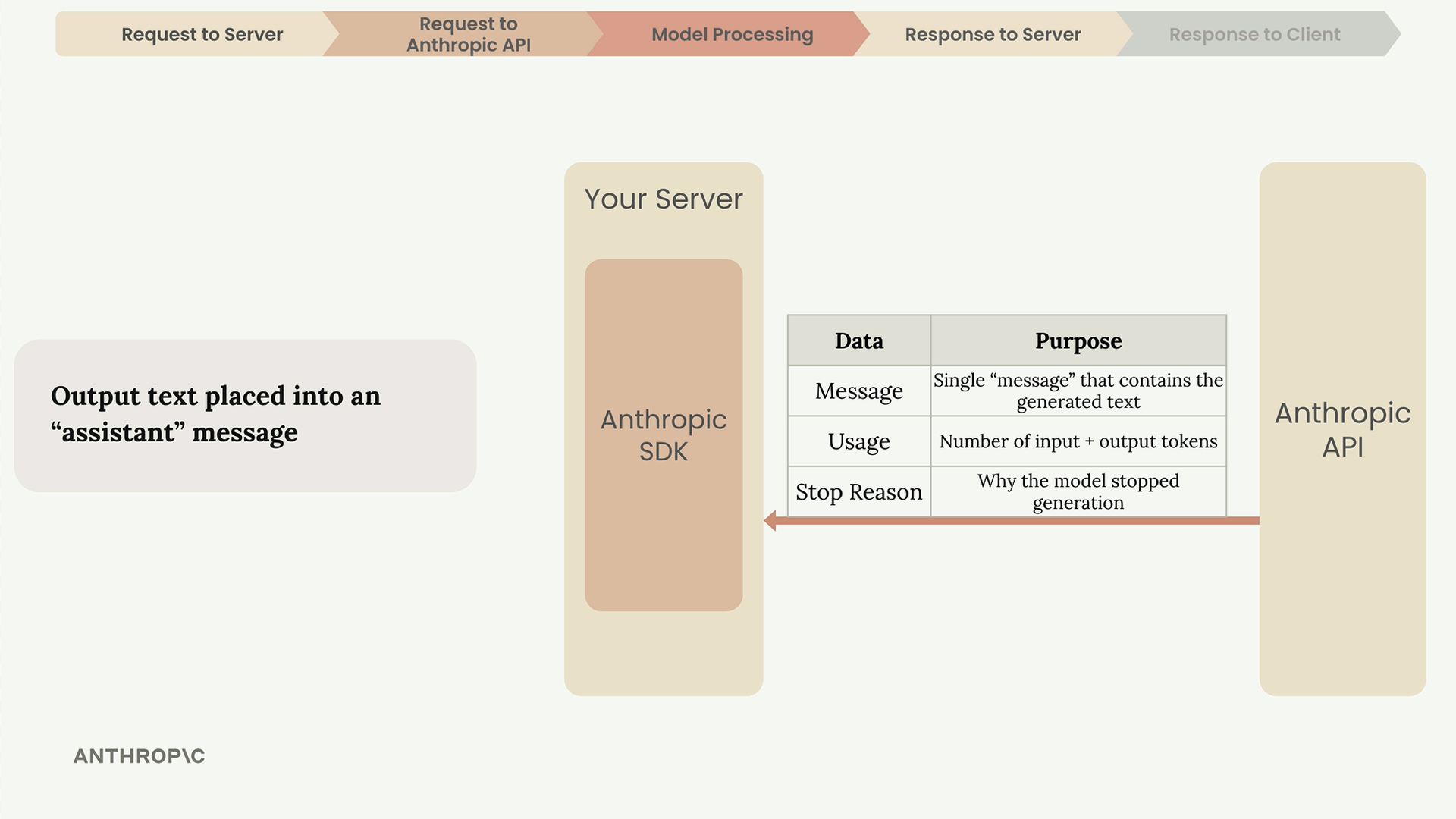

第 5 步:API 将包含生成文本 + 使用量计数 + 停止原因的响应返回给服务器,服务器再将其发送给客户端以供显示。

Token (词元) = 文本块(单词/部分/符号)。 Embedding (嵌入) = 词义的数值表示。 Contextualization (上下文关联) = 使用相邻词语进行意义提炼。 Max_tokens (最大生成词元数) = 生成长度的限制。 Stop_reason (停止原因) = 模型停止生成的原因。

发起请求

向 Anthropic 发起 API 请求 = 该过程涉及 4 个设置步骤并需理解消息结构。

设置步骤:

- 安装包 = 在 Jupyter notebook 中运行

pip install anthropic python-dotenv。 - 存储 API 密钥 = 创建一个包含

ANTHROPIC_API_KEY="your_key"的.env文件(并在版本控制中忽略它)。 - 加载环境变量 = 使用

python-dotenv安全地加载 API 密钥。 - 创建客户端 = 初始化 Anthropic 客户端并定义模型变量(

claude-3-sonnet)。

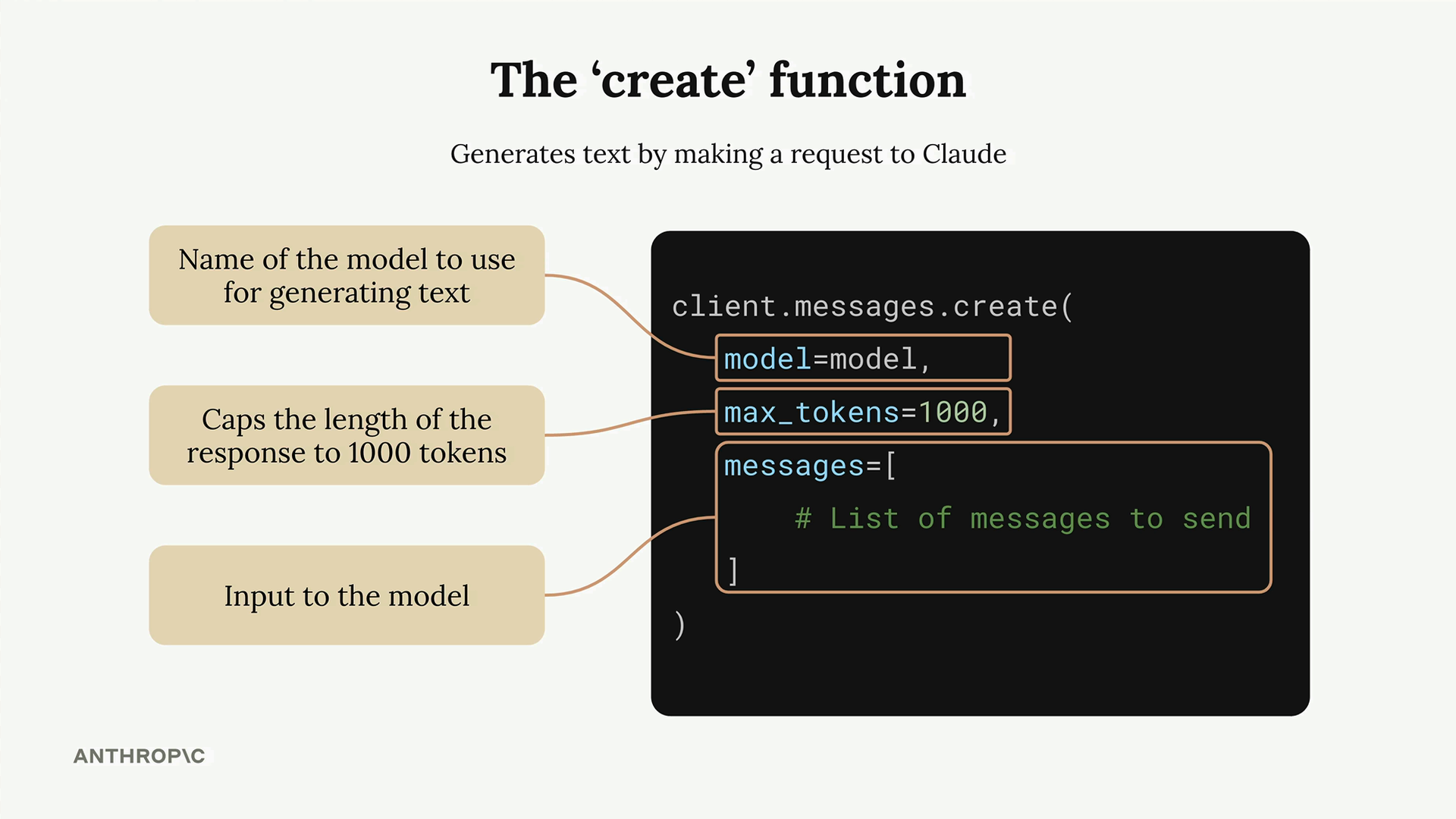

API 请求结构:

- 函数 =

client.messages.create() - 必需参数 =

model、max_tokens、messages - Model (模型) = 要使用的 Claude 模型名称。

- Max_tokens (最大生成词元数) = 用于生成长度的安全限制(不是目标长度)。

- Messages (消息) = 包含对话交流的列表。

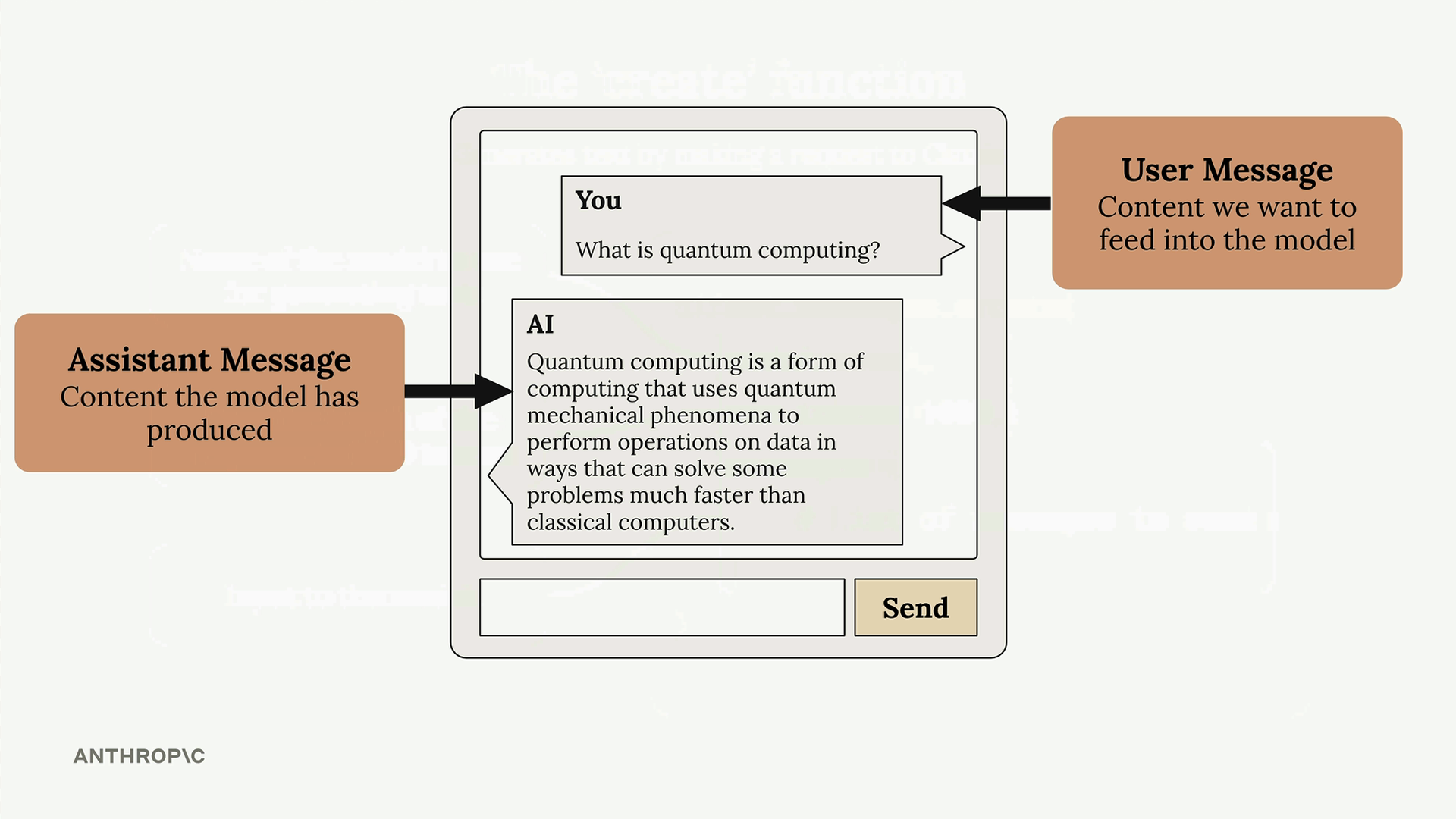

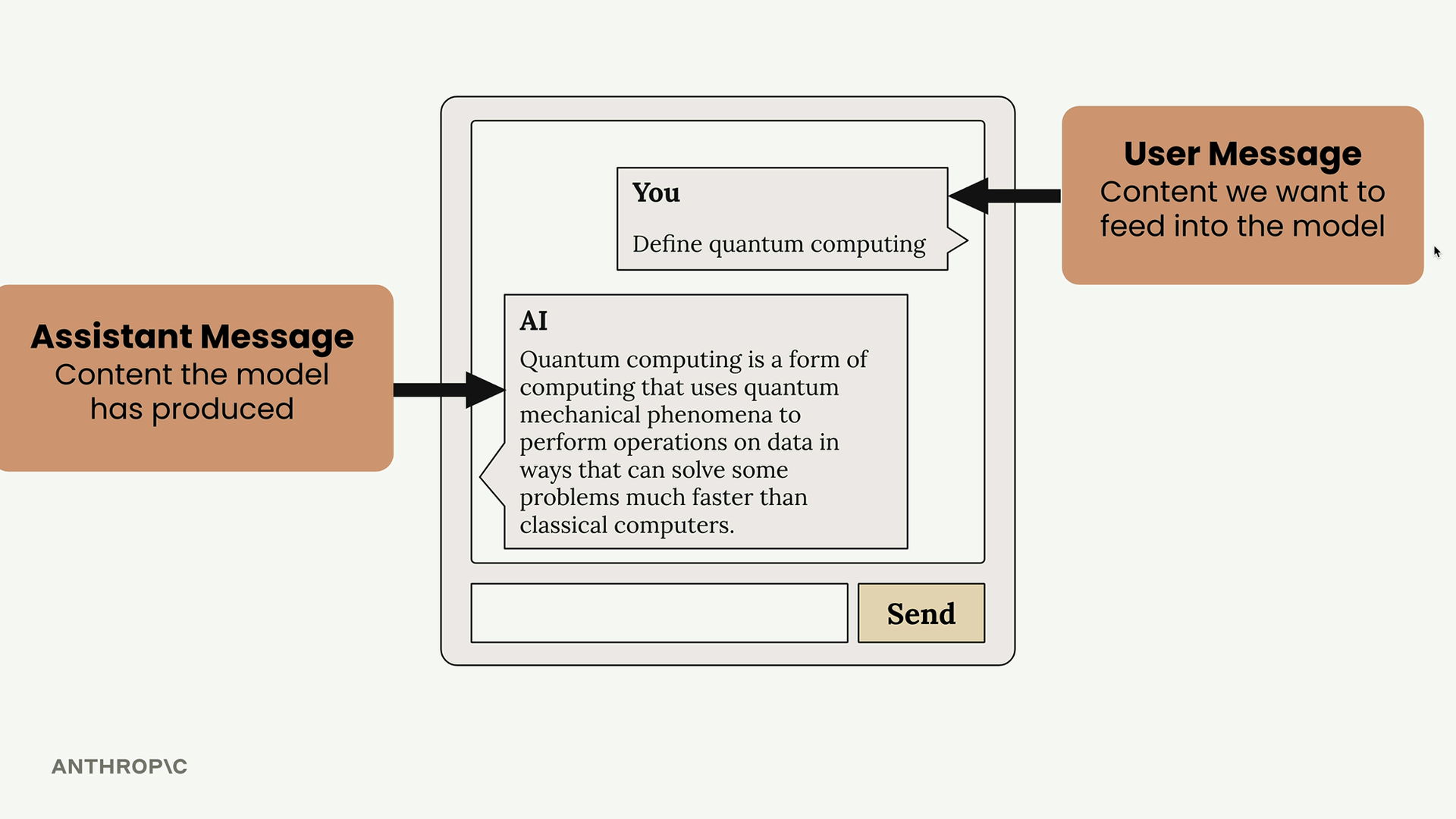

消息类型:

- 用户消息 =

{"role": "user", "content": "your text"}(人类创作的内容)。 - 助手消息 = 包含模型生成的响应。

响应访问:

- 完整响应 = 包含元数据和嵌套结构。

- 纯文本 =

message.content[0].text仅提取生成的文本。

请求示例结构:client.messages.create(model=model, max_tokens=1000, messages=[{"role": "user", "content": "What is quantum computing?"}])

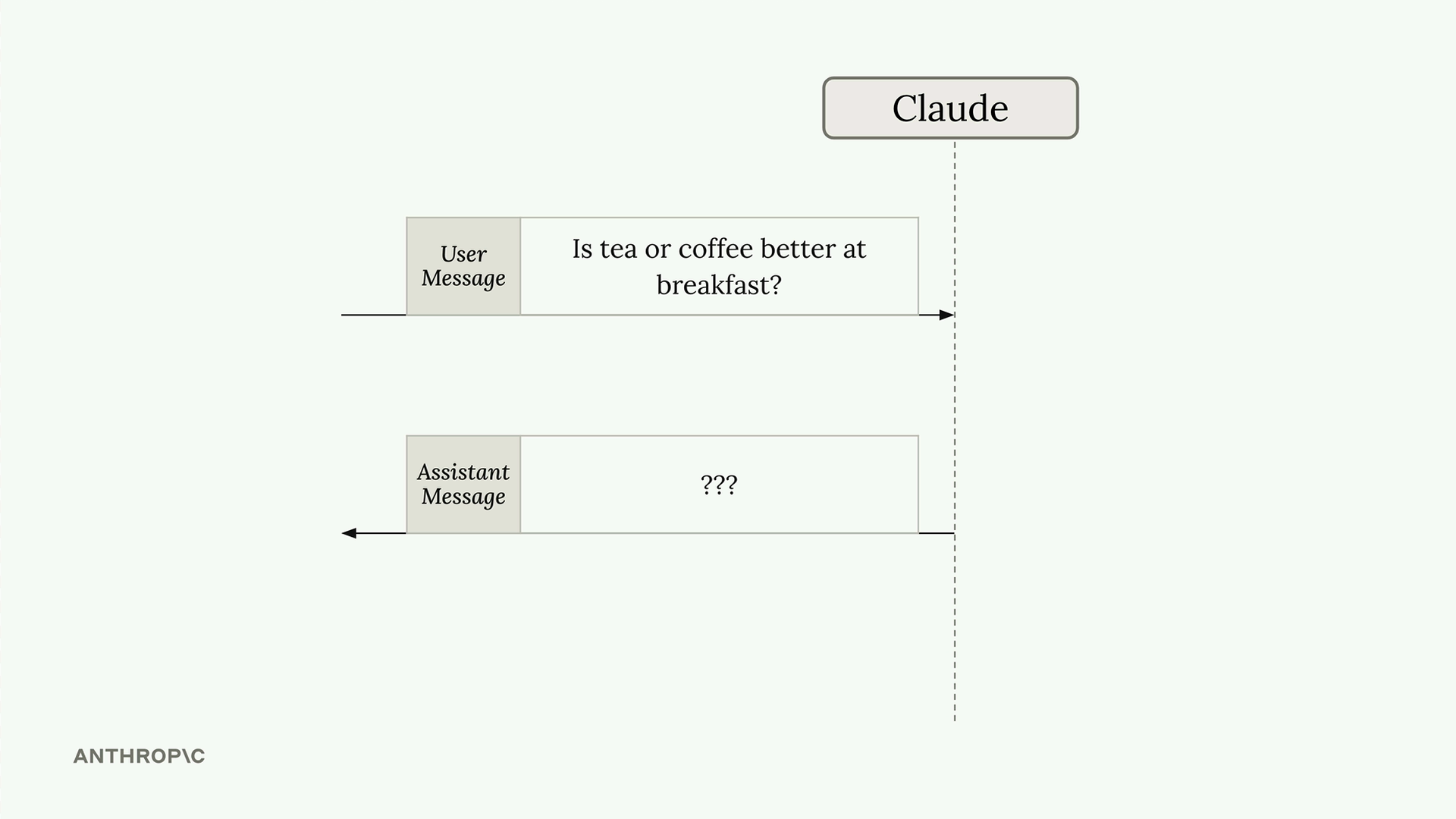

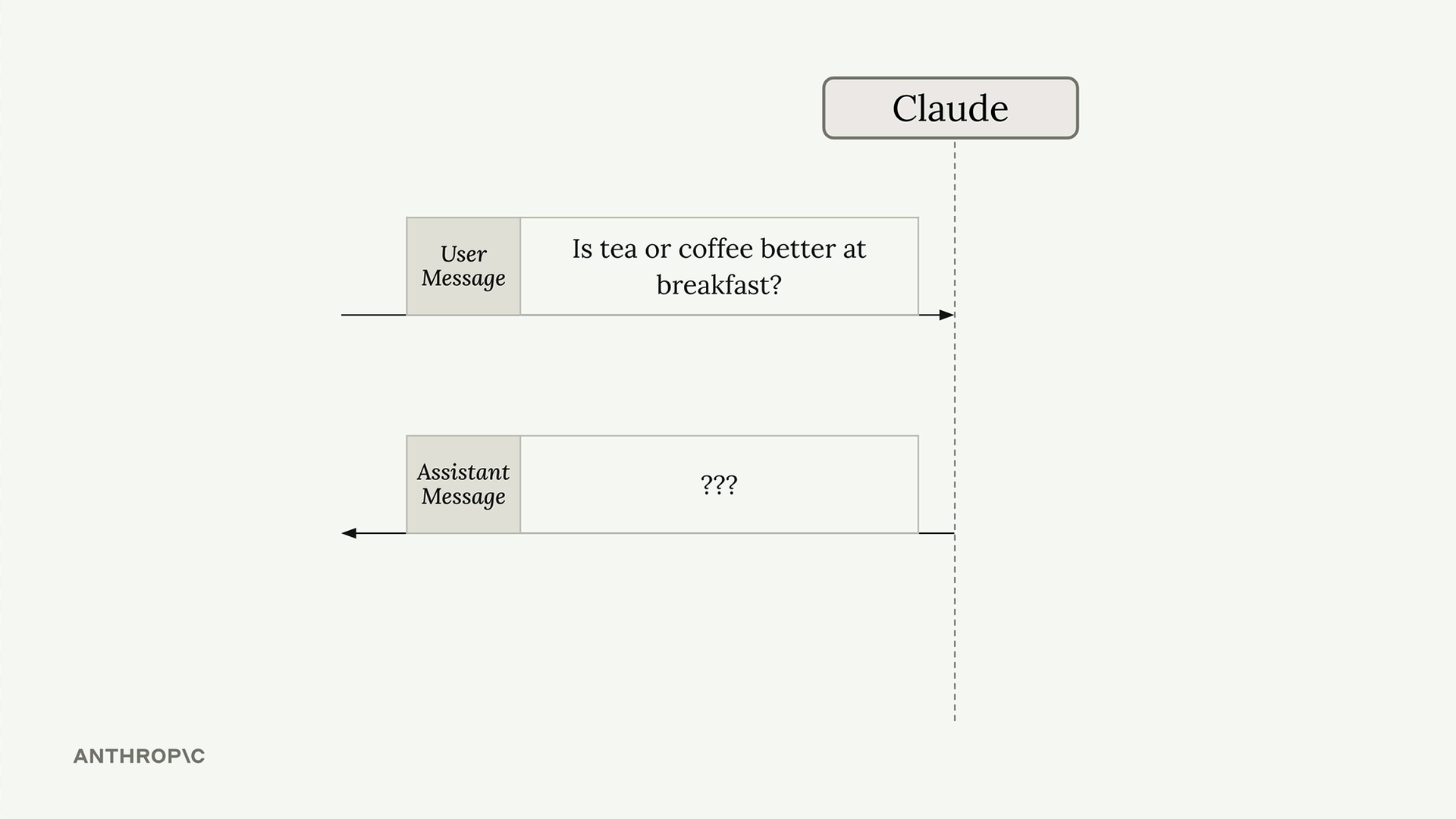

多轮对话

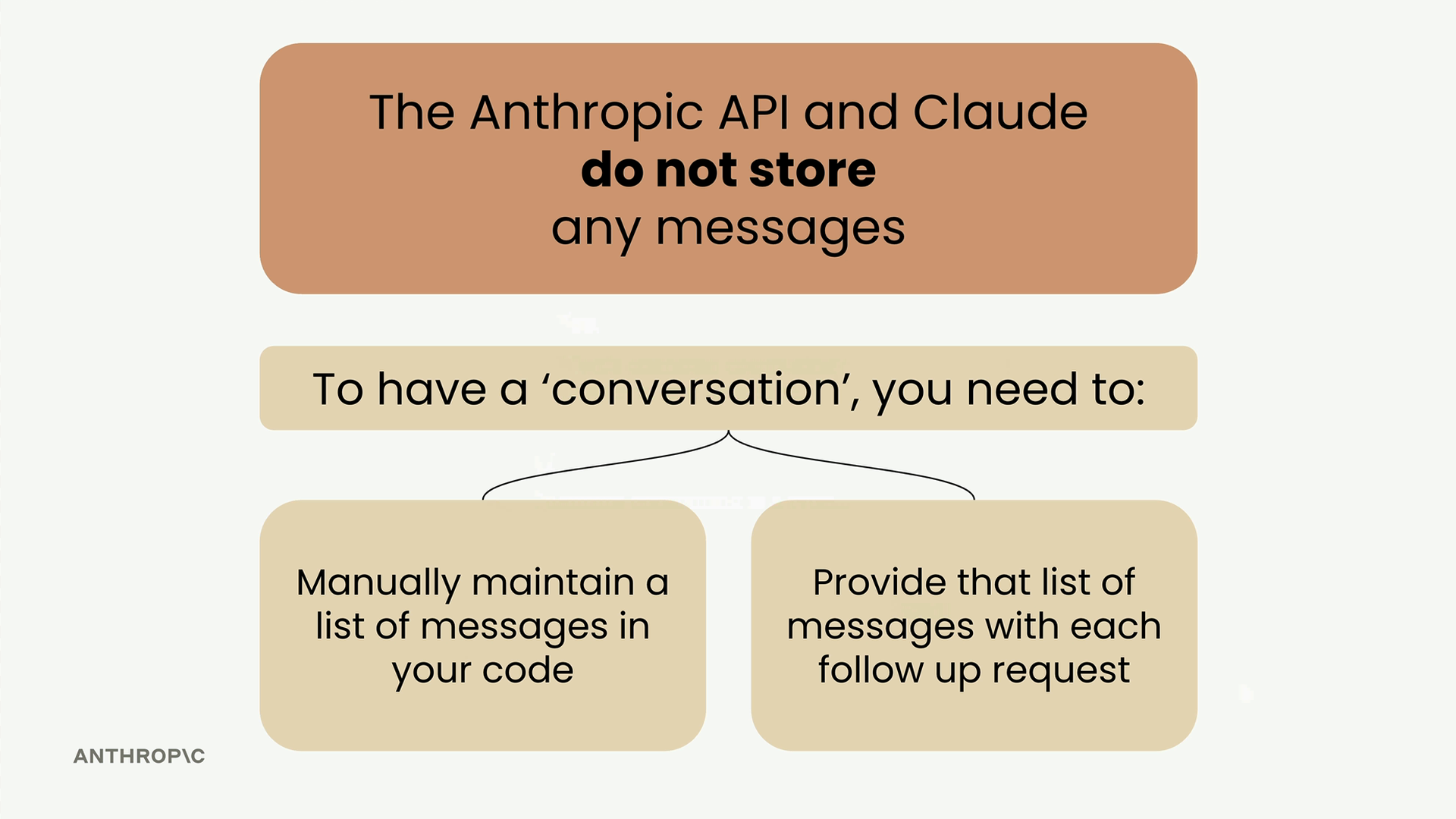

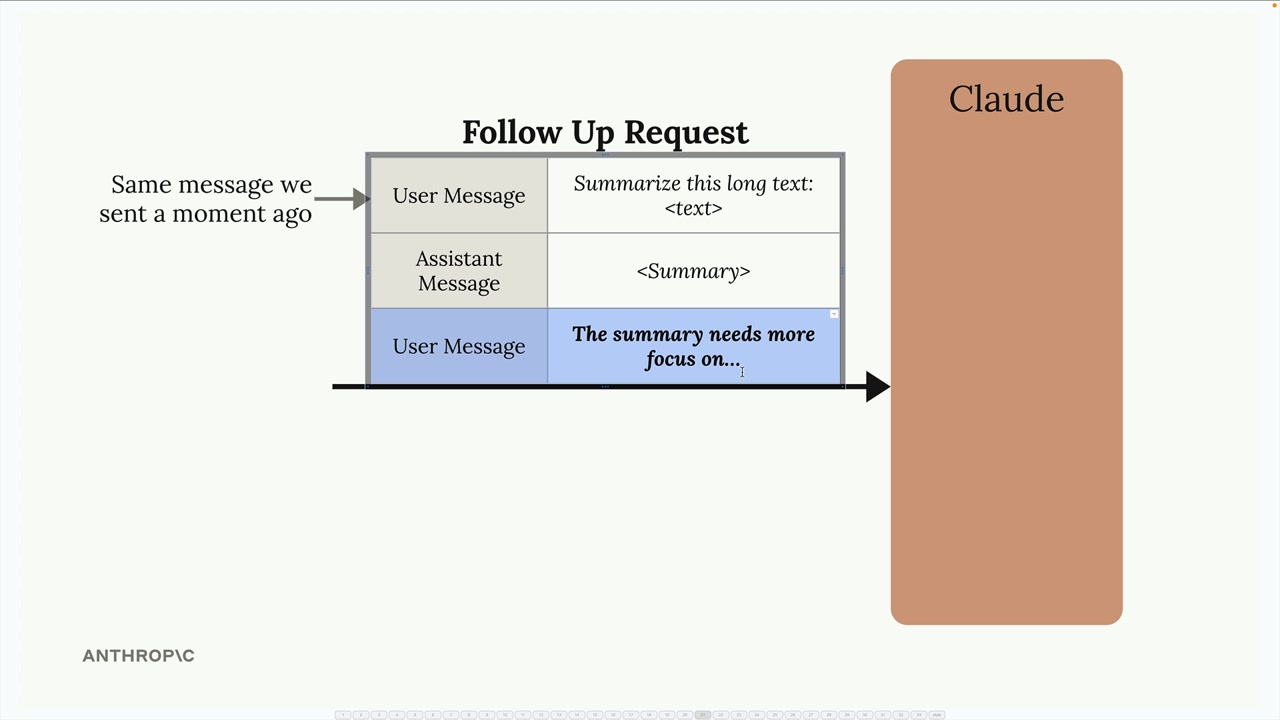

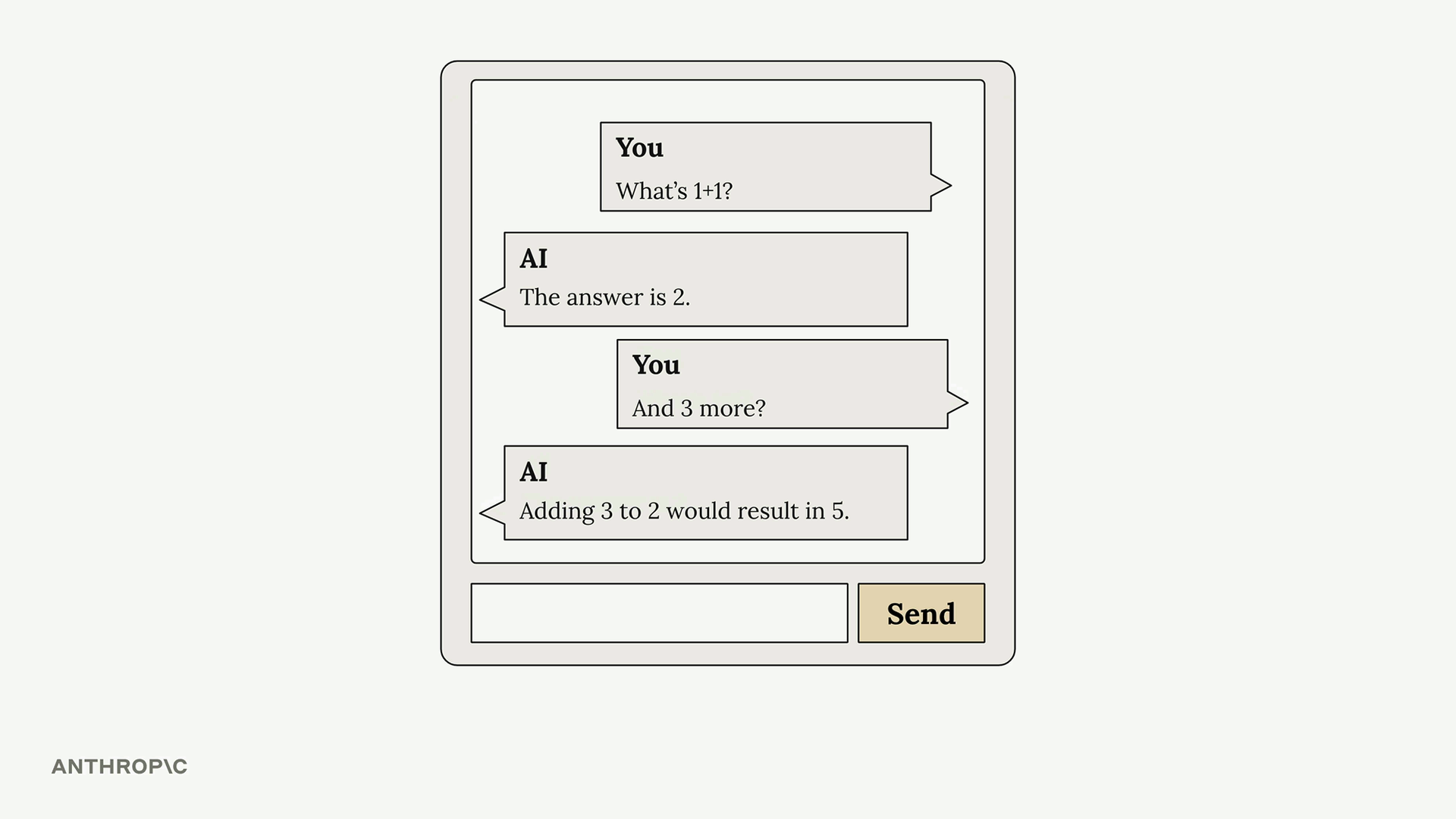

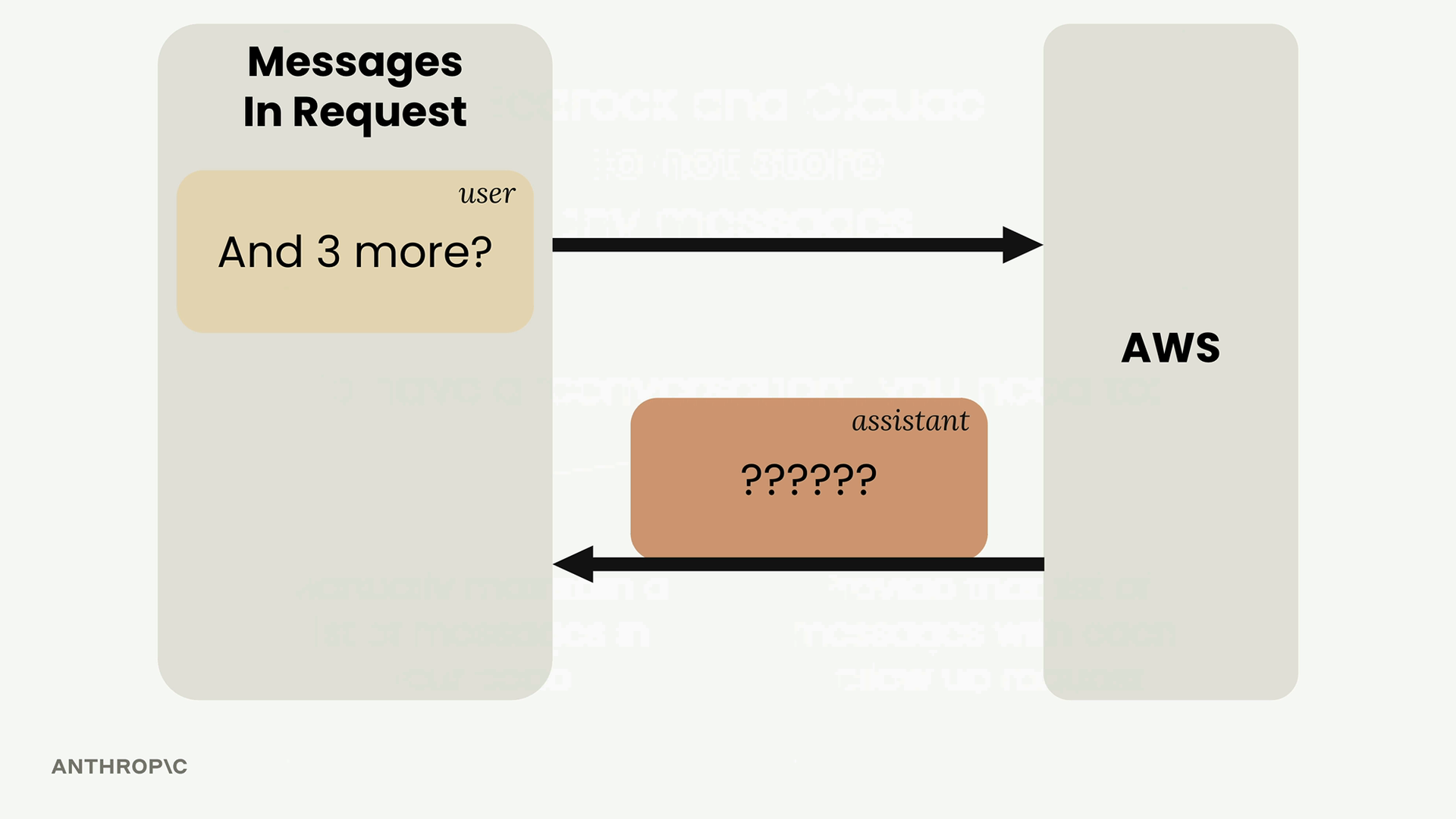

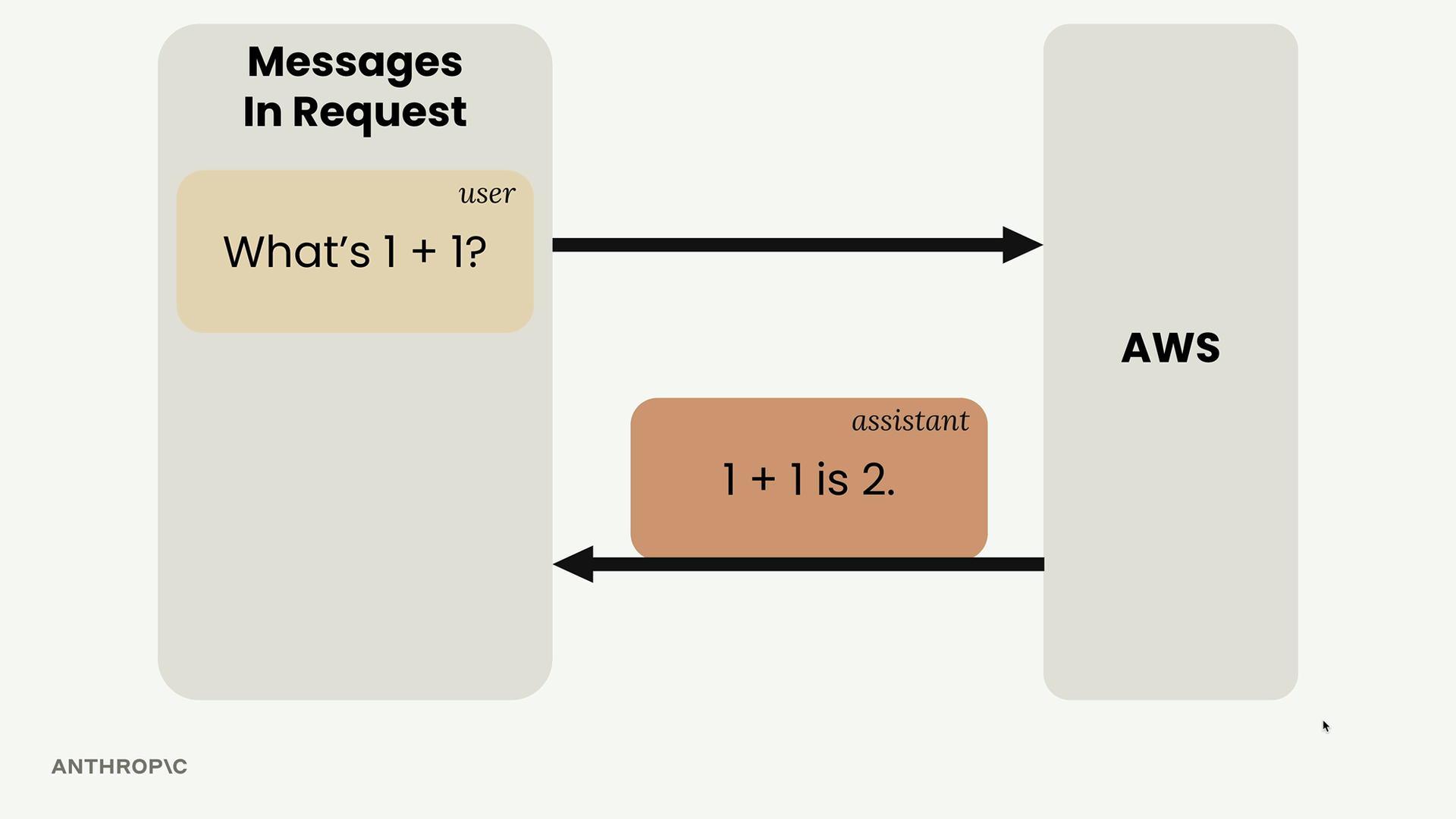

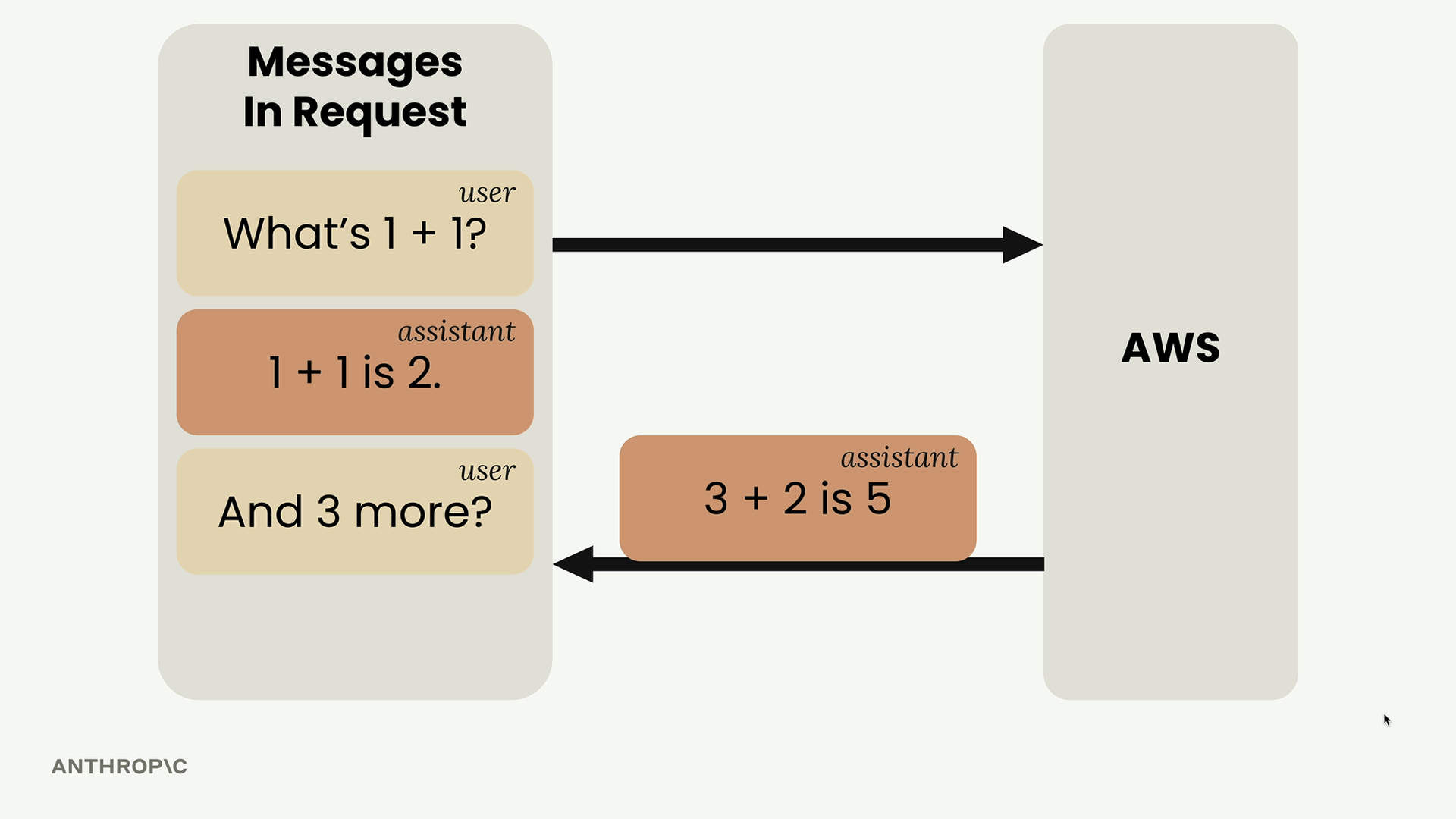

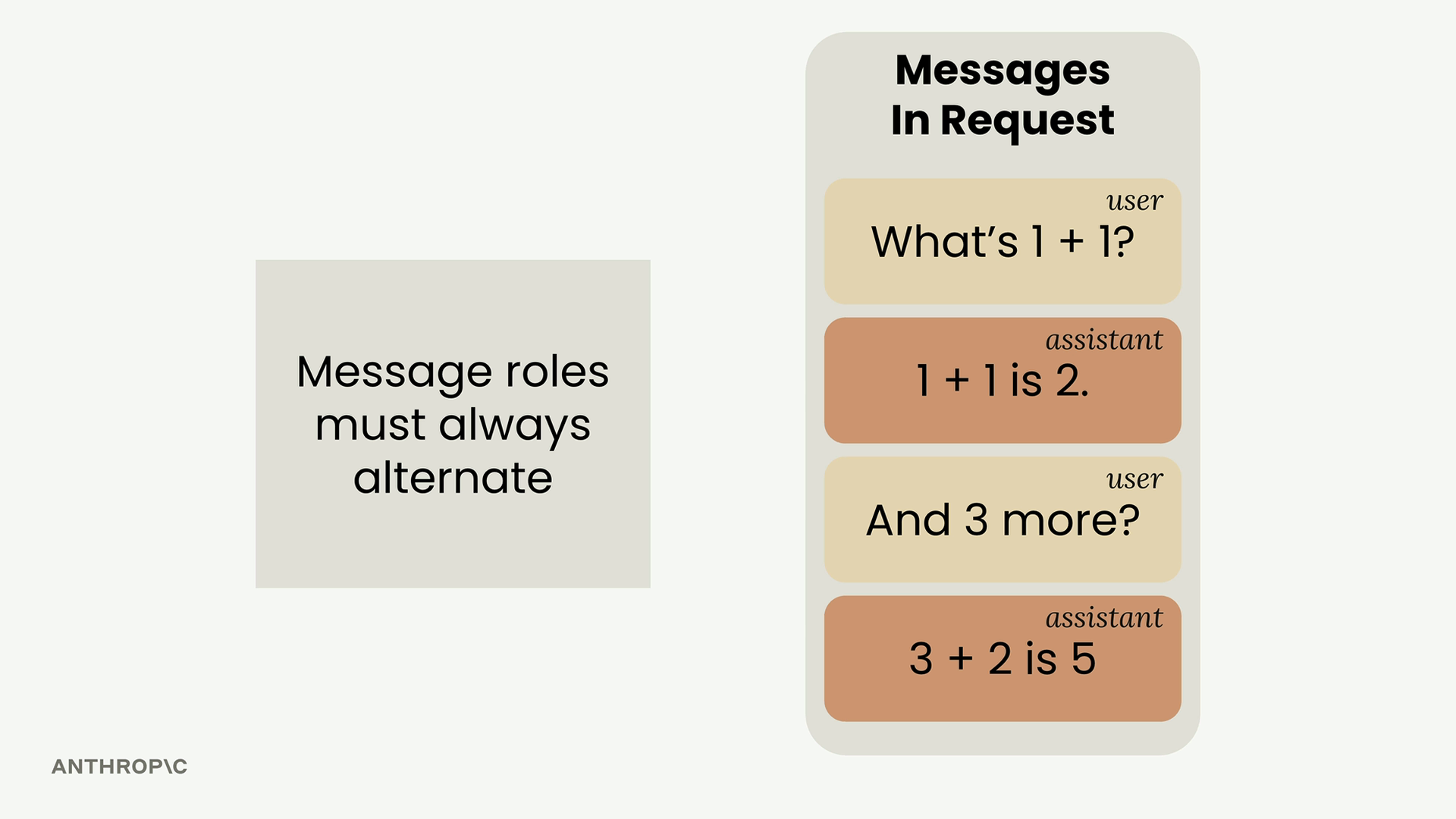

Multi-Turn Conversations (多轮对话) = 包含多次来回交流并保持上下文的对话。

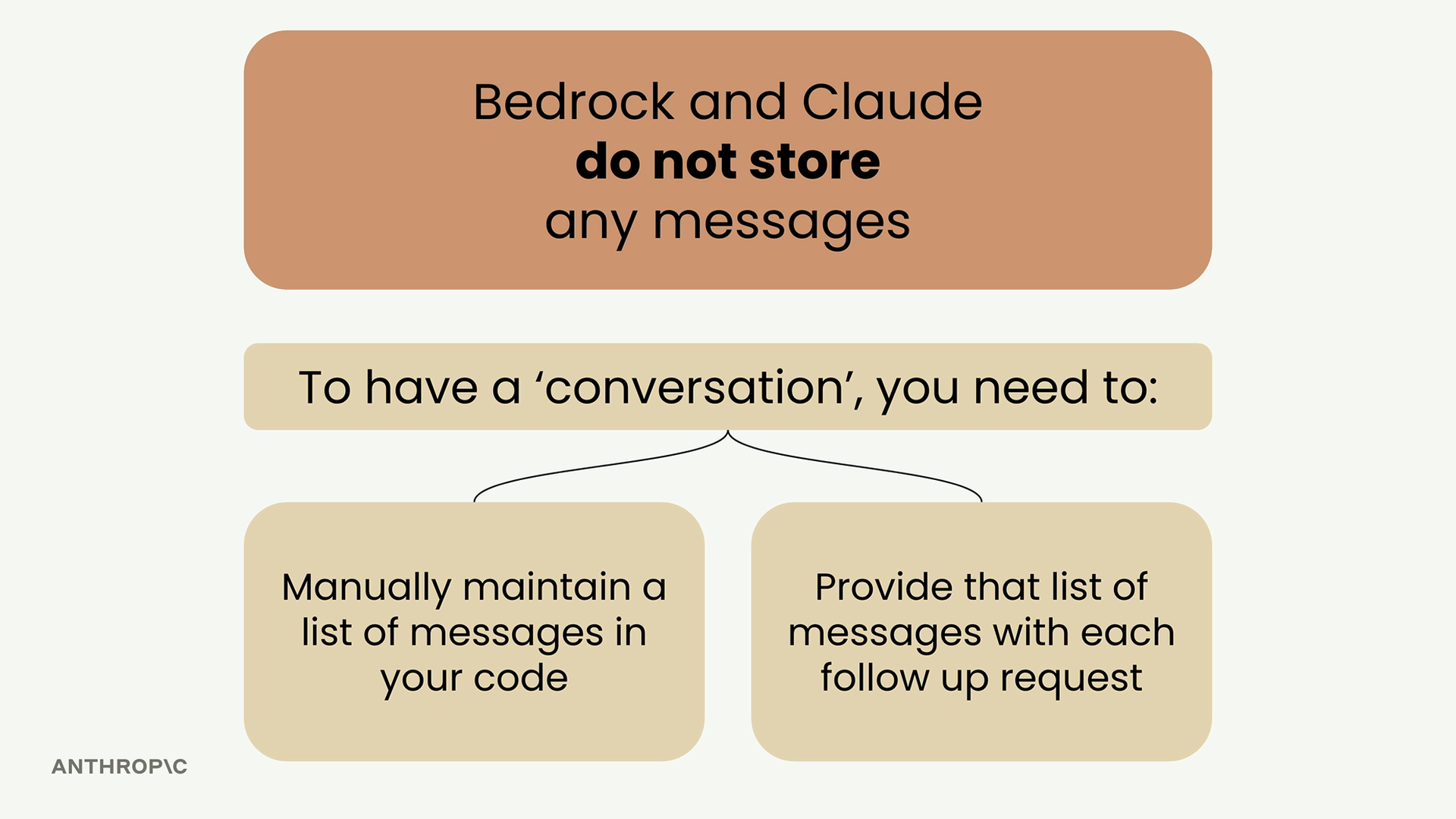

关键限制:Anthropic API 不存储任何消息。每个请求都是独立的,没有先前交流的记忆。

解决方案需要两步:

- 在代码中手动维护消息列表。

- 在每次后续请求中发送完整的对话历史。

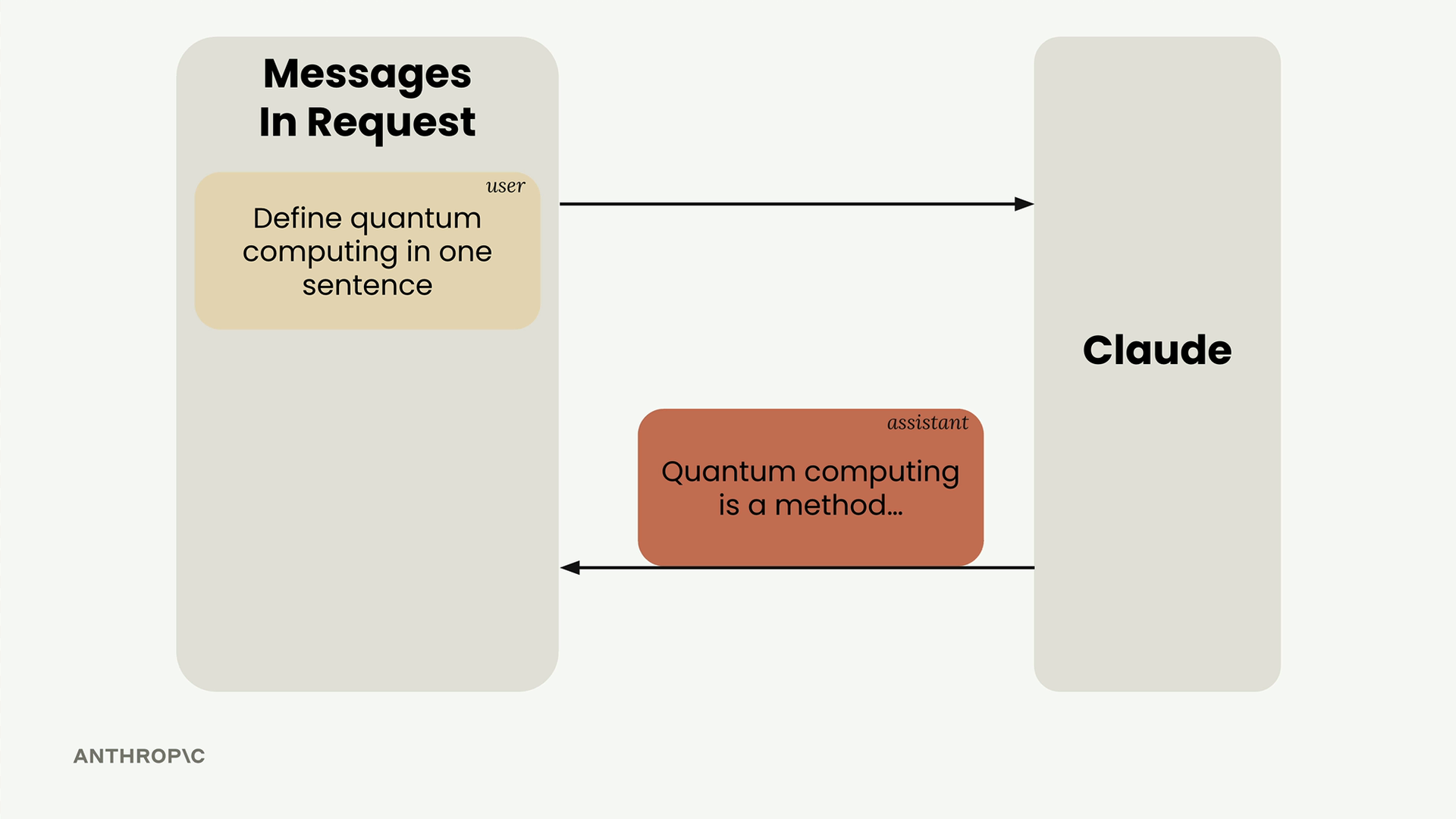

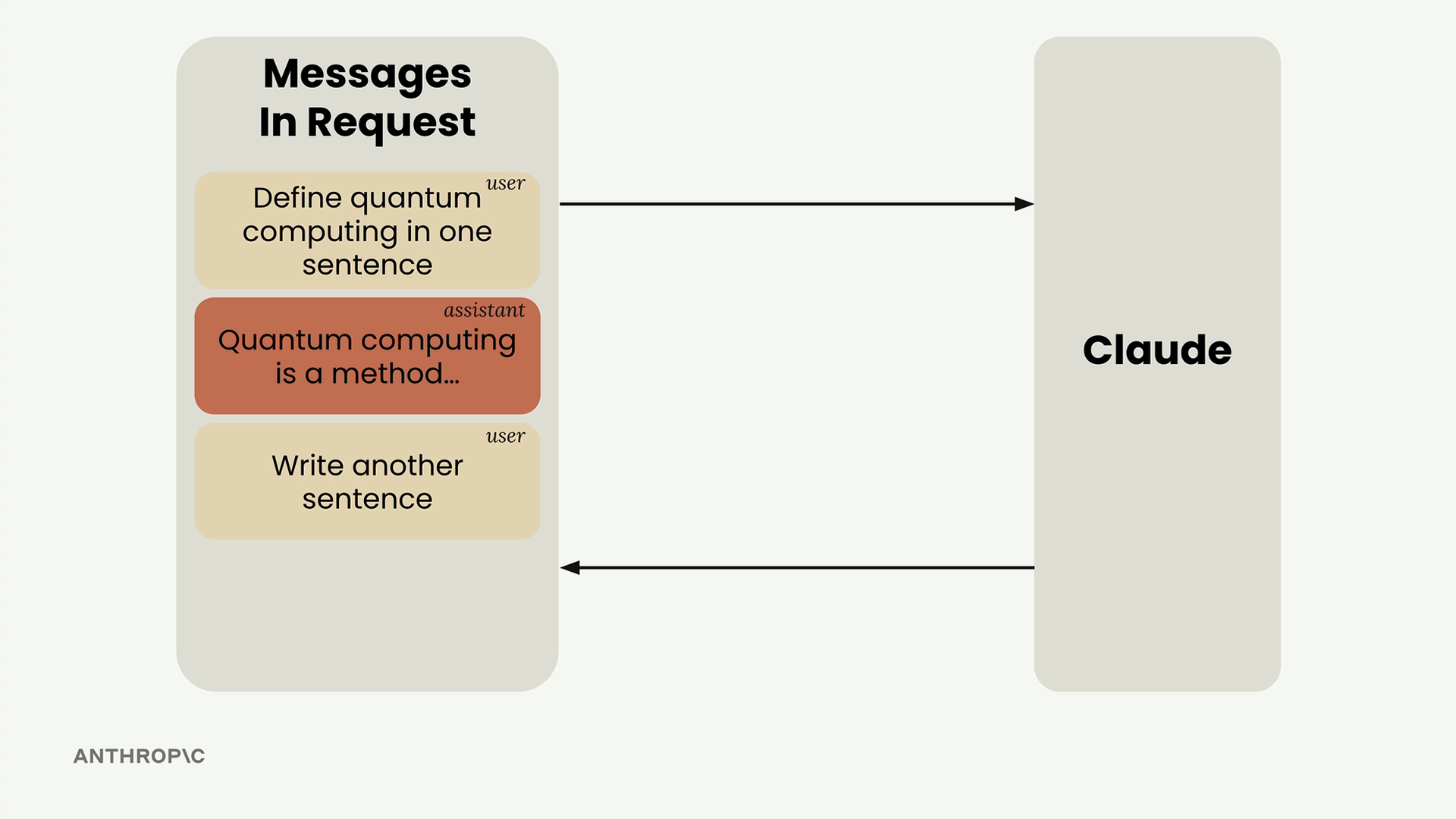

消息结构 = 一个由字典组成的列表,每个字典包含 role (角色,user/assistant) 和 content (内容) 字段。

对话流程:

- 发送初始用户消息。

- 接收助手响应。

- 将助手响应附加到消息历史中。

- 将新的用户消息添加到历史中。

- 发送完整的历史记录以进行有上下文感知的后续交流。

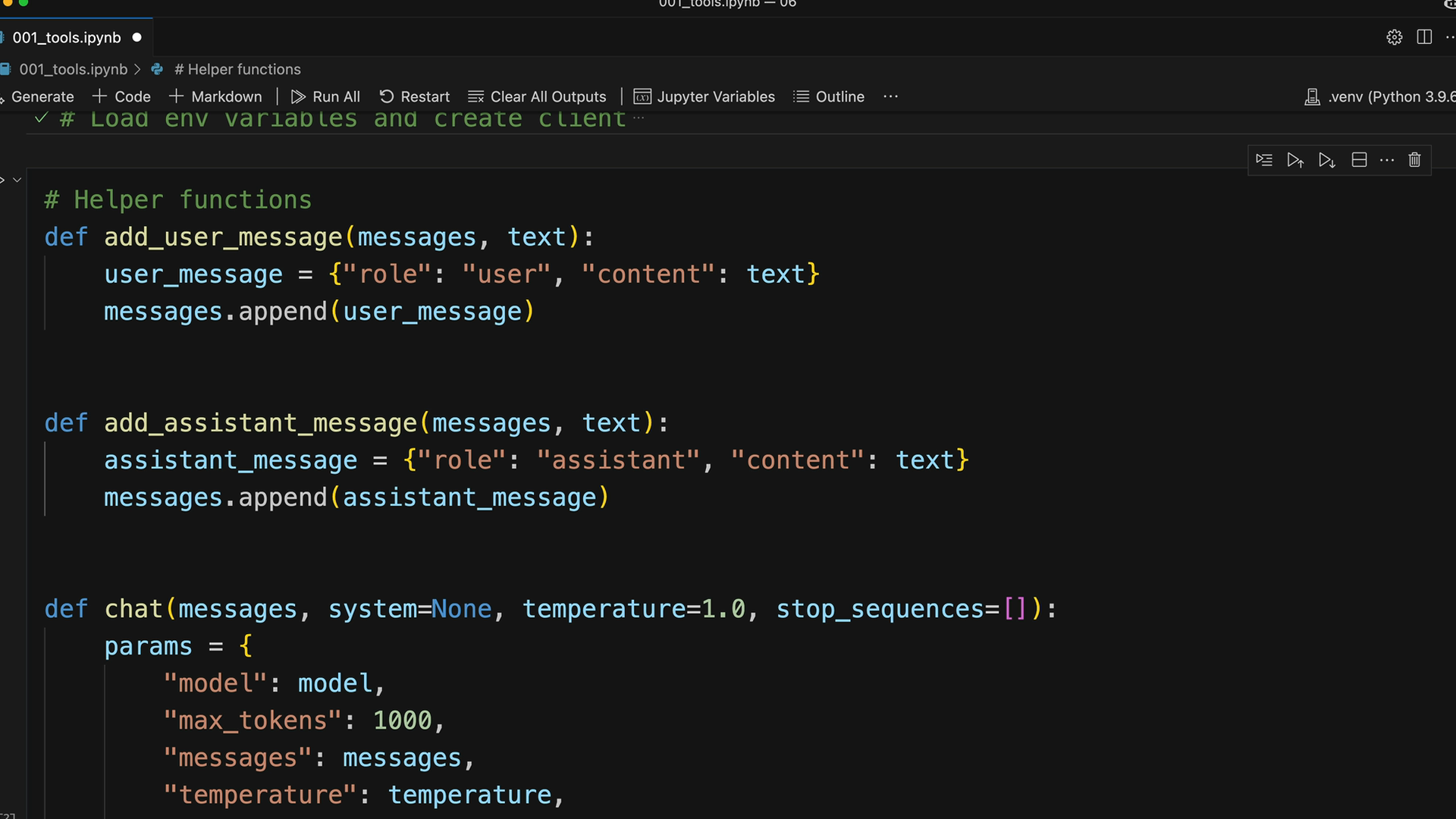

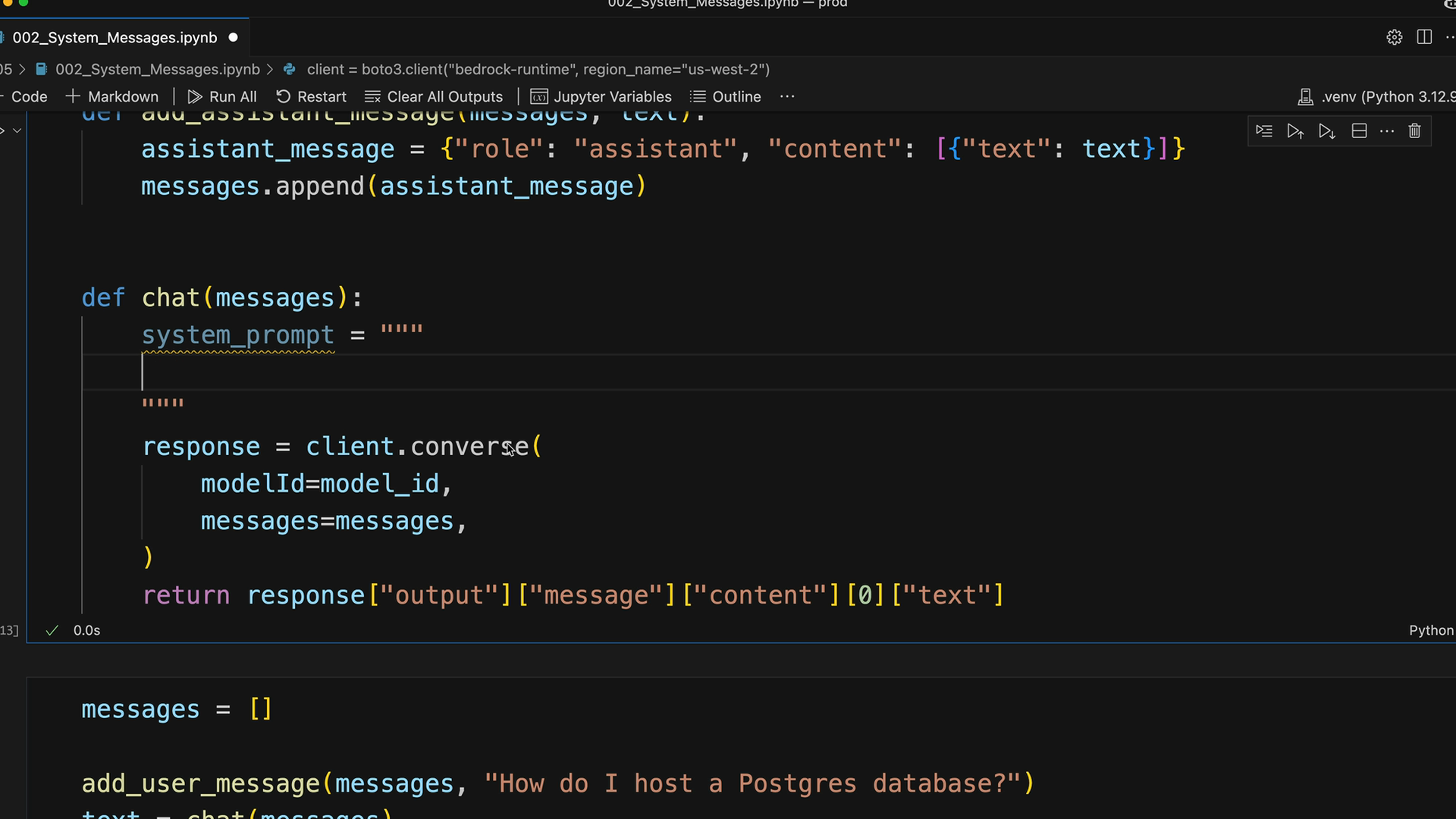

需要辅助函数:

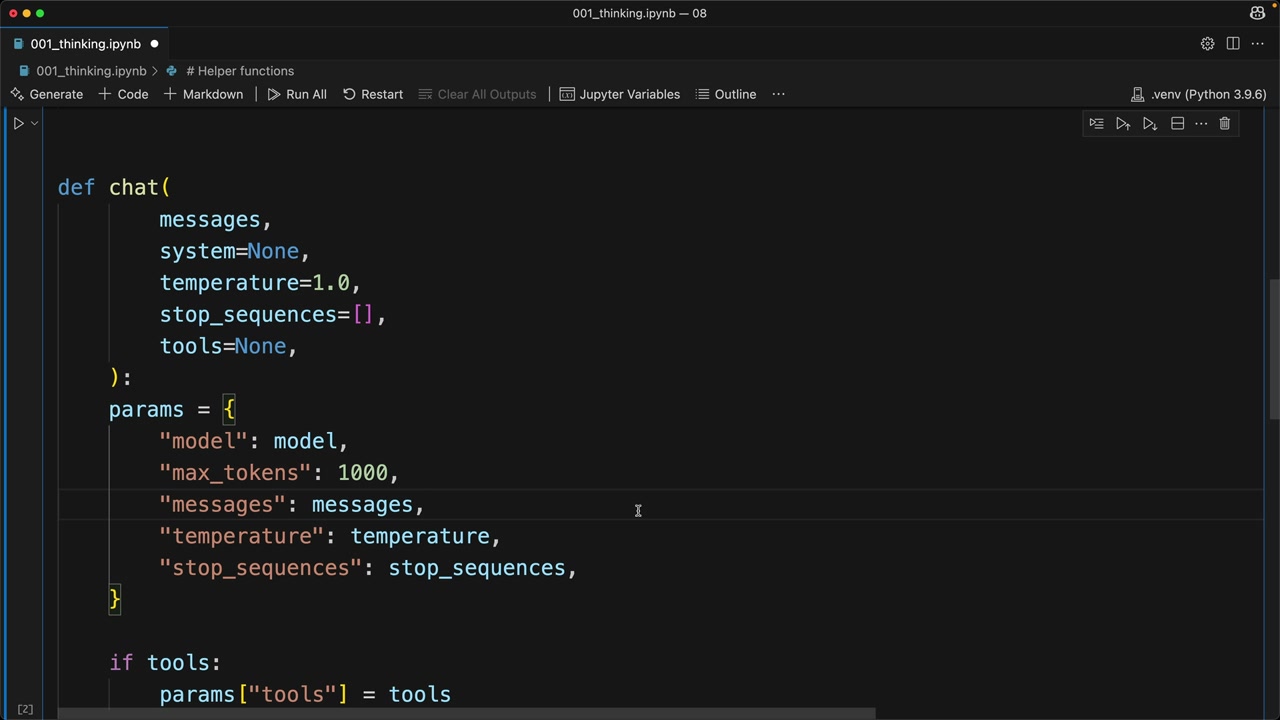

add_user_message(messages, text)= 将用户消息附加到历史记录中。add_assistant_message(messages, text)= 将助手响应附加到历史记录中。chat(messages)= 将消息历史发送到 API 并返回响应。

没有消息历史 = 响应缺乏上下文和连续性。拥有完整的历史记录 = Claude 能维持对话上下文并提供相关的后续答复。

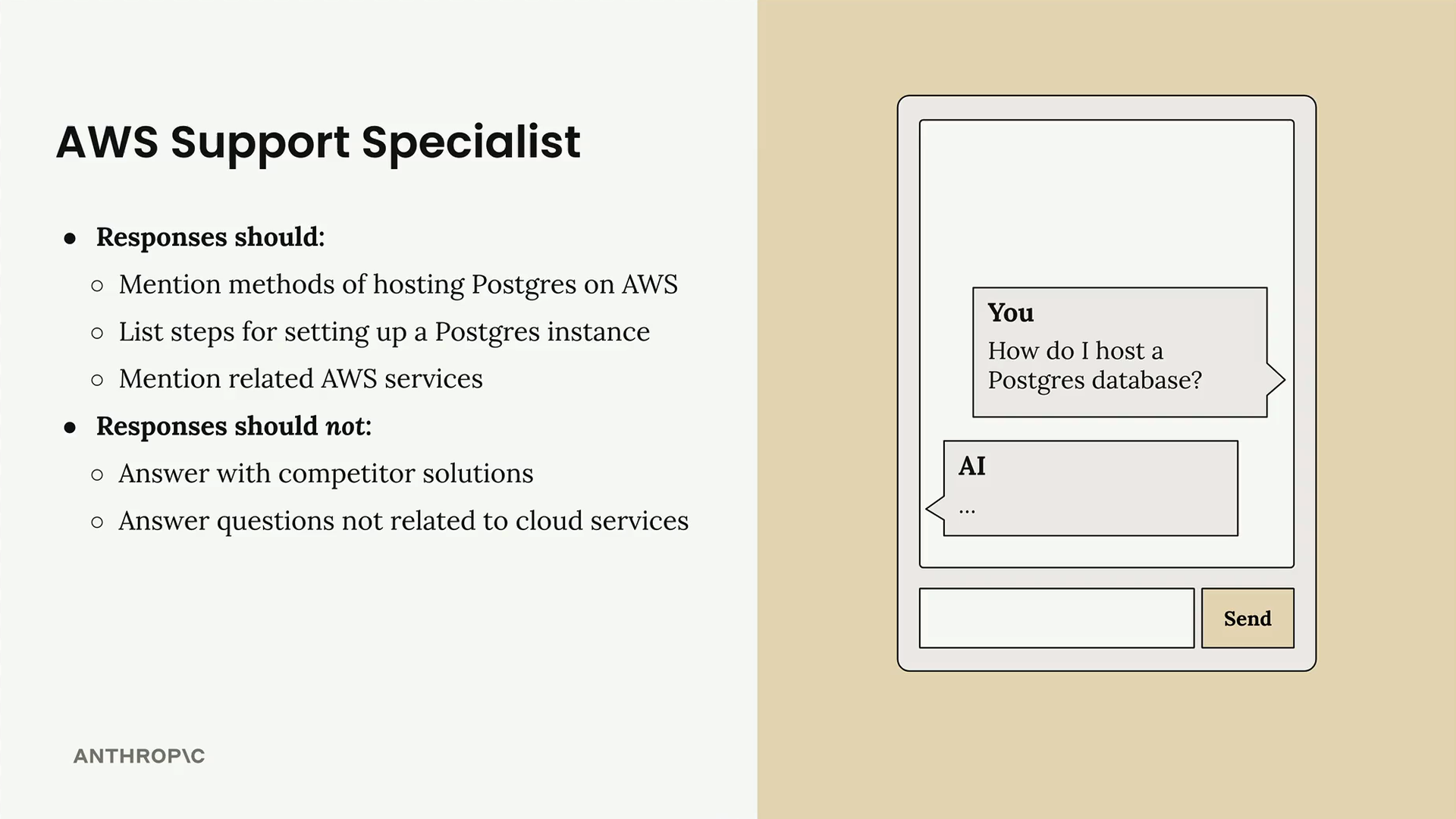

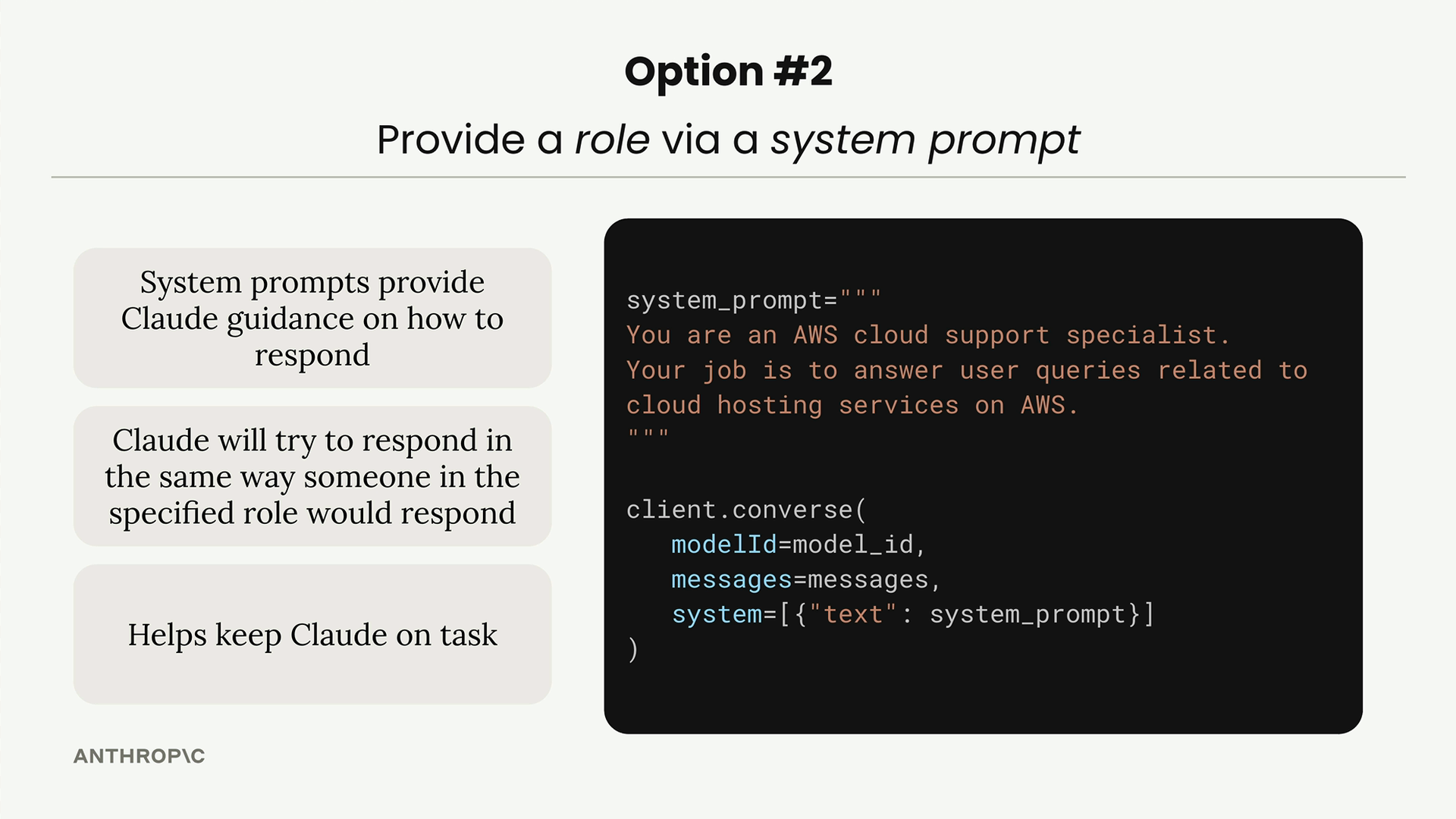

系统提示词

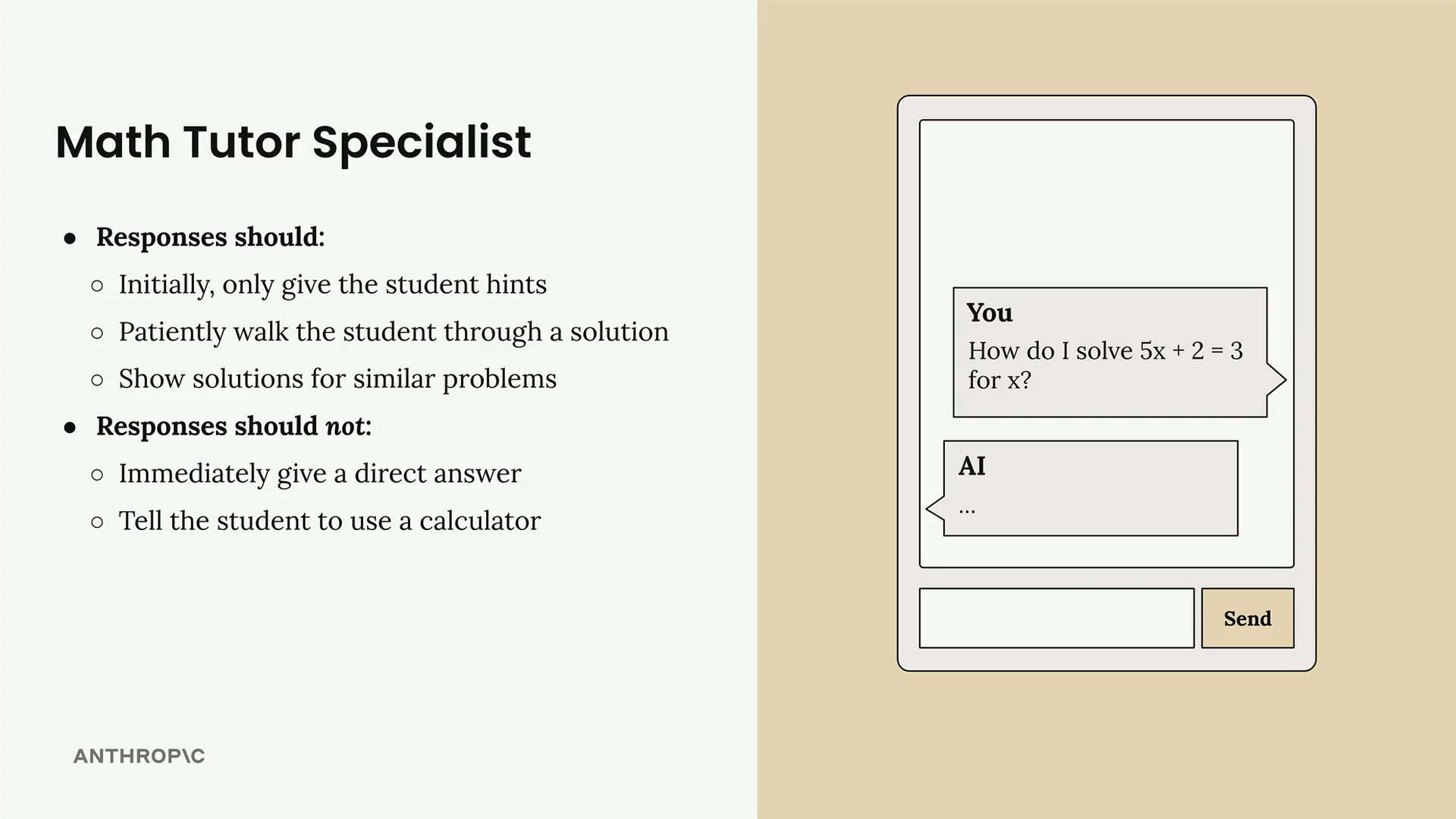

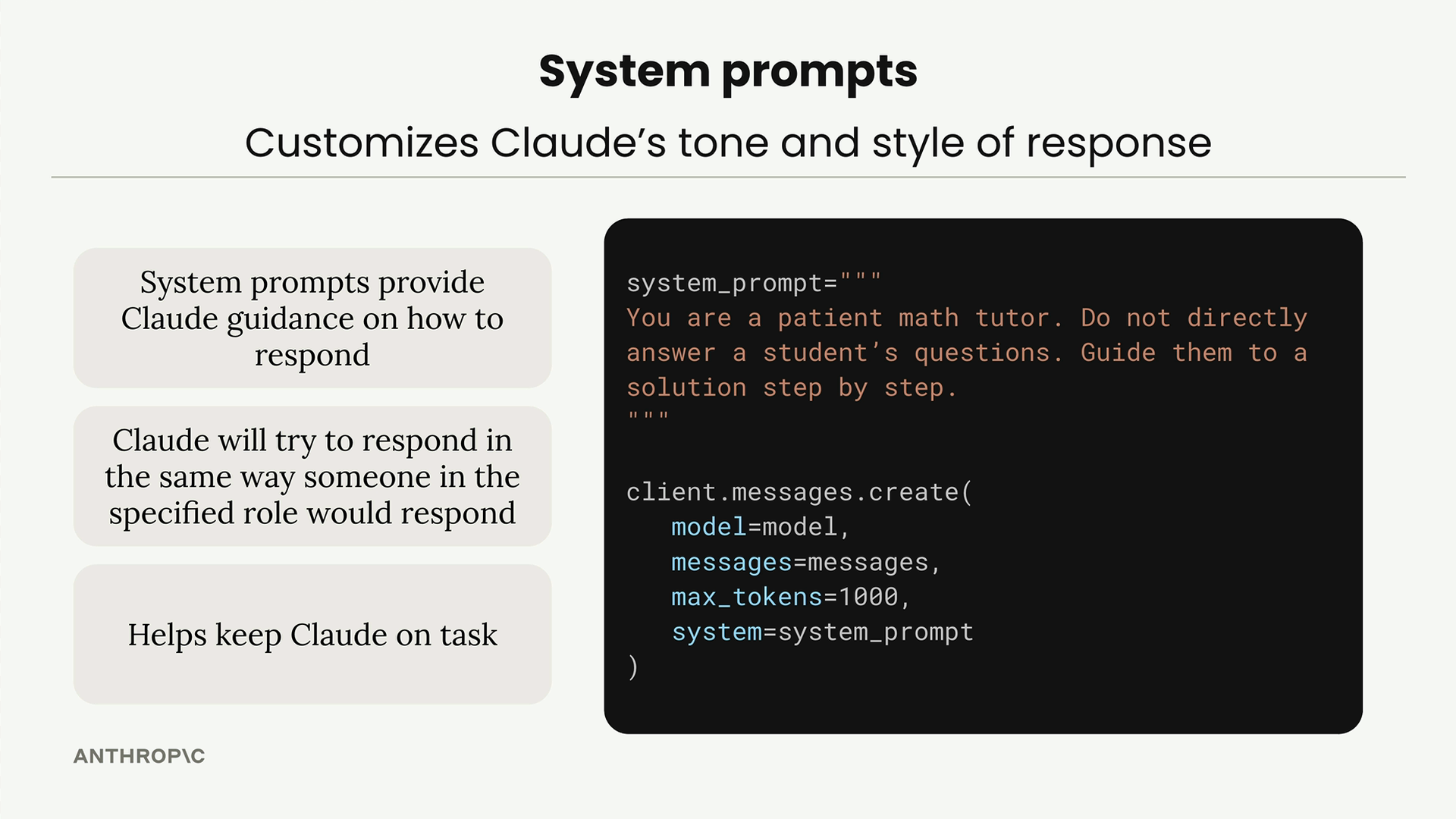

System Prompts (系统提示词) = 一种通过为 Claude 分配特定角色或行为模式来定制其响应风格和语气的技术。

实现方式 = 使用 system 关键字参数,将系统提示词作为纯字符串传递给 create 函数。

目的 = 控制 Claude 如何响应,而不是响应什么。例如:数学导师的角色会让 Claude 给出提示而非直接答案。

结构 = 首行通常分配角色(“你是一位耐心的数学导师”),随后是具体的行为指令。

关键原则 = 系统提示词指导响应的方法,而非内容。同一个问题会根据分配的角色得到不同的处理方式。

技术实现 = 创建一个 params 字典,如果提供了提示词,则有条件地添加 system 键,然后使用 ** 解包将 params 传递给 create 函数。通过完全排除 system 参数来处理 None 的情况。

用例示例 = 一个数学导师,它提供指导/提示而不是完整的解决方案,鼓励学生思考而非直接给出答案。

温度(Temperature)

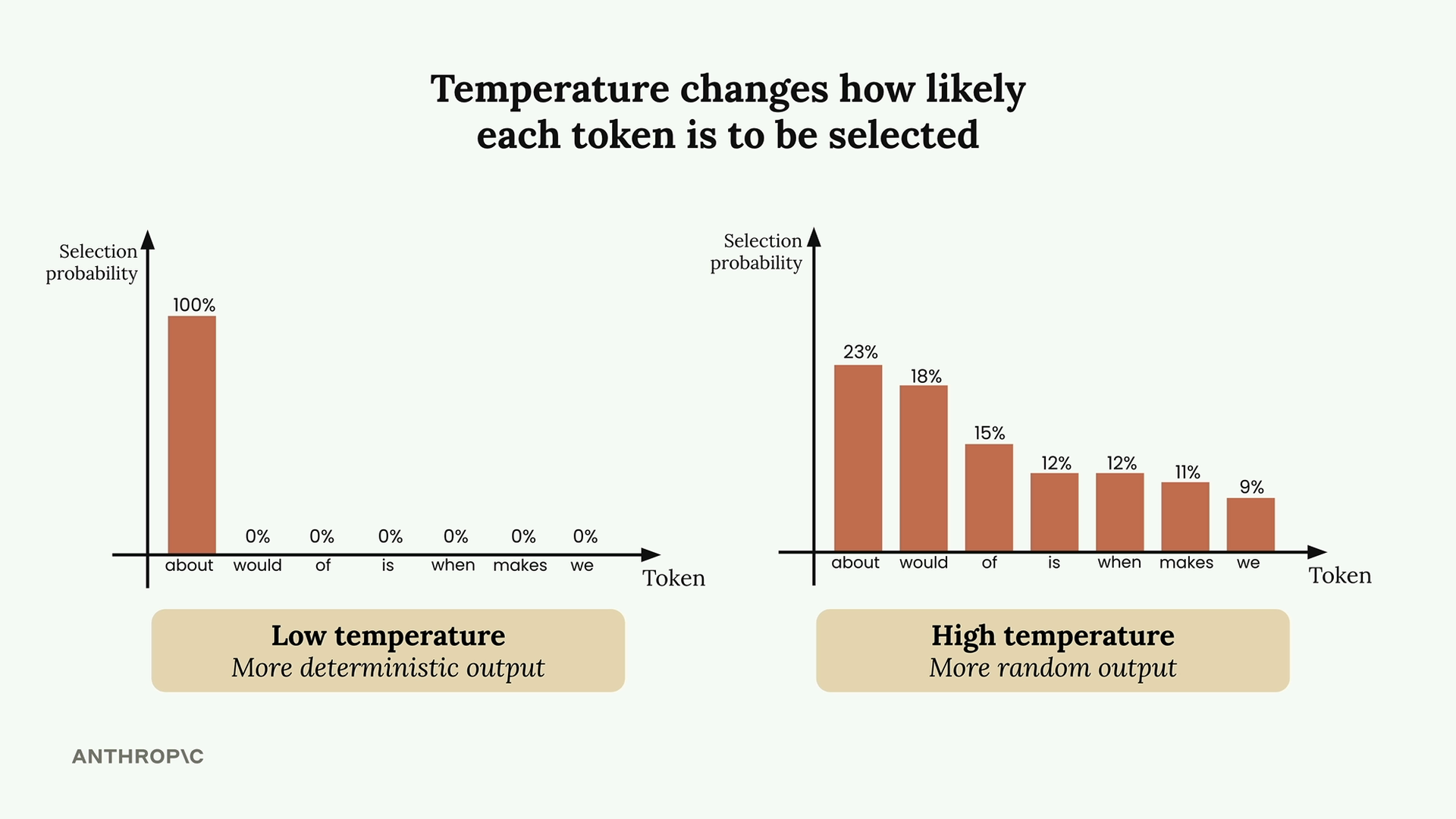

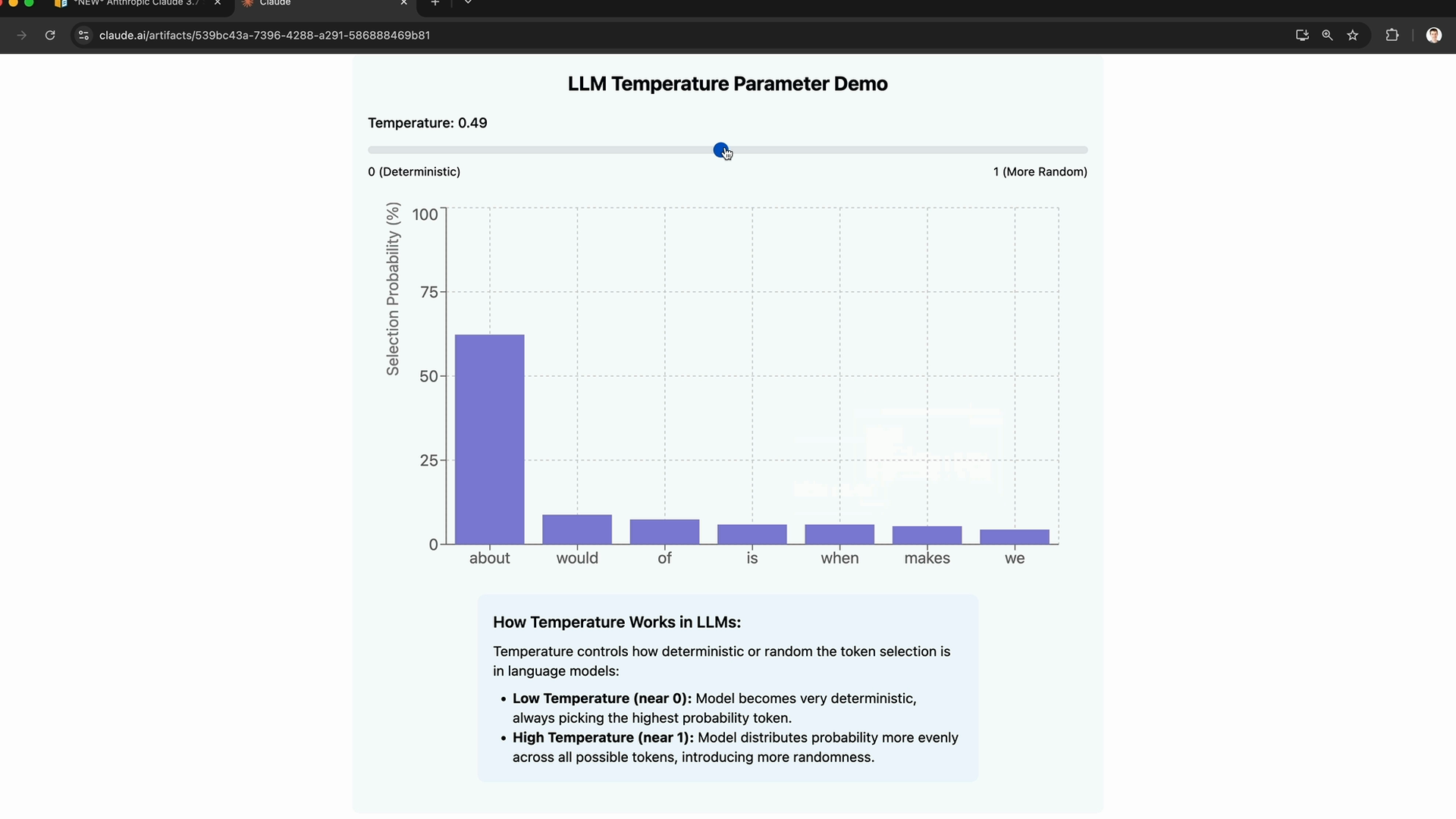

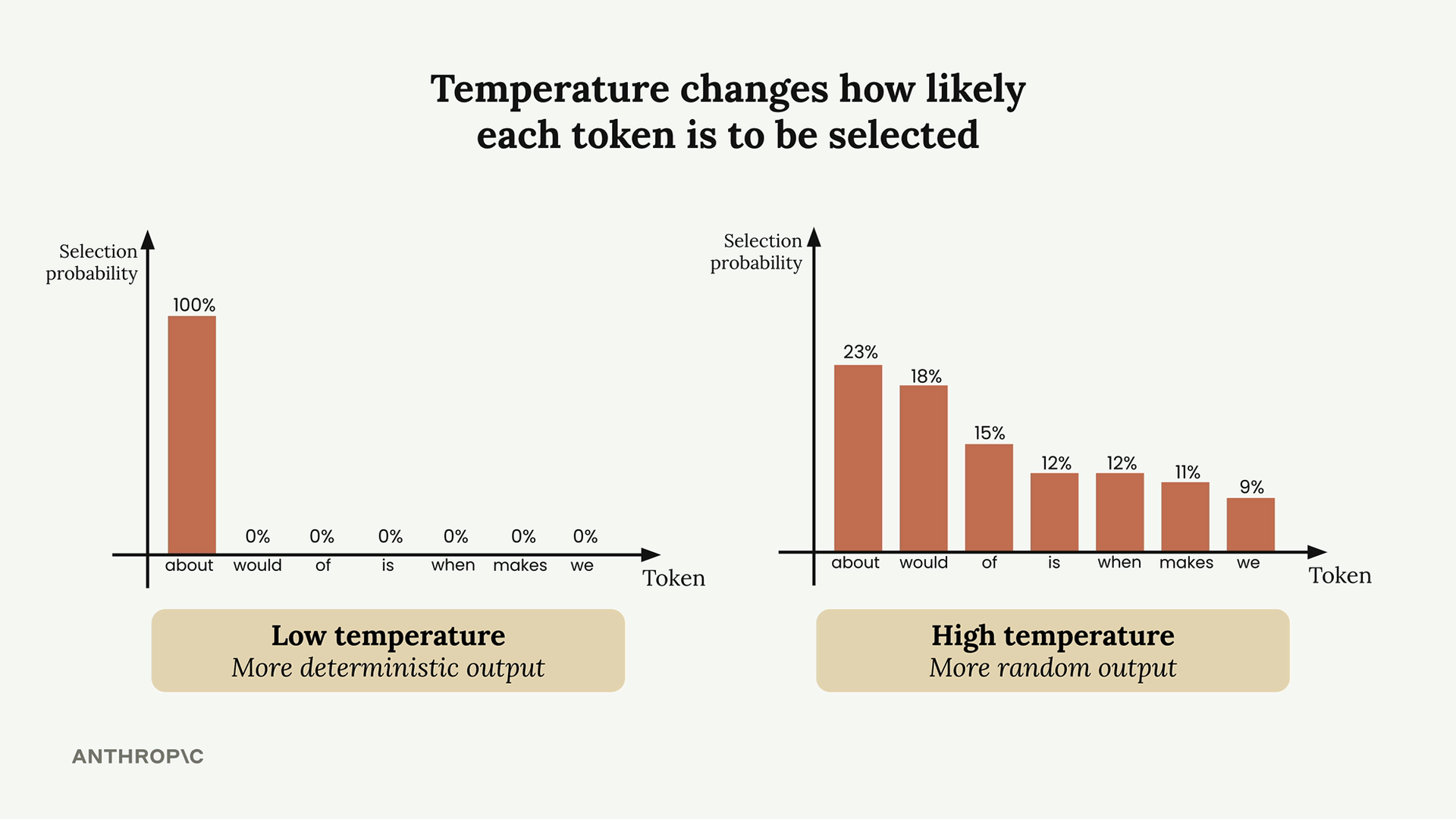

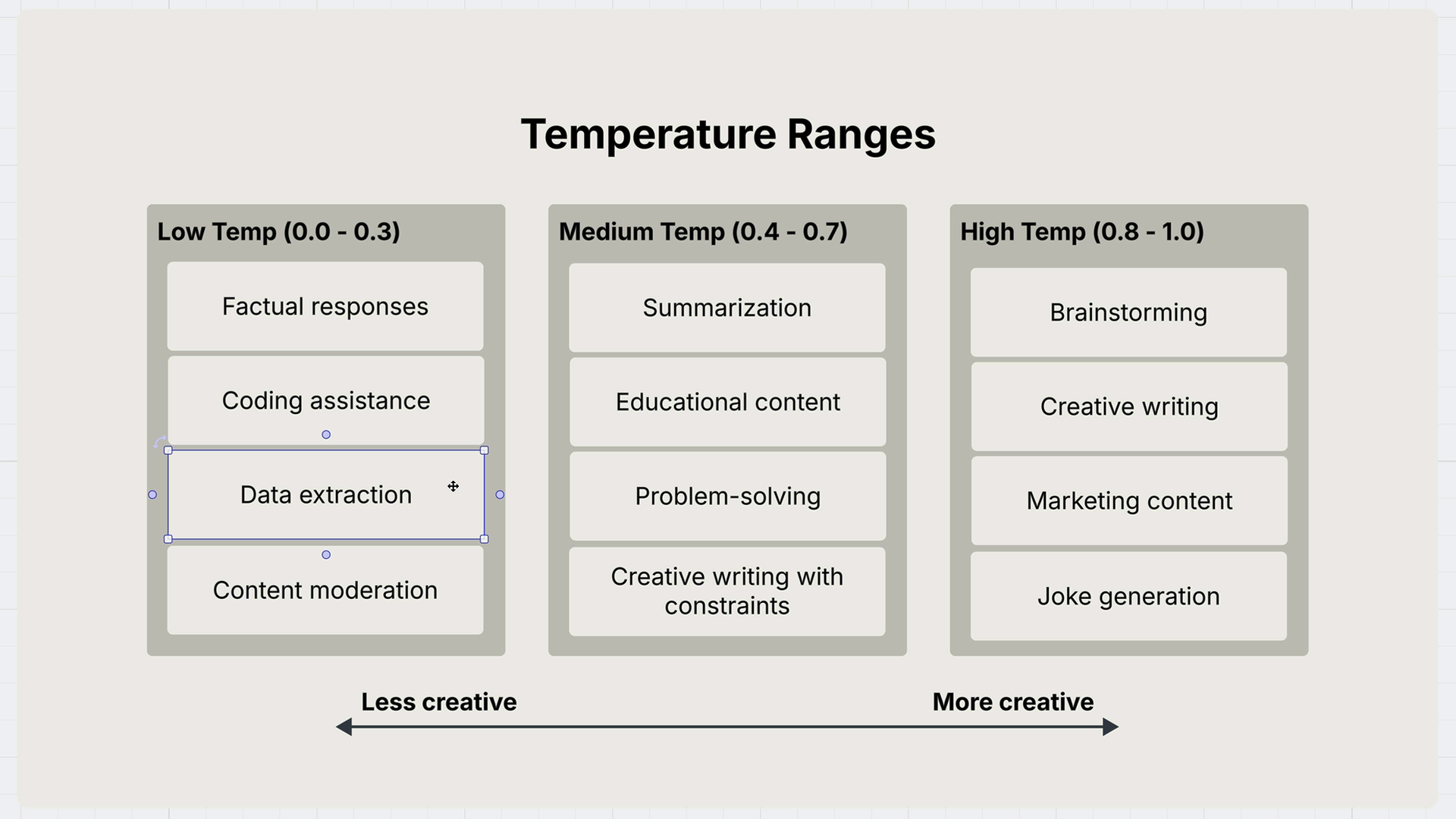

Temperature (温度) = 一个介于 0 到 1 之间的参数,通过影响词元选择的概率来控制 Claude 文本生成中的随机性。

文本生成过程:输入文本 → 分词 → 为可能的下一个词元分配概率 → 基于概率选择词元 → 重复。

温度效应:

- 温度为 0 = 确定性输出,总是选择概率最高的词元。

- 温度较高 = 增加选择较低概率词元的几率,产生更有创意/意想不到的输出。

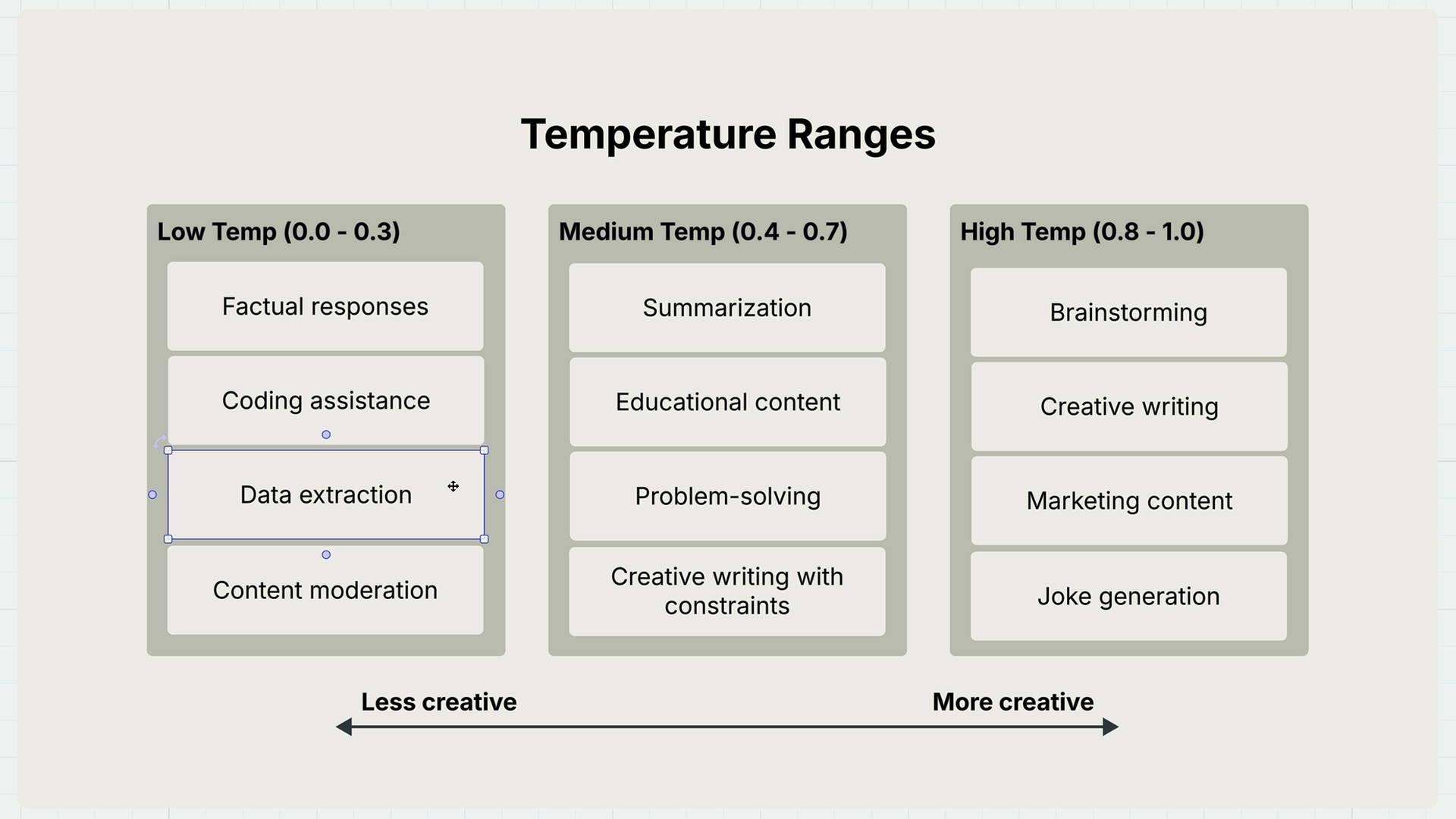

使用指南:

- 低温(接近 0) = 用于数据提取、需要一致性的事实性任务。

- 高温(接近 1) = 用于创意任务,如头脑风暴、写作、讲笑话、市场营销。

实现方式:在模型 API 调用中添加 temperature 参数。较高的值不保证输出不同,只是增加了变化的概率。

核心洞见:温度直接操纵下一个词元选择的概率分布,使得高概率词元在选择过程中的主导地位增强或减弱。

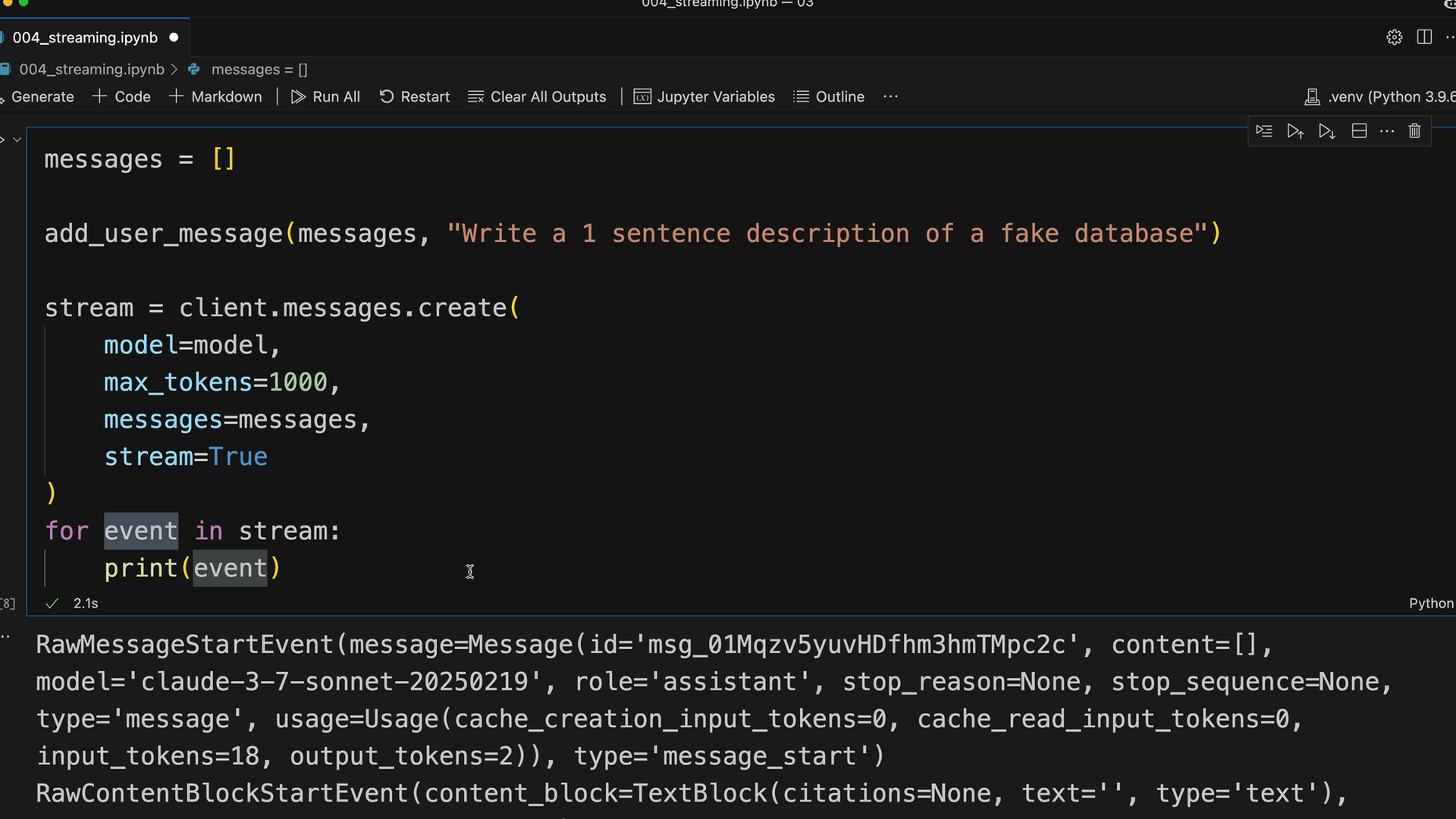

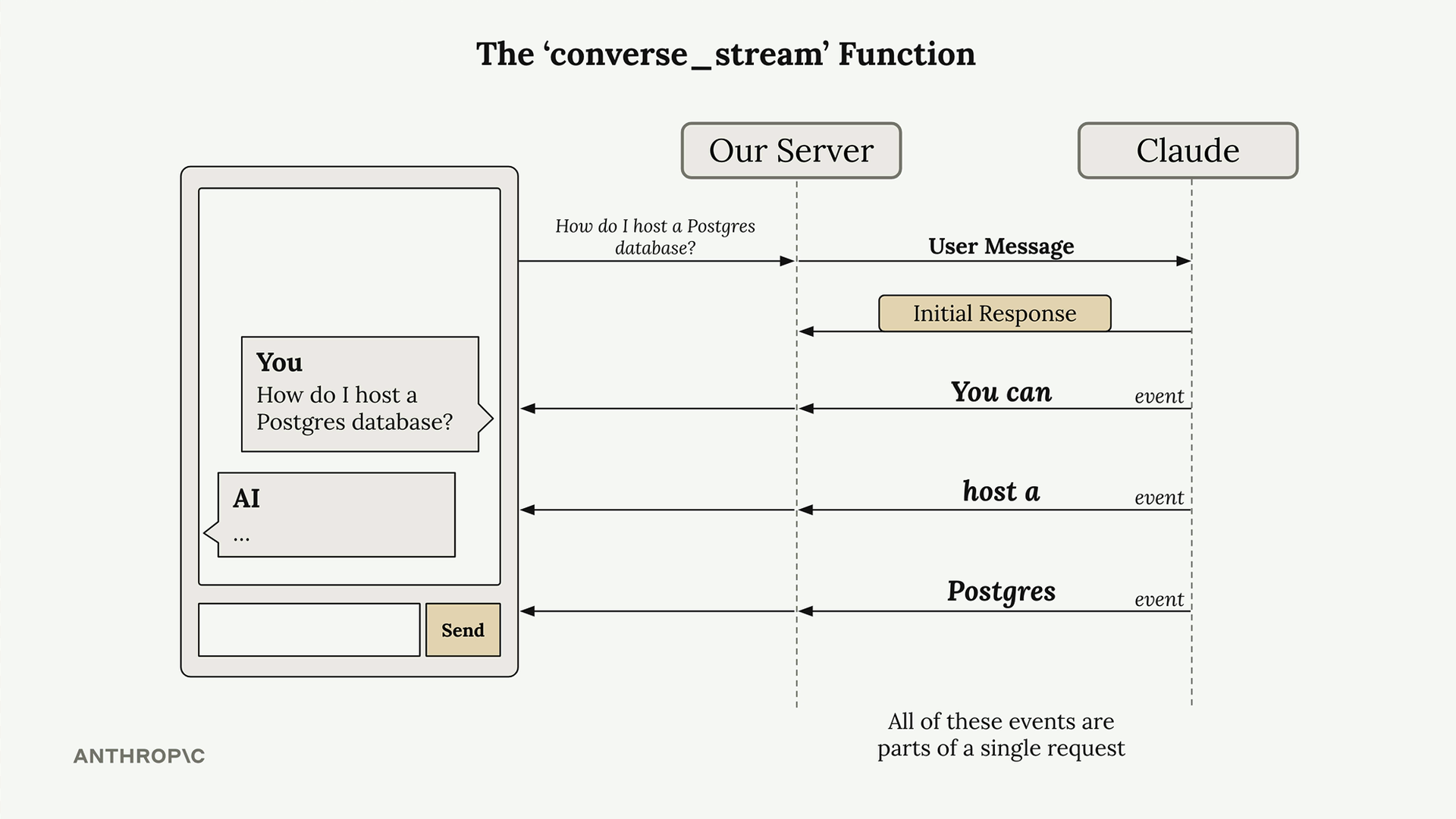

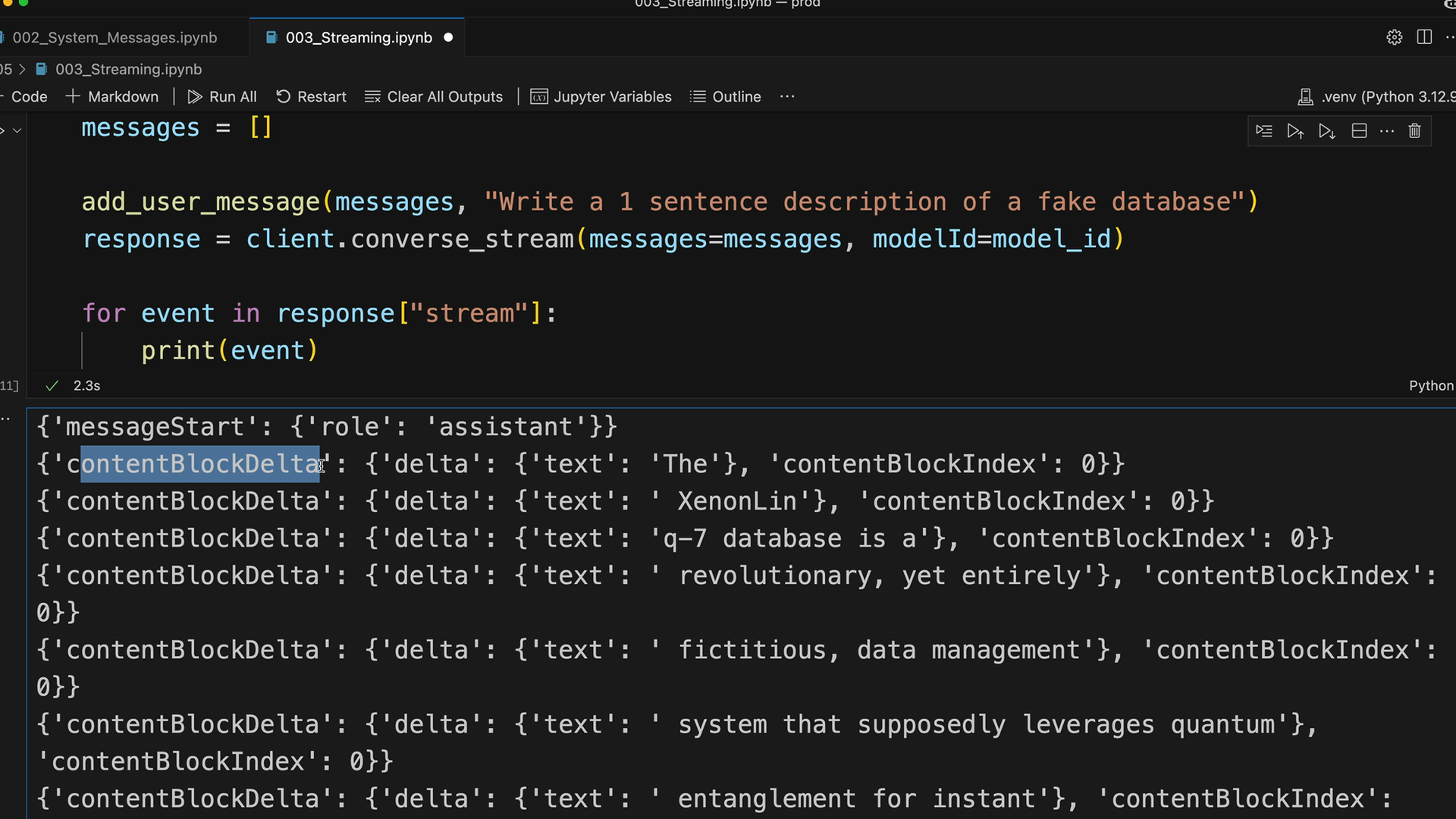

响应流

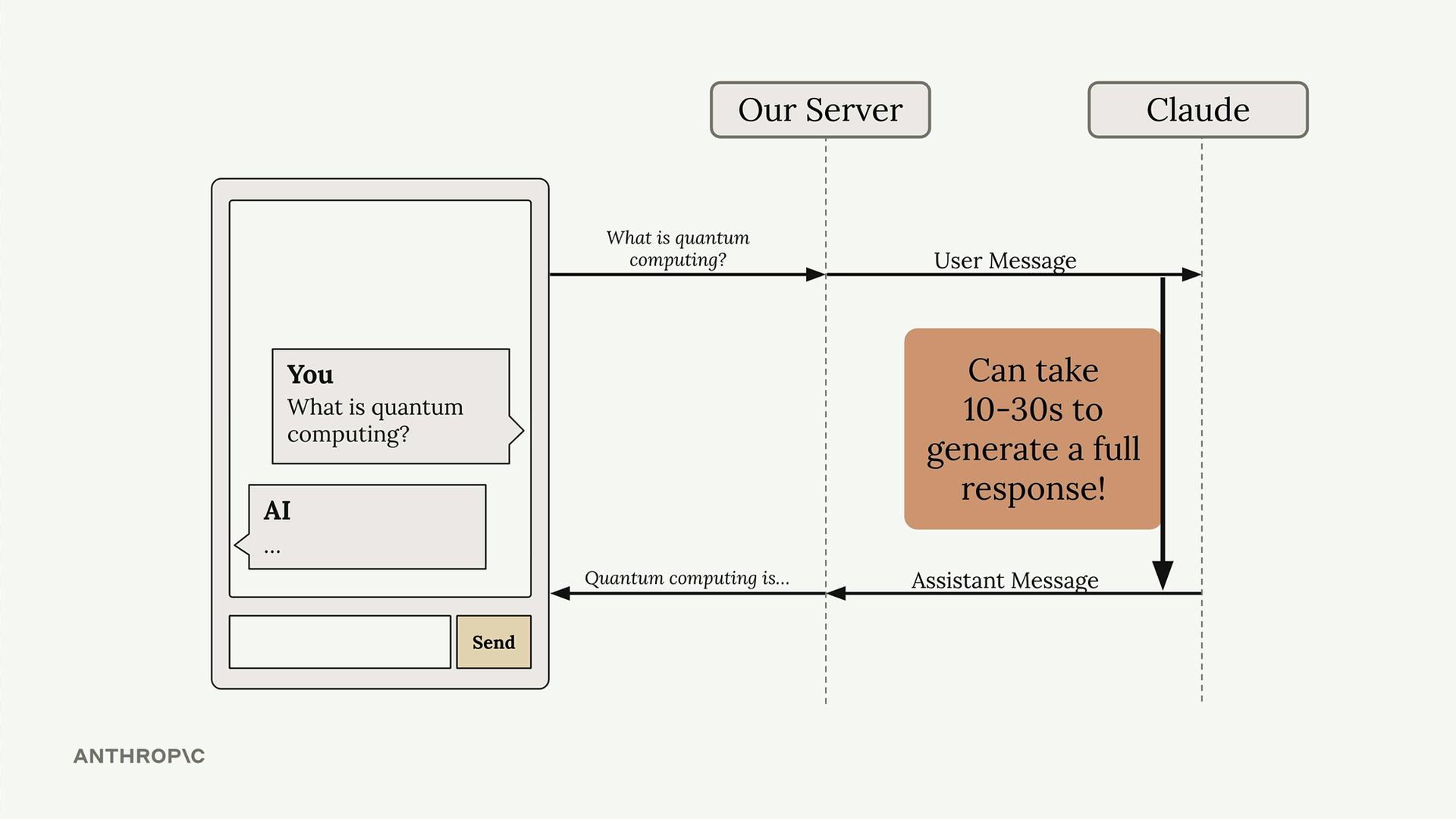

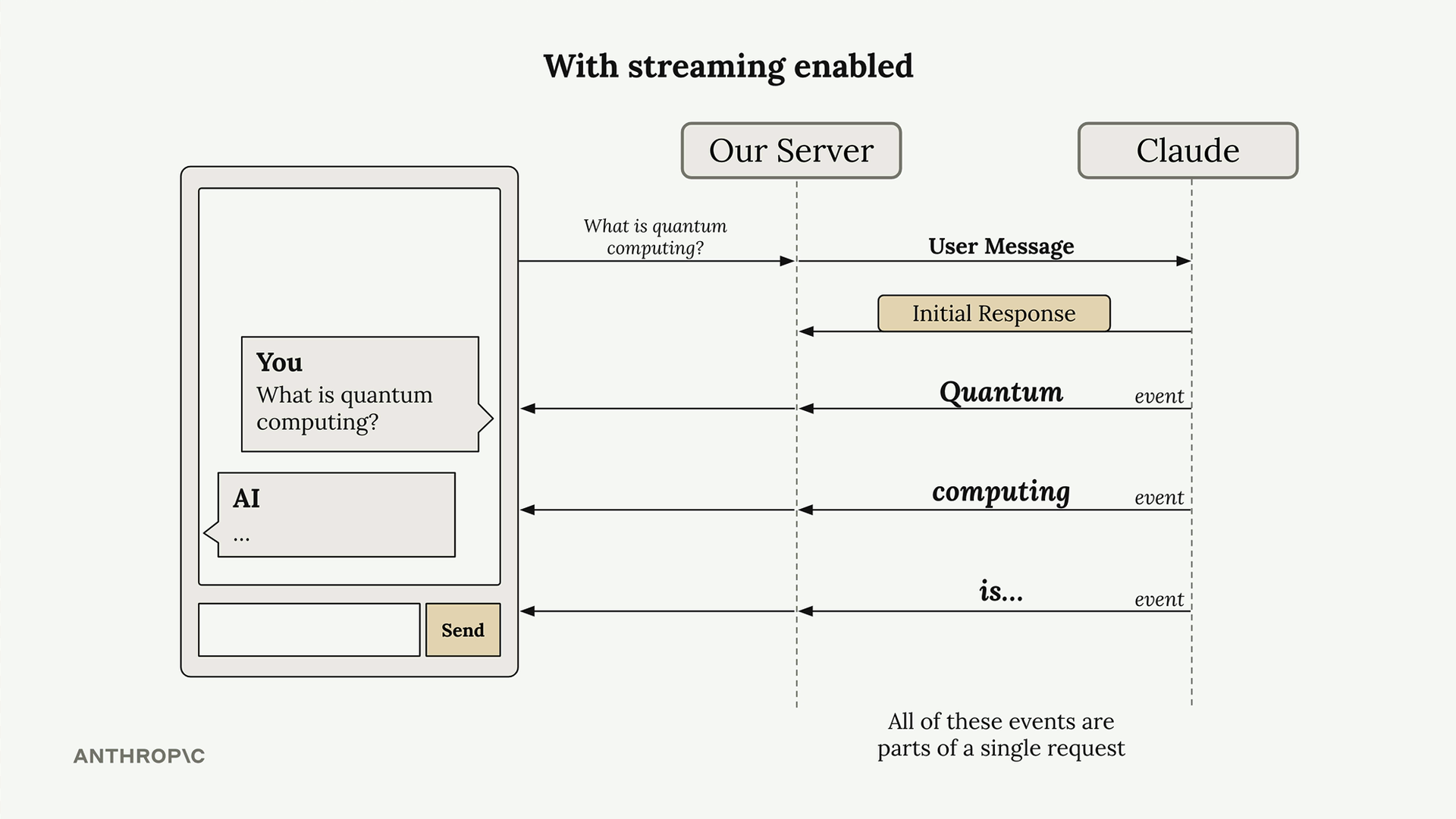

Response Streaming (响应流) = 一种技术,它在 AI 响应生成时逐块显示,而不是等待完整响应。

解决的问题:AI 响应可能需要 10-30 秒。用户期望即时反馈,而不仅仅是加载动画。

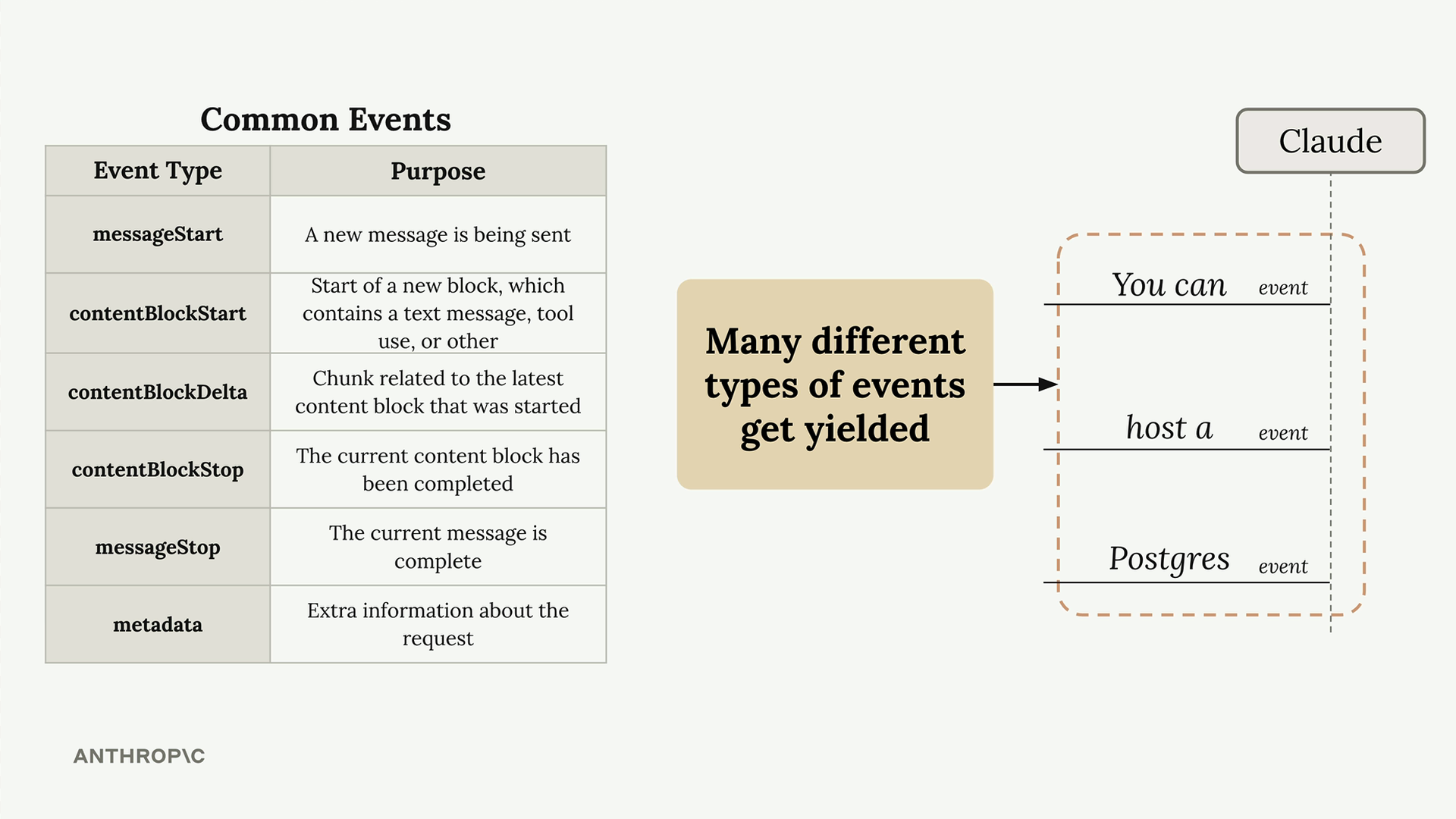

工作原理:

- 服务器将用户消息发送给 Claude。

- Claude 立即发送初始响应(无文本,仅为确认)。

- 随后是一系列事件流,每个事件包含文本块。

- 服务器将这些文本块转发到前端进行实时显示。

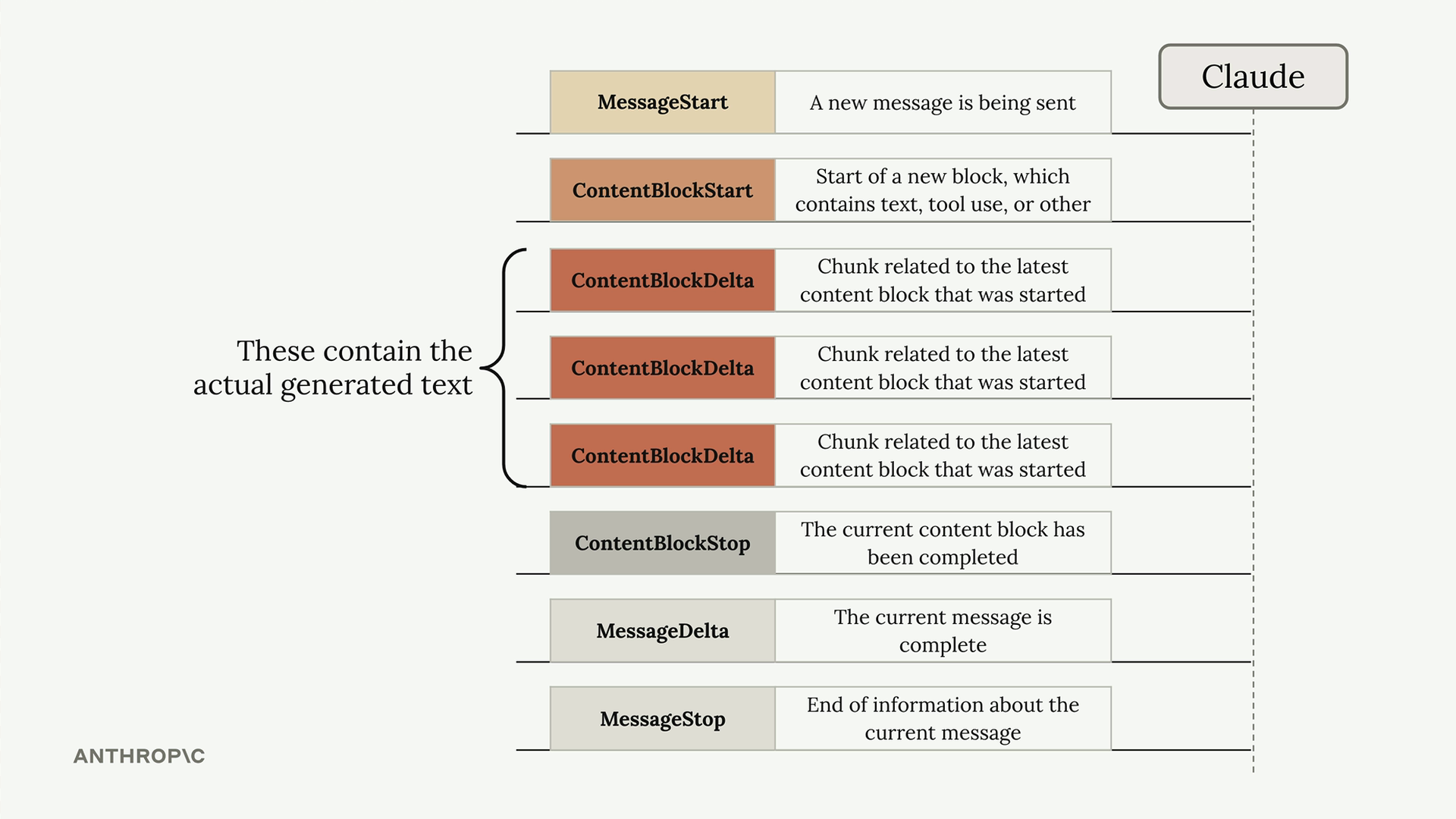

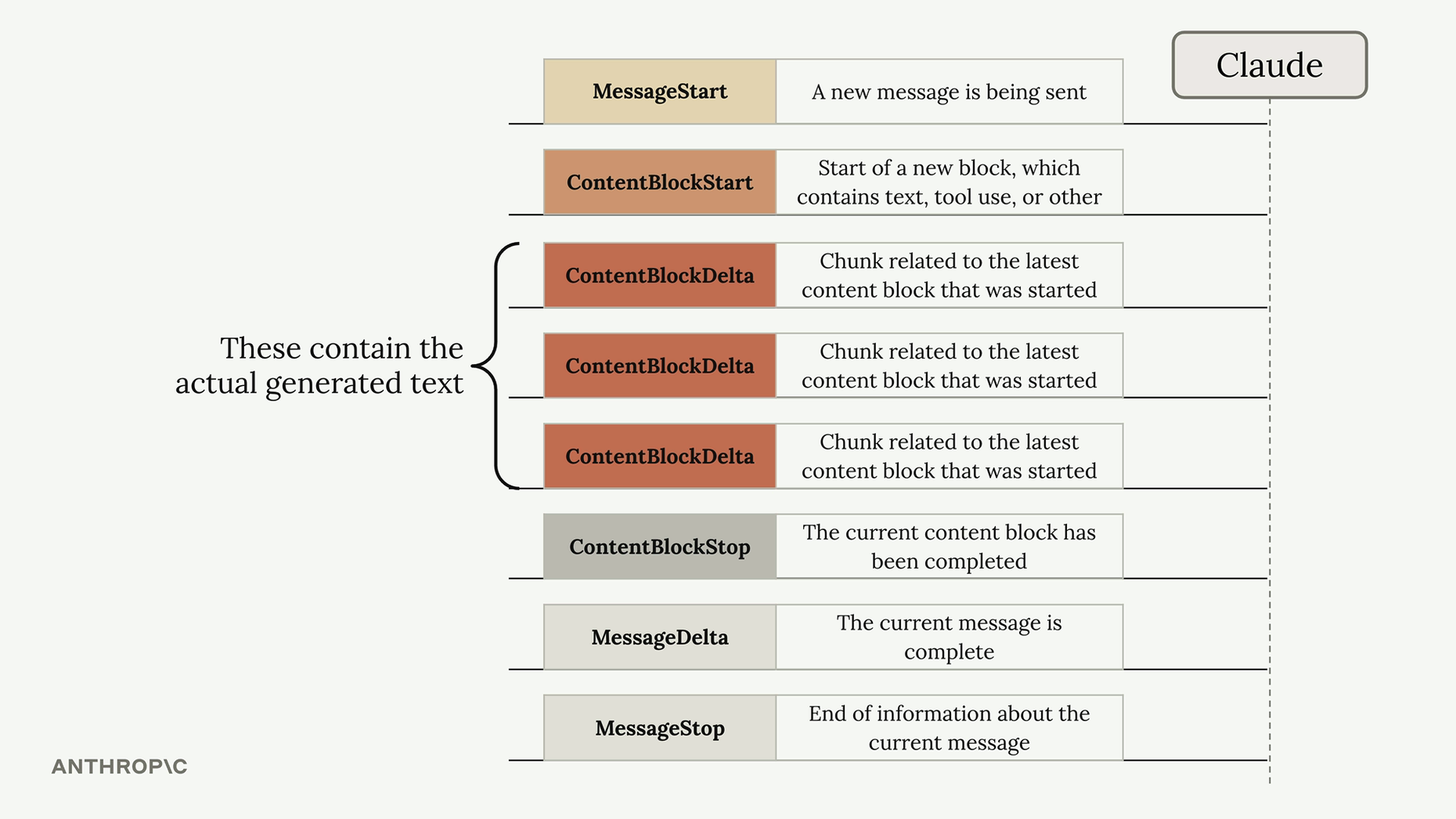

事件类型:

message_start= 初始确认。content_block_start= 文本生成开始。content_block_delta= 包含实际的文本块(最重要)。content_block_stop/message_stop= 生成完成。

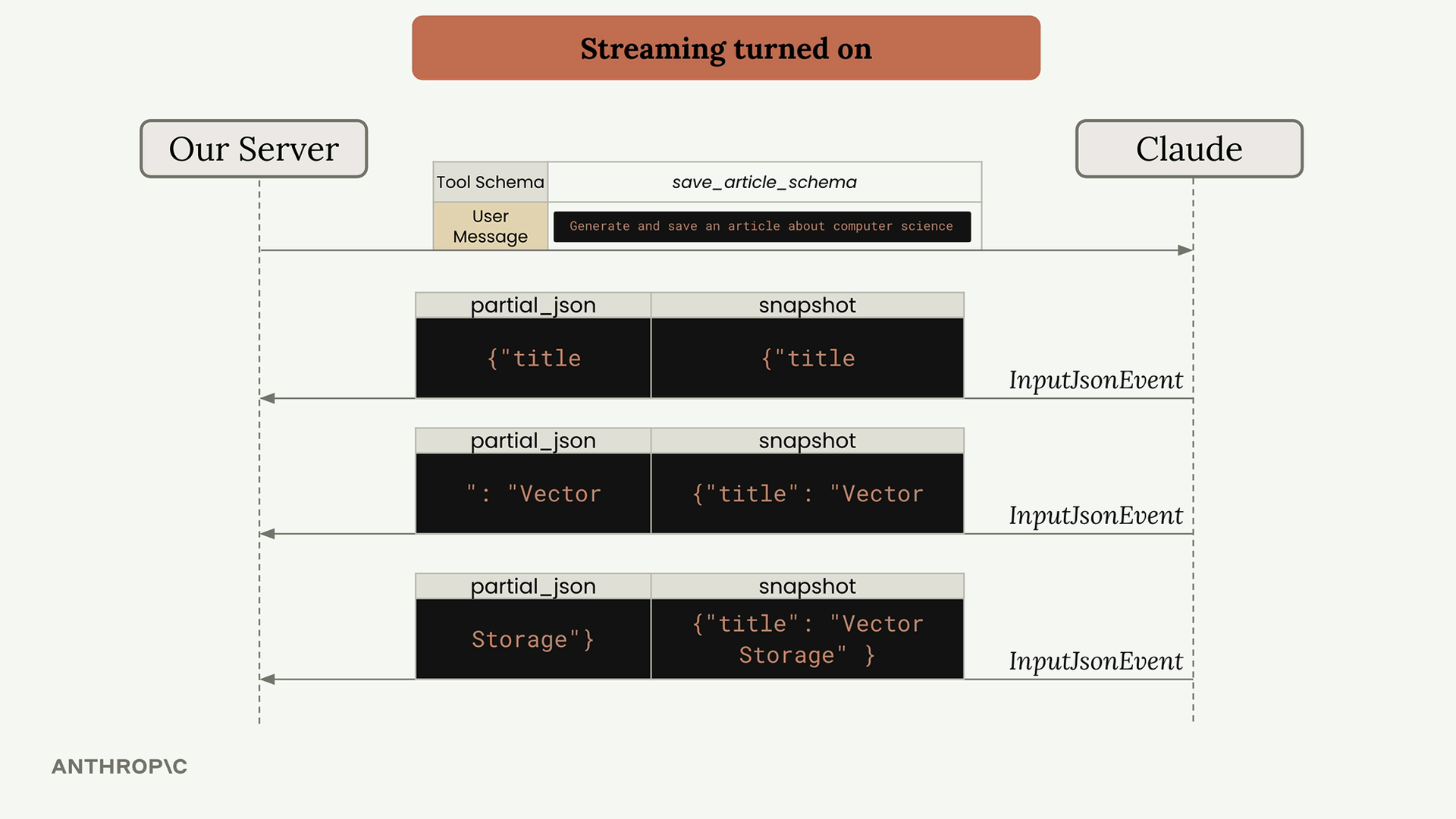

实现方式: 基础版:client.messages.create(stream=True) 返回一个事件迭代器。 简化版:client.messages.stream() 及其 text_stream 属性仅提取文本。 最终消息:stream.get_final_message() 将所有文本块组装起来以便存储。

主要优点:通过即时响应可见性改善用户体验(UX),并能捕获完整的消息以供数据库存储。

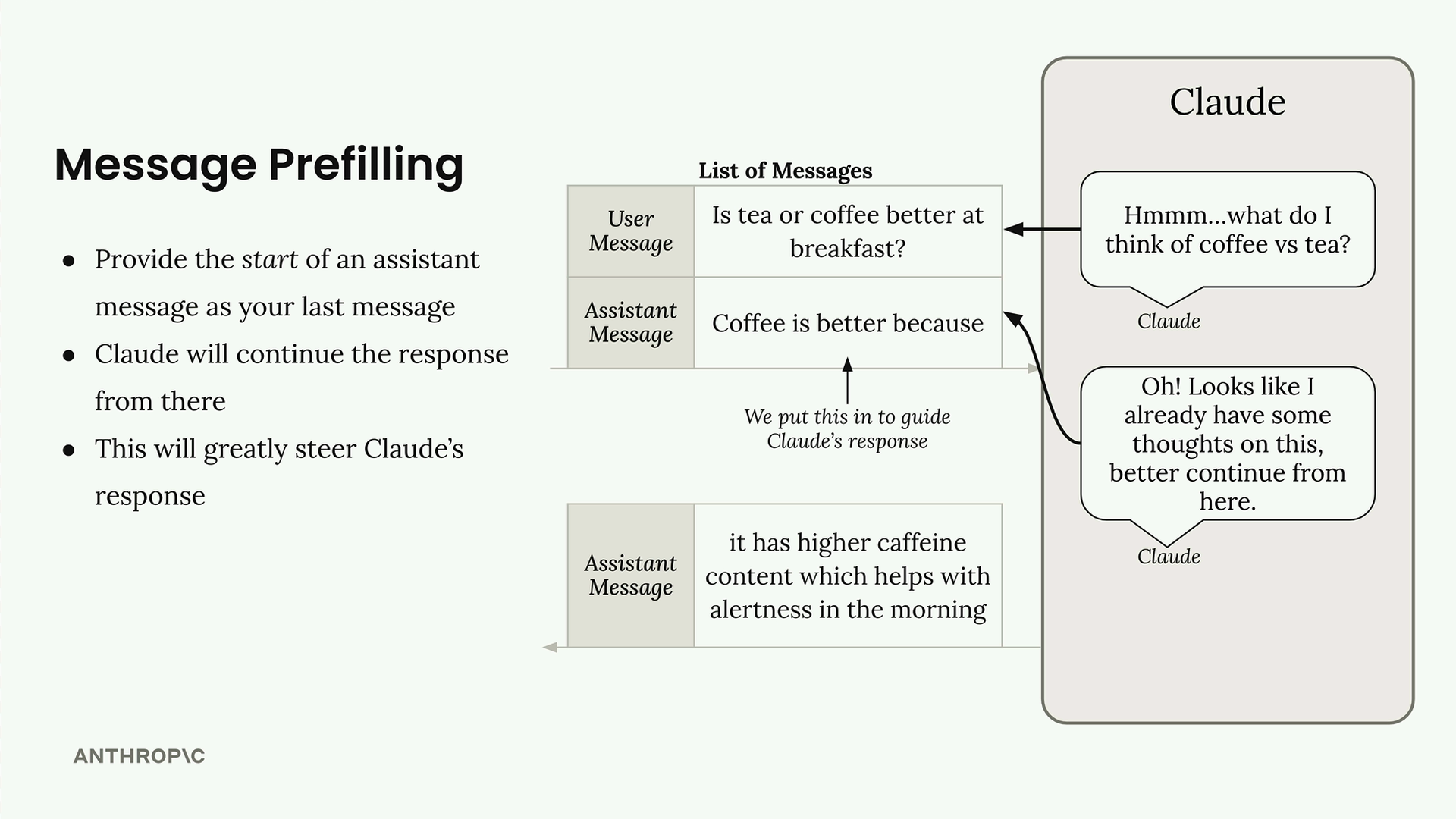

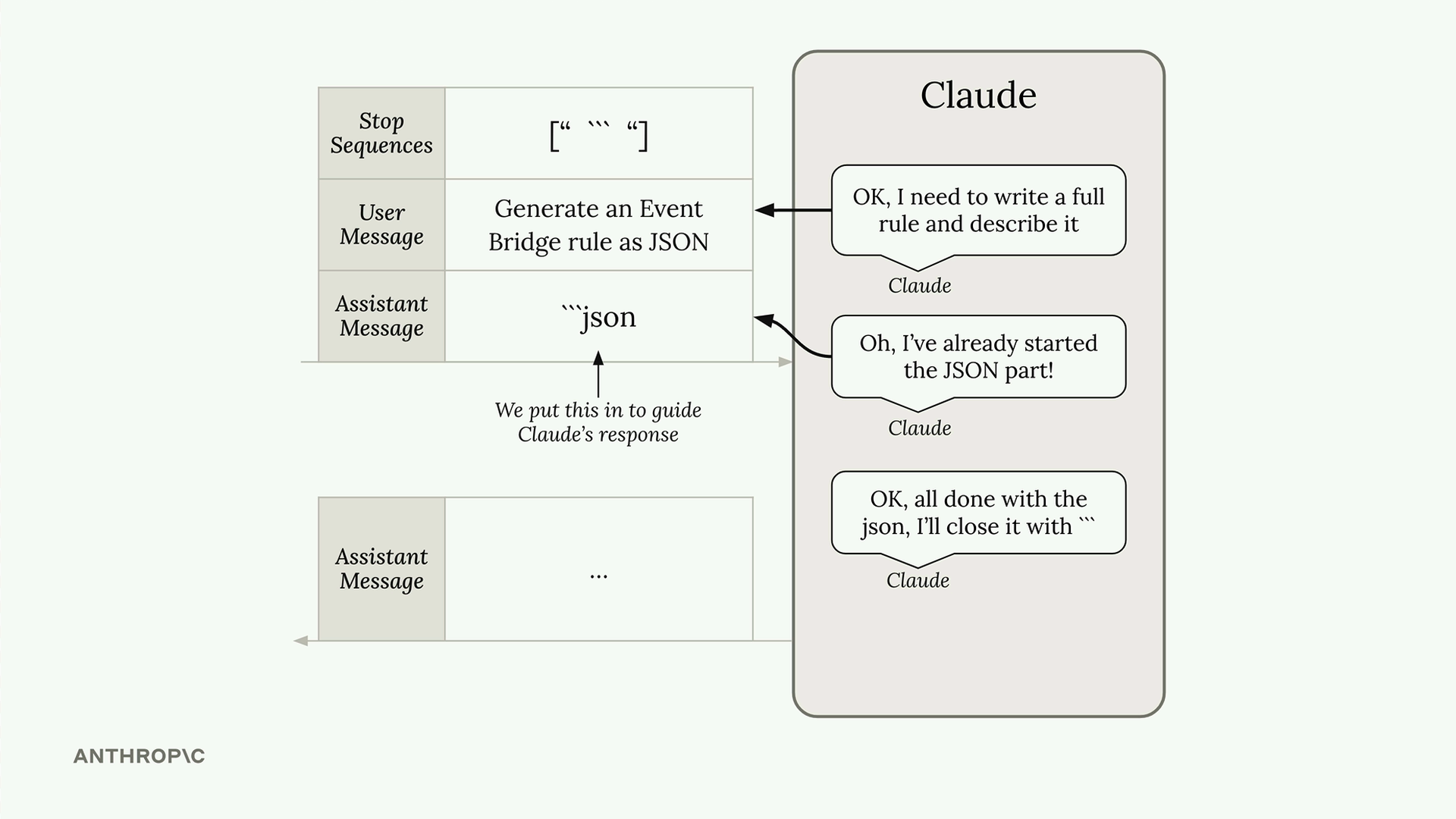

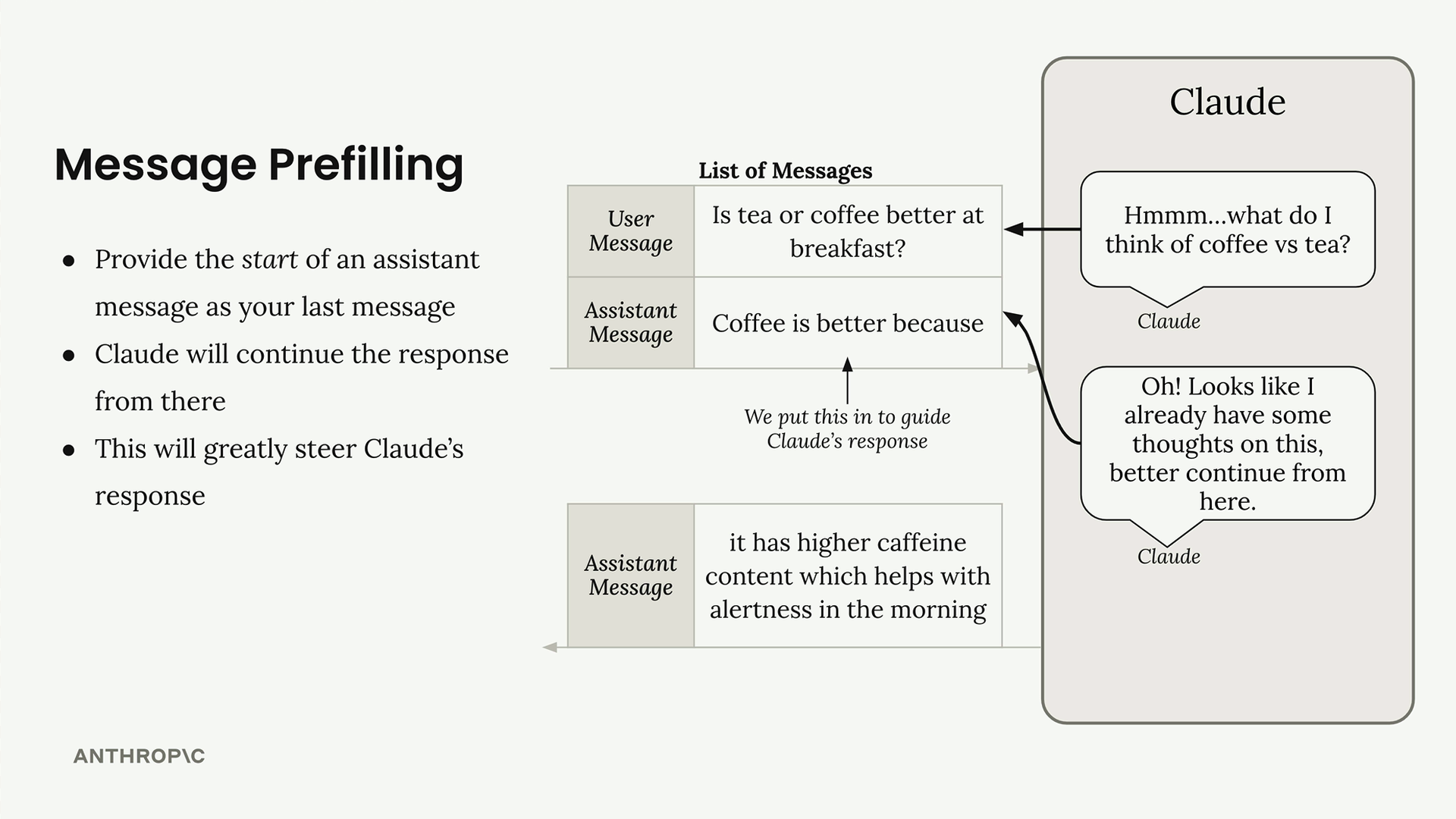

控制模型输出

控制模型输出 = 除了修改提示词之外的两种关键技术

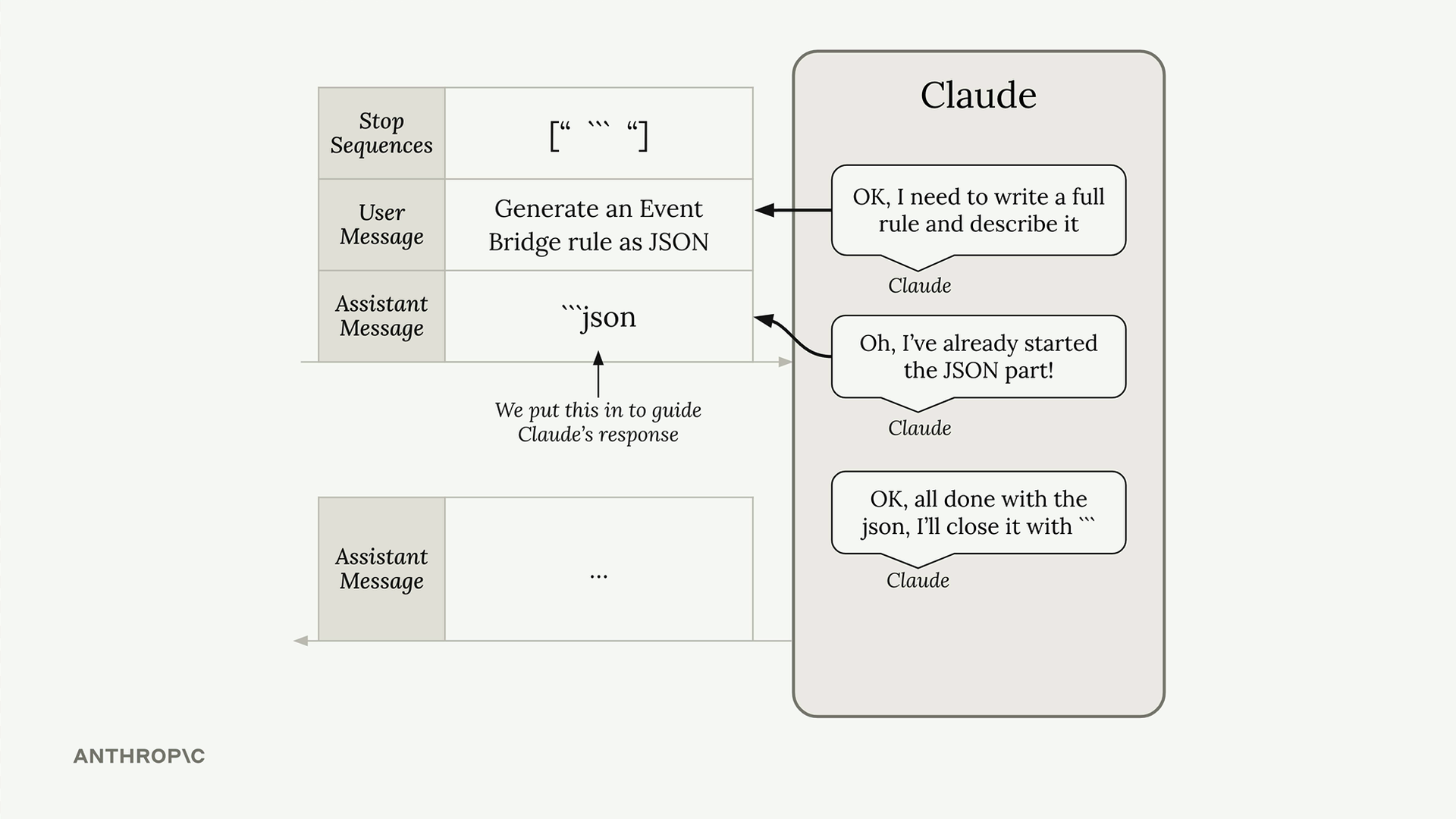

Pre-filling Assistant Messages (预填充助手消息) = 在对话末尾手动添加一条助手消息,以引导响应方向

工作原理:

- 组装包含用户提示词 + 手动添加的助手消息的消息列表。

- Claude 将这条助手消息视为已创作的内容。

- Claude 从预填充文本的末尾精确地继续响应。

- 响应被引导至预填充的方向。

关键点:Claude 从预填充的精确末尾继续,而不是从完整的句子开始。必须将预填充部分与生成的响应拼接在一起。

示例:预填充“咖啡更好,因为” → Claude 会继续给出支持咖啡的理由。

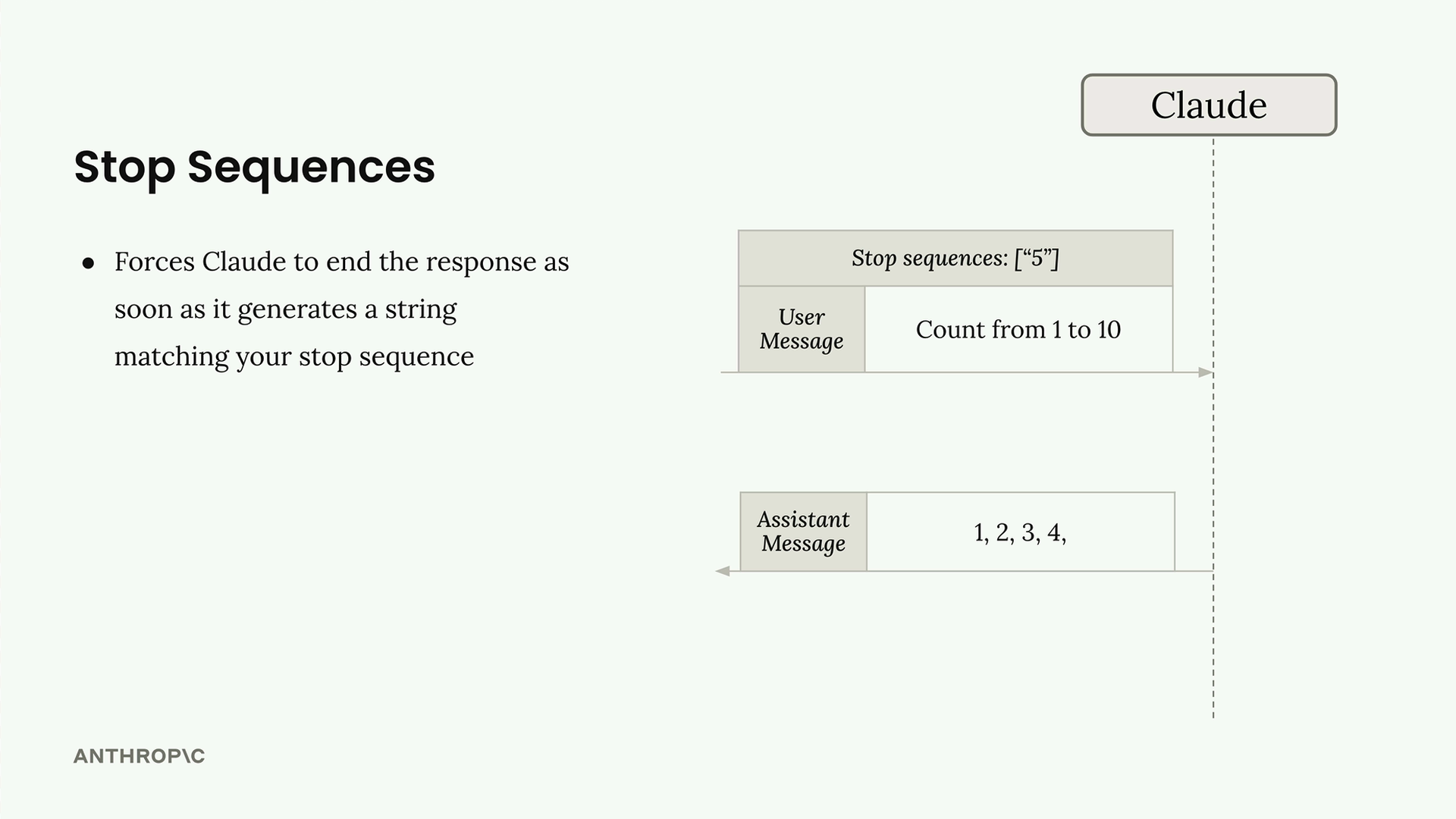

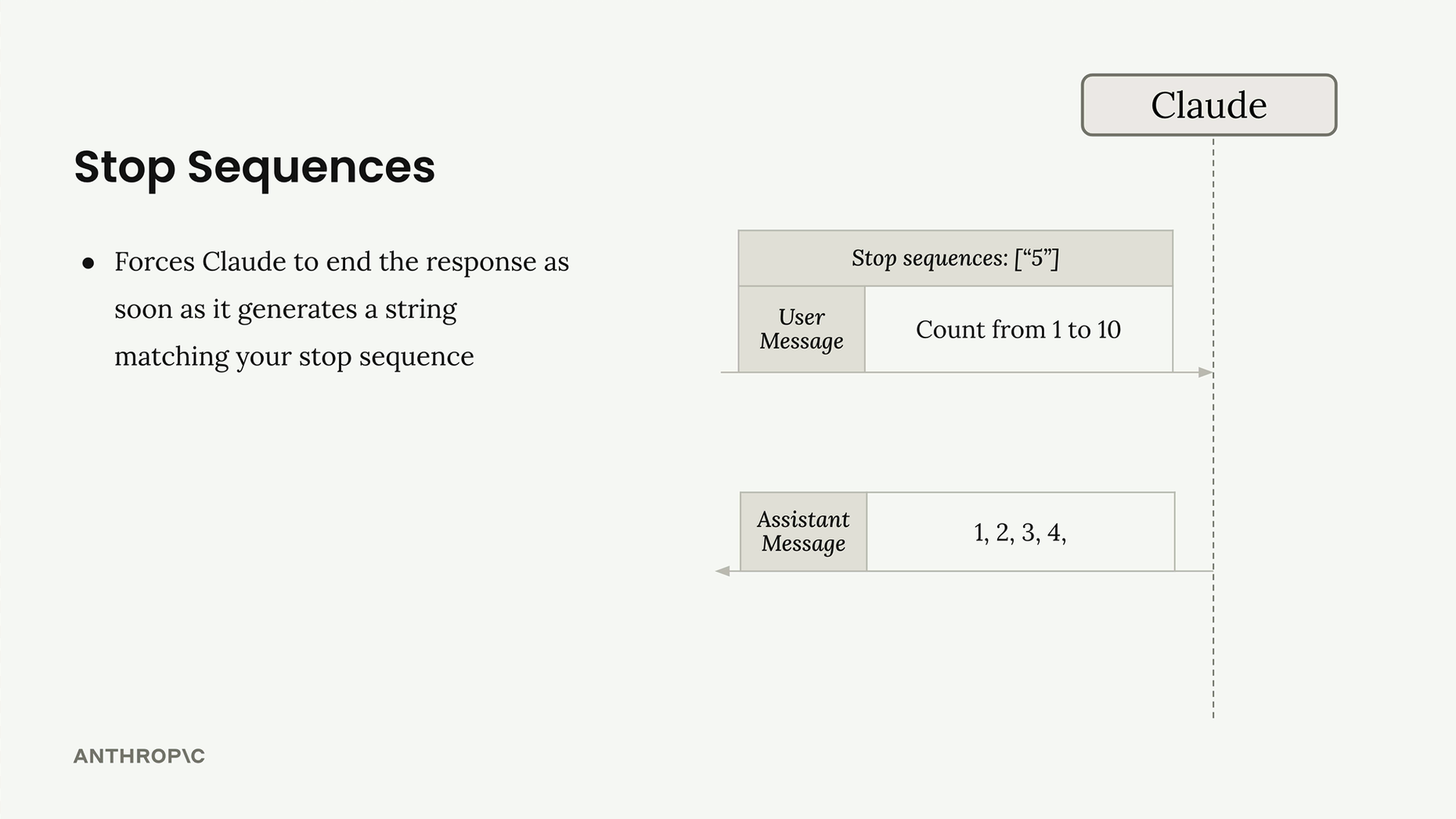

Stop Sequences (停止序列) = 当特定字符串出现时,强制 Claude 停止生成

工作原理:

- 在聊天函数中提供一个停止序列字符串。

- 当 Claude 生成该确切字符串时,响应立即停止。

- 生成的停止序列文本不包含在最终输出中。

示例:提示词“从 1 数到 10” + 停止序列“五” → 输出在“四,”处停止(“五”不被包含)。

优化:停止序列设为“, 五” → 得到干净的输出“一, 二, 三, 四”。

这两种技术都提供了对响应方向和长度的精确控制,而无需更改核心提示词。

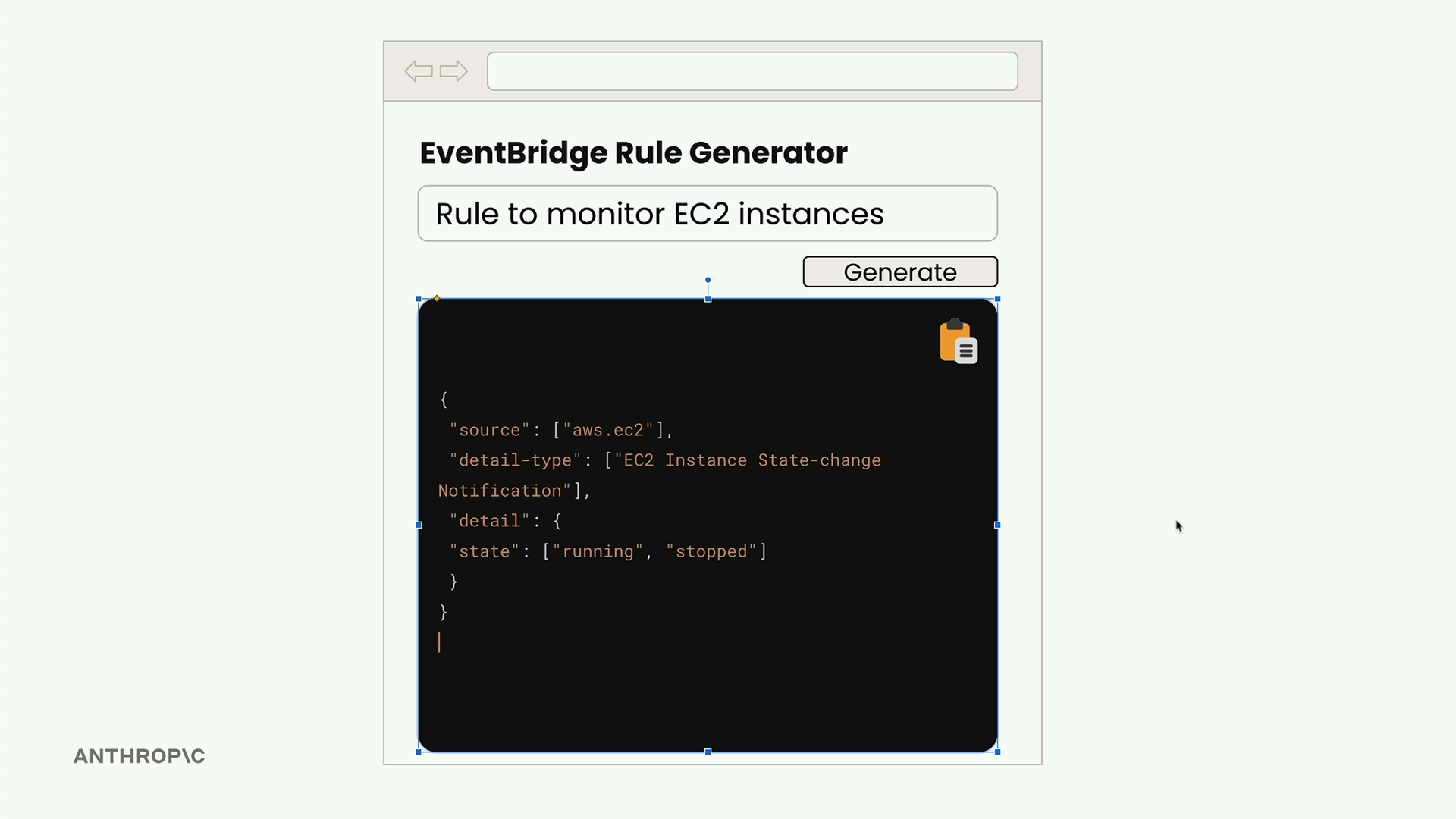

结构化数据

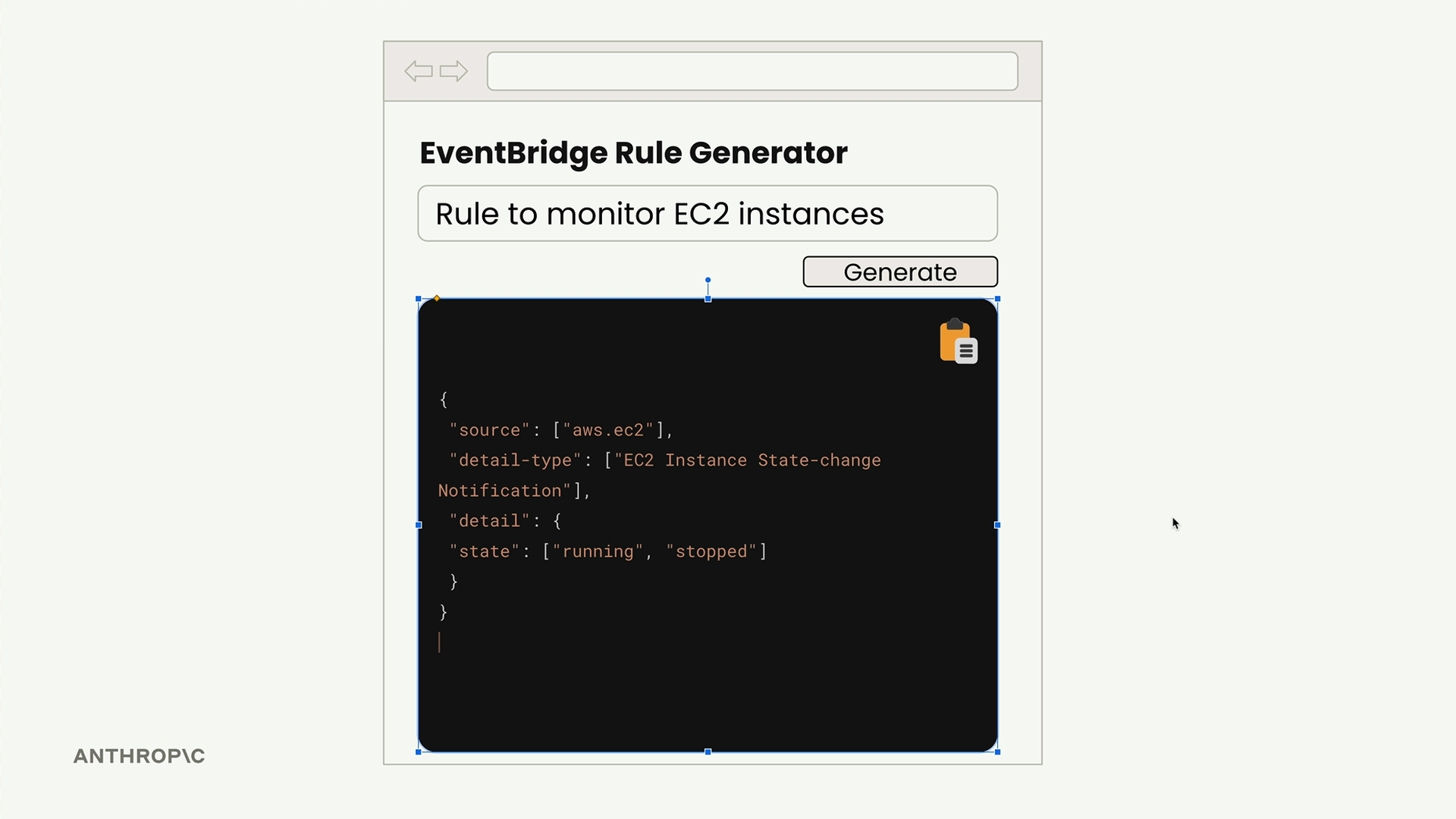

Structured Data Generation (结构化数据生成) = 一种结合使用助手消息预填充和停止序列的技术,以获得没有 Claude 自然添加的解释性页眉/页脚的原始输出。

问题 = Claude 在生成 JSON/代码/结构化内容时,会自动添加 markdown 格式、标题和注释。用户通常只想要原始数据以便于复制粘贴。

解决方案模式:

- 用户消息 = 请求结构化数据。

- 助手消息预填充 = 使用起始分隔符(例如,"```json")。

- 停止序列 = 使用结束分隔符(例如,"```")。

工作原理 = Claude 看到预填充的消息,假定它已经开始了响应,于是只生成所请求的内容,并在遇到分隔符时停止。

结果 = 获得没有任何额外格式或注释的原始结构化数据输出。

应用 = 适用于任何结构化数据类型(JSON、Python 代码、列表等),不仅限于 JSON。当你需要无需解释性文本的、干净且可解析的输出时,都可以使用。

主要优点 = 输出可以直接使用/复制,无需手动选择或解析不需要的文本。

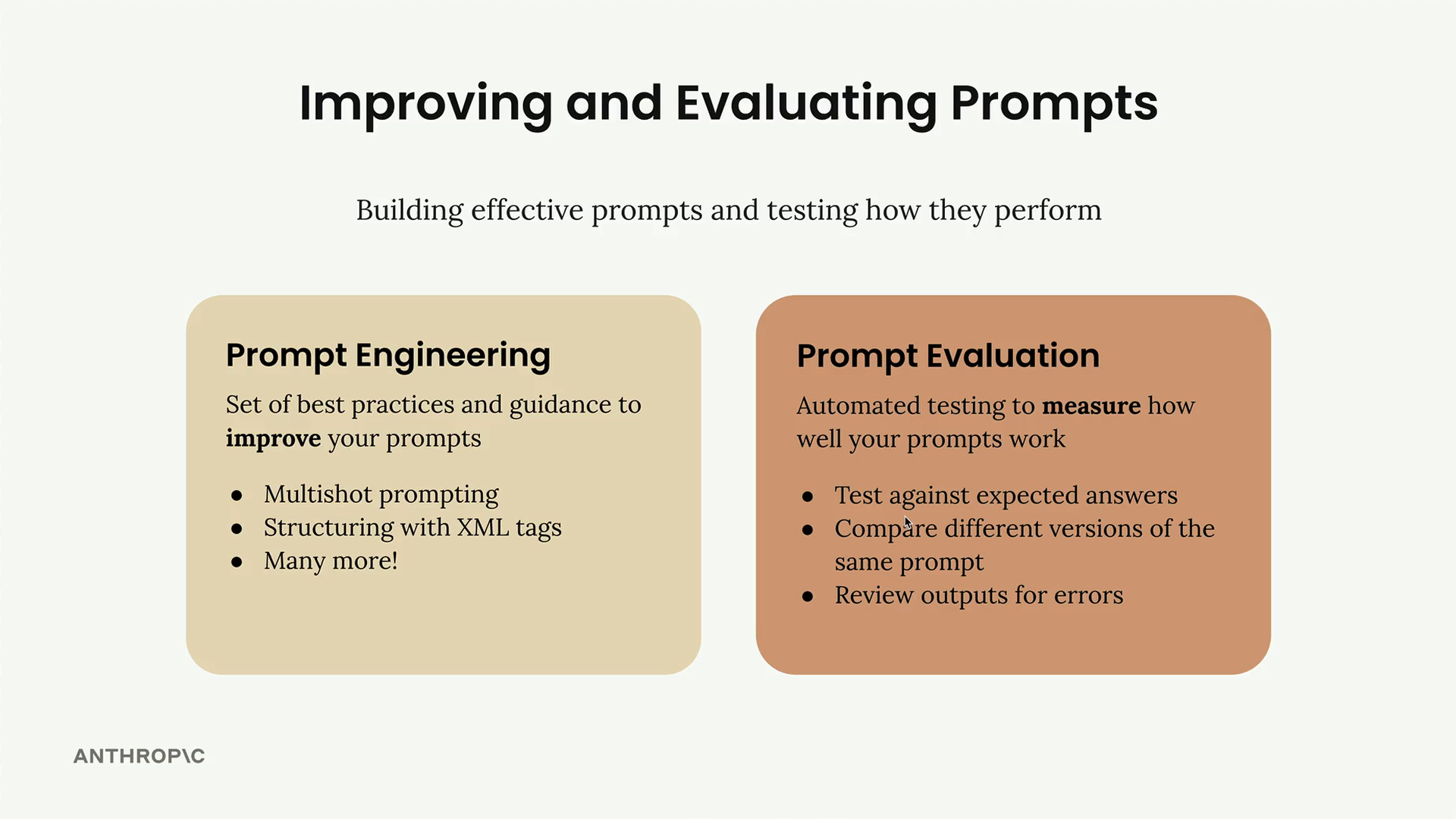

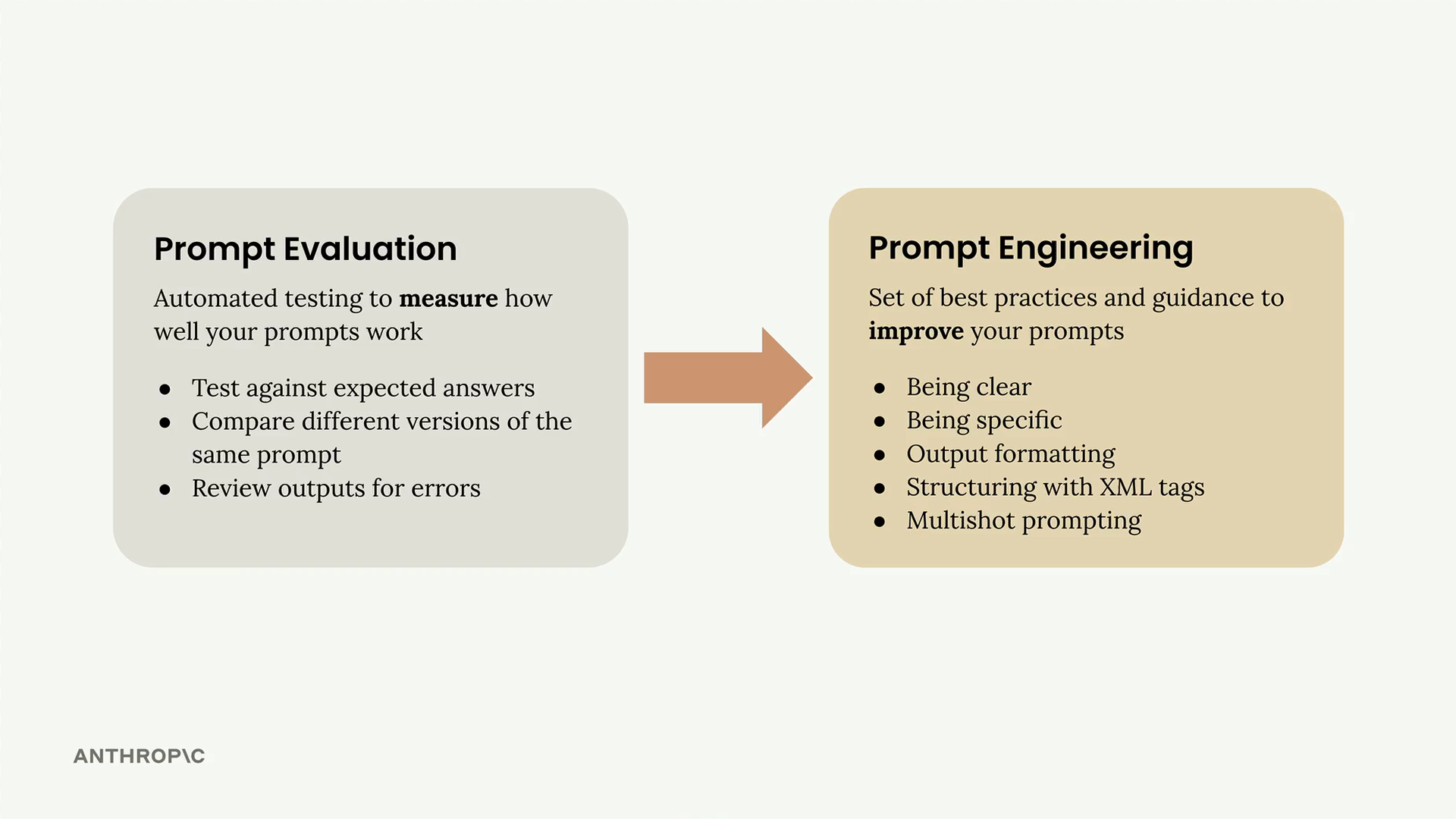

提示词评估

Prompt Engineering (提示词工程) = 编写/编辑提示词以帮助 Claude 理解请求和期望响应的技术。

Prompt Evaluation (提示词评估) = 使用客观指标自动测试提示词以衡量其有效性。

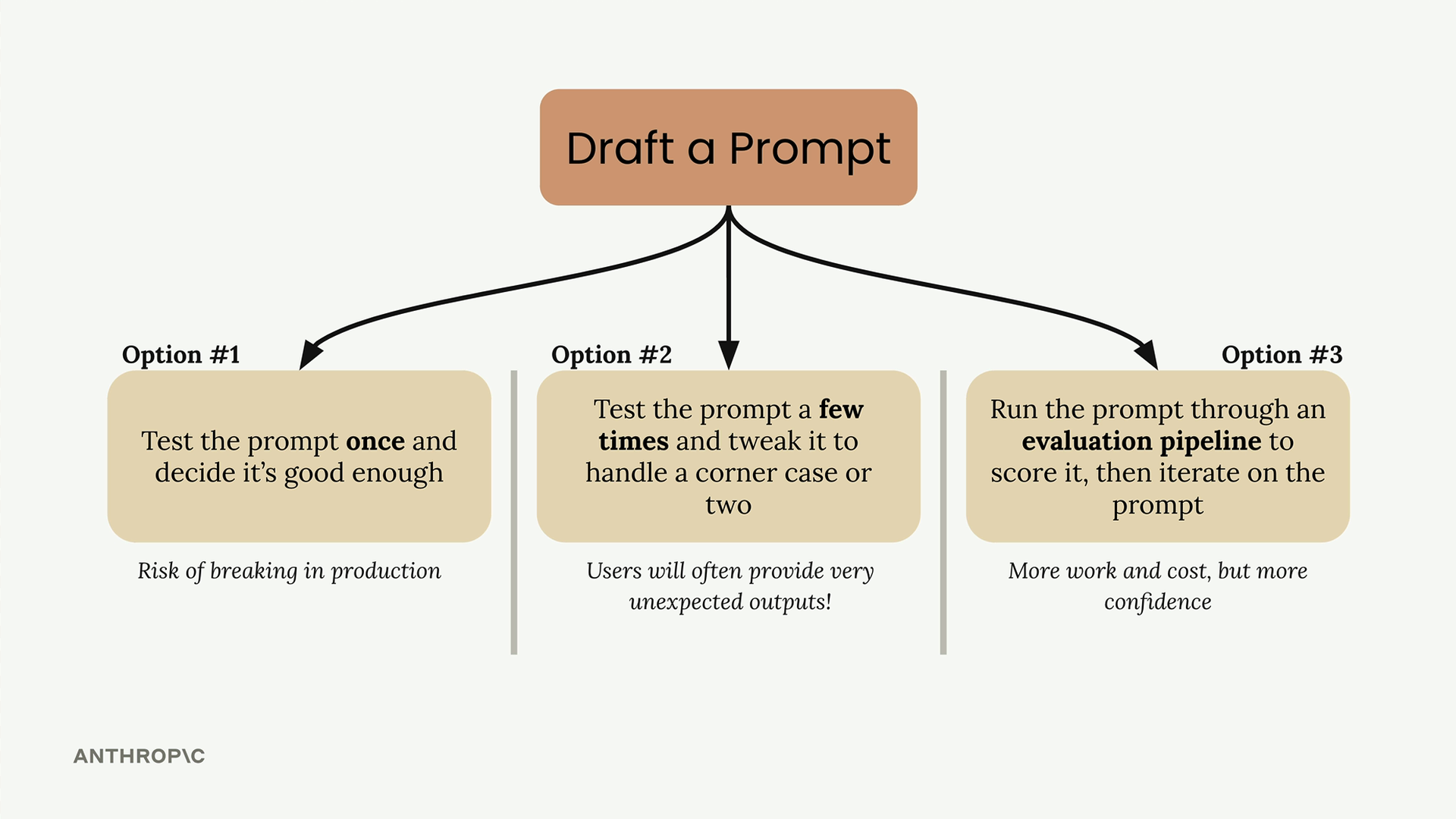

编写提示词后的三种路径:

- 测试一两次,然后部署到生产环境(陷阱)。

- 使用自定义输入进行测试,针对边界情况进行微调(陷阱)。

- 通过评估流水线运行以获得客观评分(推荐)。

核心要点:工程师普遍对提示词测试不足。应使用评估流水线在迭代和部署提示词之前获得客观的性能分数。

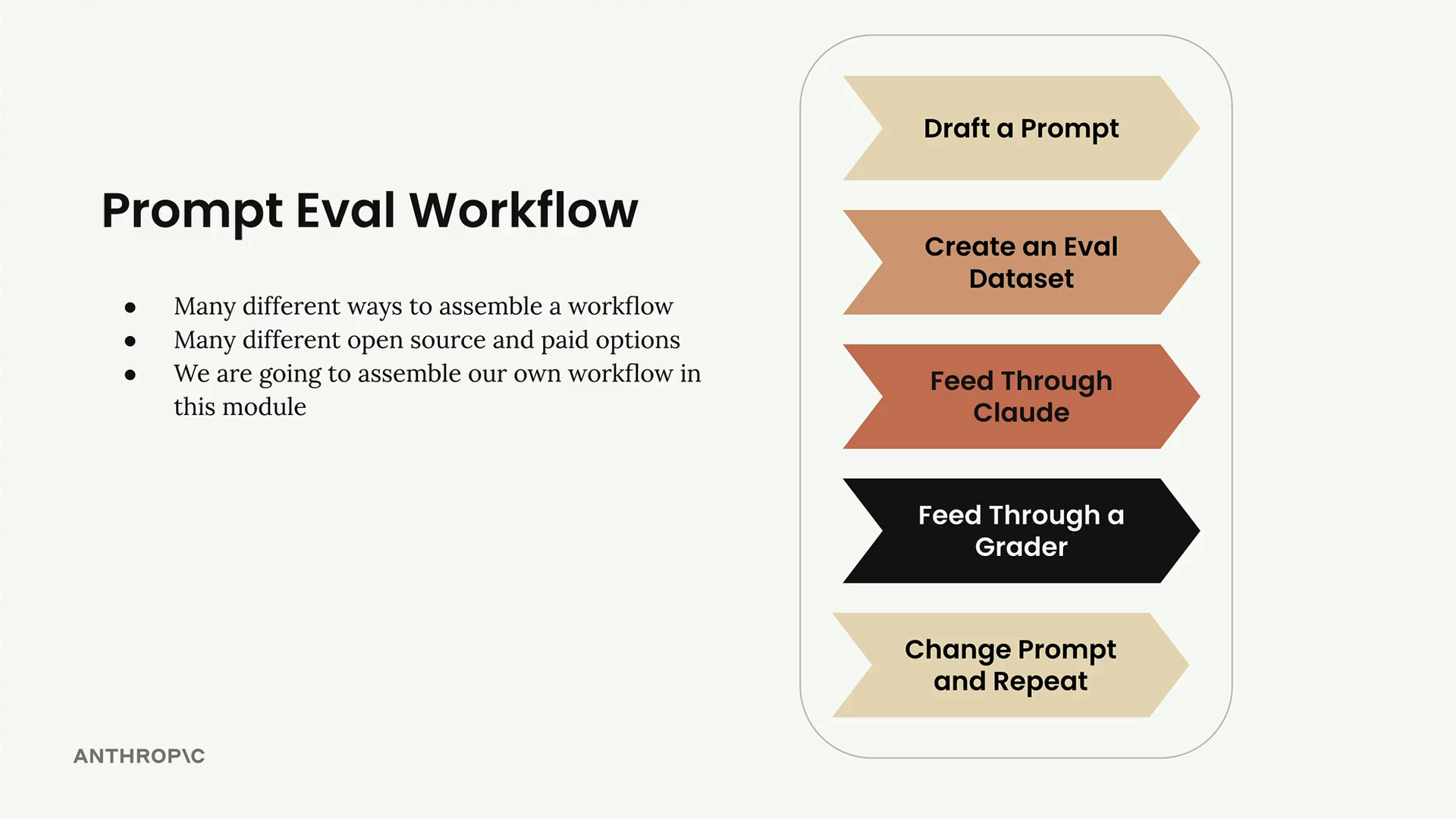

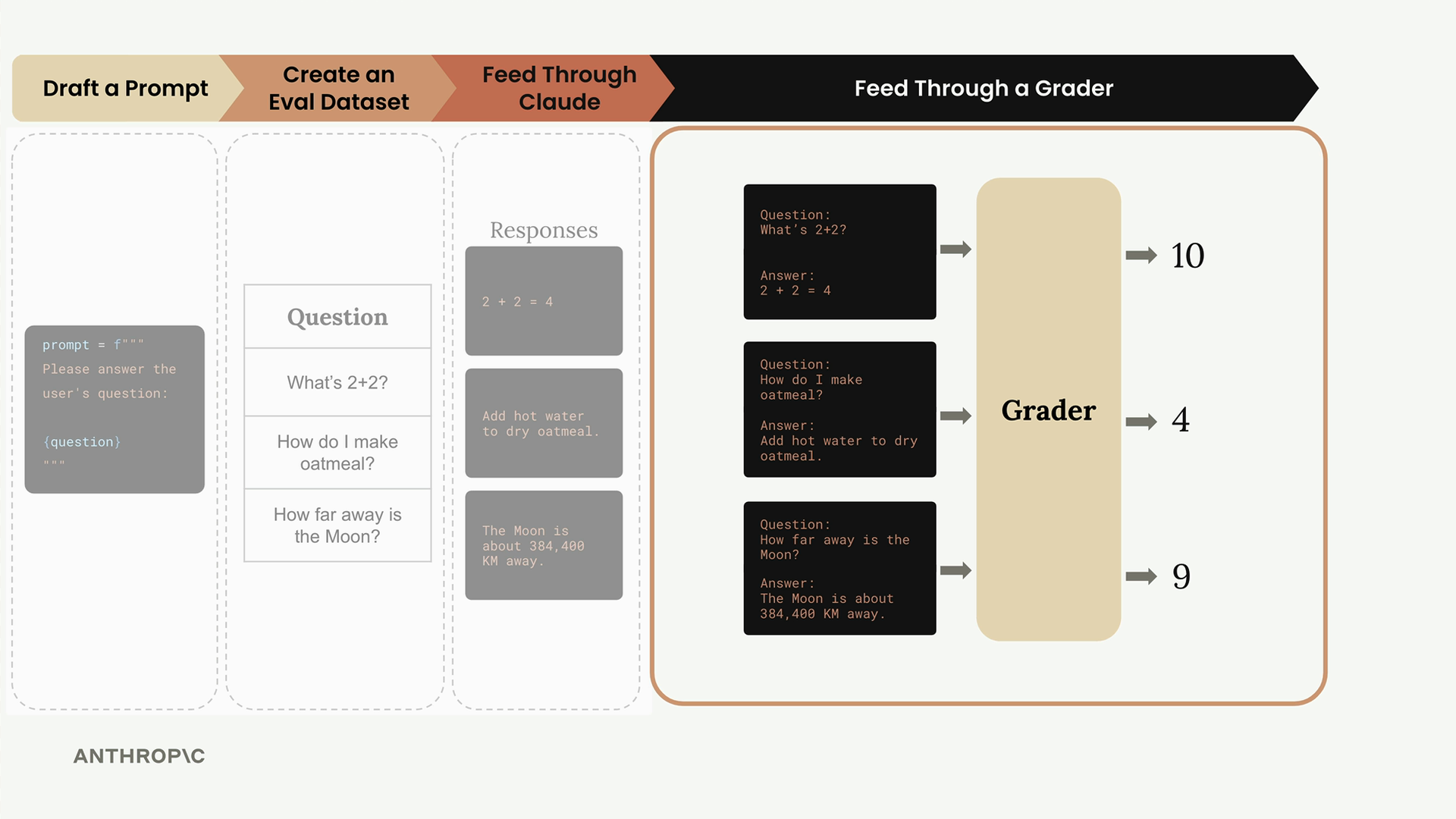

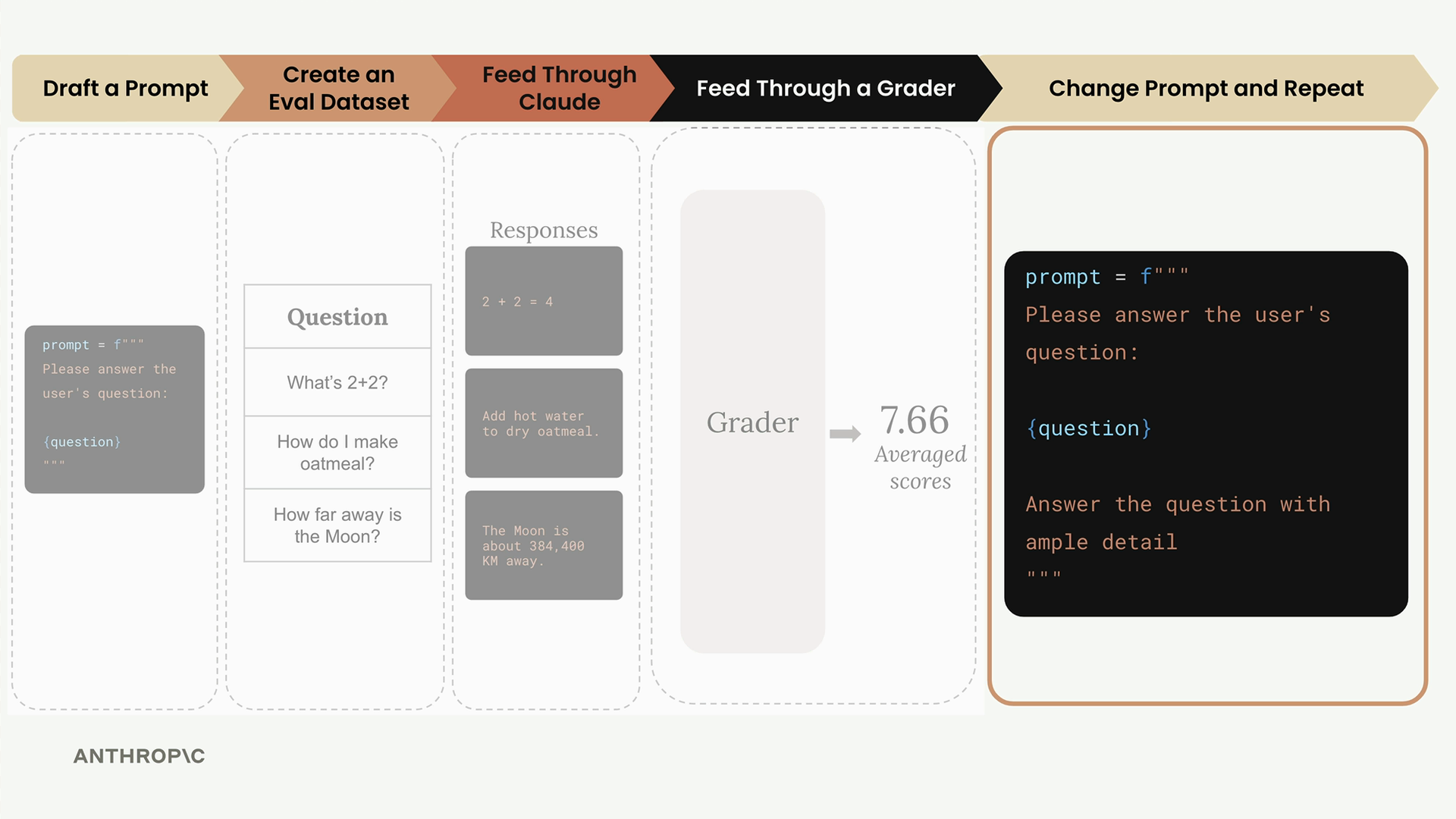

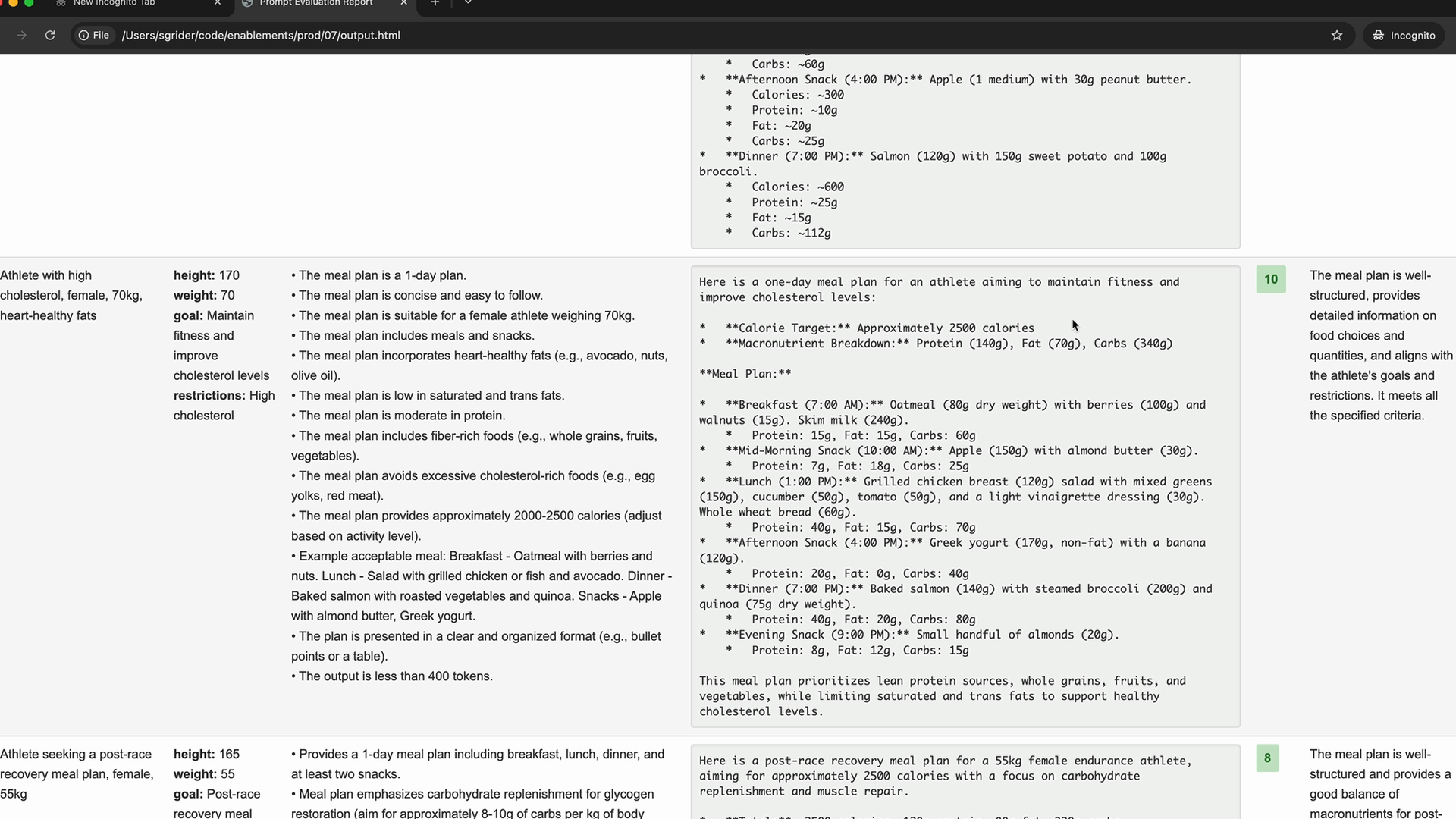

典型的评估工作流

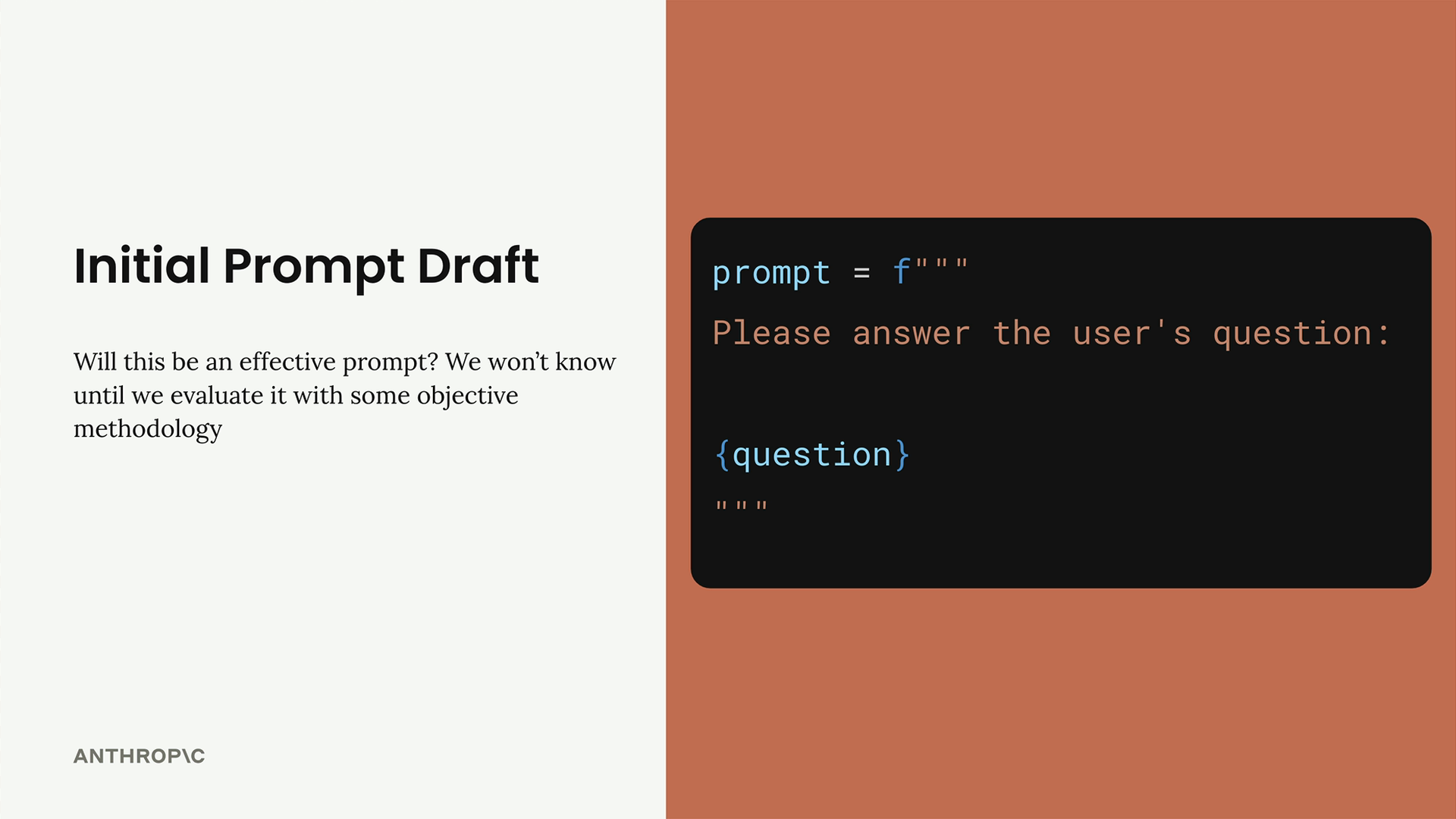

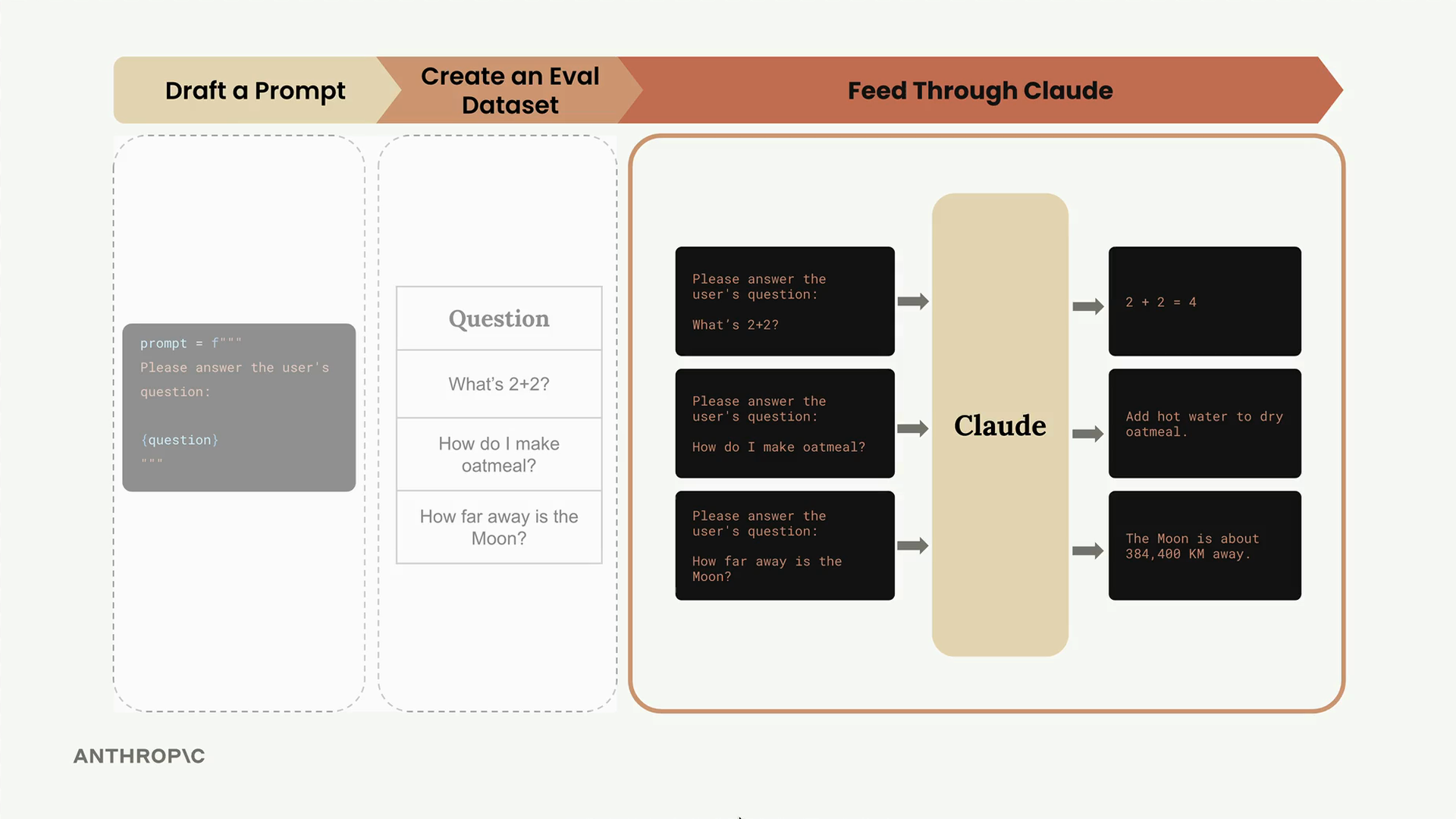

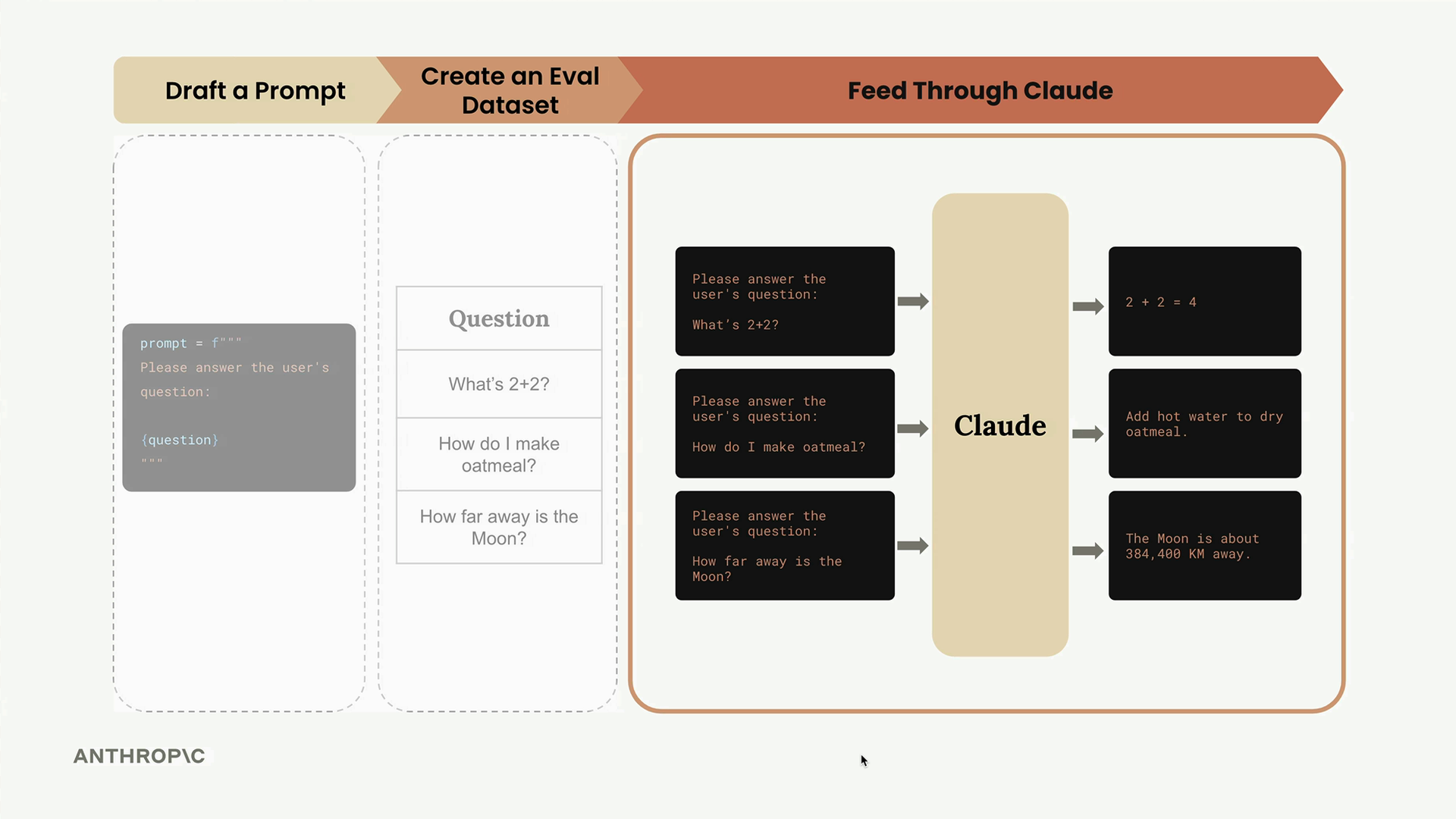

典型的评估工作流 = 一个用于改进提示词的 6 步迭代过程。

第 1 步:编写初始提示词草稿 - 创建一个用于优化的基线提示词。

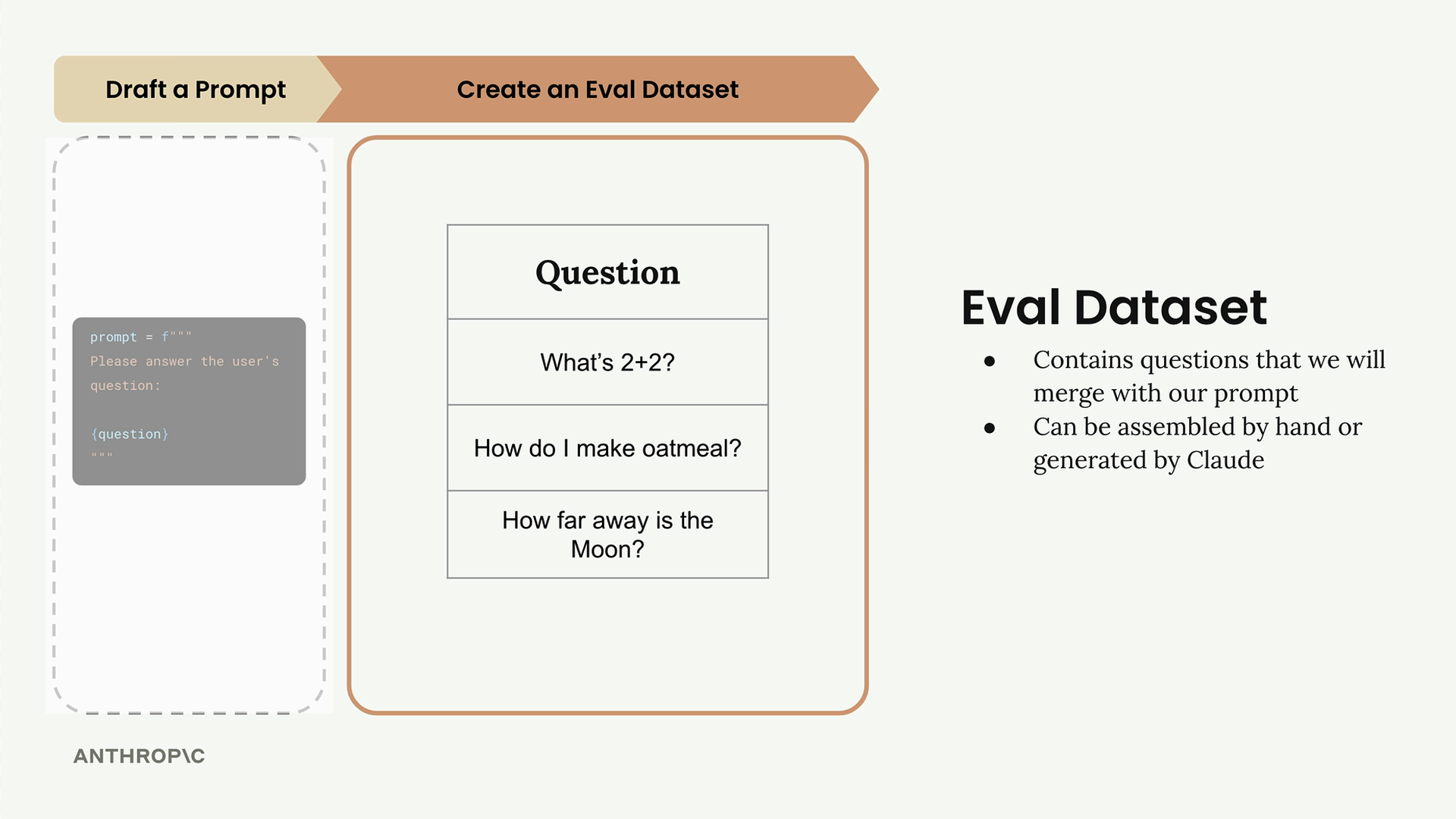

第 2 步:创建评估数据集 - 一组测试输入(可以是 3 个例子,也可以是数千个,手写或由大语言模型生成)。

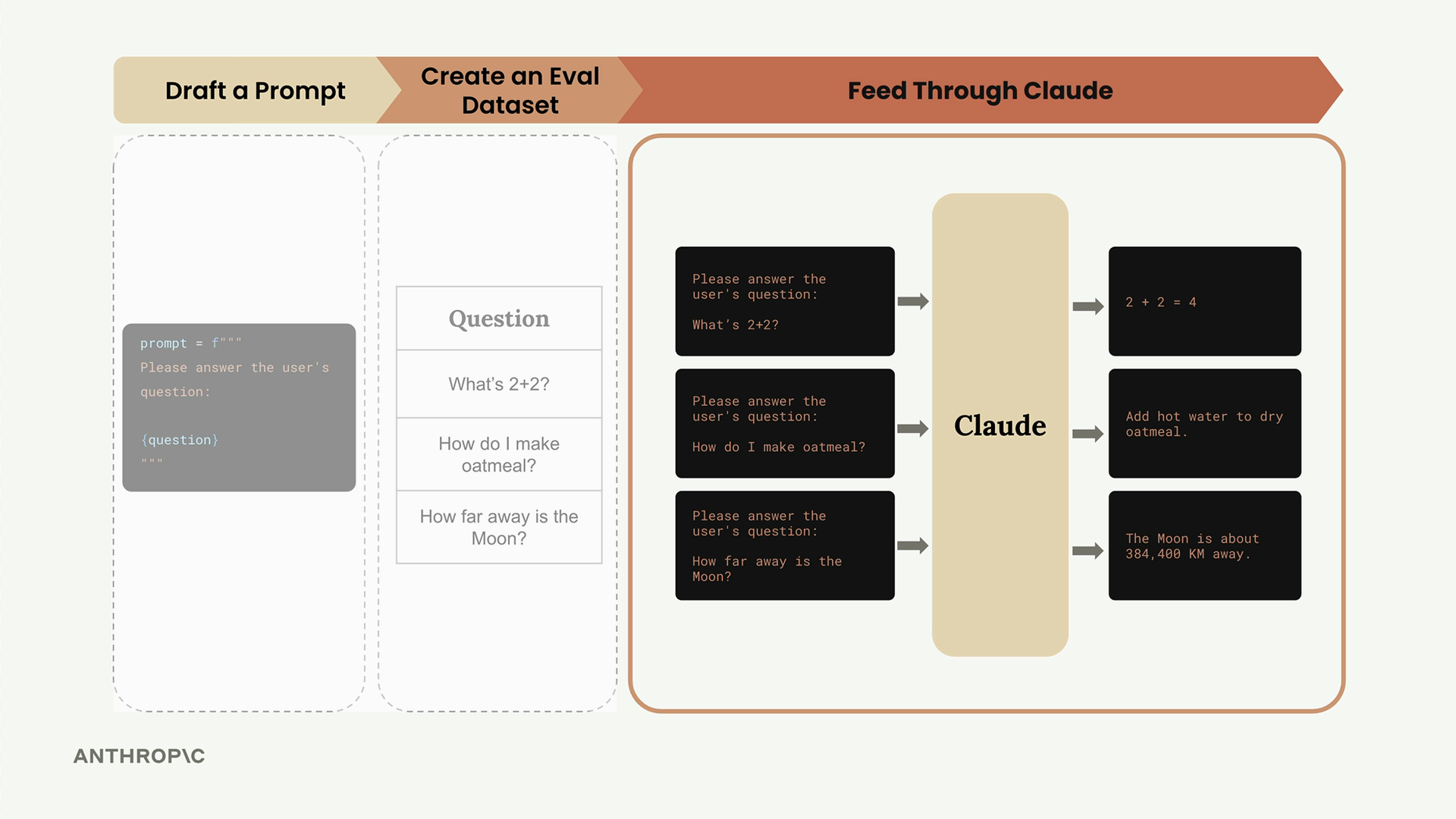

第 3 步:生成提示词变体 - 将每个数据集输入插入到提示词模板中。

第 4 步:获取大语言模型响应 - 将每个提示词变体输入给 Claude,并收集输出。

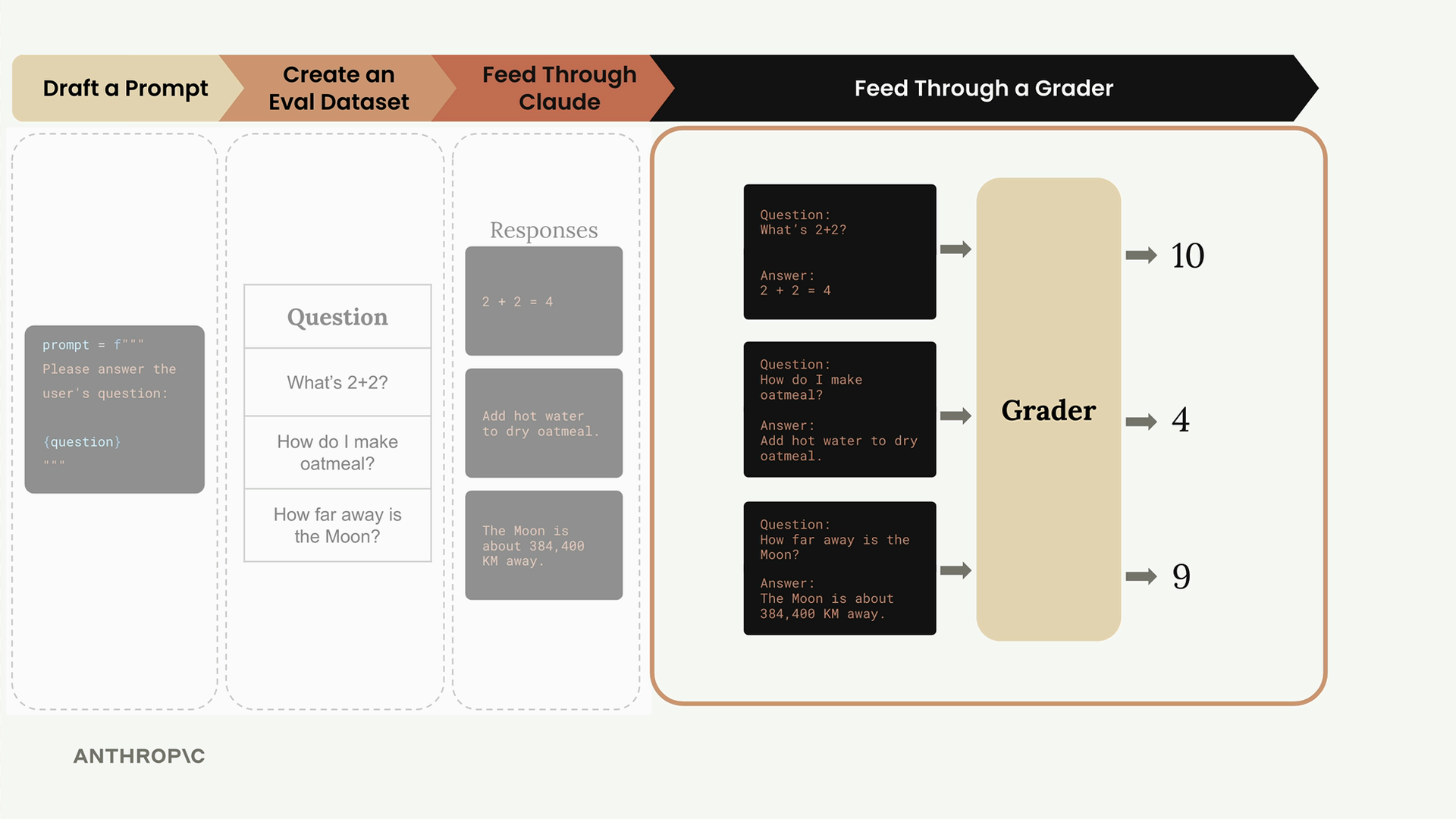

第 5 步:评分响应 - 使用评分系统为每个响应打分(例如,1-10 分制),并计算平均分以评估整体提示词性能。

第 6 步:迭代 - 根据分数修改提示词,重复整个过程,并比较不同版本。

关键点:目前尚无标准方法。有许多开源/付费工具可用。可以从简单的自定义实现开始。评分的复杂性各不相同。客观评分通过 A/B 比较实现了系统性的提示词改进。

生成测试数据集

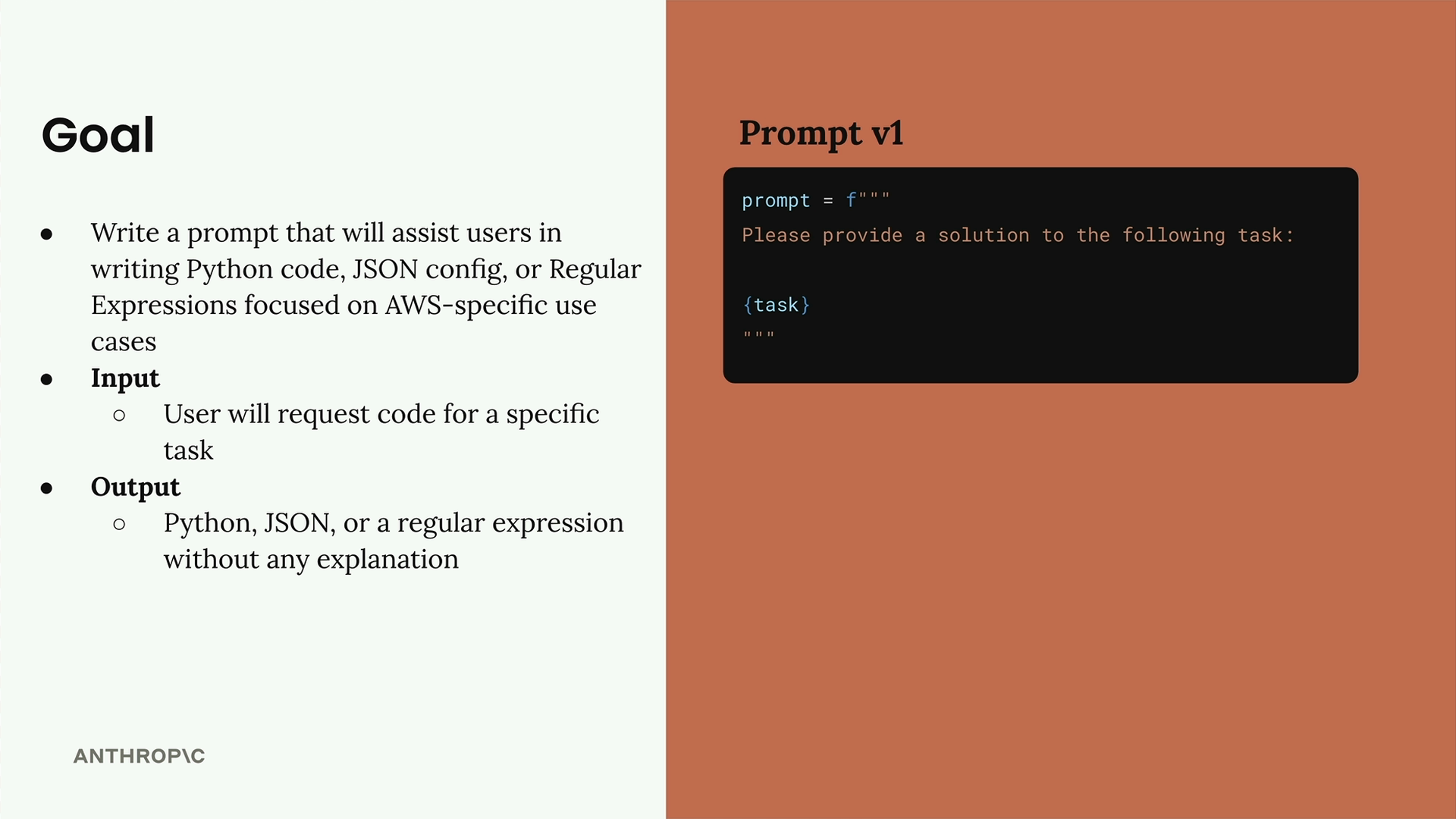

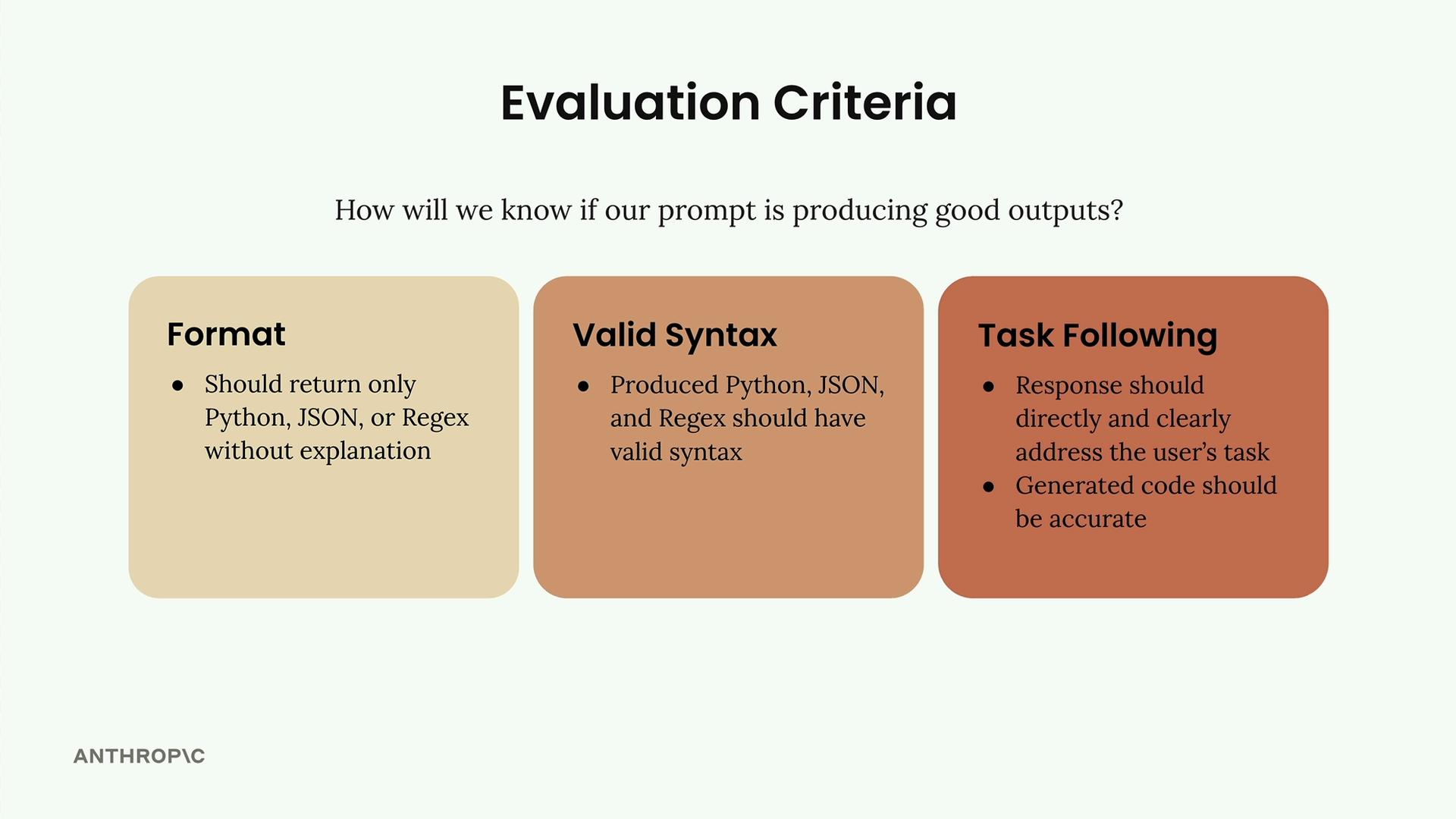

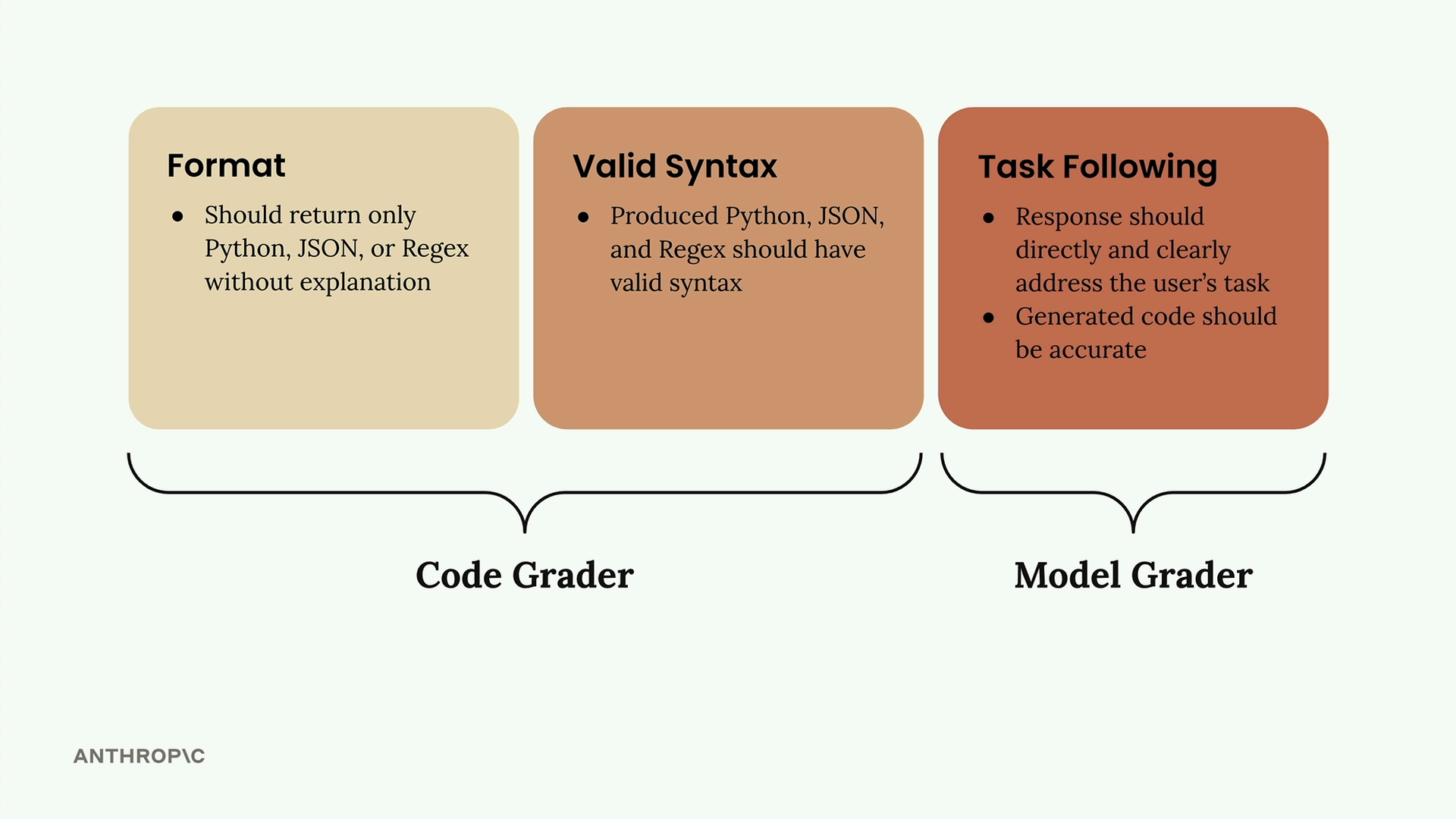

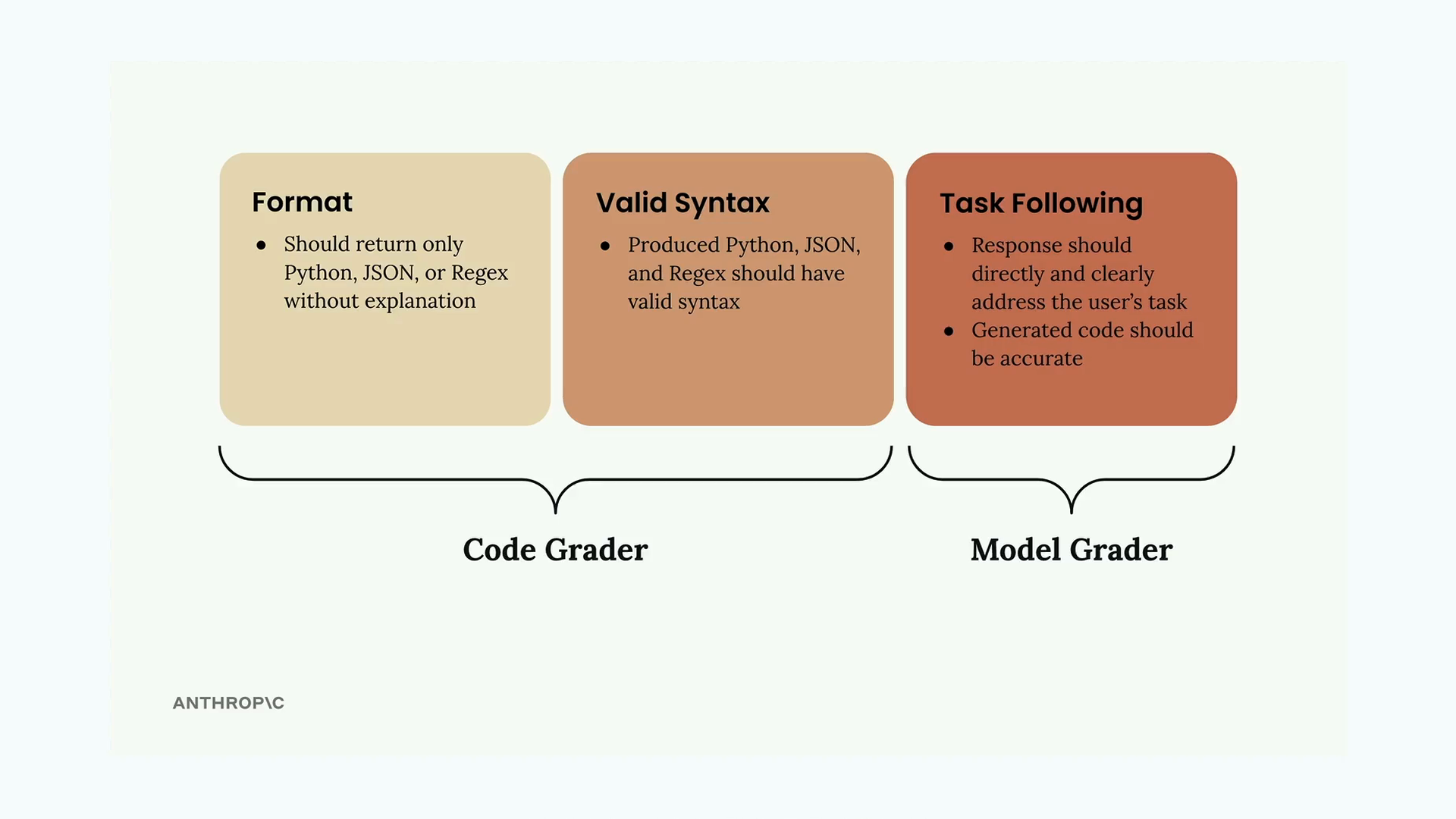

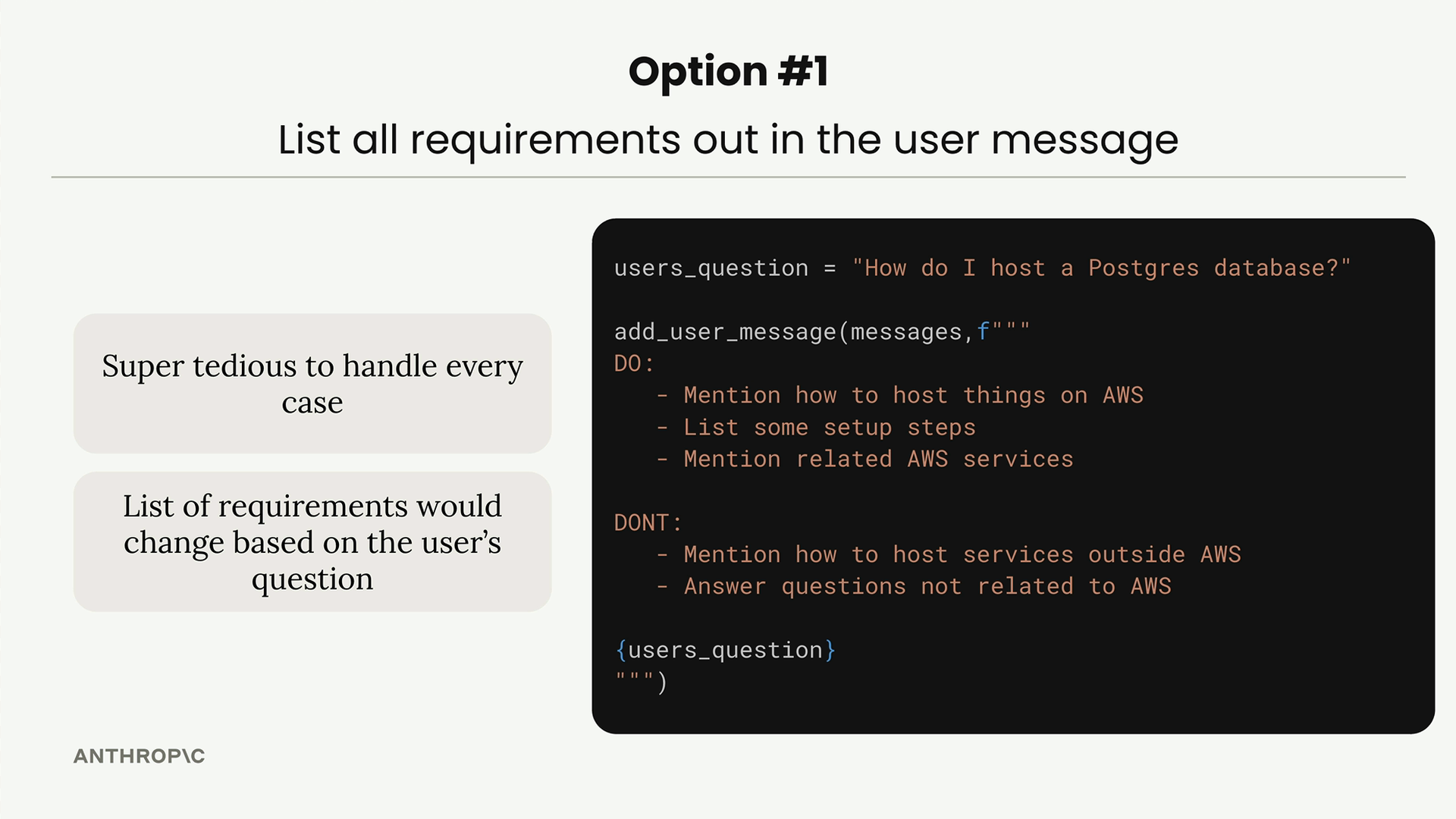

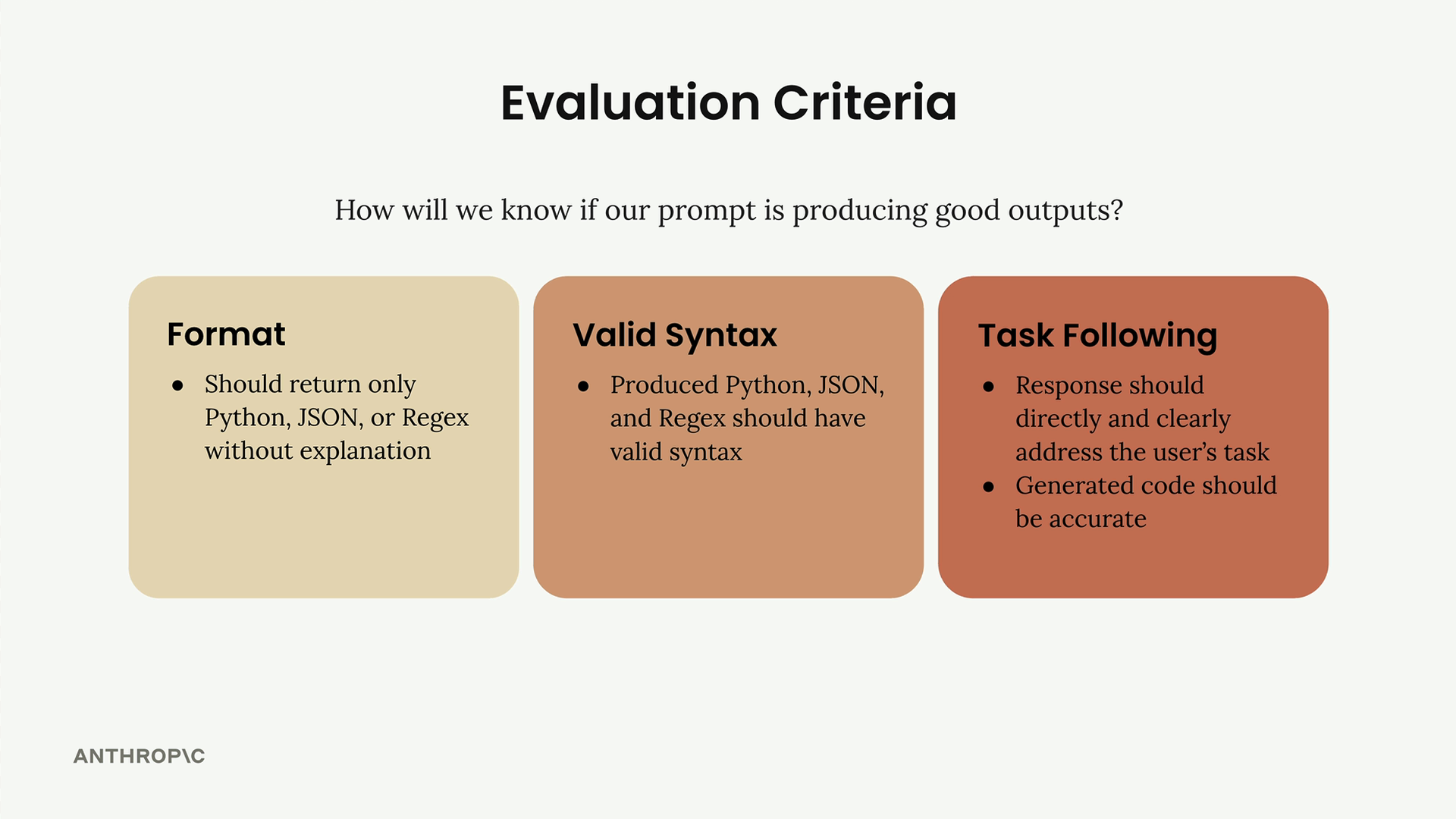

自定义提示词评估工作流 = 构建提示词 + 生成测试数据集 + 评估性能。

目标 = 一个 AWS 代码辅助提示词,它只输出 Python、JSON 配置或正则表达式,不带任何解释。

数据集生成方法 = 手动组装或使用 Claude 自动生成(使用像 Haiku 这样的快速模型进行生成)。

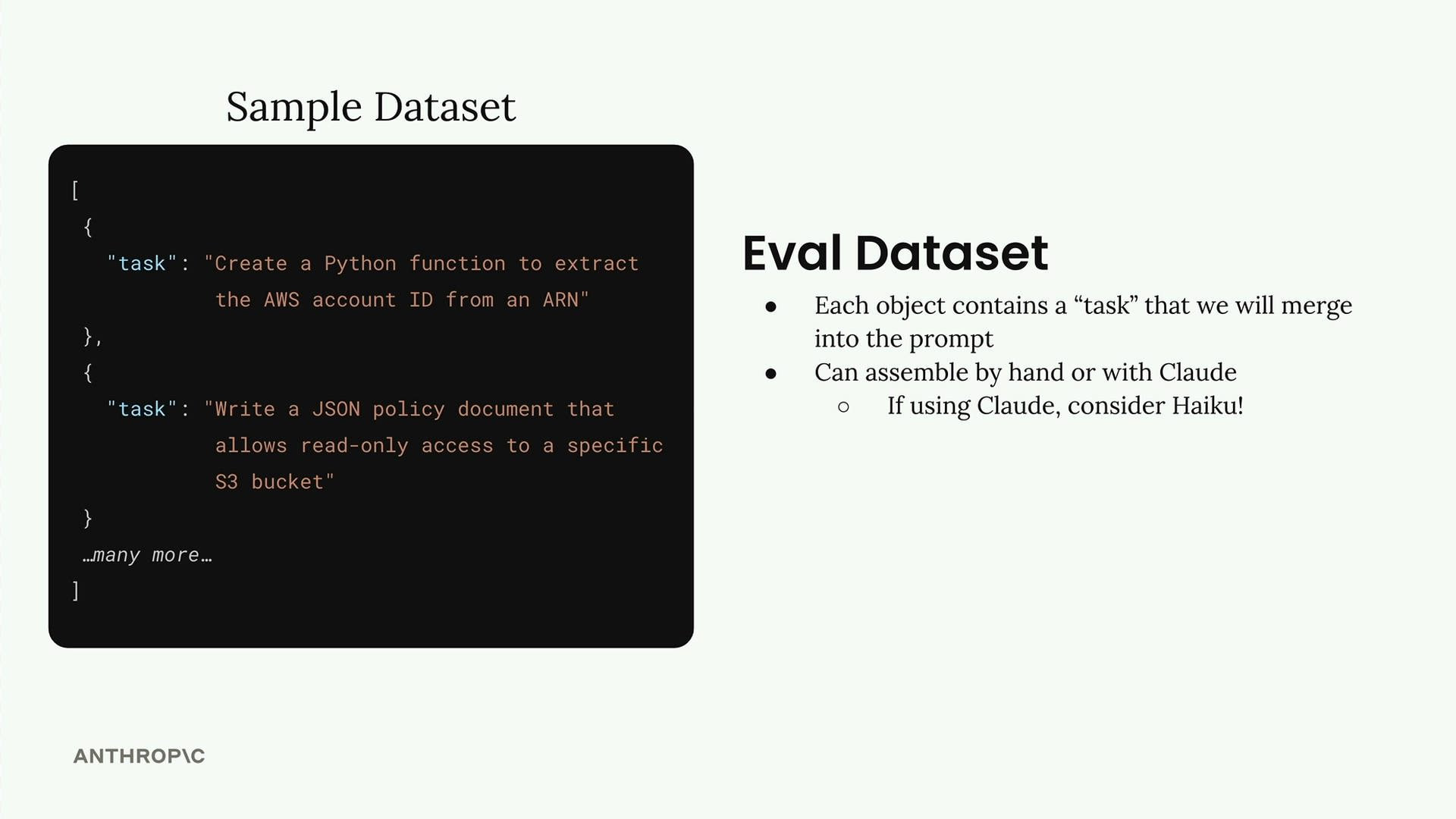

数据集结构 = 一个 JSON 对象数组,每个对象包含一个描述用户请求的 task 属性。

生成过程 = 提示 Claude 创建测试用例 → 使用助手消息预填充 "```json" → 设置停止序列 "```" → 将响应解析为 JSON → 保存到文件。

关键实现 = generate_dataset() 函数,它向 Claude 发送提示词,获取结构化的 JSON 响应(包含测试任务),并将其保存到 dataset.json 文件中,以供后续评估使用。

测试数据集通过在多种输入场景下运行提示词来衡量性能一致性,从而实现系统性评估。

运行评估

评估执行过程 = 将测试用例与提示词合并,通过大语言模型运行,并对输出进行评分。

测试用例 = 数据集中的单个记录(JSON 对象)。

三个核心函数:

run_prompt= 将测试用例与提示词合并,发送给 Claude,并返回输出。run_test_case= 调用run_prompt,对结果进行评分,并返回一个摘要字典。run_eval= 遍历数据集,为每个数据集调用run_test_case,并汇总结果。

基础提示词结构 = "Please solve the following task: [test_case_task]"(v1 起始点)。

当前局限 = 没有输出格式指令,硬编码评分(score=10),Claude 的响应冗长。

运行时间 = 使用 Haiku 模型对整个数据集执行,大约需要 31 秒。

输出格式 = 一个对象数组,每个对象包含 Claude 的输出、原始测试用例和分数。

下一步 = 实现一个合适的评分系统来取代硬编码的分数。

评估流水线核心 = 数据集 + 提示词 + 大语言模型 + 评分器,代码复杂度最低。

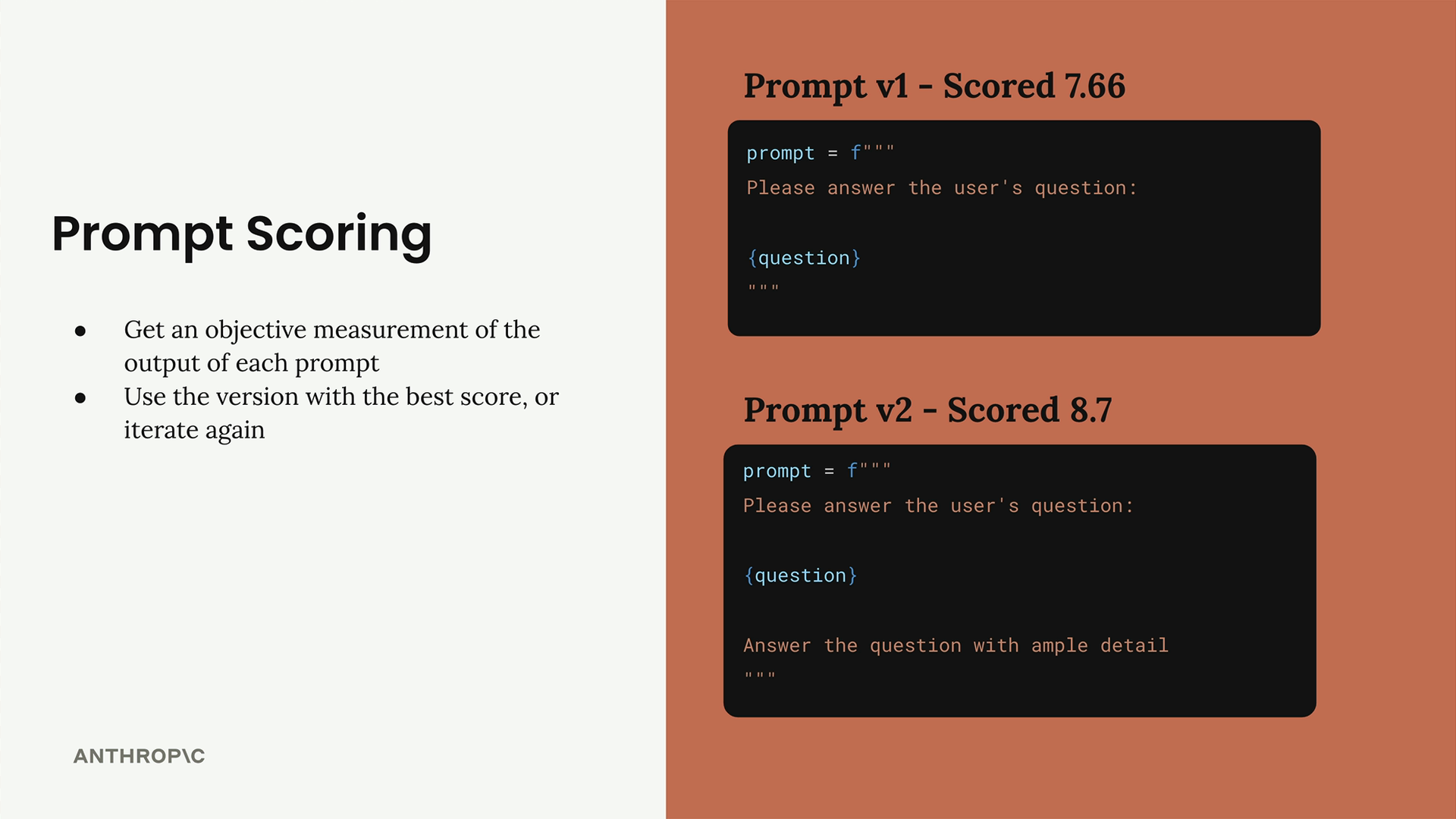

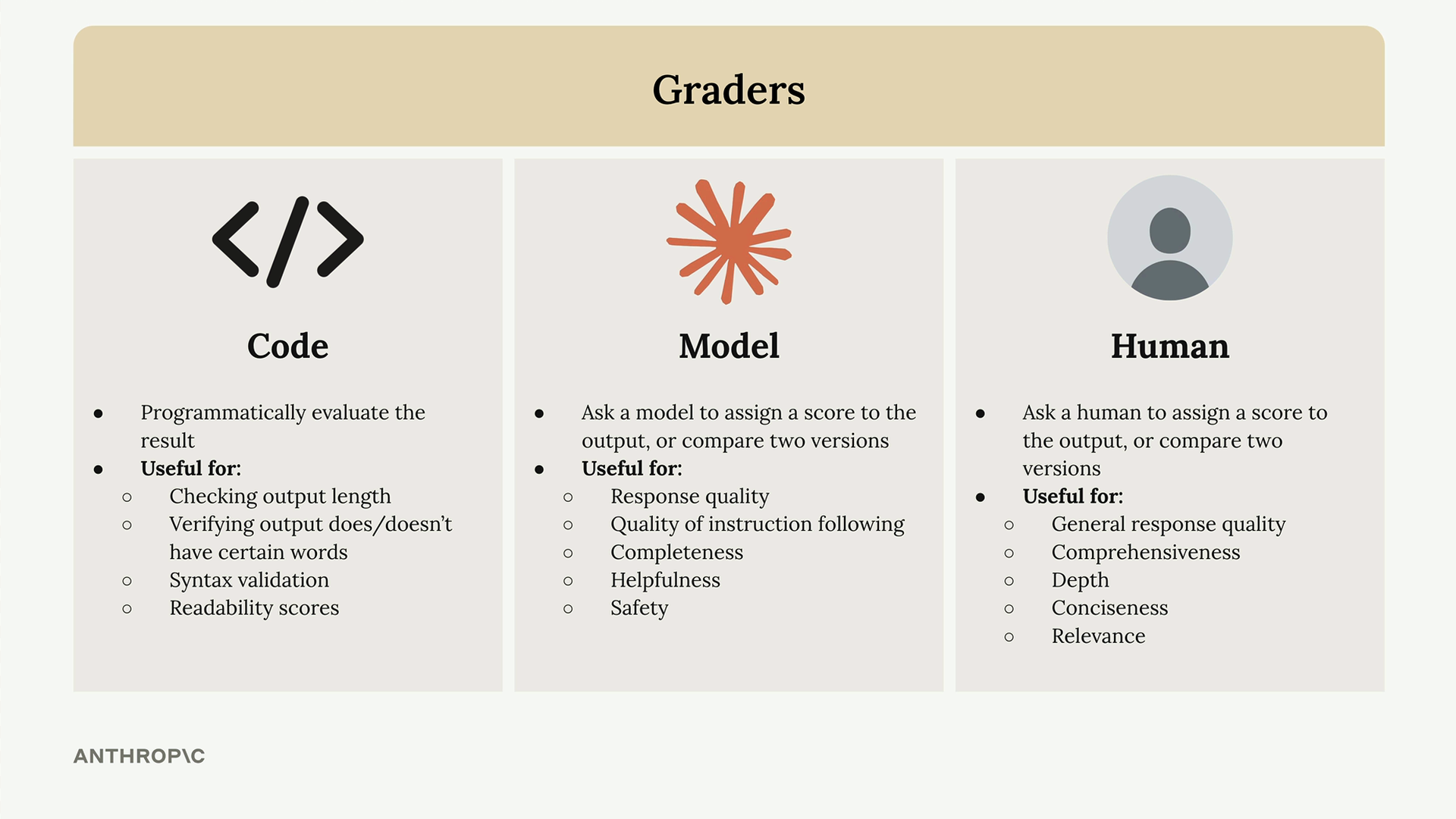

基于模型的评分

Model Based Grading (基于模型的评分) = 一种评估系统,它接收模型输出并分配客观分数(通常为 1-10 分,10 分表示最高质量)。

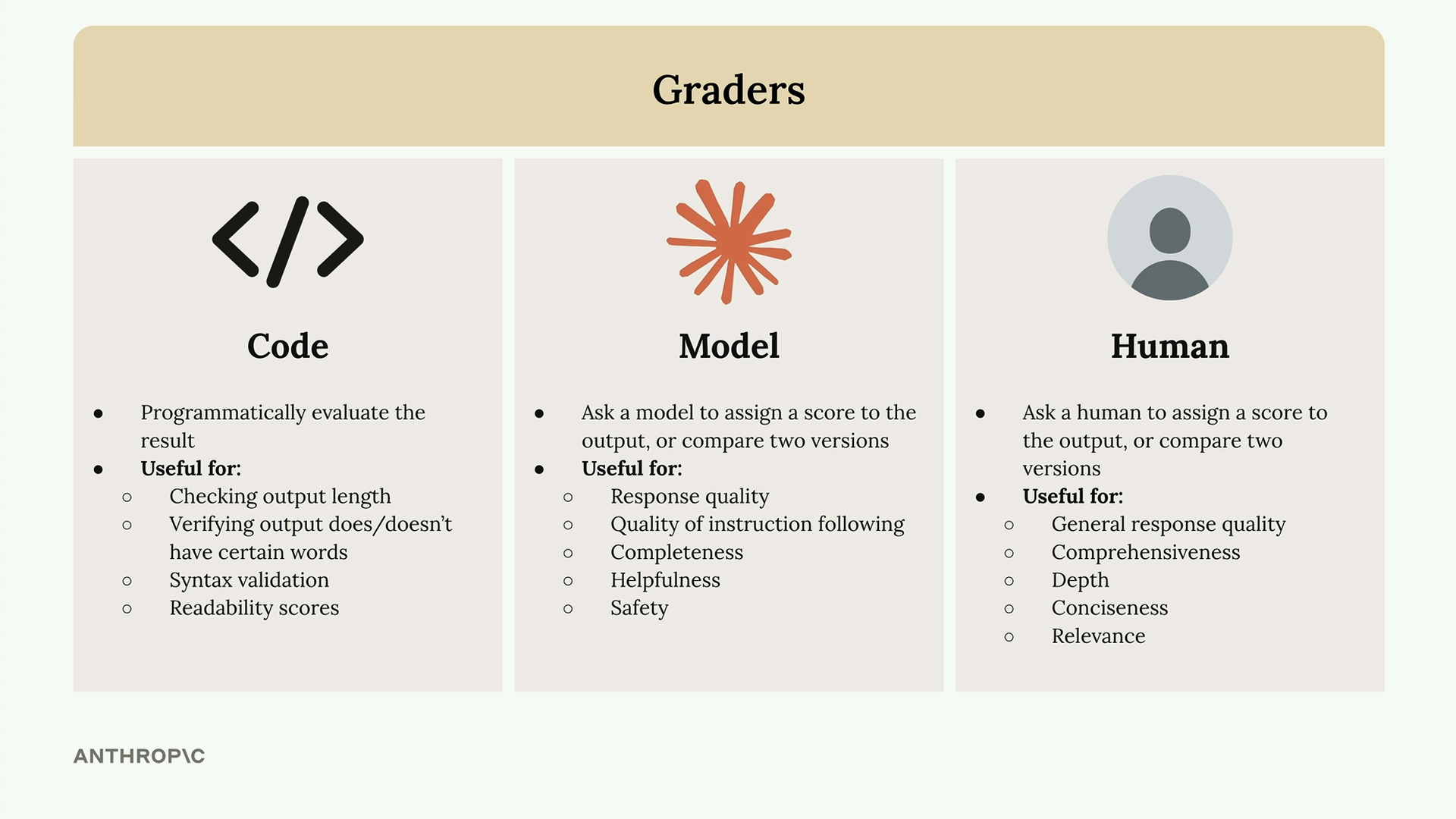

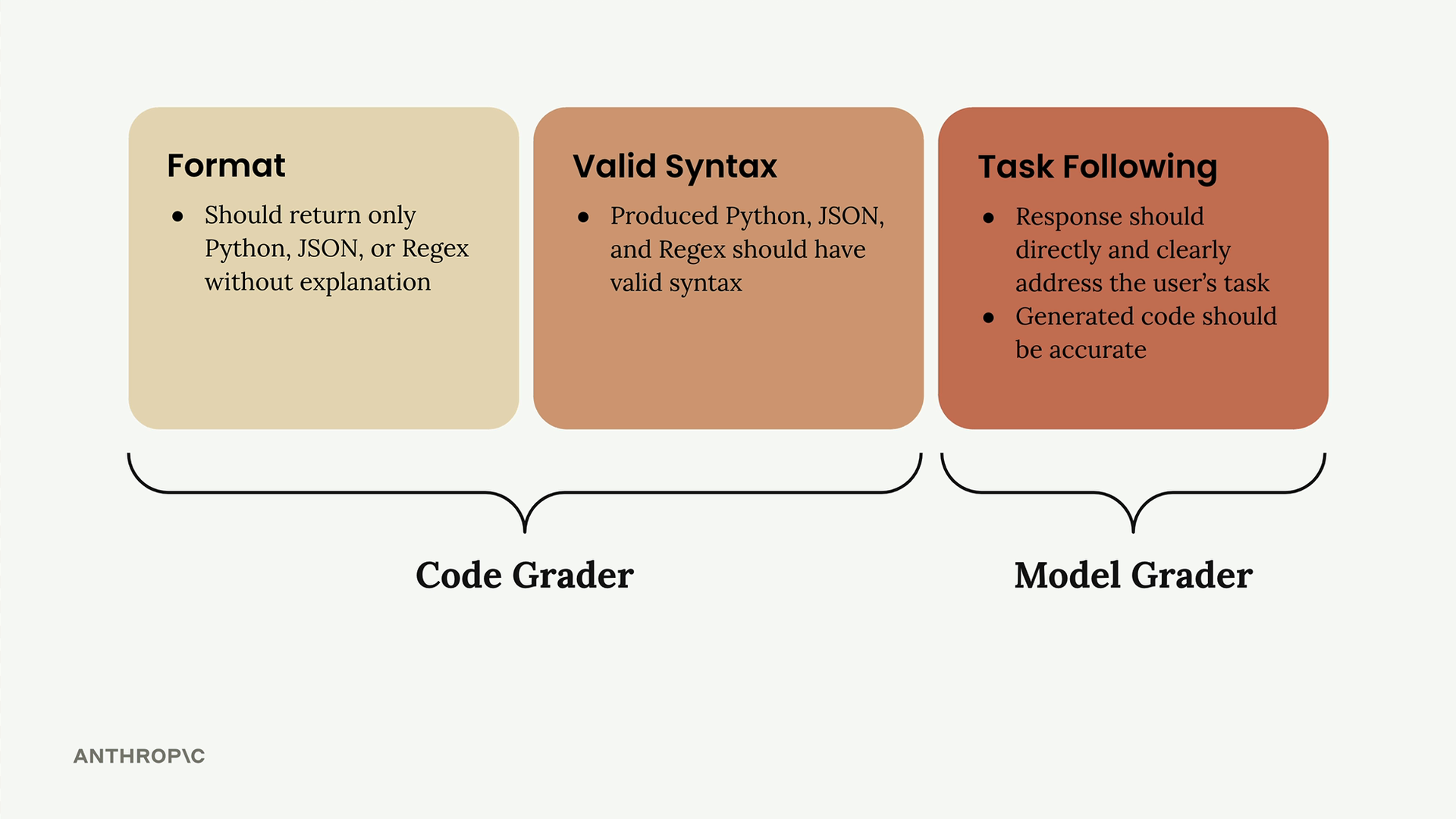

三种评分器类型:

- 代码评分器 = 程序化检查(长度、词语存在性、语法验证、可读性分数)。

- 模型评分器 = 额外的 API 调用来评估原始模型输出,在评估质量/指令遵循度方面非常灵活。

- 人工评分器 = 由人来评估响应,最灵活但耗时且乏味。

关键要求:必须返回客观信号(通常是数值分数)。预先定义评估标准。

模型评分器的实现模式:

- 创建一个详细的提示词,要求提供优点/缺点/推理/分数(不仅仅是分数,以避免默认的中间分数)。

- 使用带有预填充助手消息和停止序列的 JSON 响应格式。

- 从返回的 JSON 中解析出分数和推理。

- 计算所有测试用例的平均分作为最终指标。

模型评分器提供了高度的灵活性,但可能不一致。尽管如此,它仍为提示词优化提供了客观的基线。

基于代码的评分

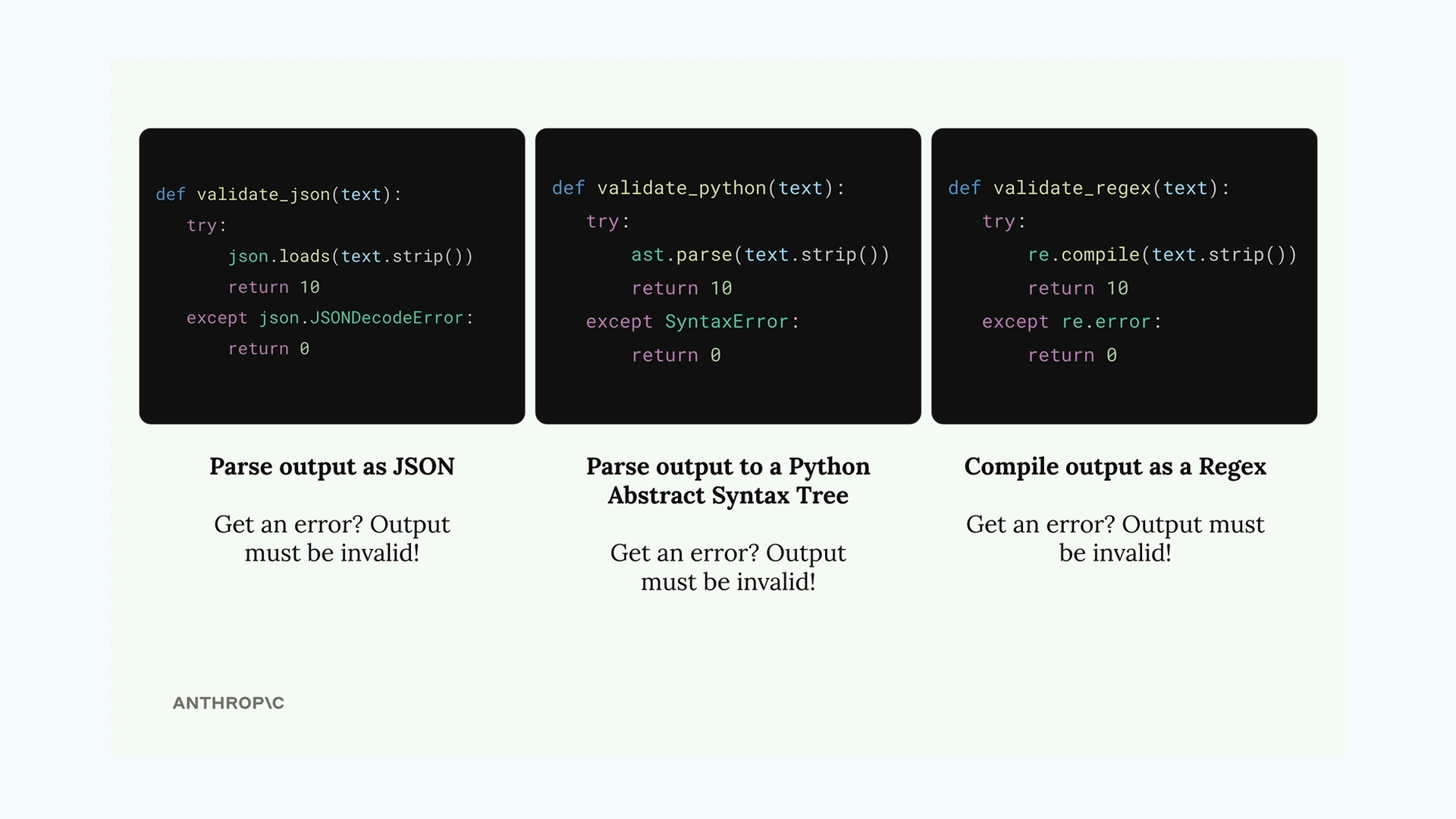

Code Based Grading (基于代码的评分) = 一种针对包含代码、JSON 或正则表达式的大语言模型输出的自动验证系统。

核心实现:

validate_json()= 尝试解析 JSON,如果有效则返回 10,如果出错则返回 0。validate_python()= 尝试进行AST parsing(抽象语法树解析),如果有效则返回 10,如果出错则返回 0。validate_regex()= 尝试编译正则表达式,如果有效则返回 10,如果出错则返回 0。

数据集要求:

- 必须包含一个 "format" 键,指定预期的输出类型(JSON/Python/RegEx)。

- 通过修改提示词模板进行更新,以实现自动化数据集生成。

提示词工程:

- 指示模型仅以原始代码/JSON/正则表达式响应。

- 无注释、解释或评论。

- 使用预填充的助手消息和 ```code``` 代码块。

- 添加停止序列以提取干净的输出。

评分系统:

- 最终分数 = (模型分数 + 语法分数) / 2。

- 结合了语义评估和语法验证。

- 能够衡量正确性和技术有效性。

关键局限 = 需要已知预期的格式才能正确选择验证器。

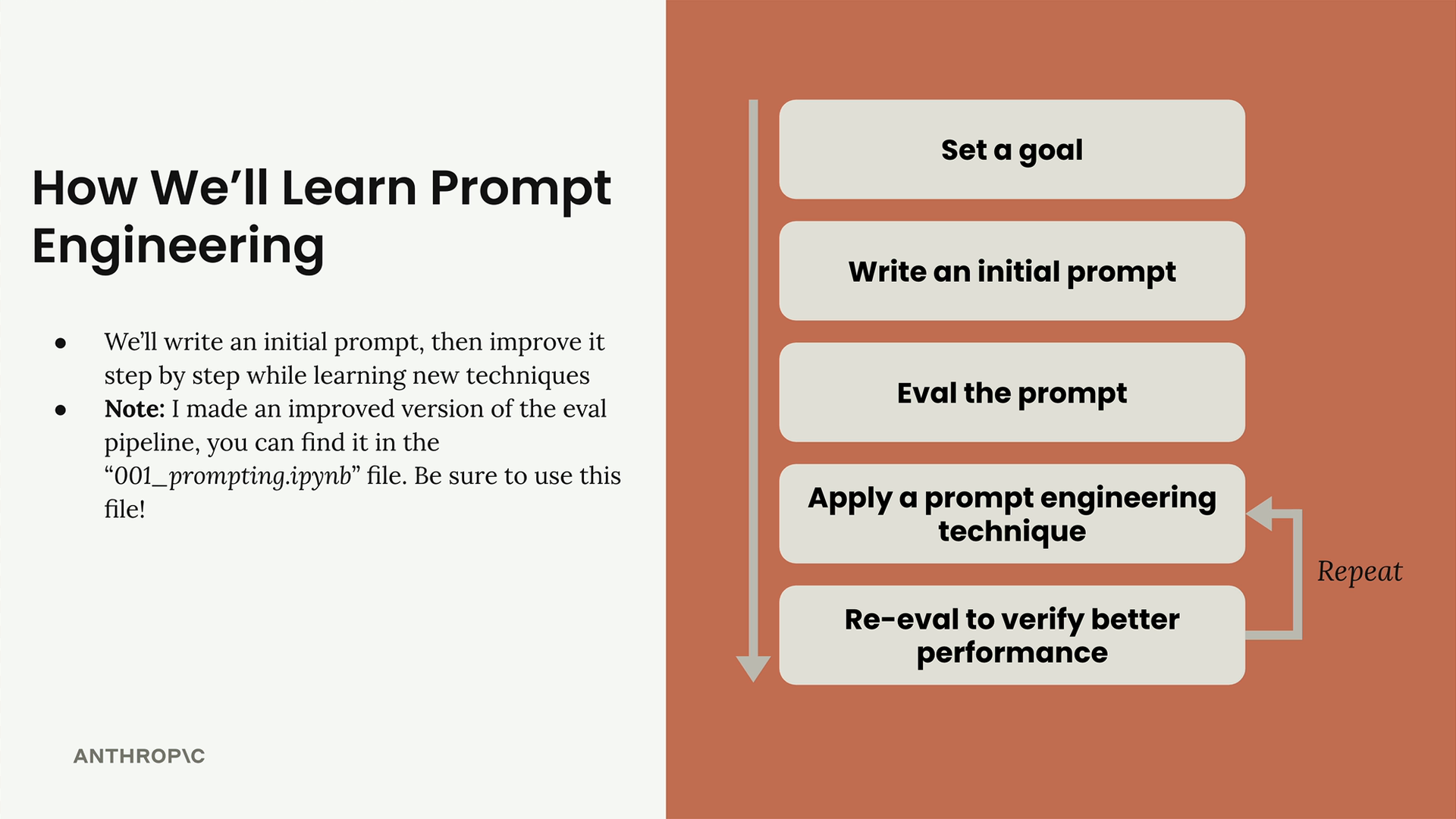

提示词工程

Prompt Engineering (提示词工程) = 改进提示词以从语言模型获得更可靠、更高质量输出的技术。

模块结构:从一个初始的差提示词开始 → 逐步应用提示词工程技术 → 在每种技术应用后评估改进效果 → 观察性能随时间的提升。

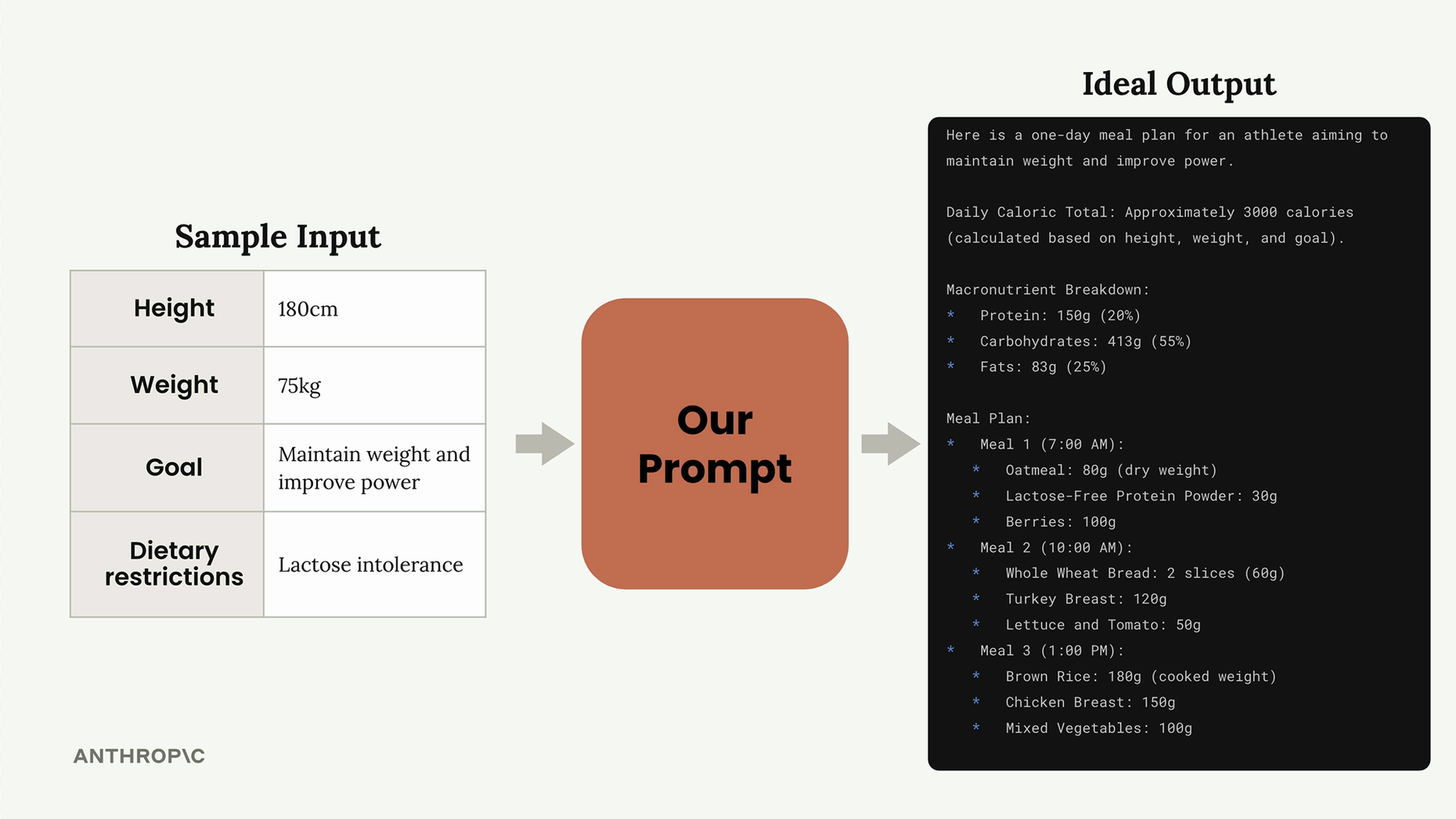

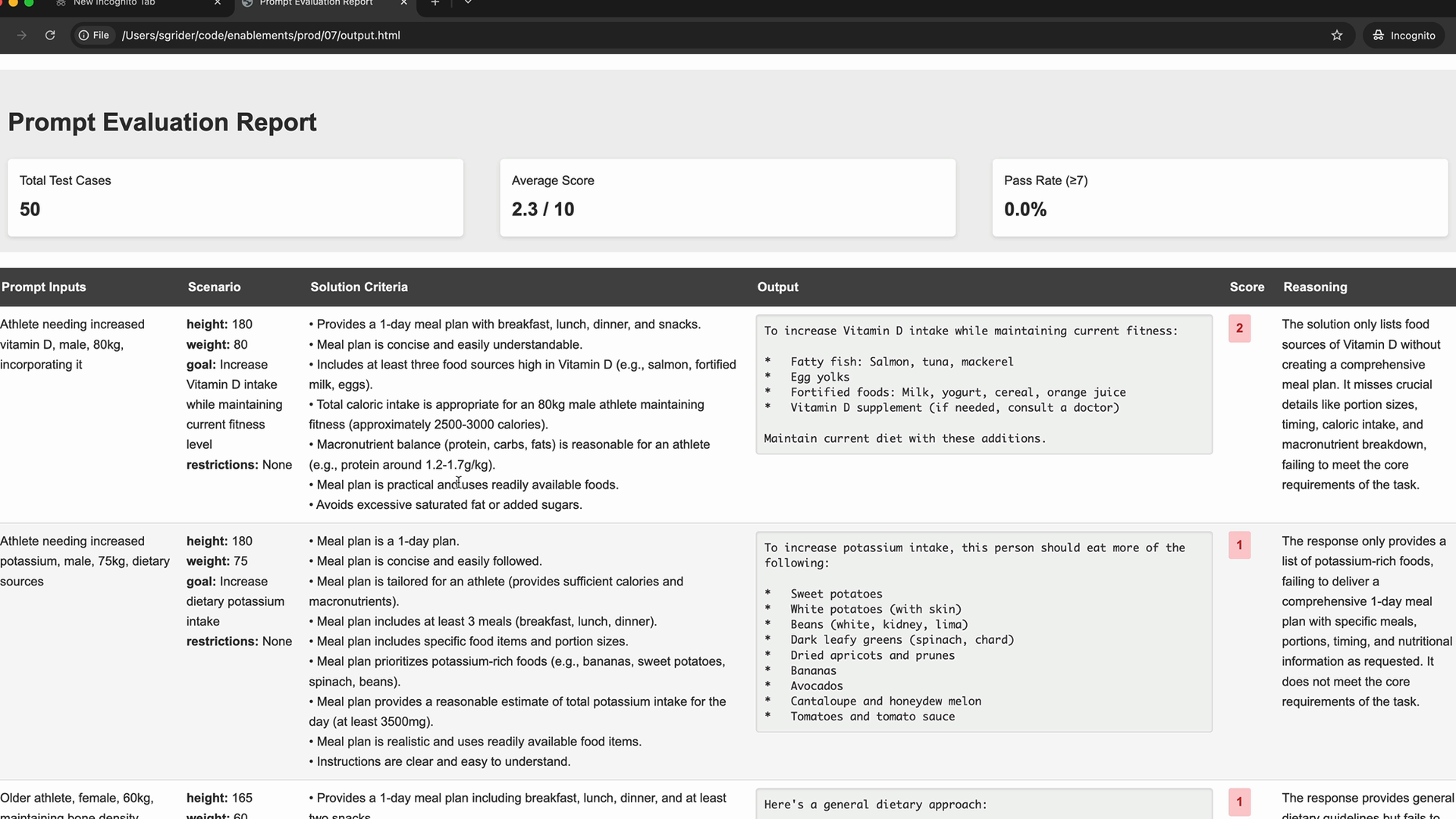

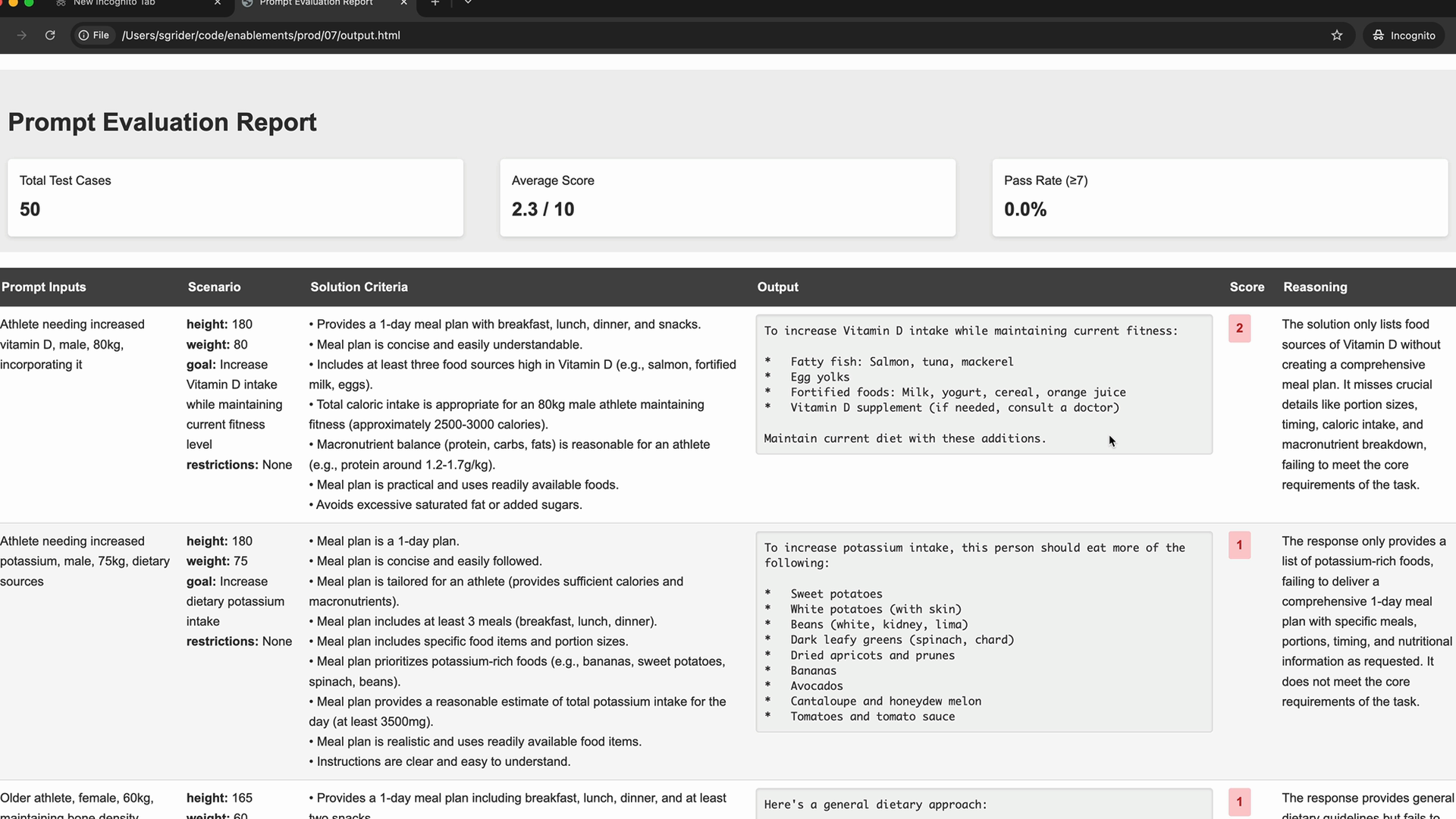

示例目标:根据身高、体重、身体目标和饮食限制,为运动员生成一日膳食计划。

技术设置:

- 更新了评估流水线,采用了灵活的提示词评估器类。

- 支持

concurrency(并发)(根据速率限制调整max_concurrent_tasks)。 generate_dataset()方法根据指定的输入创建测试用例。run_prompt()函数单独处理每个测试用例。

关键组件:

prompt_input_spec= 定义所需提示词输入的字典。extra_criteria= 用于模型评分的额外验证要求。output.html= 显示测试用例结果和分数的格式化评估报告。

过程:编写初始提示词 → 插入测试用例输入 → 运行评估 → 应用工程技术 → 重新评估 → 重复直至性能满意。

初始结果:对于基础提示词,预计得分会较差(例如:2.32),尤其是在使用能力较弱的模型时。随着技术的应用,分数会提高。

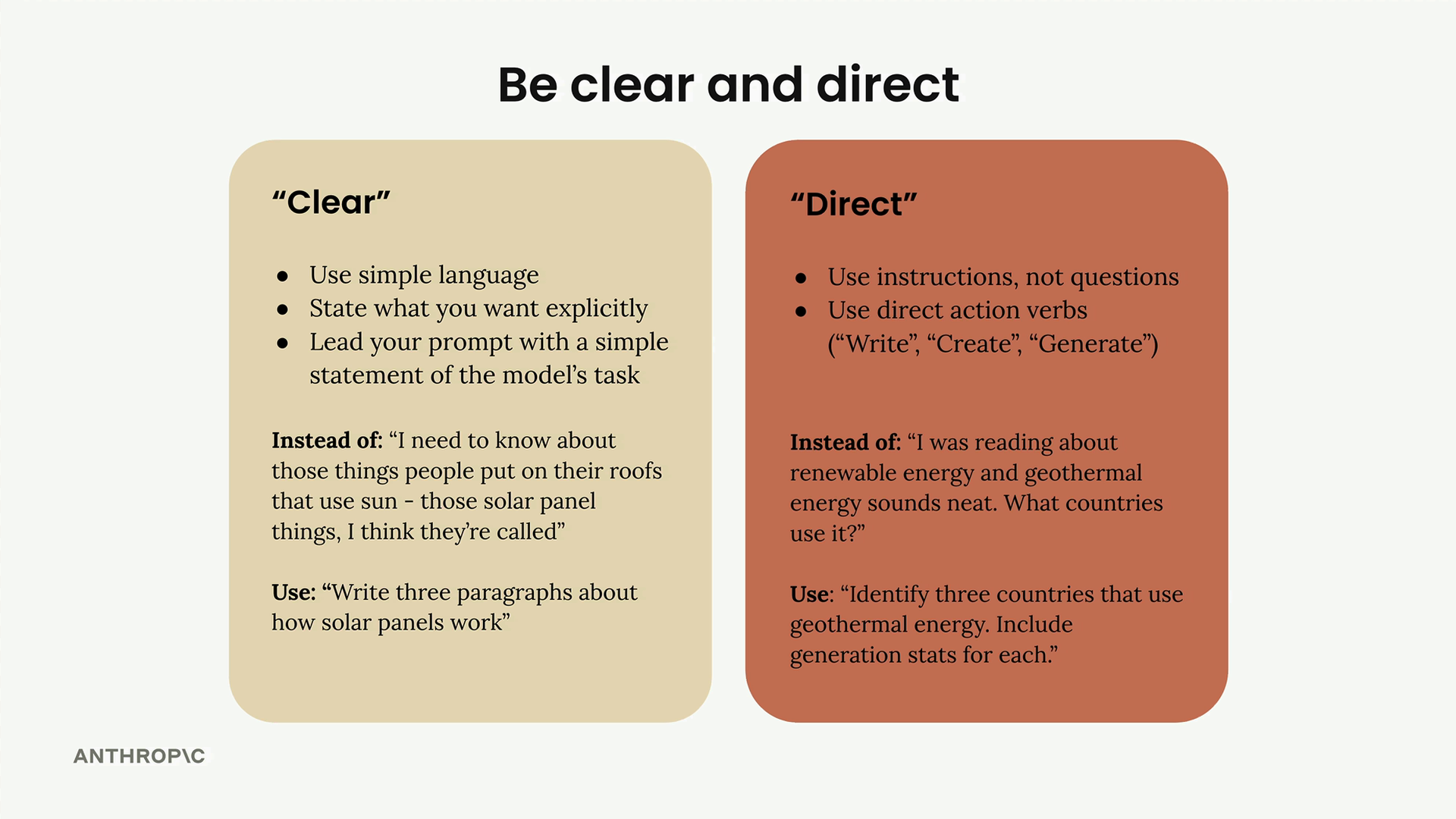

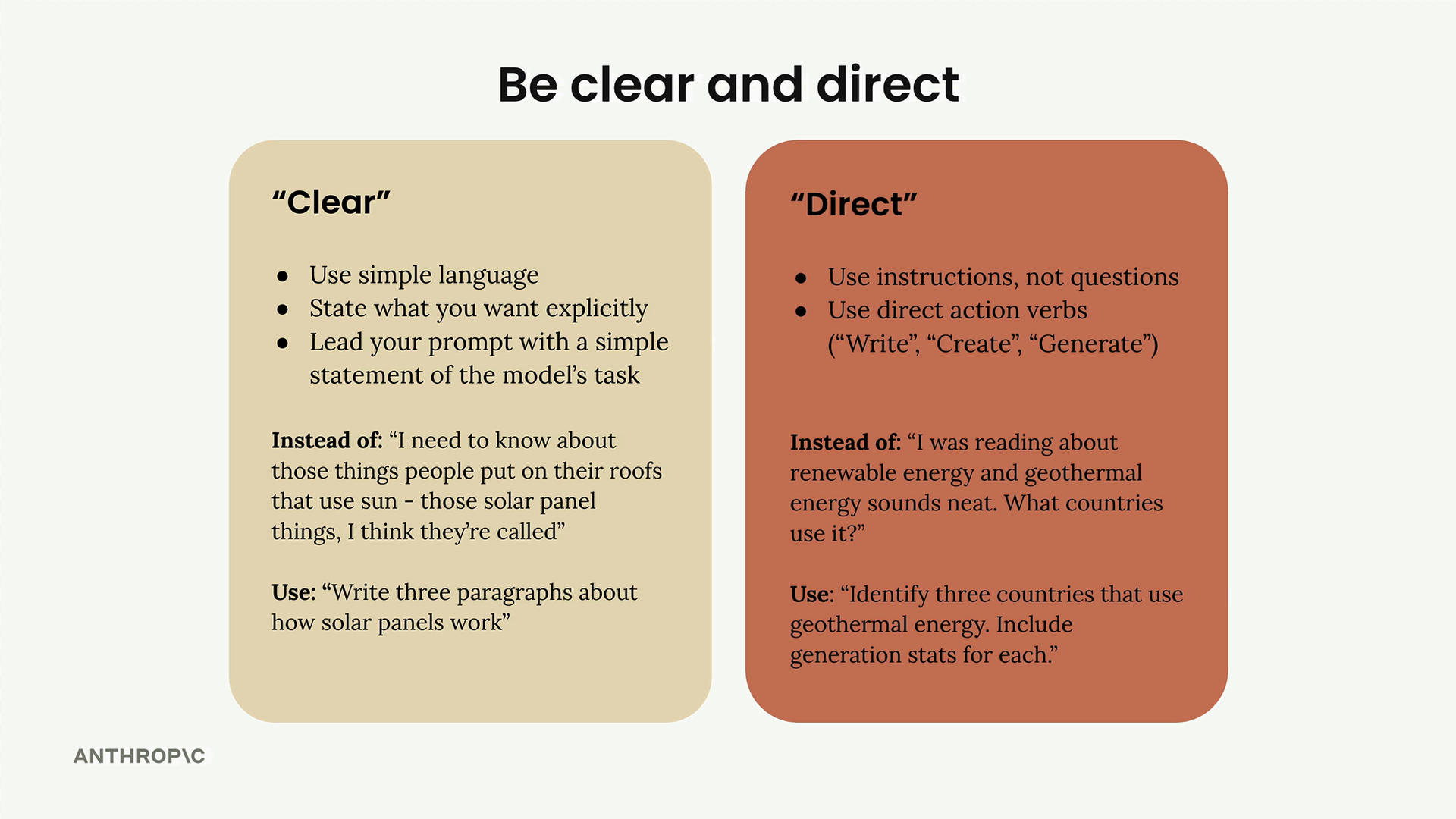

清晰直接

清晰直接 = 在提示词的第一行使用简单、直接的语言和动词来明确指定任务。

第一行的重要性 = 提示词中最关键的部分,为 AI 响应奠定基础。

结构 = 动词 + 清晰的任务描述 + 输出规格。

示例:

- “写三段关于太阳能电池板工作原理的文字。”

- “找出三个使用地热能的国家,并为每个国家附上发电统计数据。”

- “为一名运动员生成符合其饮食限制的一日膳食计划。”

关键组成部分 = 开头使用动词 +直接的任务陈述 + 预期的输出细节。

结果 = 提升了提示词性能(示例显示分数从 2.32 提高到 3.92)。

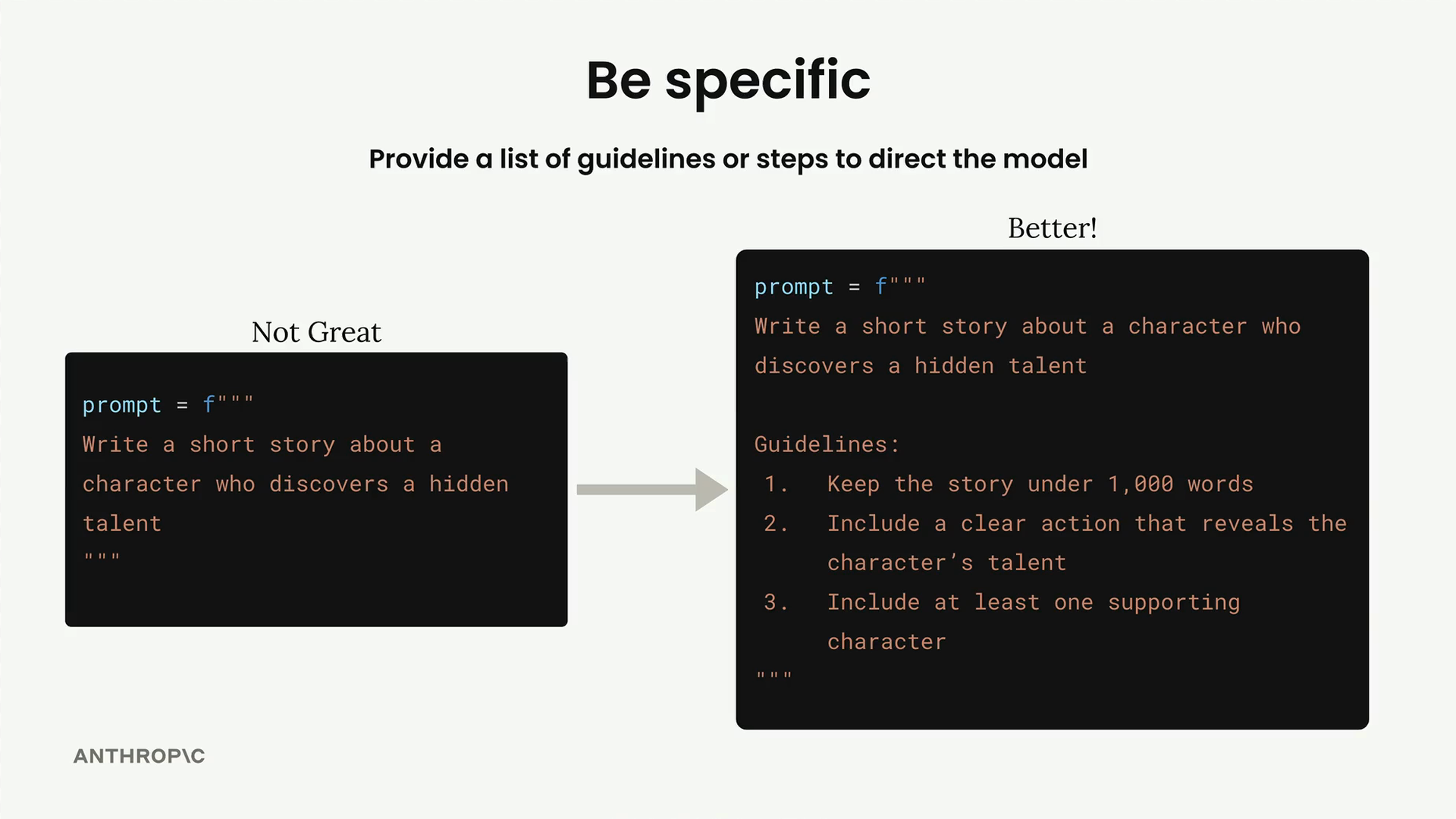

具体化

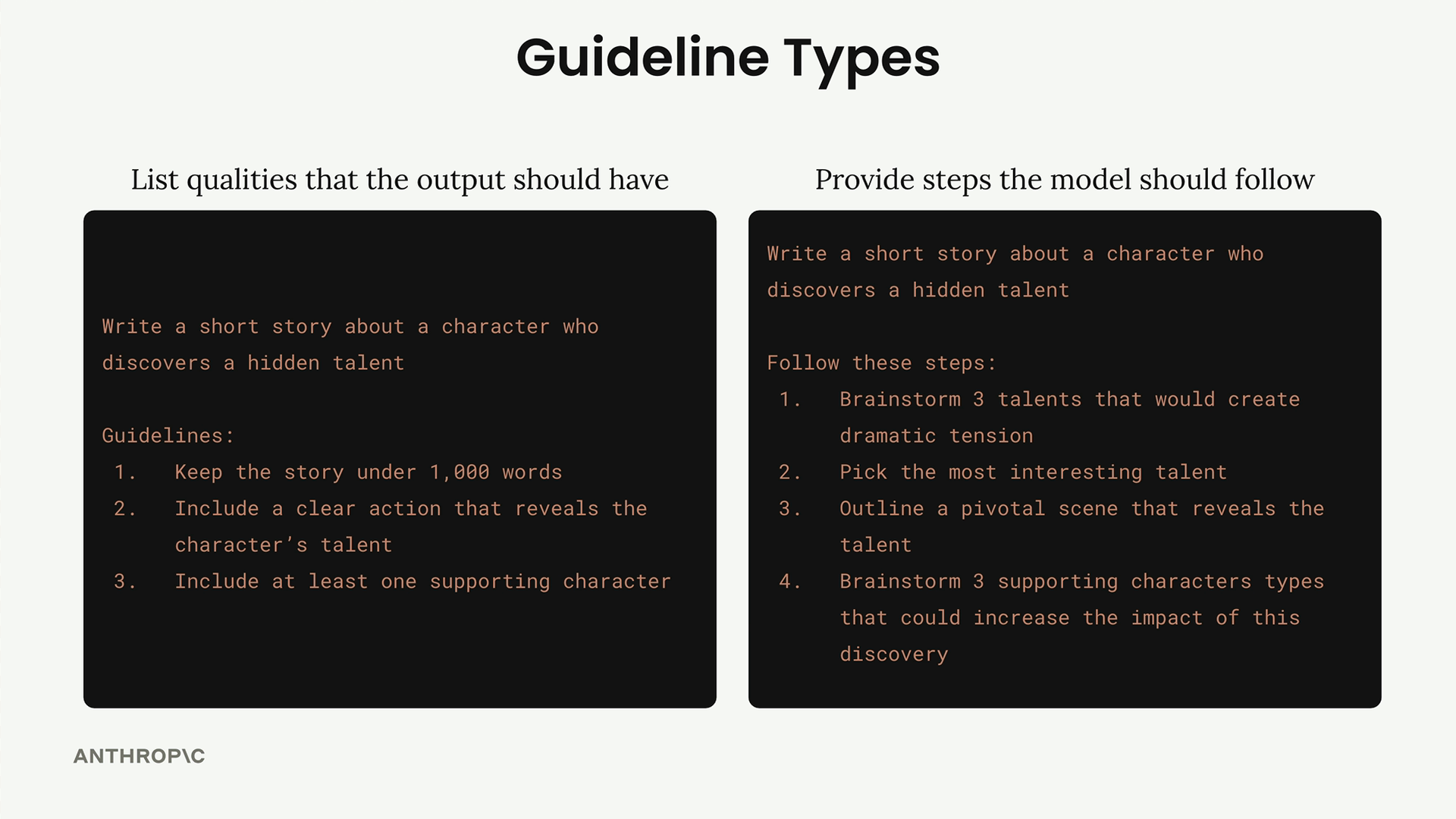

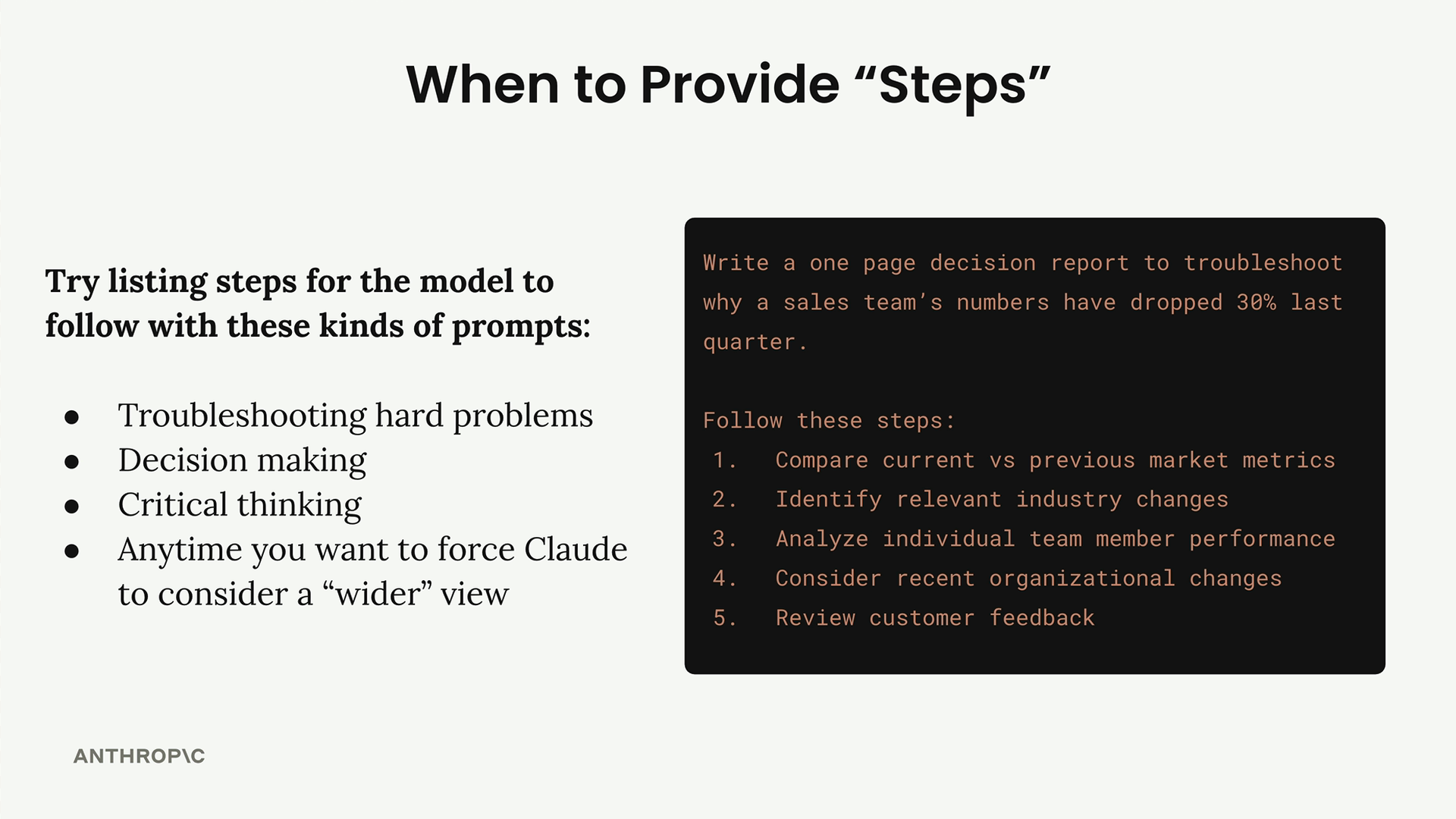

具体化 = 添加指导方针或步骤来引导模型输出朝特定方向发展。

两种指导方针: A 型(属性) = 列出期望输出具有的品质/属性(长度、结构、格式)。 B 型(步骤) = 为模型提供在推理过程中应遵循的具体步骤。

A 型控制输出特征。B 型控制模型如何得出答案。

这两种技术在专业的提示词中经常结合使用。

何时使用:

- A 型(属性):推荐用于几乎所有提示词。

- B 型(步骤):用于复杂问题,当你希望模型考虑其可能不会自然考虑的更广阔视角或其他观点时。

改进示例:在添加了指导方针后,膳食计划提示词的分数从 3.92 跃升至 7.86,表明通过具体化可以显著提高质量。

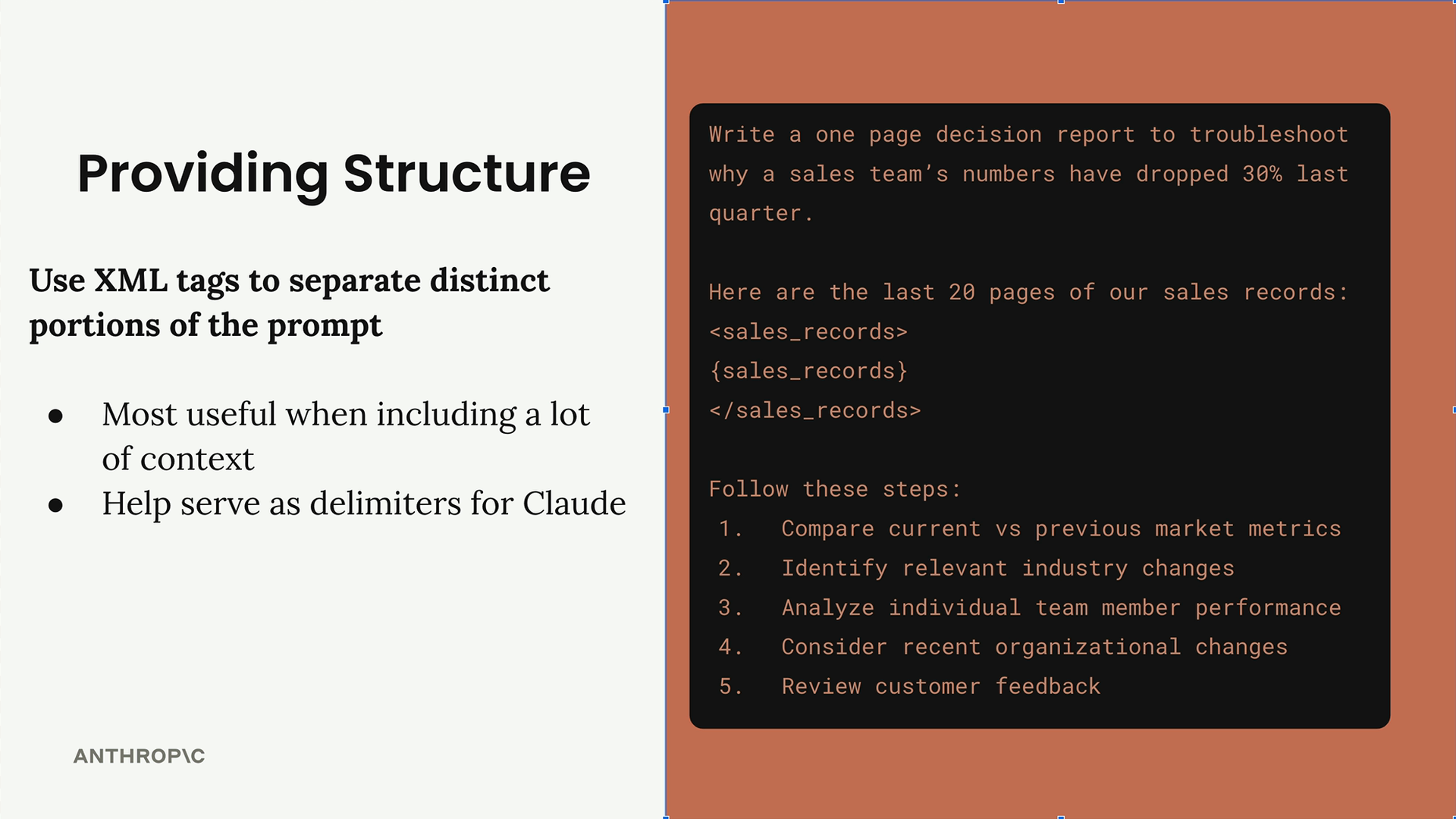

使用 XML 标签构建结构

使用 XML Tags (XML 标签) 构建提示词结构 = 使用 XML 标签来组织和界定提示词内的不同内容部分,以提高 AI 的理解能力。

目的 = 当在提示词中插入大量内容时,XML 标签有助于 AI 模型区分不同类型的信息并理解文本分组。

实现方式 = 将内容部分包裹在描述性的 XML 标签中,如 <document> 或 <example>,而不是直接堆砌非结构化文本。

标签命名 = 使用描述性、具体的标签名称(例如,"sales_records" 比 "data" 更好),以提供关于内容性质的上下文。

用例示例 = 一个包含混合代码和文档的调试提示词,当使用 <source_code> 和 <documentation> 标签将其分开时,会变得更加清晰。

优点 = 使提示词结构对 AI 显而易见,减少了关于内容边界的混淆,即使对于较小的内容块也能提高输出质量。

应用 = 可以将任何插入的内容包裹起来,如 <user_input>,即使内容很短,也能明确其为需要考虑的外部输入。

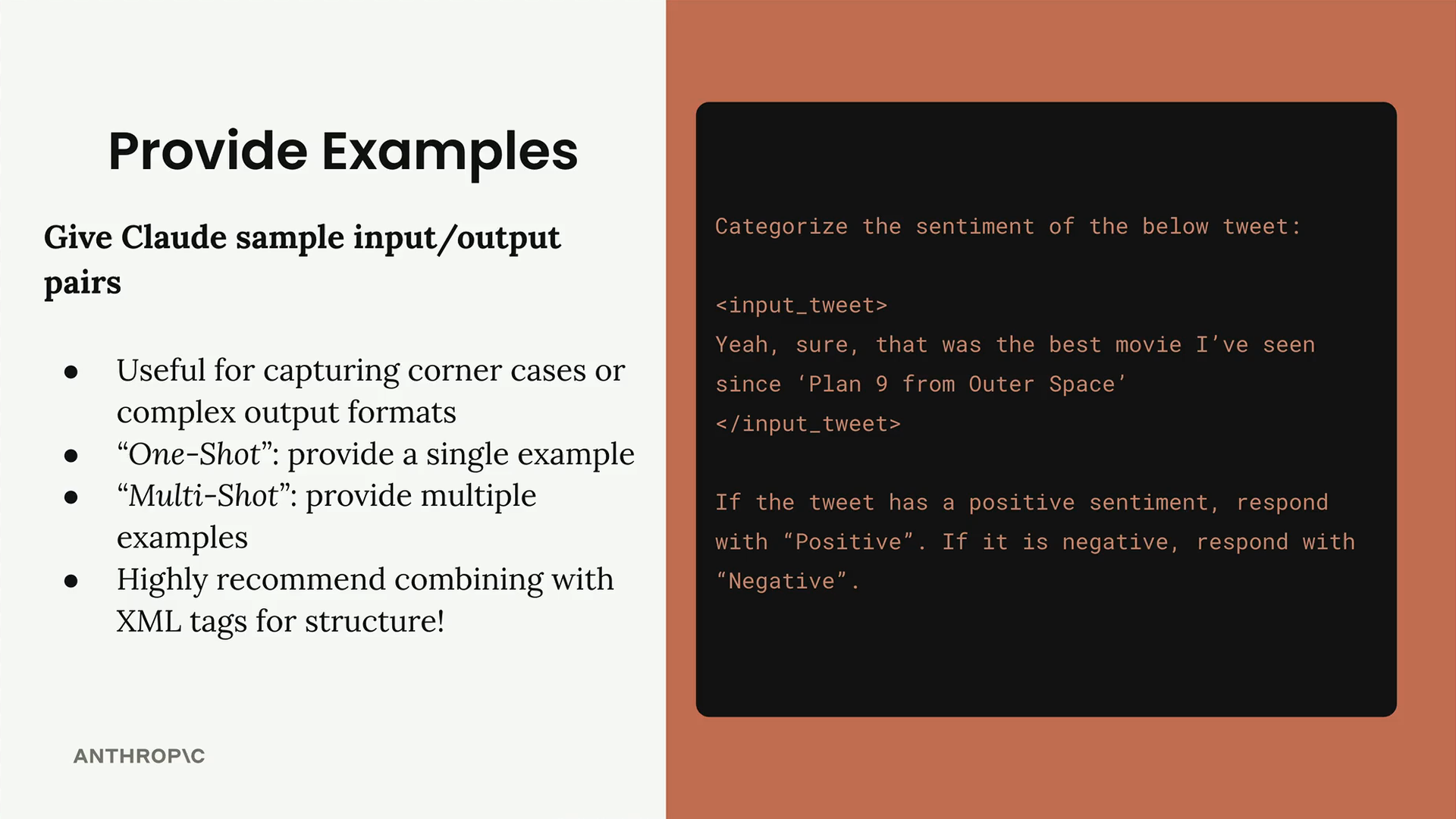

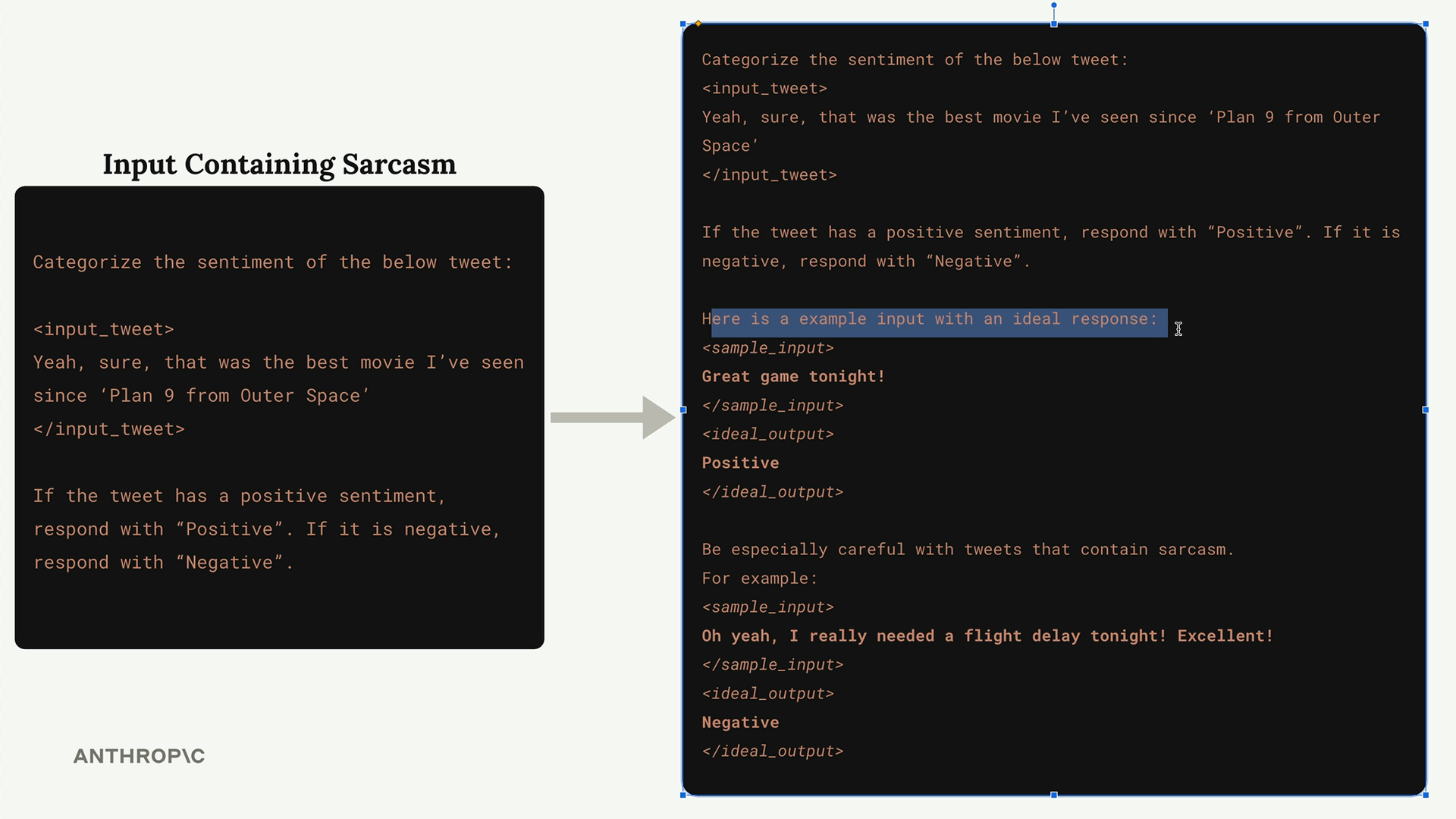

提供示例

One-shot/Multi-shot prompting (单样本/多样本提示) = 在提示词中提供示例来引导模型行为。单样本 = 单个示例,多样本 = 多个示例。

实现方式:使用包含样本输入和理想输出的 XML 标签来构建示例。务必清晰地包裹示例,以区别于实际的提示词内容。

主要应用:

- 边界情况处理(讽刺检测、边缘场景)。

- 复杂的输出格式化(JSON 结构、特定格式)。

- 阐明预期的响应质量/风格。

最佳实践:

- 为边界情况添加上下文(“要特别注意讽刺”)。

- 包含解释为什么输出是理想的推理过程。

- 使用提示词评估中得分最高的示例作为模板。

- 将示例放在主要指令/指导方针之后。

效果提升:将示例与解释其为何理想的说明相结合,以强化期望的输出特性。

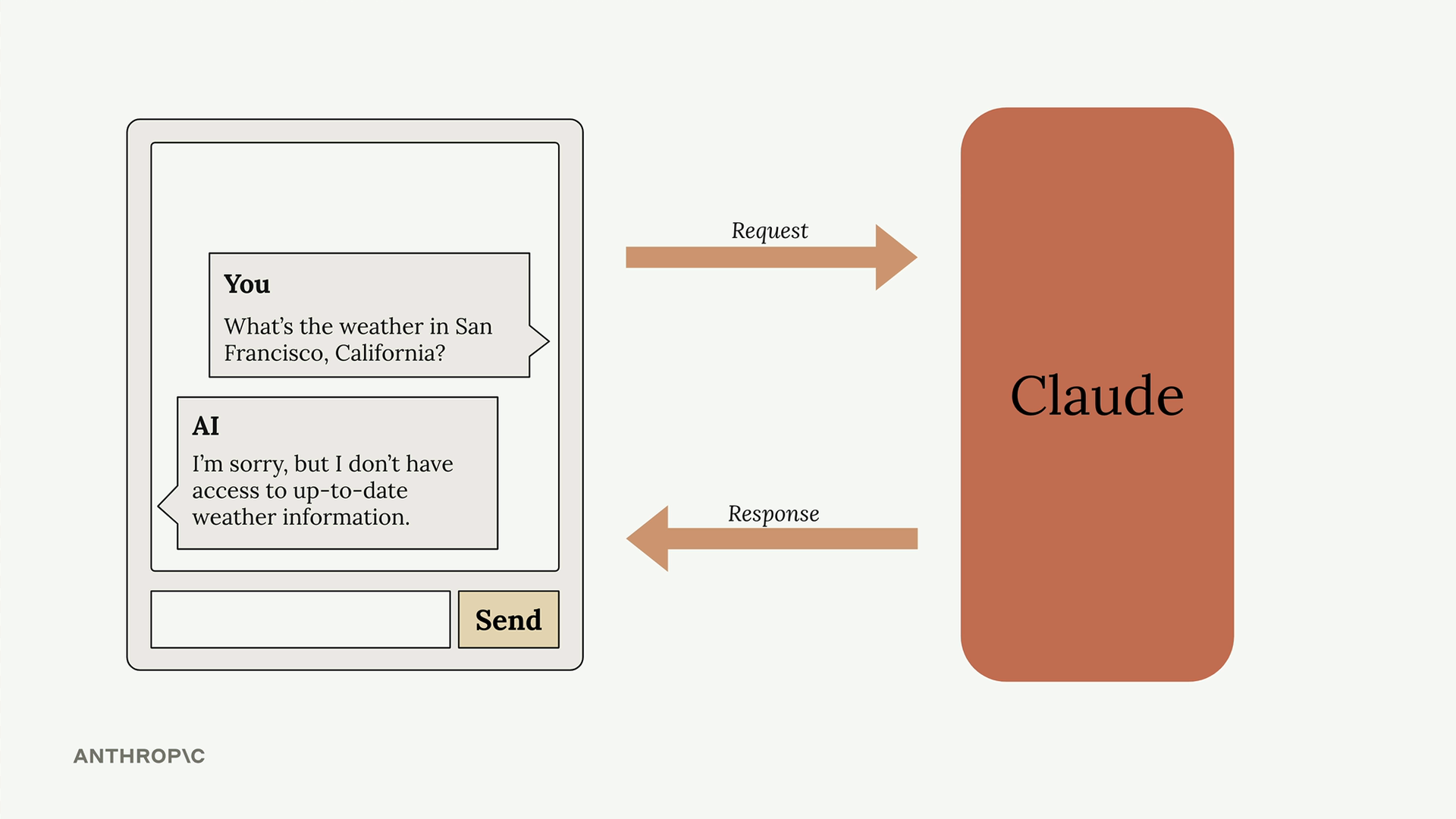

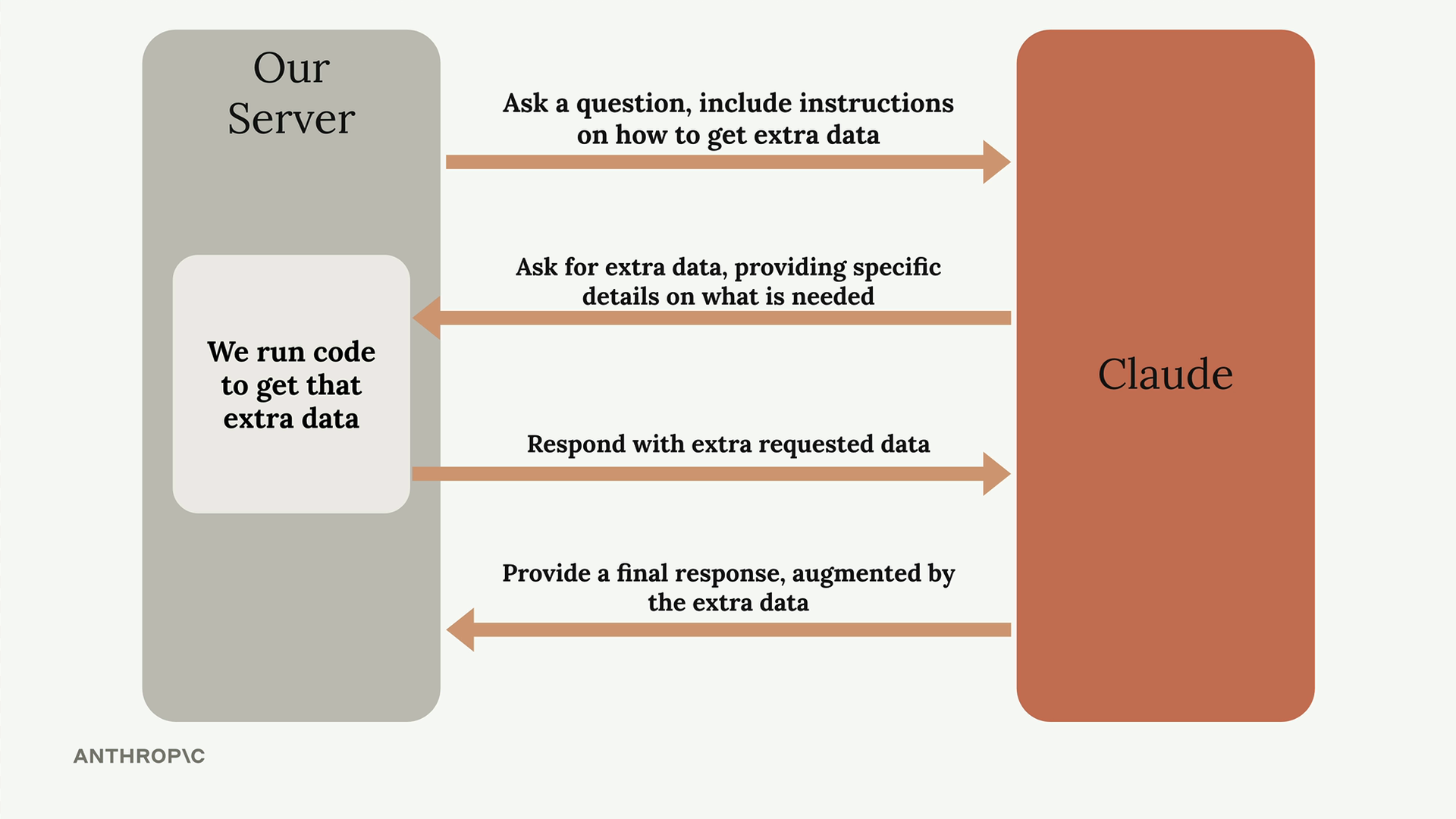

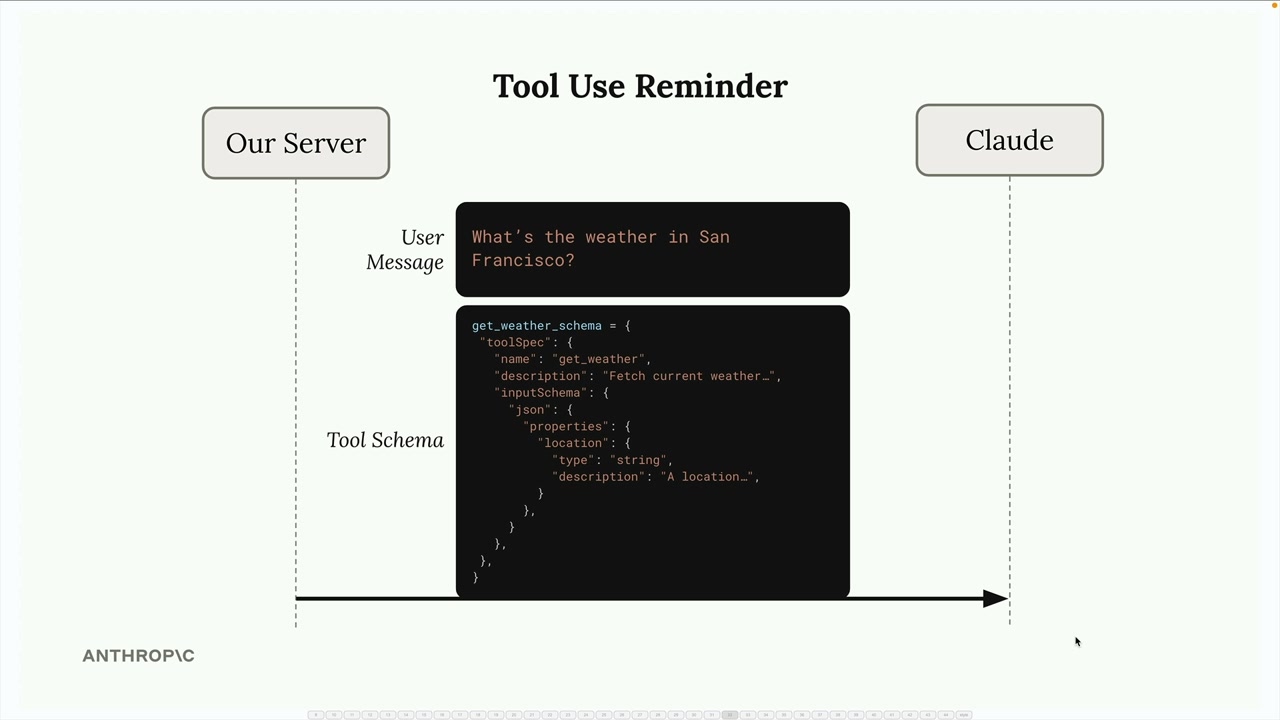

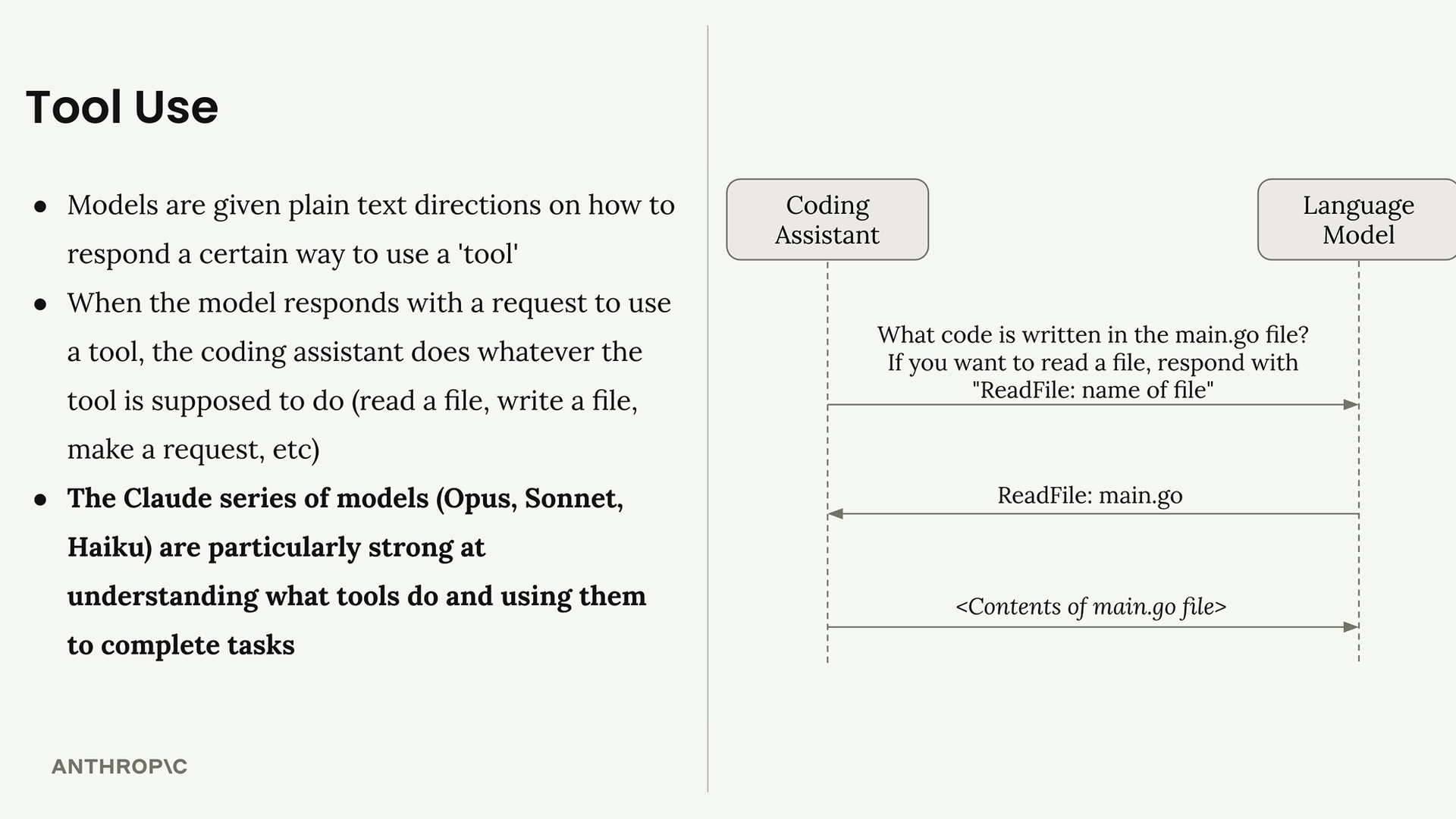

工具调用(Tool Use)简介

Tool use (工具调用) = 一种让 Claude 能够访问其训练数据之外的外部信息的方法。

默认限制:Claude 只知道其训练数据中的信息,缺乏当前/实时的信息。

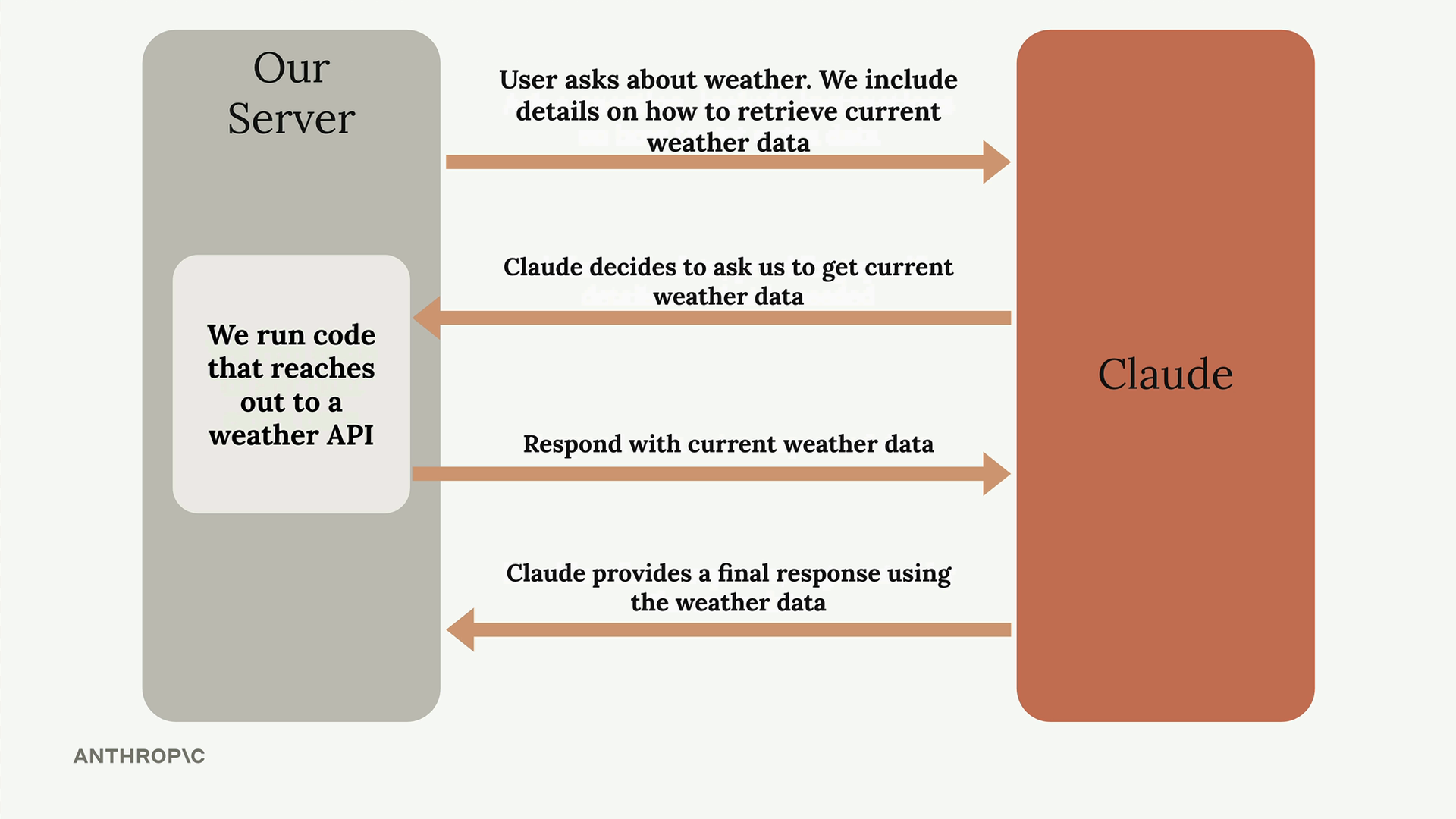

工具调用流程:

- 向 Claude 发送初始请求 + 访问外部数据的指令。

- Claude 评估是否需要外部数据,并请求特定信息。

- 服务器运行代码从外部源获取所请求的数据。

- 向 Claude 发送包含检索到数据的后续请求。

- Claude 使用原始提示词 + 外部数据生成最终响应。

天气示例:用户询问当前天气 → Claude 请求天气数据 → 服务器调用天气 API → Claude 接收天气数据 → Claude 提供有信息依据的天气响应。

核心概念:工具使 Claude 能够通过在 Claude 的请求之间协调外部数据检索,用实时/当前信息来增强其响应。

项目概览

项目概览

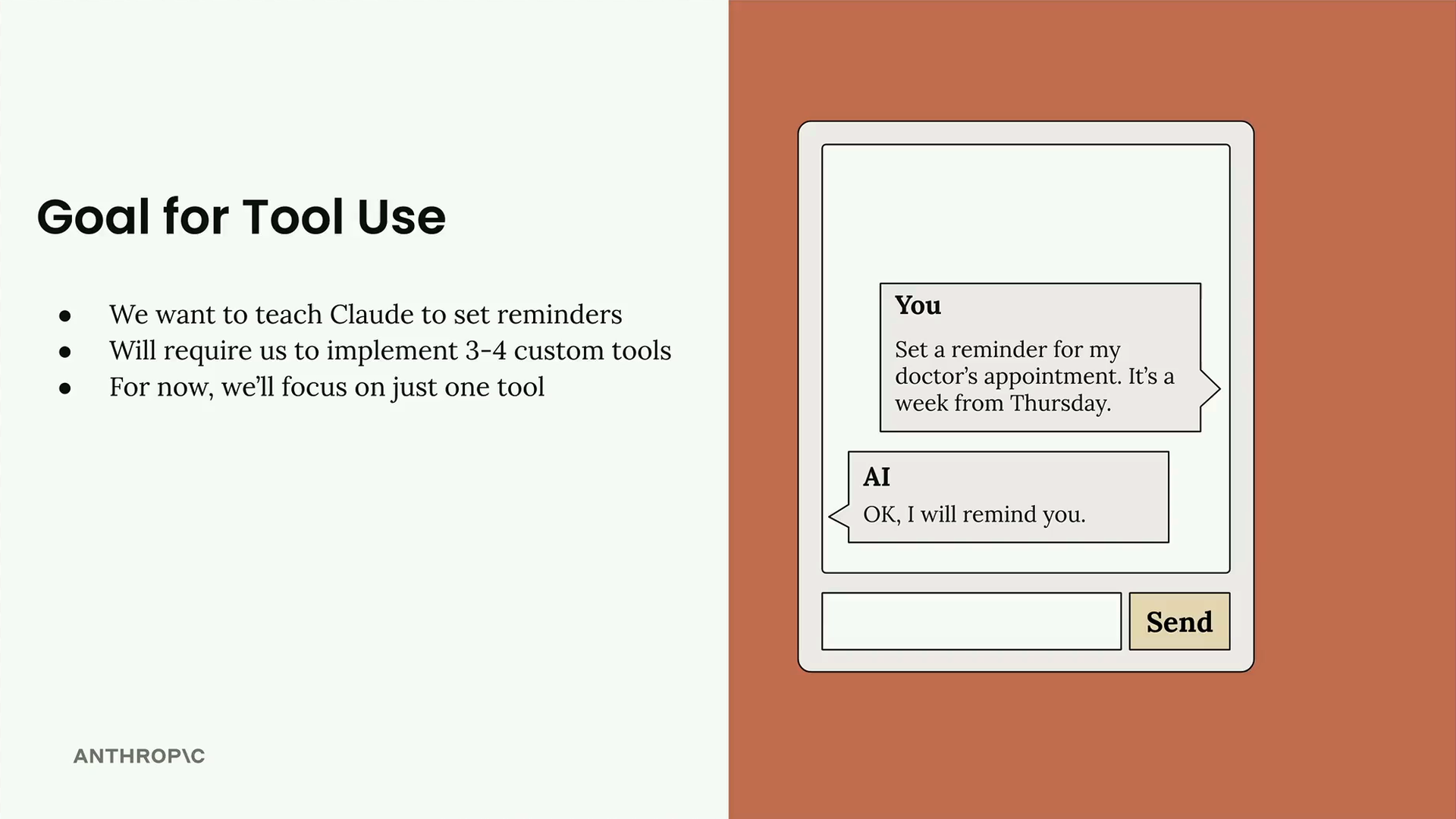

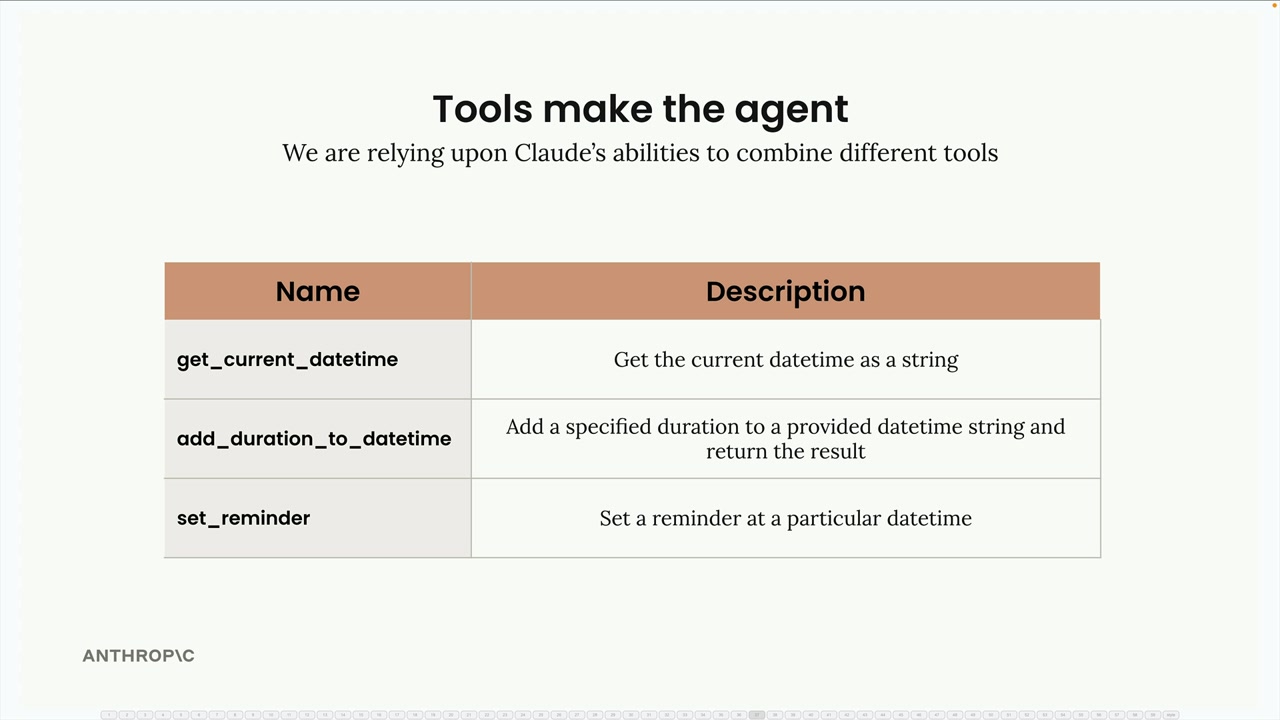

目标 = 在 Jupyter notebook 中通过工具实现,教 Claude 设置基于时间的提醒。

目标交互 = 用户:“设置一个下周四的医生预约提醒” → Claude:“我会在那个时间点提醒你”。

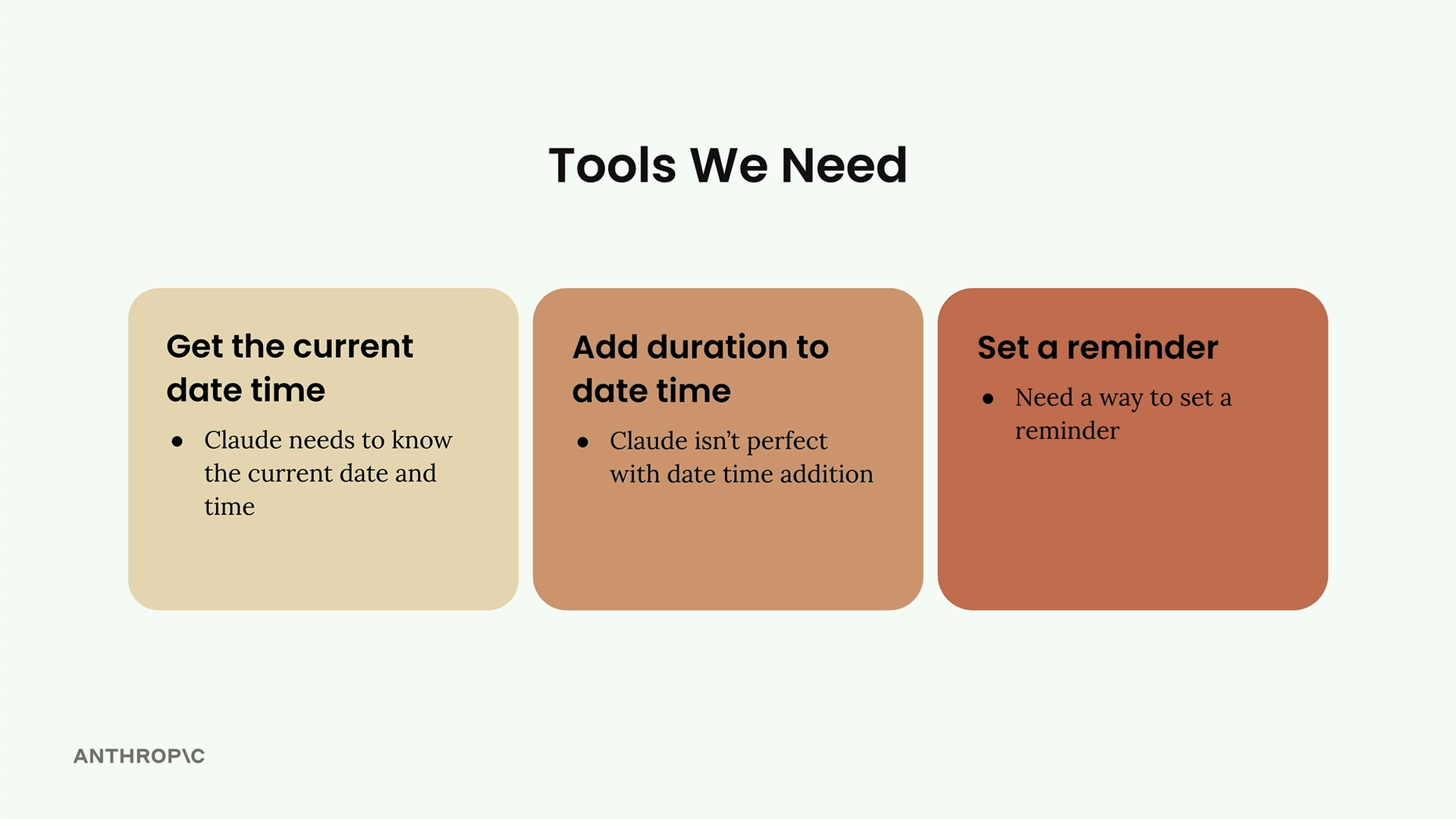

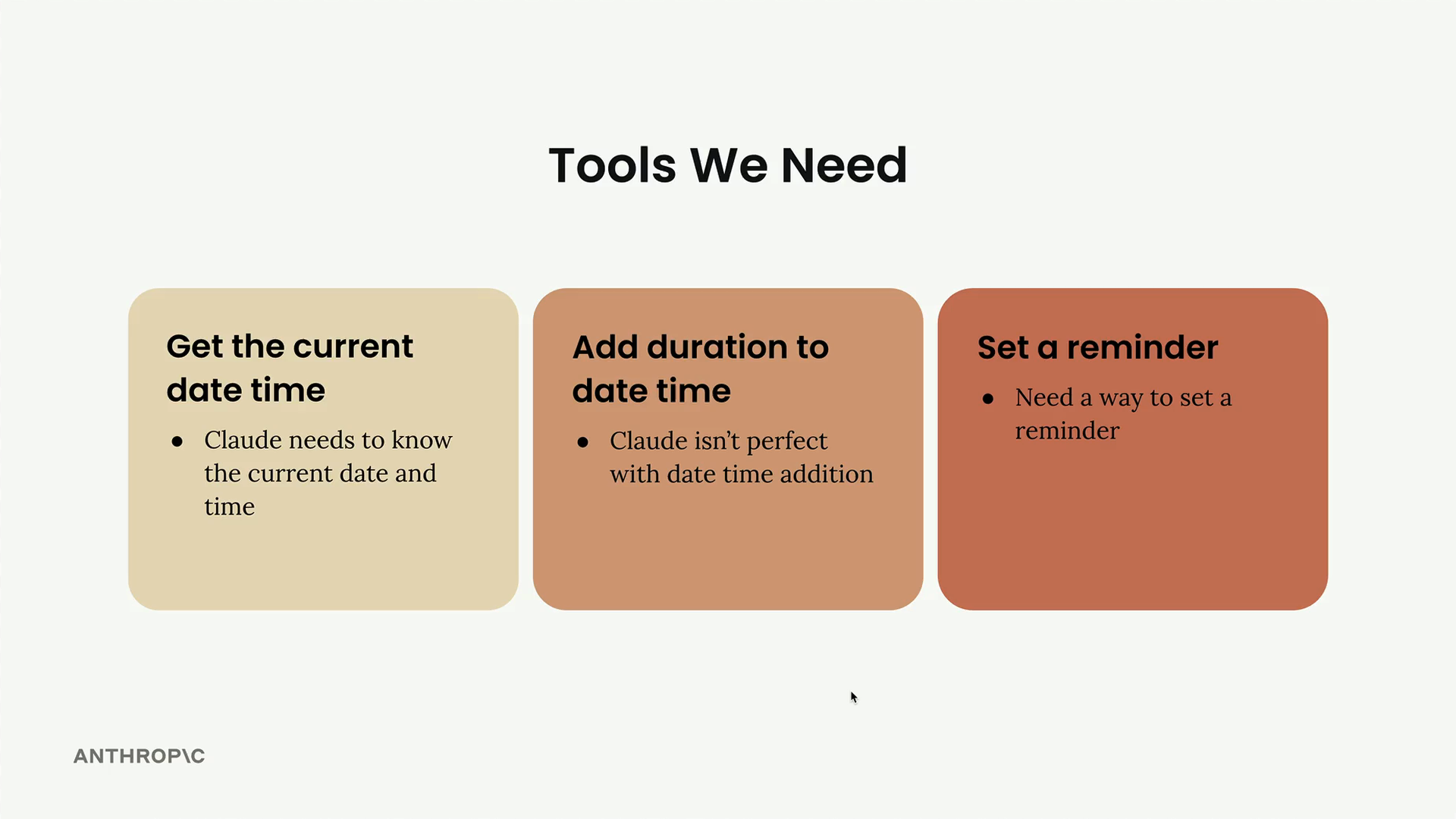

需要工具解决的三个核心问题:

- 时间知识差距 = Claude 知道当前日期但不知道确切时间。

- 时间计算错误 = Claude 有时会算错基于时间的加法(例如,从 1973 年 1 月 13 日起的 379 天)。

- 无提醒机制 = Claude 理解提醒的概念但缺乏实现能力。

需要构建的三个相应工具:

- 当前日期时间工具 = 获取当前日期 + 时间。

- 时长增加工具 = 将时长添加到日期时间上(例如,当前日期 + 20 天)。

- 提醒设置工具 = 实际设置提醒。

实现方法 = 一次构建一个工具,逐步实现多工具协调。

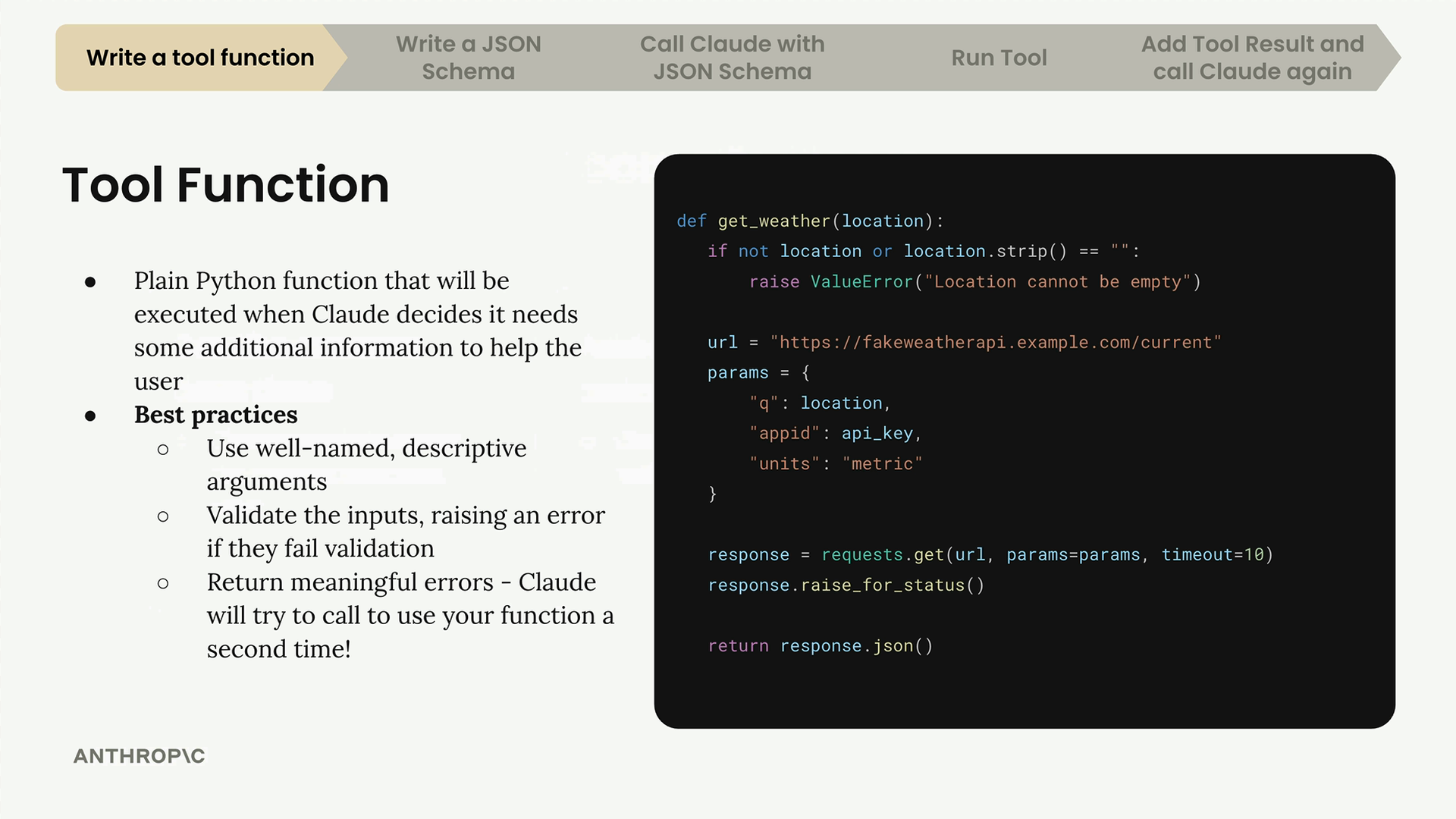

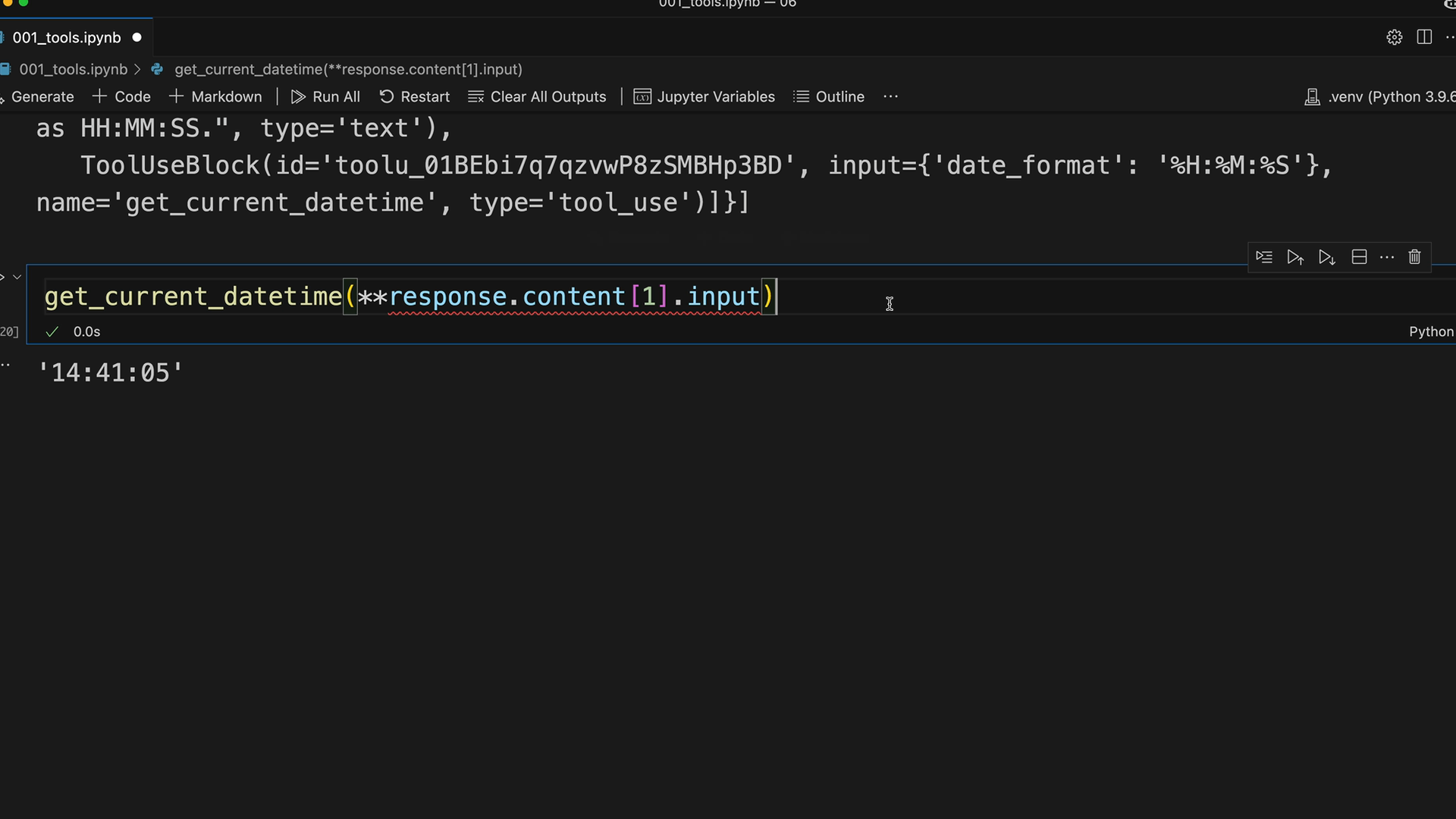

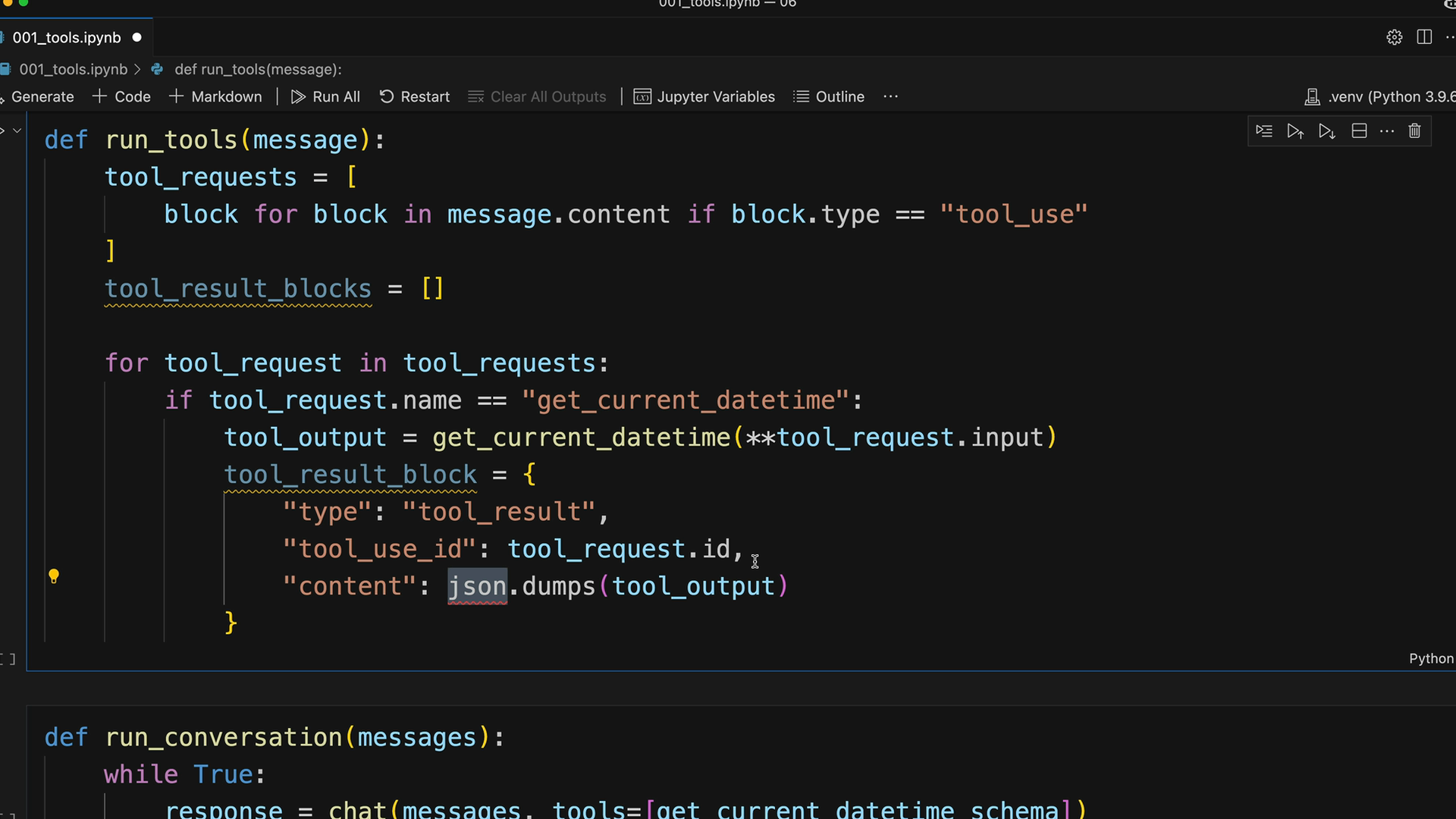

工具函数

Tool Functions (工具函数) = 当 Claude 需要额外信息来帮助用户时,会自动执行的 Python 函数。

主要特点:

- 当 Claude 判断需要额外数据时,它会调用的普通 Python 函数。

- 必须使用描述性的函数名和参数名。

- 应验证输入并对无效输入抛出带有有意义信息的错误。

- 错误消息对 Claude 可见,使其能够用修正后的参数重试。

最佳实践:

- 命名良好的函数和参数。

- 对无效输入进行验证并立即抛出错误。

- 有意义的错误消息,能指导修正。

实现模式示例:

def get_current_datetime(date_format="%Y%m%d %H:%M:%S"):

if not date_format:

raise ValueError("date format cannot be empty")

return datetime.now().strftime(date_format)工具函数工作流:Claude 识别到信息需求 → 调用工具函数 → 接收结果或错误 → 如果发生错误,可能会用修正后的参数重试。

目的:通过提供对实时信息(如当前日期时间、天气等)的访问,扩展 Claude 的能力至其训练数据之外。

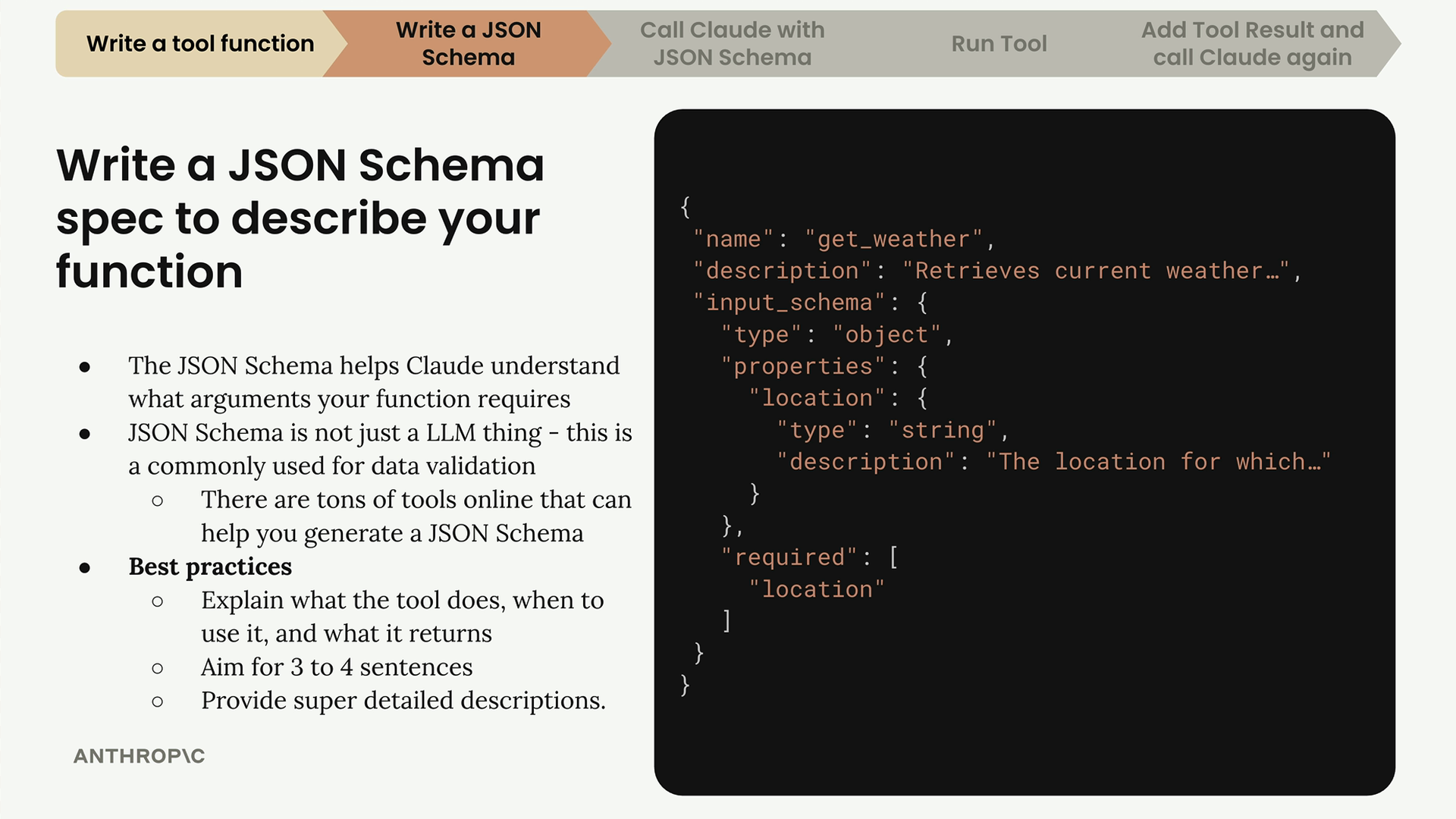

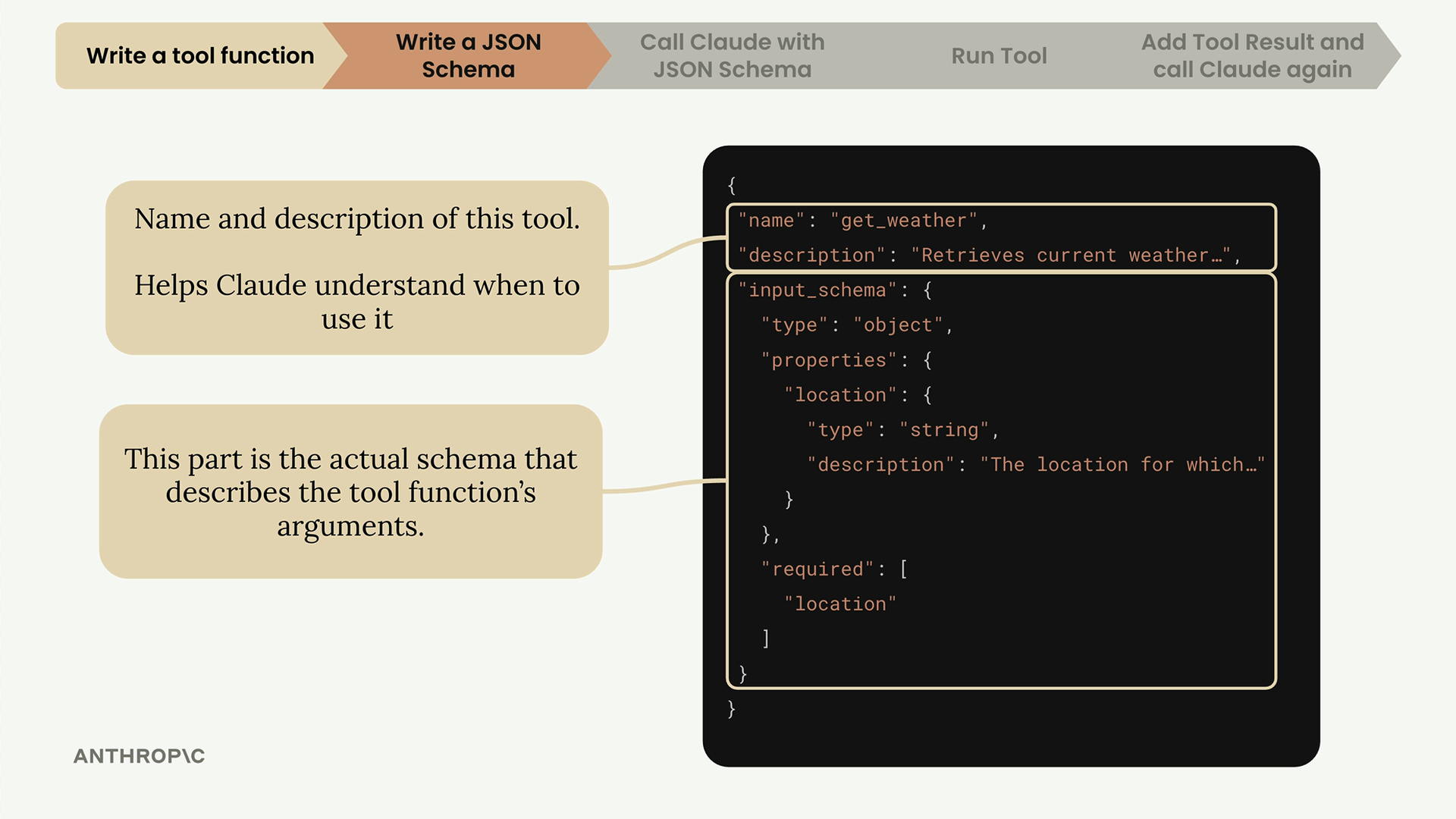

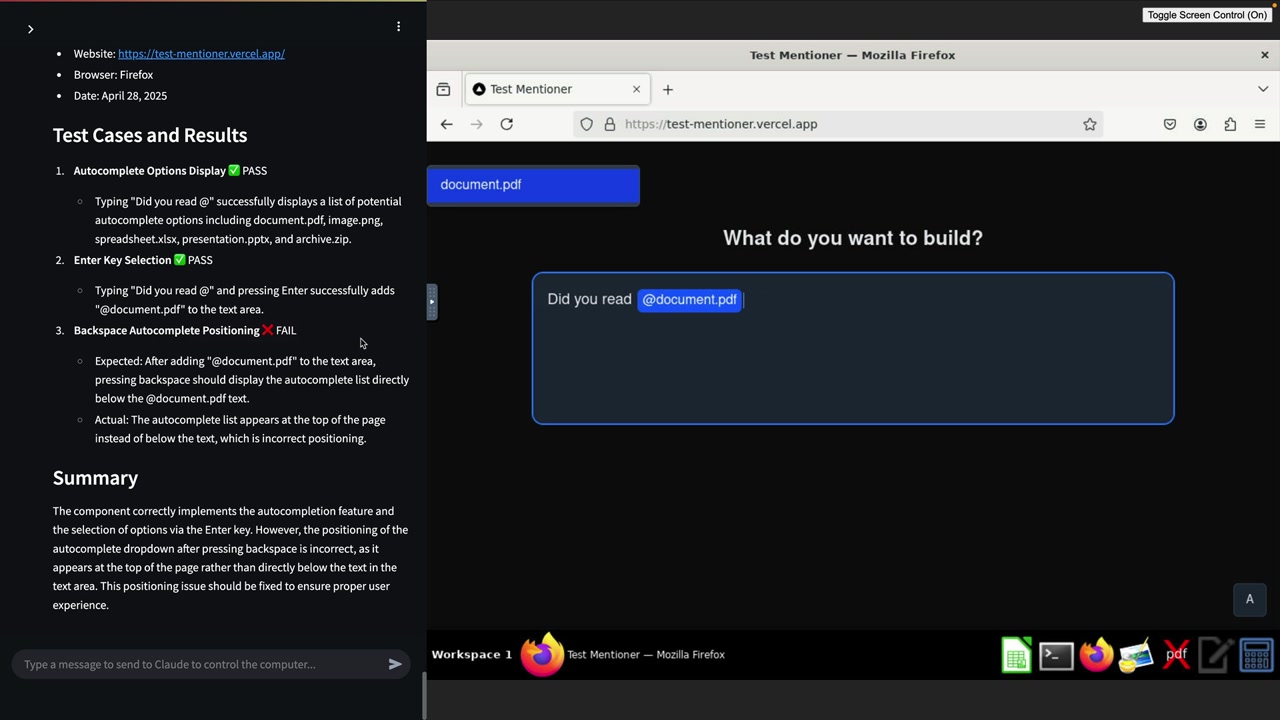

工具模式(Tool Schemas)

Tool Schemas (工具模式) = 描述工具函数及其参数的 JSON 模式规范,供语言模型使用。

JSON Schema (JSON 模式) = 一种数据验证规范(非机器学习专用),用于验证 JSON 数据,已被机器学习社区采纳用于工具调用。

工具模式结构:

name:工具标识符。description:3-4 句解释工具的作用、何时使用以及它返回什么数据。input_schema:描述函数参数的实际 JSON 模式,包括类型和描述。

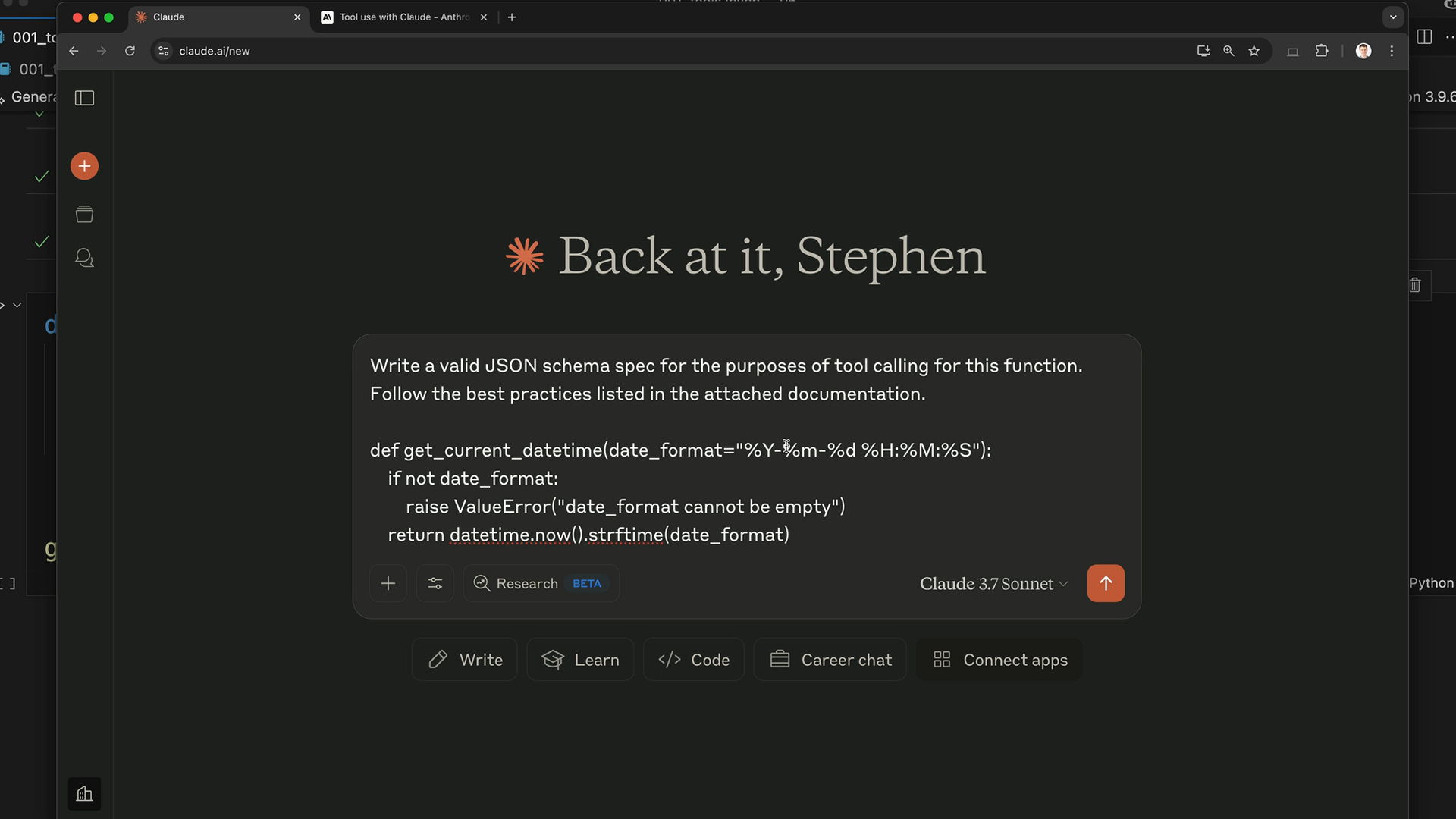

模式生成技巧:

- 将工具函数提供给 Claude.ai。

- 提示:“为这个函数编写一个用于工具调用的有效 JSON 模式规范,并遵循附加文档中的最佳实践”。

- 附上 Anthropic API 文档的工具使用页面。

- 复制生成的模式。

实现模式:

- 描述性地命名函数。

- 将模式命名为 [function_name]_schema。

- 从

anthropic.types导入ToolParam。 - 用

ToolParam()包装模式字典以防止类型错误。

目的 = 通过标准化的 JSON 验证格式,告知 Claude 可用工具、必需参数和使用上下文。

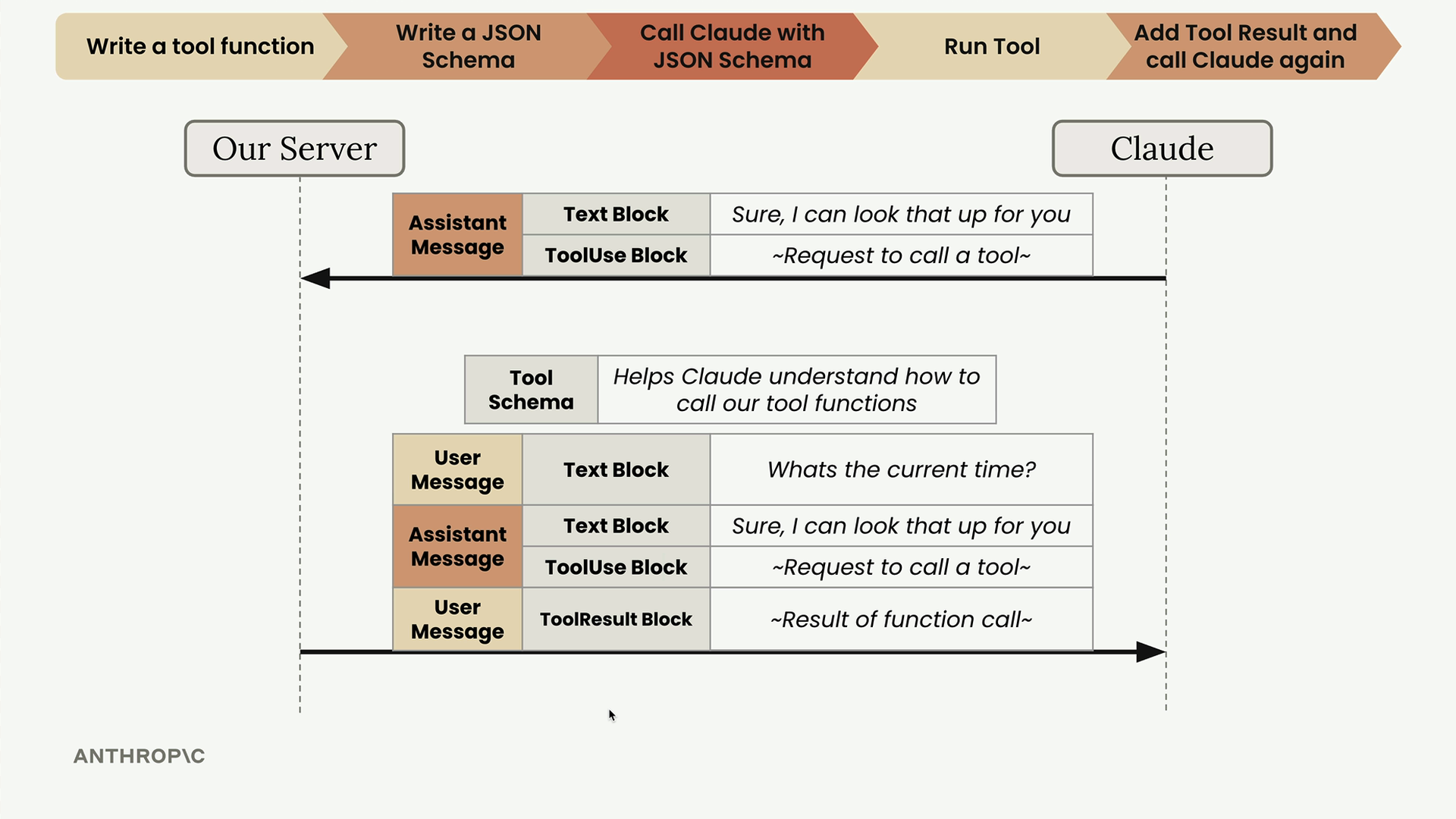

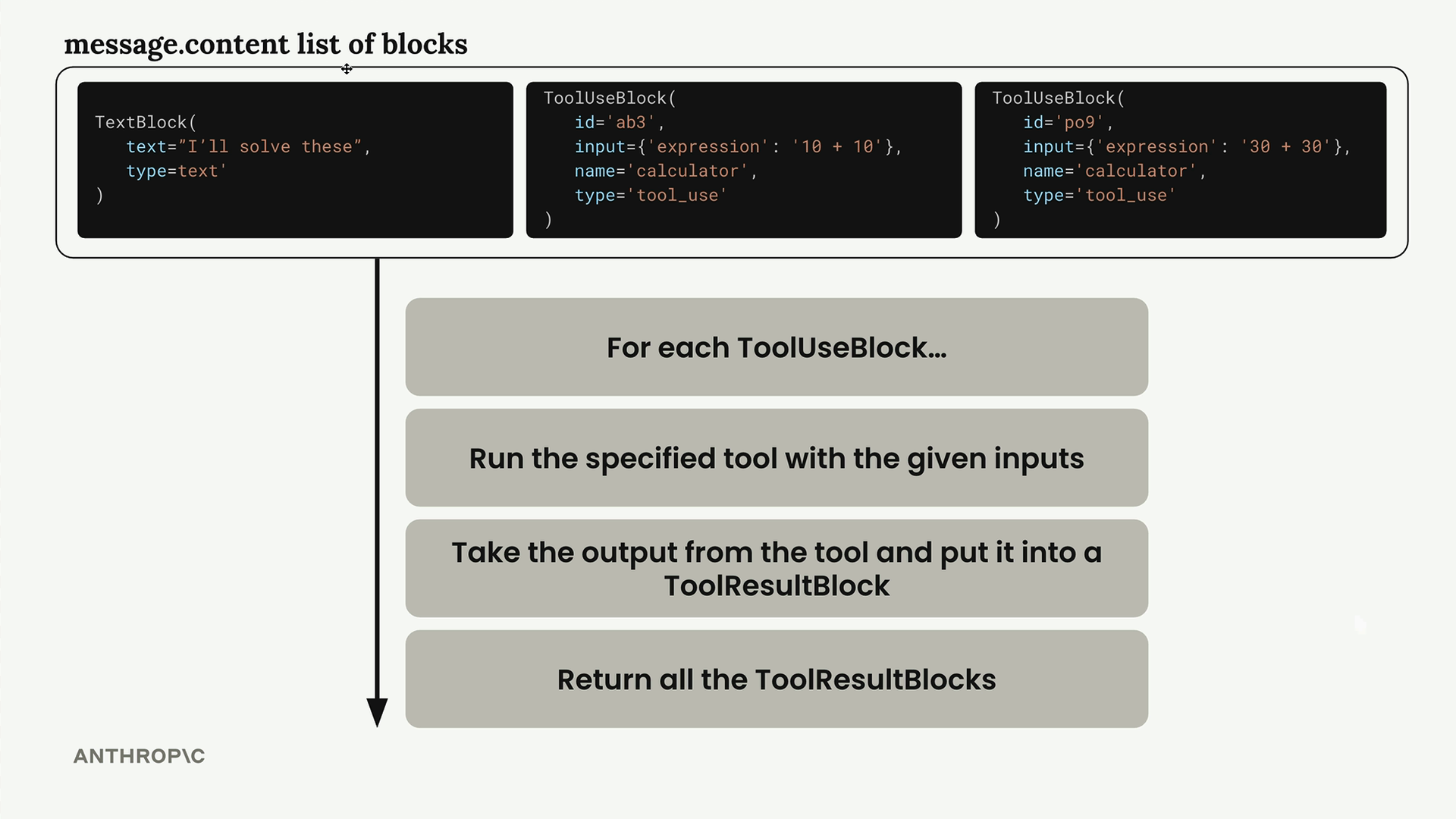

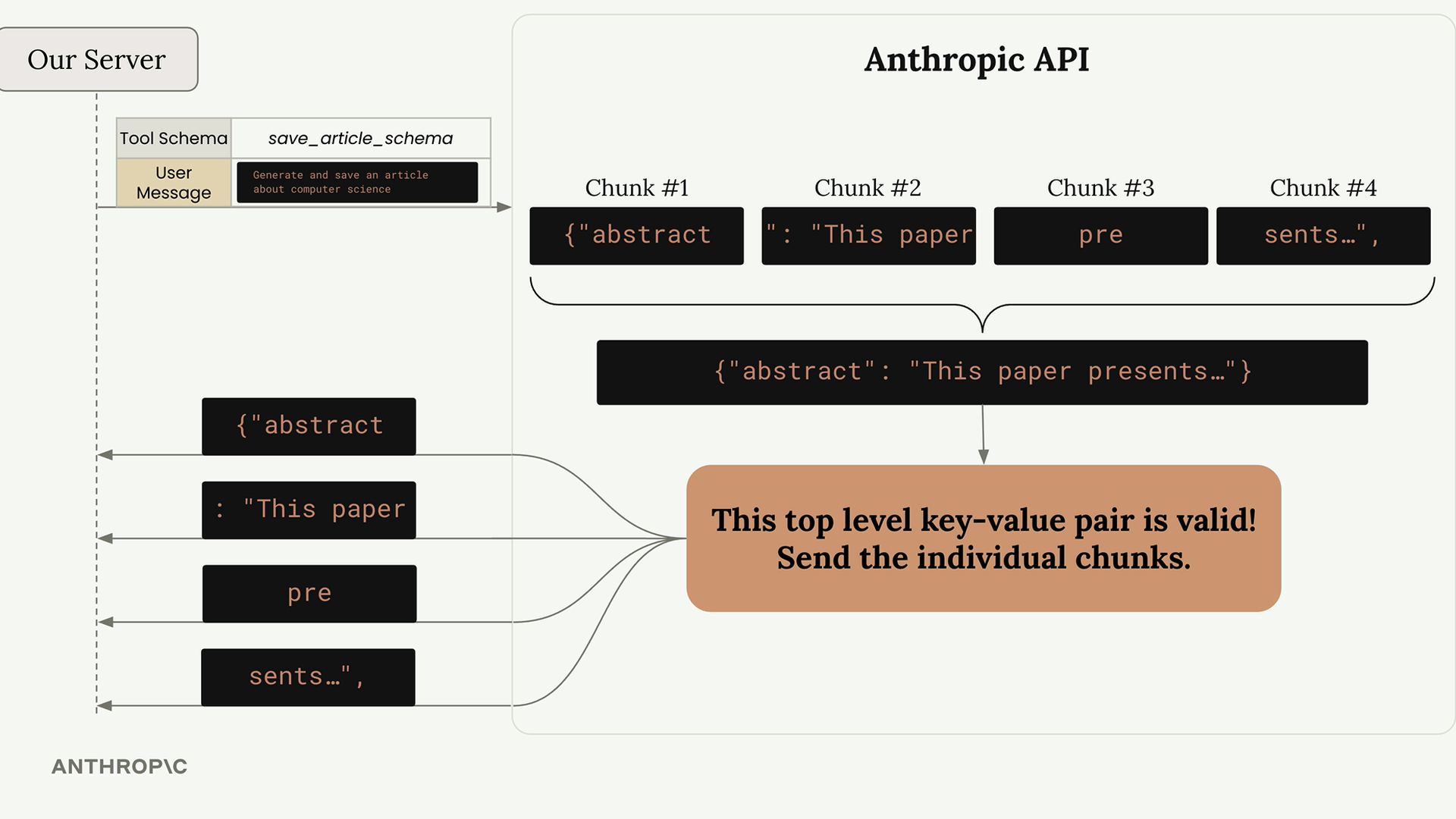

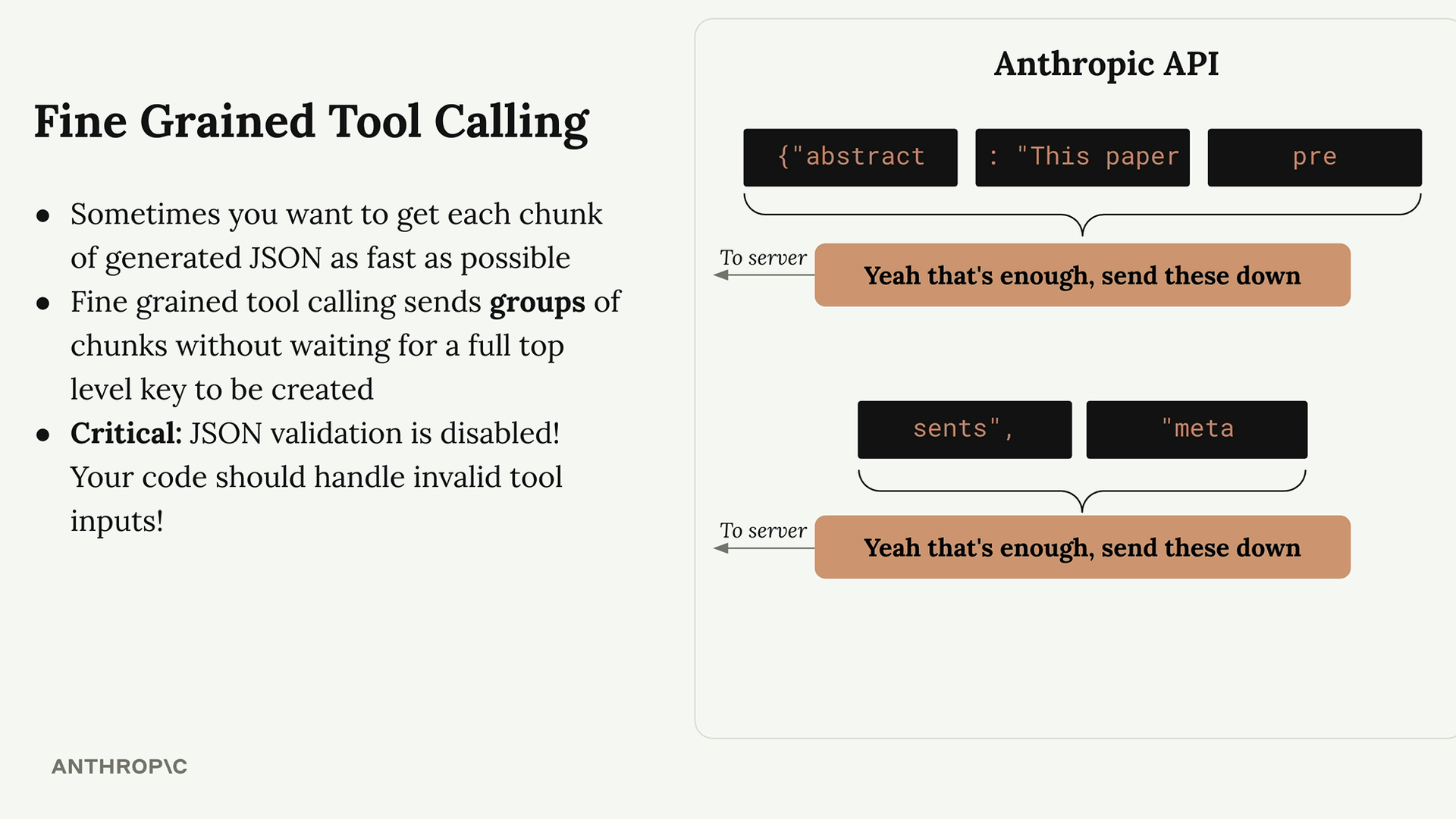

处理消息块

支持工具的 Claude 请求

第 3 步:使用工具向 Claude 发出请求 = 在请求中除了用户消息外,还需使用 tools 关键字参数包含工具模式,其中含有 JSON 模式规范。

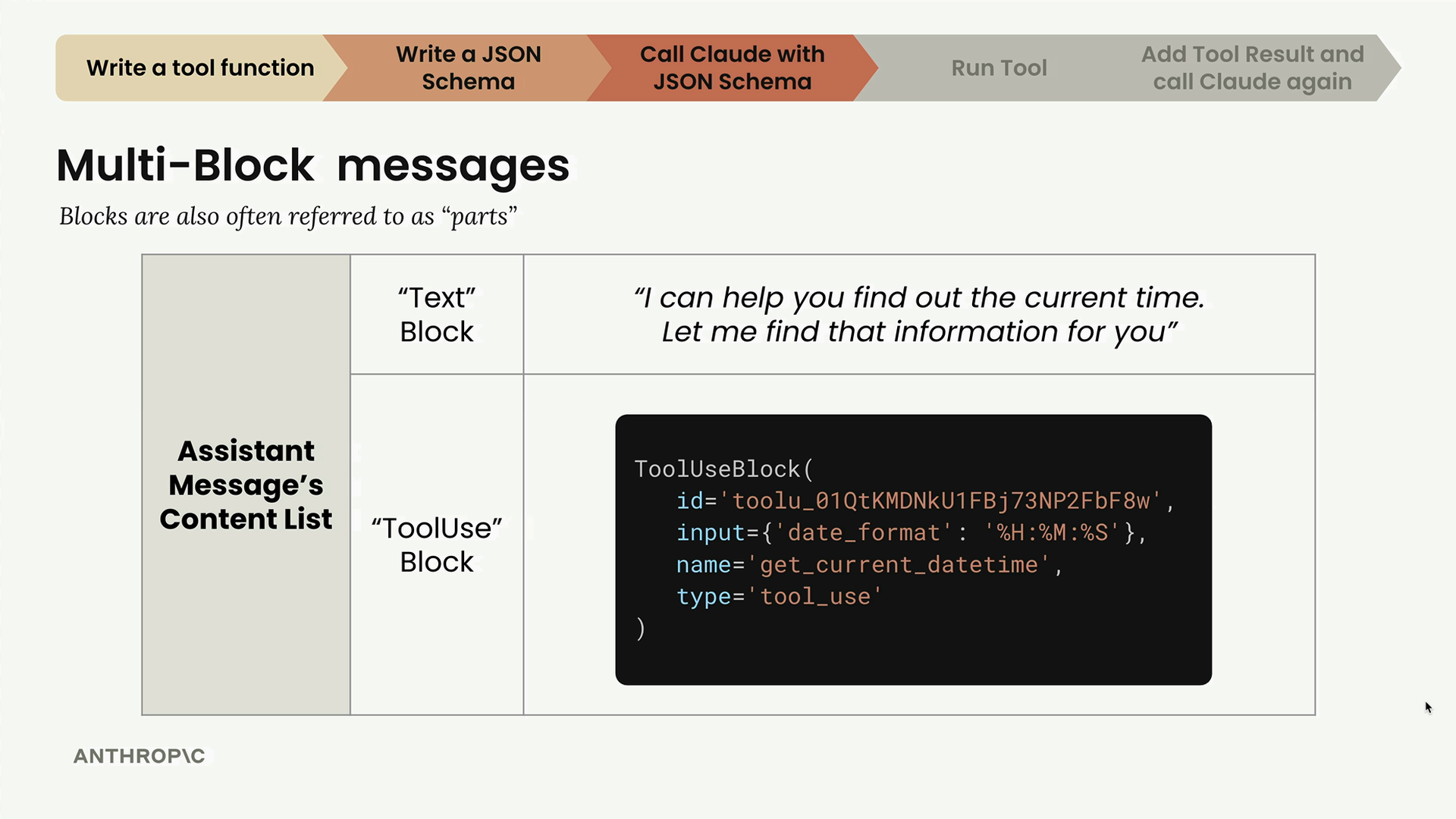

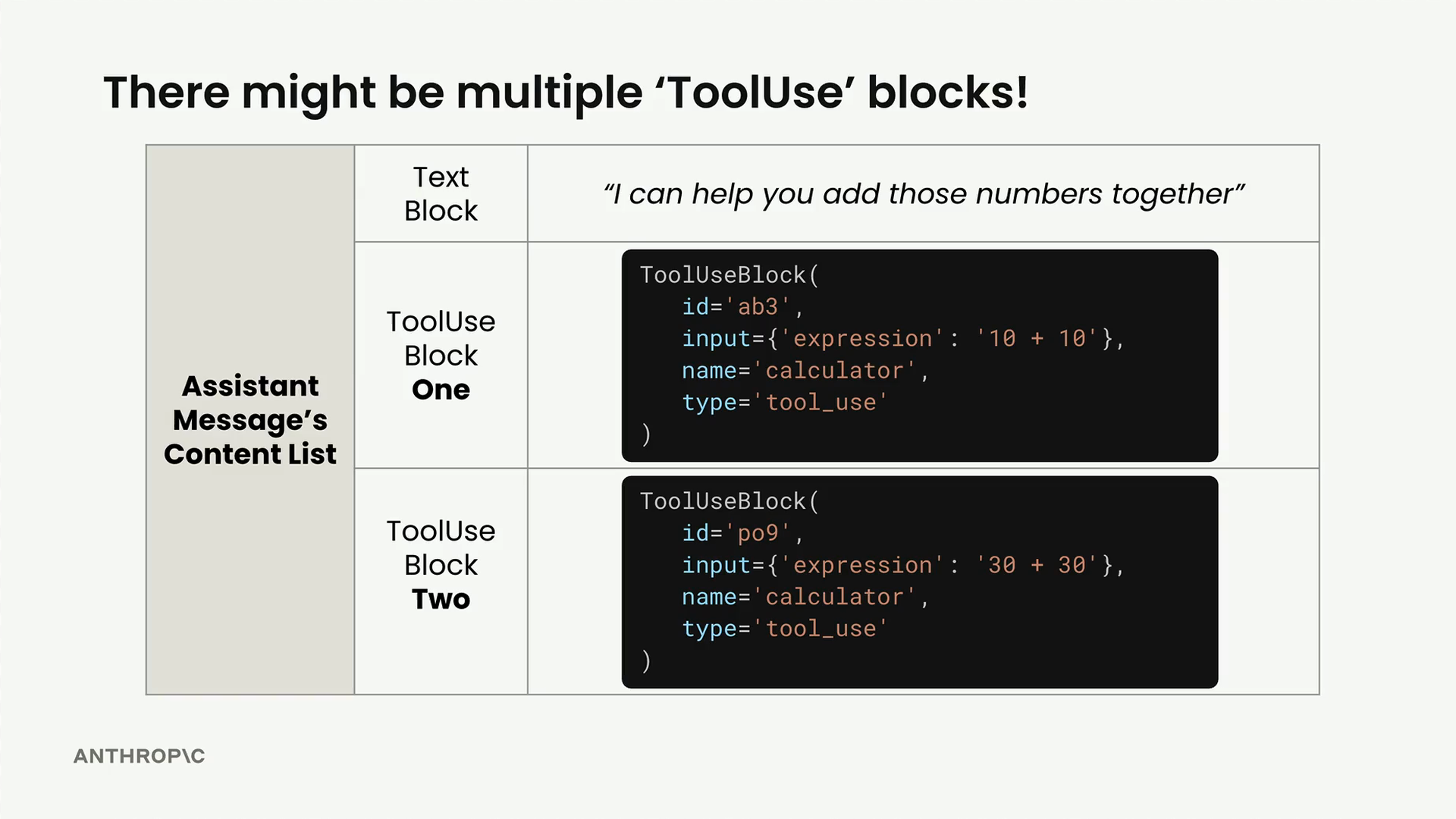

Multi-Block Messages (多块消息)

内容结构变化 = 消息现在包含多个块,而不仅仅是文本块。

工具响应格式 = 助手消息包含:

- 文本块 = 面向用户的解释。

- 工具使用块 = 包含工具执行的函数名 + 参数。

消息历史管理

关键要求 = 手动维护对话历史,因为 Claude 不存储任何内容。

多块处理 = 将整个 response.content(所有块)附加到消息列表中,而不仅仅是文本。

需要更新辅助函数 = add_user_message 和 add_assistant_message 函数必须支持多个块,而不仅仅是单个文本块。

对话流程 = 用户消息 → 带有工具使用块的助手响应 → 执行工具 → 以完整的历史记录向 Claude 回应。

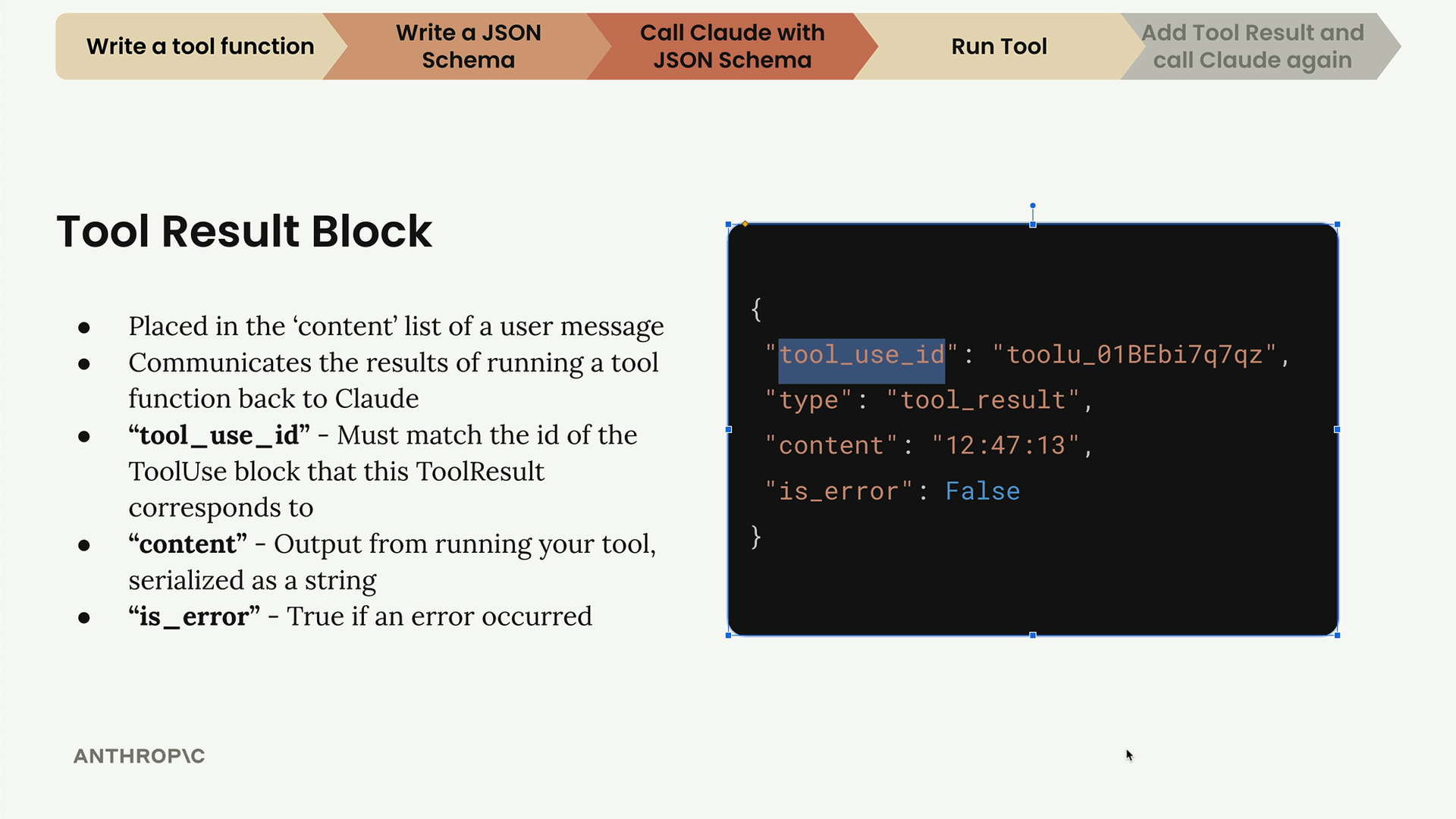

发送工具结果

Tool Results (工具结果) = 从已执行的工具函数中获得的结果,在后续请求中发送回 Claude。

过程:执行 Claude 请求的工具函数 → 创建一个 Tool Result Block (工具结果块) → 发送包含完整对话历史的后续请求。

工具结果块结构:

tool_use_id= 与原始工具使用块中的 ID 匹配,以将请求与结果配对。content= 工具函数输出,转换为字符串(通常是 JSON)。is_error= 用于标记函数执行错误的布尔标志(默认为 false)。

tool_use_id 的目的 = 当 Claude 同时进行多个工具调用时,将多个工具请求链接到正确的结果。每个工具使用都会获得一个唯一的 ID,工具结果必须引用匹配的 ID。

后续请求要求:

- 包含完整的消息历史(原始用户消息 + 助手的工具使用消息 + 带有工具结果的新用户消息)。

- 即使不再使用工具,也必须包含原始的工具模式。

- 工具结果块放在用户消息中,而不是助手消息中。

对话流程:用户请求 → Claude 助手响应(文本 + 工具使用块) → 服务器执行工具 → 带有工具结果块的用户消息 → Claude 的最终响应(集成了结果)。

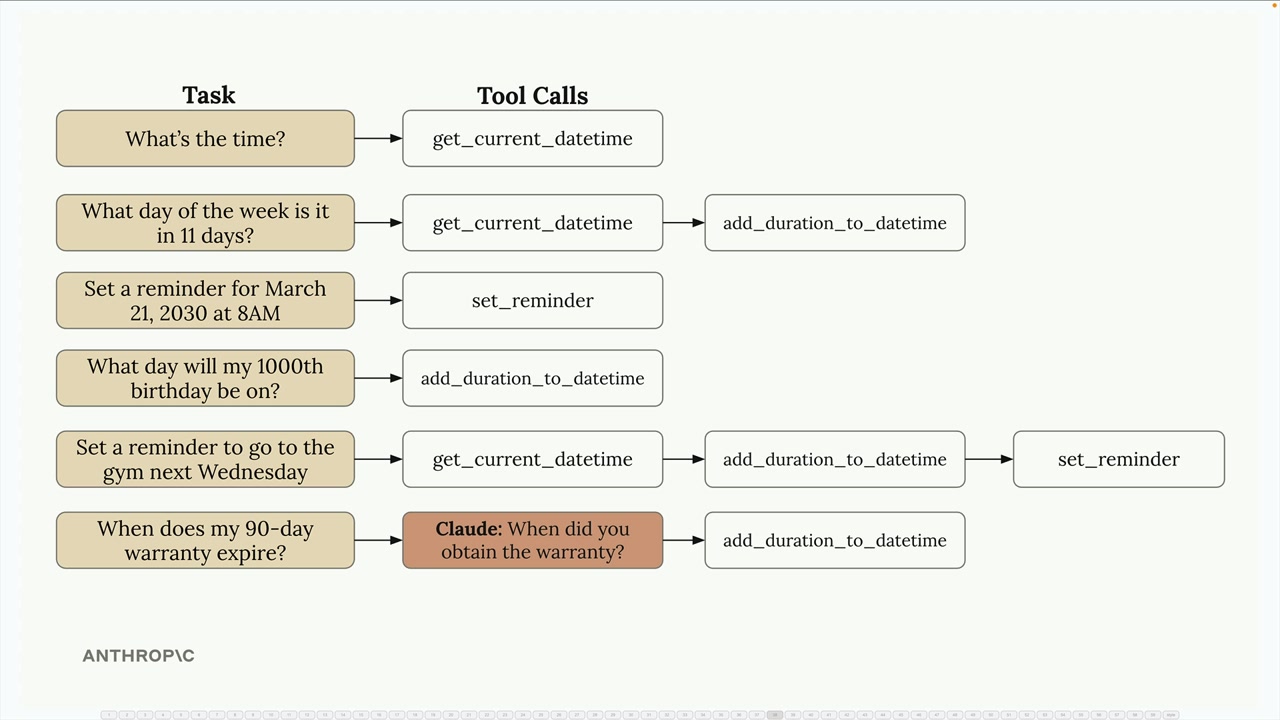

使用工具进行多轮对话

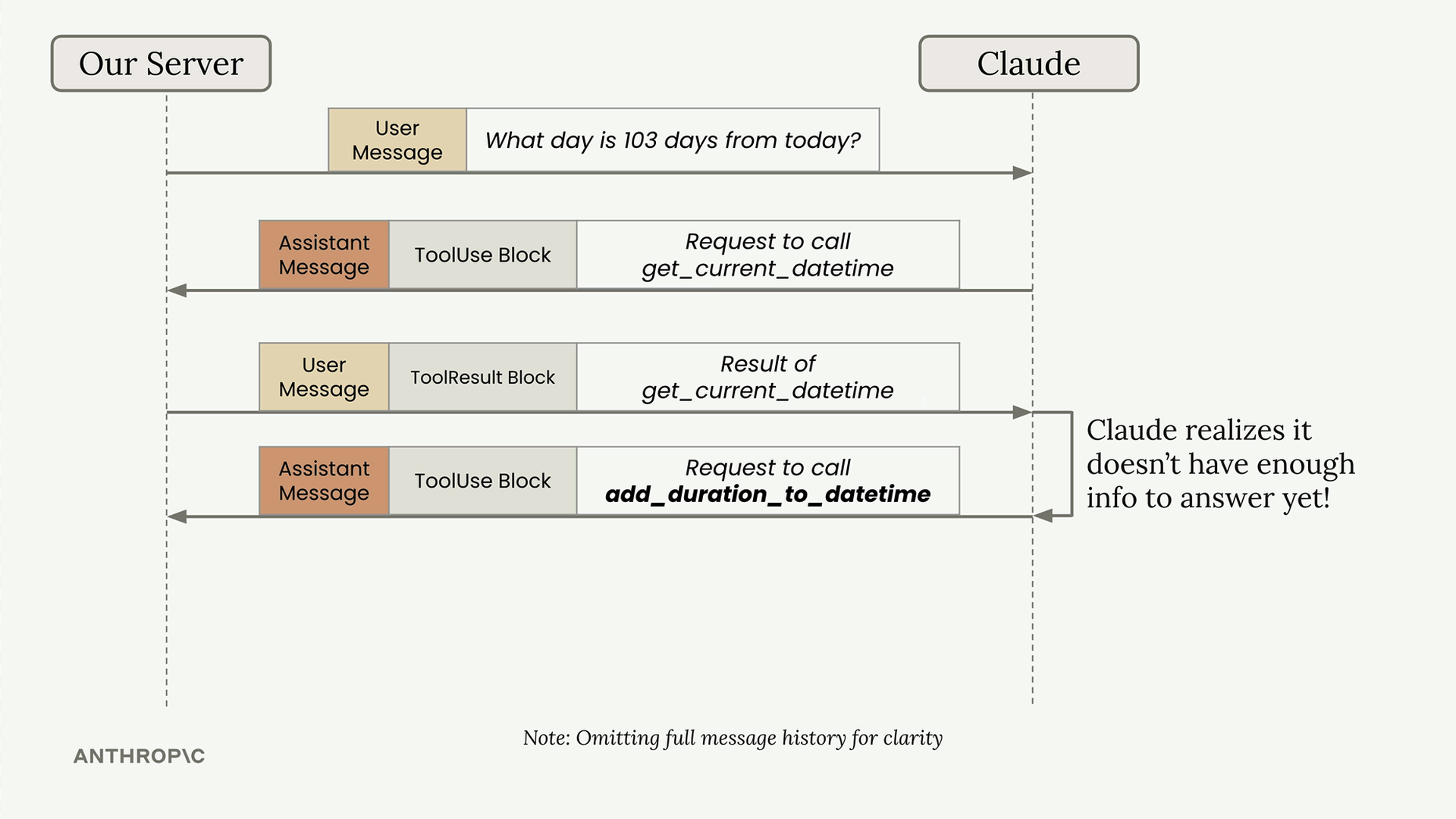

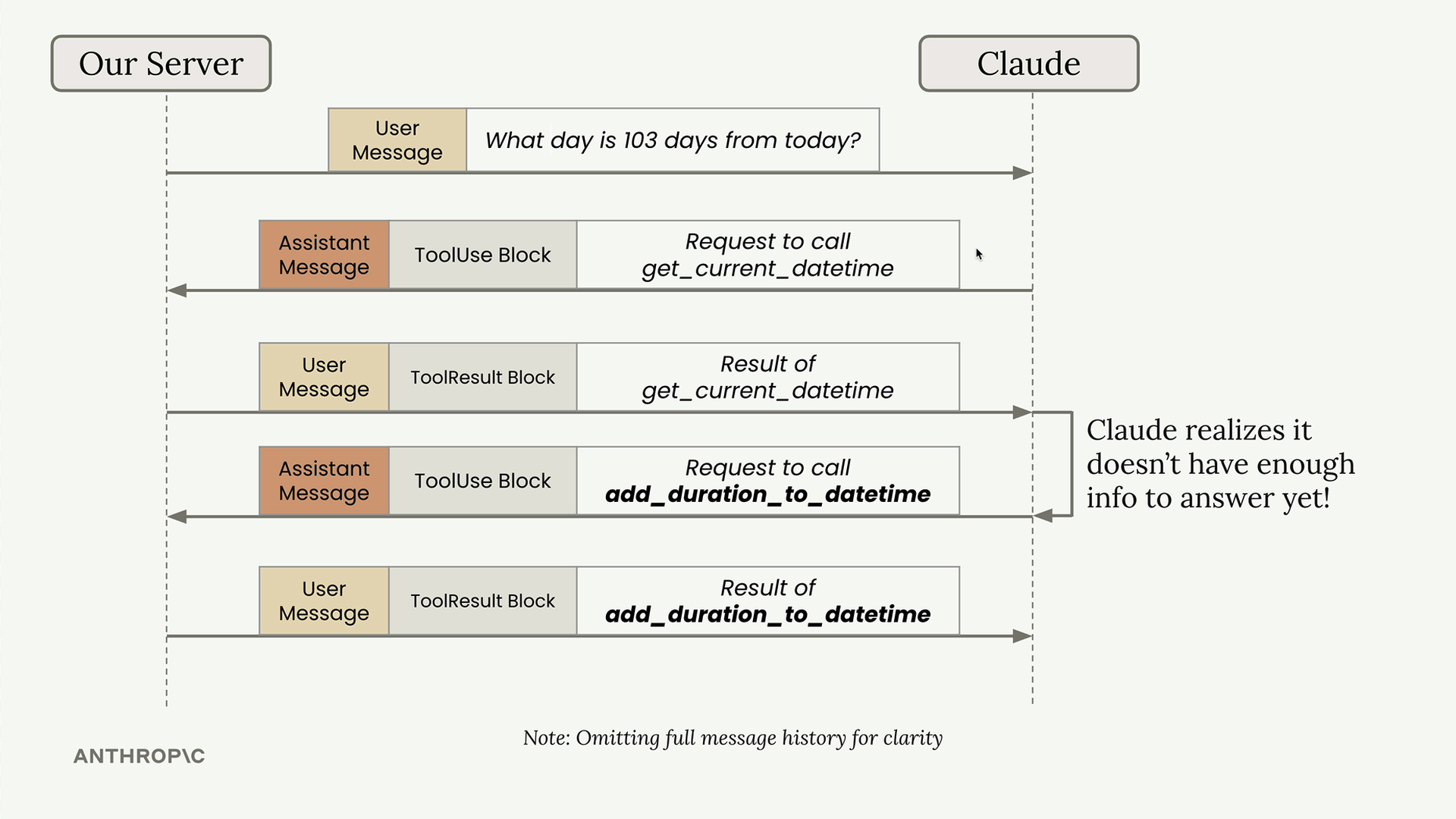

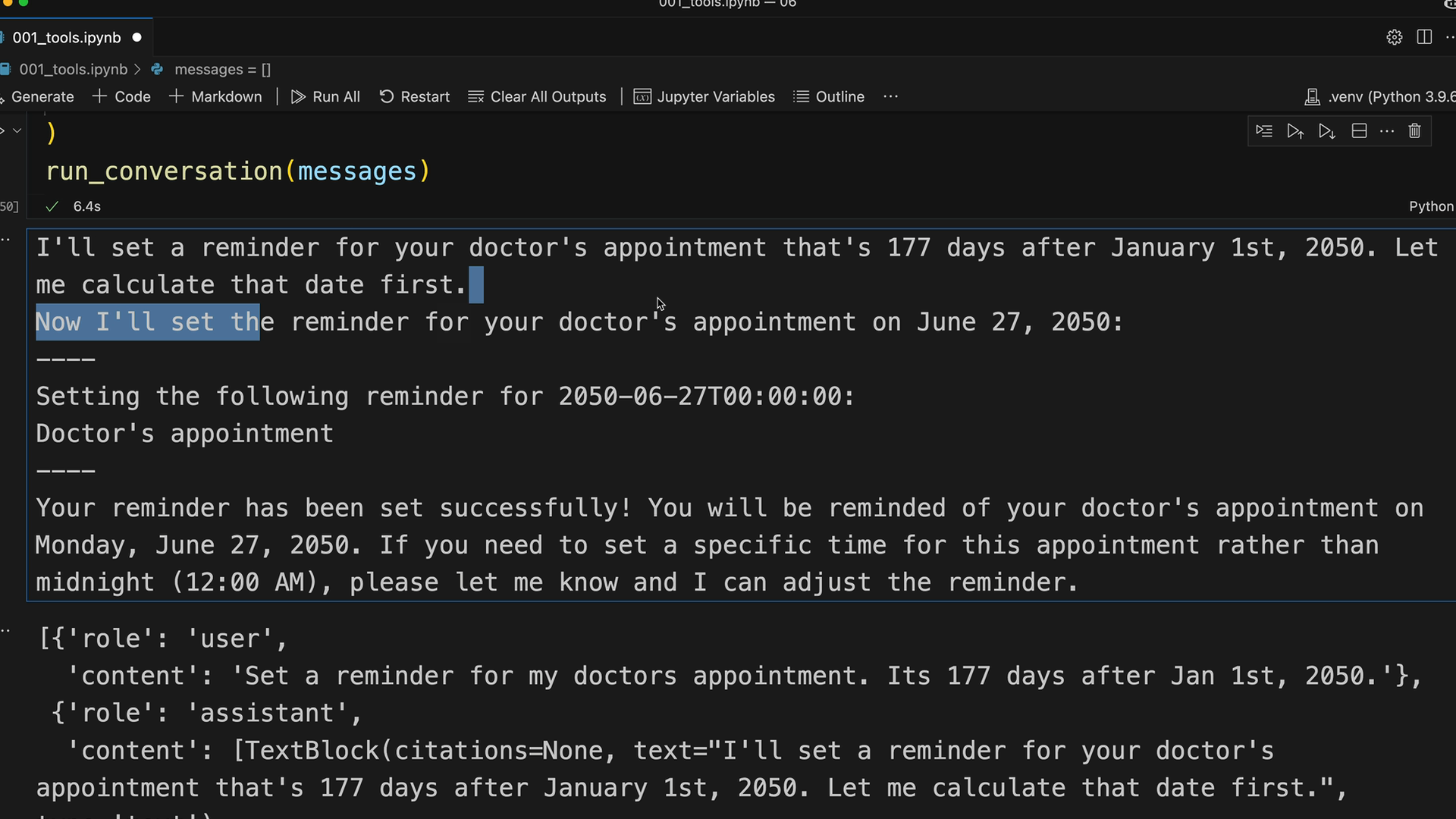

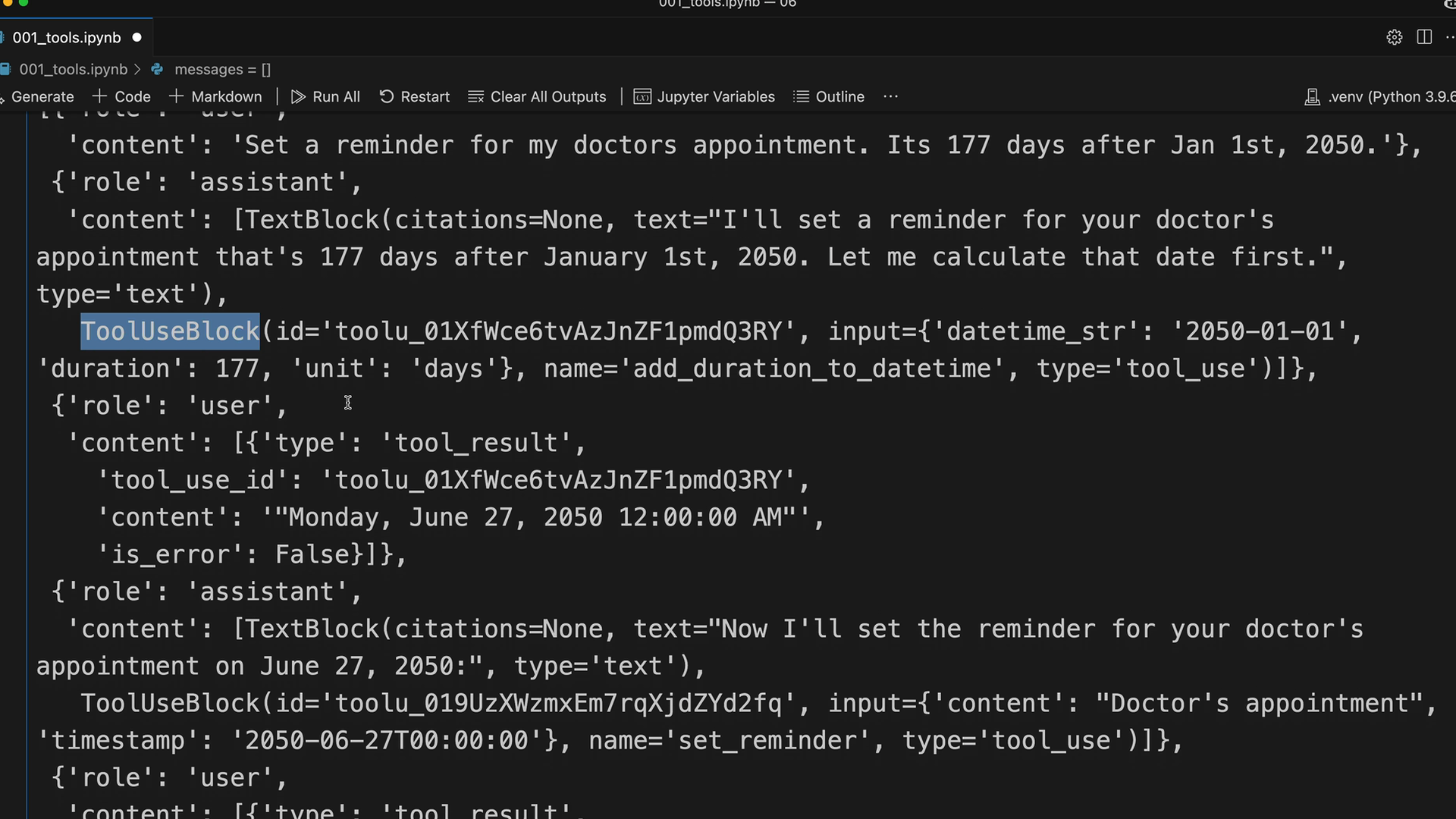

使用工具的多轮对话 = 对话中 Claude 为回答单个用户查询而顺序使用多个工具。

Tool Chaining (工具链) 过程 = 用户提问 → Claude 请求第一个工具 → 工具执行 → 返回结果 → Claude 请求第二个工具 → 工具执行 → 返回结果 → Claude 提供最终答案。

示例流程 = 用户问“从今天起 103 天后是哪一天” → Claude 调用 get_current_datetime → Claude 调用 add_duration_to_datetime → Claude 提供答案。

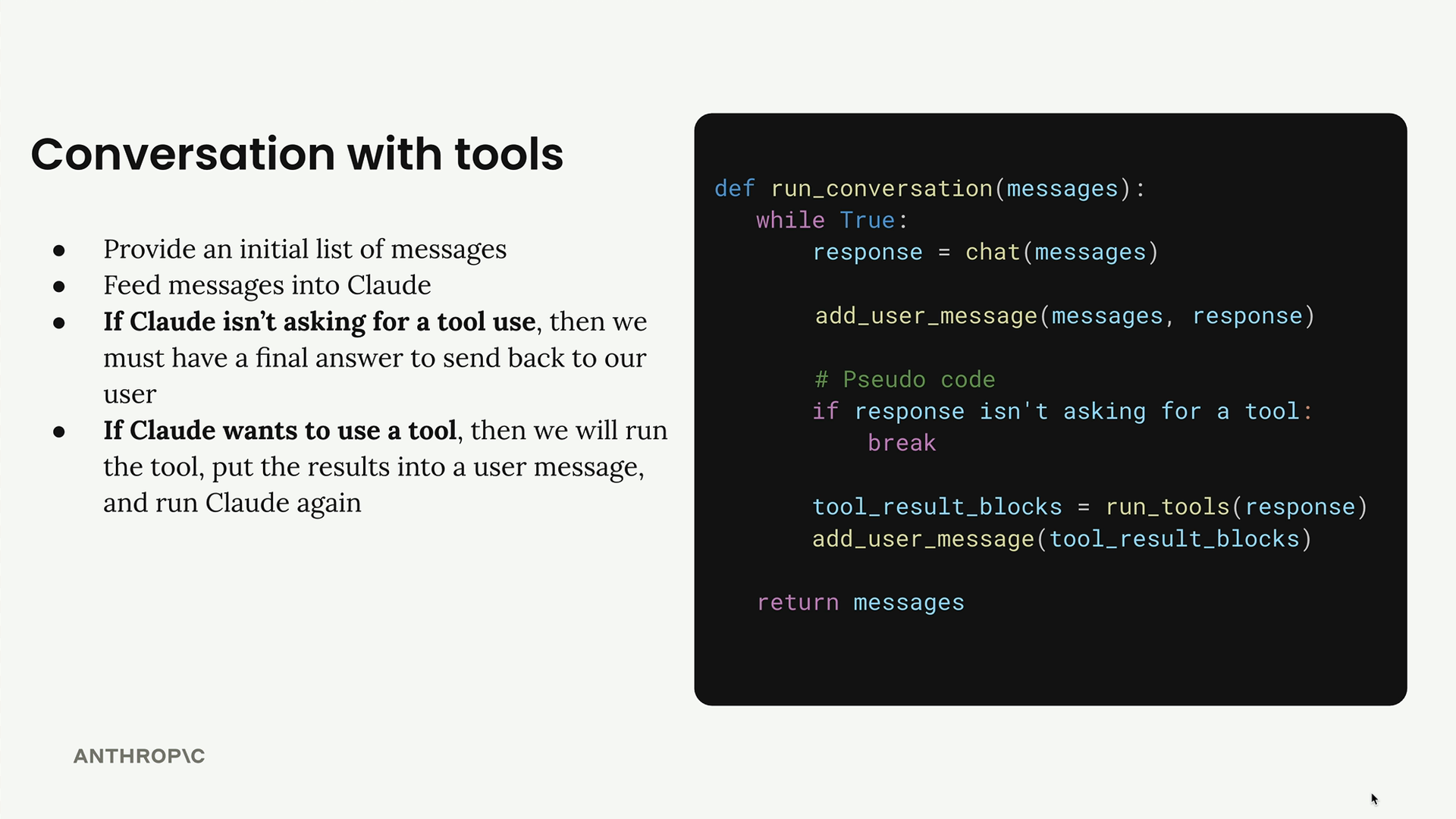

实现模式 = 使用 while 循环,持续调用 Claude 直到不再有工具请求,检查每个响应中是否有 tool_use 块。

run_conversation 函数 = 接收初始消息,循环调用 Claude,执行请求的工具,将结果添加到对话中,直到得到最终响应。

必需的重构:

add_user_message/add_assistant_message= 更新以处理多个消息块,而不仅仅是纯文本。chat函数 = 接受tools参数,返回整个消息而不仅仅是第一个文本块。text_from_message辅助函数 = 从具有多个内容块的消息中提取所有文本块。

核心洞见 = 无法预测用户查询需要多少个工具,因此系统必须能自动处理任意长度的工具调用链。

实现多轮交互

多轮交互的实现 = 持续调用 Claude 直到它停止请求工具

stop_reason 字段 = 表明 Claude 为何停止生成文本

stop_reason= "tool_use" 表示 Claude 想要调用一个工具。- 存在其他值,但

tool_use是最常检查的。

run_conversation 函数 = 主循环,其功能如下:

- 用消息 + 可用工具调用 Claude。

- 将助手响应添加到对话历史中。

- 检查

stop_reason- 如果不是 "tool_use",则跳出循环。 - 如果是 "tool_use",则调用

run_tools函数。 - 将工具结果作为用户消息添加。

- 重复此过程,直到没有更多的工具请求。

run_tools 函数 = 处理多个工具使用块:

- 从

message.content中筛选出类型为 "tool_use" 的块。 - 遍历每个工具请求。

- 通过

run_tool辅助函数运行相应的工具函数。 - 创建

tool_result块,包含:type="tool_result",tool_use_id=original_id,content=JSON_encoded_output,is_error=boolean。 - 返回所有工具结果块的列表。

run_tool 函数 = 一个分发器,其功能如下:

- 接收

tool_name和tool_input。 - 使用

if语句将工具名称与函数匹配。 - 执行相应的工具函数。

- 可扩展以添加多个工具。

错误处理 = 在工具执行周围使用 try/except 块:

- 成功:

is_error=false,content=tool_output。 - 失败:

is_error=true,content=error_message。

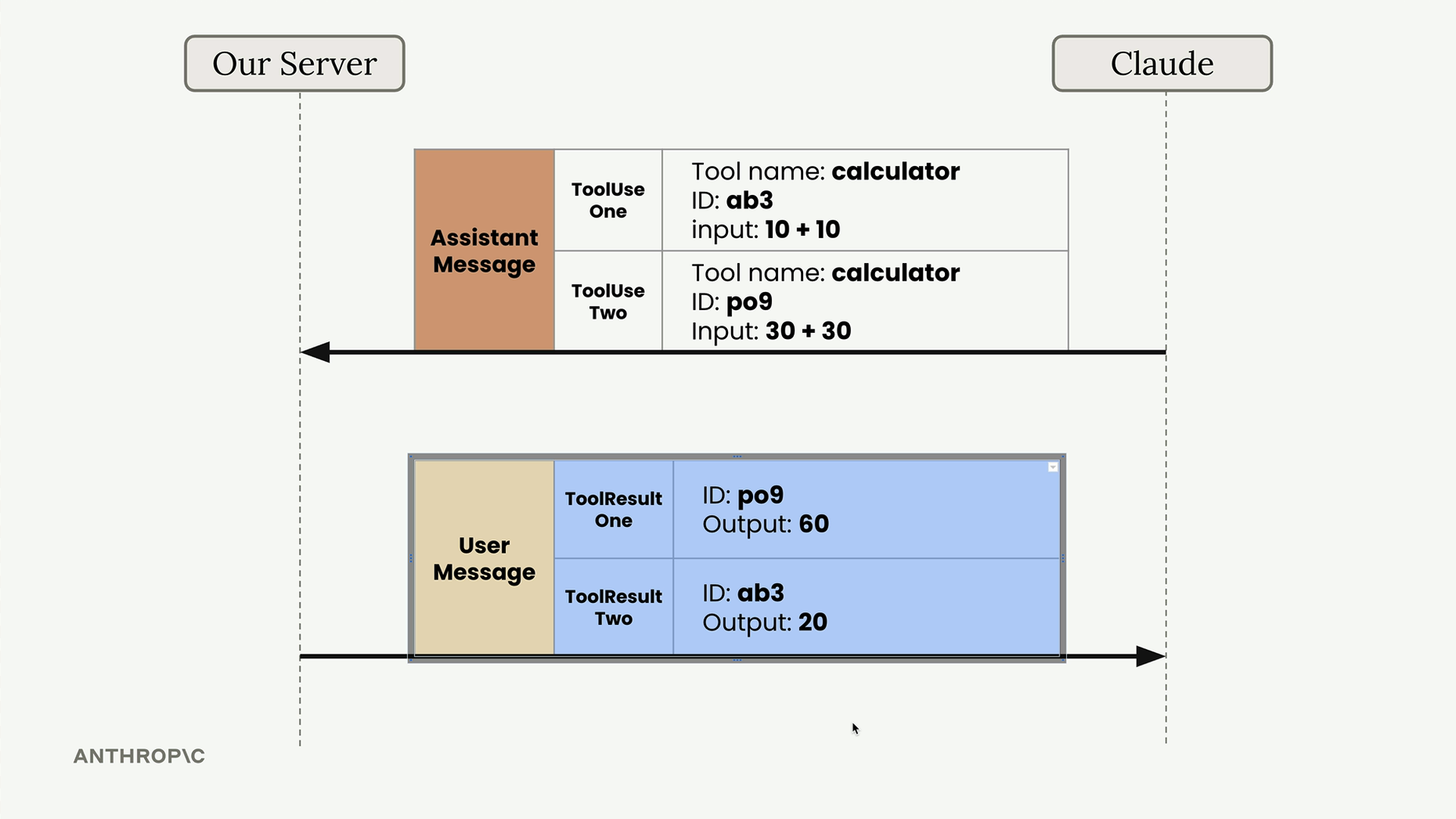

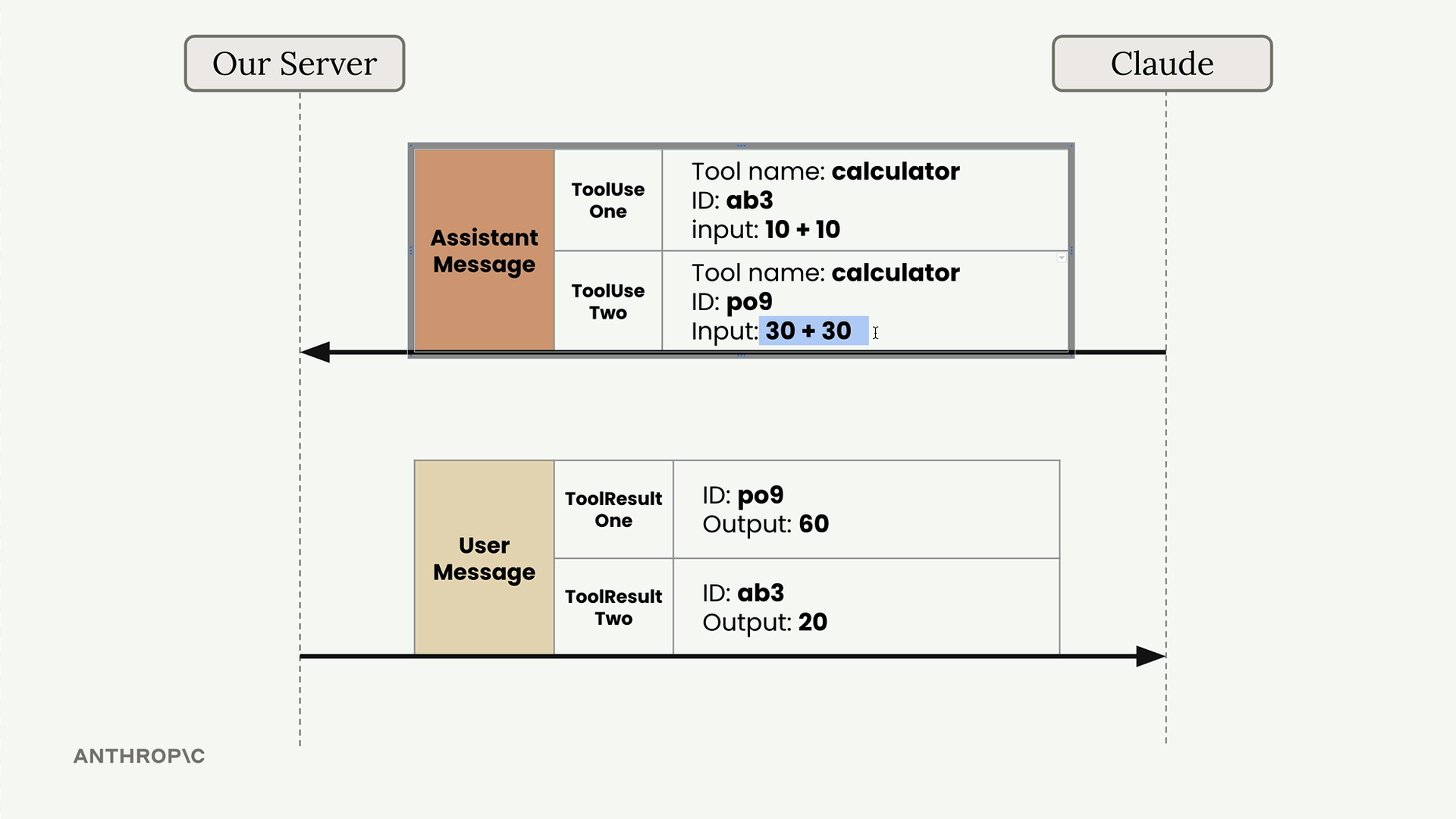

关键架构要点:

- 助手消息可以包含多个块(文本 + 多个

tool_use)。 - 每个

tool_use块都得到一个单独的tool_result响应。 - 工具结果作为包含所有结果的用户消息发回。

- 该过程重复进行,直到 Claude 提供最终的纯文本响应。

使用多个工具

实现多个工具 = 在初始框架建立后,向现有工具系统添加额外的工具。

过程 = 3 个步骤:(1) 将工具模式添加到 RunConversation 函数的 tools 列表中,(2) 在 RunTool 函数中添加条件分支来处理新的工具名称,(3) 实现实际的工具函数。

关键组件:

RunConversation函数 = 包含tools列表,使 Claude 了解可用的工具。RunTool函数 = 根据工具名称将工具调用路由到相应的函数。- 工具模式 = 为 AI 模型定义工具结构。

- 工具函数 = 实际的实现代码。

添加的示例工具:

AddDurationToDateTime= 计算带有时长偏移的日期/时间。SetReminder= 创建提醒(一个打印确认信息的模拟实现)。

工具链 = AI 可以在单次对话中按顺序使用多个工具(例如,先计算日期,然后用结果设置提醒)。

消息结构 = 助手响应可以包含多个块:同一消息中可同时包含文本块和工具使用块。

可扩展性 = 初始框架建立后,添加新工具就变成了简单的模式:模式 + 路由 + 实现。

批量工具(Batch Tool)

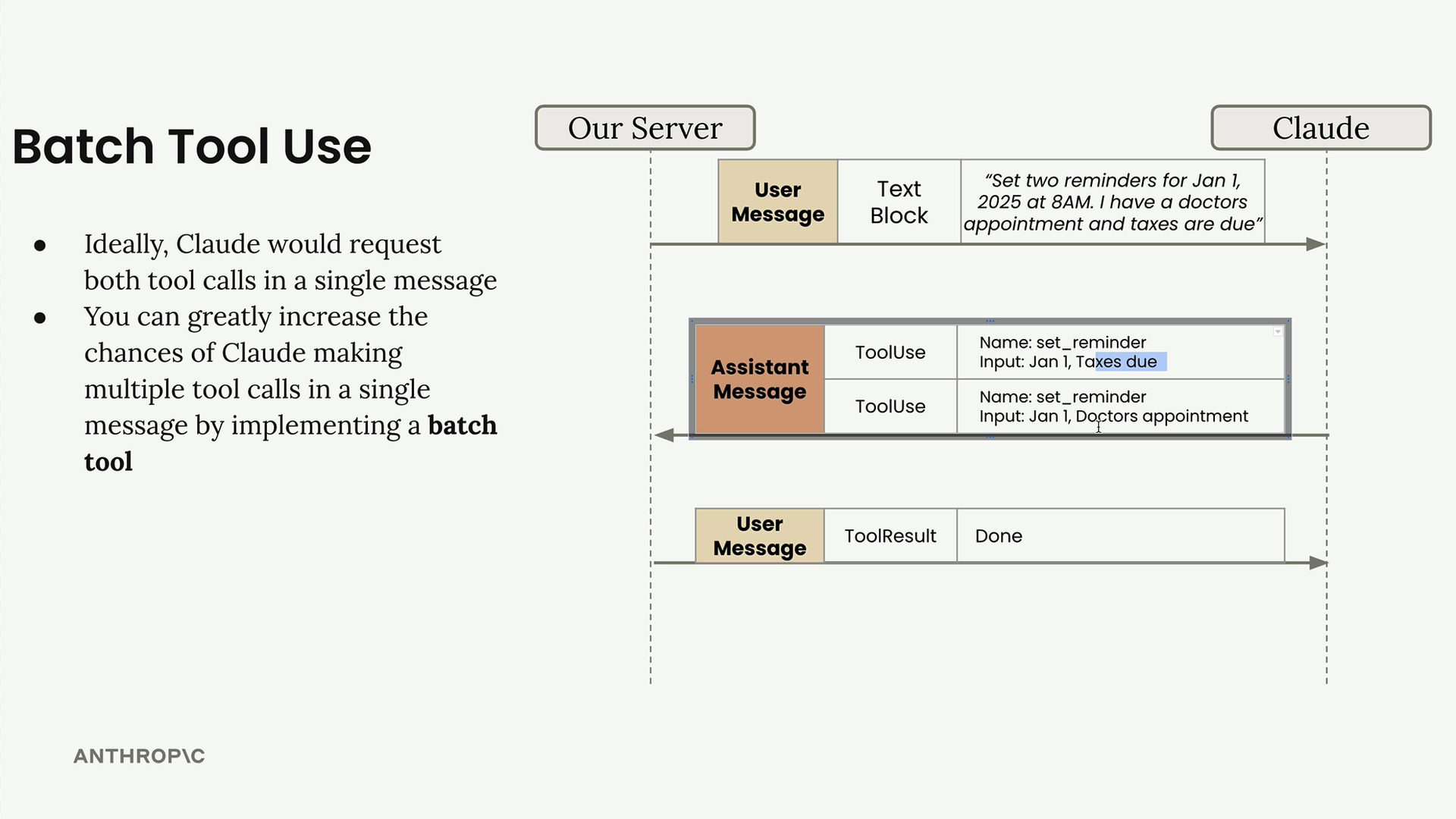

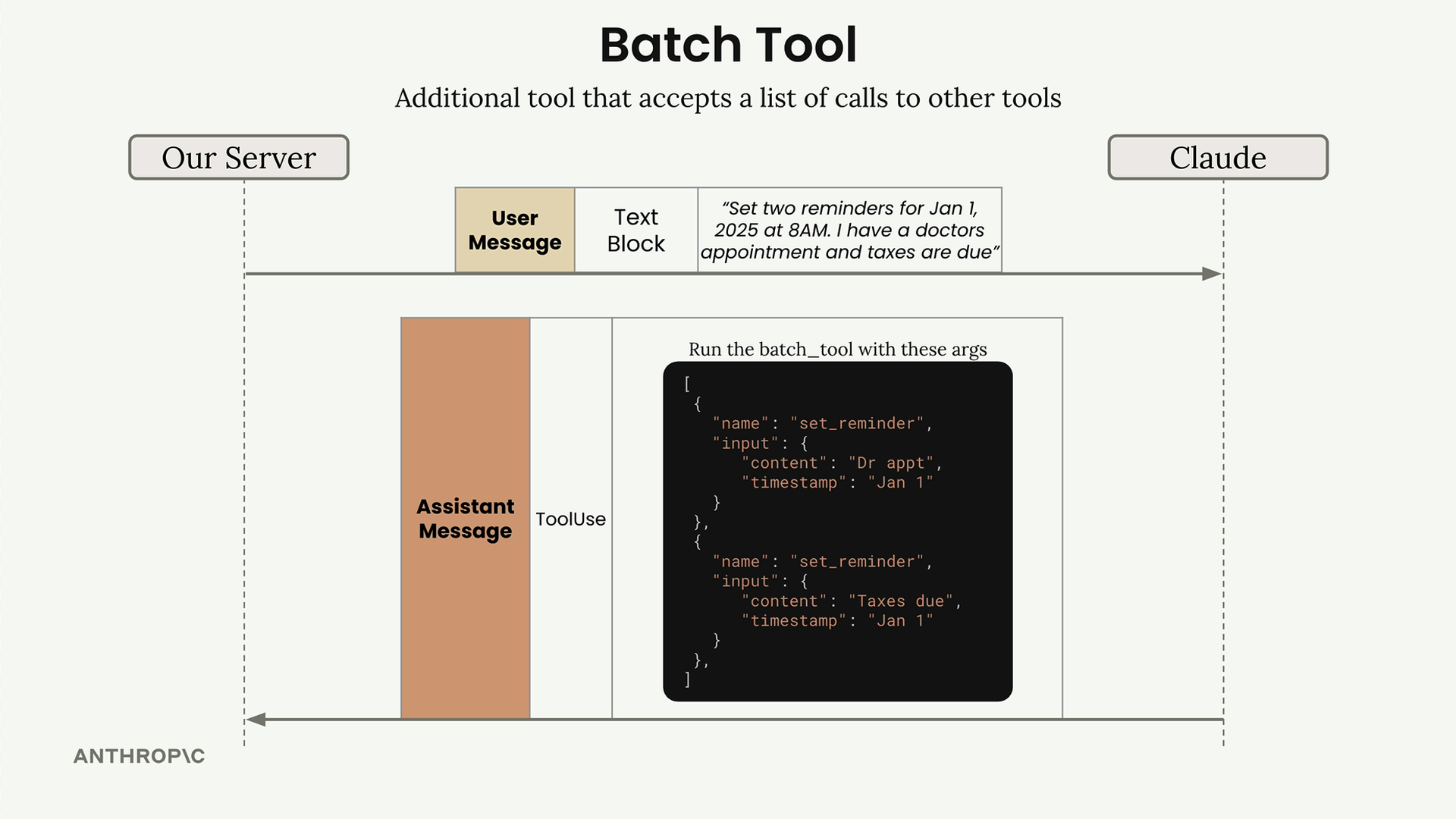

Batch Tool (批量工具) = 一种工具,它使 Claude 能够在单个助手消息中并行运行多个工具,而不是发出多个顺序请求。

问题:理论上 Claude 可以在一条消息中发送多个工具使用块,但在实践中很少这样做,导致不必要的顺序工具调用。

解决方案:创建一个批量工具模式,该模式接受一个 invocations(调用)列表,每个调用包含工具名称 + 参数。Claude 不再直接调用工具,而是调用这个批量工具,并附带一个期望执行的工具数组。

实现方式:

- 在模式中添加批量工具,并带有

invocations参数。 - 创建

run_batch函数,遍历invocations列表。 - 从每个调用中提取工具名称和经 JSON 解析的参数。

- 为每个请求的工具调用

run_tool函数。 - 返回一个包含所有工具执行结果的

batch_output列表。

机制:通过提供一个更高级别的抽象,手动处理多个工具使用块本应自动完成的工作,从而“欺骗” Claude 进行并行工具执行。

结果:对于可并行执行的任务,只需一次请求-响应周期,而不是多个顺序的轮次。

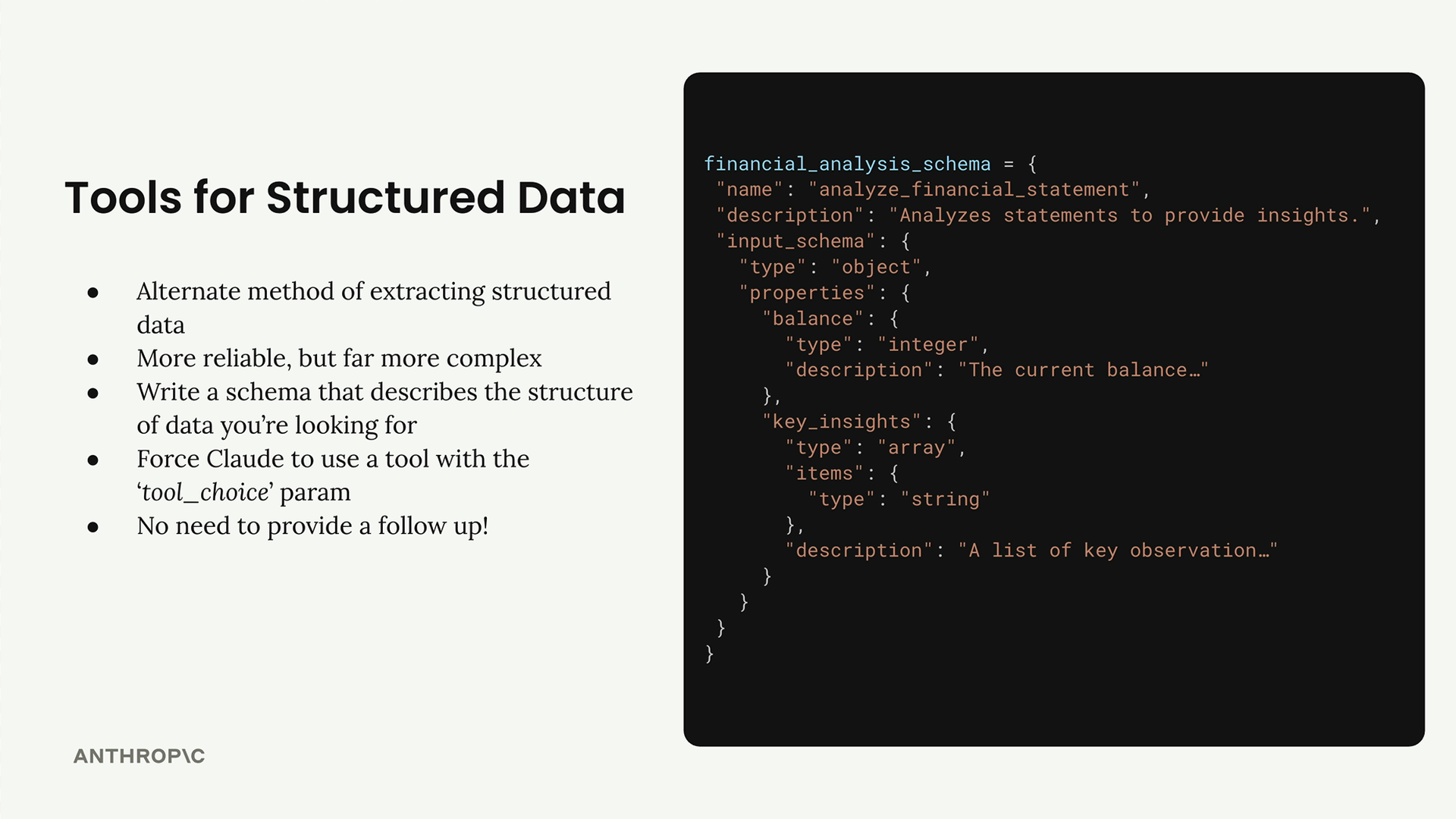

用于结构化数据的工具

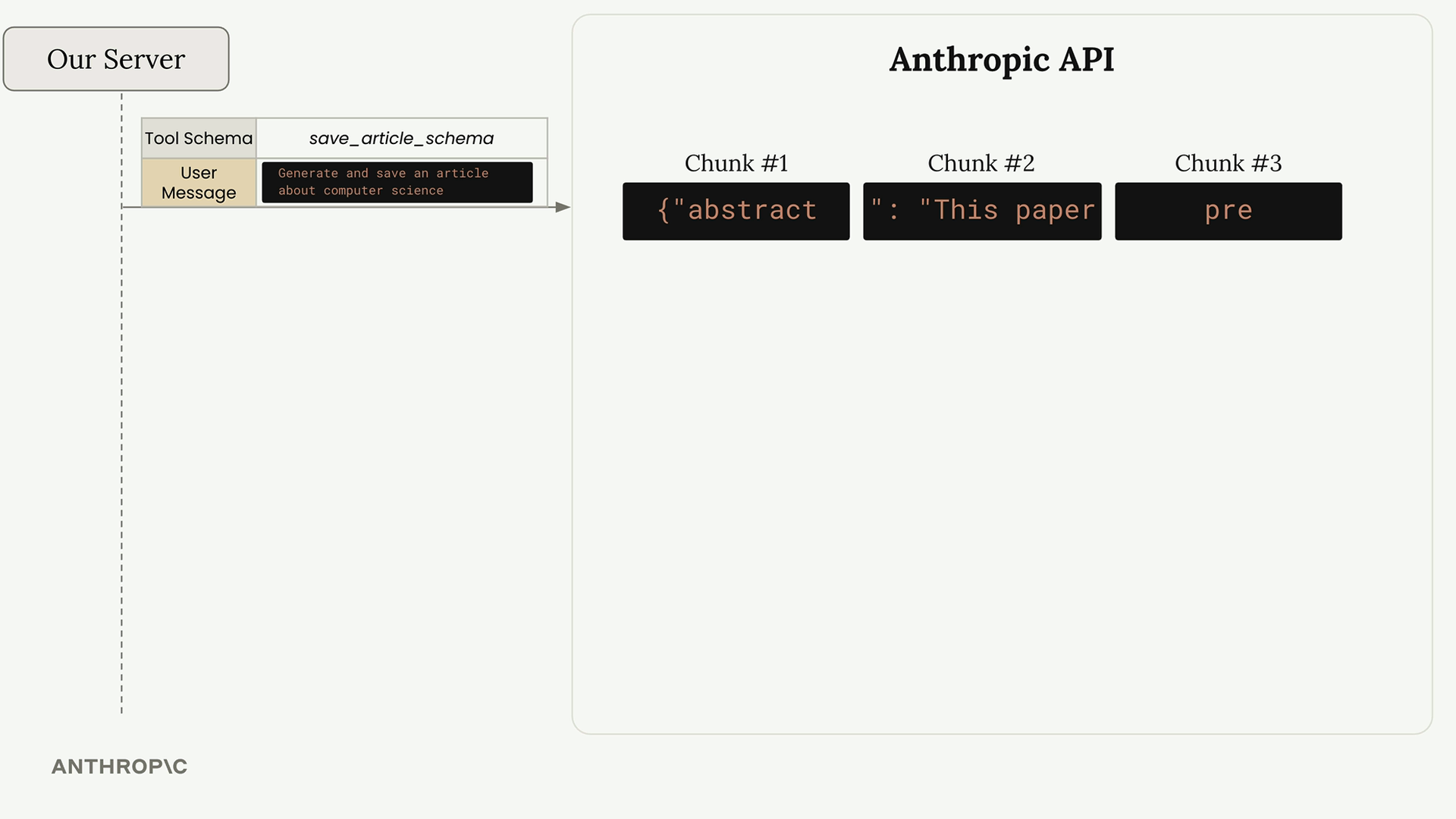

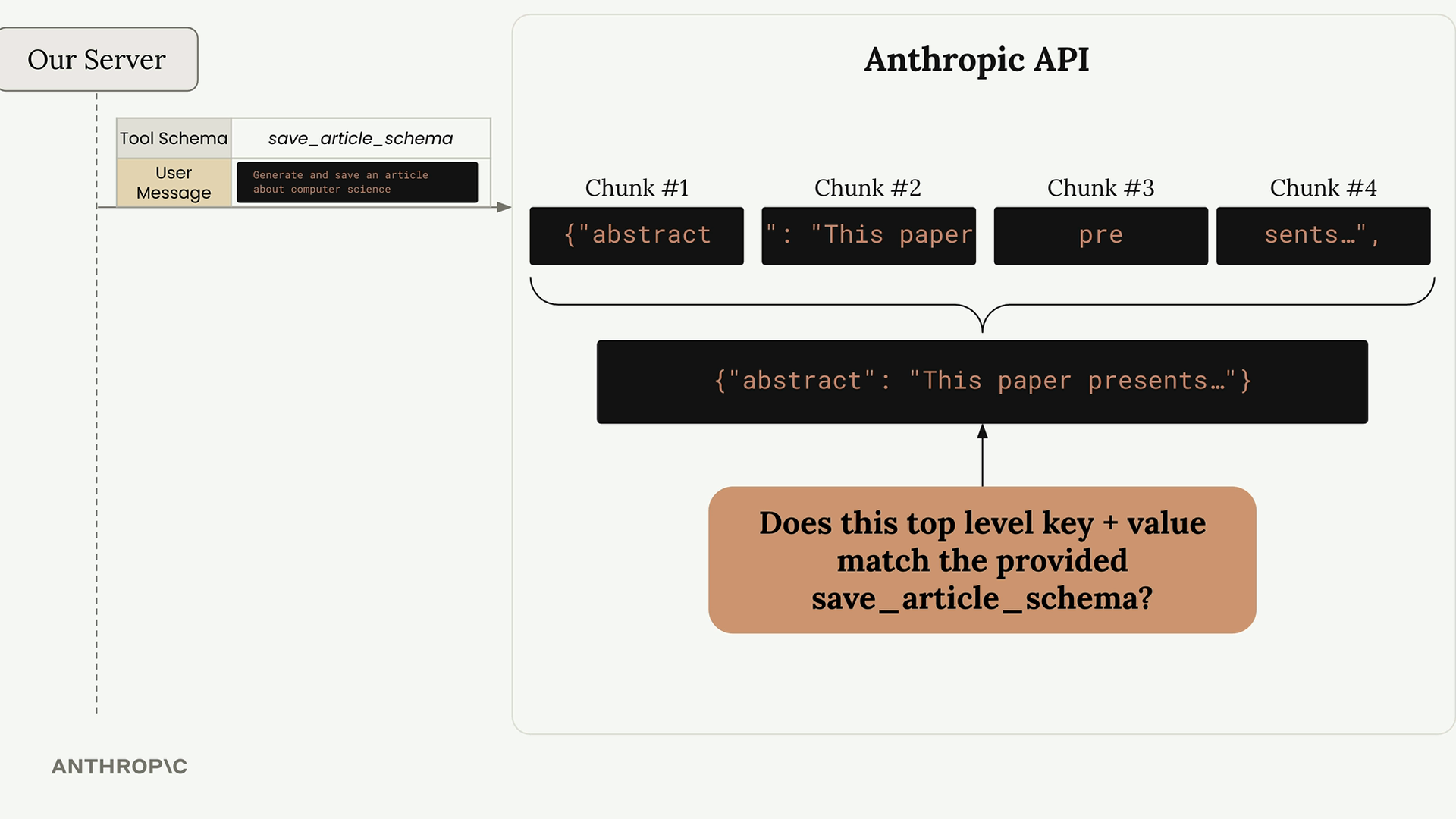

用于结构化数据的工具 = 一种从数据源中提取结构化 JSON 的替代方法,它使用 Claude 的工具系统,而不是消息预填充和停止序列。

与基于提示词的提取方法的主要区别:

- 输出更可靠。

- 设置更复杂。

- 需要 JSON 模式规范。

核心流程:

- 为工具定义 JSON 模式,其中输入 = 期望的数据结构。

- 将提示词 + 模式发送给 Claude。

- Claude 使用与模式匹配的结构化参数调用工具。

- 从工具使用块中提取 JSON(不需要工具结果)。

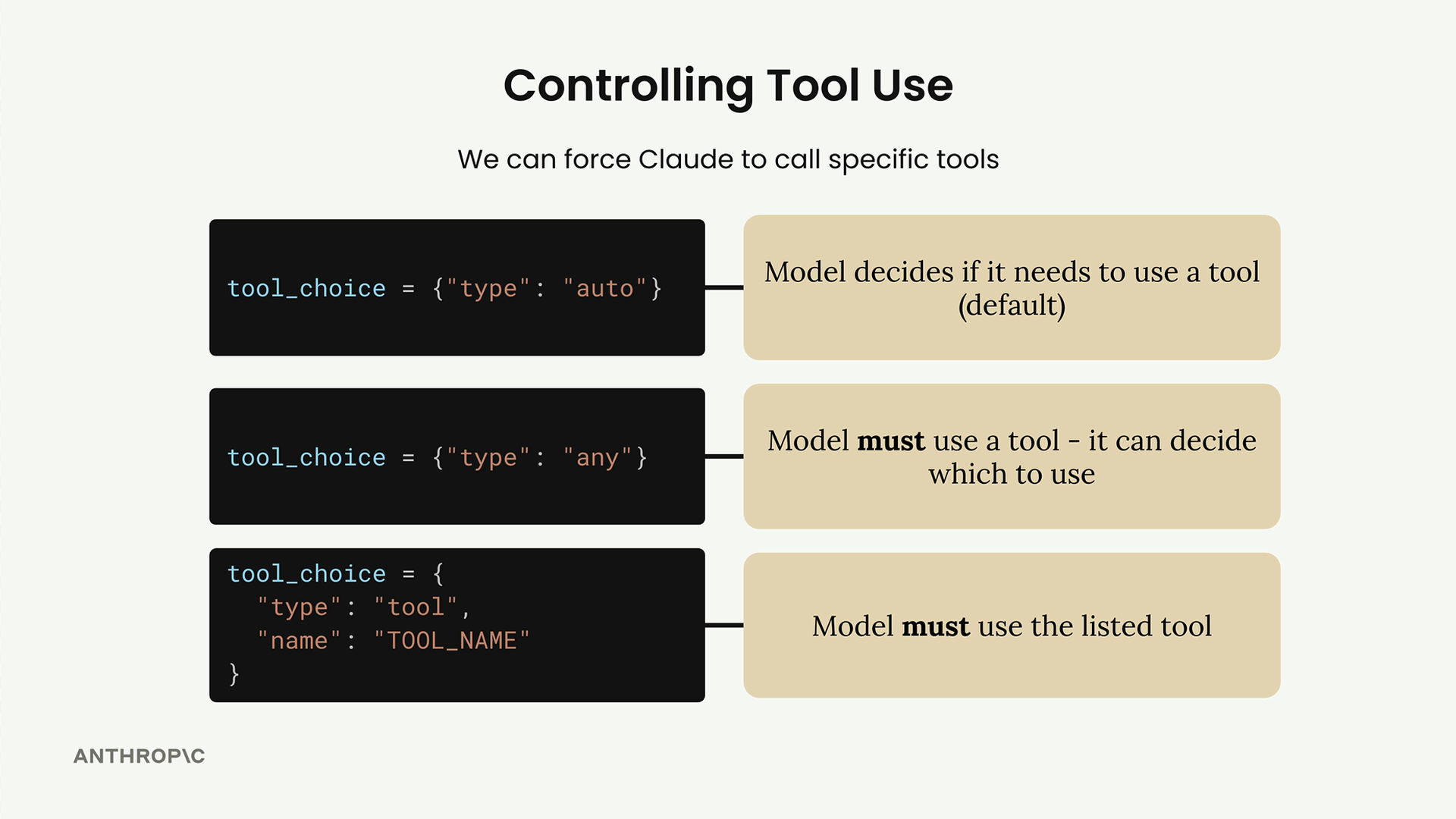

关键要求 = 使用 tool_choice 参数强制进行工具调用:

tool_choice = {"type": "tool", "name": "your_tool_name"}- 确保 Claude 总是调用指定的工具。

实现步骤:

- 为提取工具创建模式定义。

- 更新

chat函数以接受tool_choice参数。 - 将

tool_choice传递给client.messages.create()。 - 从

response.content[0].input访问结构化数据。

使用场景 = 当可靠性比简单性更重要时。基于提示词的方法更适合快速/简单的提取,而工具更适合复杂/可靠的提取。

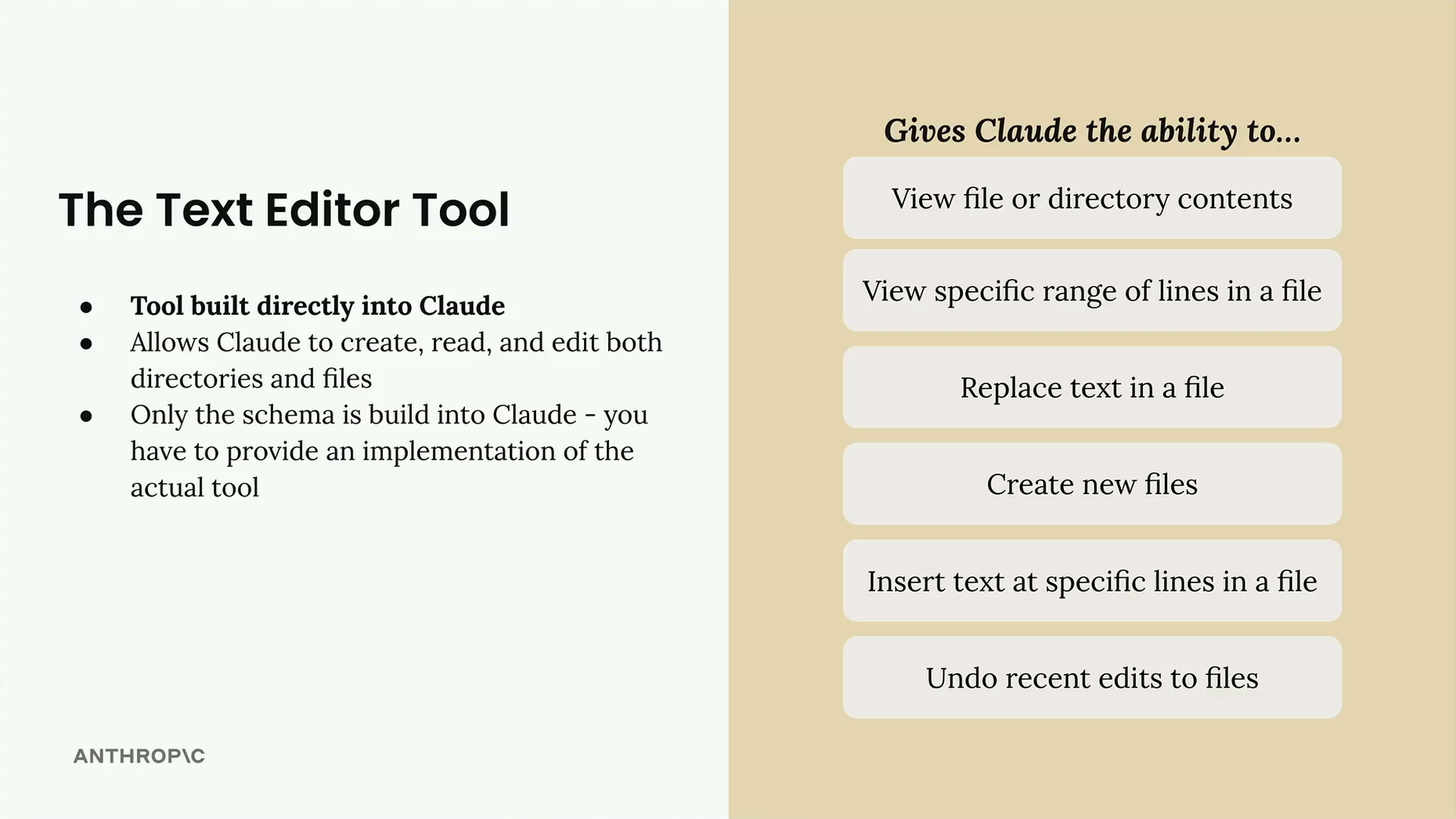

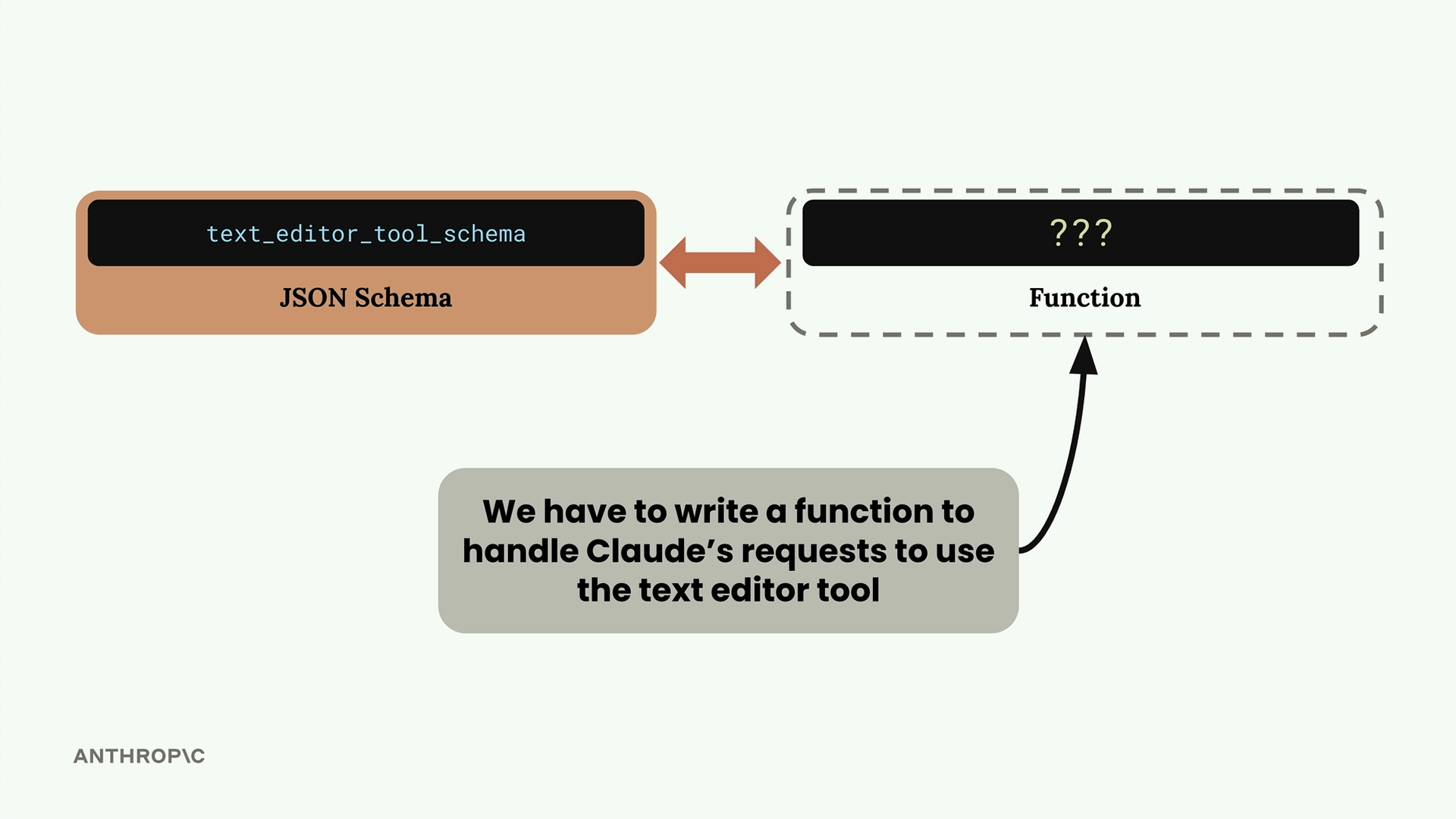

文本编辑器工具

Text Editor Tool (文本编辑器工具) = Claude 内置的用于文件/文本操作的工具(读取、写入、创建、替换、撤销文件/目录)。

主要特点:

- 只有 JSON 模式是内置于 Claude 中的,实现必须自定义编码。

- 发送给 Claude 的模式存根会自动扩展为完整的模式。

- 模式类型字符串因 Claude 模型版本而异(3.5 和 3.7 版本有不同的日期)。

- 使 Claude 能够开箱即用地扮演软件工程师的角色。

必需的实现:

- 用于处理 Claude 工具使用请求的自定义类/函数。

- 用于查看文件、字符串替换、创建文件等的函数。

- Claude 不提供实际的文件系统操作。

工作流程:

- 向 Claude 发送最小的模式存根(名称 + 带有特定版本日期的类型)。

- Claude 在内部将其扩展为完整模式。

- Claude 发送工具使用请求。

- 自定义实现执行实际的文件操作。

- 结果被发送回 Claude。

使用场景:

- 复制 AI 代码编辑器的功能。

- 在无法使用原生编辑器的情况下进行文件系统操作。

- 自动代码生成/重构。

- 多文件项目操作。

优点 = 通过 API 调用而非图形用户界面(GUI)交互,近似实现了高级代码编辑器的功能。

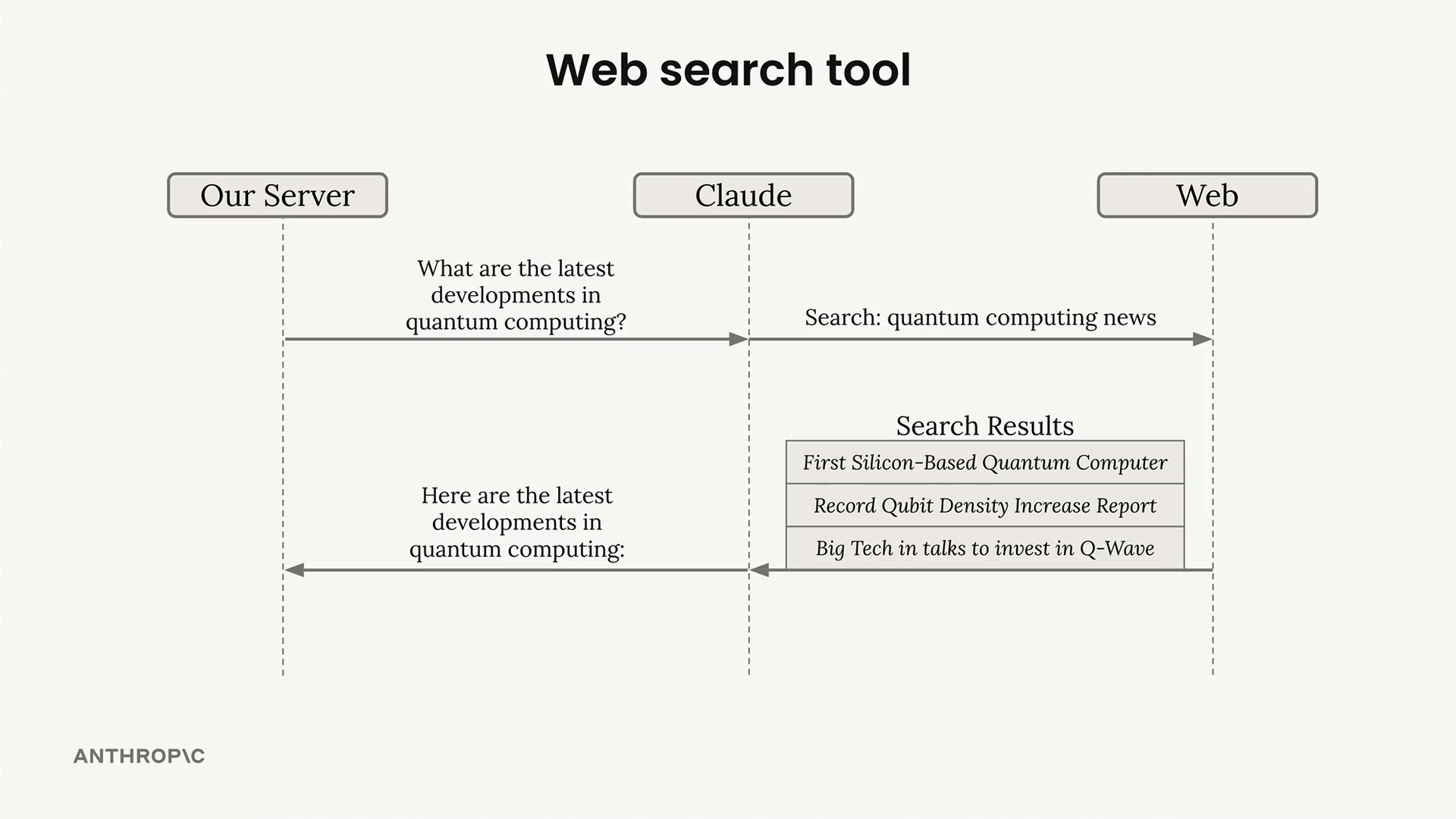

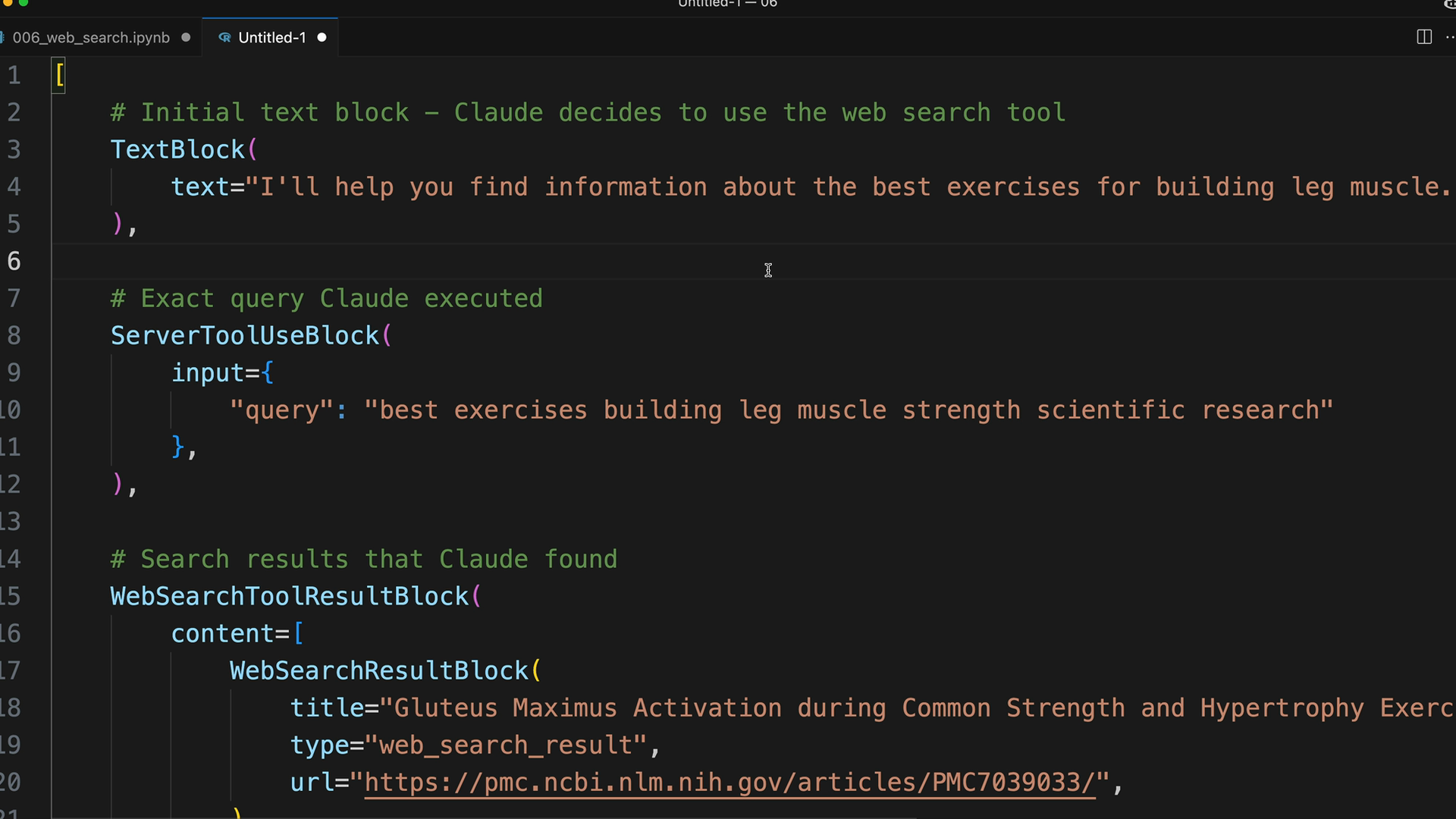

网络搜索工具

Web Search Tool (网络搜索工具) = Claude 的一个内置工具,用于在网络上搜索最新/专业信息以回答用户问题。

实现 = 无需自定义代码,Claude 自动处理搜索执行。

模式要求:

type: "web_search_20250305"name: "web_search"max_uses: number (限制总搜索次数,默认为 5)allowed_domains: 可选列表,用于将搜索限制在特定域名。

响应结构:

- 文本块 = Claude 的解释性文本。

- 工具使用块 = Claude 执行的搜索查询。

- 网络搜索结果块 = 找到的页面(标题、URL)。

Citations(引用) 块 = 支持 Claude 陈述的特定文本。

主要特点:

- 每个请求可进行多次搜索(最多

max_uses次)。 - 可通过域名限制进行质量控制。

- 引用系统将陈述链接到源材料。

UI 渲染模式:

- 将文本块显示为普通文本。

- 将搜索结果显示为参考列表。

- 用来源归属(域名、标题、URL、引用的文本)高亮显示引用。

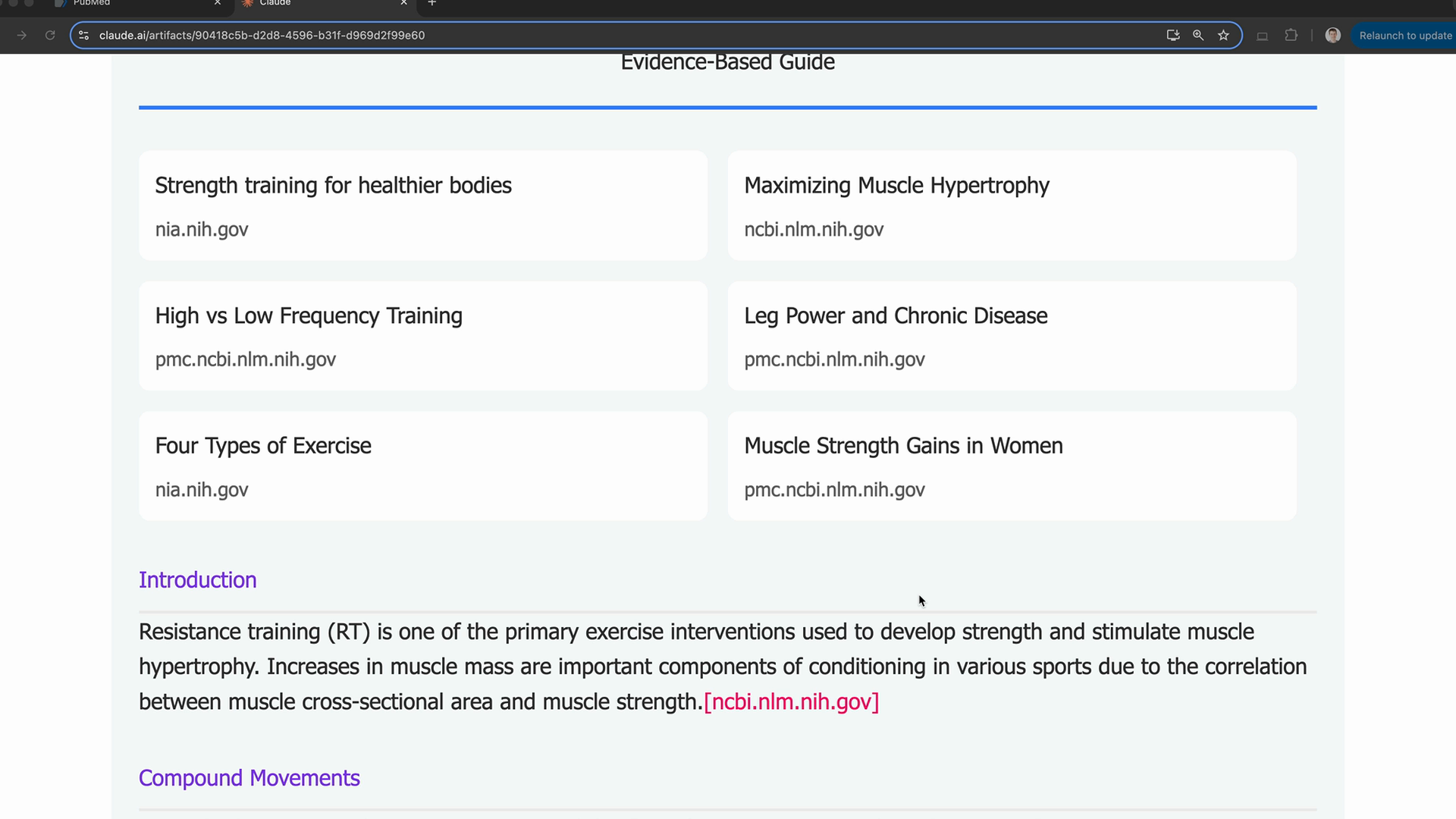

用例示例:将搜索限制在 NIH.gov 以获取医疗/运动建议,确保信息有科学依据,而不是来自泛泛的网络内容。

检索增强生成(RAG)简介

RAG = Retrieval Augmented Generation (检索增强生成),一种使用语言模型查询大型文档的技术。

问题:如何在不超出上下文限制的情况下,使用 Claude 从大型文档(100-1000+ 页)中提取特定信息。

选项 1(直接方法):将整个文档文本直接放入提示词中。

- 局限性:存在硬性的词元限制,长提示词效果下降,成本更高,处理更慢。

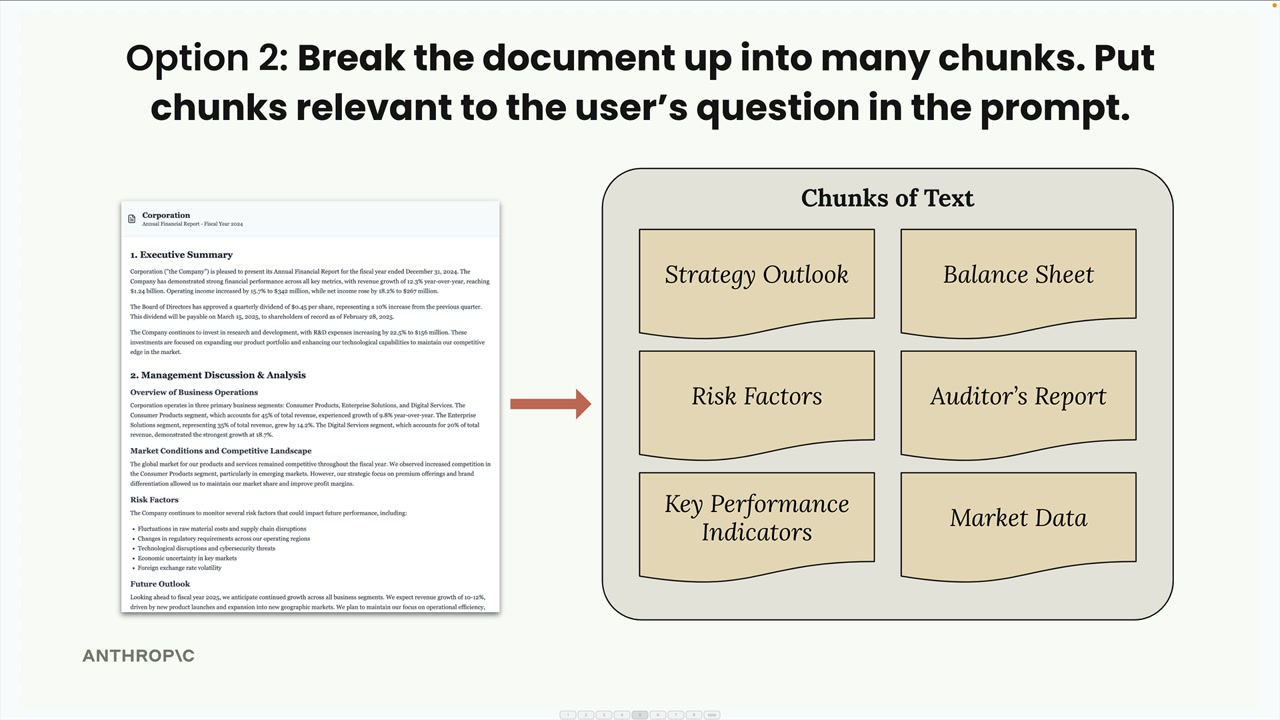

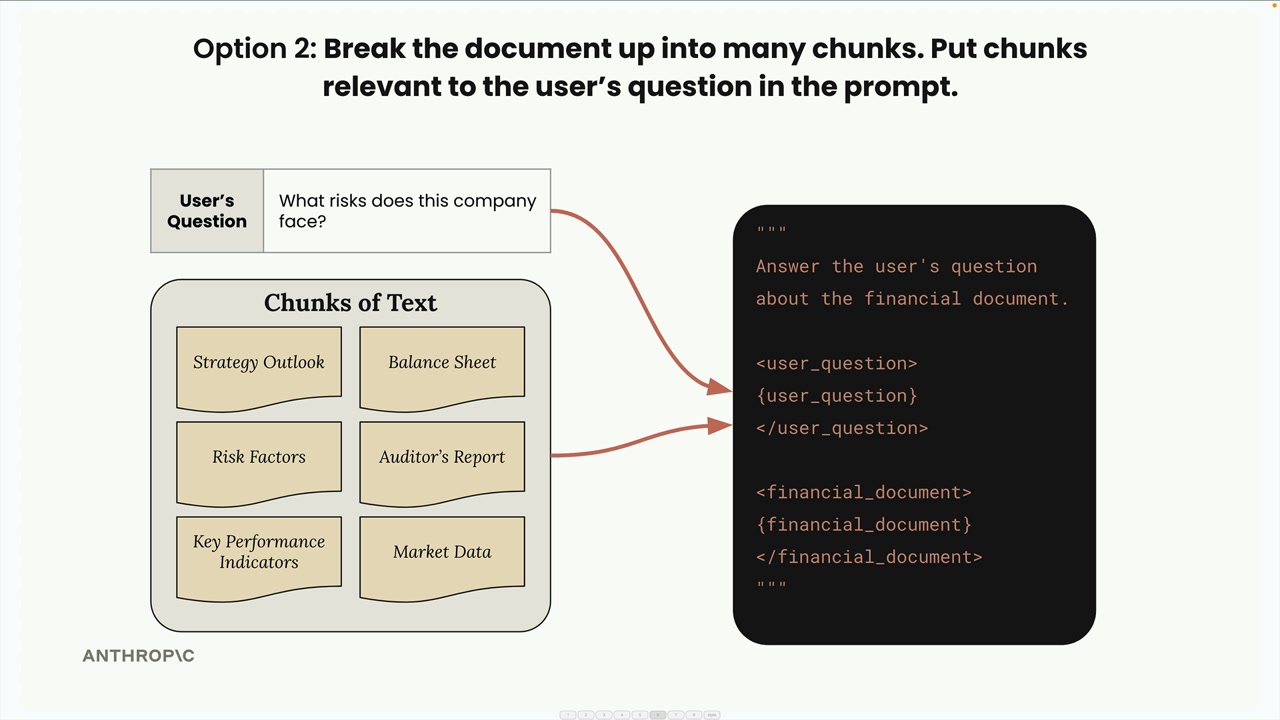

选项 2(RAG 方法):两步过程。

- 第 1 步:将文档分成小块。

- 第 2 步:对于用户问题,找到最相关的块,并仅将这些块包含在提示词中。

RAG 的好处:模型专注于相关内容,可扩展至大型/多个文档,提示词更小,成本更低,处理更快。

RAG 的缺点:更复杂,需要预处理,需要搜索机制来查找相关块,不保证块中包含完整上下文,可能存在多种分块策略(等分 vs. 基于标题)。

关键挑战:为特定用例定义相关性和最佳分块策略。

RAG 以简单性换取了可扩展性和效率,但需要仔细的实现和评估。

文本分块策略

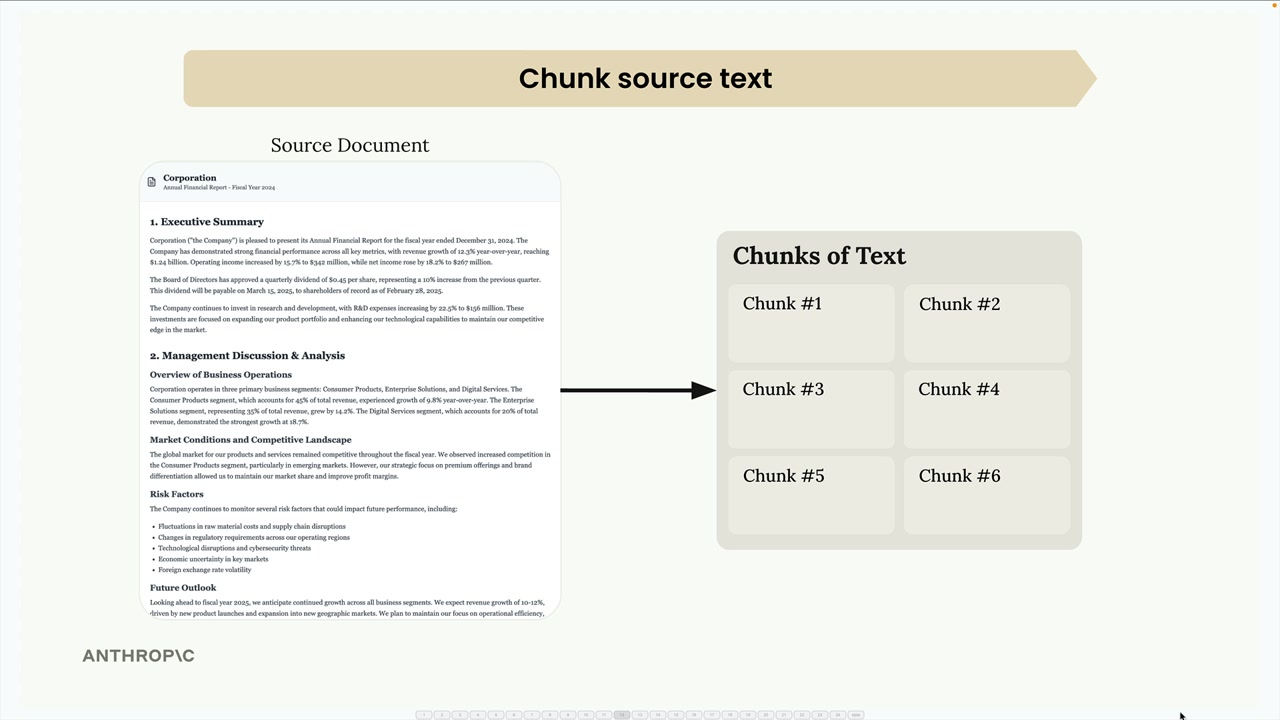

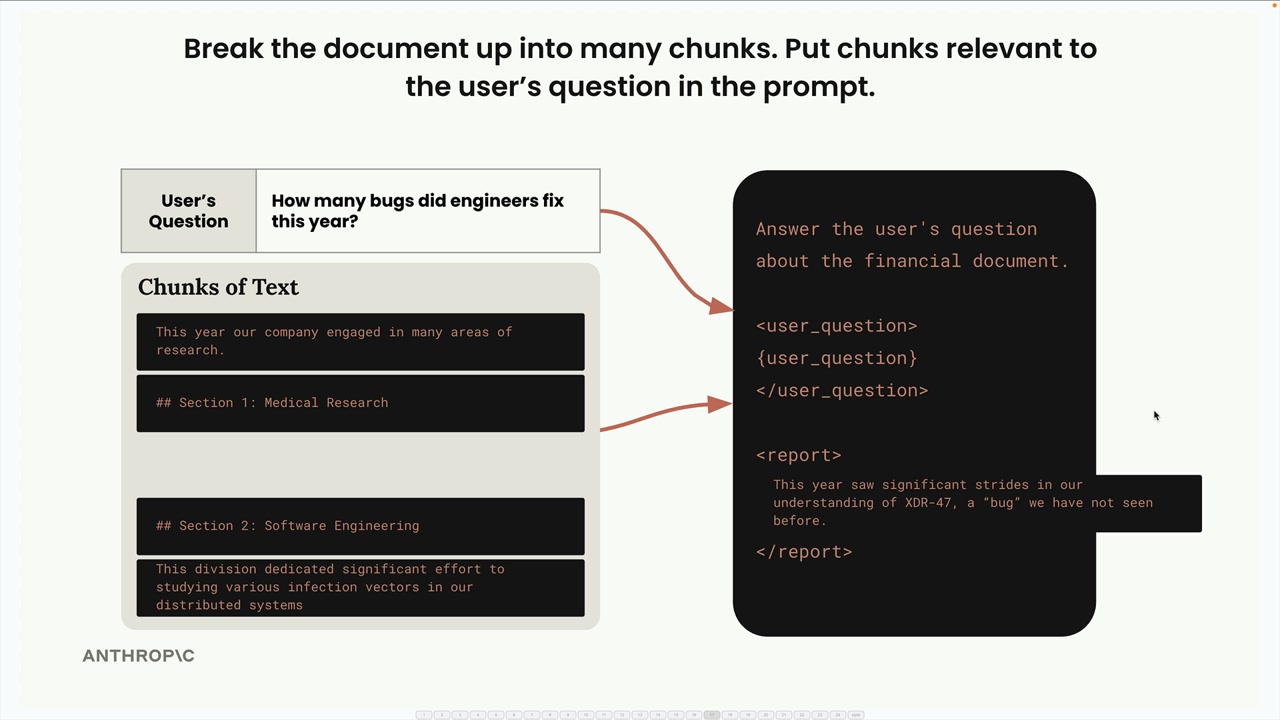

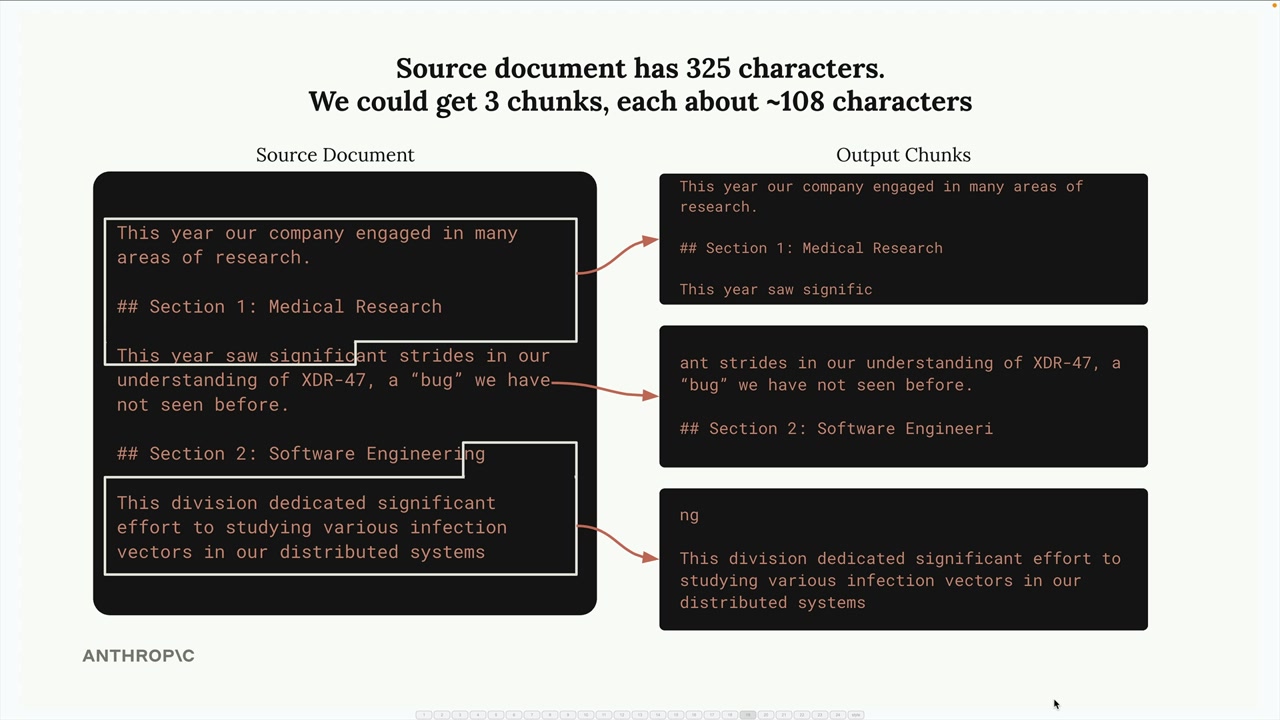

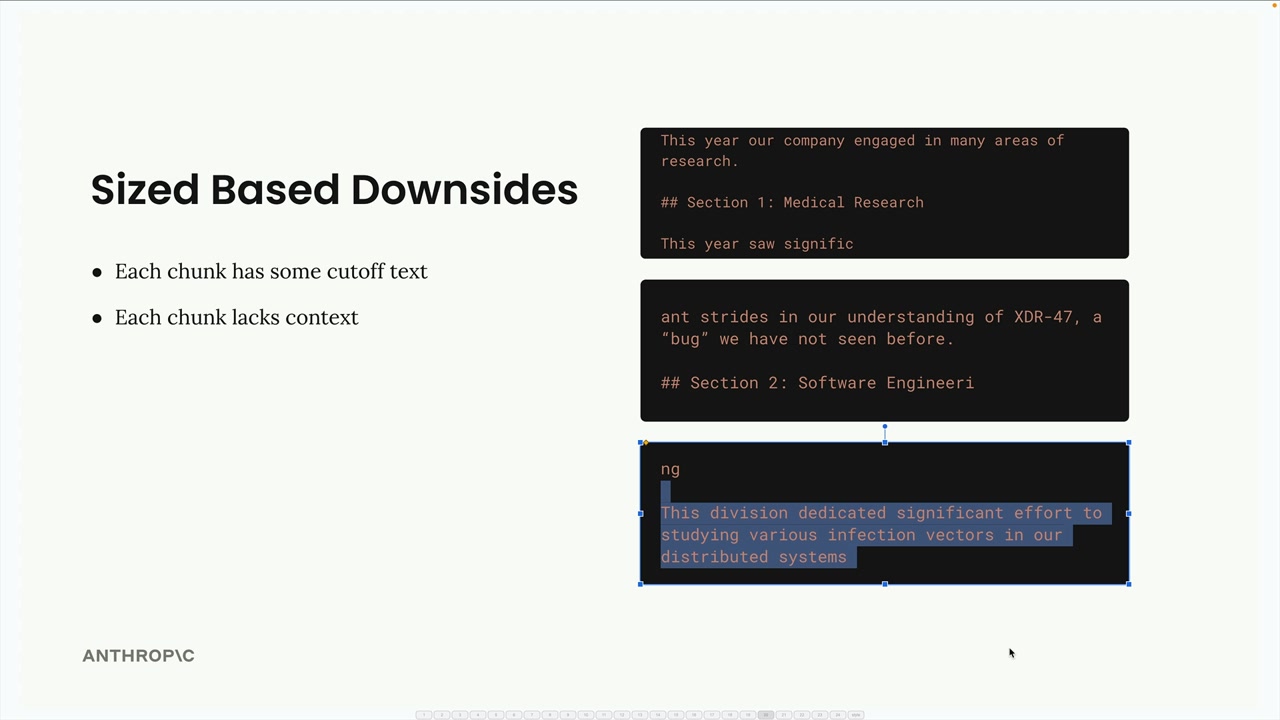

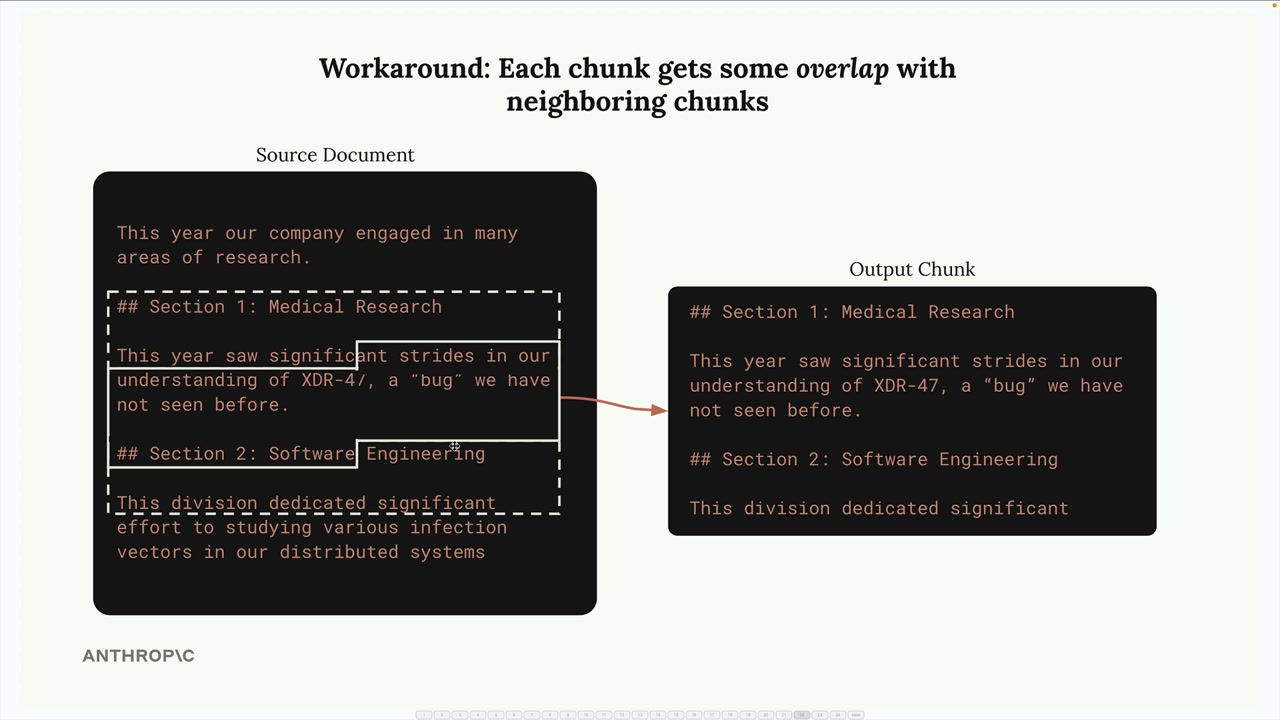

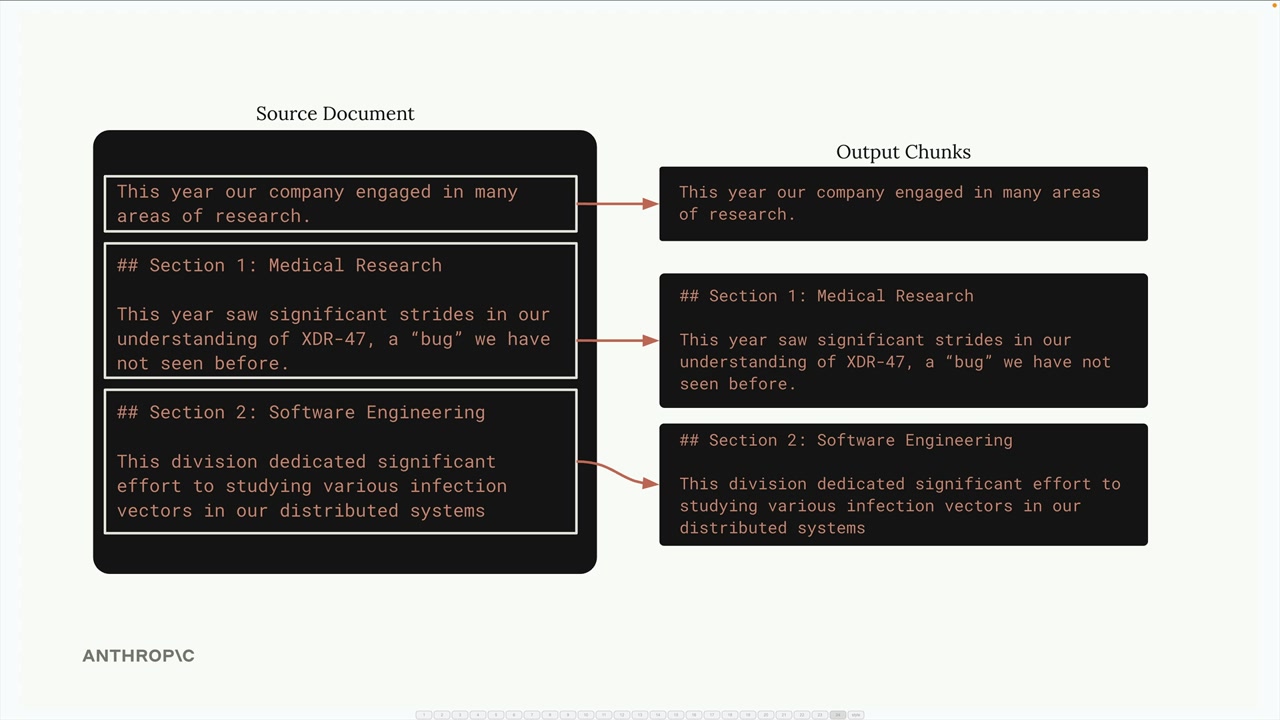

Text Chunking Strategies (文本分块策略) = 为 RAG 流水线将文档分割成更小部分的过程。

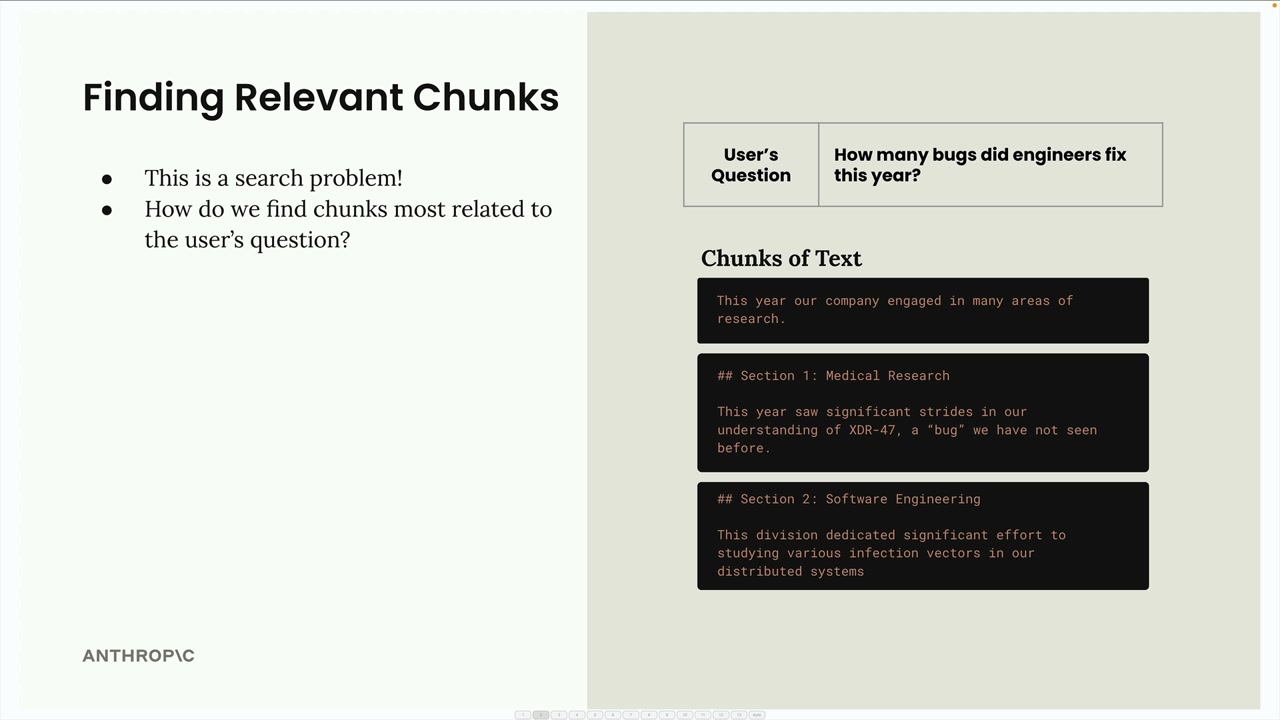

核心问题:分块质量直接影响 RAG 性能。糟糕的分块会导致检索到不相关的上下文(例如,为一个关于软件工程 bug 的查询检索到医学上的“bug”文本)。

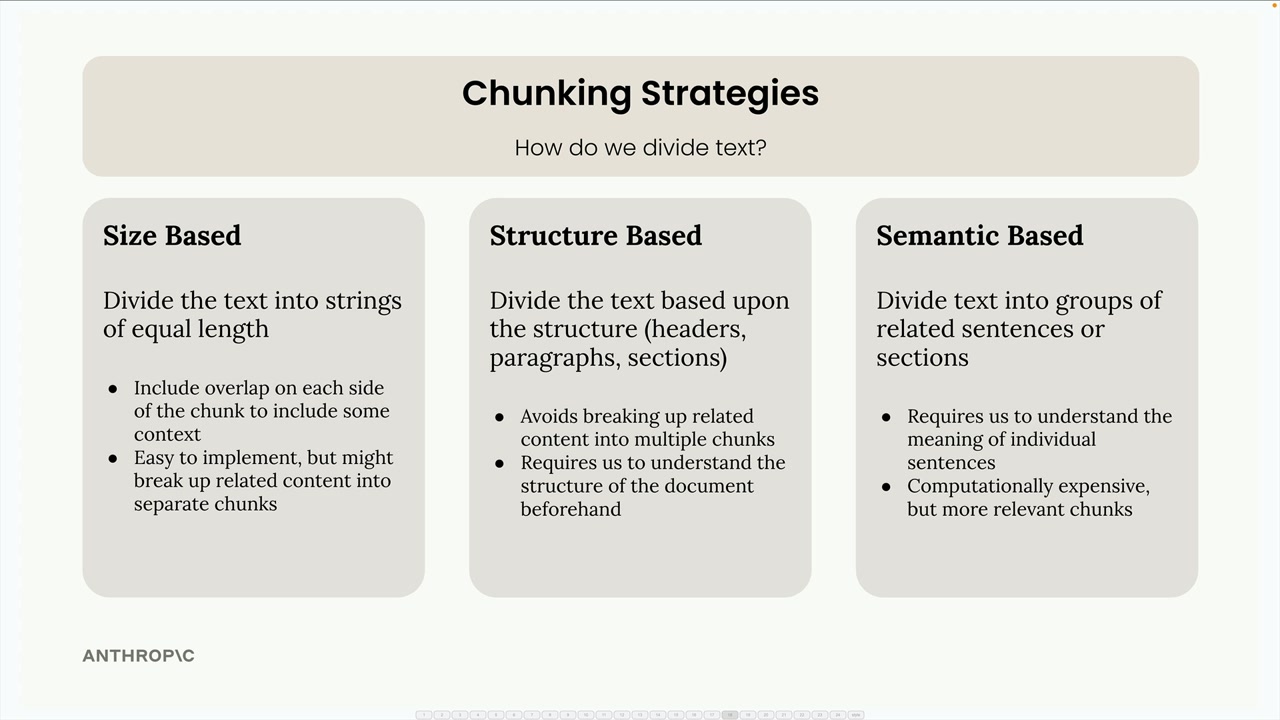

三种主要策略:

- 基于大小的分块 = 将文本分割成等长的字符串。

- 优点:易于实现,在生产环境中最常见。

- 缺点:可能切断单词,缺乏上下文。

- 解决方案:重叠策略 = 包含相邻块的字符以保留上下文。

- 权衡:会产生文本重复,但能改善块的意义。

- 基于结构的分块 = 根据文档结构(标题、段落、章节)进行分割。

- 最适合结构化文档(markdown, HTML)。

- 局限性:需要文档格式有保证。

- 示例:按 markdown 标题(##)分割以创建基于章节的块。

- 基于语义的分块 = 使用自然语言处理(NLP)对相关句子/章节进行分组。

- 最先进的技术。

- 根据语义相似性对连续的句子进行分组。

- 实现复杂。

关键实现说明:

- 按字符分块 = 最可靠的后备方案,适用于任何文档类型。

- 按句子分块 = 如果句子检测可靠,这是一个很好的折中方案。

- 按章节分块 = 结果最佳,但需要结构化输入。

- 策略选择取决于文档类型是否有保证以及用例需求。

规则:没有通用的最佳分块方法——取决于文档结构的保证和具体用例。

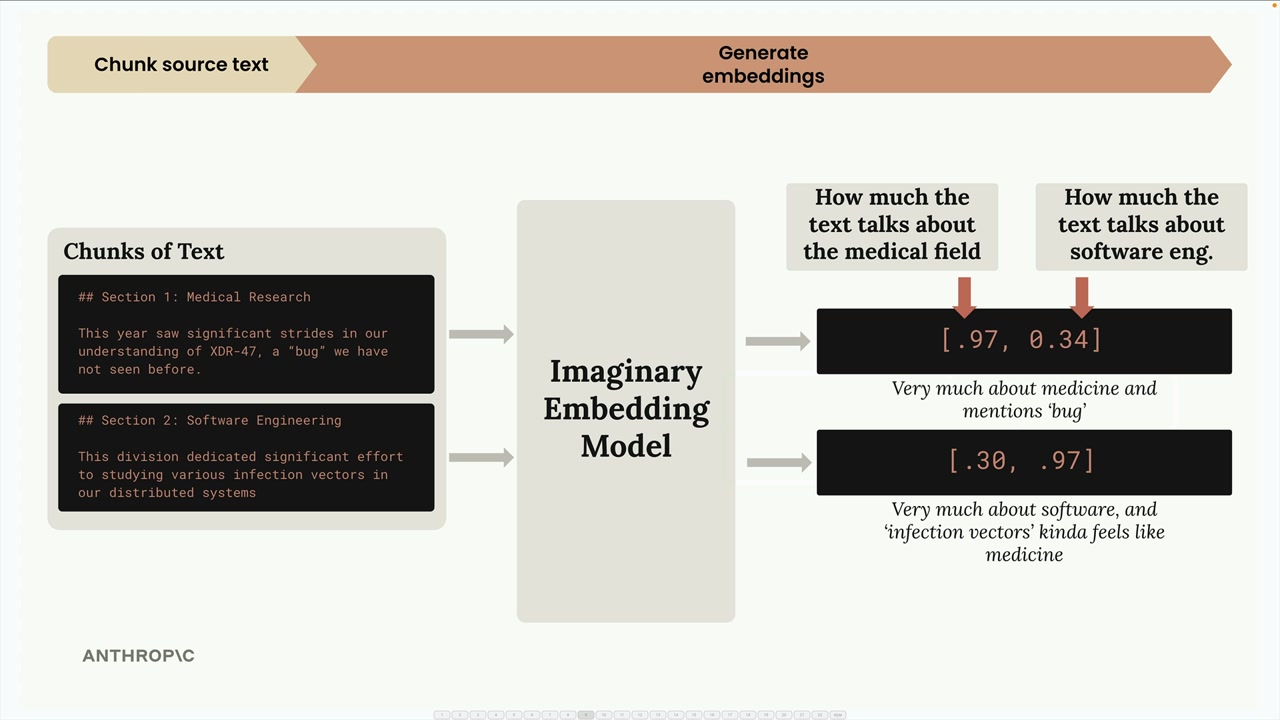

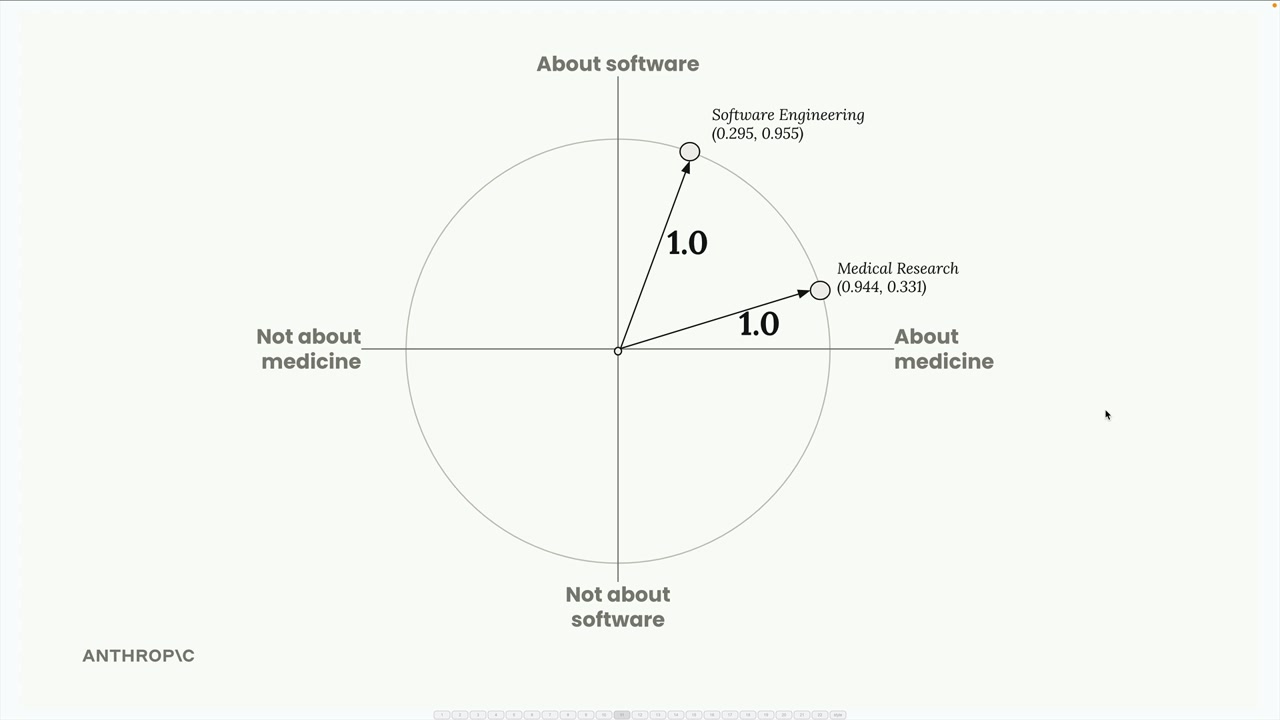

文本嵌入

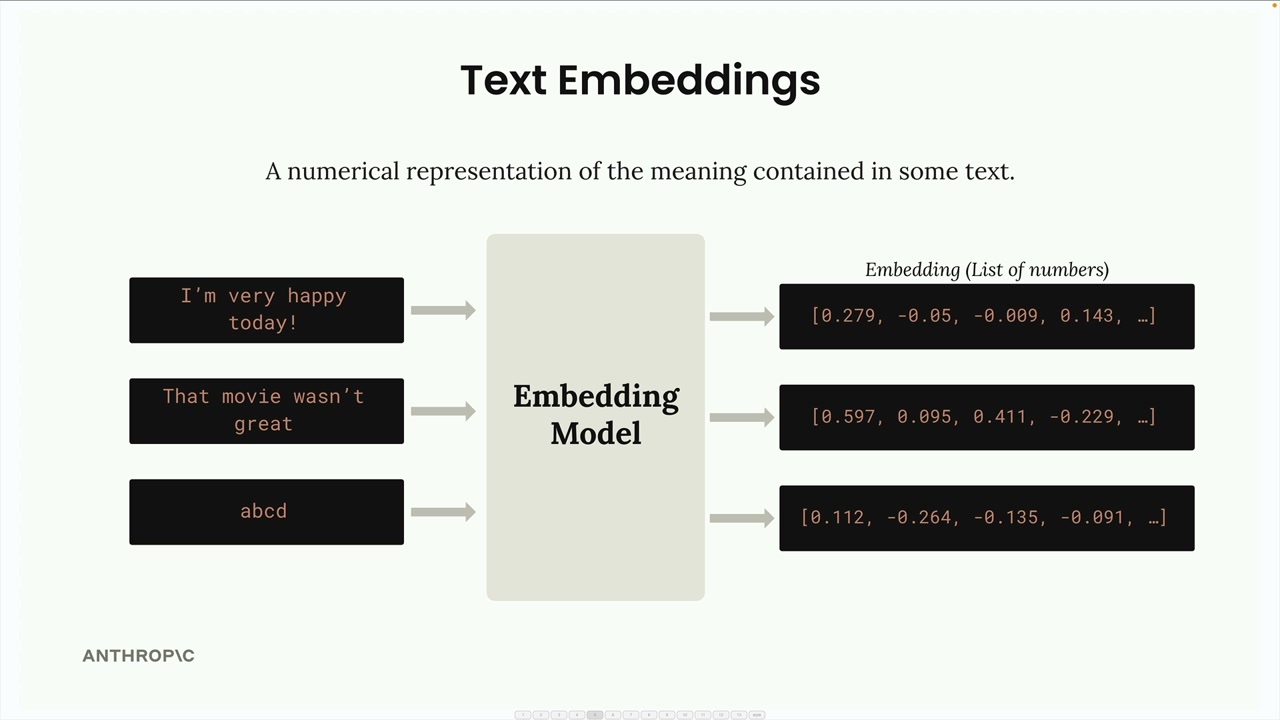

Text Embeddings (文本嵌入) = 由 Embedding Model (嵌入模型) 生成的文本含义的数值表示。

嵌入模型 = 接收文本输入,输出一长串数字(范围从 -1 到 +1)。

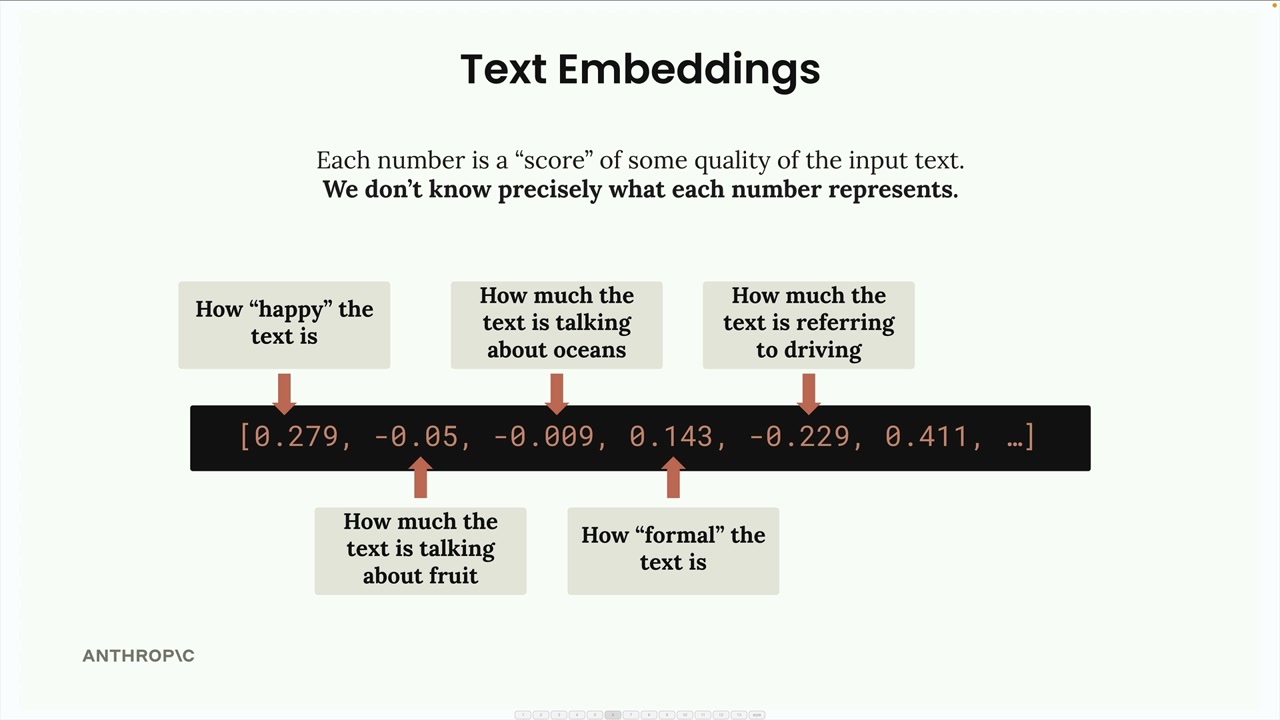

嵌入数字 = 代表输入文本未知品质/特征的分数。理论上每个数字都对不同方面(快乐程度、主题相关性等)进行评分,但用户并不知道其实际含义。

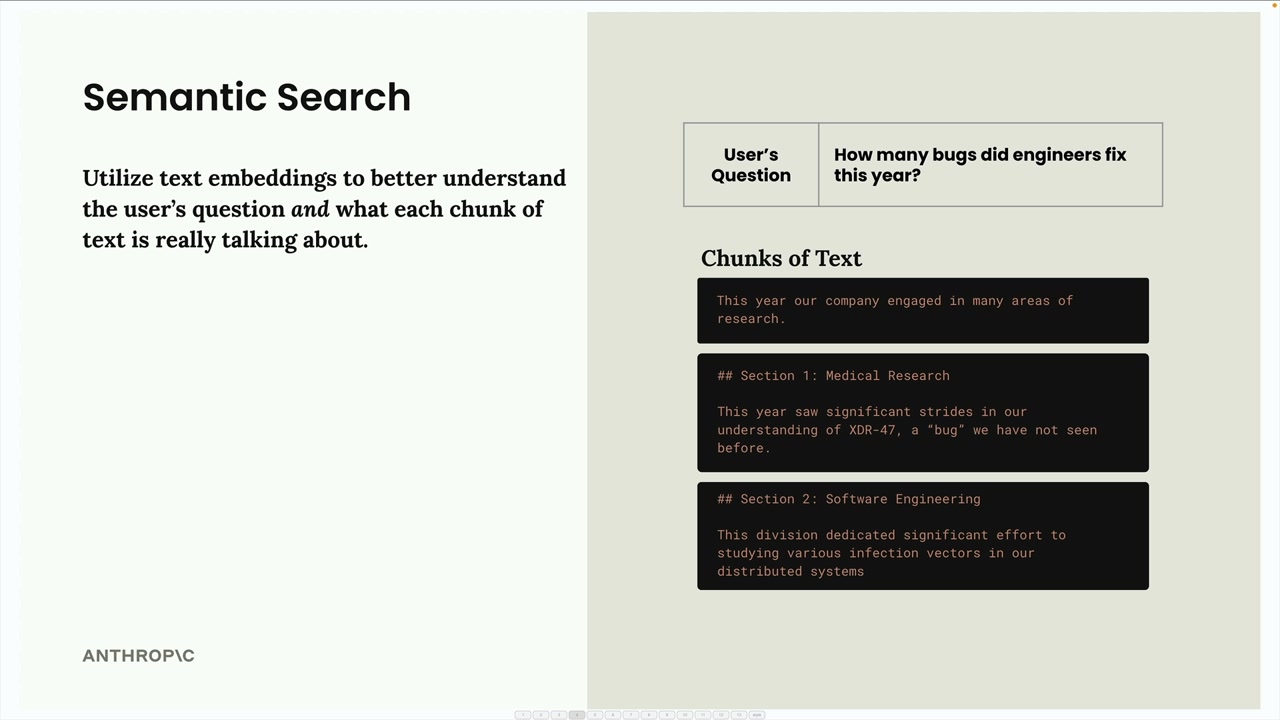

Semantic Search (语义搜索) = 使用文本嵌入在 RAG 流水线中查找与用户问题相关的文本块。它解决了将用户查询与相关文档块匹配的搜索问题。

RAG 流水线过程 = 提取文本块 → 用户提交查询 → 使用语义搜索找到相关块 → 将相关块作为上下文添加到提示词中。

实现 = Anthropic 推荐使用 Voyage AI 进行嵌入生成。需要单独的账户/API 密钥。上手免费,通过 SDK 易于集成。

核心洞见 = 嵌入实现了语义相似性匹配而非关键字匹配,从而能更好地理解文本关系以用于检索任务。

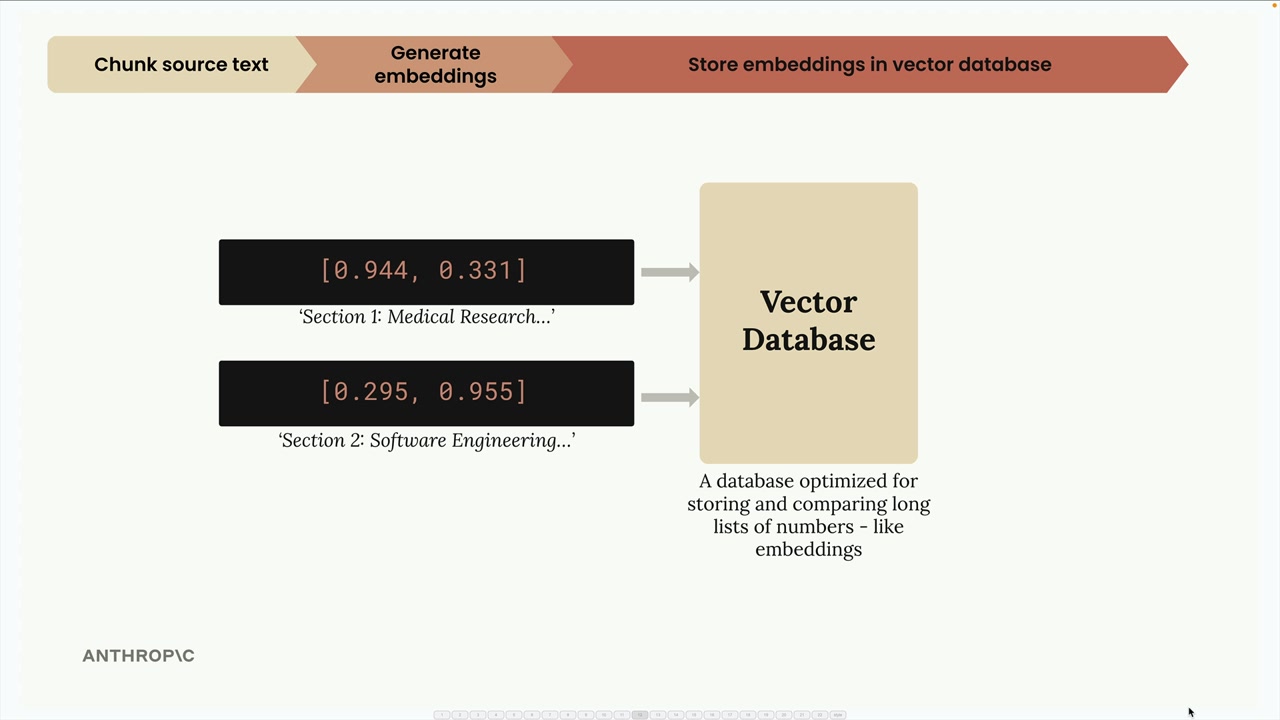

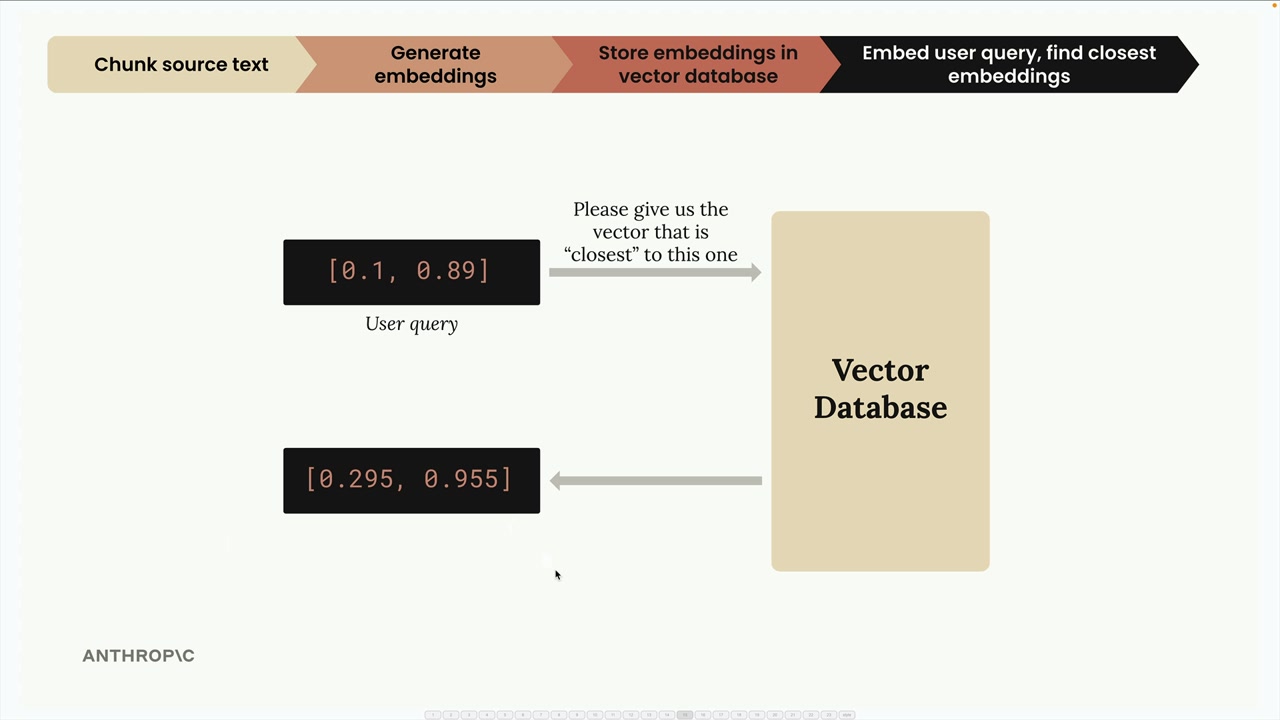

完整的 RAG 流程

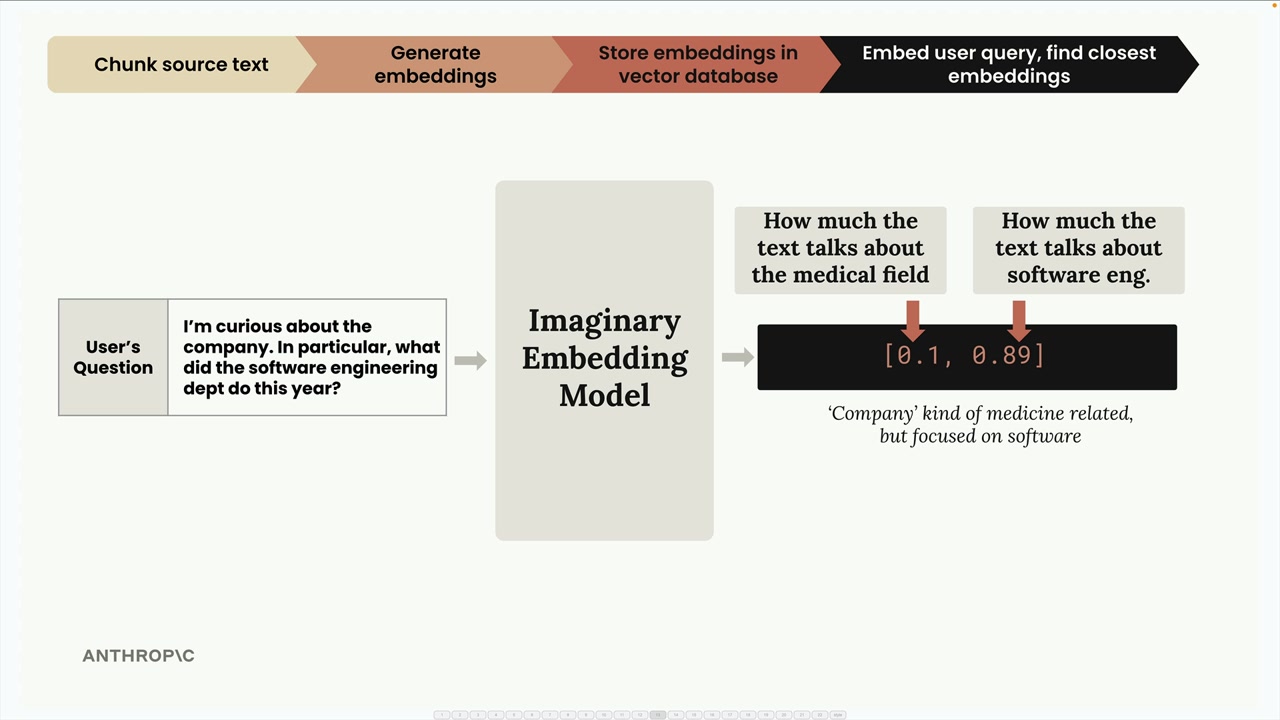

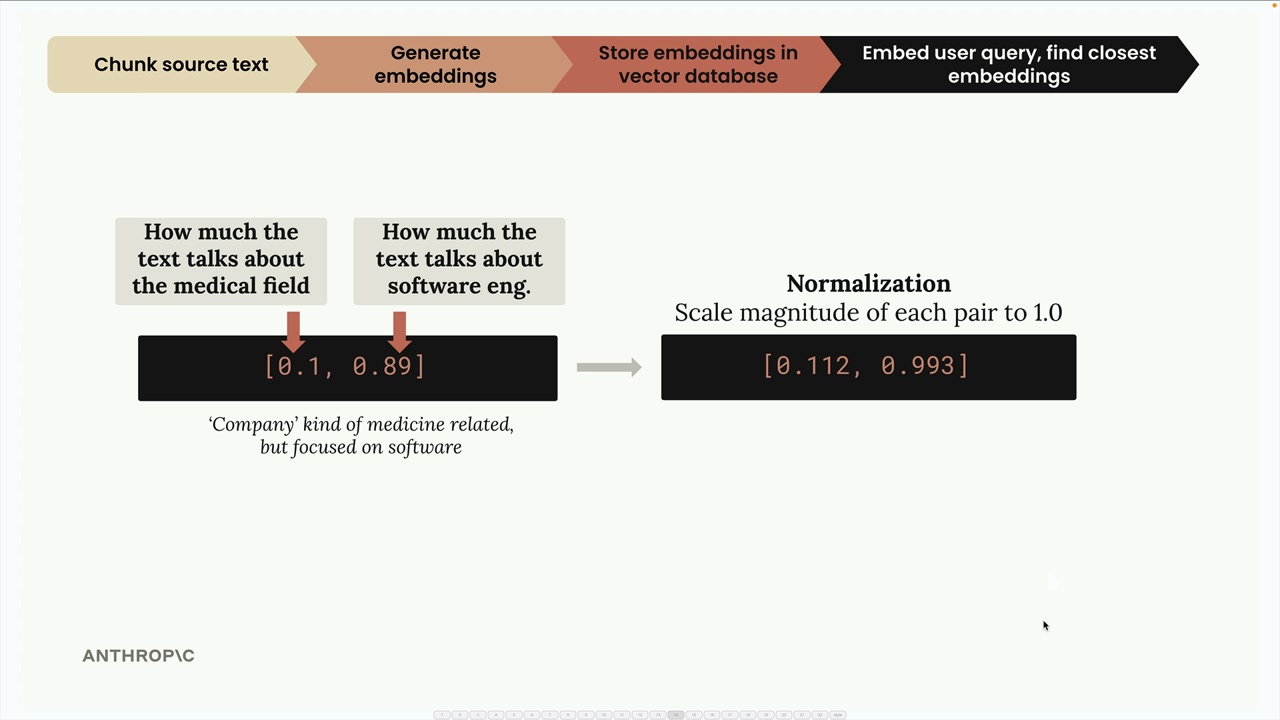

RAG Flow (RAG 流程) = 一个 7 步过程,结合了文本分块、嵌入和向量搜索,为大语言模型查询检索相关上下文。

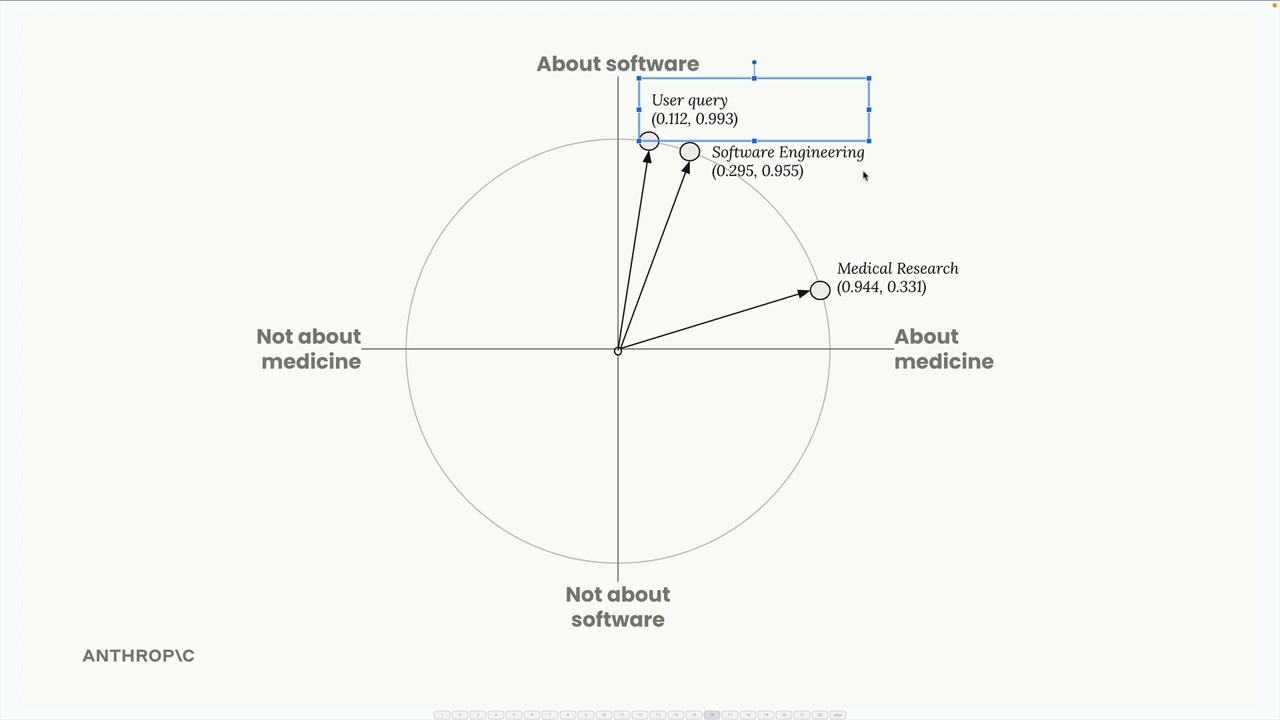

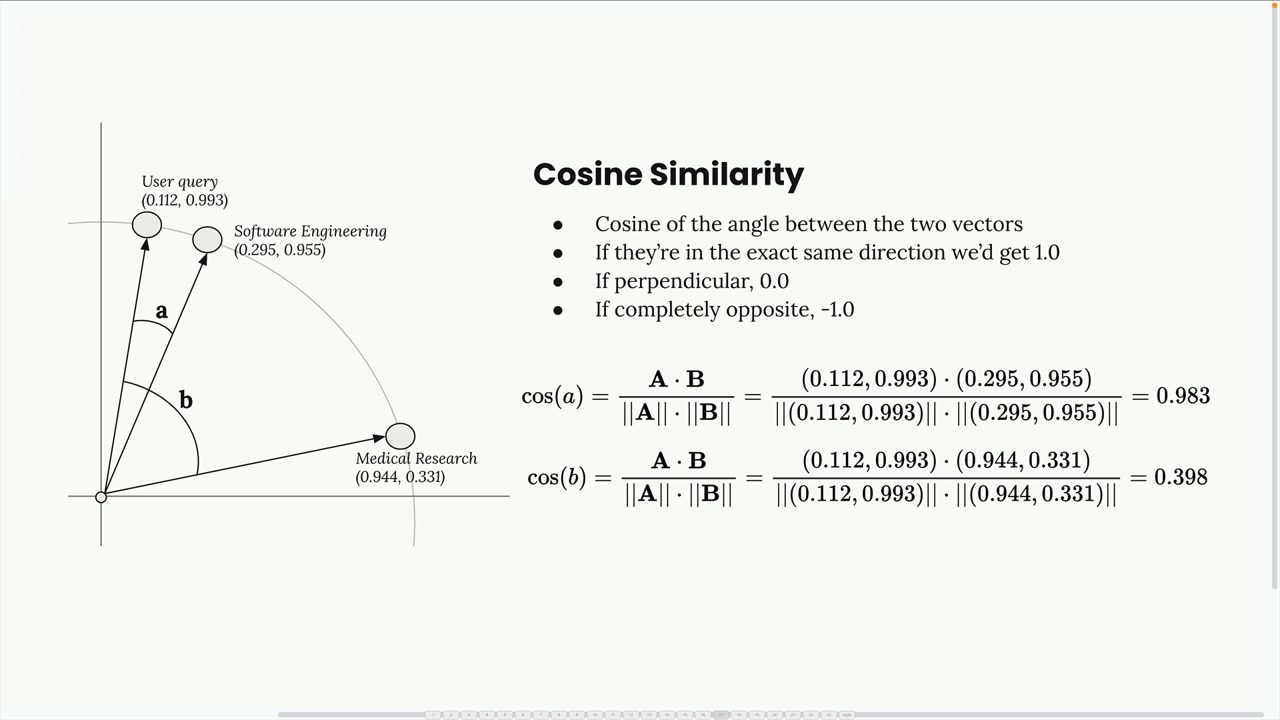

第 1 步:文本分块 = 将源文档分割成独立的文本片段。 第 2 步:生成嵌入 = 使用嵌入模型将文本块转换为数值向量。 第 3 步:归一化 = 将向量的模长缩放到 1.0(由嵌入 API 自动处理)。 第 4 步:Vector Database (向量数据库) 存储 = 将嵌入存储在专门为数值向量操作优化的数据库中。 第 5 步:查询处理 = 使用相同的模型将用户问题转换为嵌入。 第 6 步:相似性搜索 = 使用 Cosine Similarity (余弦相似度) 计算找到最相似的存储嵌入。 第 7 步:提示词组装 = 将用户问题与检索到的相关文本块结合,发送给大语言模型。

关键数学概念:

- 余弦相似度 = 向量之间夹角的余弦值,返回值在 -1 到 1 之间,越接近 1 表示越相似。

Cosine Distance(余弦距离) = 1 减去余弦相似度,值越接近 0 表示相似度越高。- 向量数据库 = 执行相似性计算以找到最匹配的嵌入。

流程:预处理(步骤 1-4) → 用户查询 → 实时检索(步骤 5-7) → 大语言模型响应。

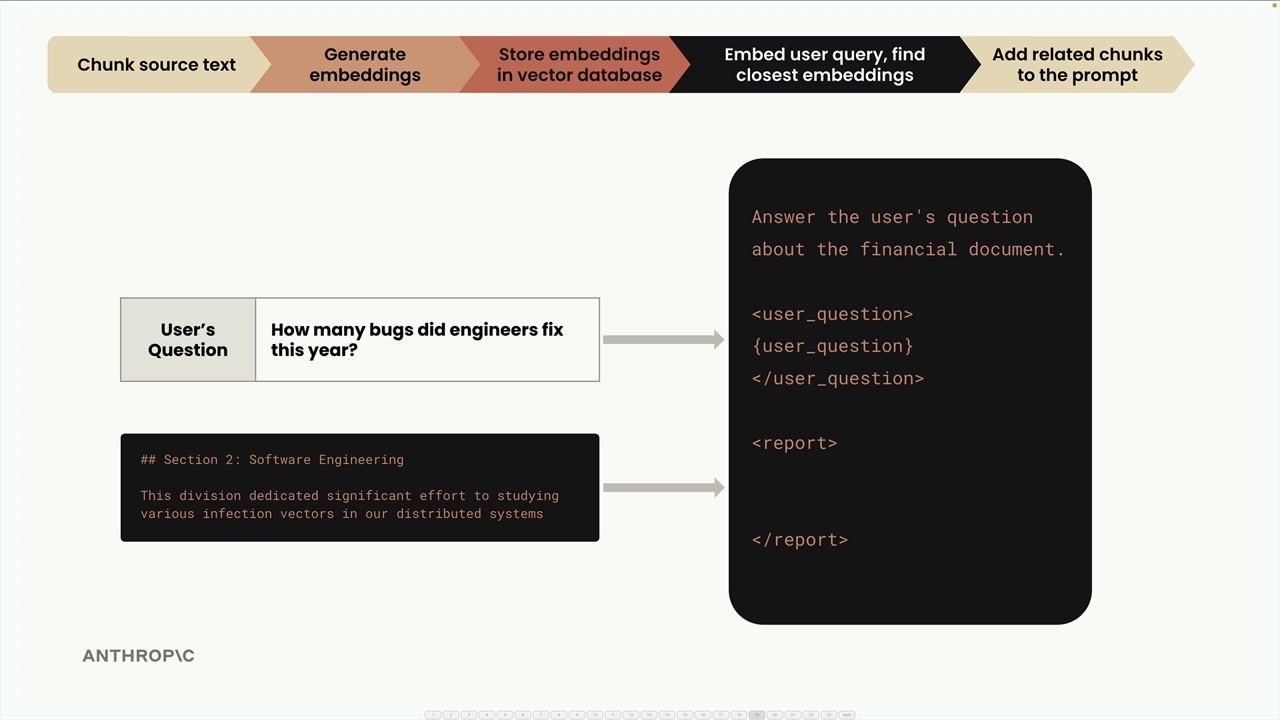

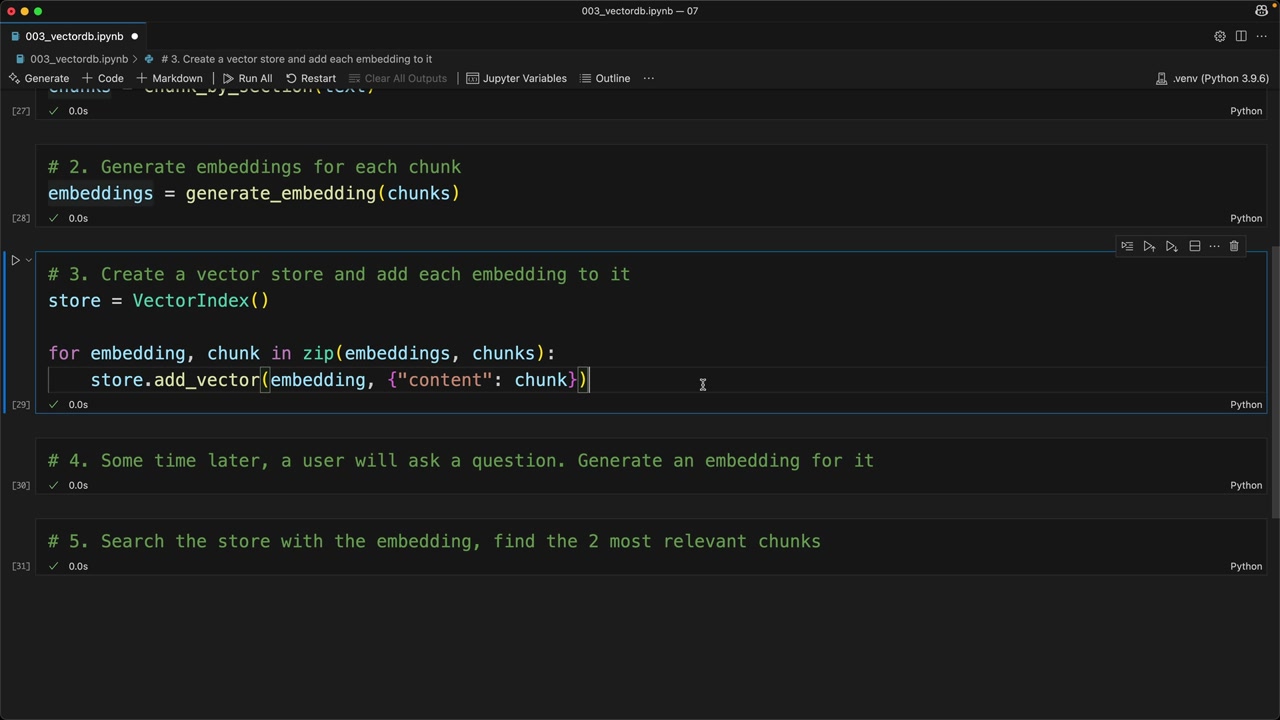

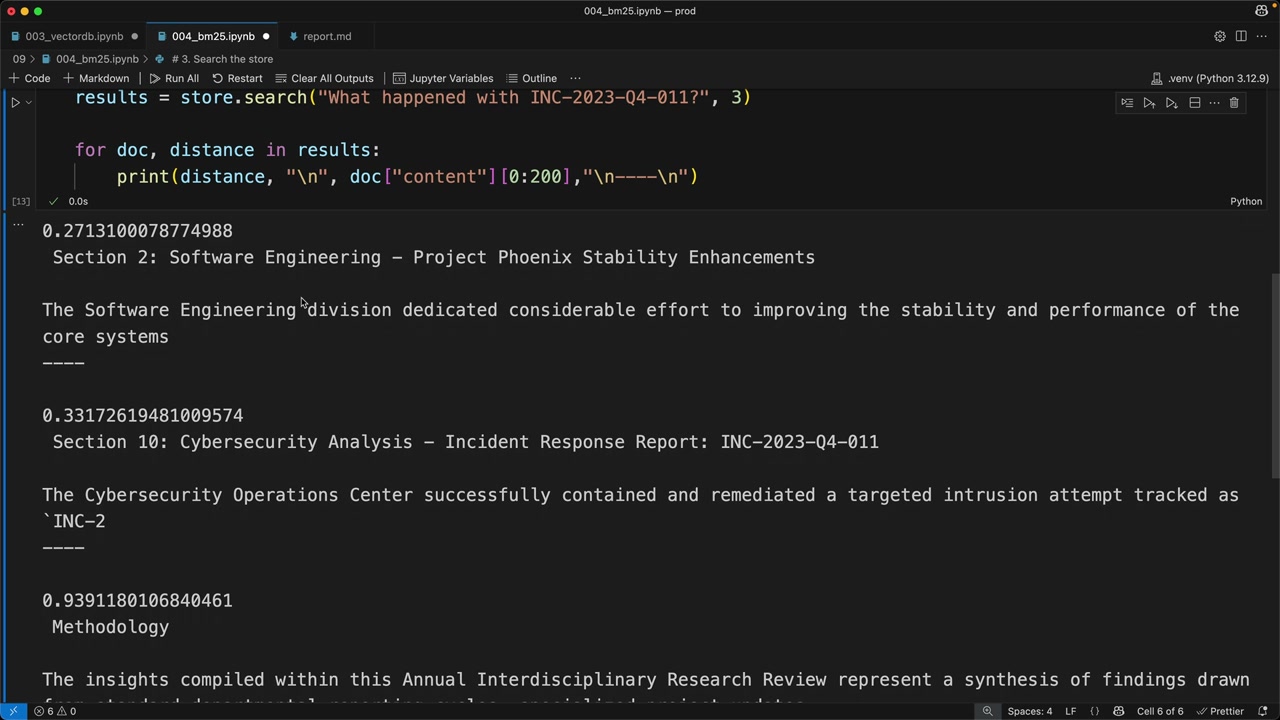

实现 RAG 流程

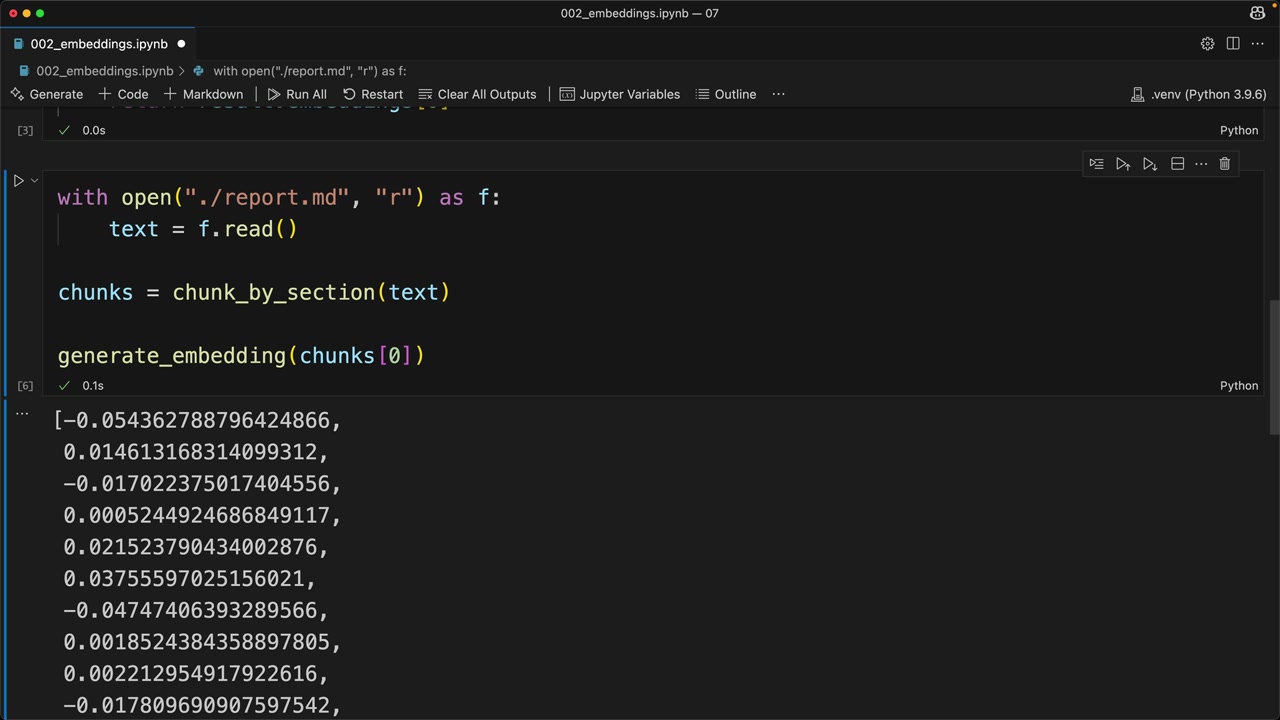

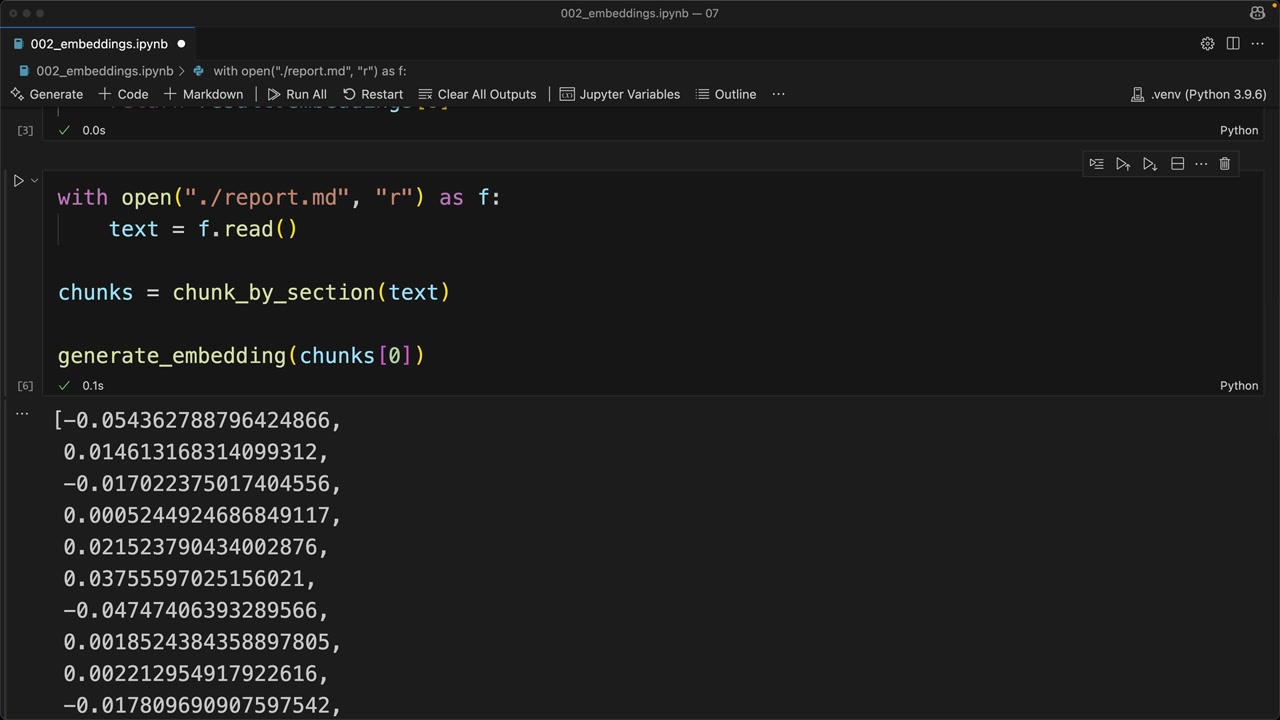

RAG 流程实现 = 检索增强生成过程的 5 步实践演练。

第 1 步:文本分块 = 使用 chunk_by_section 函数在 report.MD 文件上按章节分割文档。

第 2 步:嵌入生成 = 使用 generate_embedding 函数为每个块创建向量表示(支持单个字符串或字符串列表输入)。

第 3 步:向量存储填充 = 创建一个向量索引实例,使用 zip() 遍历块-嵌入对,并使用 store.add_vector(embedding, {content: chunk}) 存储每一对。将原始文本与嵌入一起存储,以便检索到有意义的结果。

第 4 步:查询处理 = 用户提问“软件工程部门去年做了什么”,为用户查询生成嵌入。

第 5 步:相似性搜索 = 使用 store.search(user_embedding, 2) 找到 2 个最相关的块,返回结果及余弦距离(第二部分为 0.71,方法论部分为 0.72)。

关键组件:

- 向量索引类 = 自定义的向量数据库实现。

- 余弦距离 = 查询与存储嵌入之间的相似性度量。

- 元数据存储 = 将原始文本内容与嵌入一同存储,可实现有意义的检索。

工作流程已完成,但存在局限,需要进一步改进。

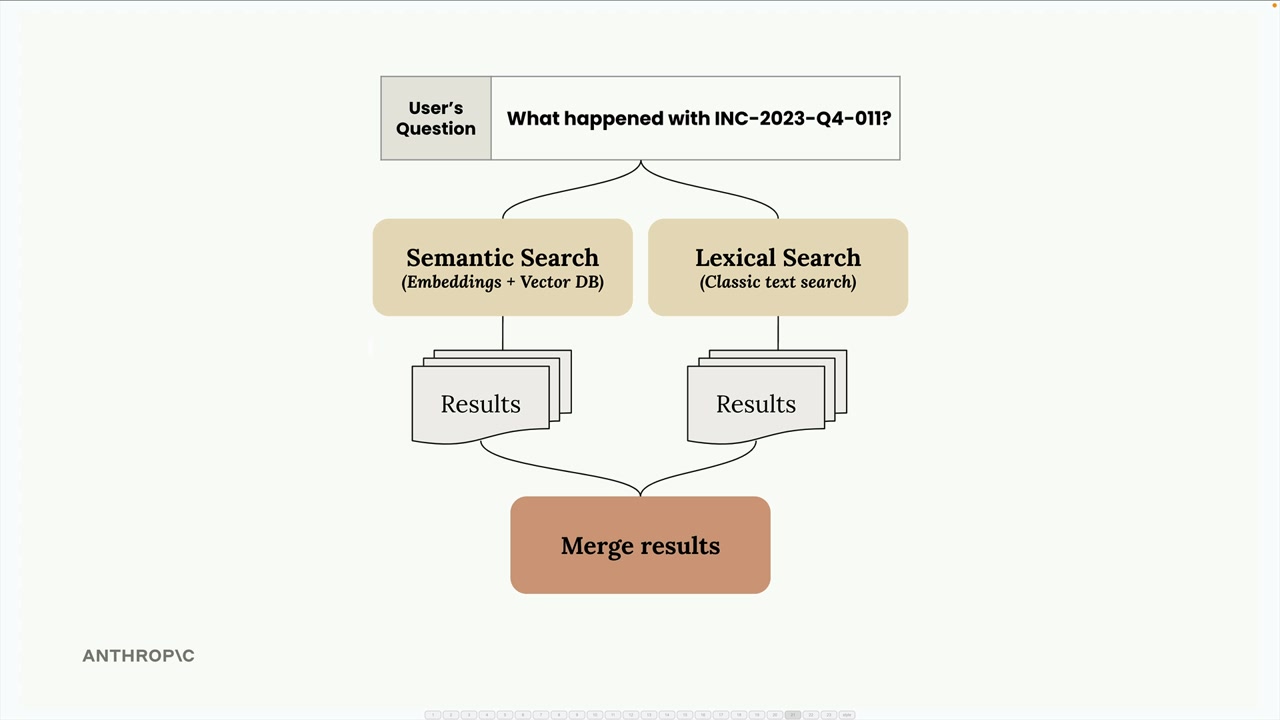

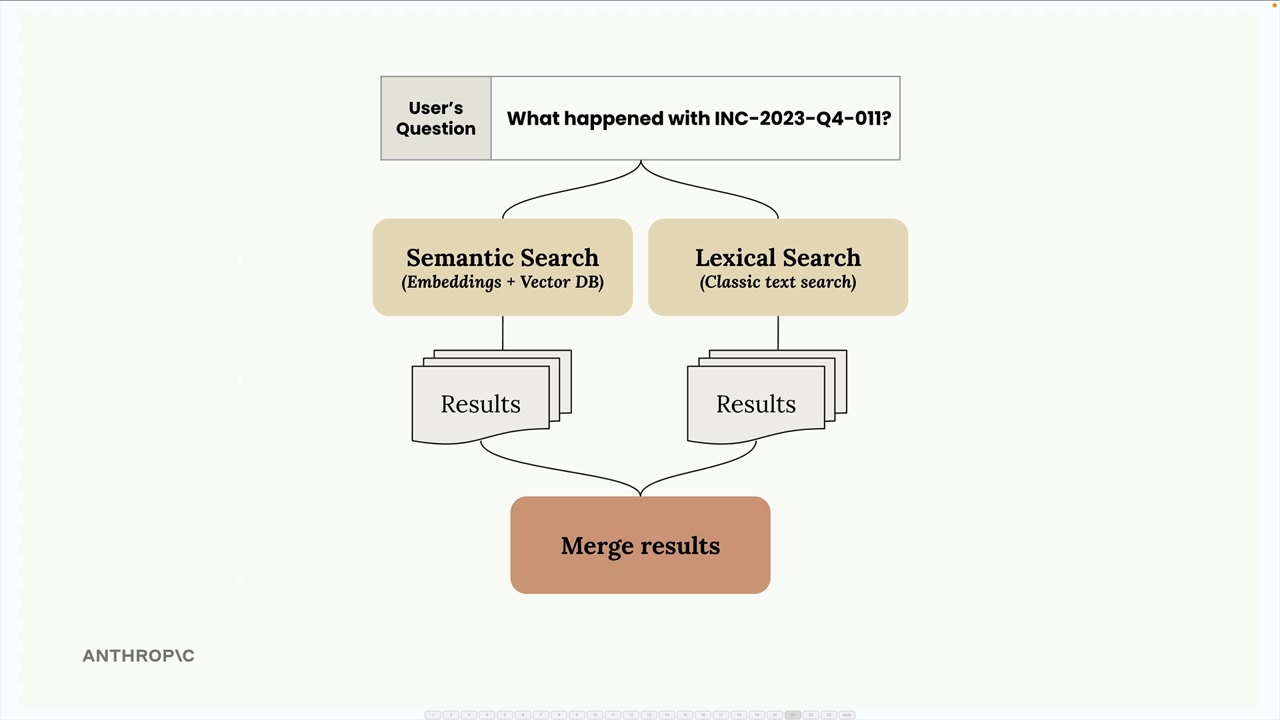

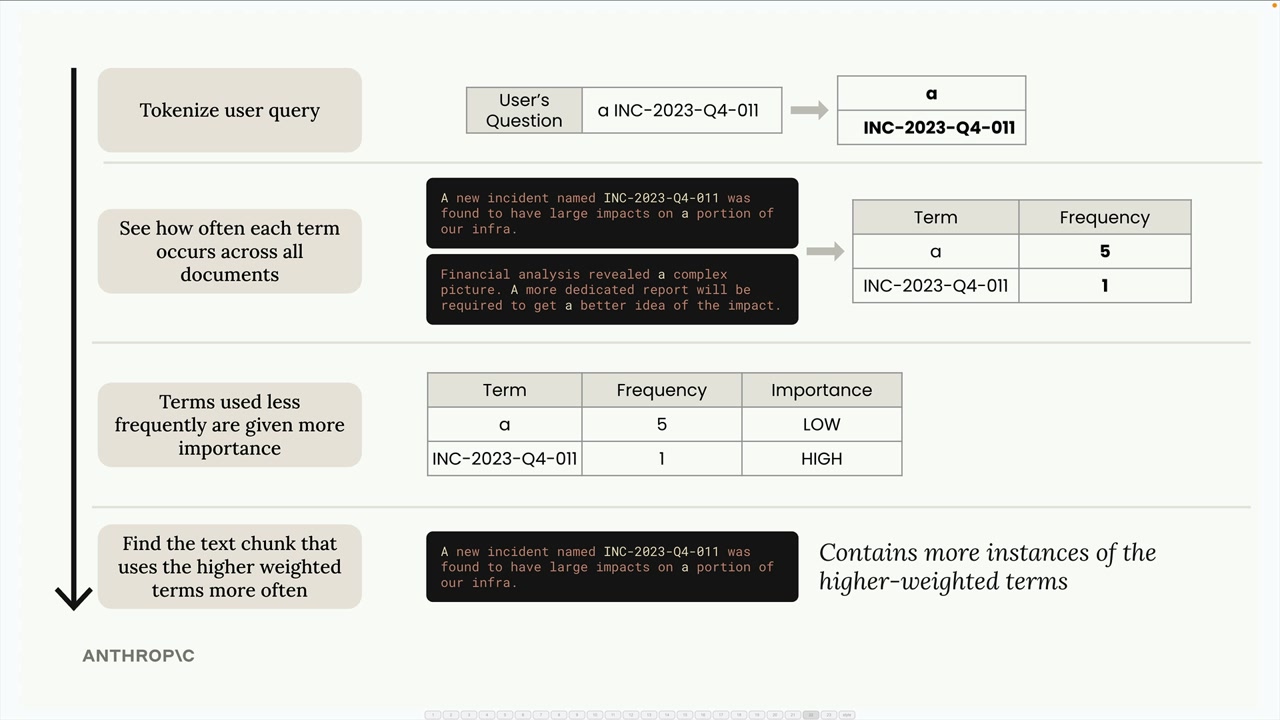

BM25 词法搜索

BM25 = Best Match 25,一种 lexical search (词法搜索) 算法,常用于 RAG 流水线中以补充语义搜索。

仅使用语义搜索的问题 = 可能会漏掉精确的术语匹配,即使特定术语在某些文档中频繁出现,也可能返回不相关的结果。

Hybrid search (混合搜索) 方法 = 并行地将语义搜索(嵌入/向量数据库)与词法搜索(BM25)相结合,然后合并结果以获得更好的平衡。

BM25 算法步骤:

- 将用户查询分词为独立的术语(去除标点,按空格分割)。

- 统计每个术语在所有文本块/文档中的出现频率。

- 根据使用频率为术语分配相对重要性(稀有术语 = 重要性更高,常见词如 "a" = 重要性更低)。

- 根据文本块包含高权重术语的频率对其进行排序。

核心洞见 = 在整个语料库中频繁使用的术语,对于搜索相关性的重要性低于稀有、特定的术语。

BM25 的优势 = 更擅长查找精确的术语匹配,优先考虑包含稀有/特定搜索词的文档,补充了语义搜索的弱点。

实现 = 语义搜索和词法搜索系统都使用相似的 API(add_document, search 函数),使其易于结合。

下一步 = 合并两种搜索系统的结果,以同时获得语义理解和精确术语匹配的好处。

多索引 RAG 流水线

Multi-Index RAG Pipeline (多索引 RAG 流水线) = 一个结合了语义搜索(向量索引)和词法搜索(BM25 索引)的系统,以提高检索准确性。

关键组件:

- 向量索引 = 使用嵌入进行语义相似性搜索。

- BM25 索引 = 基于词法/关键字的搜索。

- 检索器类 = 一个包装器,它将查询转发给两个索引并合并结果。

Reciprocal Rank Fusion (倒数排序融合) = 一种用于合并来自不同索引的搜索结果的技术。公式:RRF_score = 对于每个文档,在所有搜索方法中求和 (1/(rank + 1))。文档按最高的组合分数排序。

示例:向量搜索返回 [doc2, doc7, doc6],BM25 返回 [doc6, doc2, doc7]。经过 RRF 计算后,最终排名变为 [doc2, doc6, doc7],因为 doc2 在两种方法中都排名靠前。

优点:

- 通过结合不同的搜索范式提高了搜索准确性。

- 采用模块化设计和标准化的 API(

search()和add_document()方法)。 - 易于扩展,可添加额外的搜索索引。

- 更好地处理单一方法失败的边缘情况。

实现模式允许多种搜索方法协同工作,同时保持索引类的独立和隔离。

结果重排序

Reranking (重排序) = 一个后处理步骤,在初次检索后使用大语言模型根据相关性对搜索结果进行重新排序。

过程:运行向量 + BM25 搜索 → 合并结果 → 将结果传递给大语言模型,并附上提示词要求按相关性对文档进行排序 → 获取重新排序后的结果。

实现细节:为提高效率,使用文档 ID 而非全文。大语言模型接收用户查询 + 候选文档 + 指示其按递减顺序列出最相关文档的指令。使用助手消息预填充 + 停止序列确保结构化的 JSON 输出。

权衡:通过利用大语言模型对语义相关性的理解,提高了搜索准确性。但由于额外的 LLM 调用,增加了延迟。当初始检索方法未能捕捉到微妙的查询意图时(例如,“ENG team” vs “engineering team”),此方法尤其有效。

改进示例:查询“工程团队在 2023 年事故中做了什么?”在重排序后,正确地将软件工程部分置于网络安全部分之上,尽管混合搜索最初给它的排名较低。

上下文检索

Contextual Retrieval (上下文检索) = 一种在嵌入文档块之前为其添加上下文,以提高 RAG 流水线准确性的技术。

问题:当文档被分割成块时,单个块会失去原始文档的上下文,从而降低检索准确性。

解决方案:一个预处理步骤,在将每个块插入检索器数据库之前,为其添加上下文信息。

过程:

- 取单个块 + 原始源文档。

- 发送给大语言模型(Claude),并附上提示词要求生成定位上下文。

- 大语言模型生成简短的上下文,解释该块与整个文档的关系。

- 将生成的上下文与原始块连接 = “带上下文的块”。

- 使用带上下文的块作为向量/BM25 索引的输入。

大型文档处理:如果源文档太大,无法放入单个提示词中,则使用选择性上下文策略:

- 包含文档开头的起始块(1-3个)以获取摘要/概要。

- 包含目标块之前的块以获取局部上下文。

- 跳过提供相关性较低上下文的中间块。

实现:add_context 函数接收一个文本块 + 源文本,通过大语言模型生成上下文,将上下文与原始块连接,并返回带上下文的版本。

好处:块保留了与更宏观的文档结构和交叉引用的联系,提高了对具有相互关联章节的复杂文档的检索准确性。

扩展思考

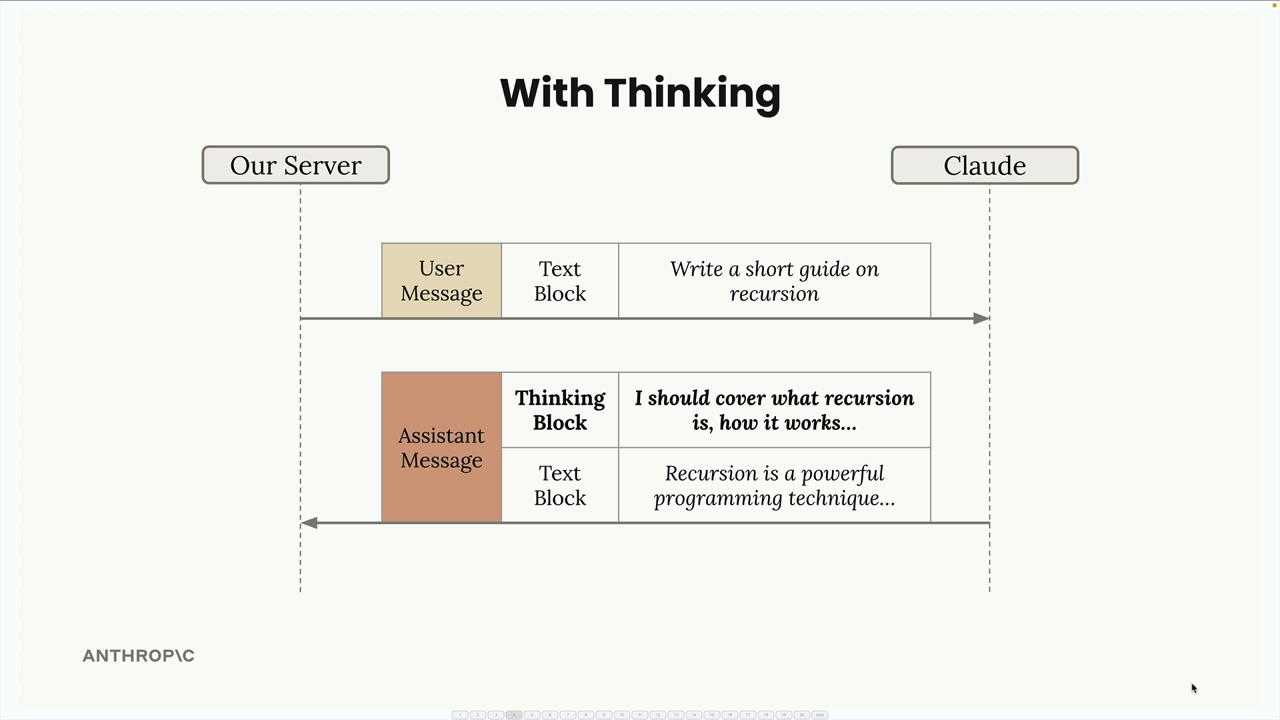

Extended Thinking (扩展思考) = Claude 的一项功能,允许在生成最终响应前进行推理。

关键机制:

- 显示一个用户可见的独立思考过程。

- 提高了复杂任务的准确性,但增加了成本(为思考的词元付费)和延迟。

thinking budget(思考预算) = 为思考阶段分配的最少 1024 个词元。max_tokens必须超过思考预算(例如,预算为 1024,则max_tokens≥ 1025)。

何时使用:

- 在提示词优化未能达到预期准确性后启用。

- 使用提示词评估来判断其必要性。

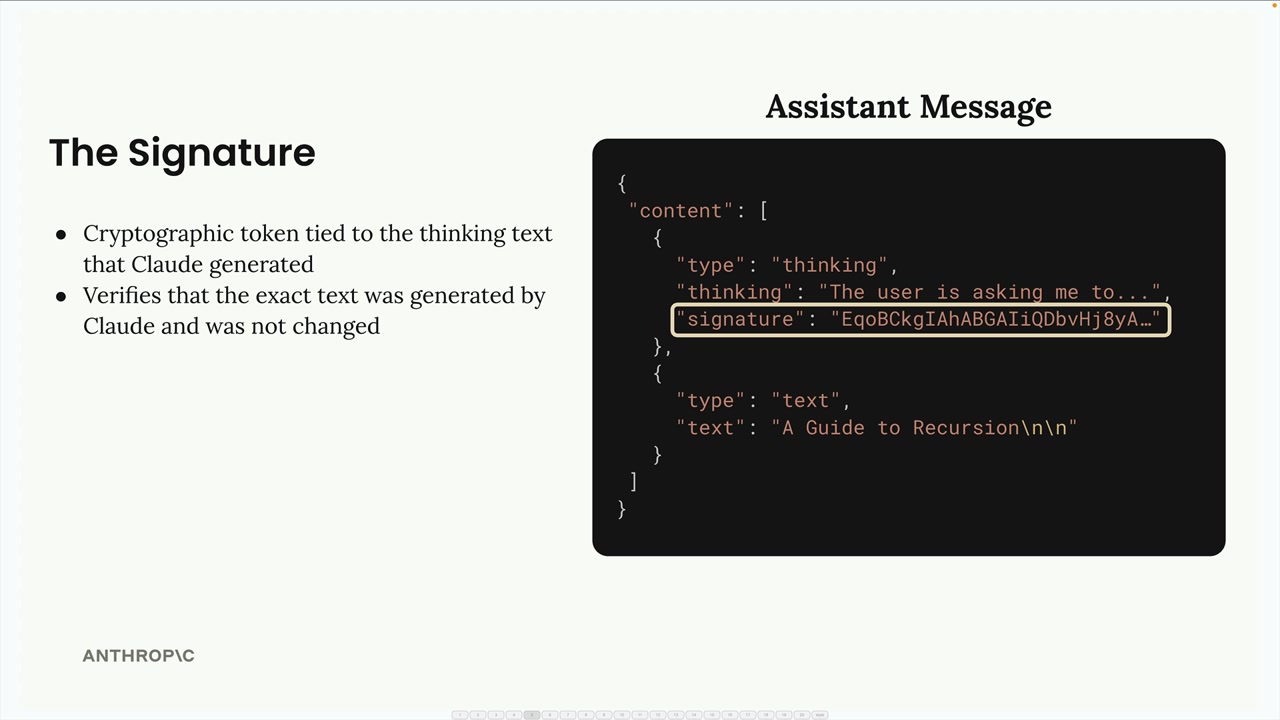

响应结构:

thinking块 = 包含推理文本 + 加密签名。text块 = 最终响应。- 签名 = 防止思考文本被篡改(安全措施)。

特殊情况:

- 经过编辑的思考块 = 被安全系统标记的加密思考文本。

- 为保持对话连续性而提供,不丢失上下文。

- 可以使用测试字符串强制生成编辑块:“entropic magic string triggered redacted thinking [special characters]”。

实现:

- 设置

thinking=true和thinking_budget参数。 - 确保

max_tokens>thinking_budget以保证足够的响应生成能力。

图像支持

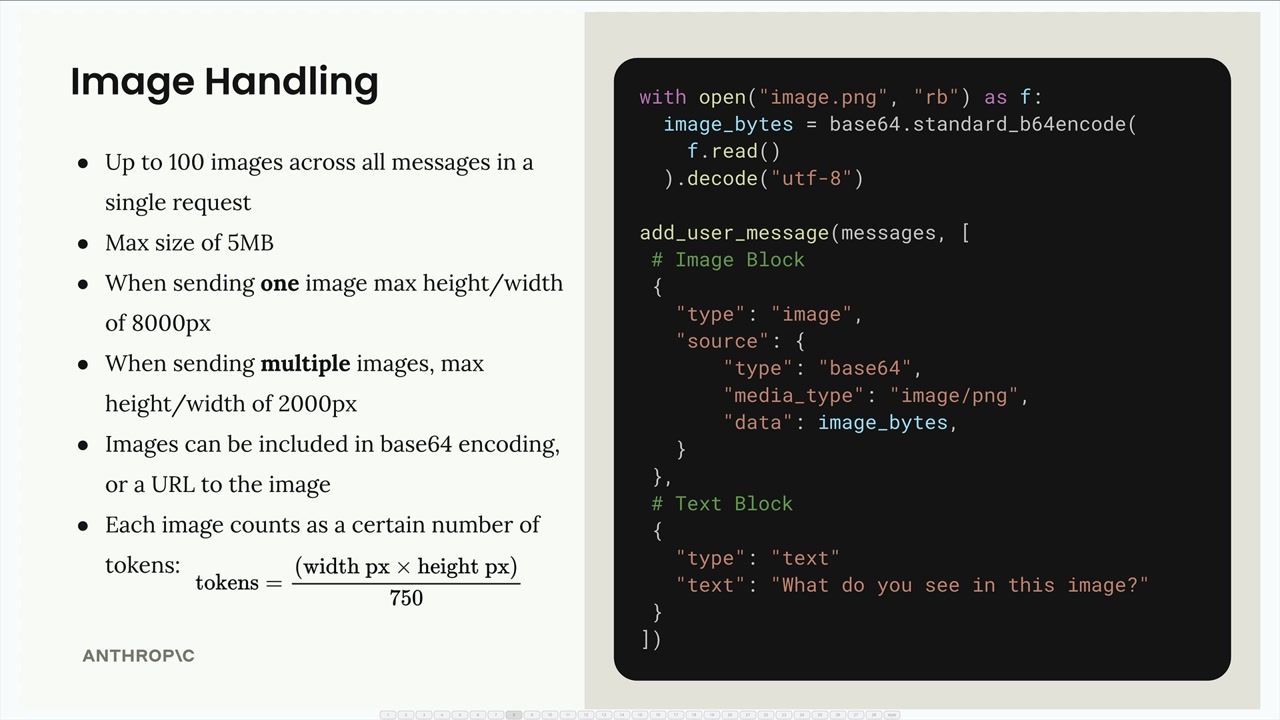

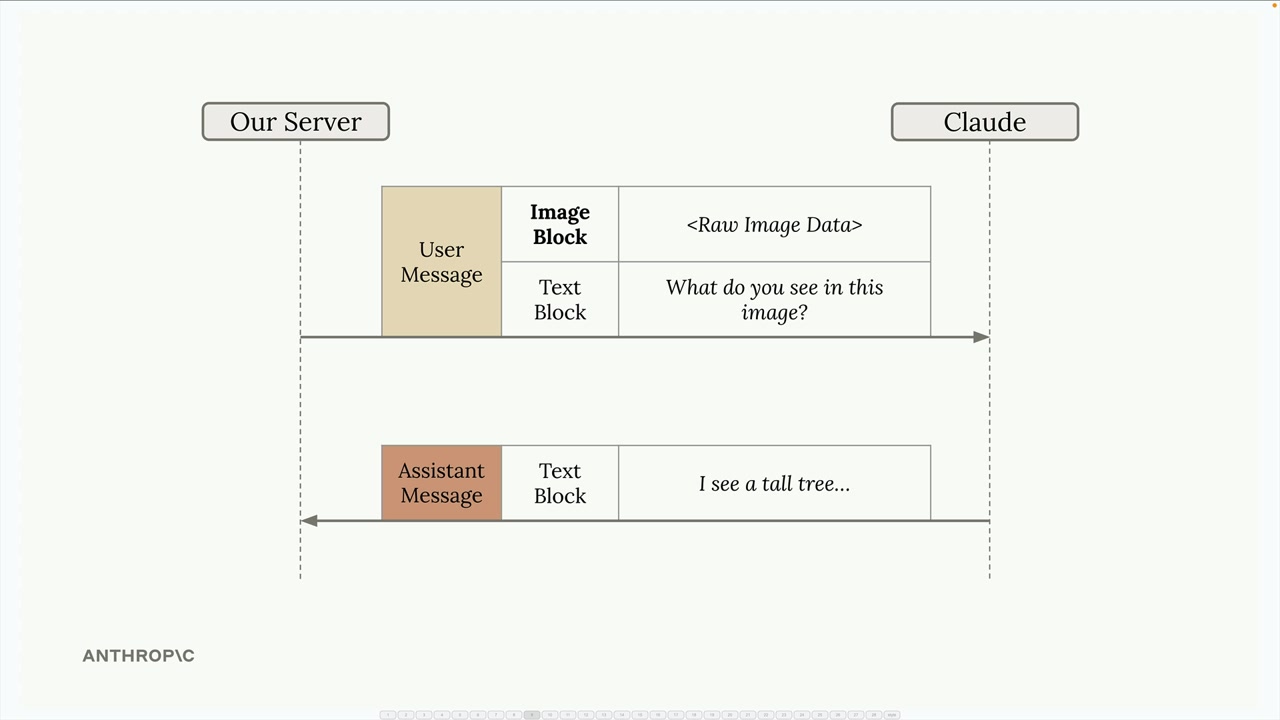

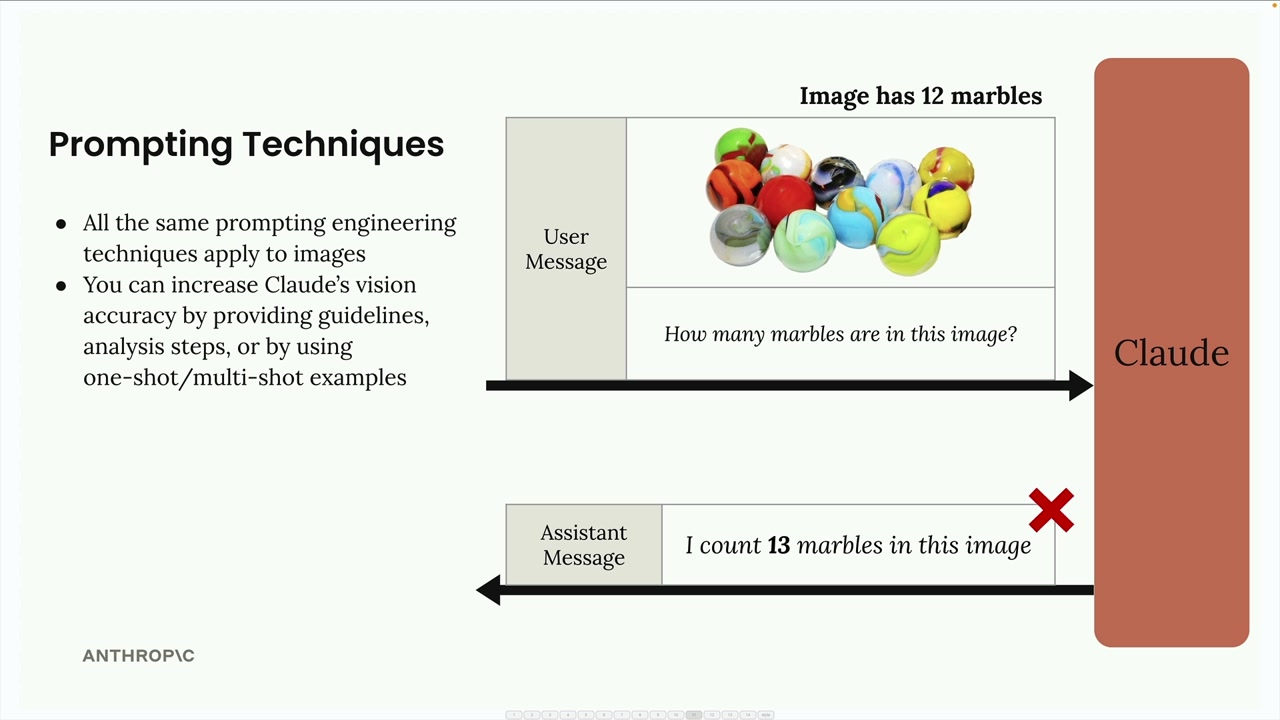

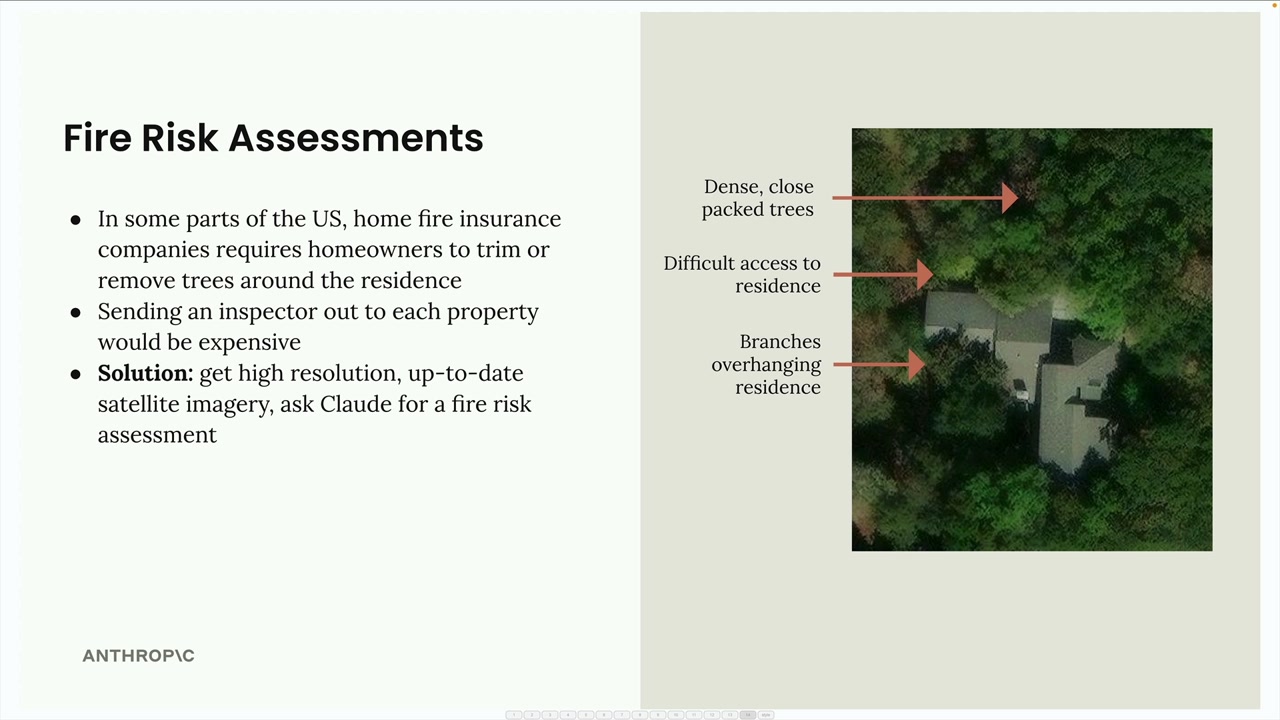

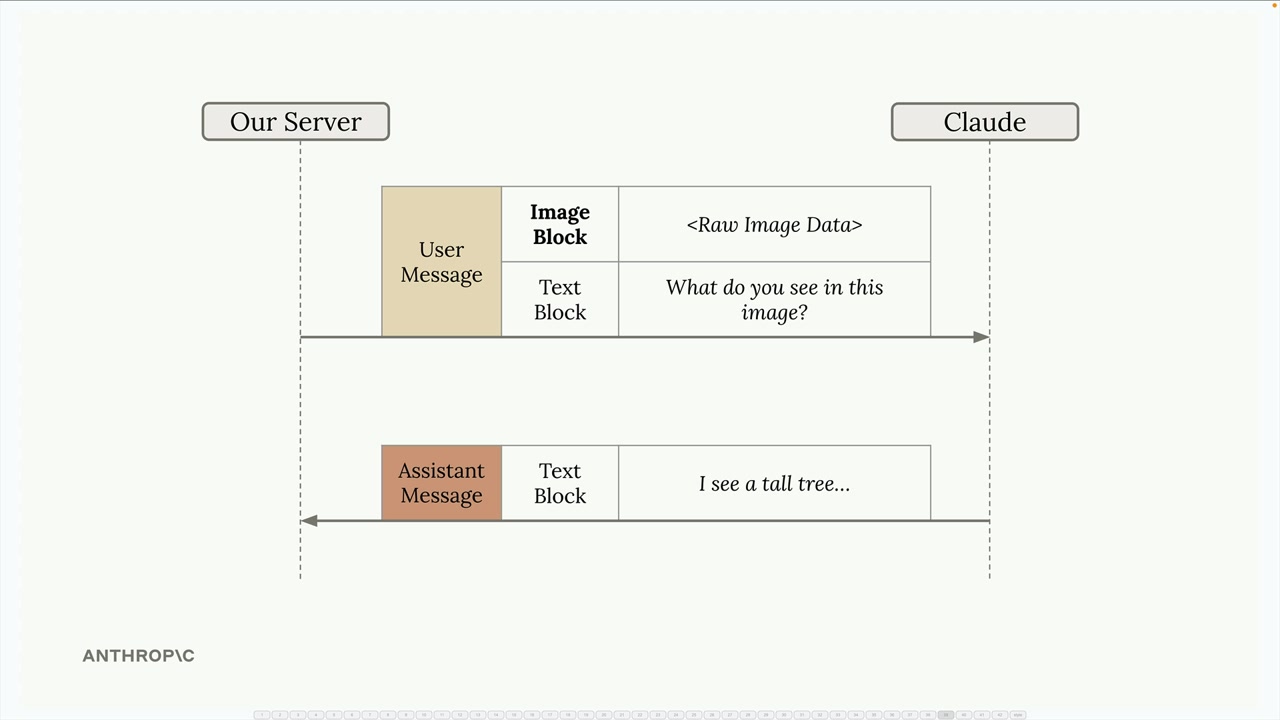

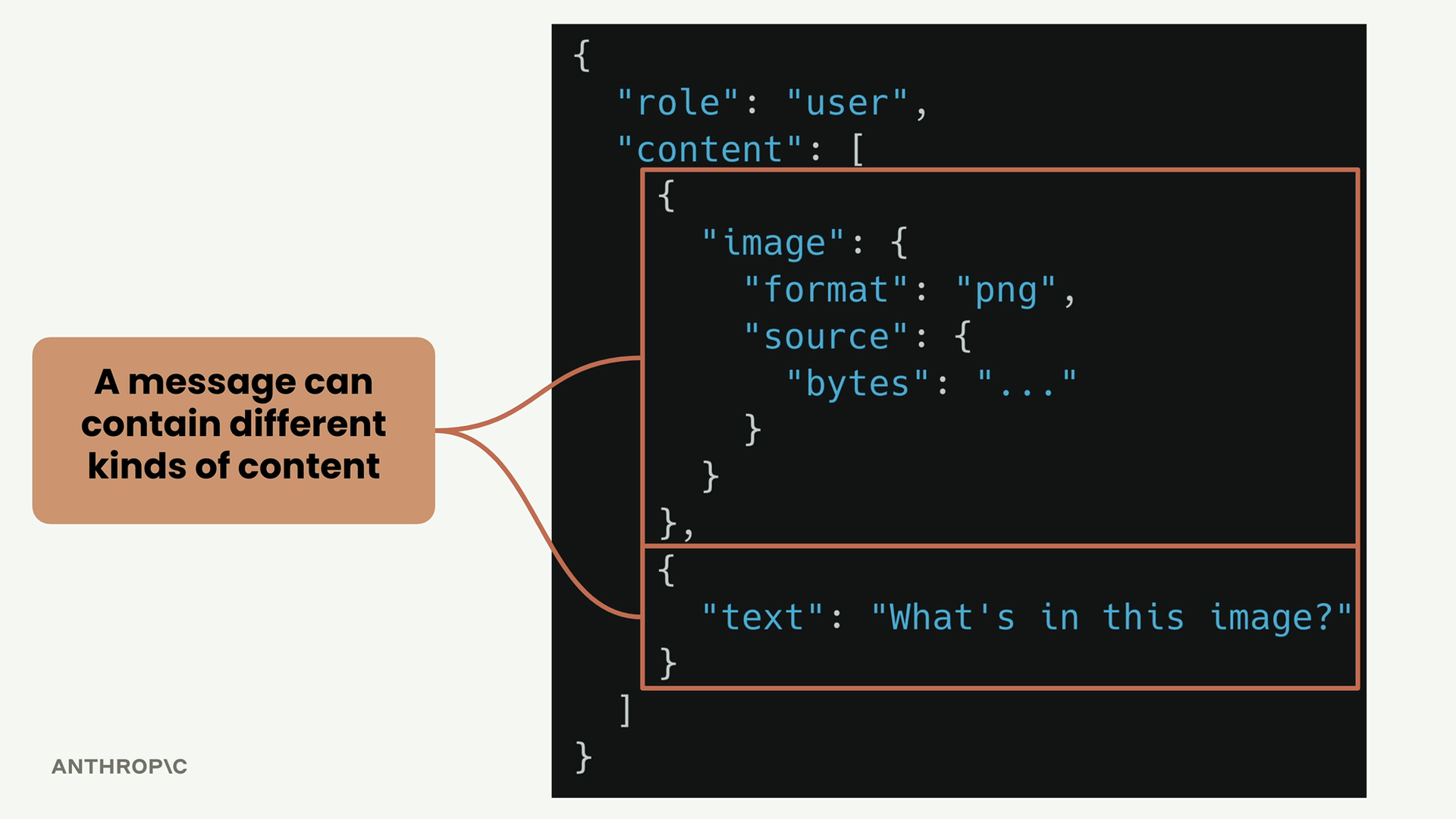

Claude 视觉能力 = 在用户消息中处理图像,用于分析、比较、计数和描述任务。

图像限制:

- 每个请求最多 100 张图像。

- 存在尺寸/维度限制。

- 图像消耗词元(根据像素高度/宽度计算收费)。

图像块结构 = 用户消息中的一种特殊块类型,持有原始图像数据(base64)或在线图像的 URL 引用。每条消息允许有多个图像块。

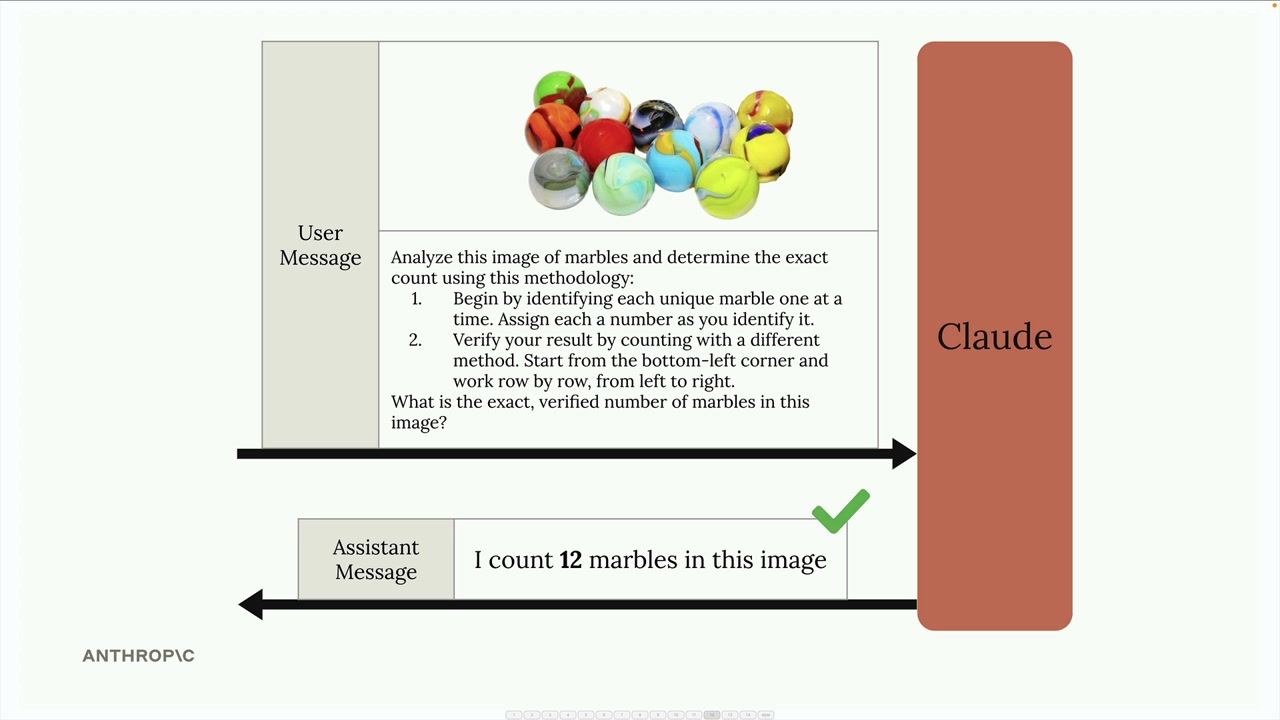

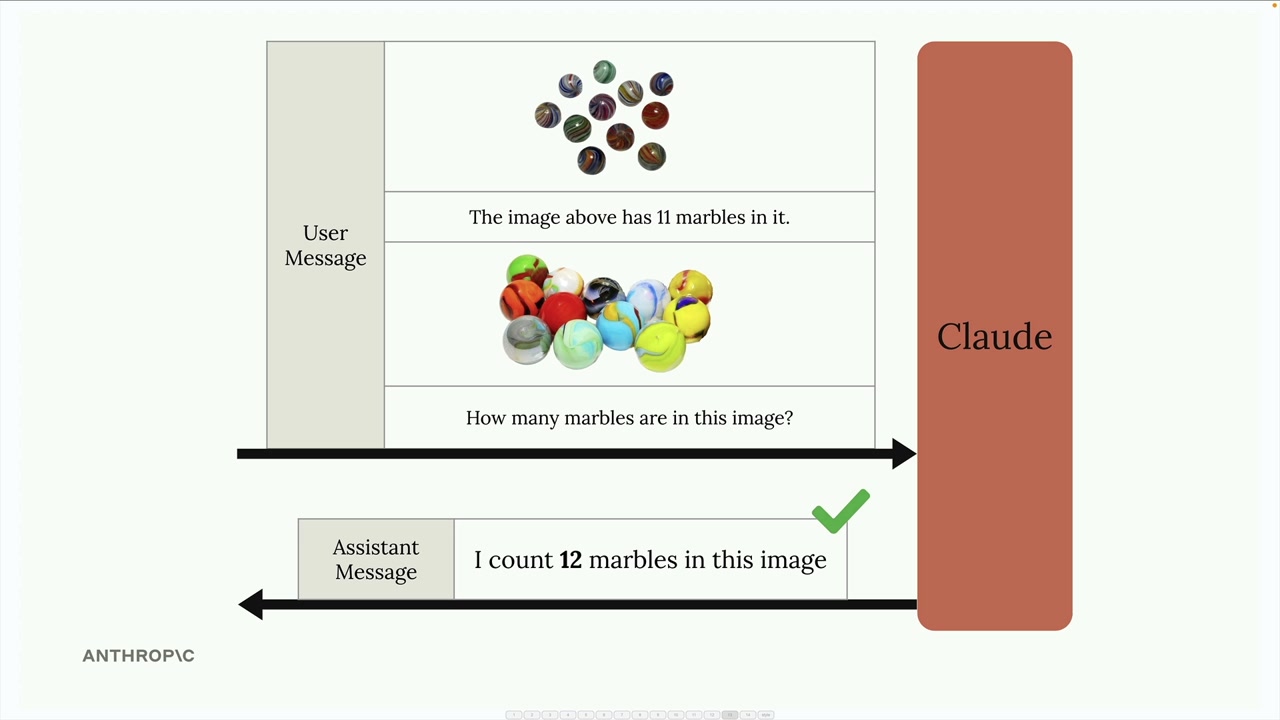

成功的关键因素 = 需要强有力的提示词技术才能获得准确结果。简单的提示词通常会失败。

针对图像的提示词技术:

- 循序渐进的分析指令。

- 单样本/多样本示例(交替的图像和文本对)。

- 清晰的指导方针和验证步骤。

- 结构化的分析框架。

用例示例 = 从卫星图像中自动评估火灾风险,分析树木密度、财产通道、屋顶悬挑,并分配数值风险评分。

实现 = 对图像数据进行 base64 编码,创建包含图像块(type: image, source: base64, media_type, data)的消息,后跟包含详细提示指令的文本块。

核心要点 = 图像的准确性完全取决于提示词的复杂程度,而不仅仅是图像质量。

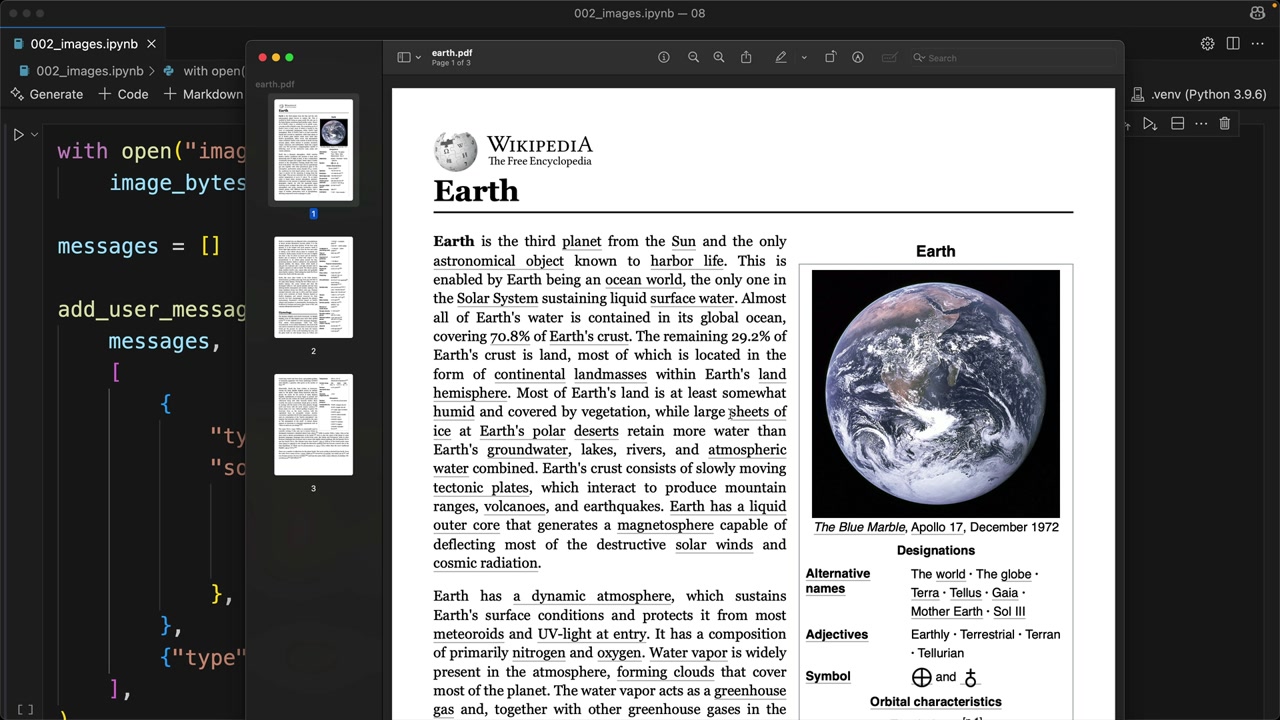

PDF 支持

Claude 中的 PDF 支持:

Claude 可以使用与图像处理类似的代码直接读取 PDF 文件。

关键实现变更:

- 文件类型 = "document" 而不是 "image"。

- 媒体类型 = "application/pdf" 而不是 "image/png"。

- 变量命名 =

file_bytes而不是image_bytes。

Claude PDF 能力 = 读取文本 + 图像 + 图表 + 表格 + 混合内容提取。

PDF 处理 = 全面文档分析的一站式解决方案。

使用模式 = 与图像输入相同,但使用特定于文档的参数。

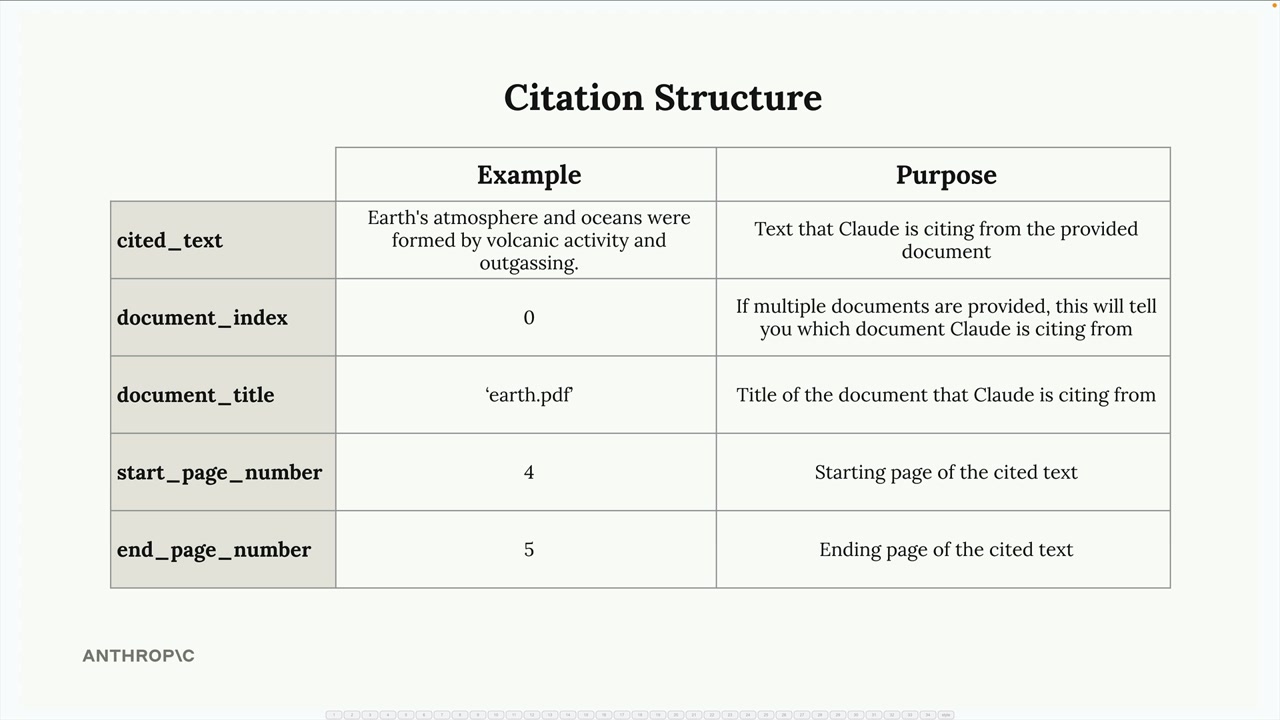

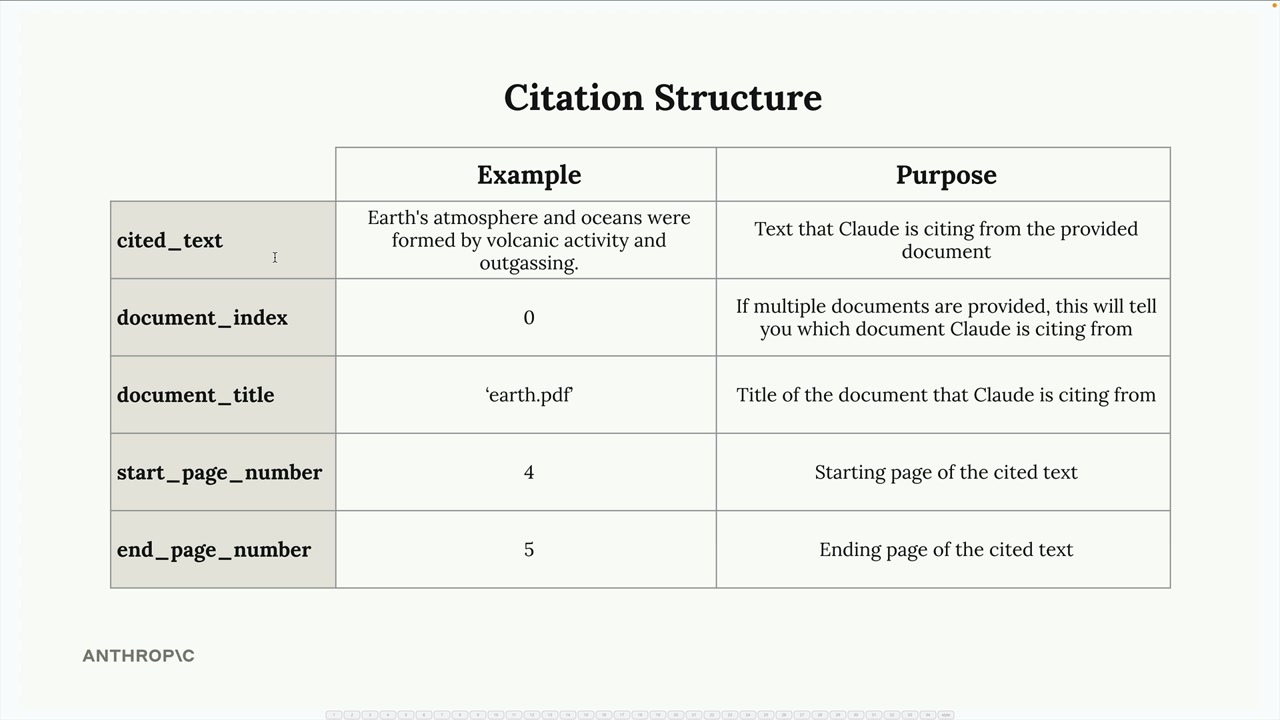

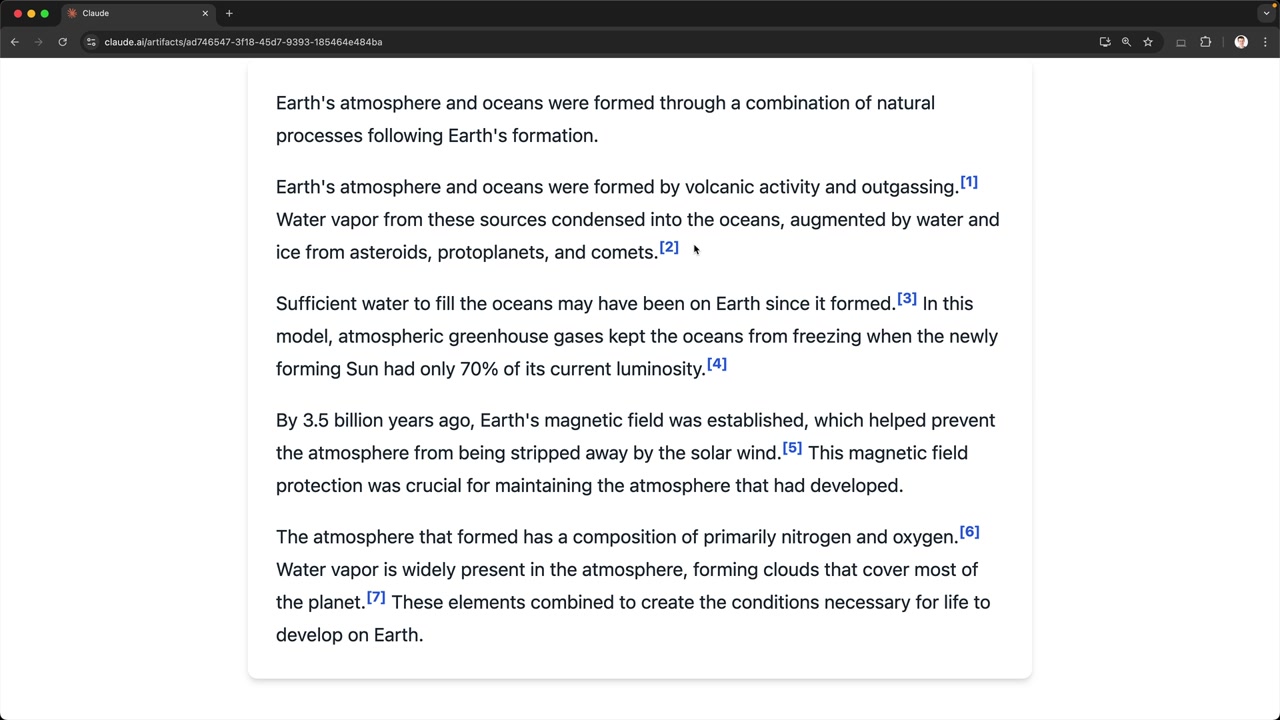

引用

Citations (引用) = 一项功能,允许 Claude 引用源文档并显示信息来源。

引用类型:

citation_page_location= 用于 PDF 文档,显示文档索引/标题/起始页/结束页/引用的文本。citation_char_location= 用于纯文本,显示文本块中的字符位置。

实现:

- 在请求中添加

"citations": {"enabled": true}。 - 添加 "title" 字段以标识源文档。

- 适用于 PDF 文件和纯文本源。

响应结构 = content 变为一个文本块列表,其中一些包含带有位置数据的 citations 数组。

目的 = 为用户提供透明度,以验证 Claude 的信息来源并检查其解释的准确性。

UI 优势 = 当用户悬停在引用内容上时,可以实现引用弹出窗口/覆盖层,显示源文档、页码和确切的引用文本。

关键用例 = 确保用户可以调查 Claude 是如何根据源材料构建响应的,而不是看起来像凭空记忆说话。

提示词缓存

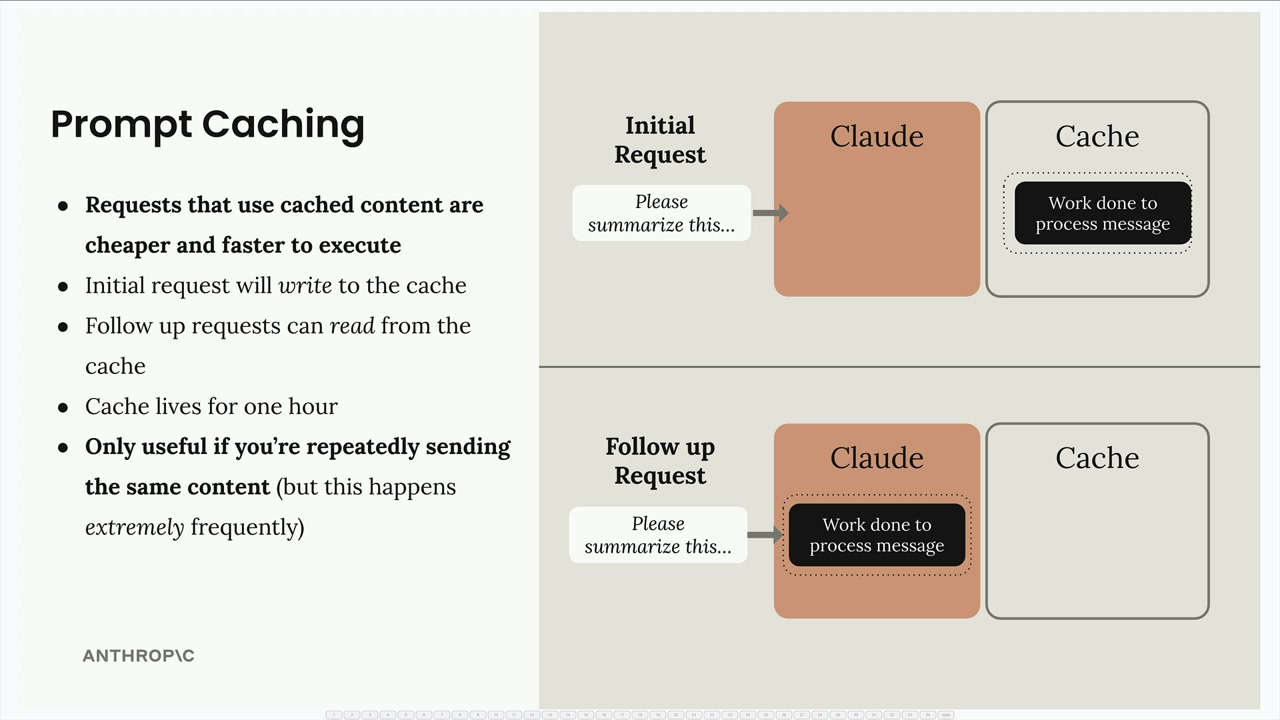

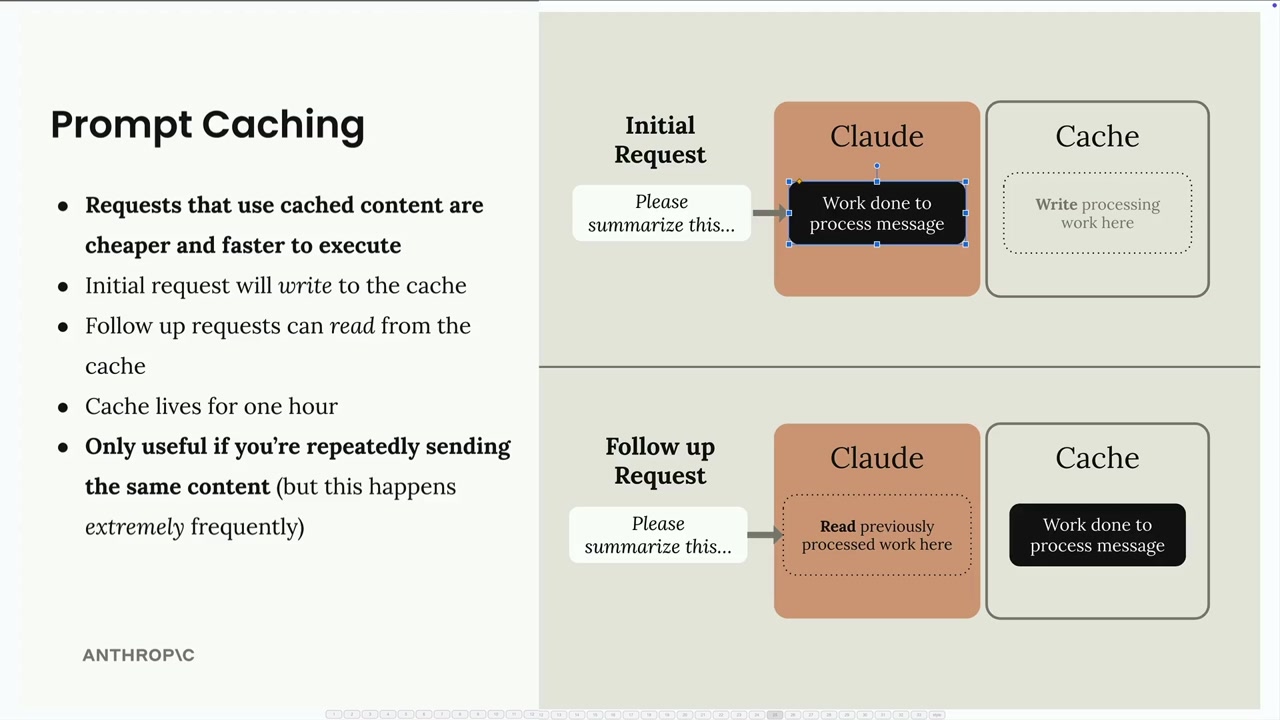

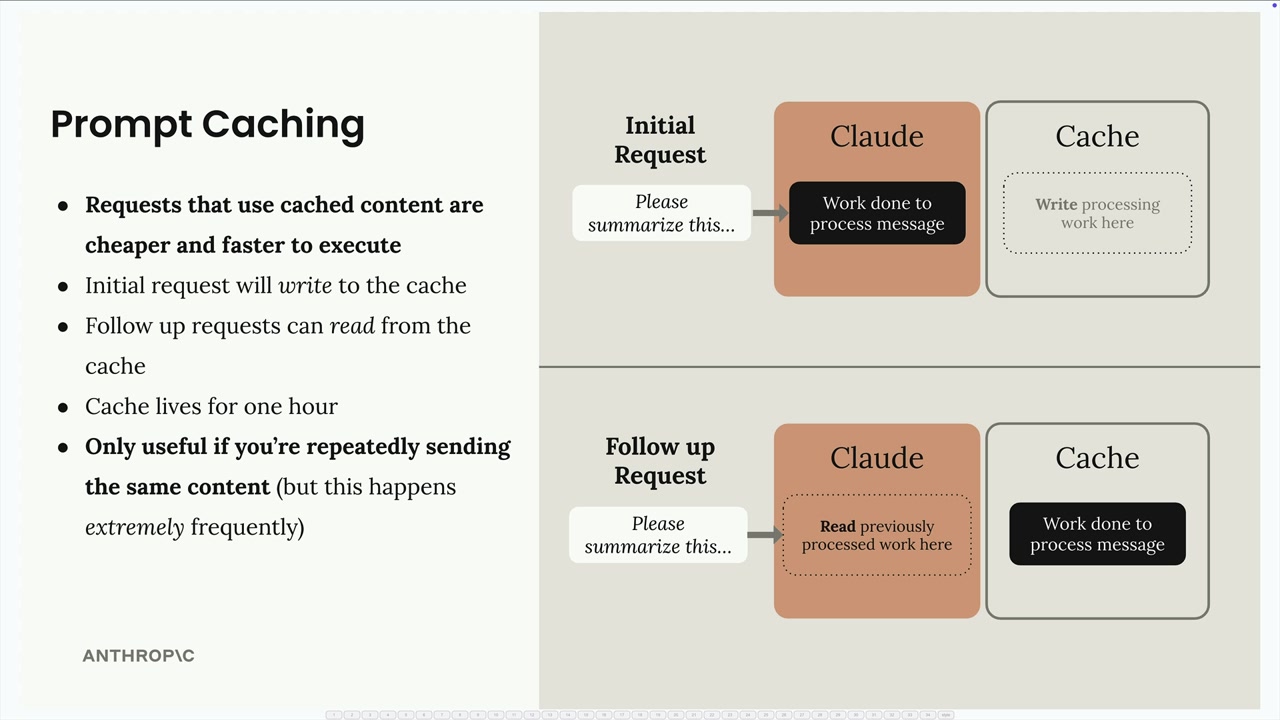

Prompt Caching (提示词缓存) = 一项通过重用先前请求的计算工作来加快 Claude 响应速度并降低文本生成成本的功能。

正常请求流程:用户发送消息 → Claude 处理输入(创建内部数据结构,执行计算)→ Claude 生成输出 → Claude 丢弃所有处理工作 → 准备好下一个请求。

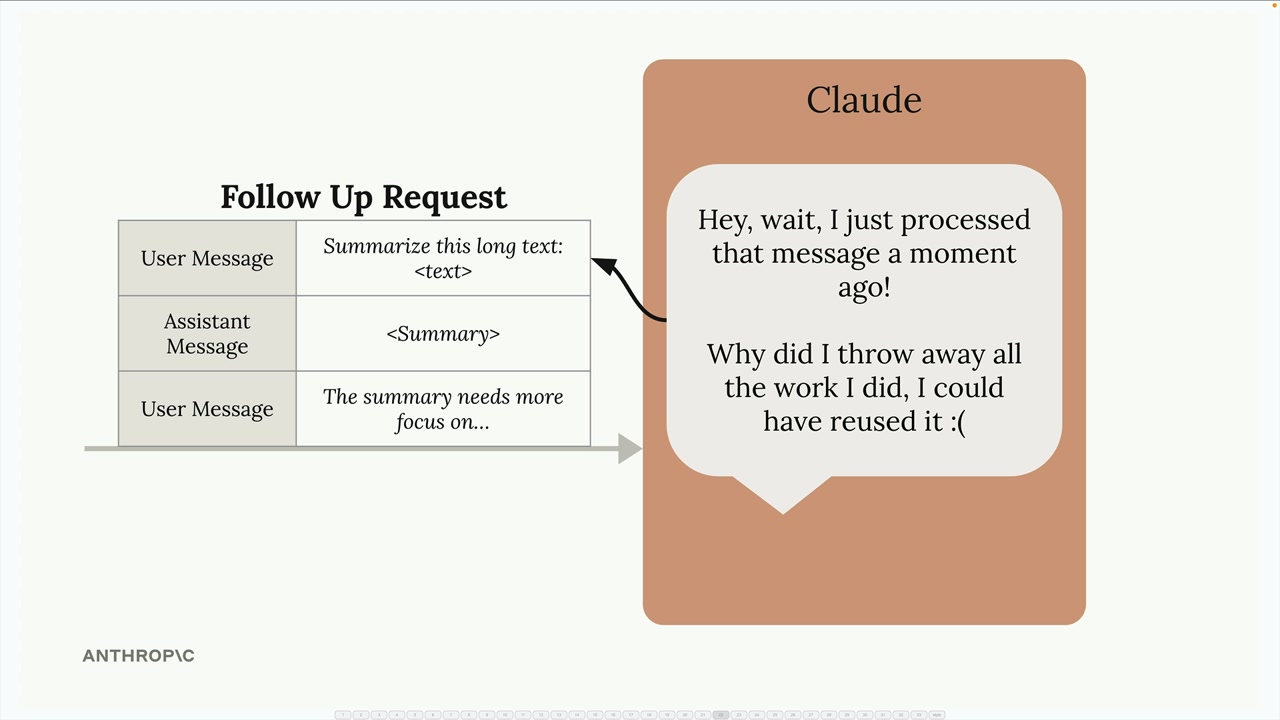

问题:当后续请求包含相同的输入消息时,Claude 必须重复它刚刚丢弃的所有计算工作,这造成了效率低下。

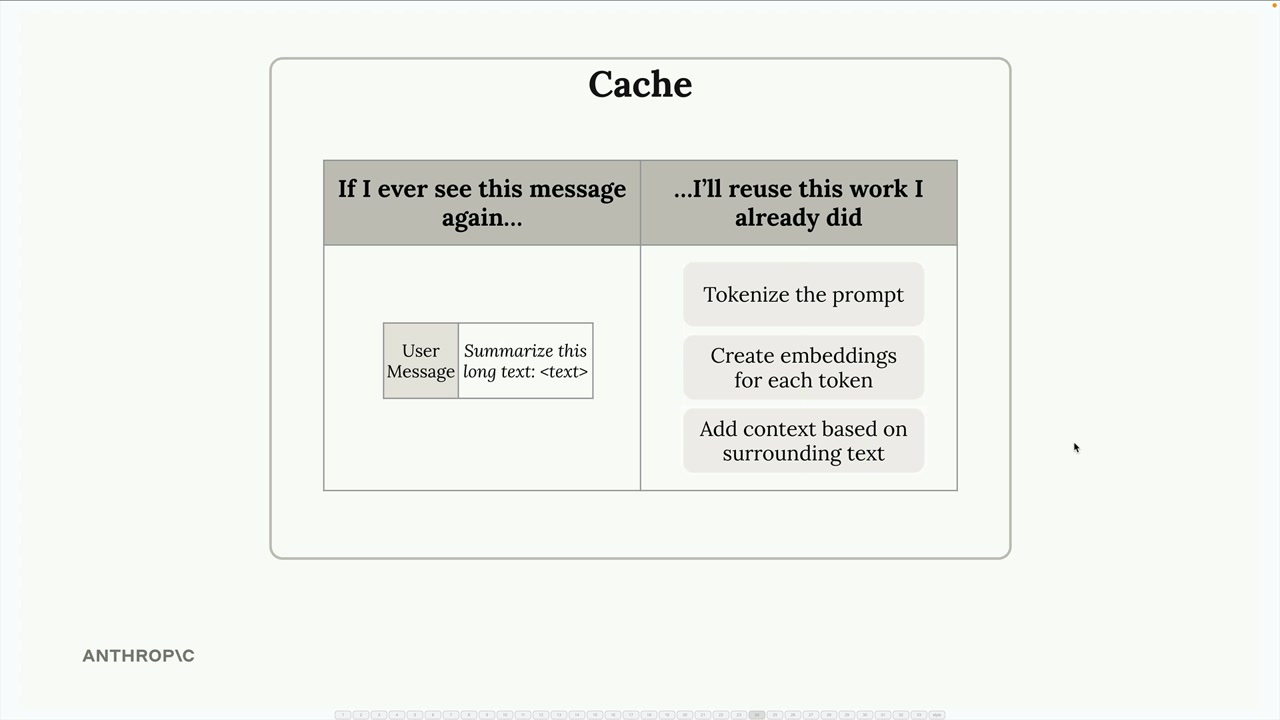

解决方案:提示词缓存将输入消息处理的结果存储在临时缓存中,而不是丢弃。当后续请求中出现相同的输入时,Claude 会检索缓存的工作,而不是重新处理,从而显著加快响应生成速度。

主要优点:重用以前的计算工作,以避免对重复内容进行冗余处理。

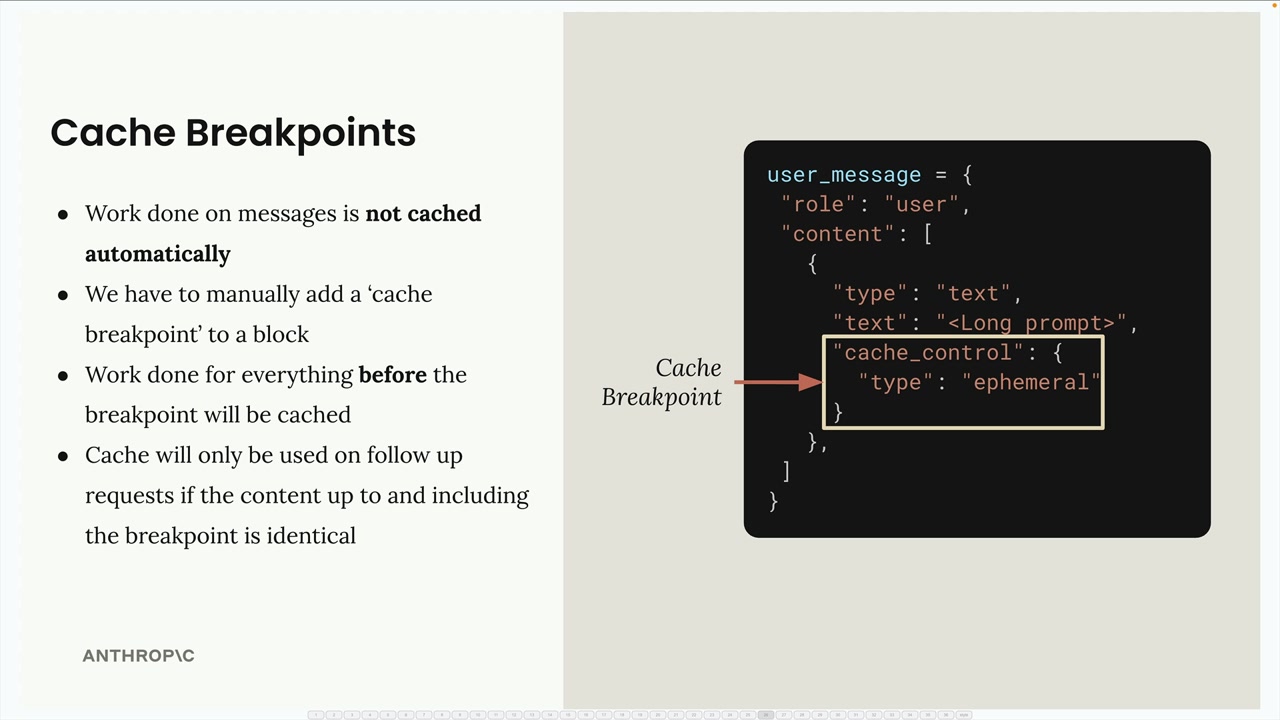

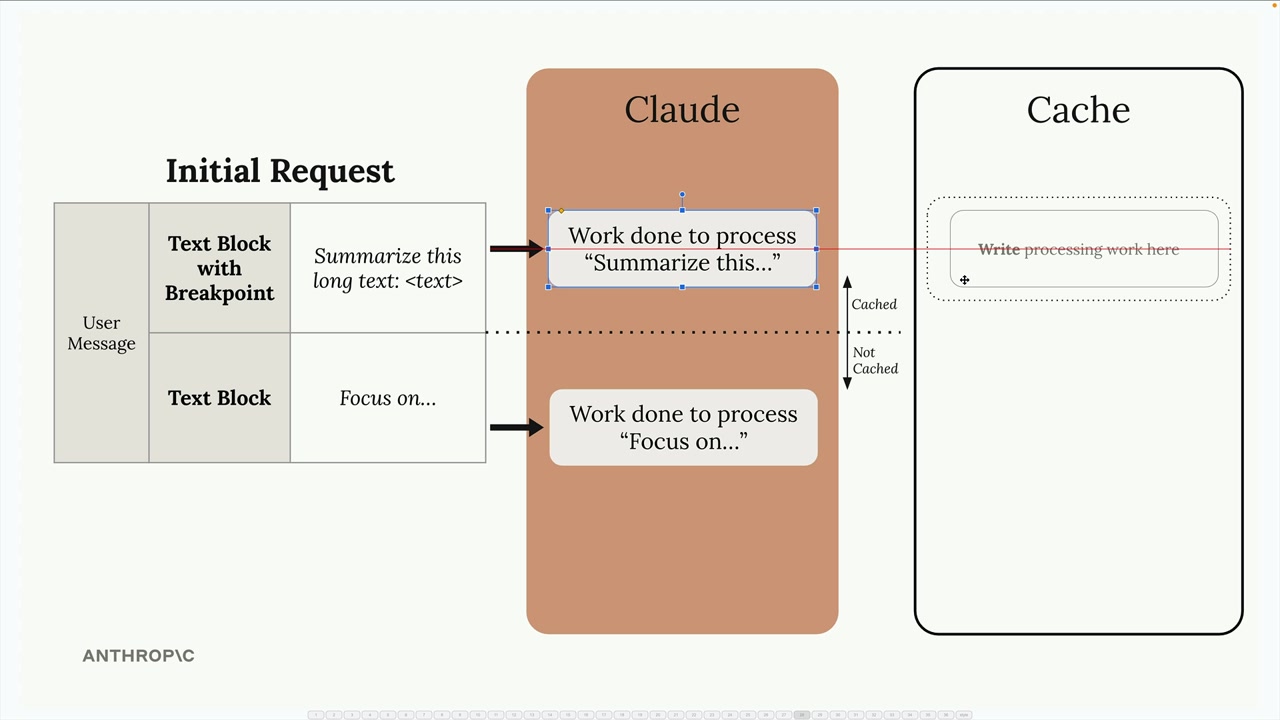

提示词缓存规则

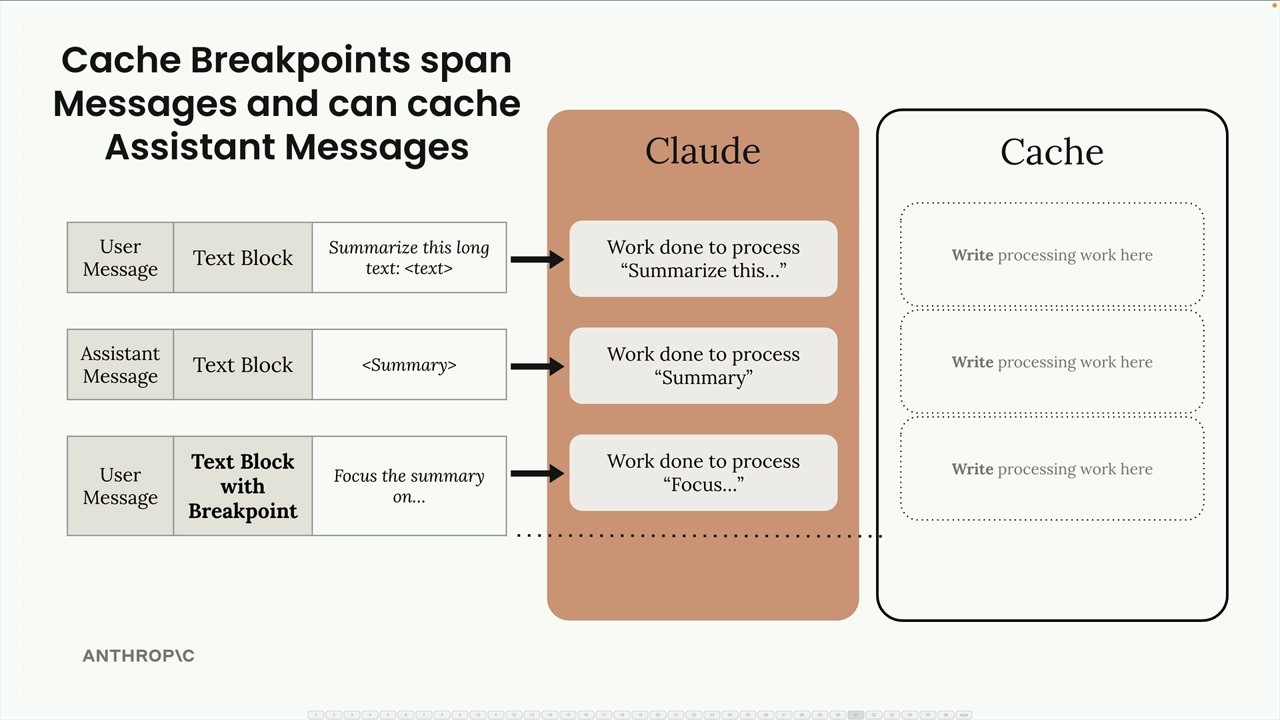

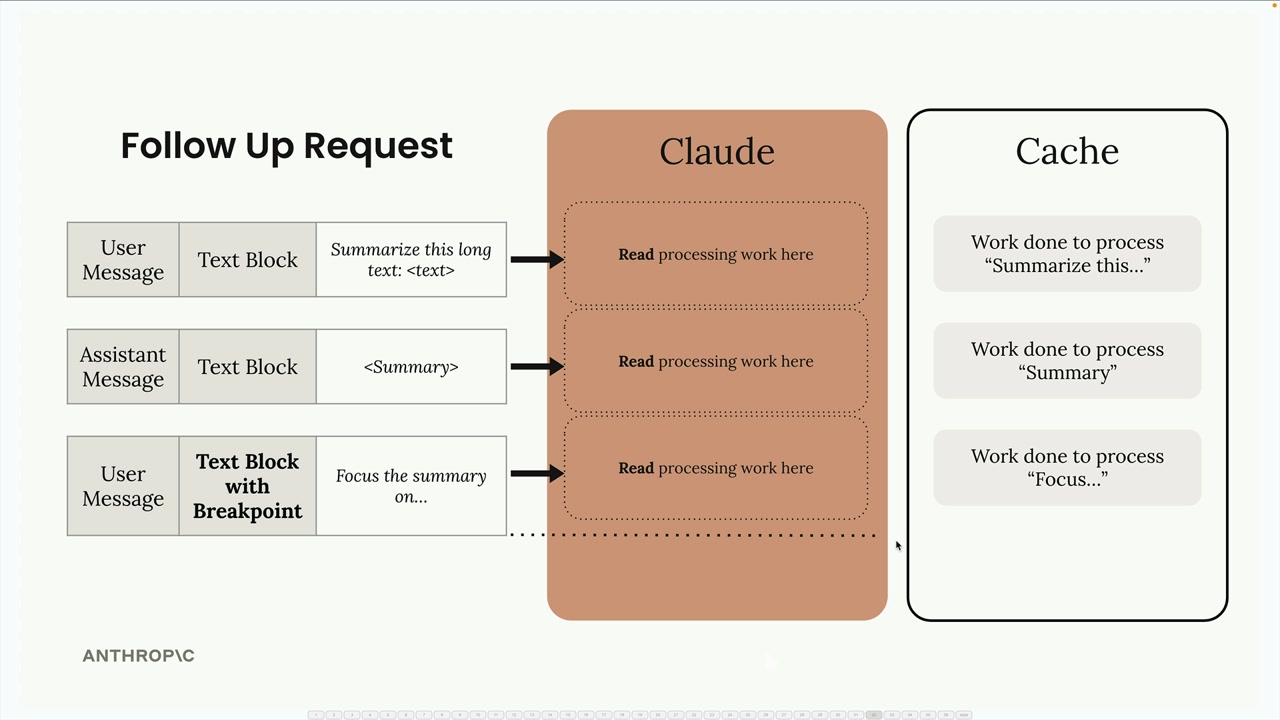

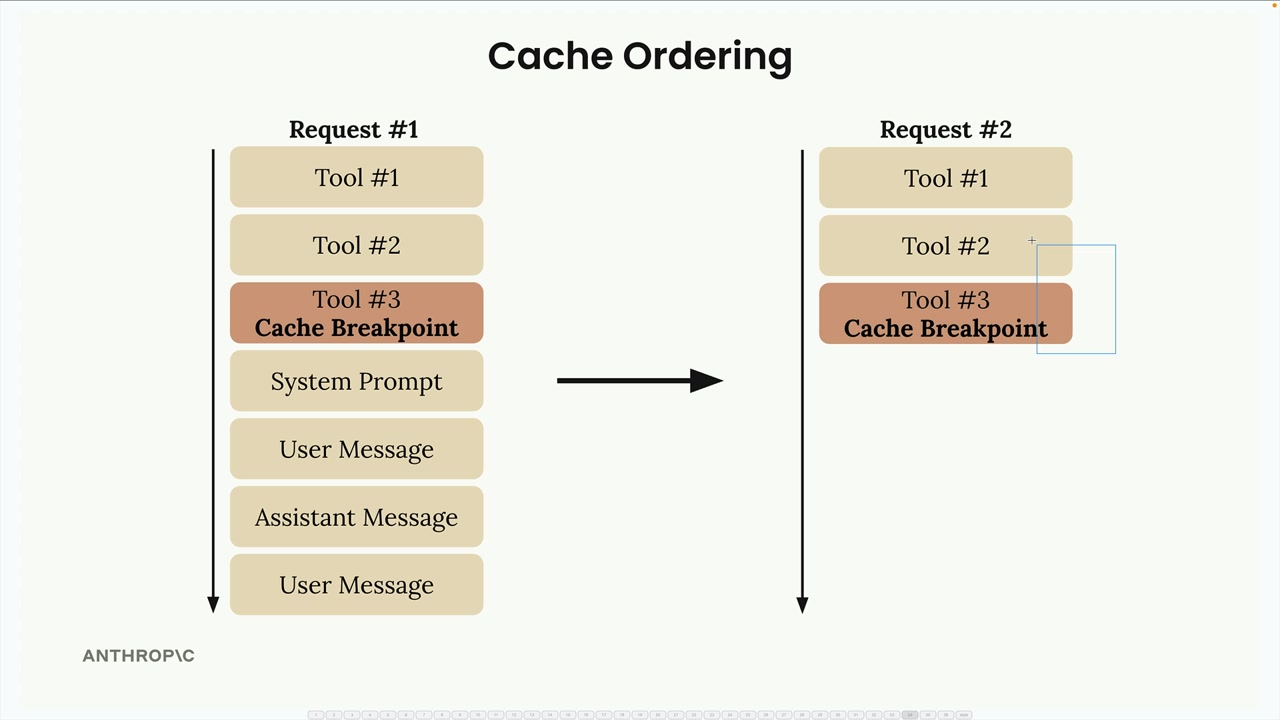

Prompt Caching (提示词缓存) = 一个保存初始请求处理工作的系统,以便在内容相同的后续请求中重用。

核心机制:初始请求 → Claude 处理 + 将工作保存到缓存 → 后续请求内容相同 → Claude 从缓存中检索工作,而不是重新处理。

缓存持续时间 = 最长 1 小时。

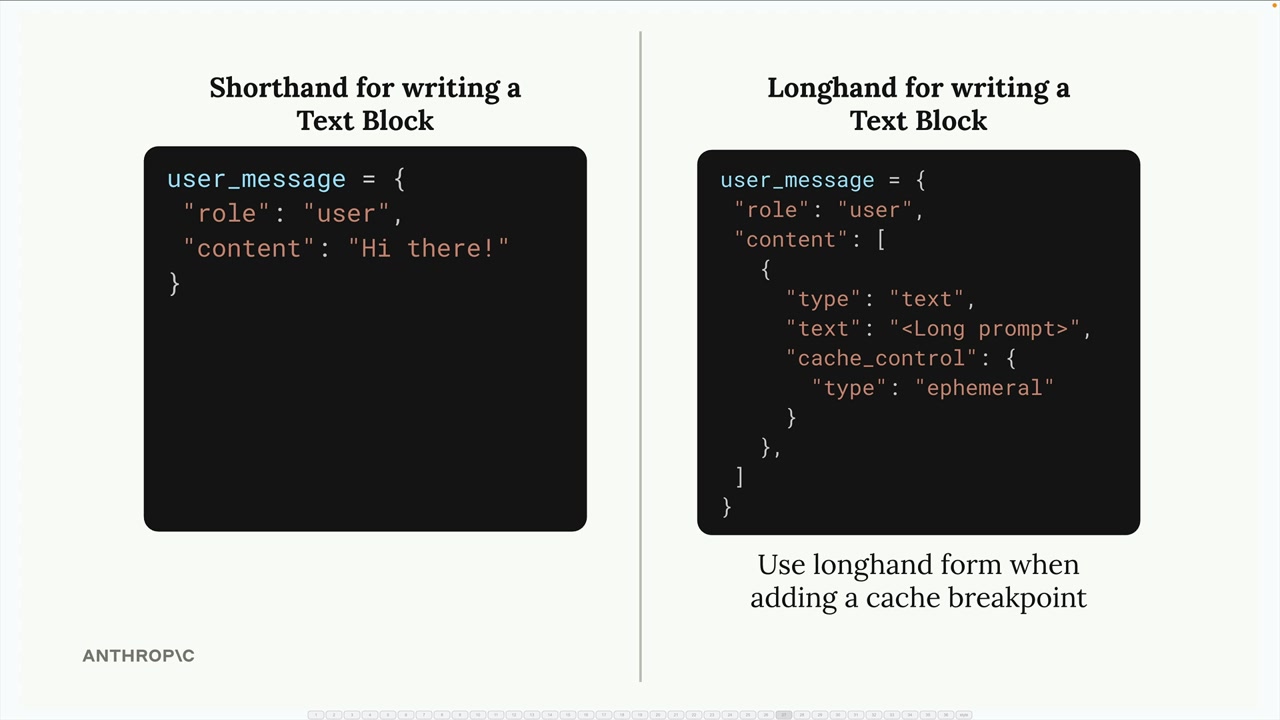

缓存激活需要手动在消息块中添加 cache breakpoint (缓存断点)。

文本块格式:

- 简写:

content = "text string"(无法添加缓存控制)。 - 完整写法:

content = [{"type": "text", "text": "content", "cache_control": {...}}](缓存所需)。

缓存范围 = 所有内容,直到并包括断点,都会被缓存。

缓存失效 = 断点前内容的任何更改都会使整个缓存失效。

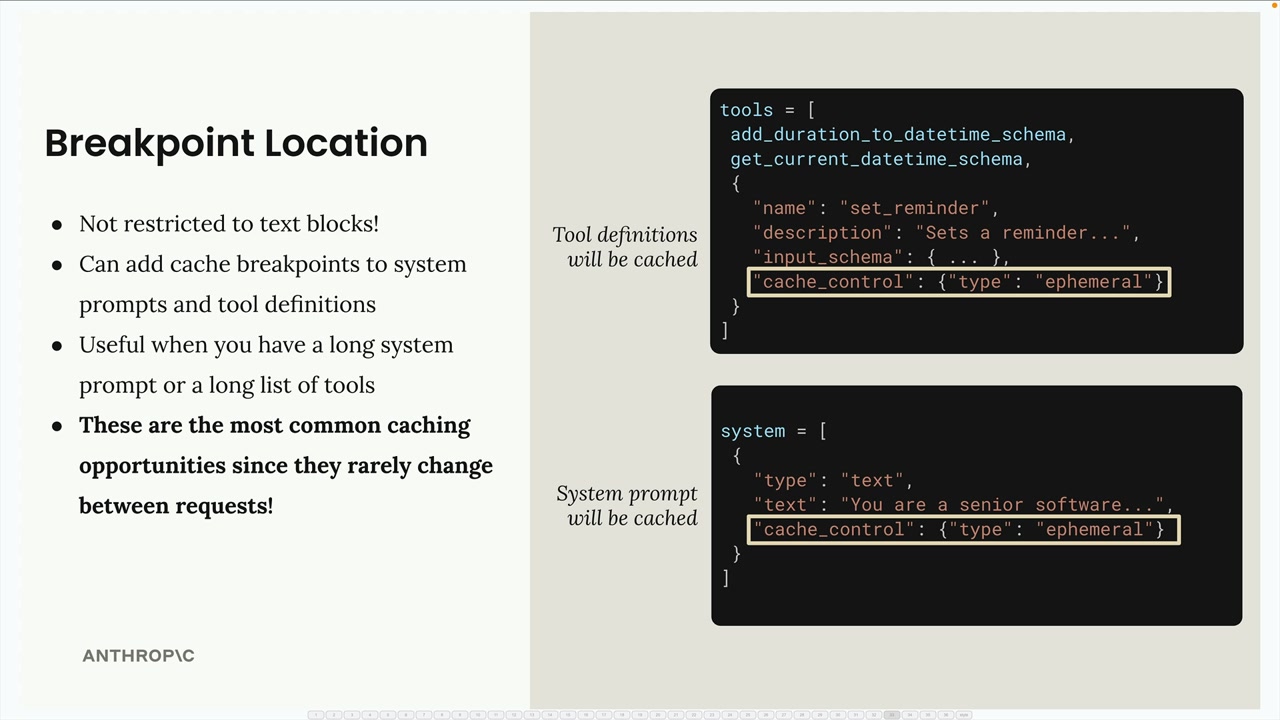

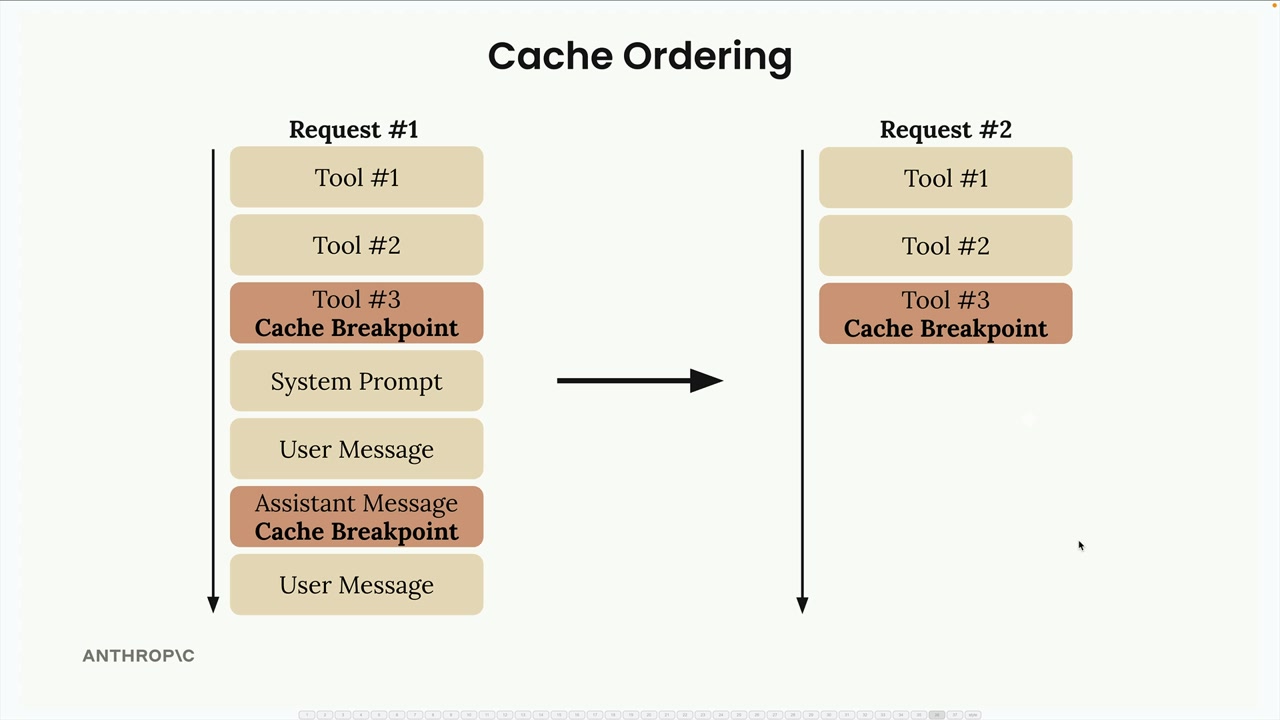

内容处理顺序 = 工具 → 系统提示词 → 消息(拼接在一起)。

缓存断点放置选项:

- 工具模式。

- 系统提示词。

- 消息块(文本、图像、工具使用、工具结果)。

每个请求最多 4 个断点。

多个断点 = 创建多个缓存层,如果只有后面的内容发生变化,可能实现部分缓存命中。

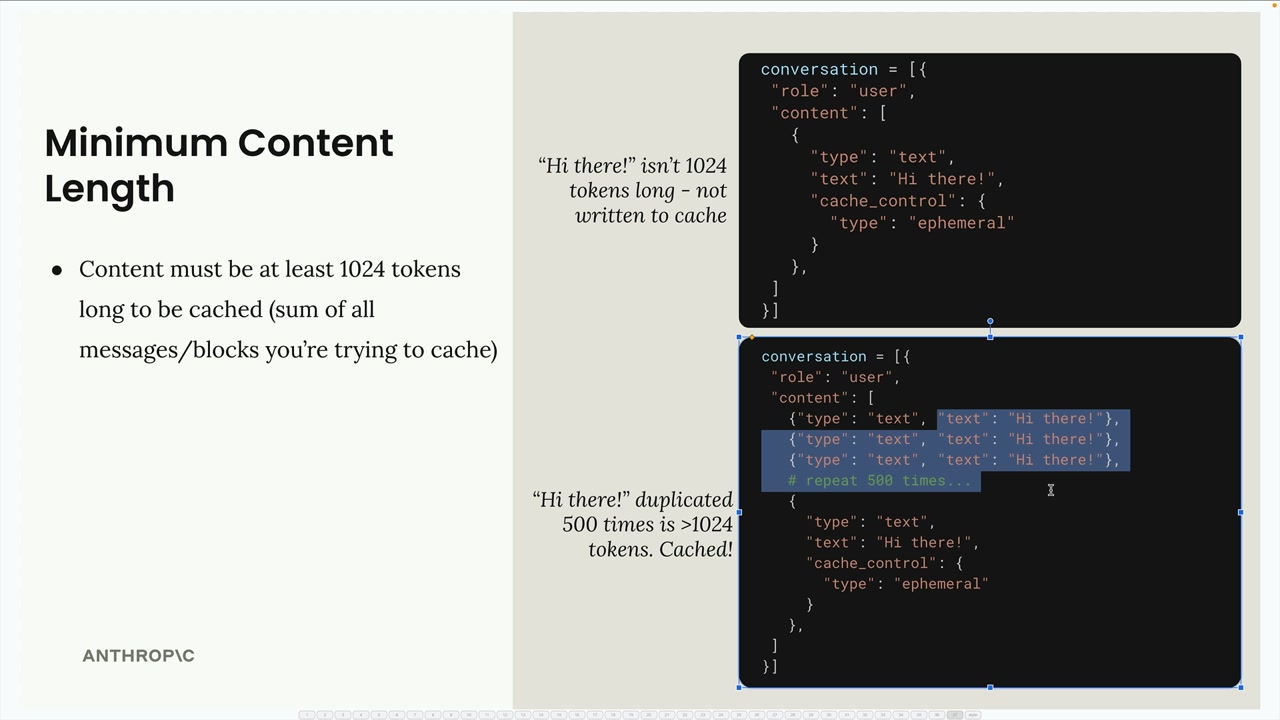

最小缓存阈值 = 内容需要达到 1024 个词元才能被缓存。

最佳用例 = 请求间内容完全相同(系统提示词、工具定义、静态消息前缀)。

提示词缓存实战

提示词缓存实现 = 自动缓存工具模式和系统提示词以减少词元使用。

设置 = 修改 chat 函数,默认对工具和系统提示词启用缓存。

工具模式缓存 = 将 cache_control 字段(类型为 "ephemeral")添加到列表中的最后一个工具。最佳实践:创建工具列表的副本,克隆最后一个工具模式,添加缓存控制,然后覆盖,以避免修改原始模式。

系统提示词缓存 = 将系统提示词包装在带有 cache_control 类型 "ephemeral" 的文本块字典中。

多个缓存断点 = 可以在单个请求中为工具和系统提示词都设置缓存点。

缓存顺序 = 工具 → 系统提示词 → 消息。

词元使用模式:

cache_creation_input_tokens= 首次使用时写入缓存的词元。cache_read_input_tokens= 在后续相同请求中从缓存中读取的词元。- 当部分内容与缓存数据匹配时,可能发生部分缓存读取。

缓存失效 = 缓存内容(工具或系统提示词)的任何更改都会使缓存失效,强制创建新缓存。

使用场景 = 跨请求内容相同 - 相同的工具模式、系统提示词或消息序列。

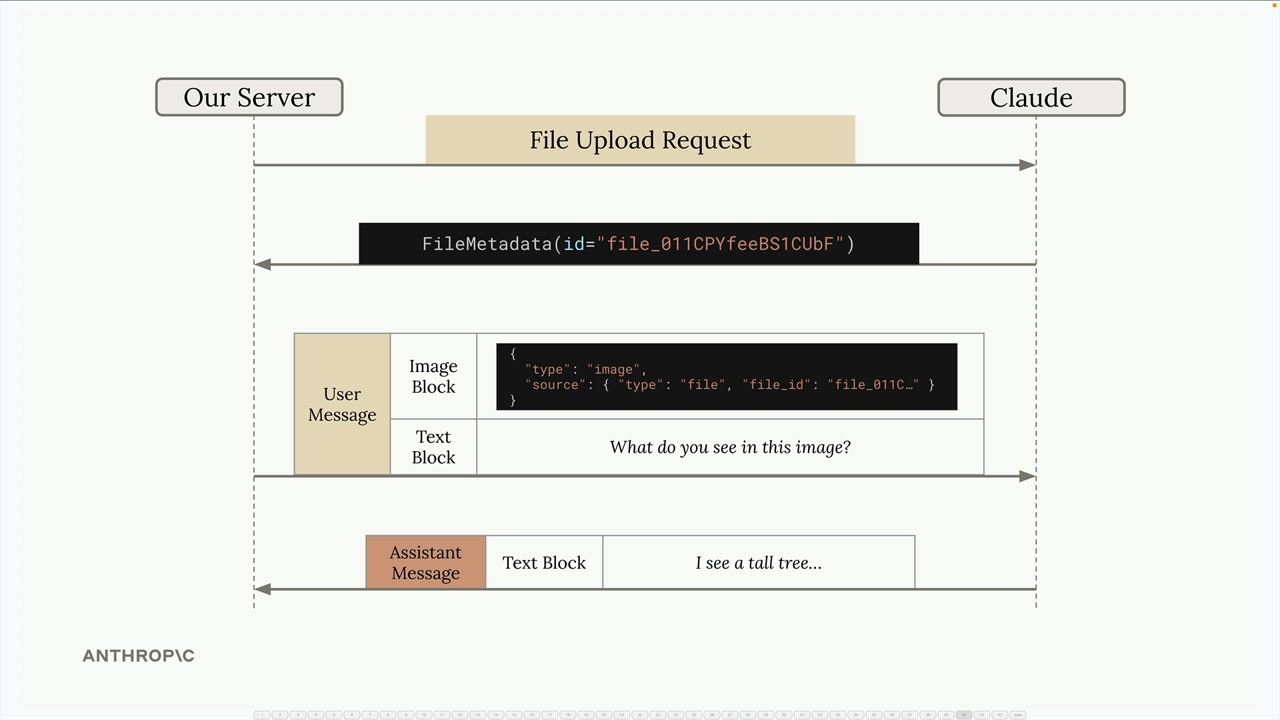

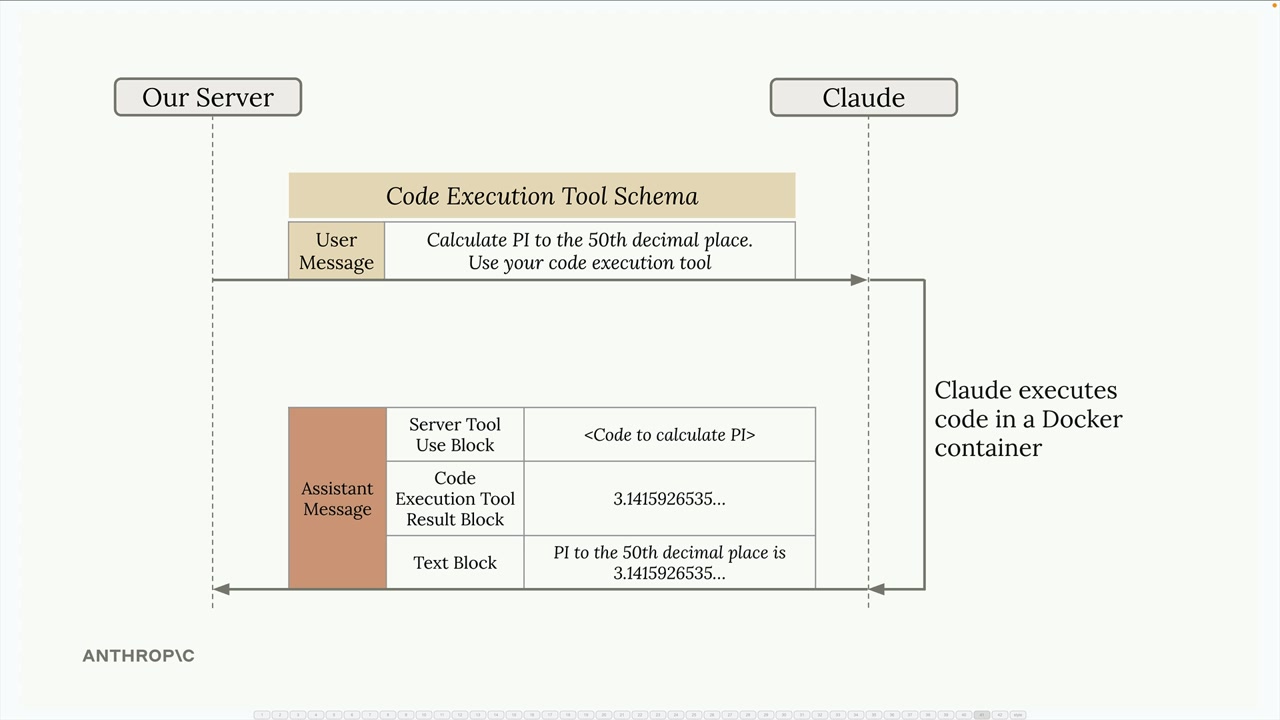

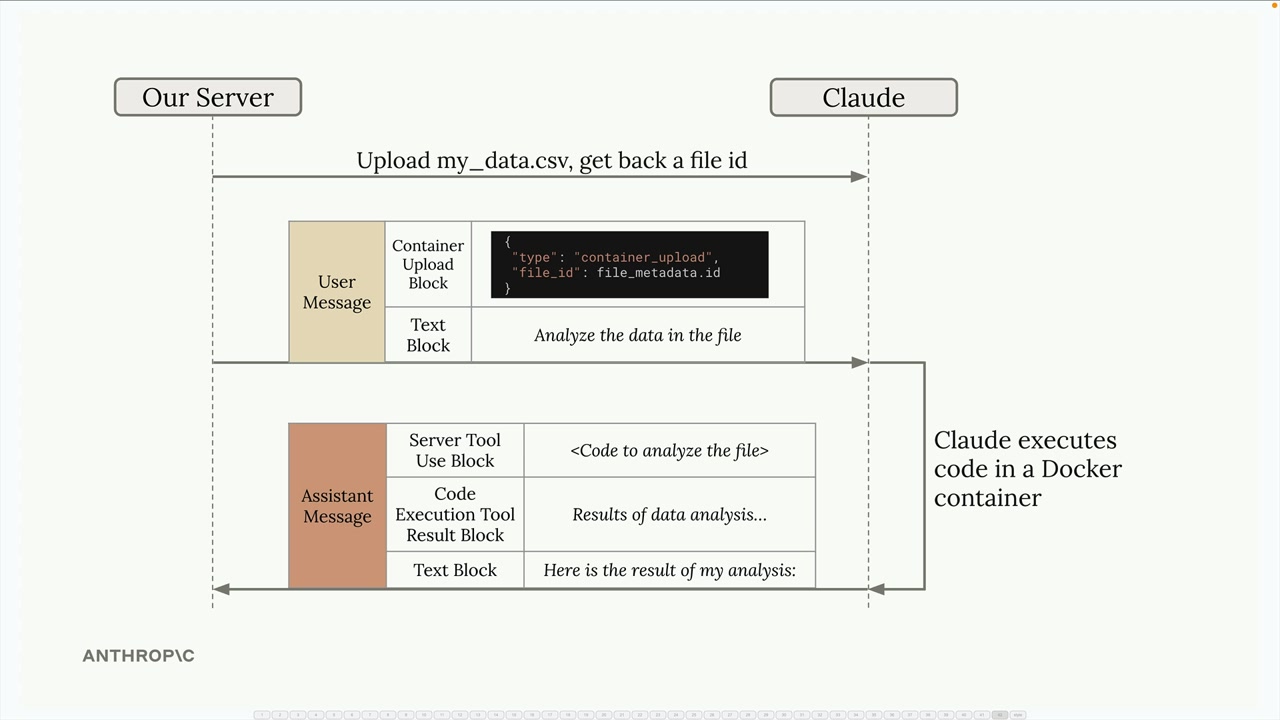

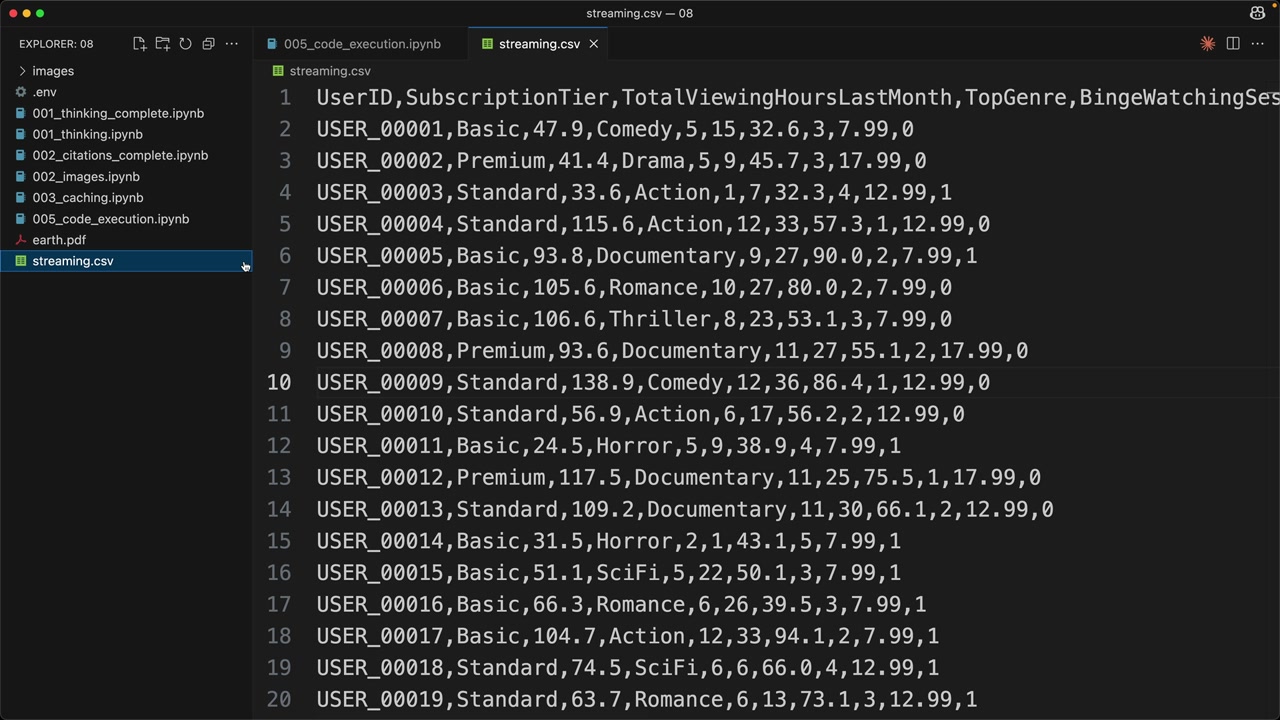

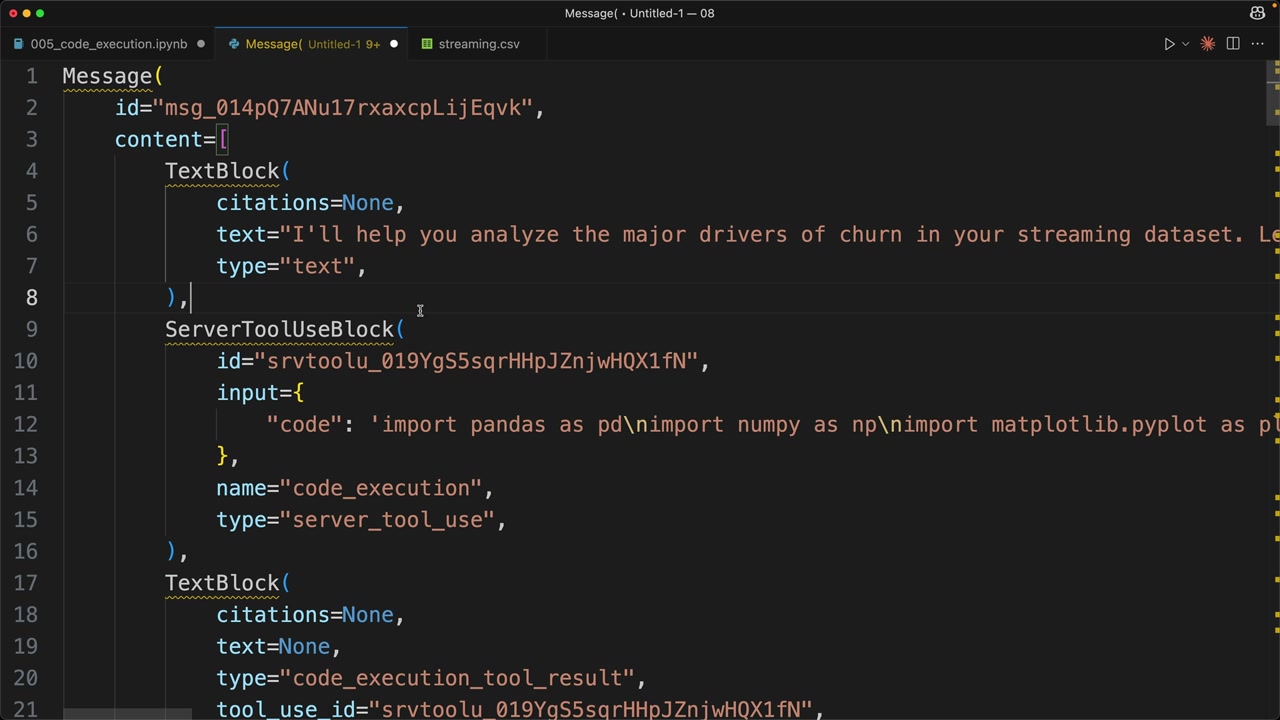

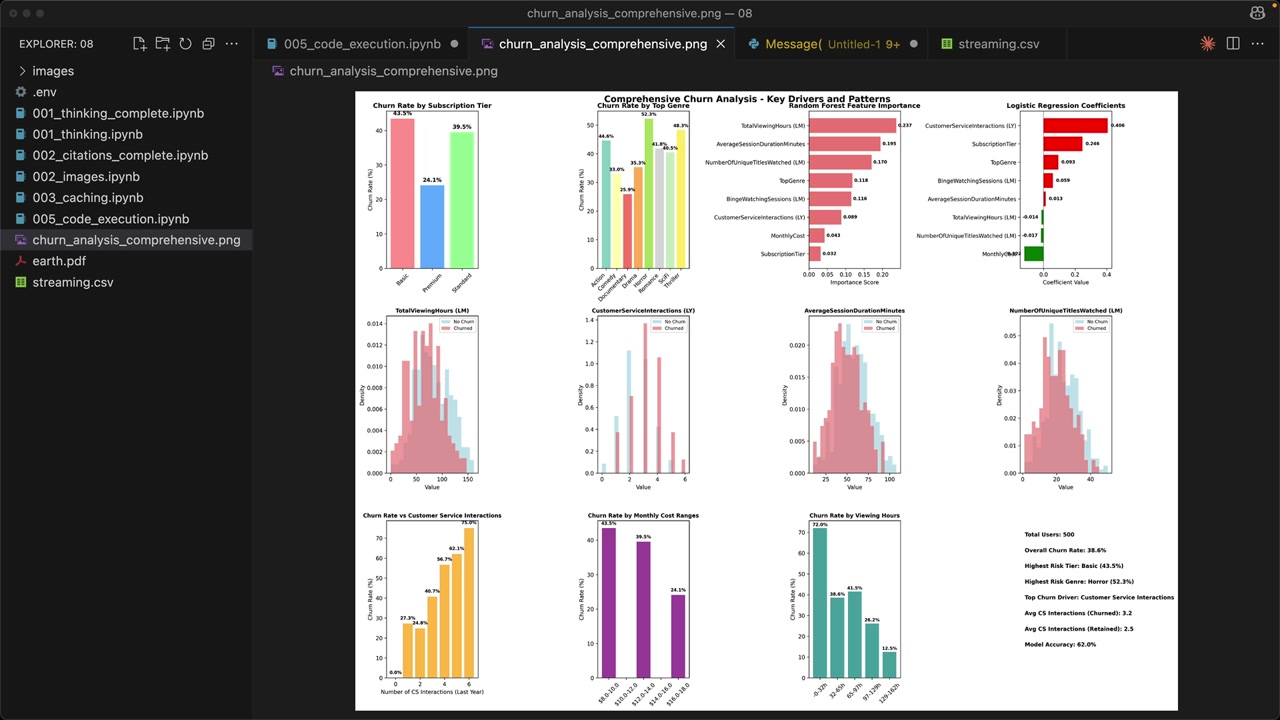

代码执行与文件 API

Files API (文件 API) = 允许提前上传文件,并在之后通过文件 ID 引用它们,而不是在每个请求中包含原始文件数据。上传文件 → 获取带有 ID 的文件元数据对象 → 在未来请求中使用该 ID。

Code Execution (代码执行) = 一个基于服务器的工具,Claude 在隔离的 Docker 容器中执行 Python 代码。无需实现,只需包含预定义的工具模式。Claude 可以多次运行代码,解释结果,并生成最终响应。

关键限制:Docker 容器没有网络访问权限。数据输入/输出依赖于与 Files API 的集成。

组合工作流程:通过 Files API 上传文件 → 获取文件 ID → 在容器上传块中包含该 ID → 要求 Claude 进行分析 → Claude 编写/执行可访问上传文件的代码 → 返回分析和结果。

Claude 可以在容器内生成文件(如图表、报告),这些文件可以通过响应中返回的文件 ID 进行下载。

使用场景:数据分析、文件处理、复杂任务的自动代码生成。响应包含代码块、执行结果和最终分析。

实现:使用带有文件 ID 的容器上传块,包含分析提示词,Claude 会自动处理代码执行。

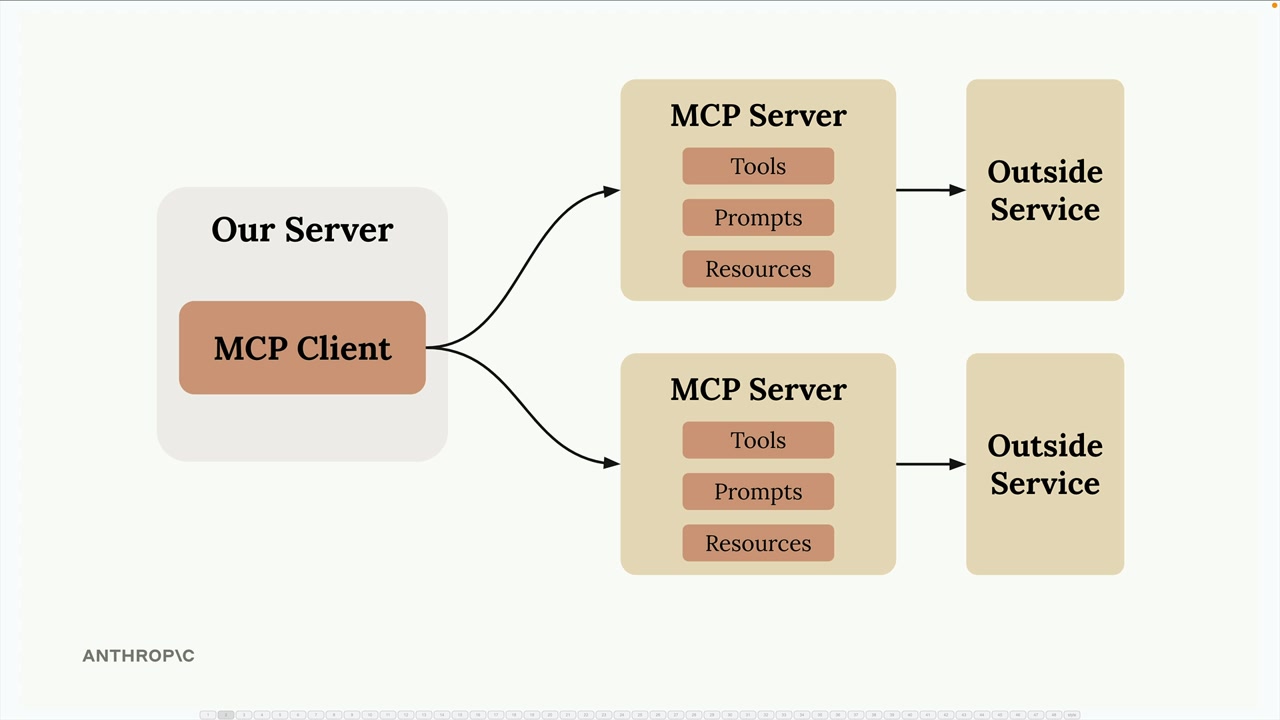

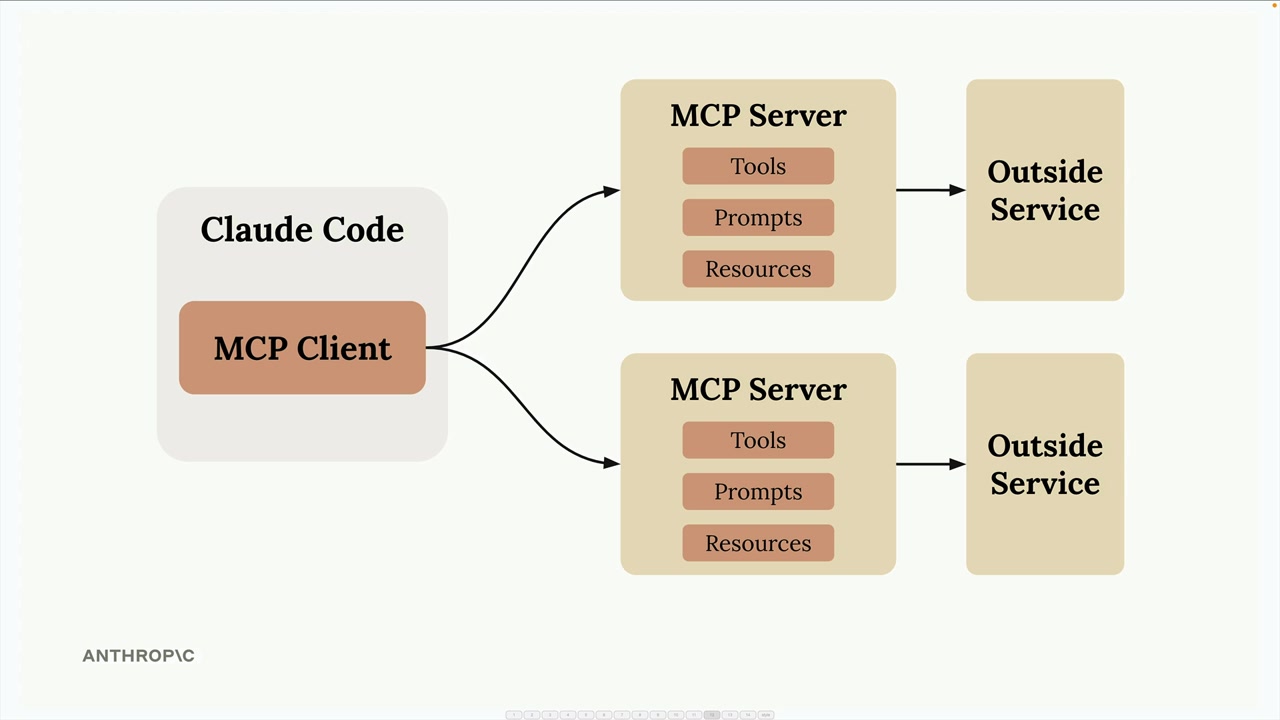

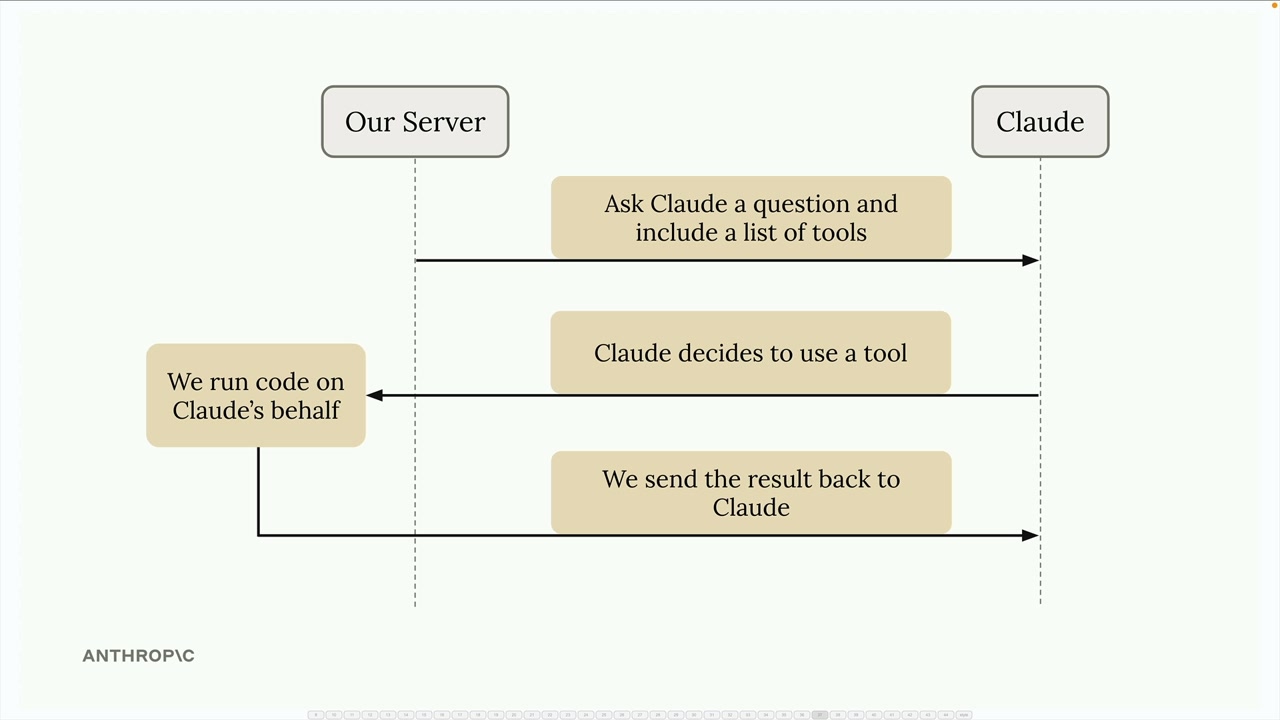

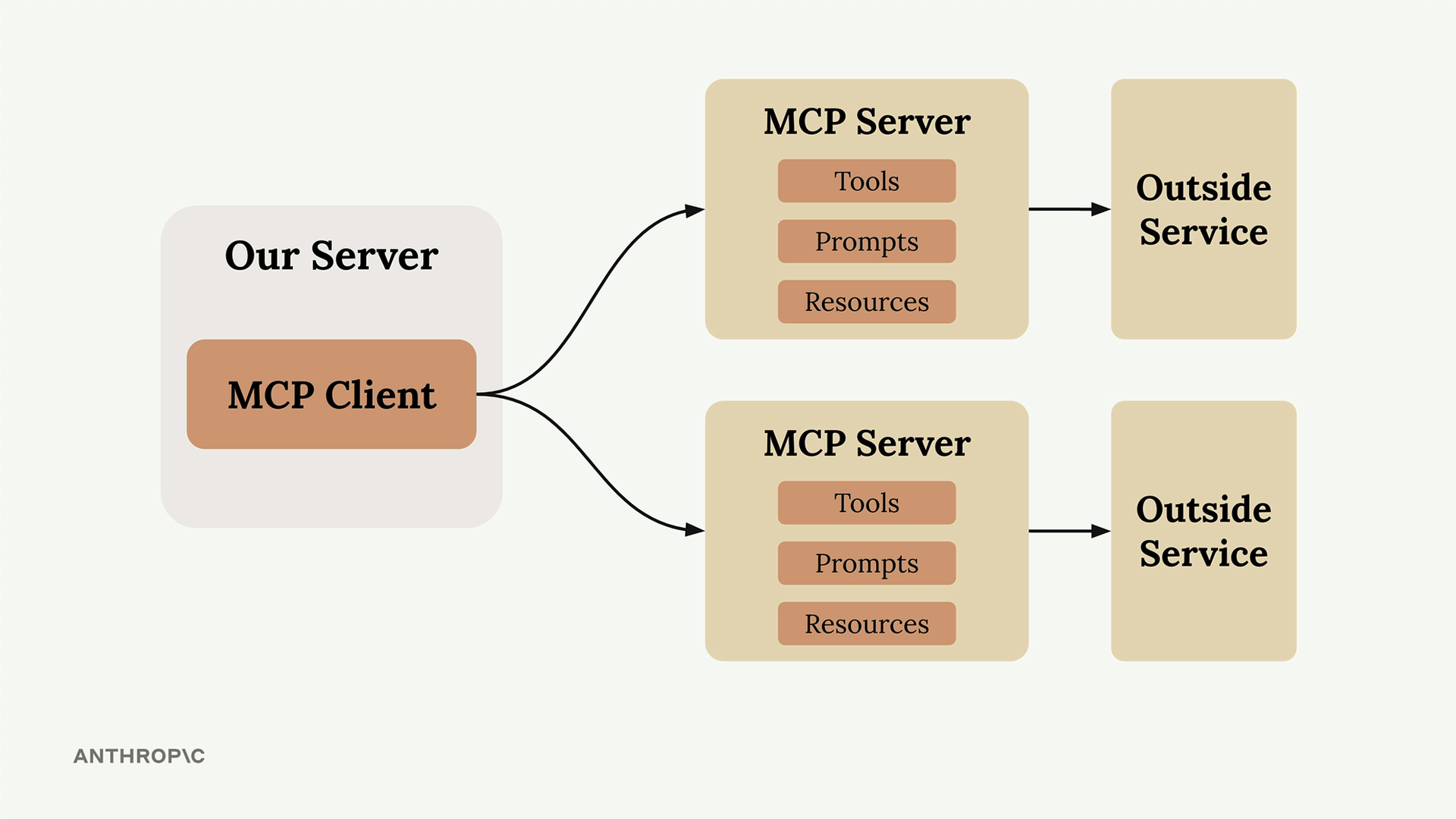

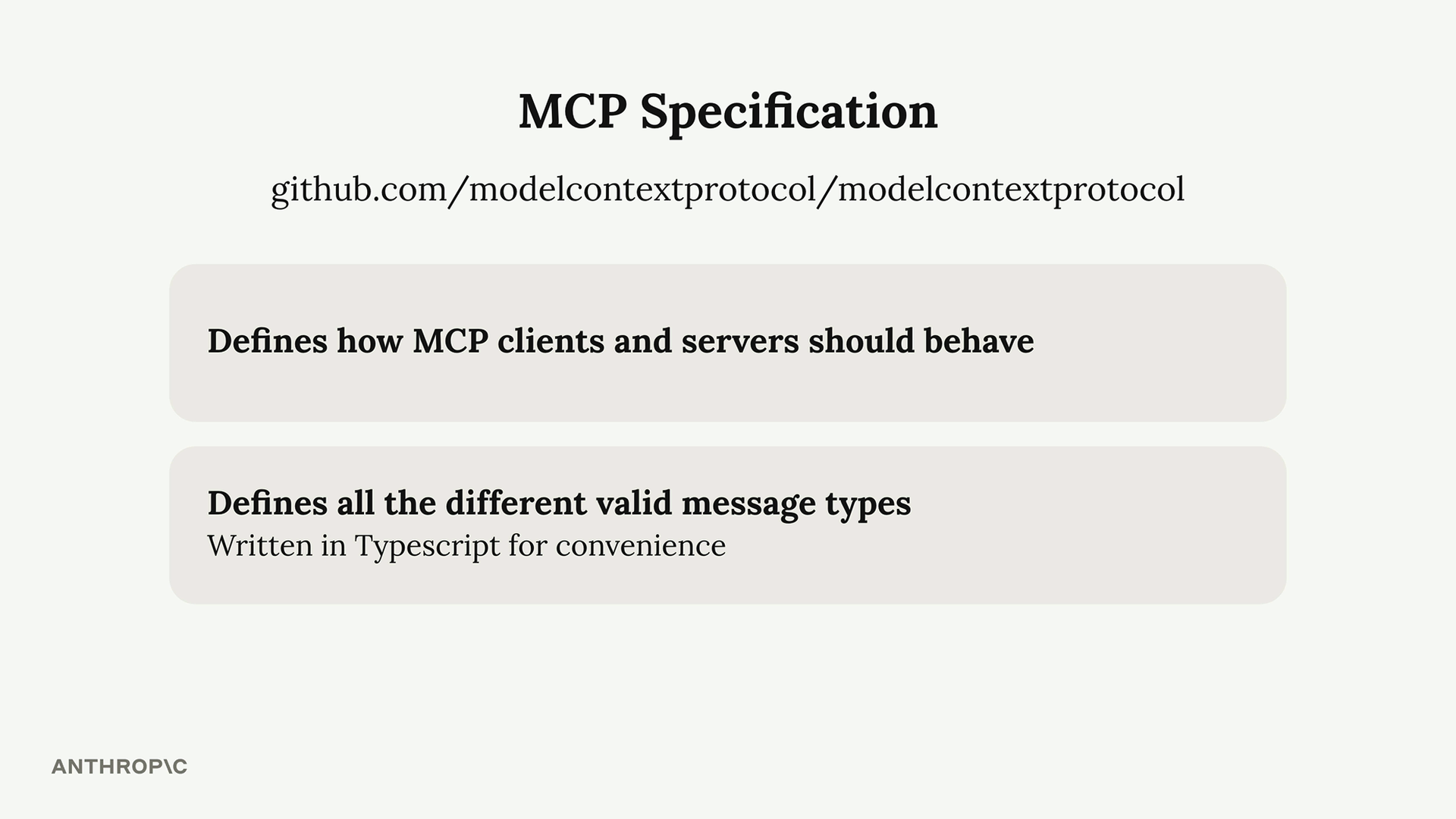

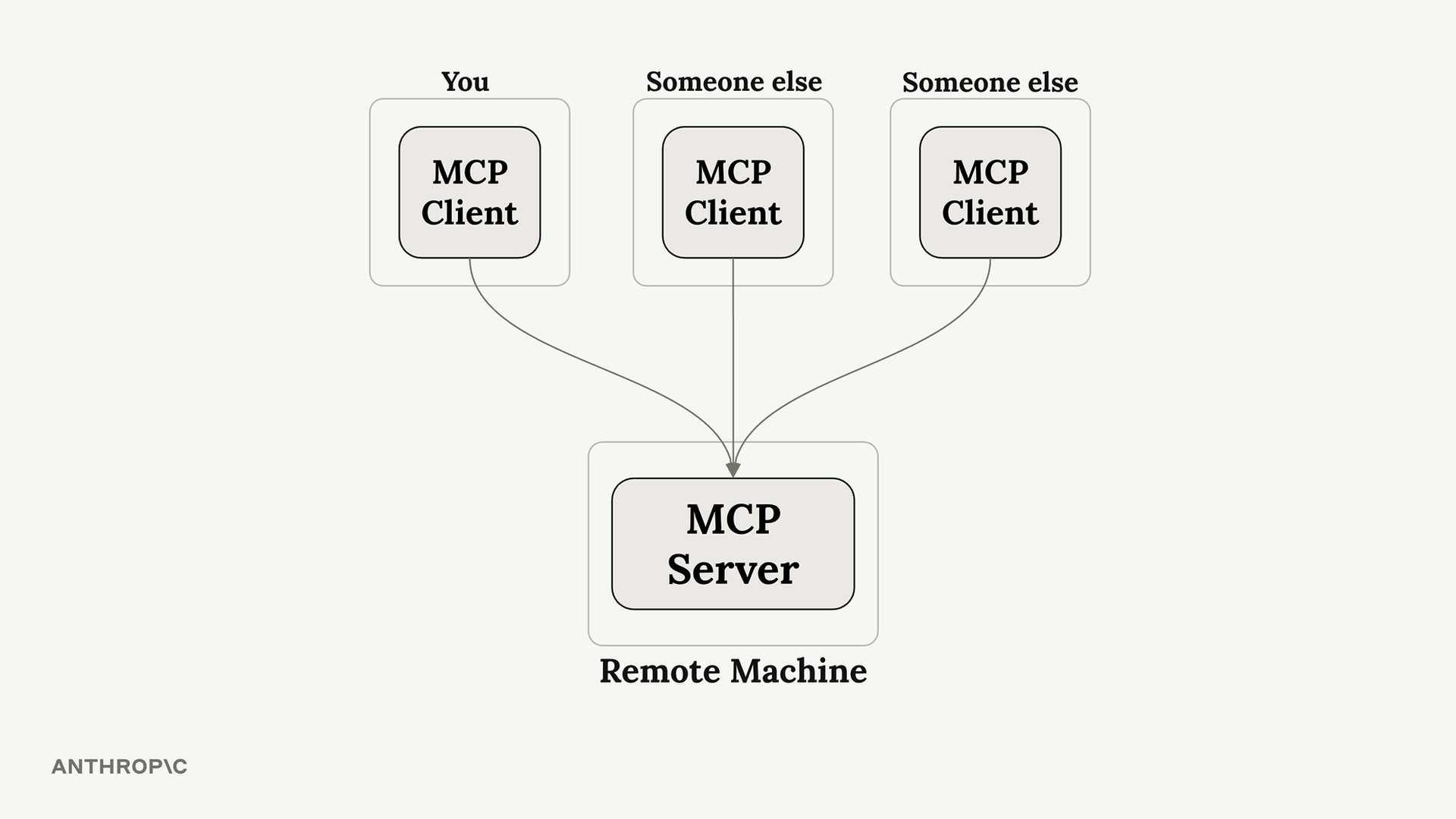

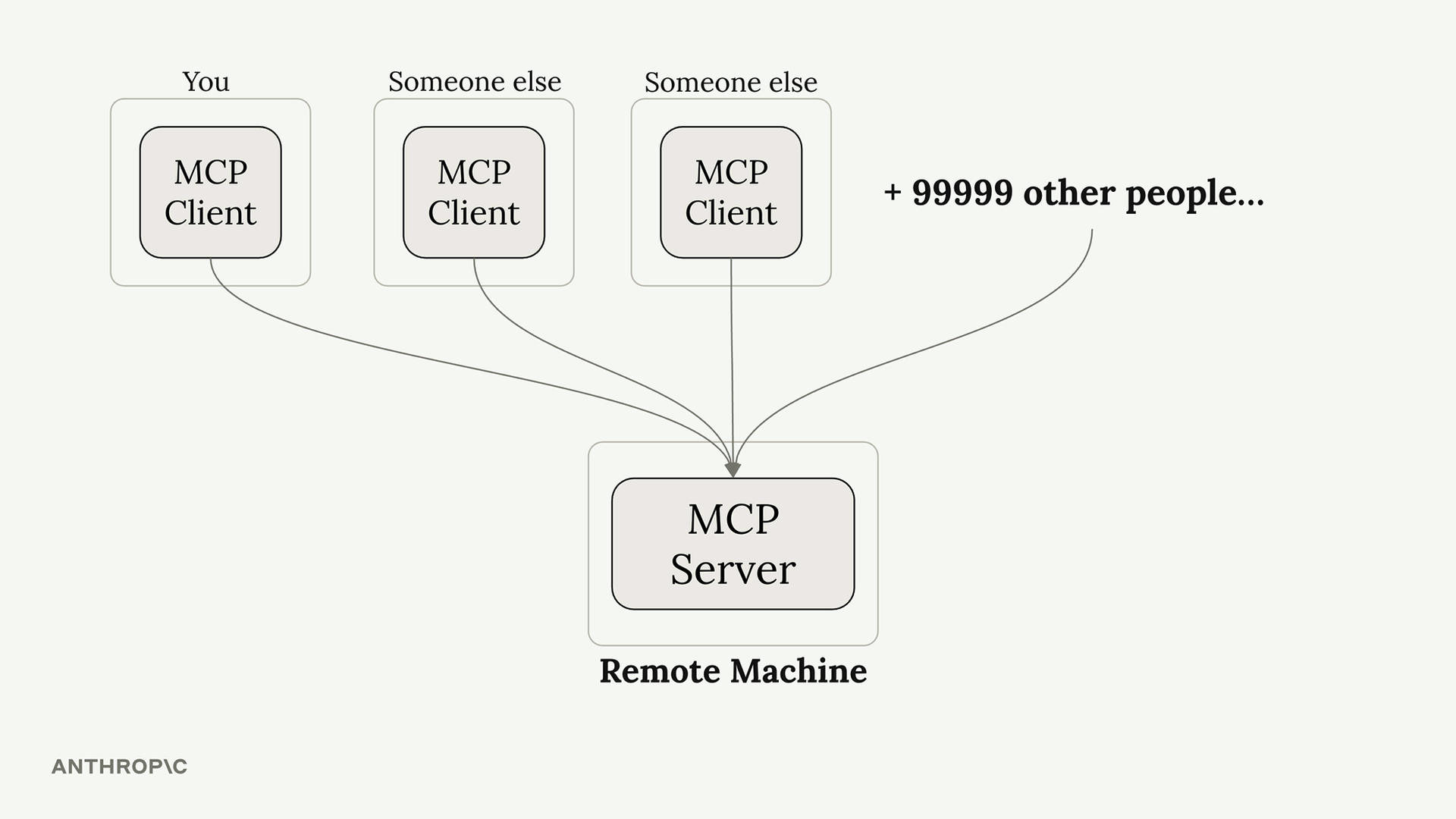

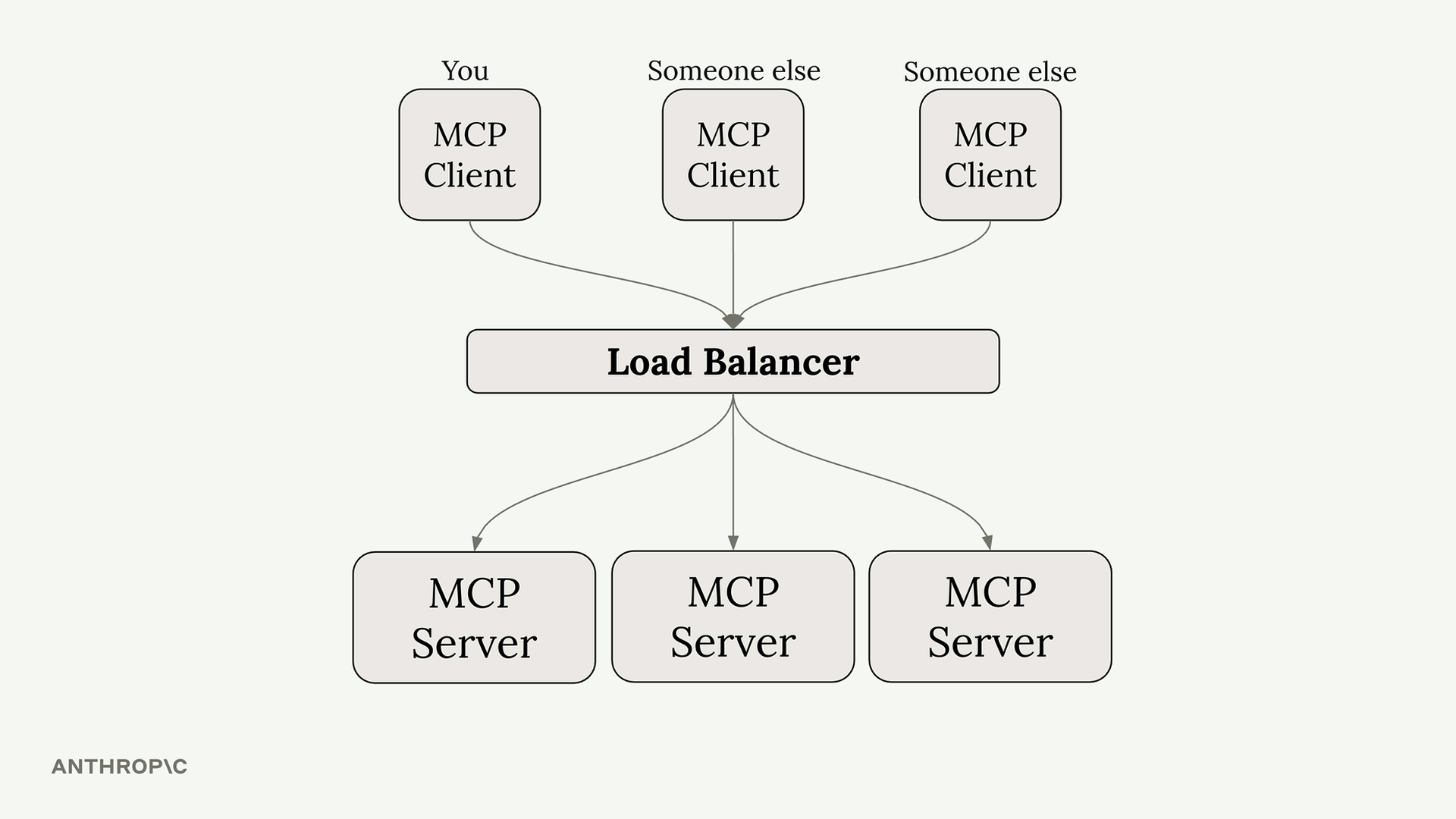

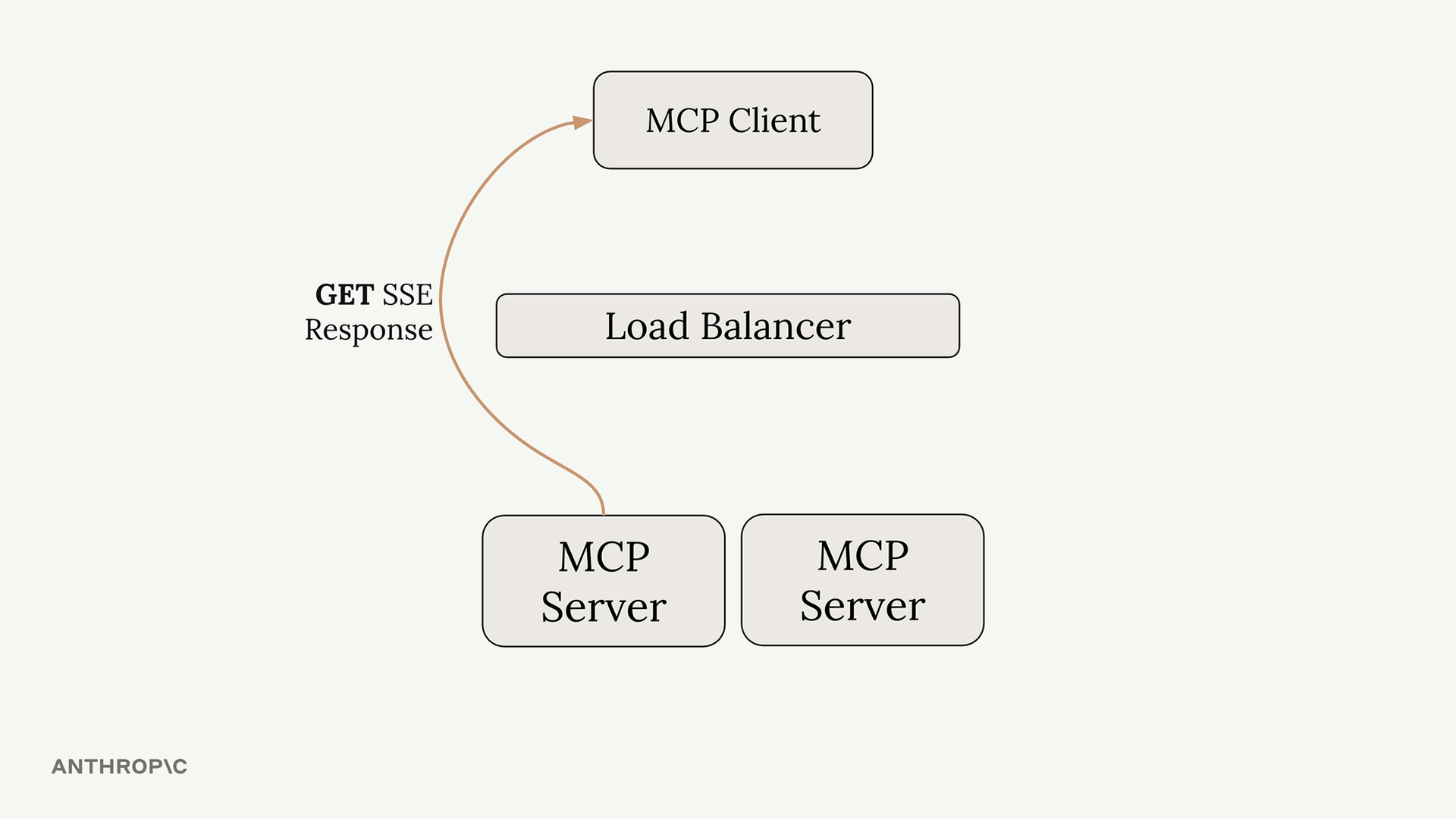

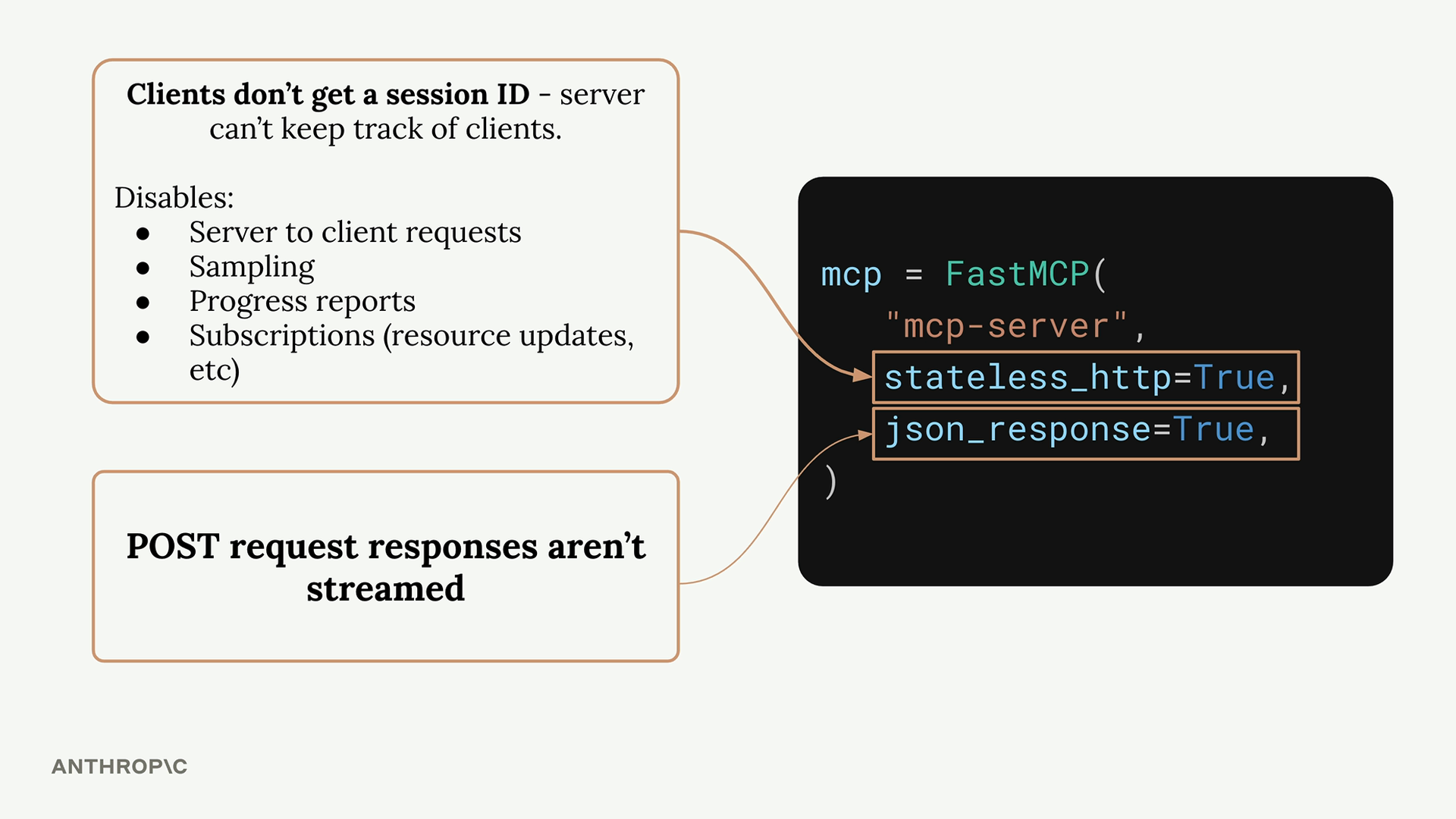

MCP 简介

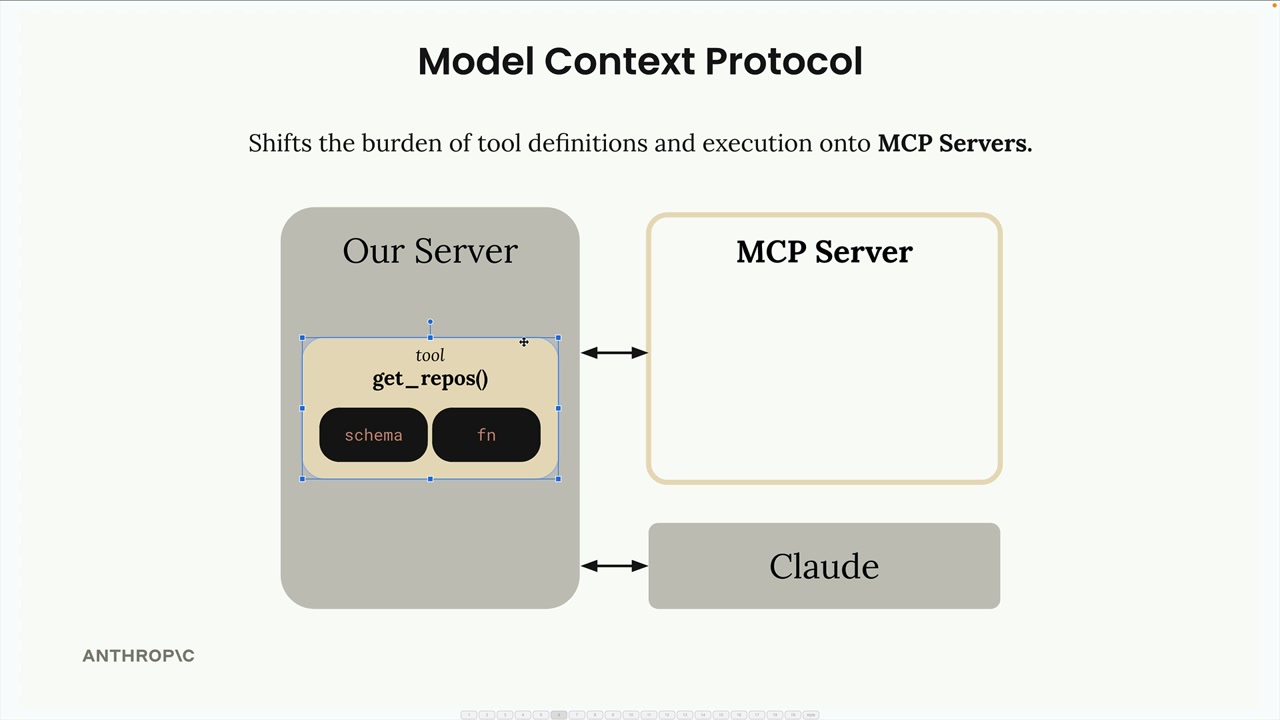

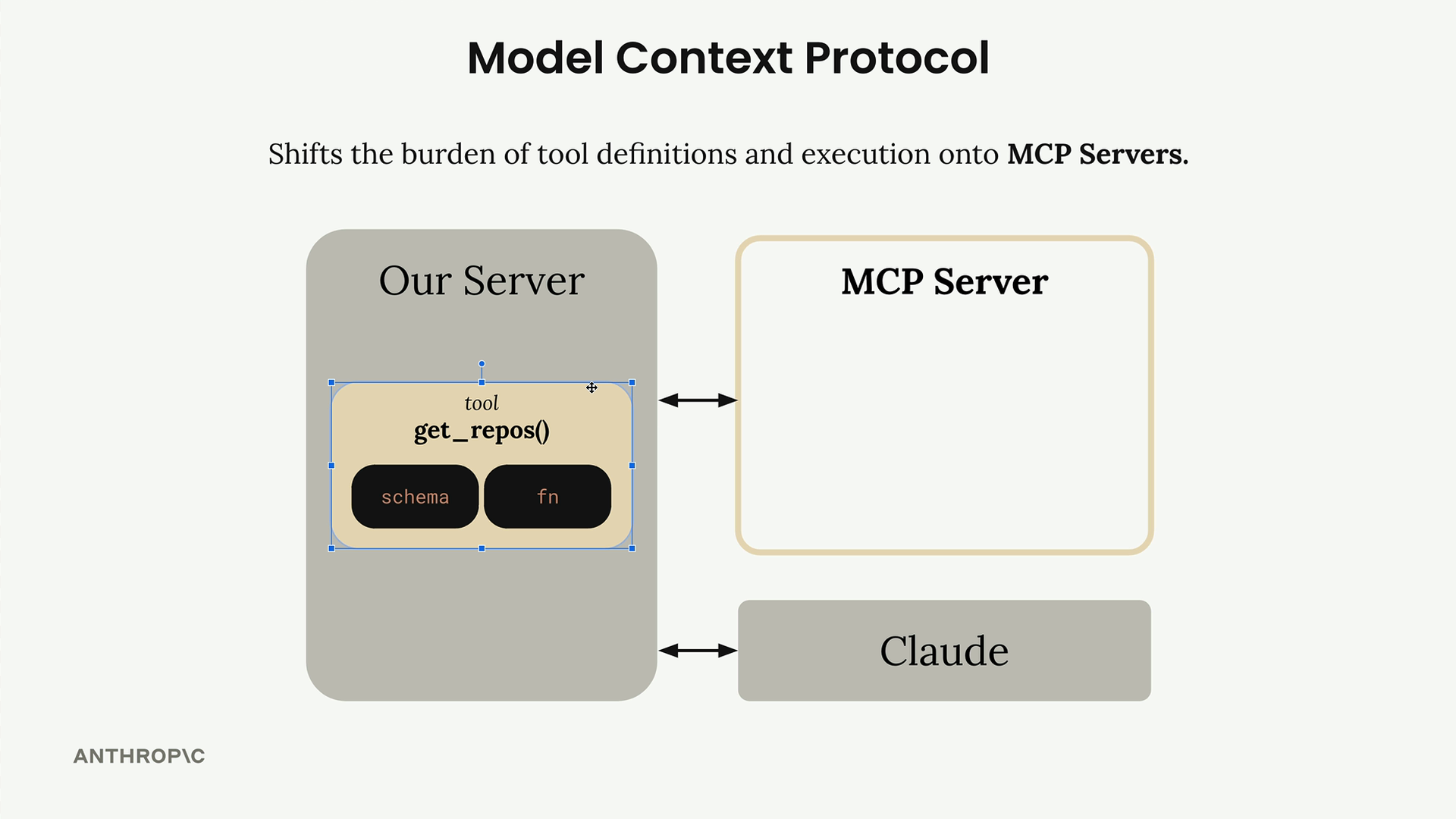

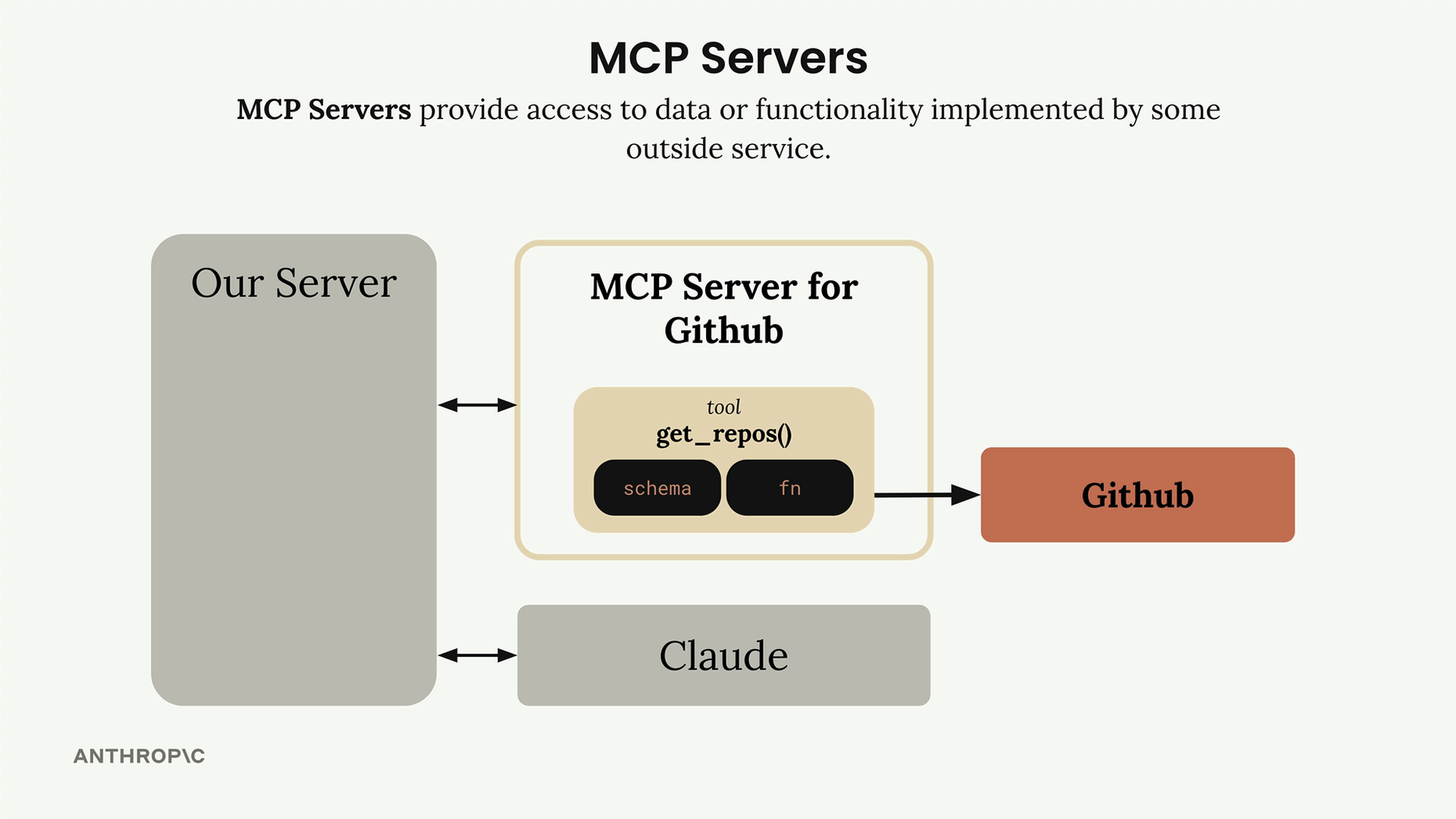

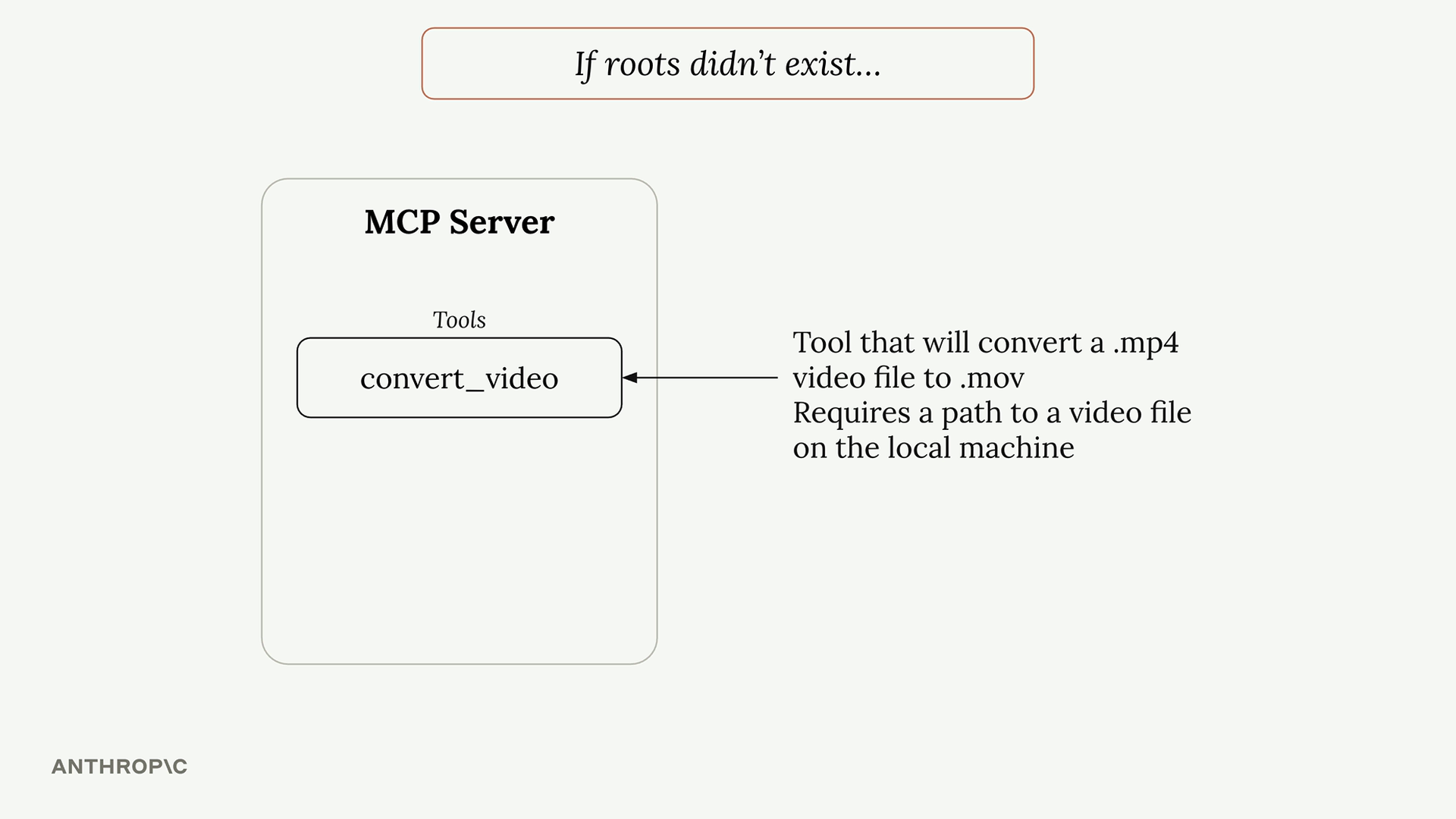

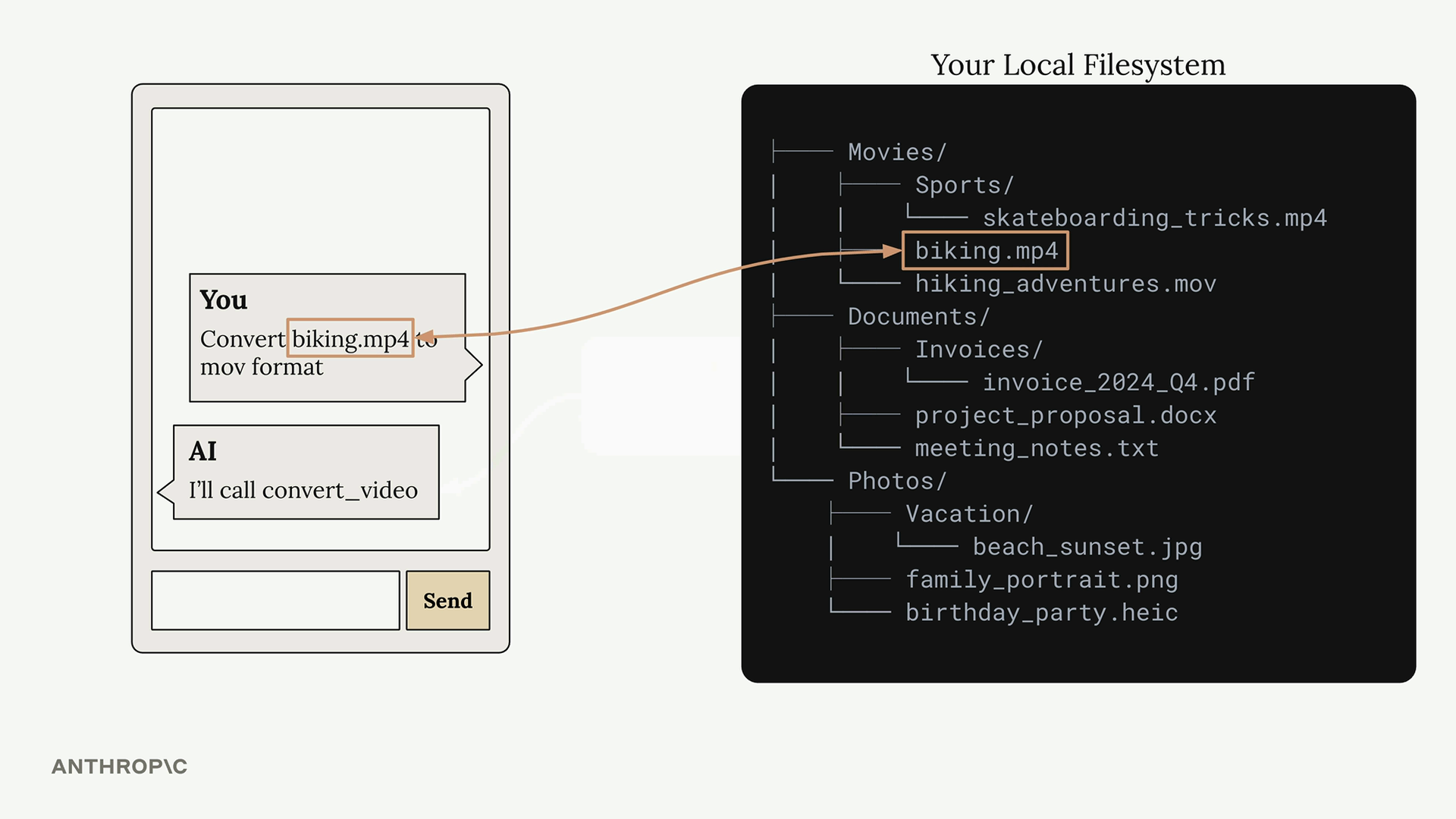

MCP = Model Context Protocol (模型上下文协议),一个通信层,为 Claude 提供上下文和工具,而无需开发者编写繁琐的代码。

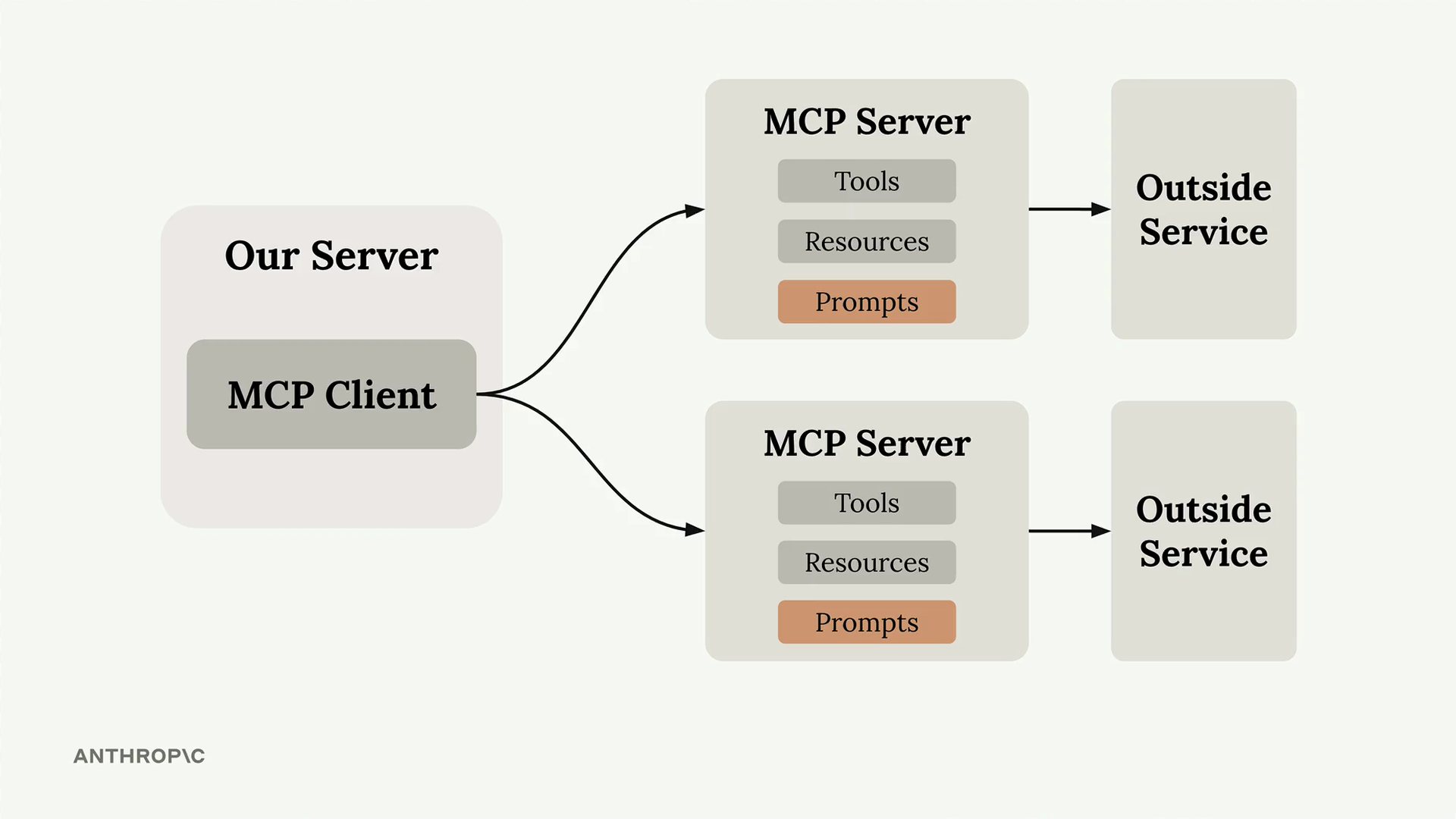

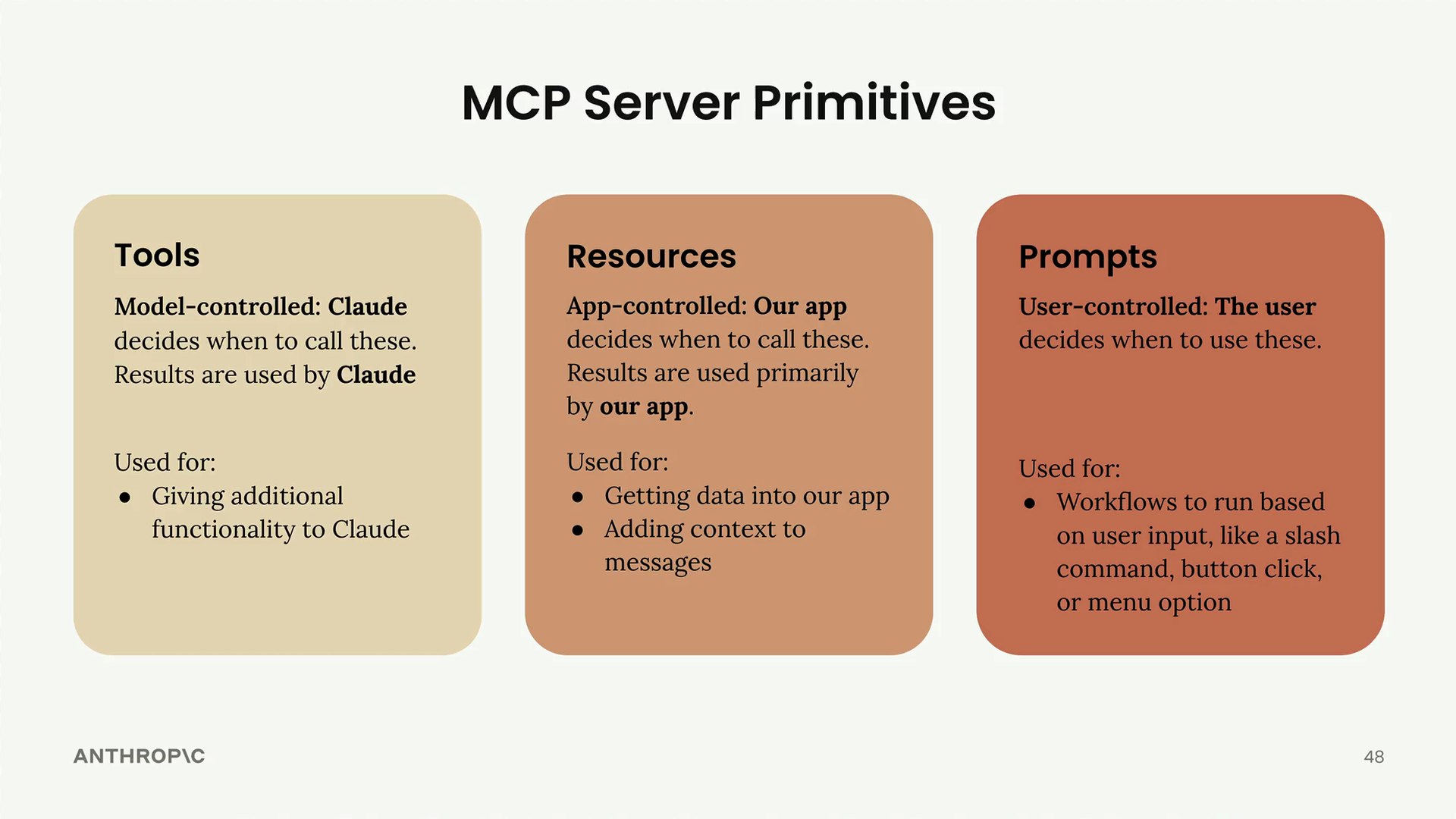

架构:MCP client (MCP 客户端) 连接到 MCP server (MCP 服务器)。服务器内部包含工具、资源和提示词作为组件。

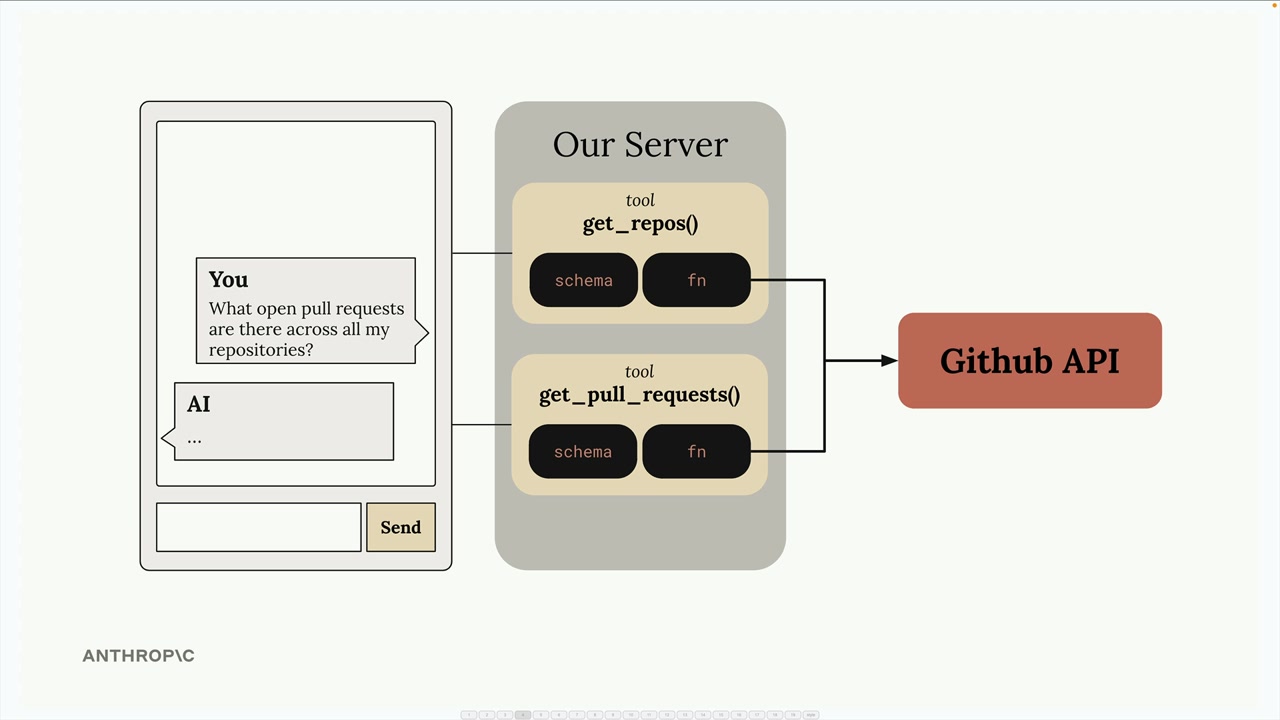

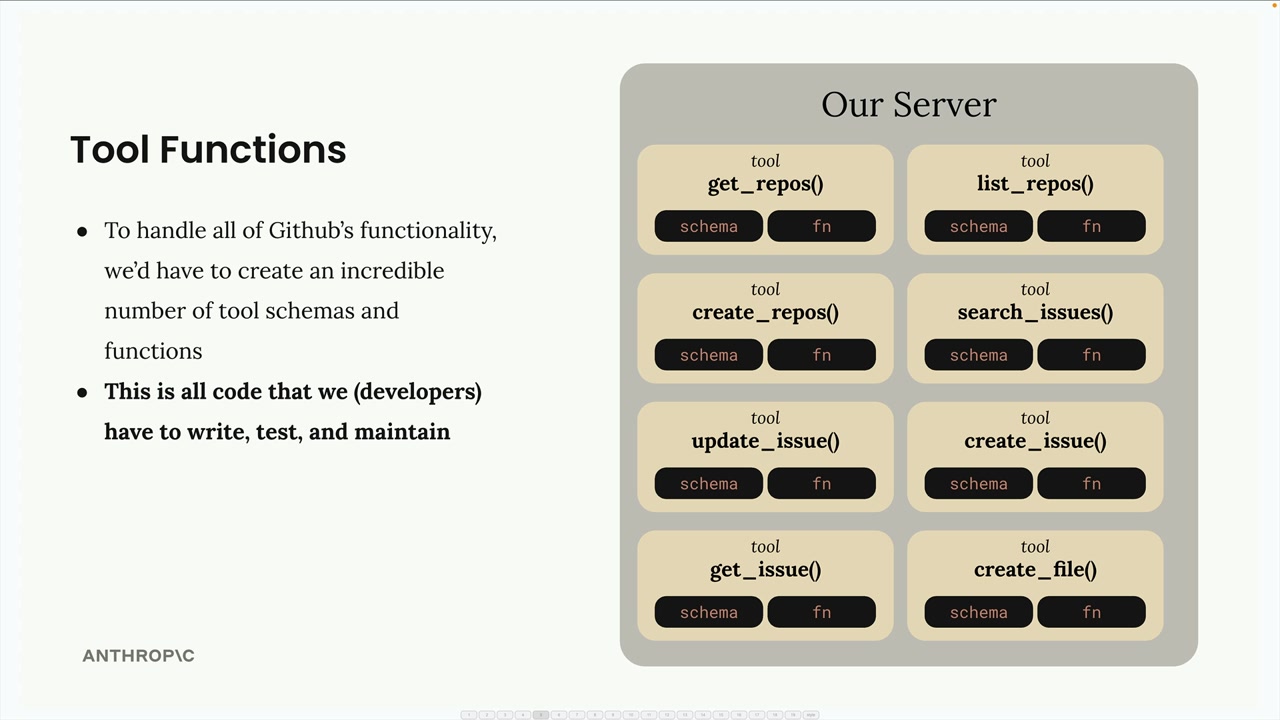

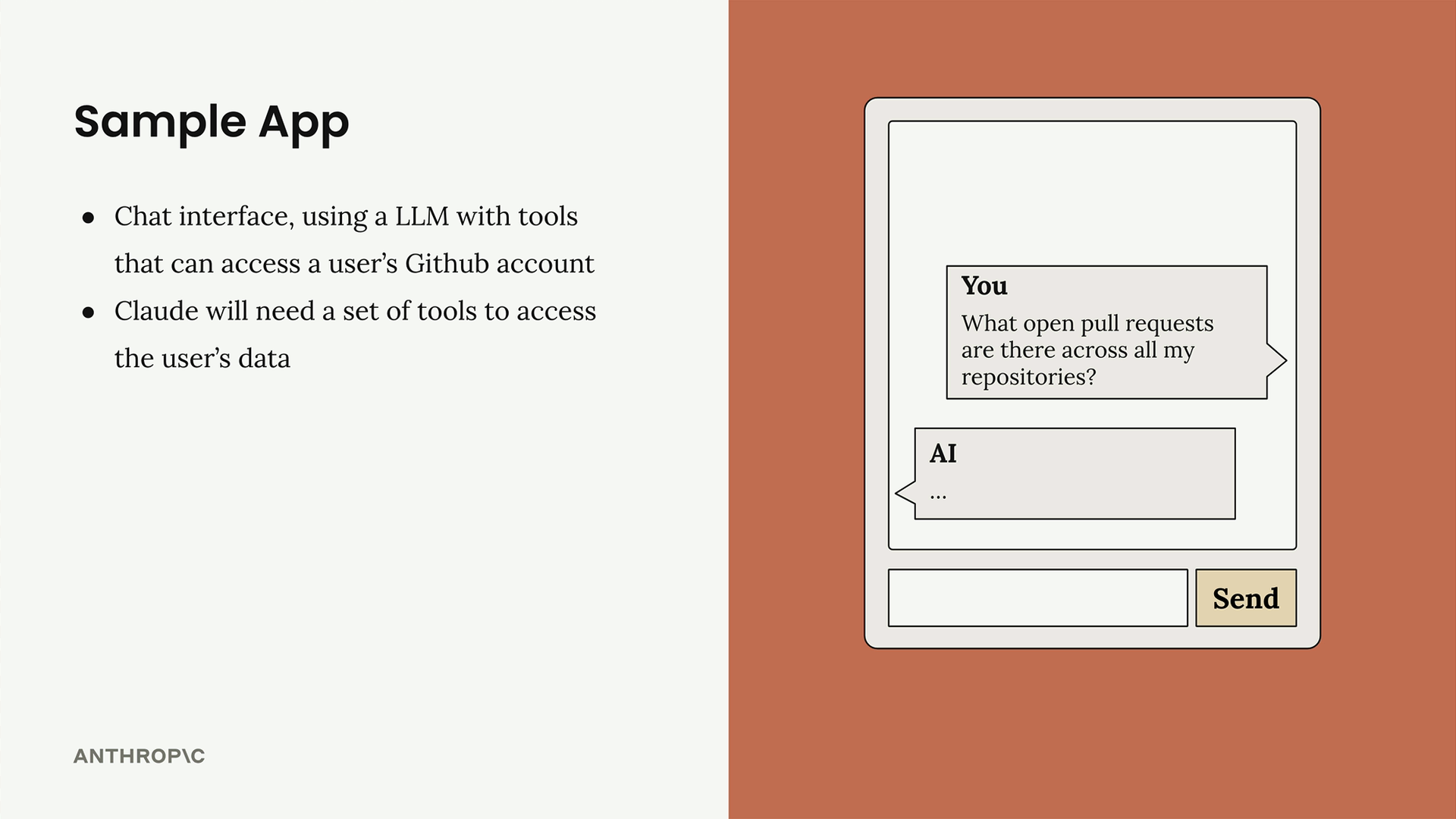

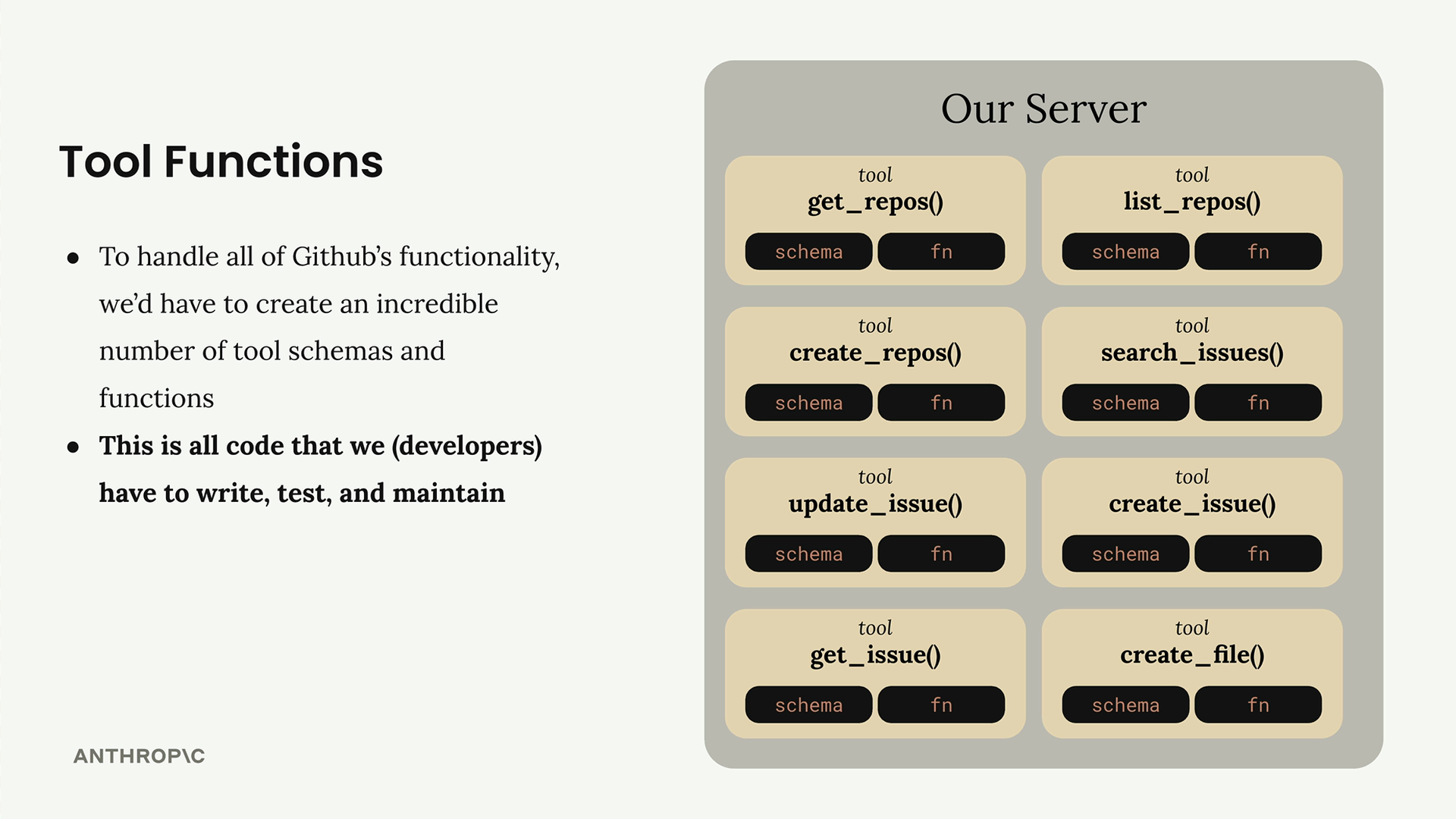

解决的问题:消除了为服务集成编写/维护大量工具模式和函数的负担。例如:一个 GitHub 聊天机器人将需要实现用于仓库、拉取请求、问题、项目的工具——这需要大量的开发者工作。

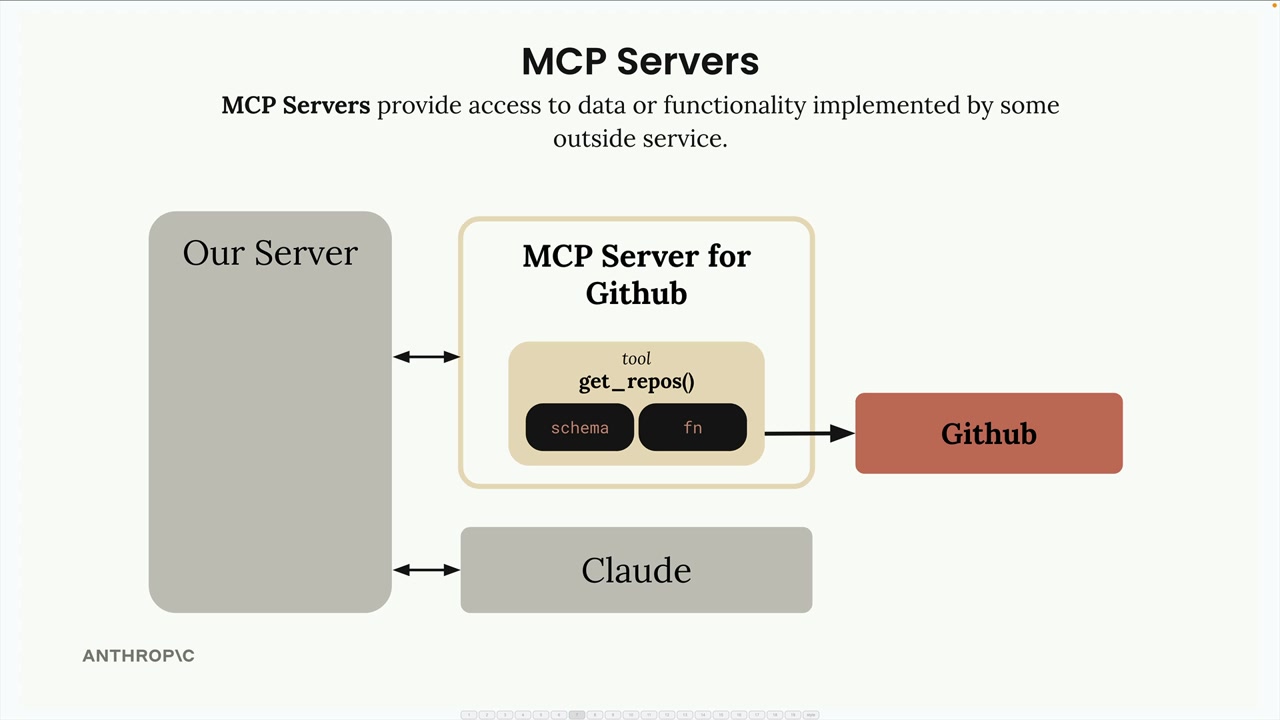

解决方案:由 MCP 服务器处理工具的定义和执行,而不是你的应用程序服务器。MCP 服务器 = 外部服务的接口,将功能包装成即用型工具。

主要优点:开发者无需亲自编写工具模式和函数实现。

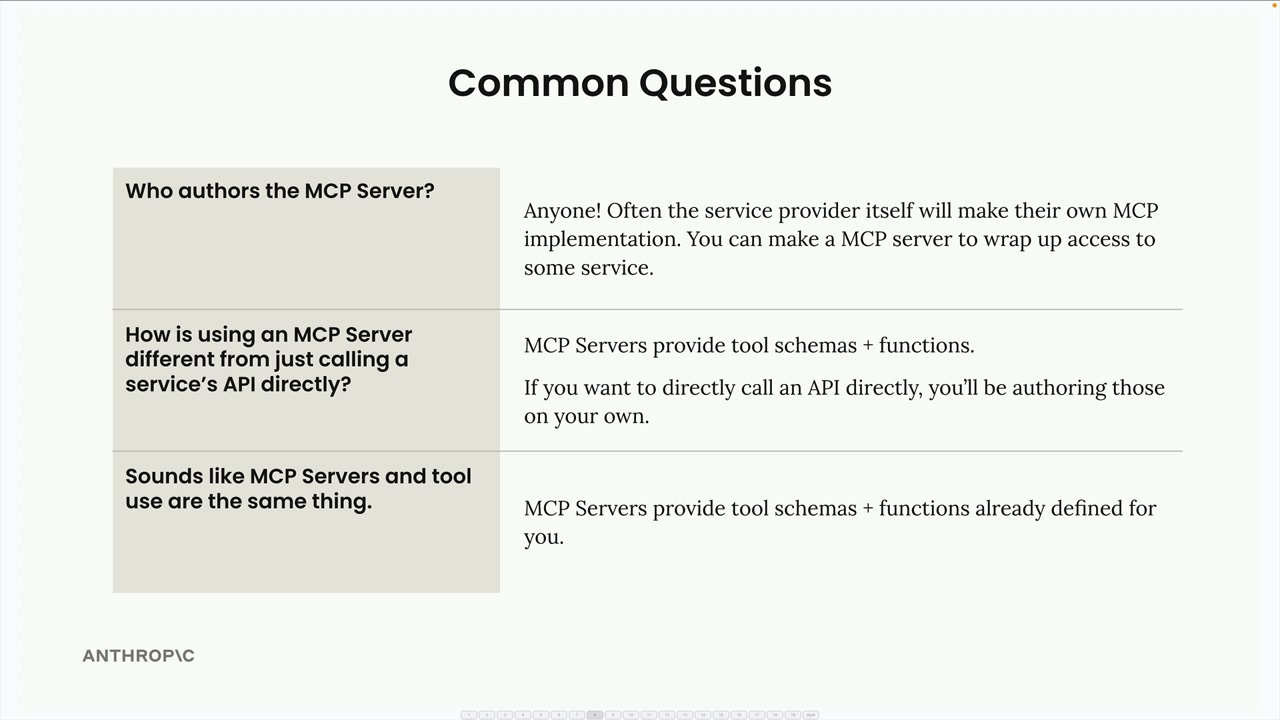

常见问题:

- 谁创建

MCP服务器?任何人都可以,通常服务提供商会提供官方实现(如 AWS 等)。 - 与直接 API 调用相比?

MCP免去了你亲自编写工具模式/函数的需要。 - 与工具调用相比?

MCP和工具调用是互补的——MCP处理由谁来完成工作(服务器 vs 开发者),但两者都涉及工具。

核心价值:将集成负担从应用程序开发者转移到 MCP 服务器维护者。

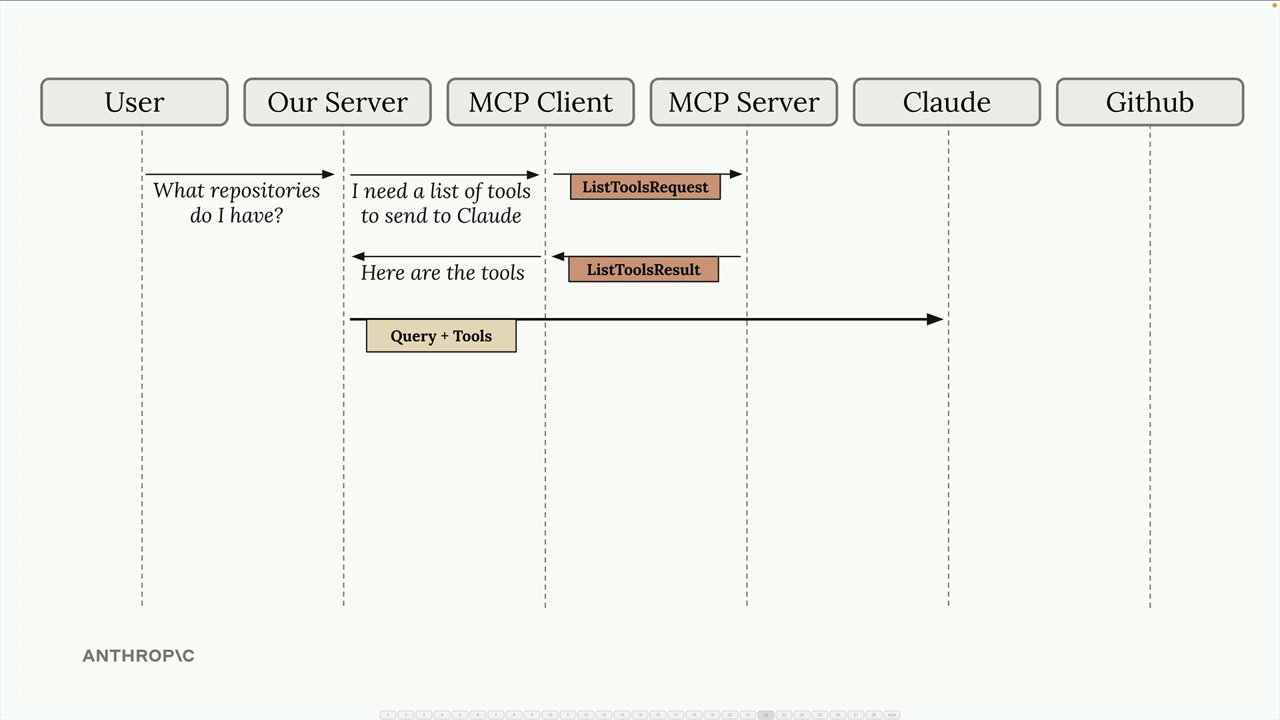

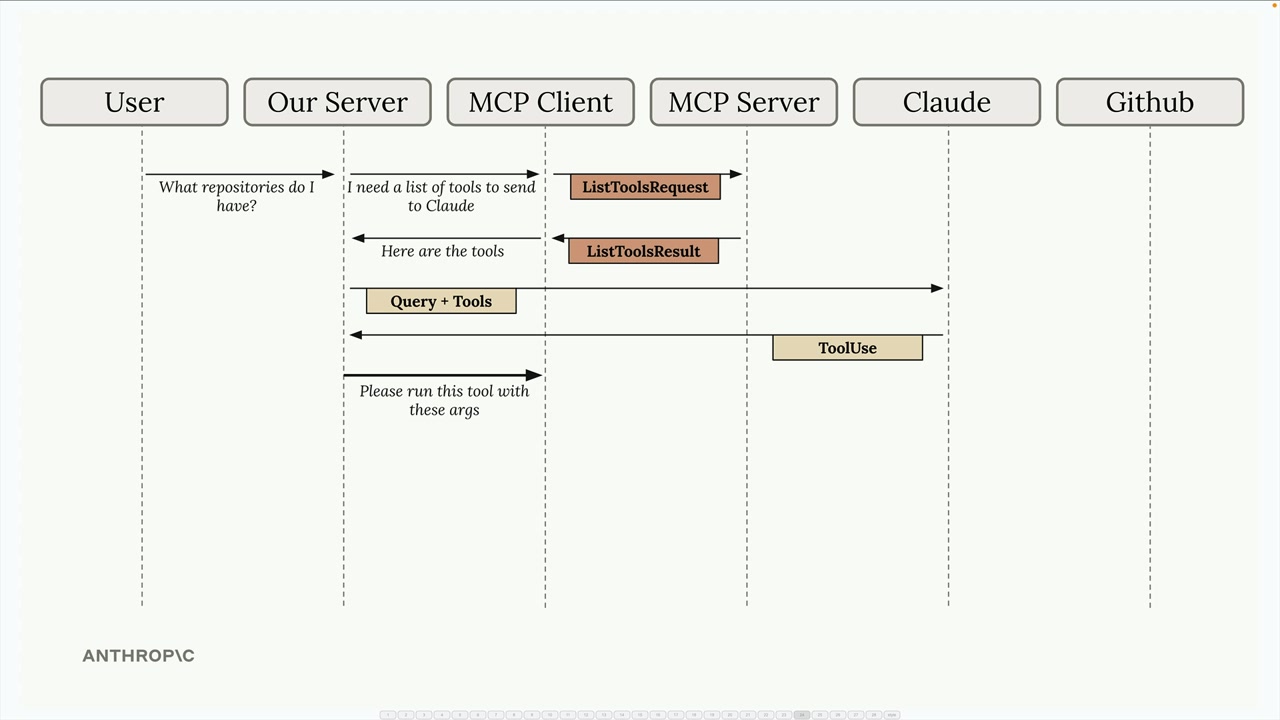

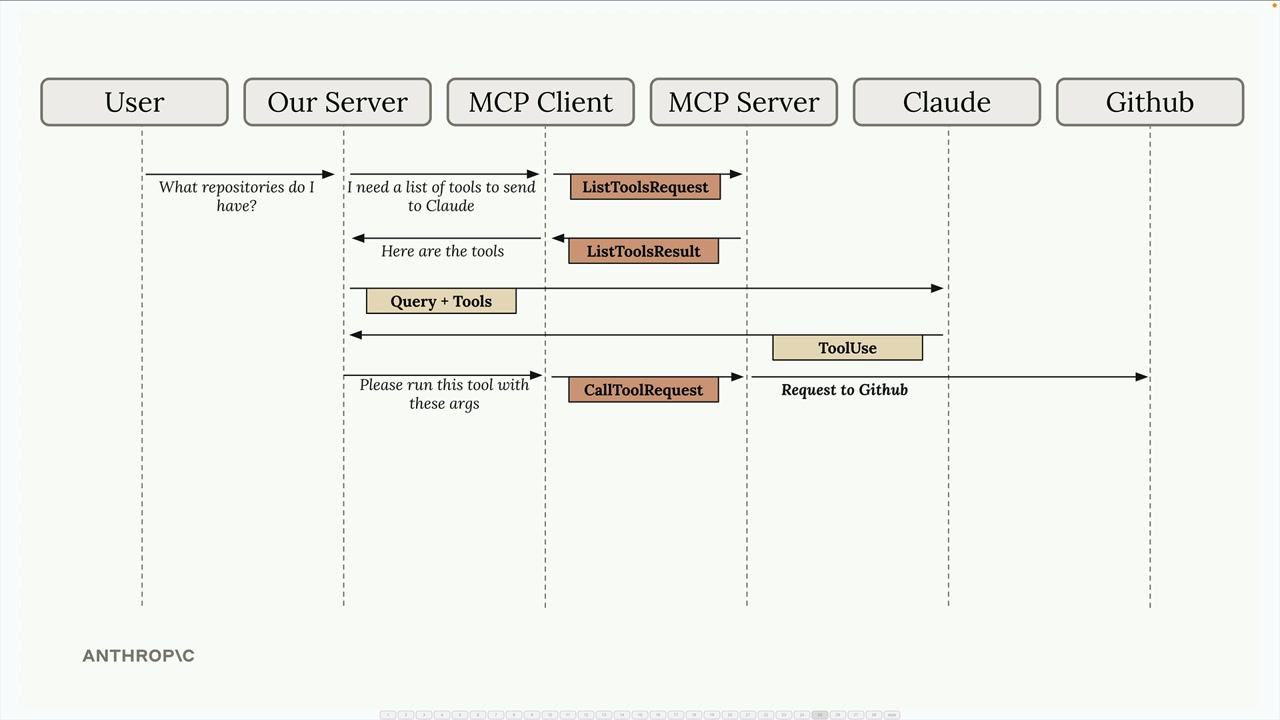

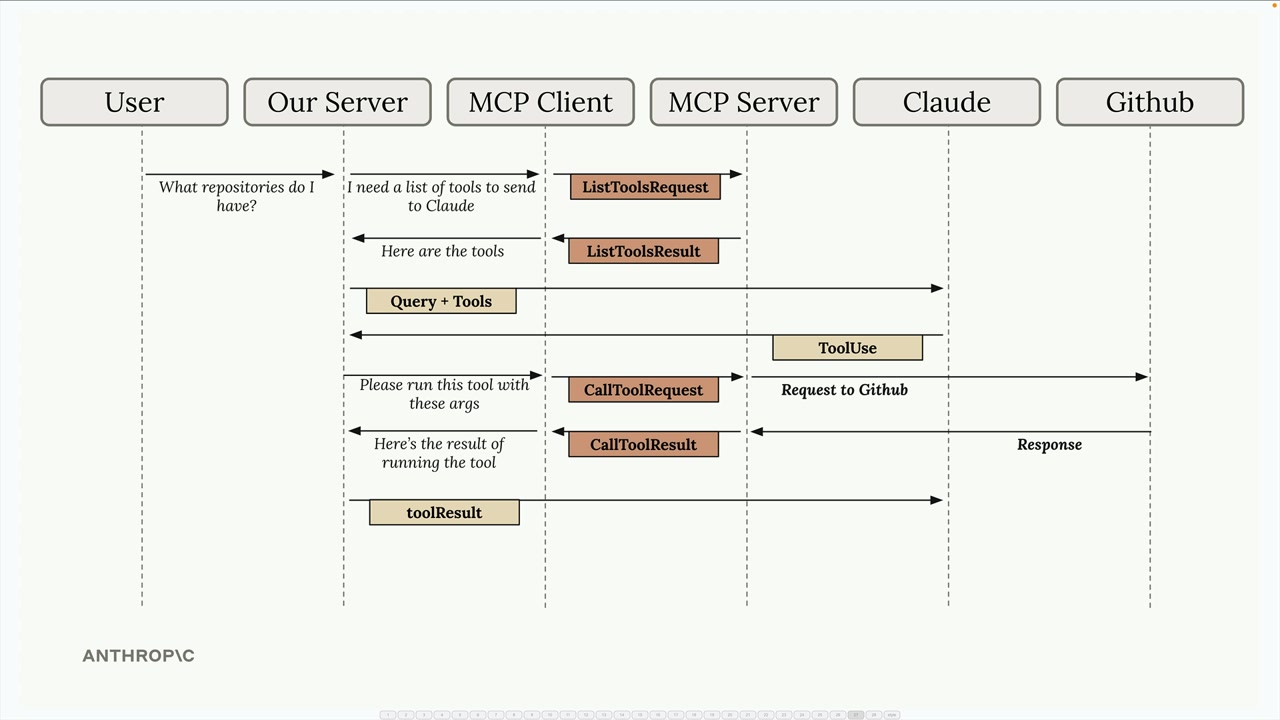

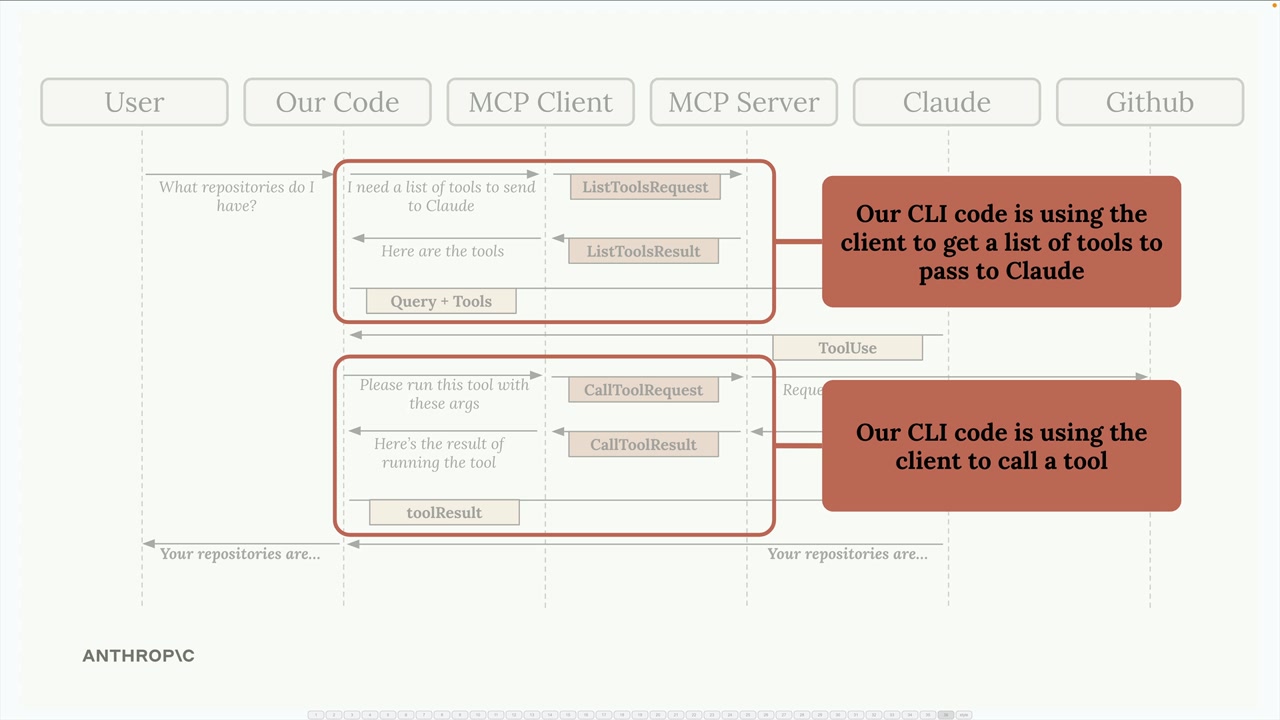

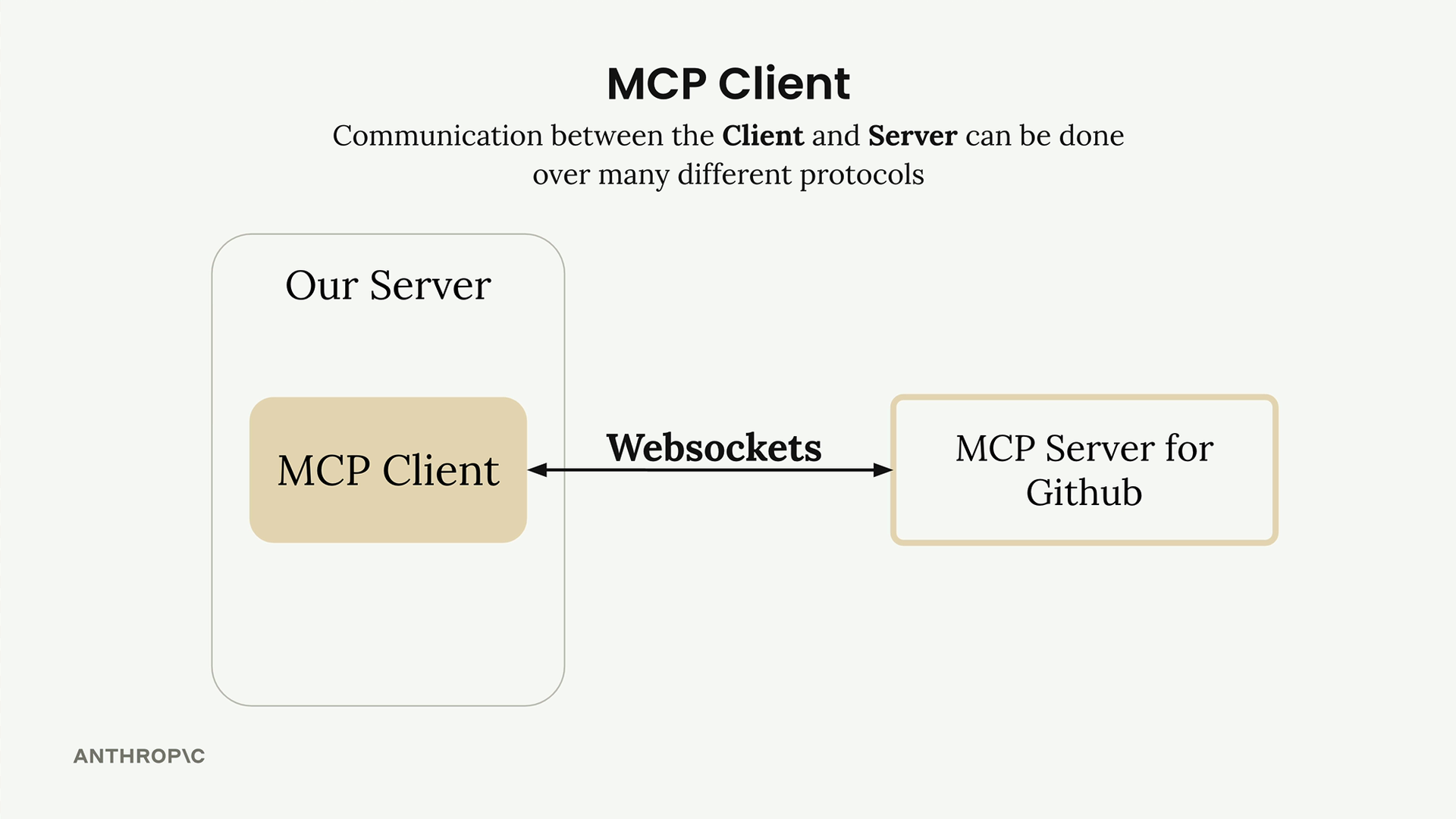

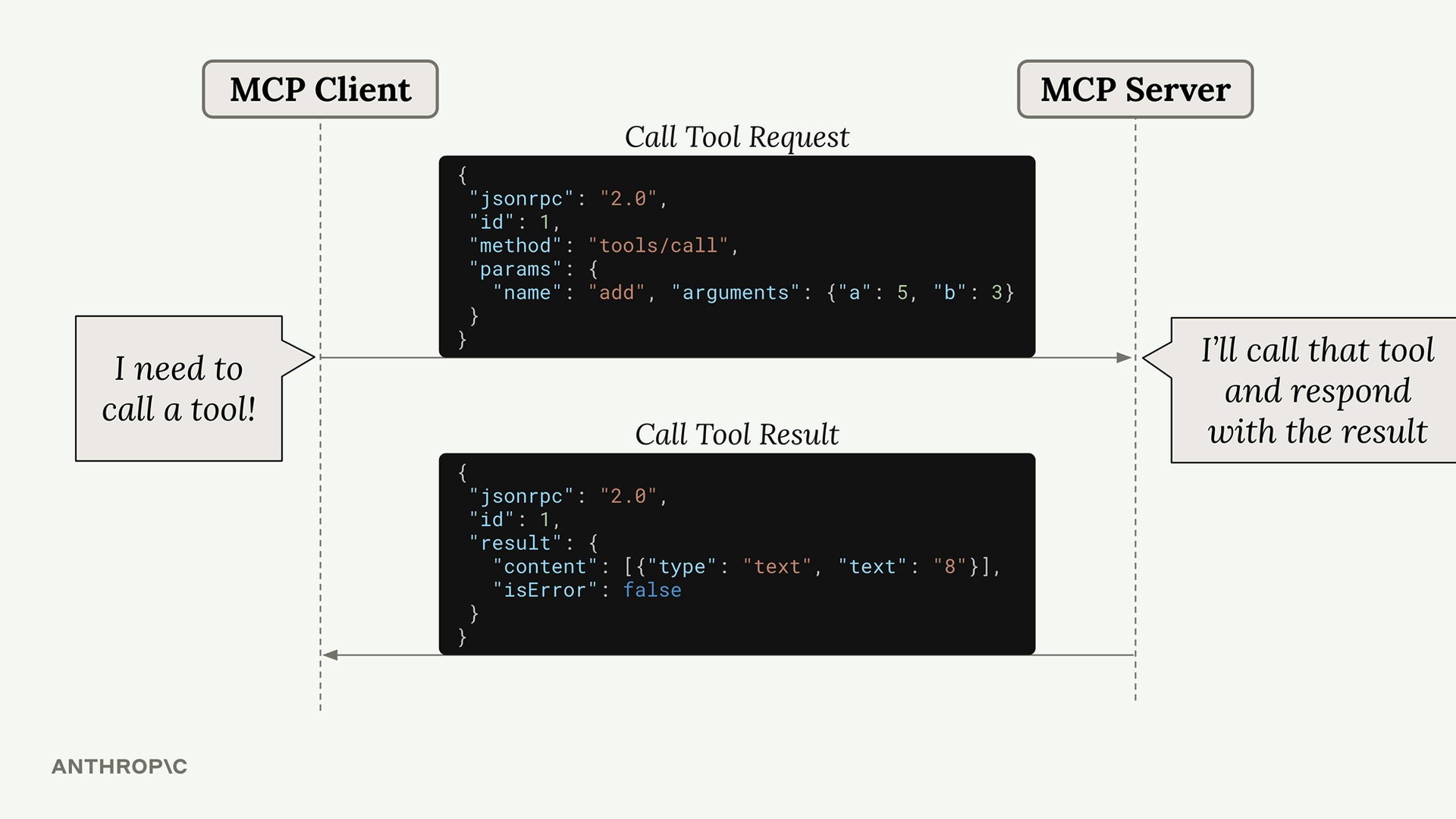

MCP 客户端

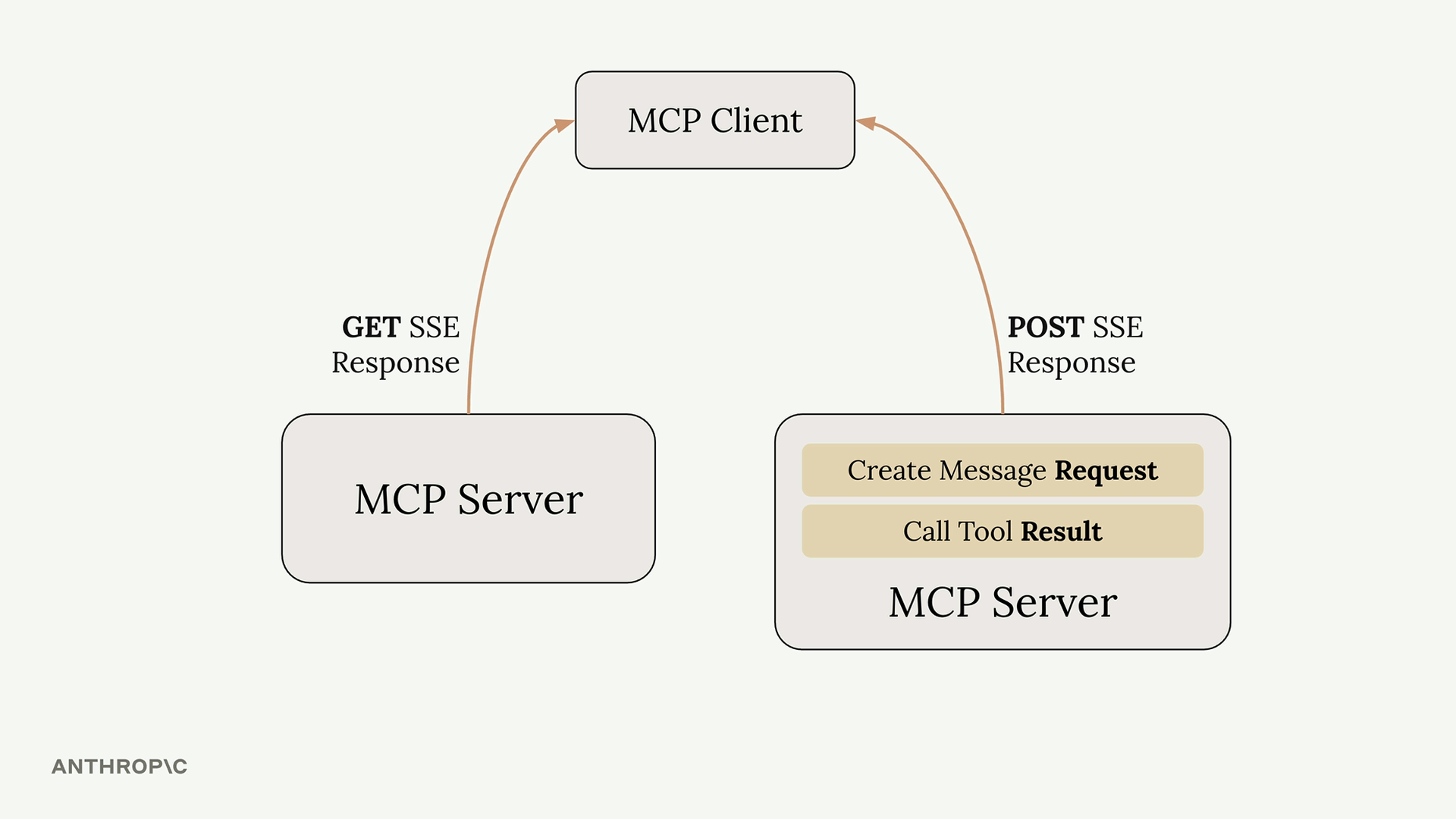

MCP Client = MCP 客户端,是你的服务器与 MCP 服务器之间的通信接口,提供了对服务器工具的访问。

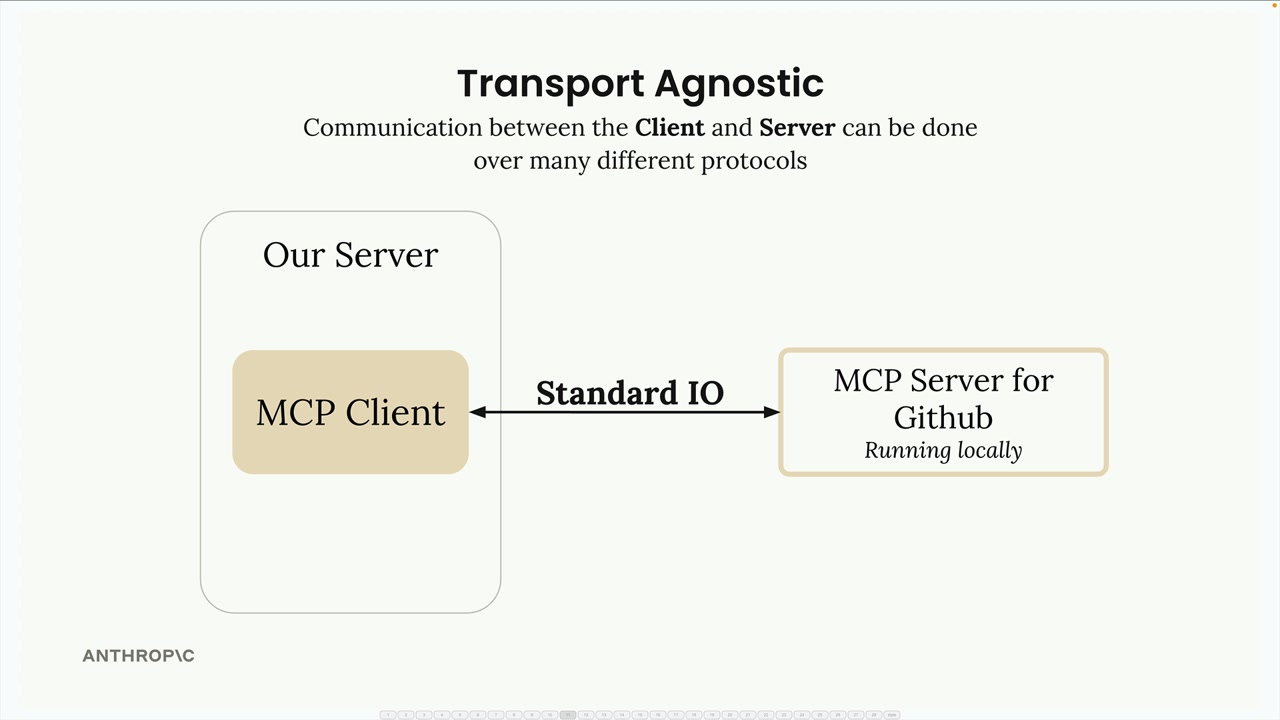

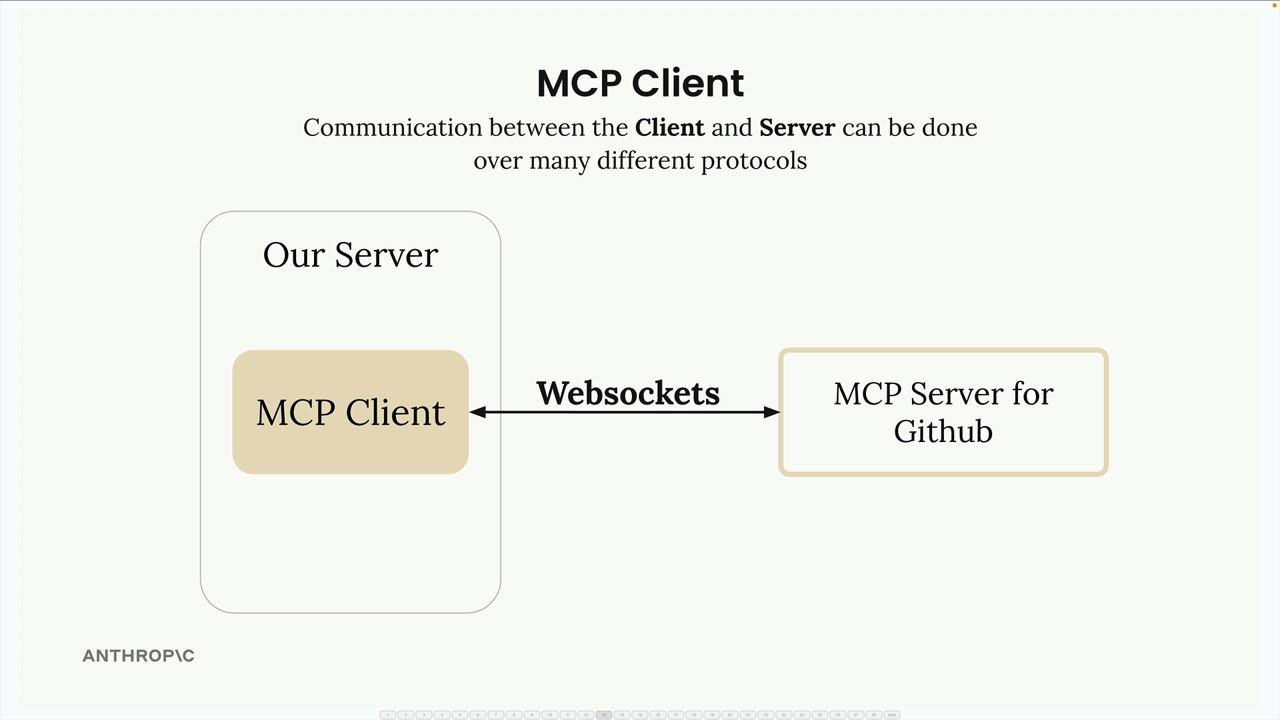

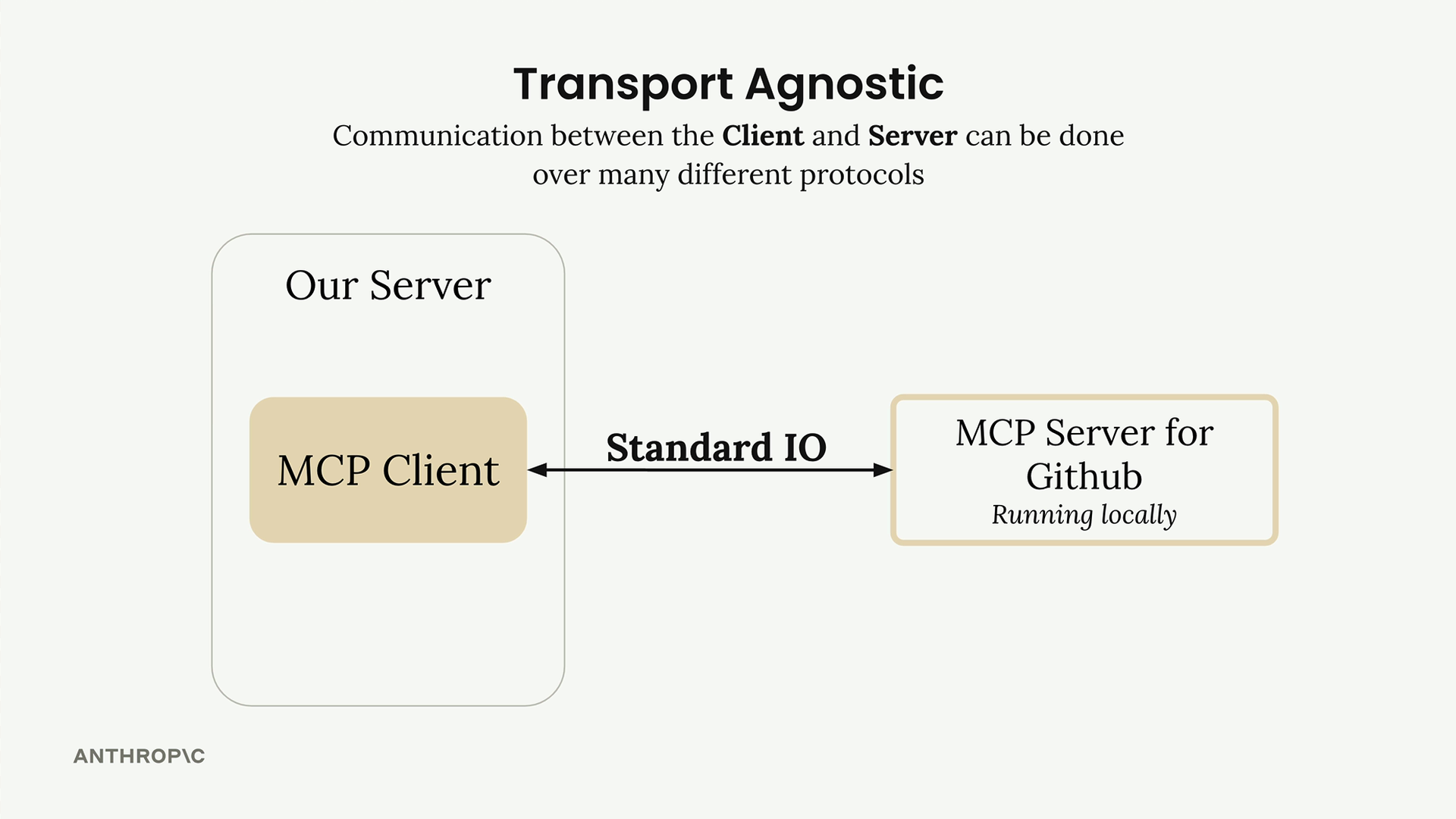

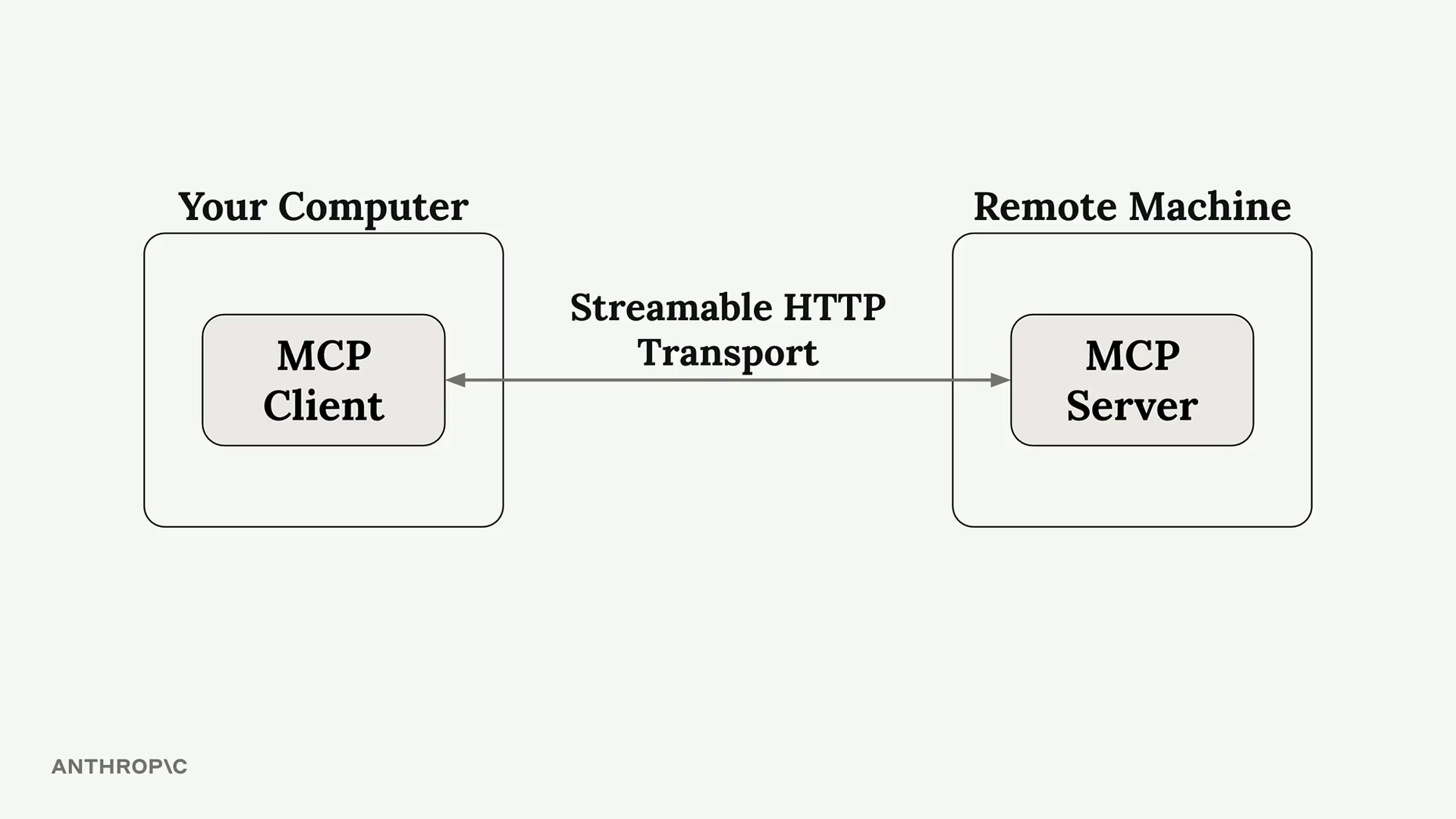

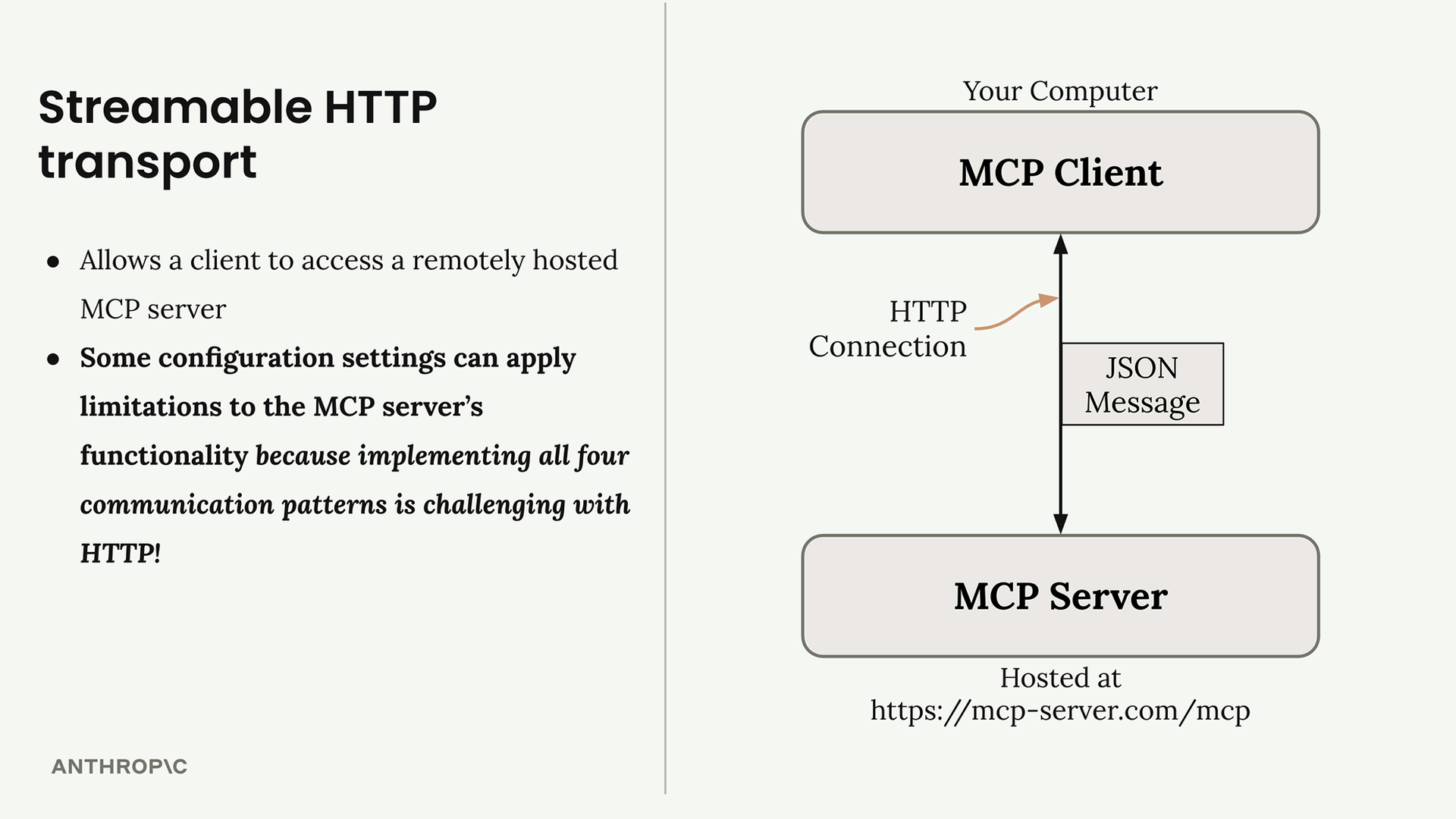

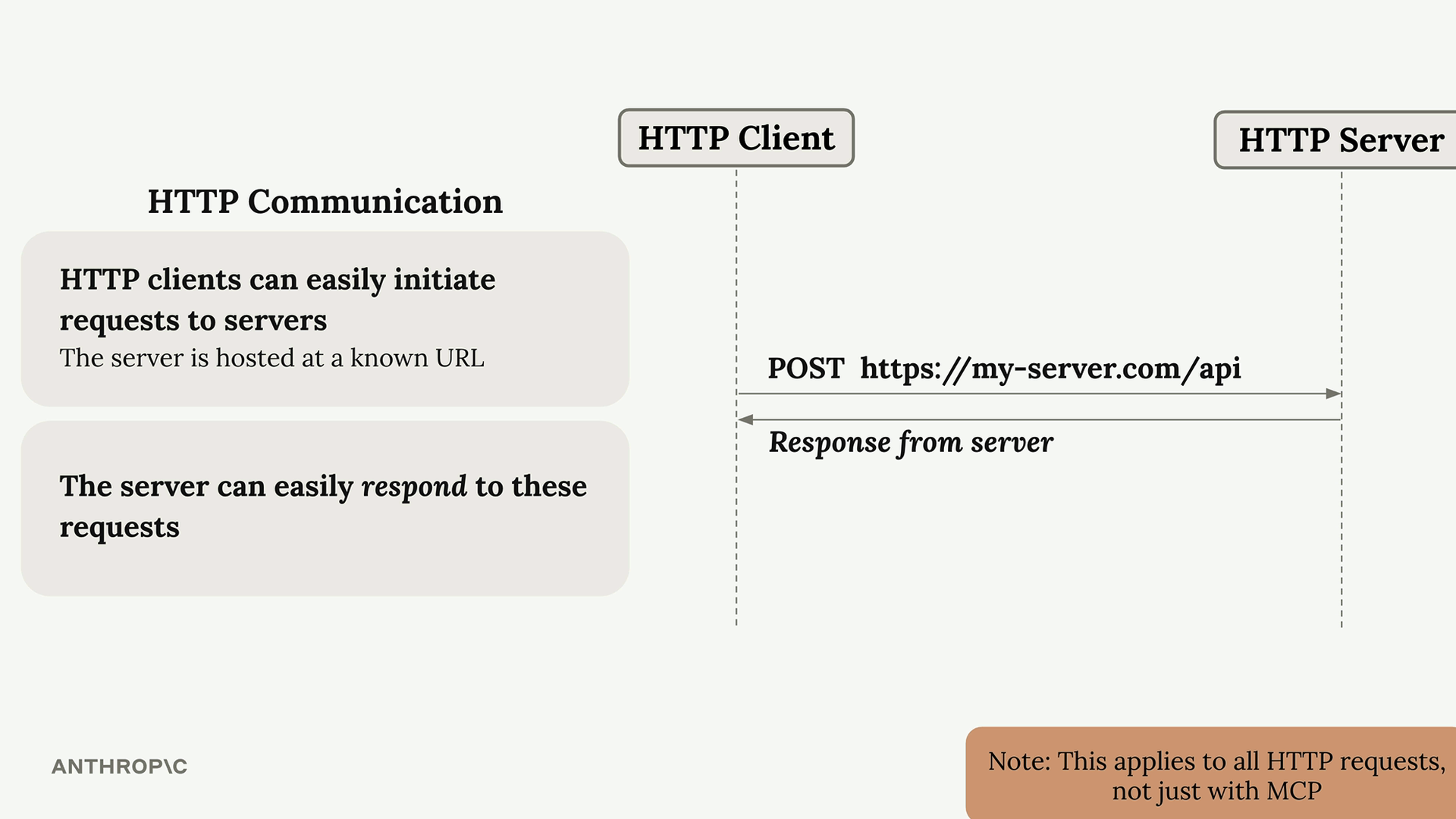

传输无关 = 客户端/服务器可以通过多种协议(stdio、HTTP、WebSockets)进行通信。

常见设置 = 客户端和服务器在同一台机器上,使用标准输入/输出。

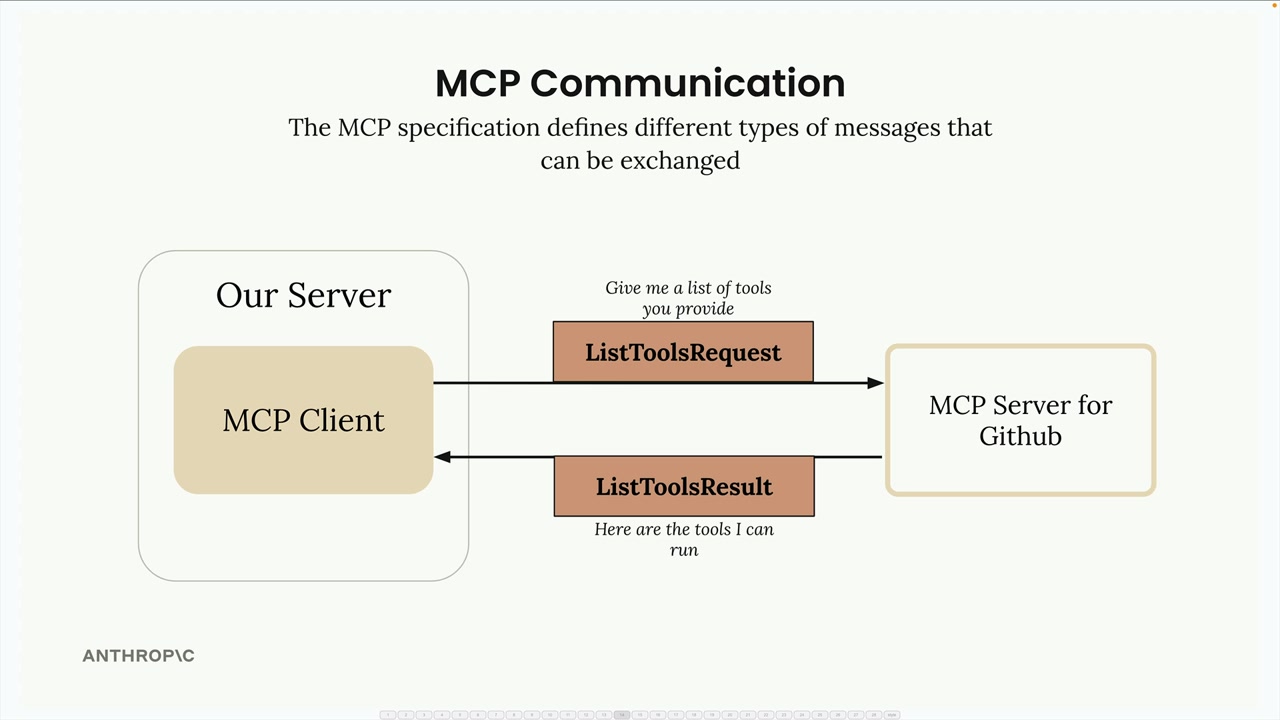

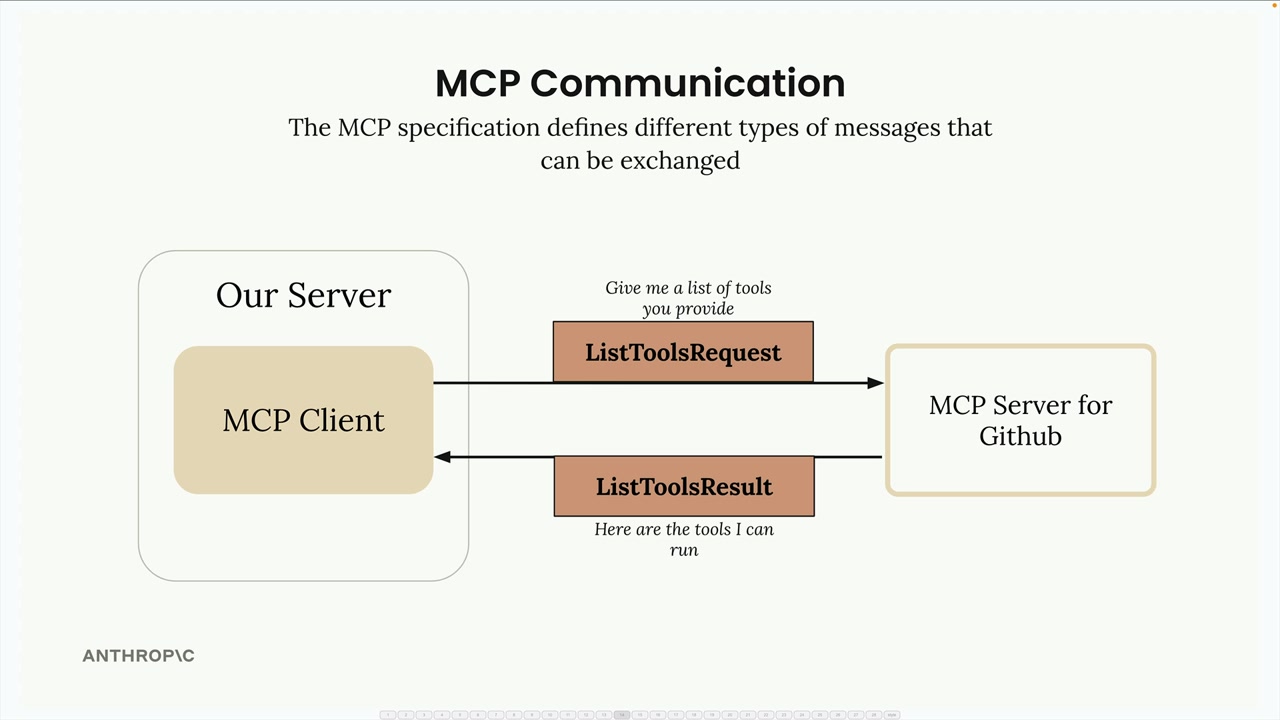

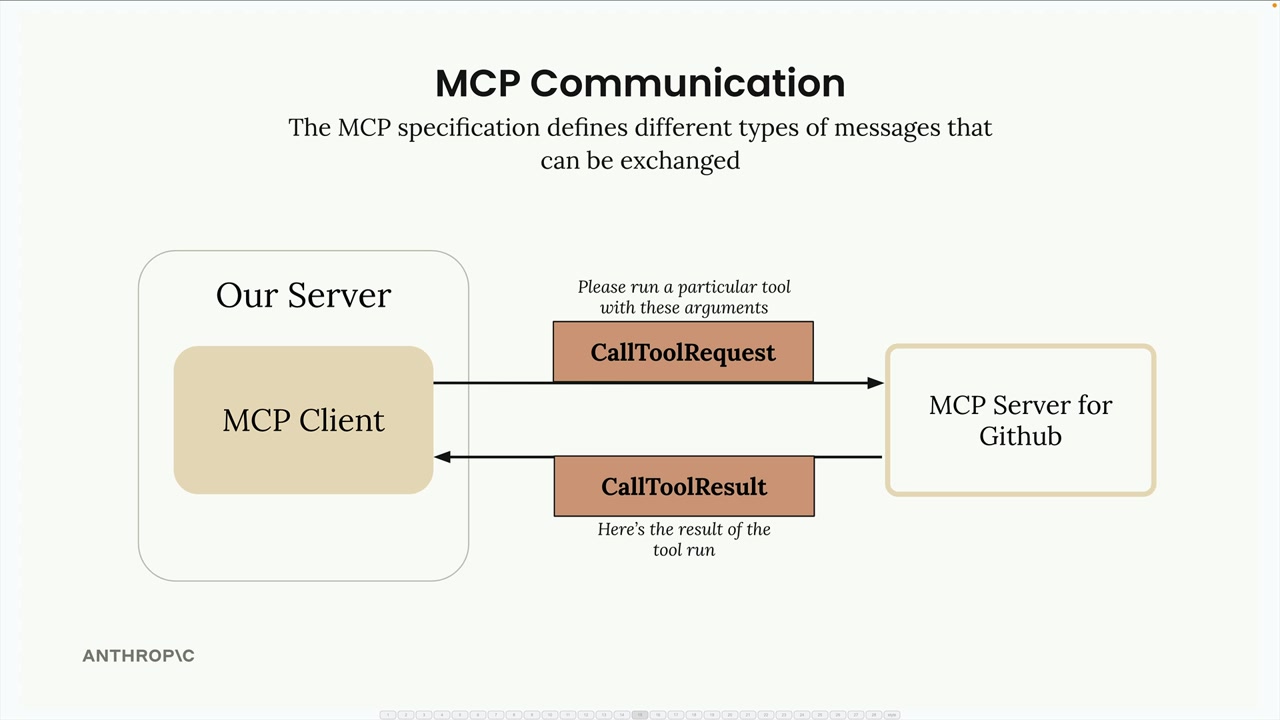

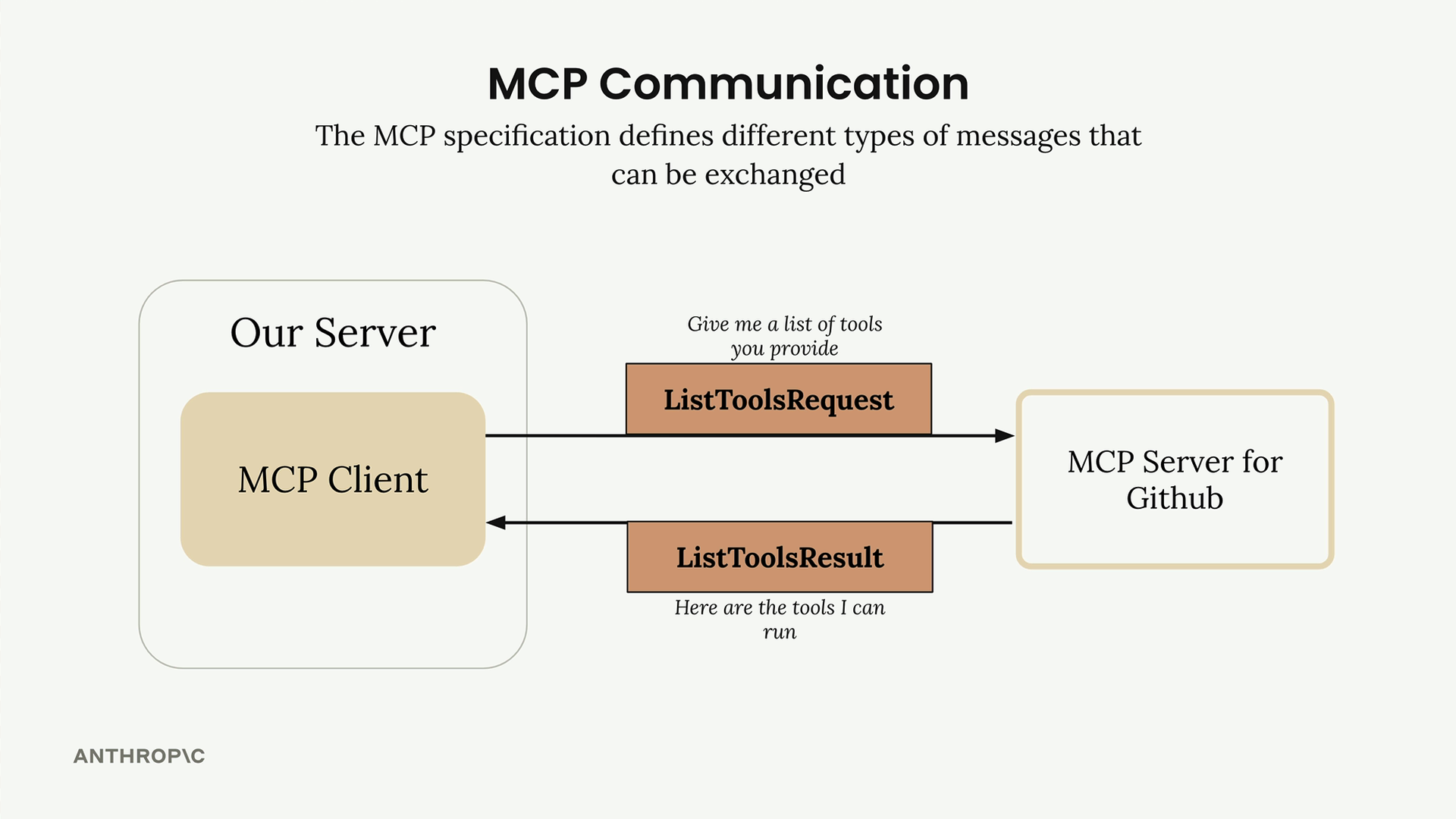

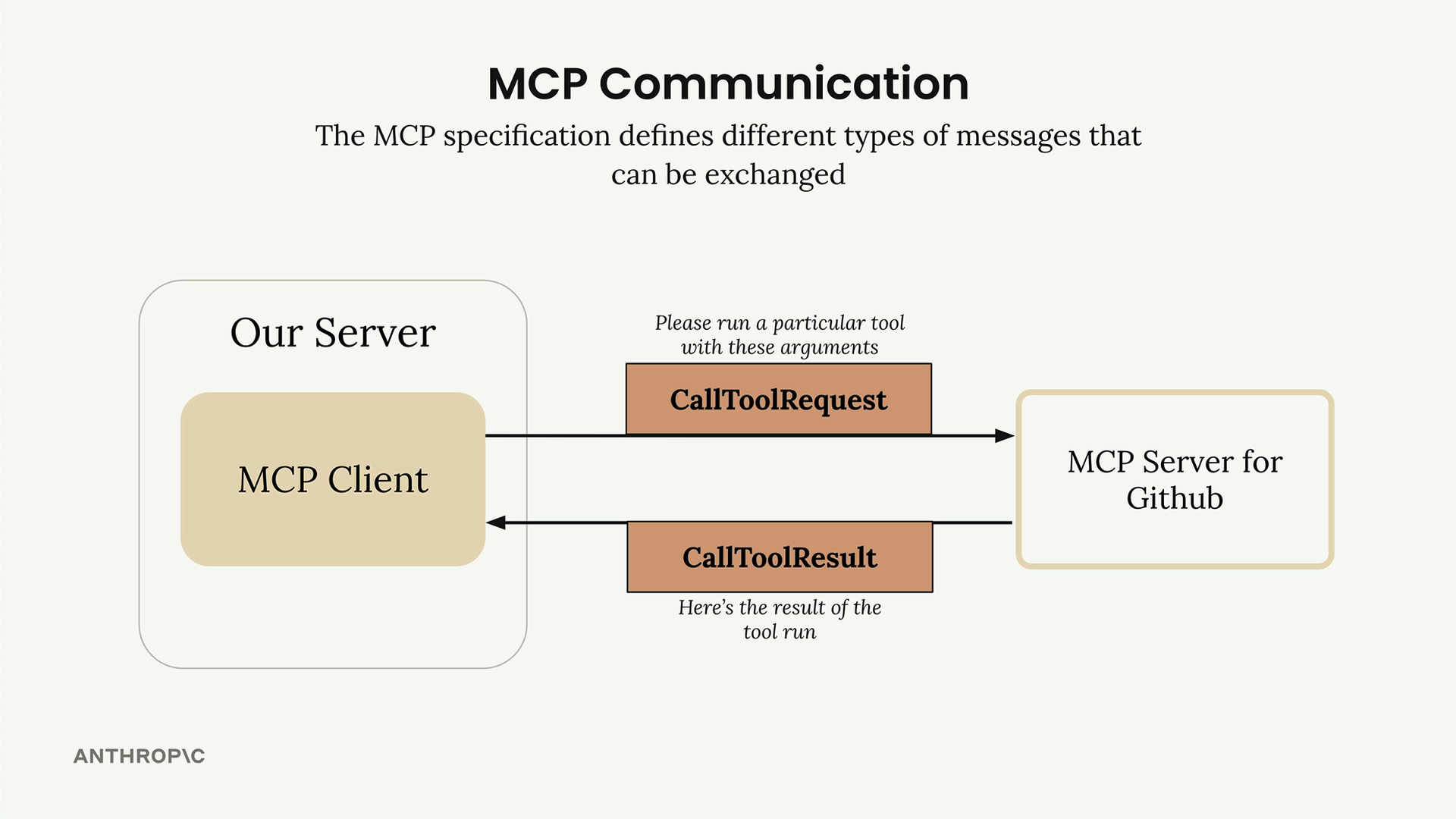

通信 = 由 MCP 规范定义的消息交换。

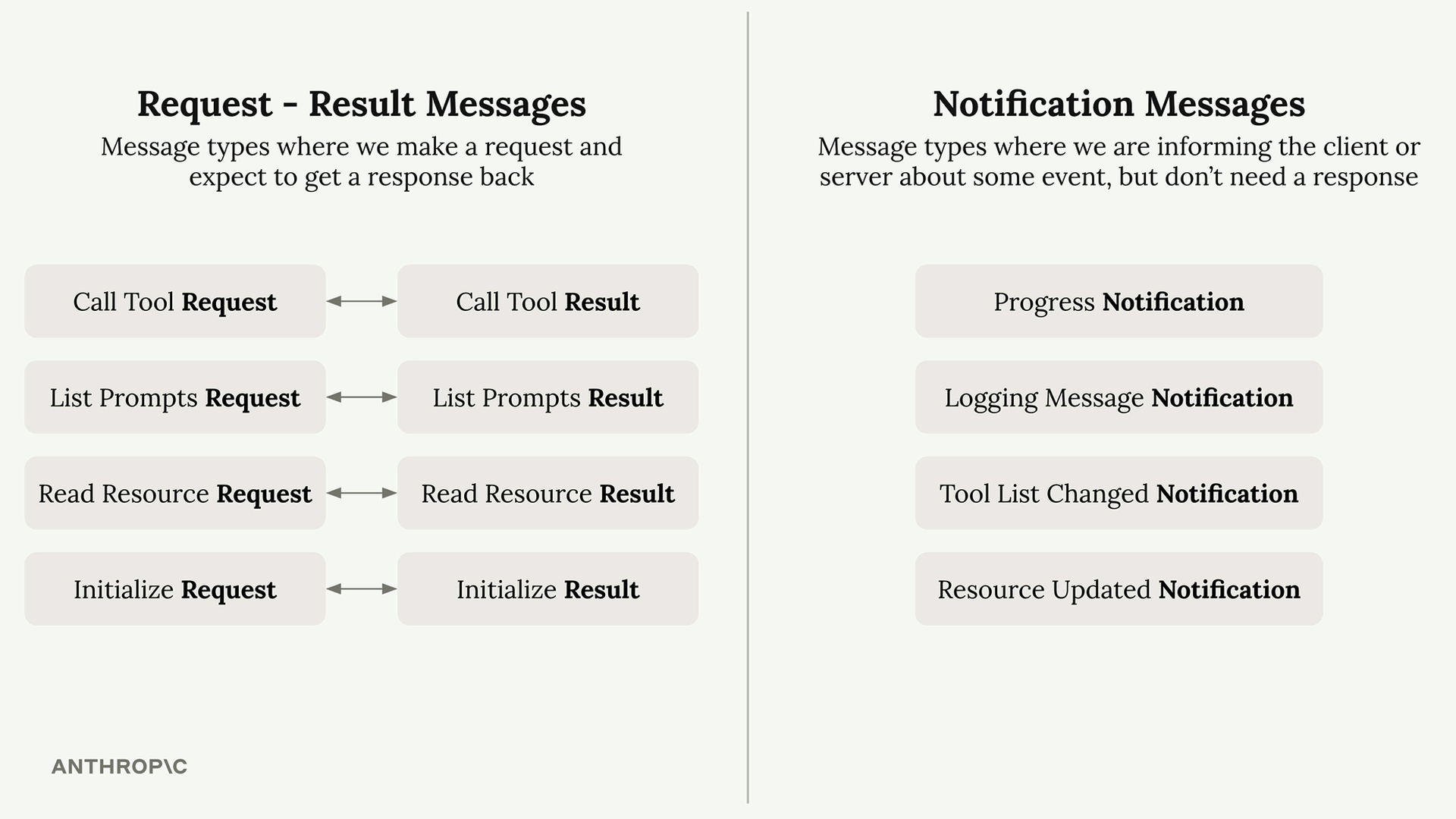

关键消息类型:

list tools请求 = 客户端向服务器请求可用工具。list tools结果 = 服务器以工具列表作为响应。call tool请求 = 客户端请求服务器使用参数运行工具。call tool结果 = 服务器以工具执行结果作为响应。

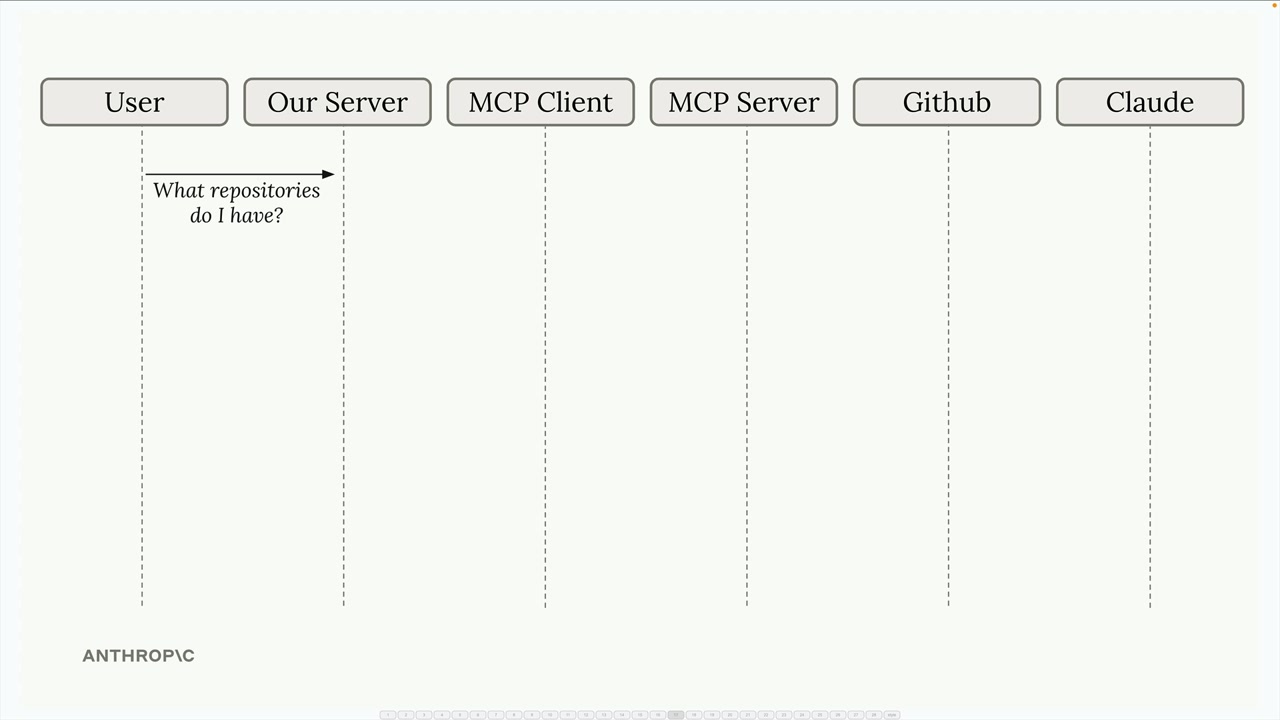

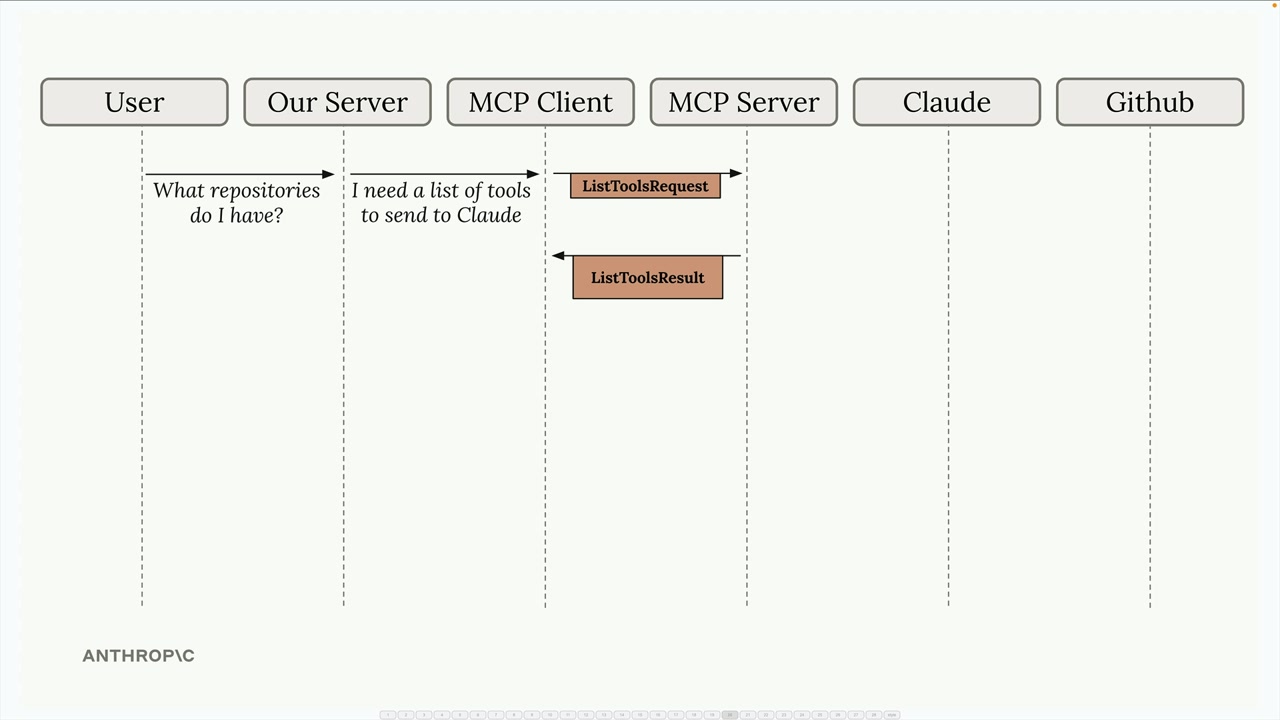

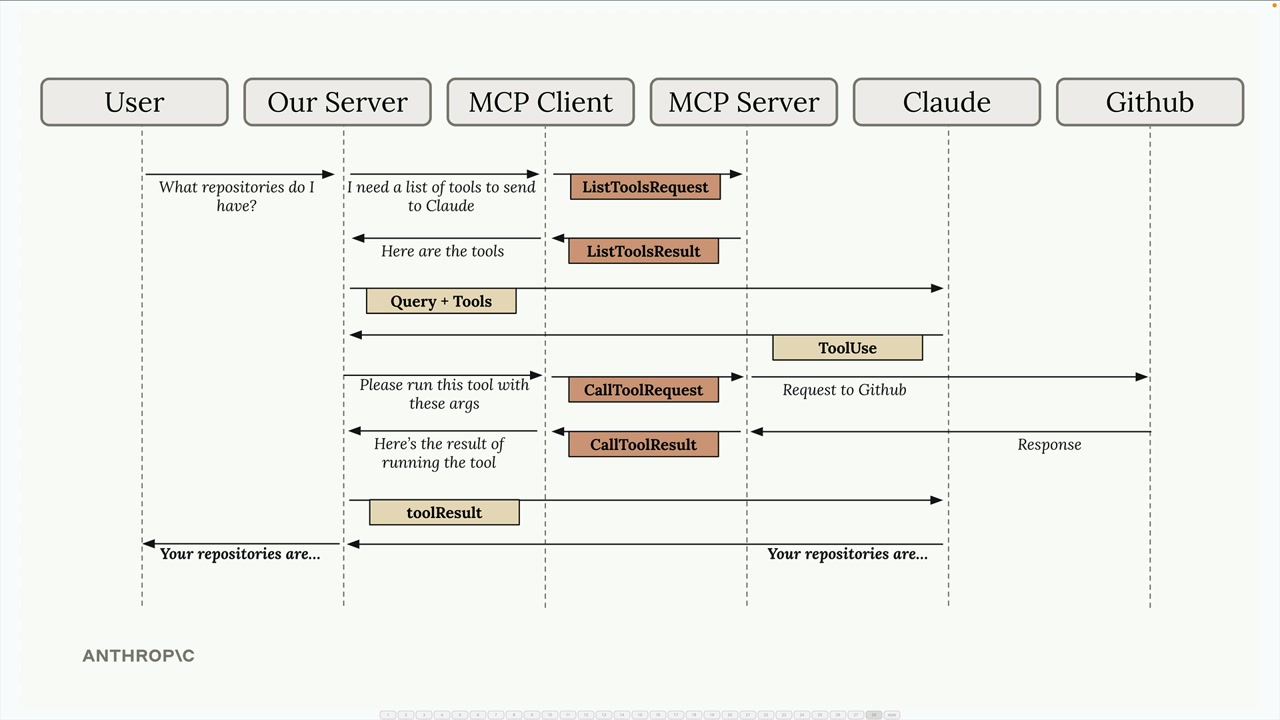

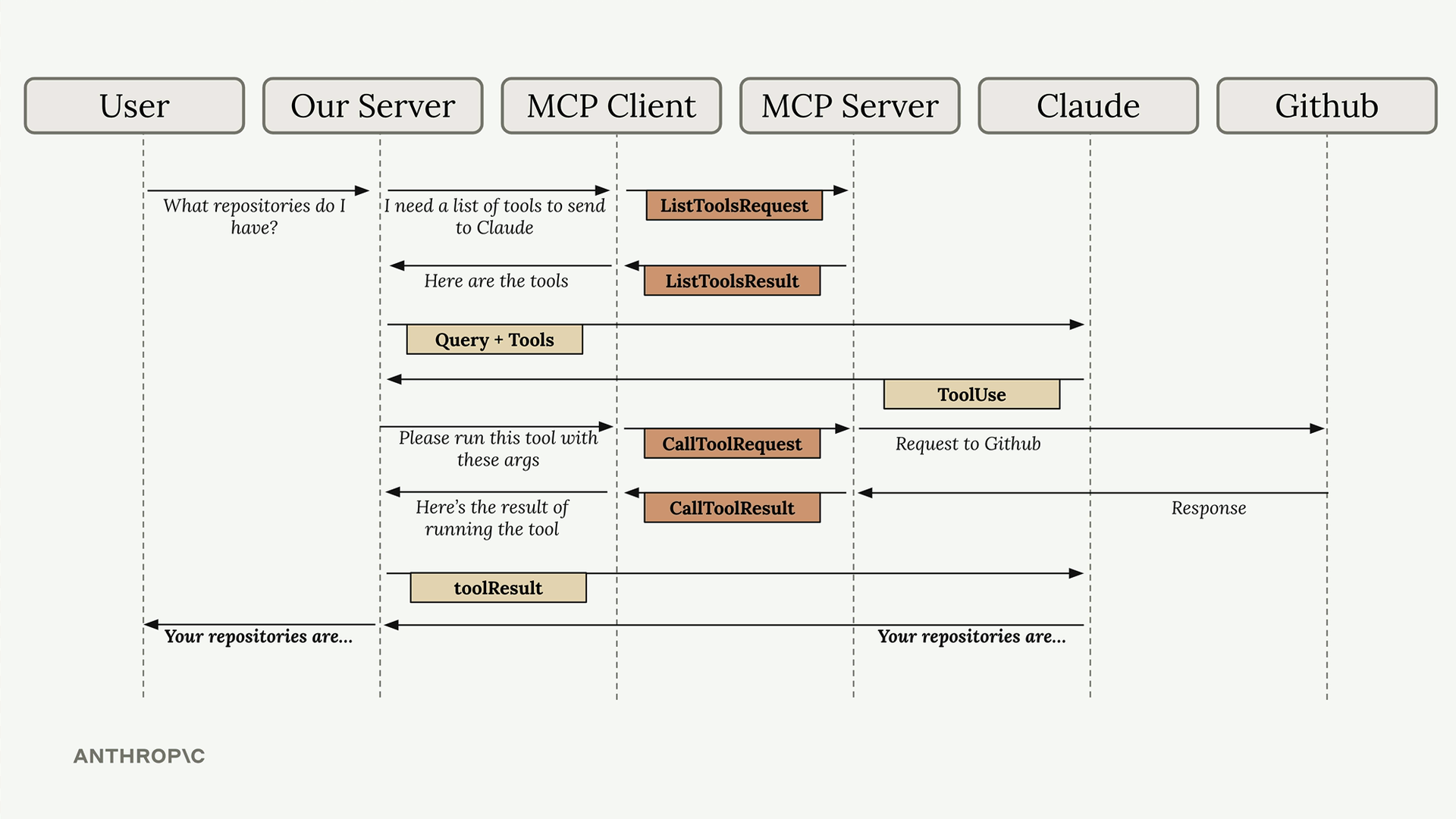

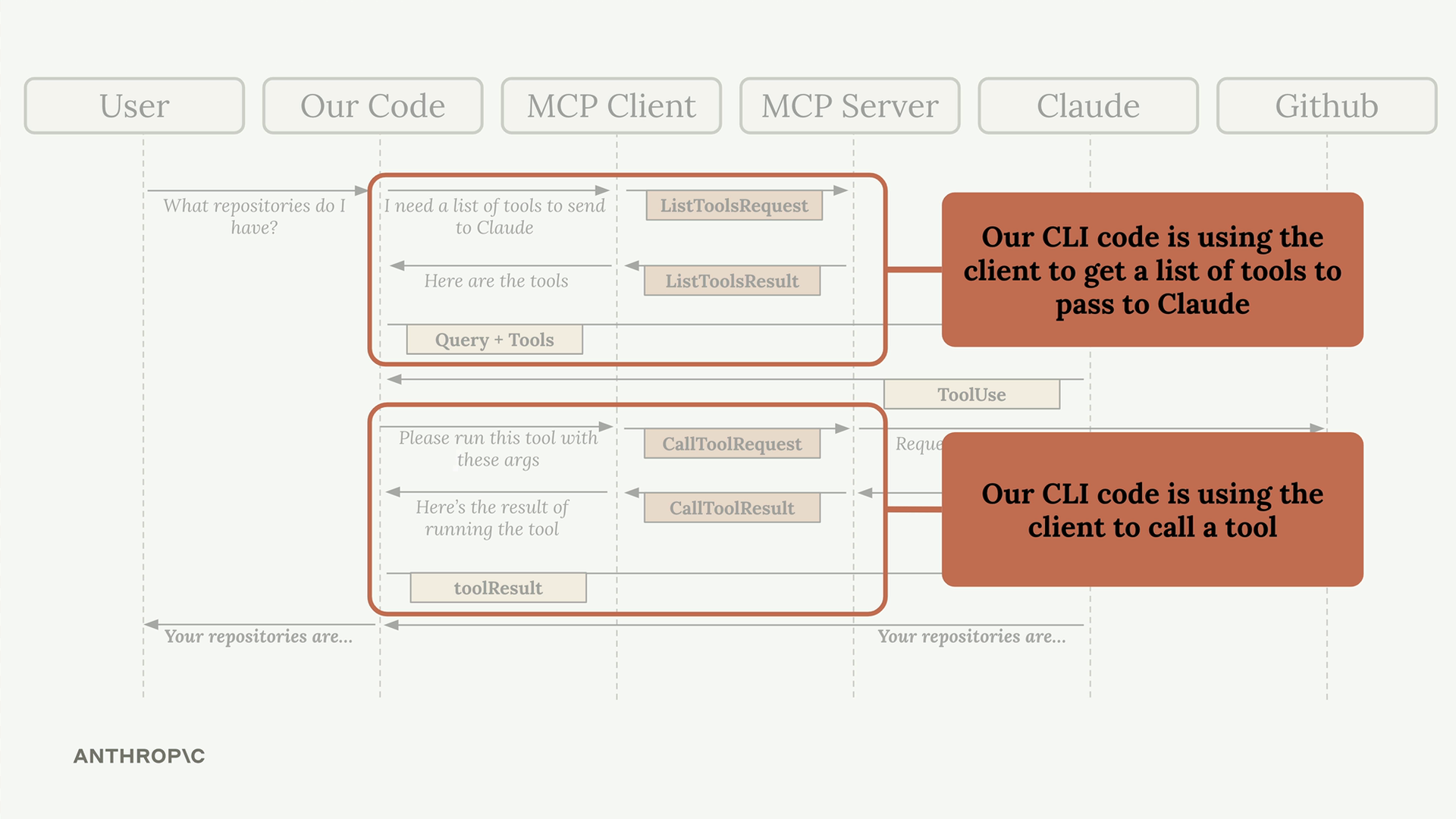

典型流程:

- 用户查询服务器。

- 服务器向

MCP客户端请求工具列表。 MCP客户端向MCP服务器发送list tools请求。MCP服务器以list tools结果作为响应。- 服务器将查询 + 工具发送给 Claude。

- Claude 请求执行工具。

- 服务器要求

MCP客户端运行工具。 MCP客户端向MCP服务器发送call tool请求。MCP服务器执行工具(例如,GitHub API 调用)。- 结果通过链条回传:

MCP服务器 →MCP客户端 → 服务器 → Claude → 用户。

目的 = 使服务器能够将工具执行委托给专门的 MCP 服务器,同时保持与 Claude 的集成。

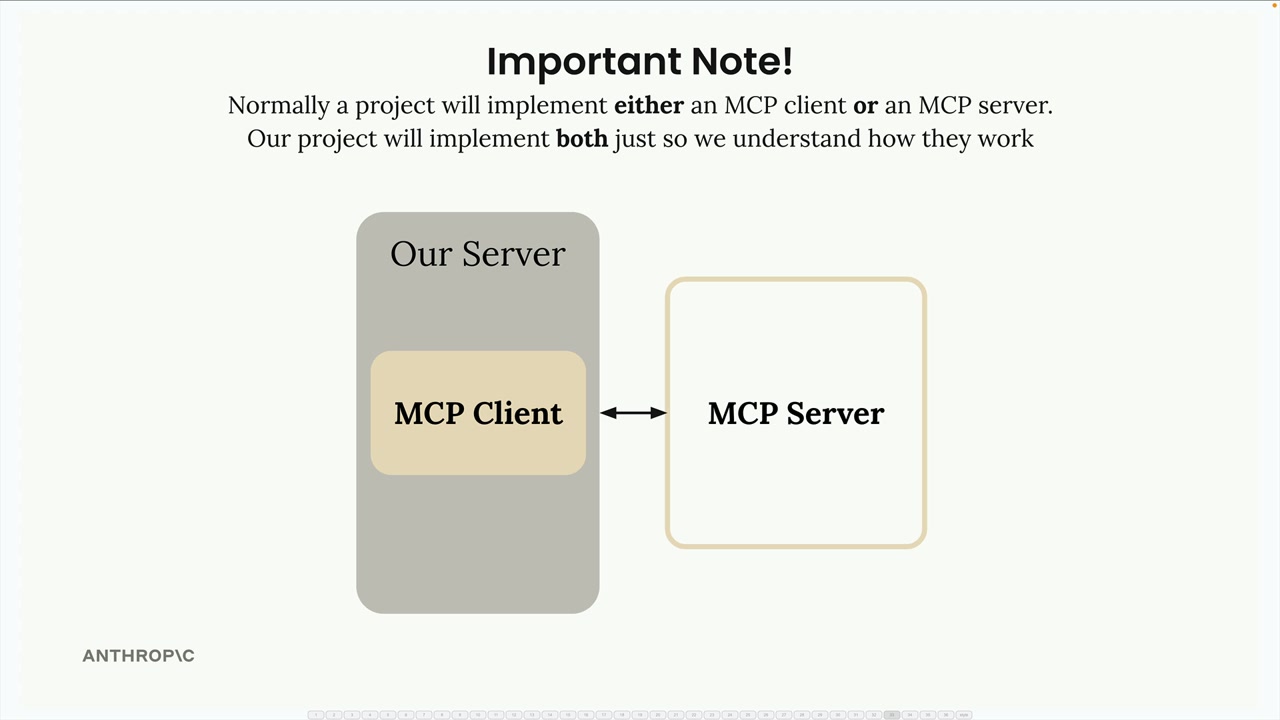

项目设置

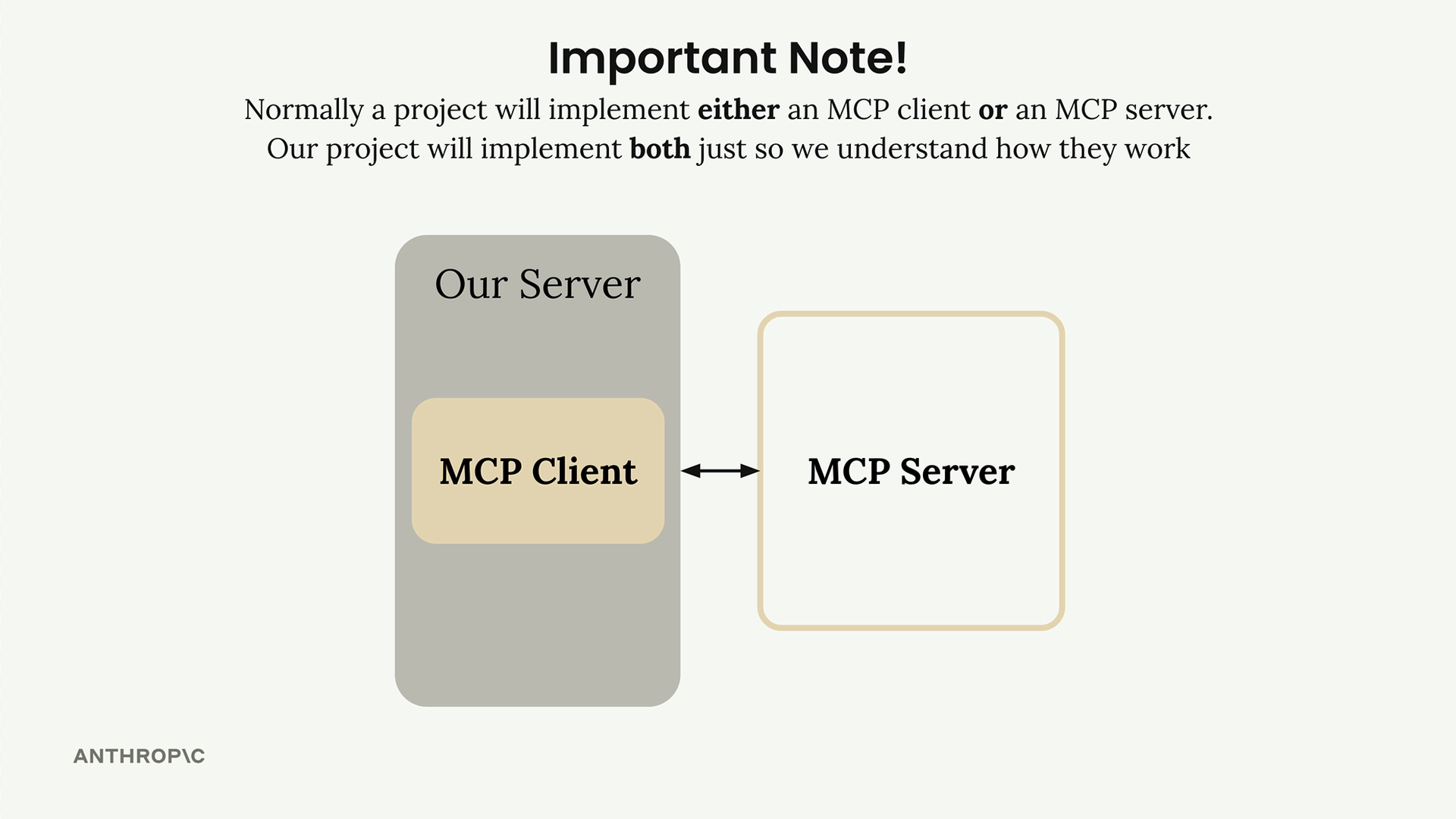

基于 CLI 的聊天机器人项目 = 通过动手实践来教授 MCP 客户端-服务器交互。

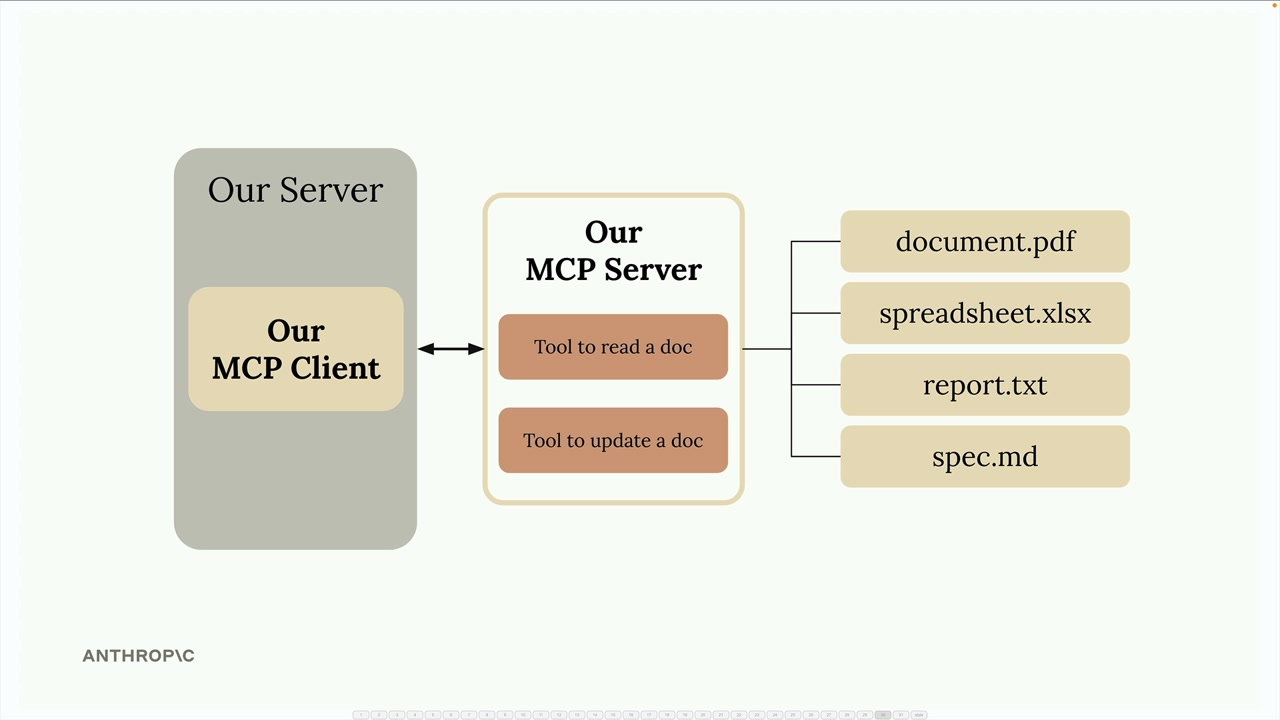

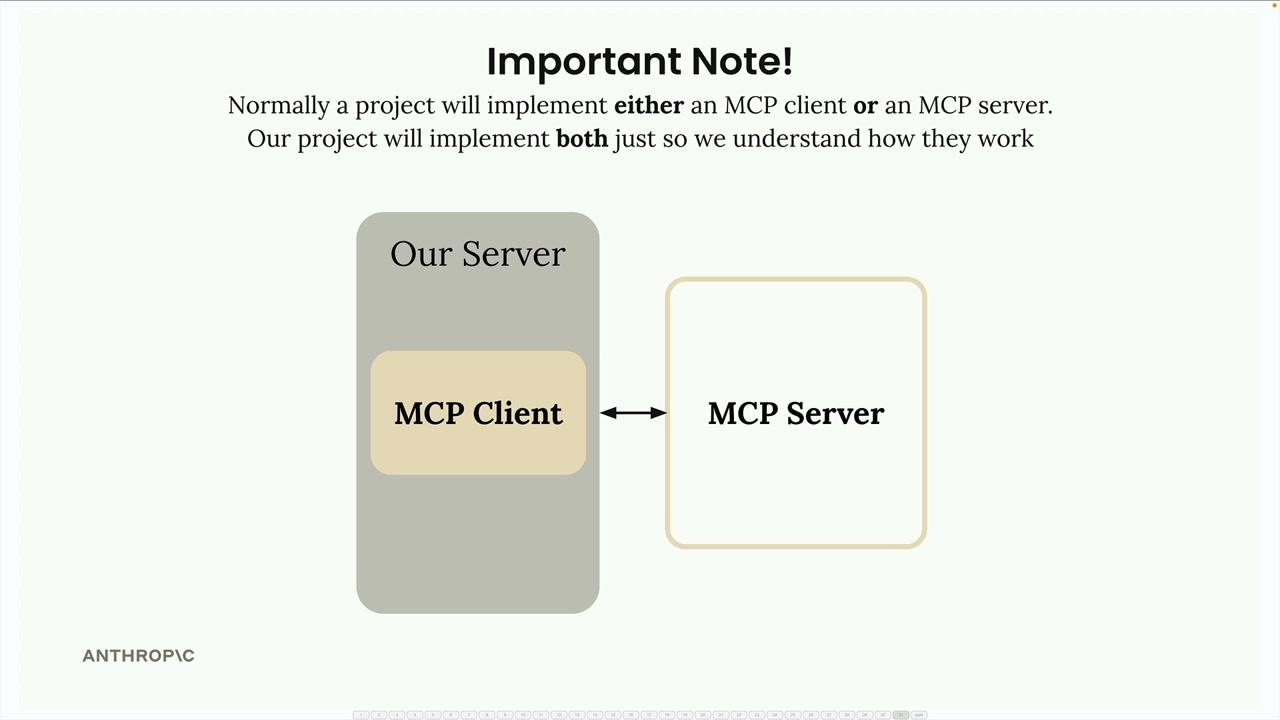

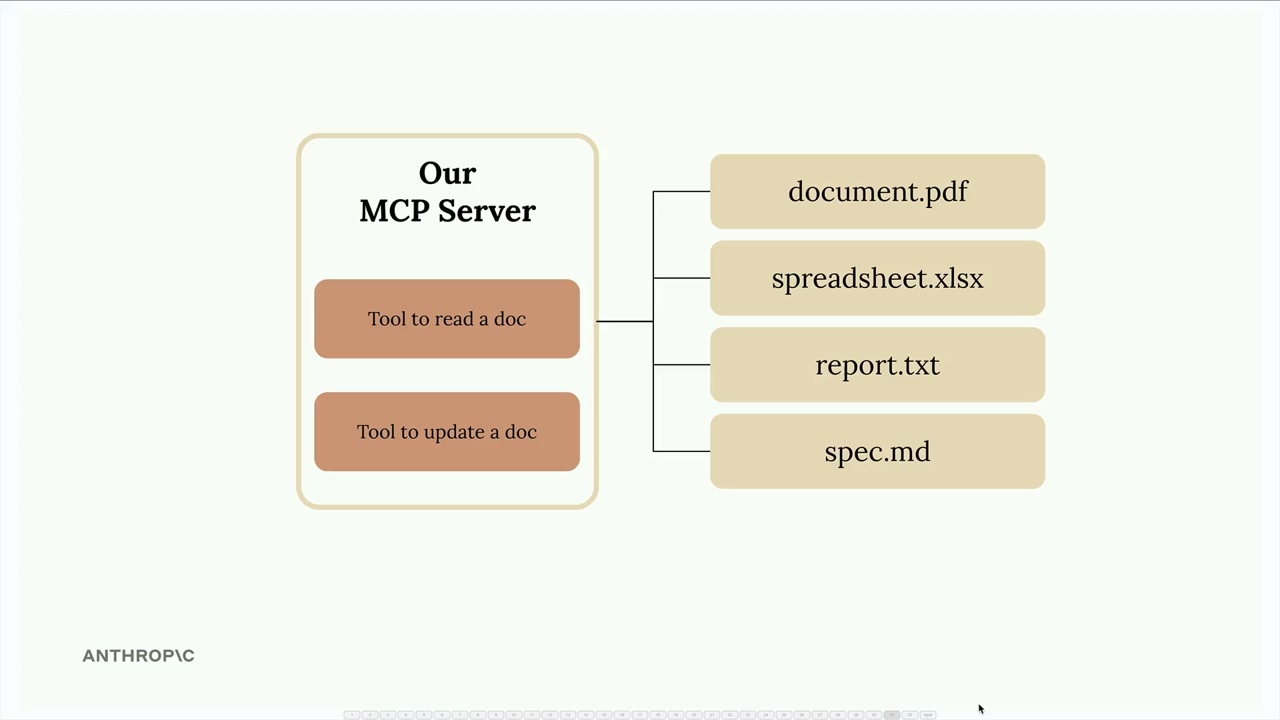

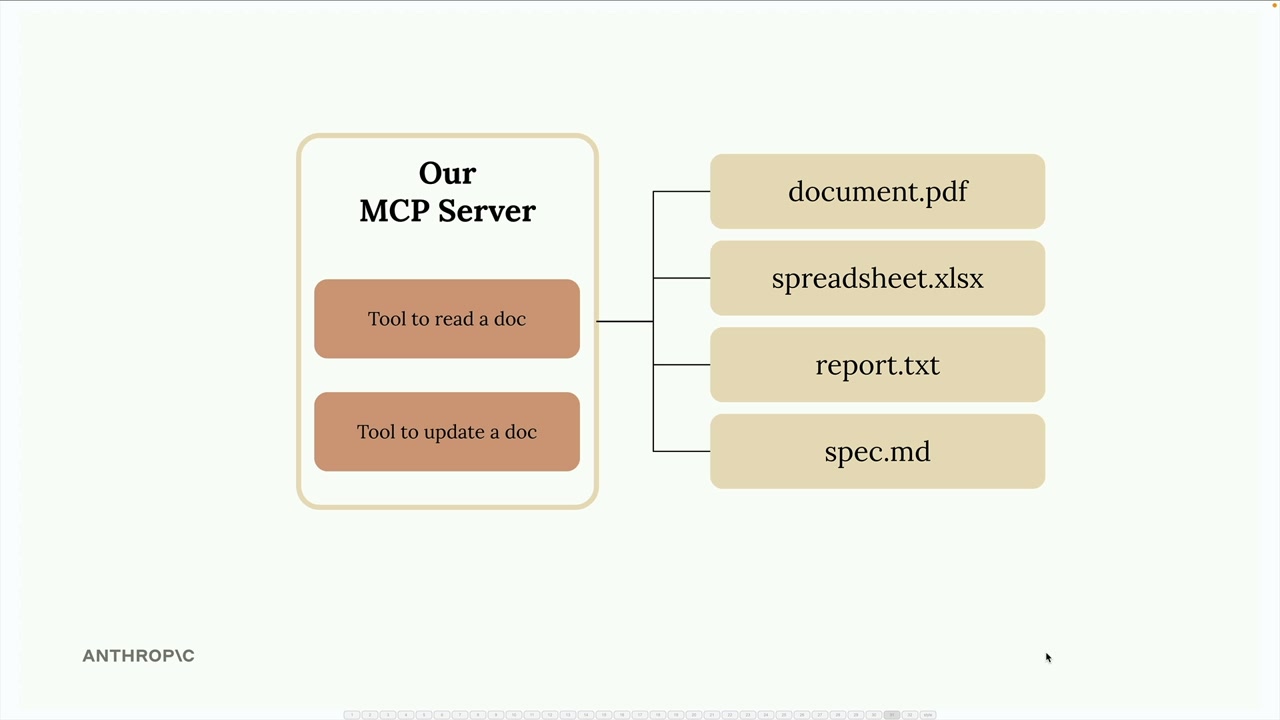

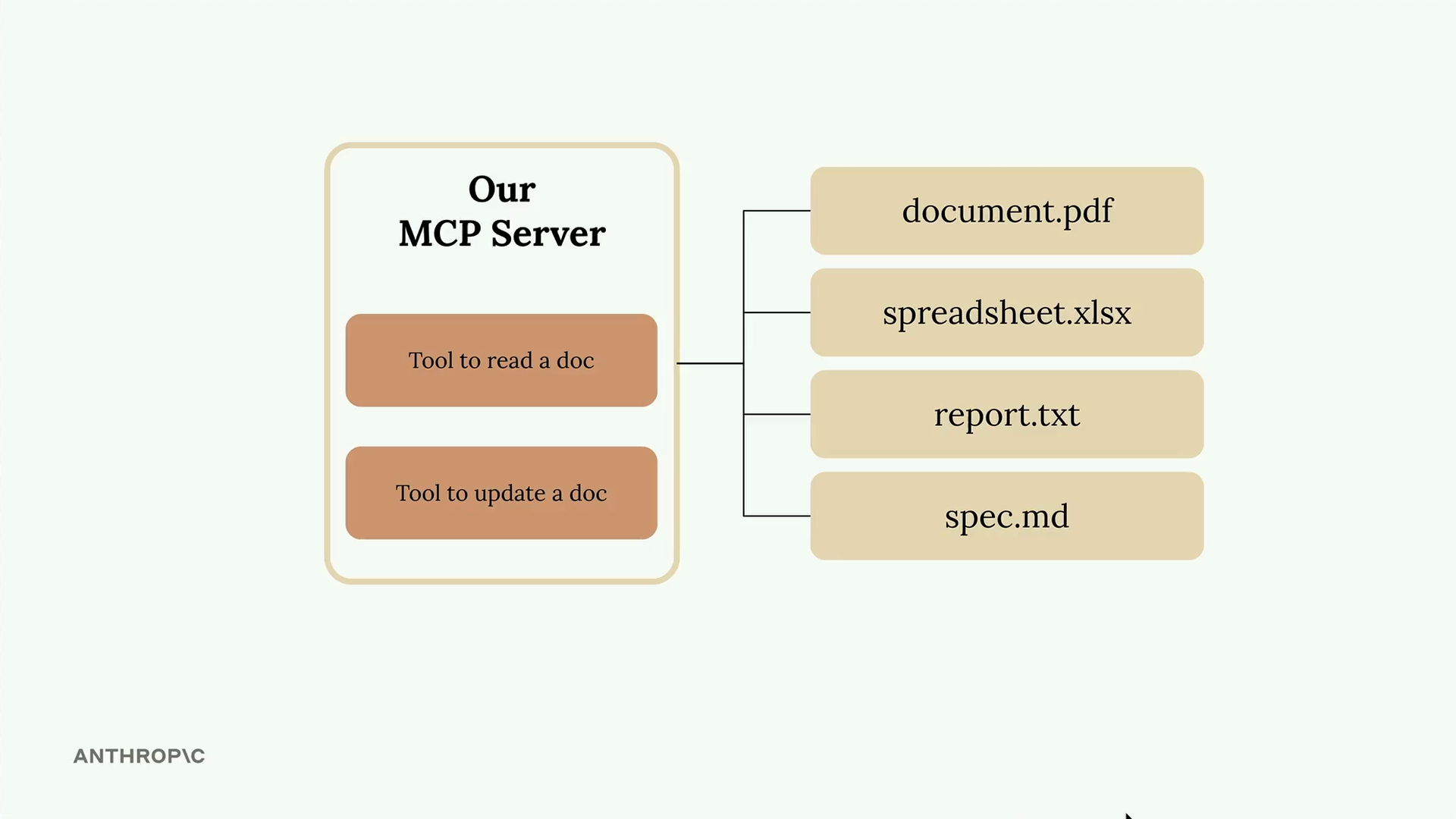

项目组件:

MCP客户端 = 连接到自定义的MCP服务器。MCP服务器 = 提供 2 个工具(读取文档、更新文档)。- 文档集合 = 仅存储在内存中的虚拟文档。

关键区别:普通项目要么实现客户端,要么实现服务器,而不是两者都实现。本项目为了教学目的,两者都将实现。

设置过程:

- 下载

CLI_project.zip入门代码。 - 解压并在代码编辑器中打开。

- 遵循

readme.md中的设置说明。 - 将 API 密钥添加到

.env文件中。 - 安装依赖项(使用/不使用 UV)。

- 运行项目:

uv run main.py或python main.py。 - 使用聊天提示词进行测试。

预期结果 = 一个能响应基本查询的工作聊天界面,为添加 MCP 功能做好准备。

使用 MCP 定义工具

使用 Python SDK 实现 MCP 服务器时,通过装饰器创建工具,而非手动编写 JSON 模式。

MCP Python SDK = 一个官方包,它使用 @mcp.tool 装饰器从 Python 函数定义中自动生成工具的 JSON 模式。

工具定义语法 = @mcp.tool(name="tool_name", description="description") + 带有类型化参数的函数,使用 Field() 来描述参数。

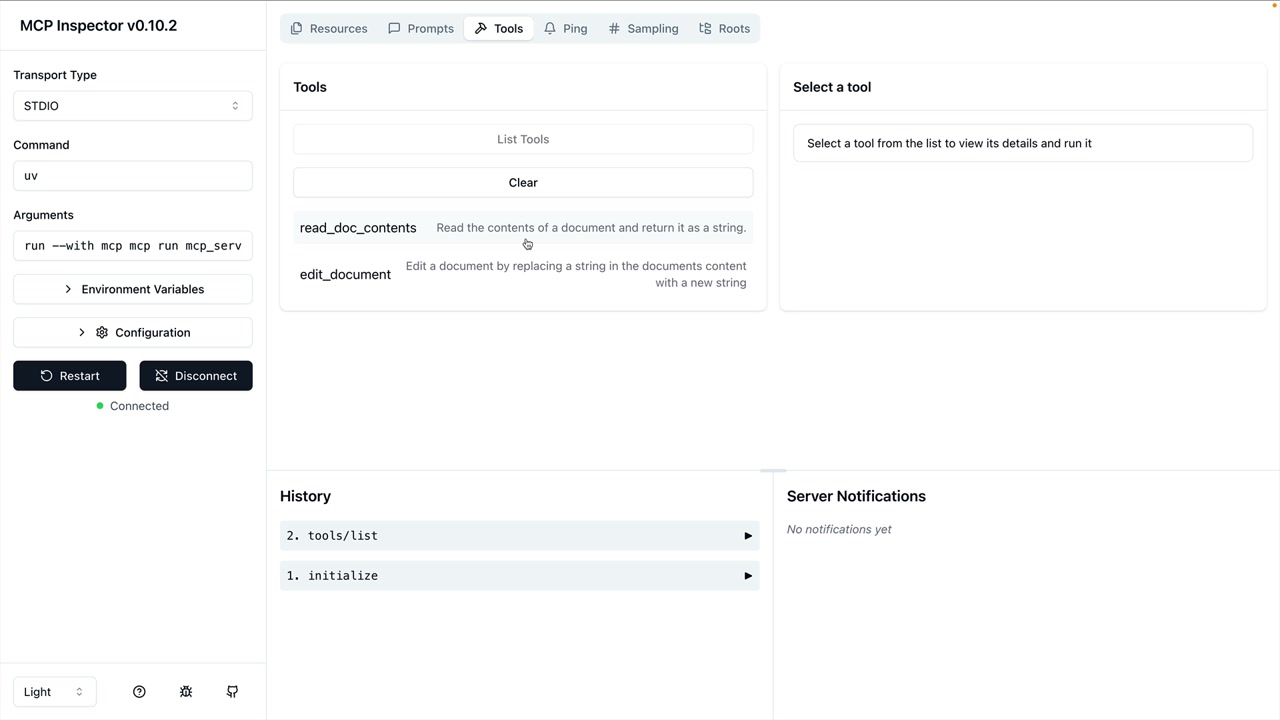

实现的两个工具:

read_doc_contents= 接收一个doc_id字符串,从内存中的docs字典返回文档内容。edit_document= 接收doc_id、old_string、new_string参数,对文档内容执行查找/替换操作。

错误处理 = 检查 doc_id 是否存在于 docs 字典中,如果未找到则引发 ValueError。

主要优势 = SDK 消除了手动编写 JSON 模式的工作,自动从 Python 函数签名和装饰器生成模式。

必需的导入 = 用于参数描述的 pydantic 中的 Field,以及用于服务器和工具装饰器的 mcp 包。

实现模式 = 装饰器定义工具元数据,函数参数定义带有类型和描述的工具参数,函数体包含工具逻辑。

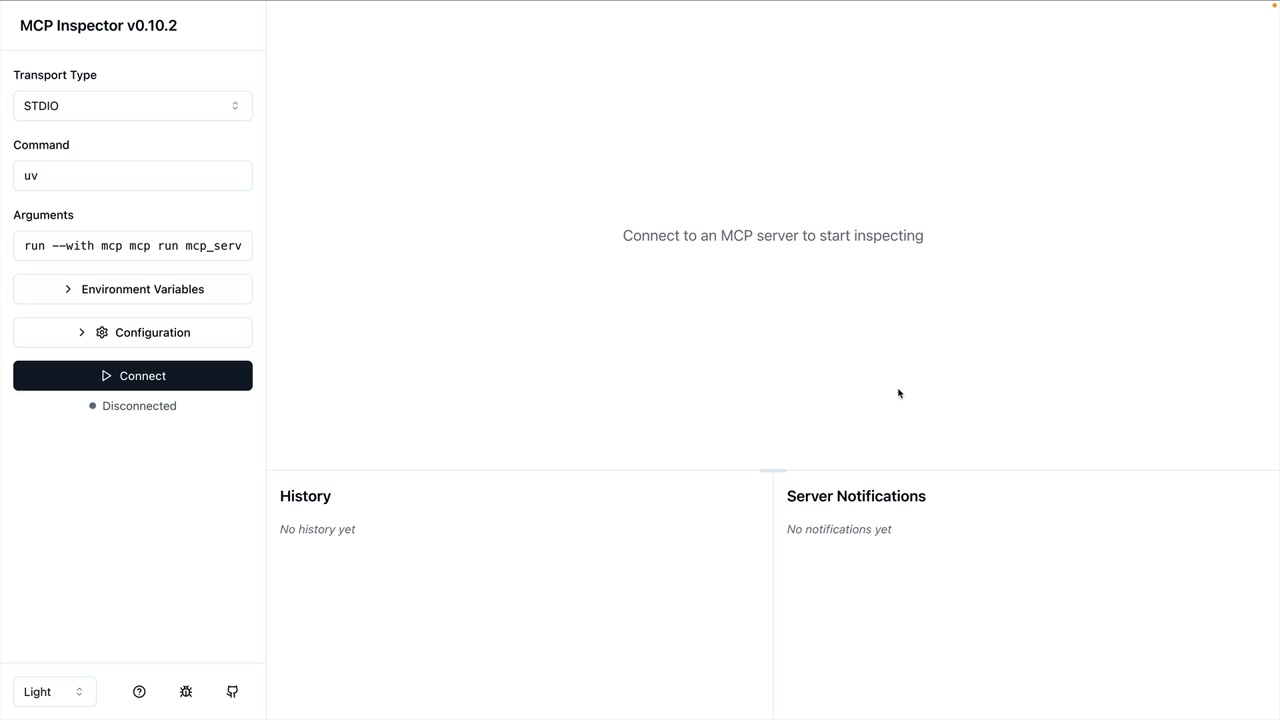

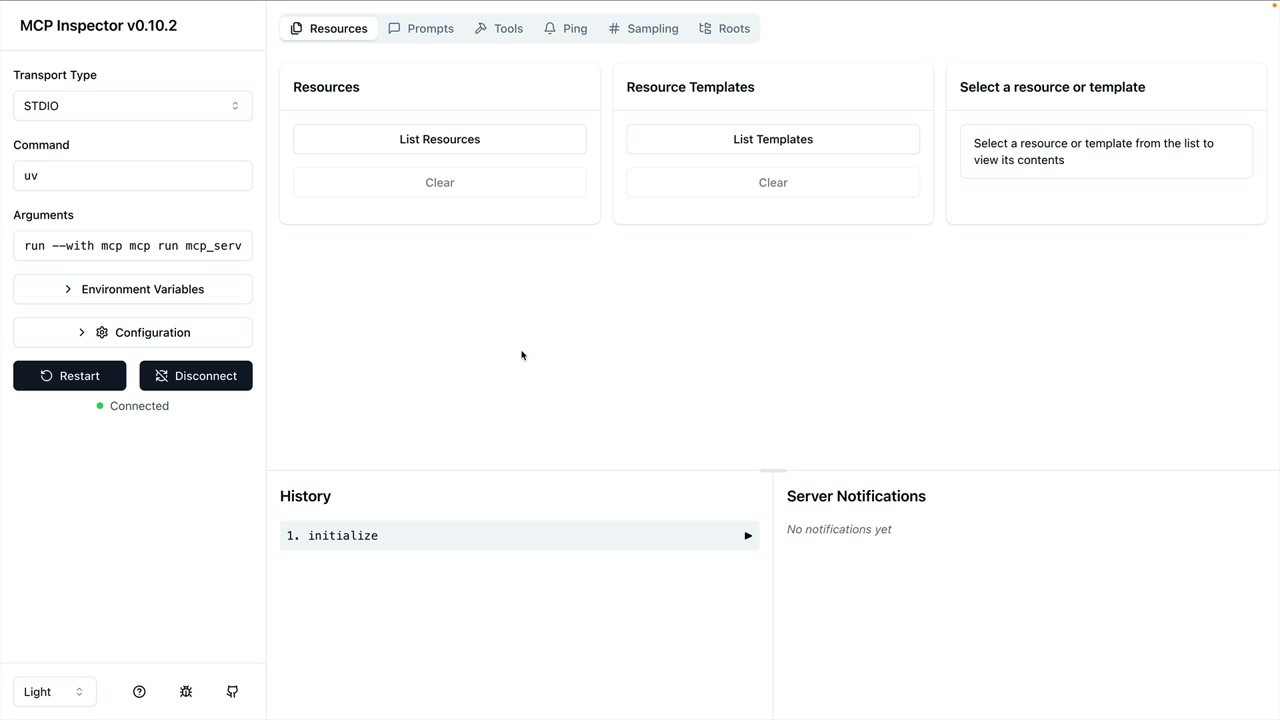

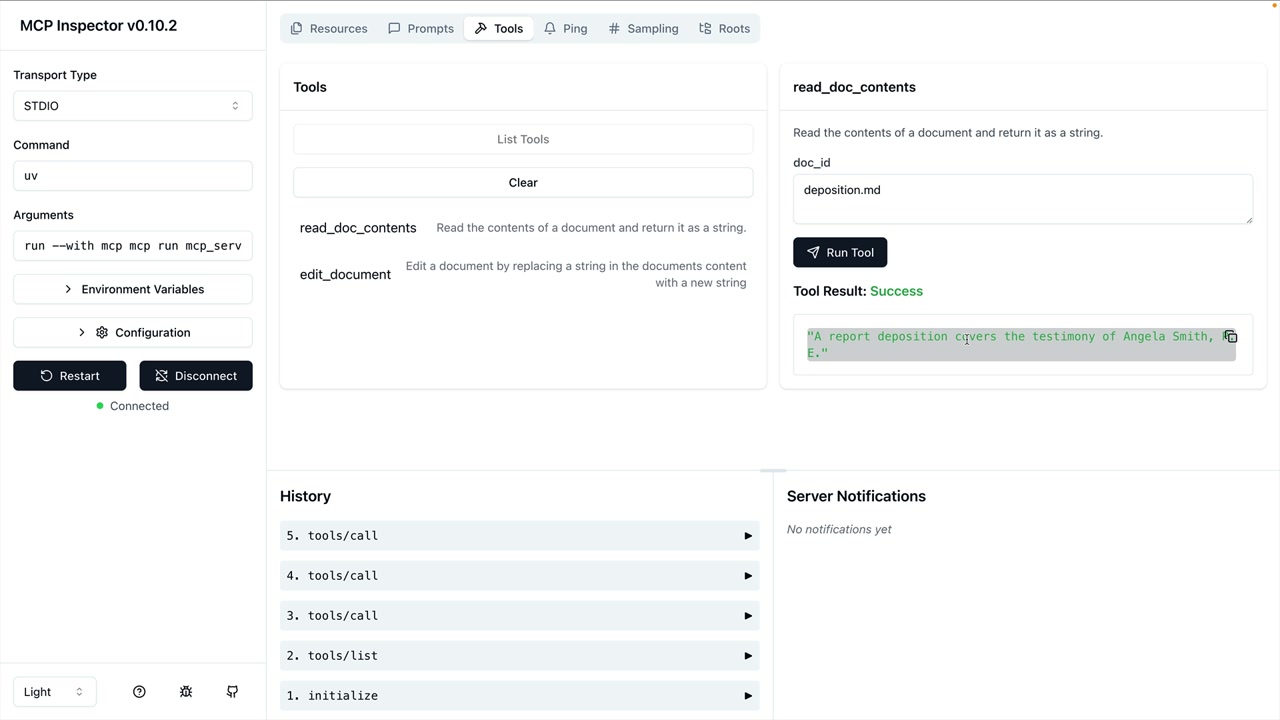

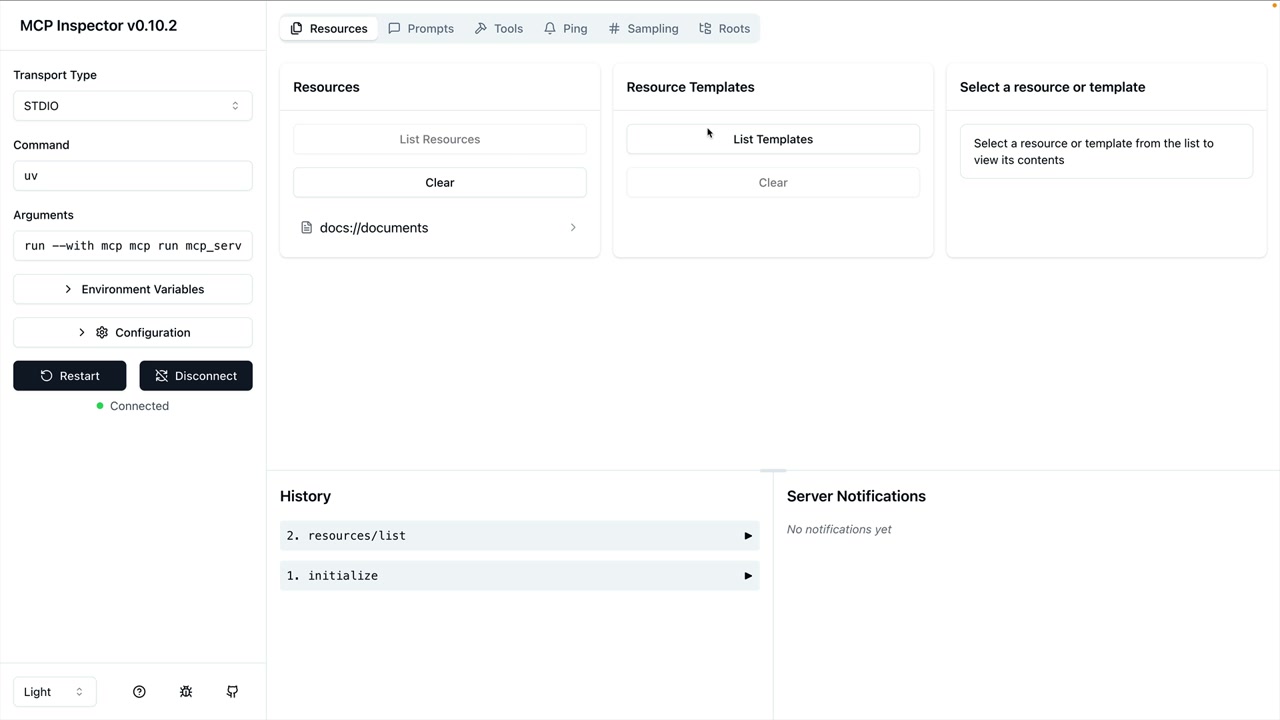

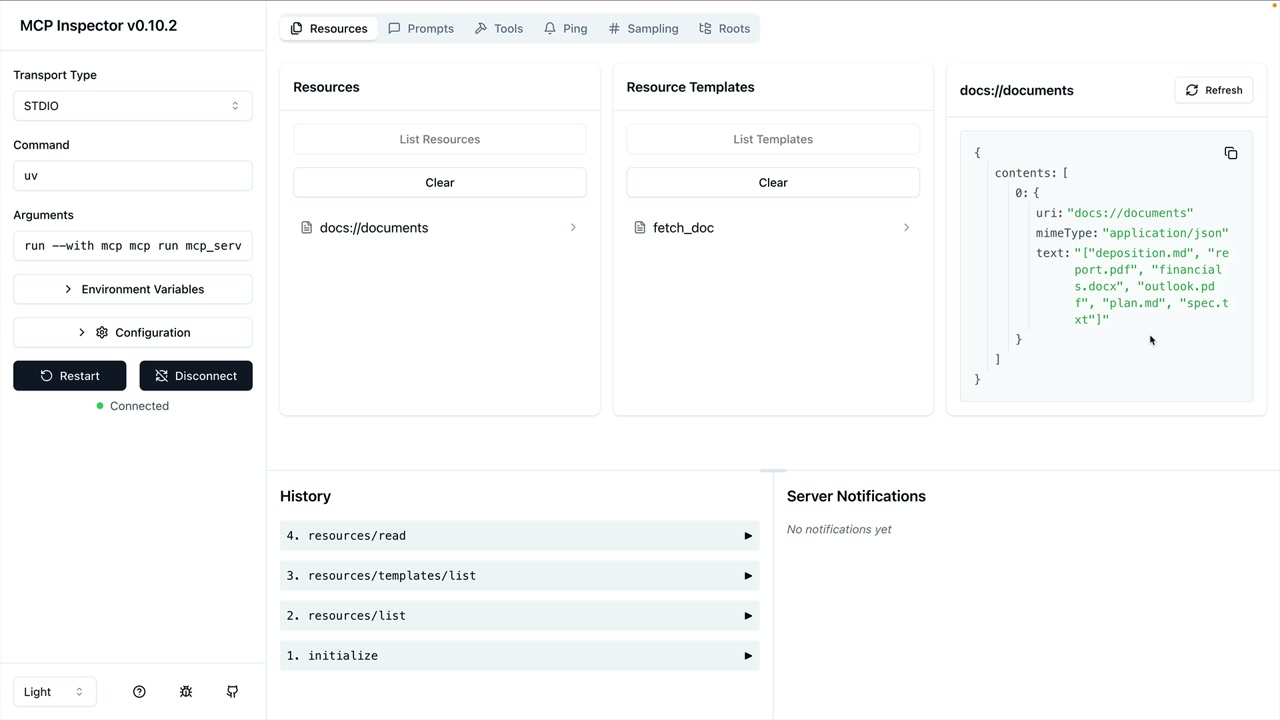

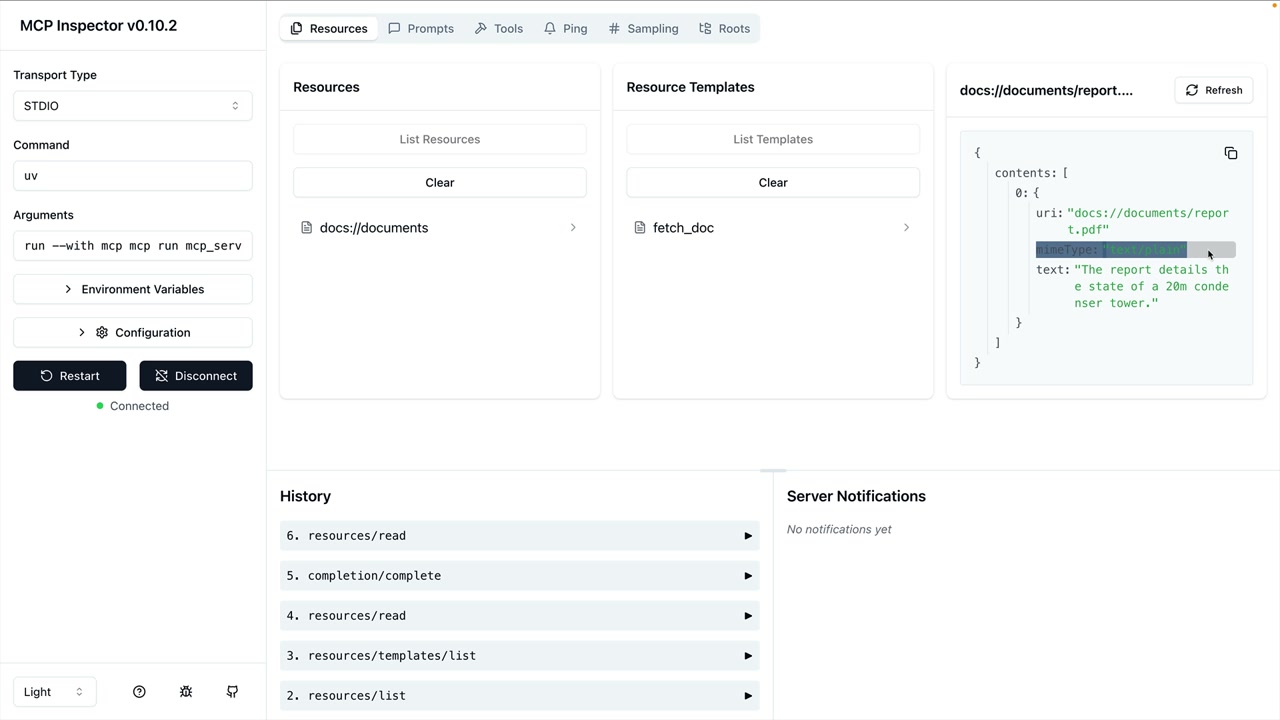

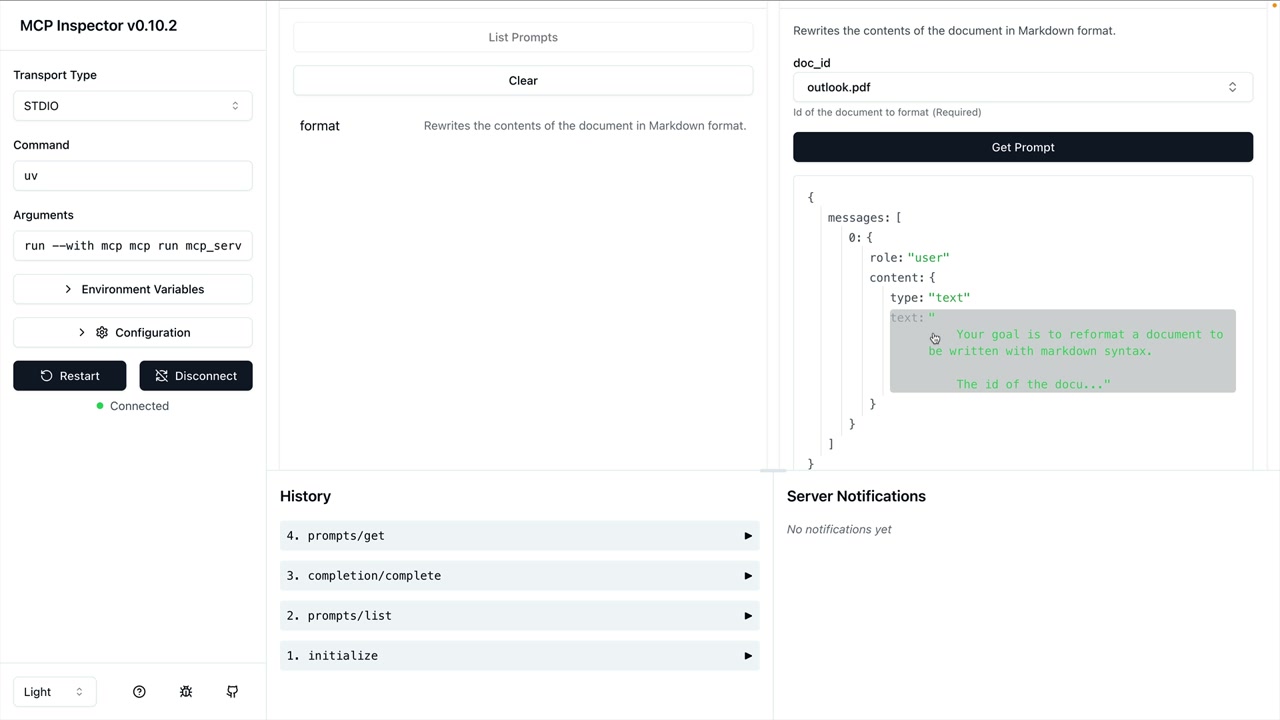

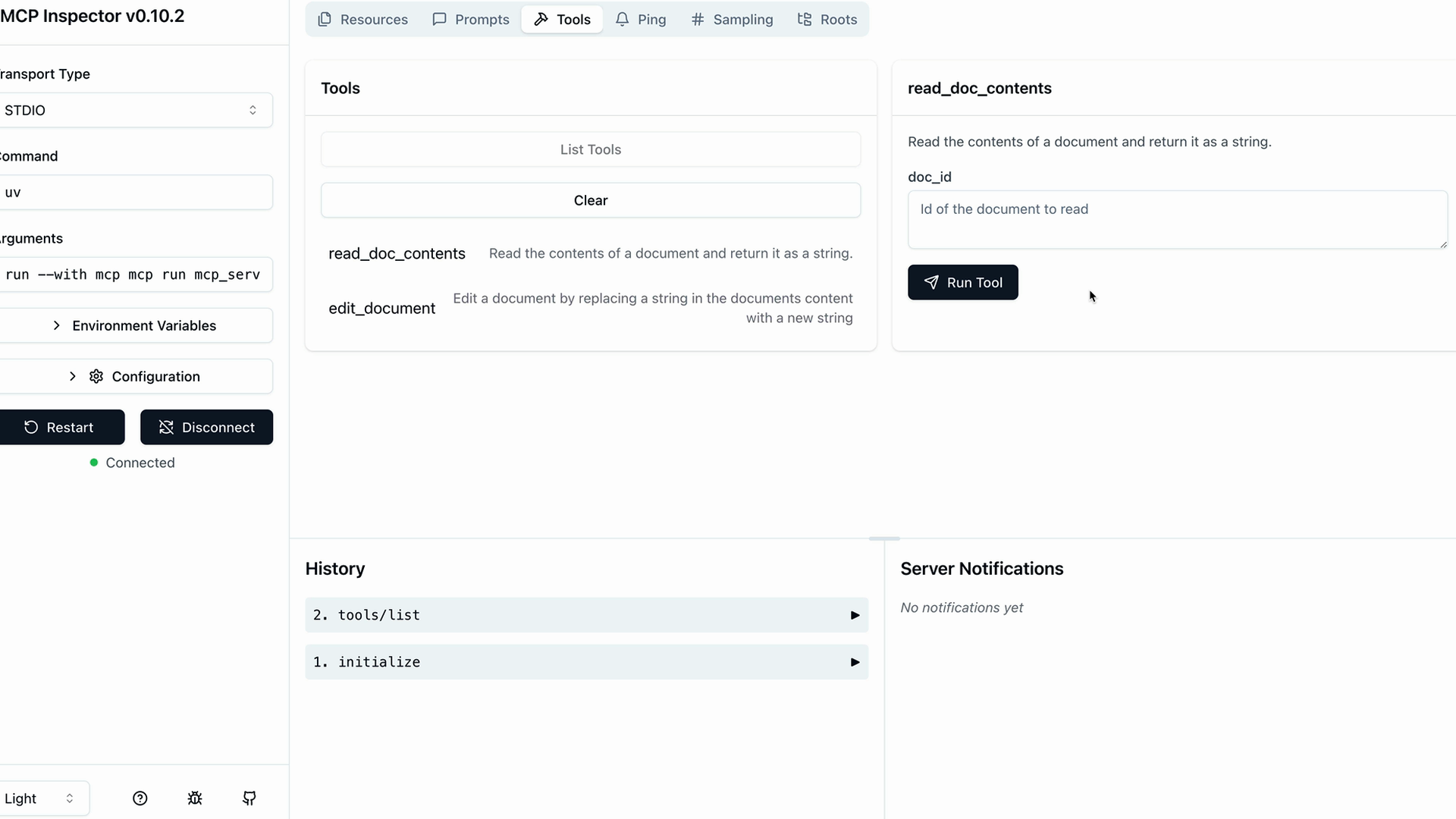

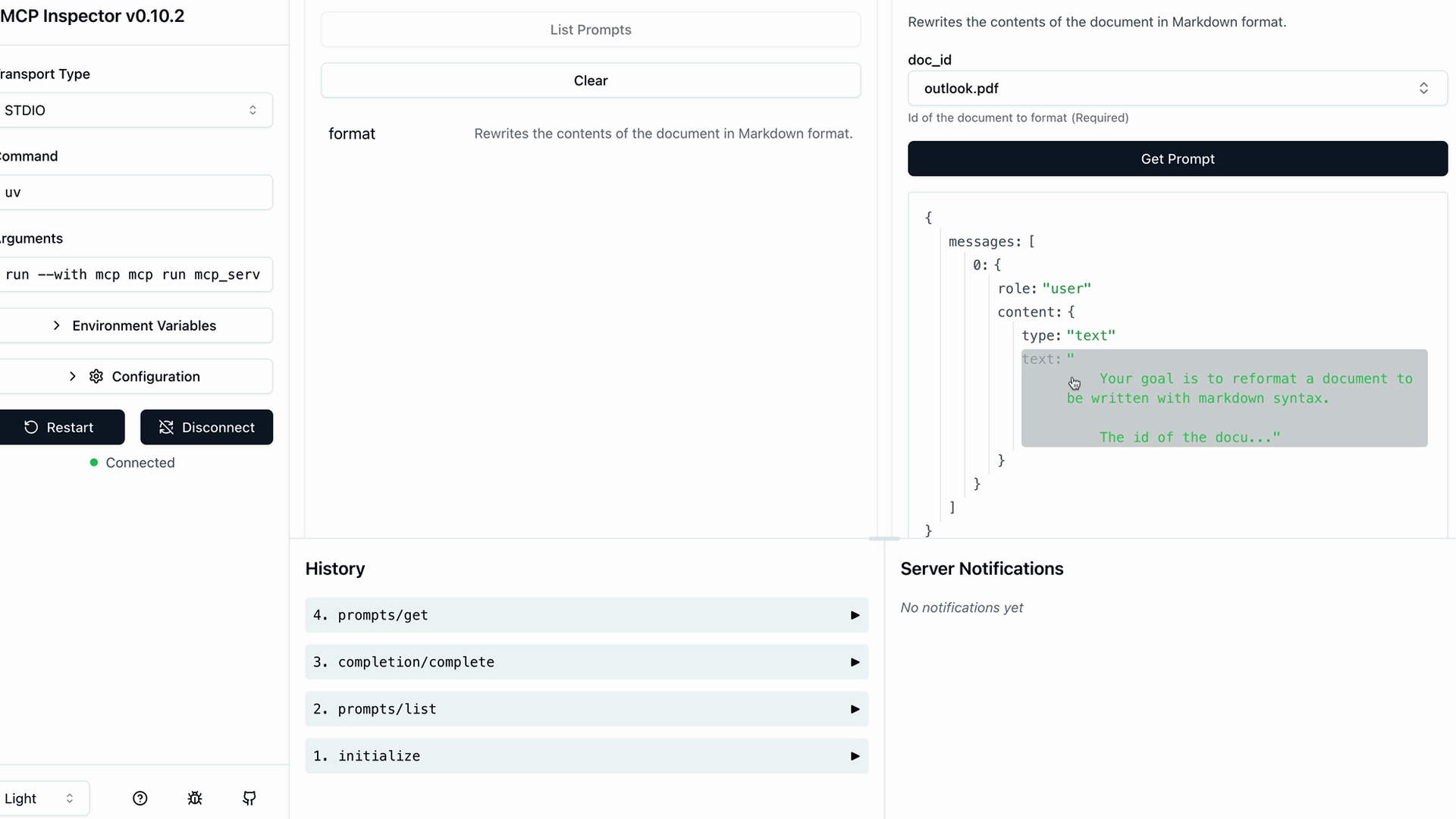

服务器检查器

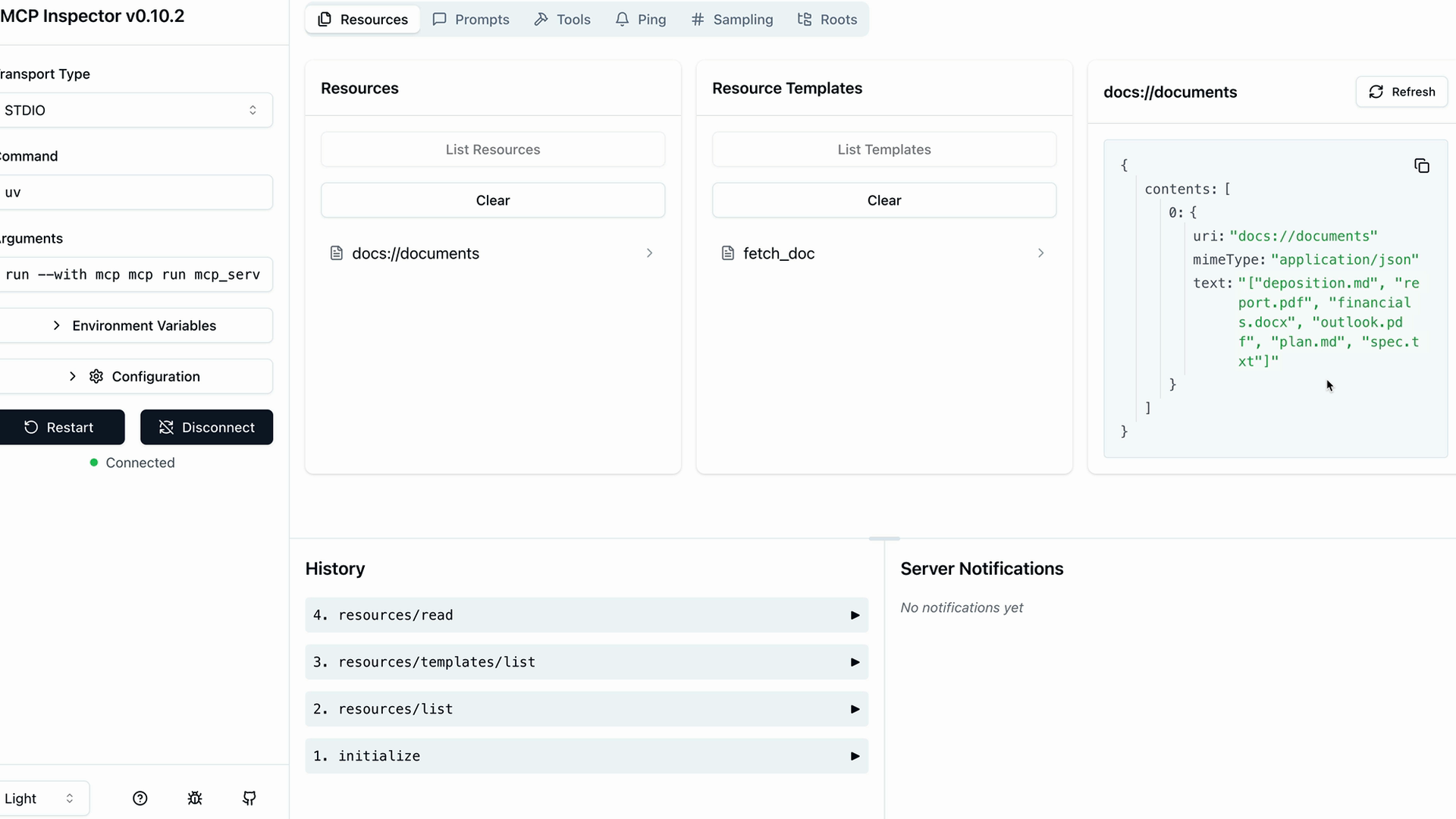

MCP Inspector (MCP 检查器) = 一个用于测试 MCP 服务器的浏览器内调试器,无需连接到应用程序。

访问方式:在终端运行 mcp dev [server_file.py] → 在端口上启动服务器 → 在浏览器中导航到提供的 URL。

界面:左侧边栏有连接按钮 → 顶部菜单显示资源/提示词/工具部分 → 工具部分列出可用工具 → 点击工具以在右侧面板中打开手动测试界面。

测试工作流程:连接到服务器 → 导航到工具 → 选择特定工具 → 输入所需参数 → 点击运行工具 → 验证输出。

主要功能:实时开发测试、手动工具调用、参数输入表单、成功/失败反馈,无需完整的应用程序集成。

注意:UI 在开发过程中正在积极变化,但核心功能保持相似。

使用示例:通过输入文档 ID 测试文档工具,验证读取操作,测试编辑操作,链接操作以验证更改。

主要好处:在开发阶段高效地调试 MCP 服务器实现。

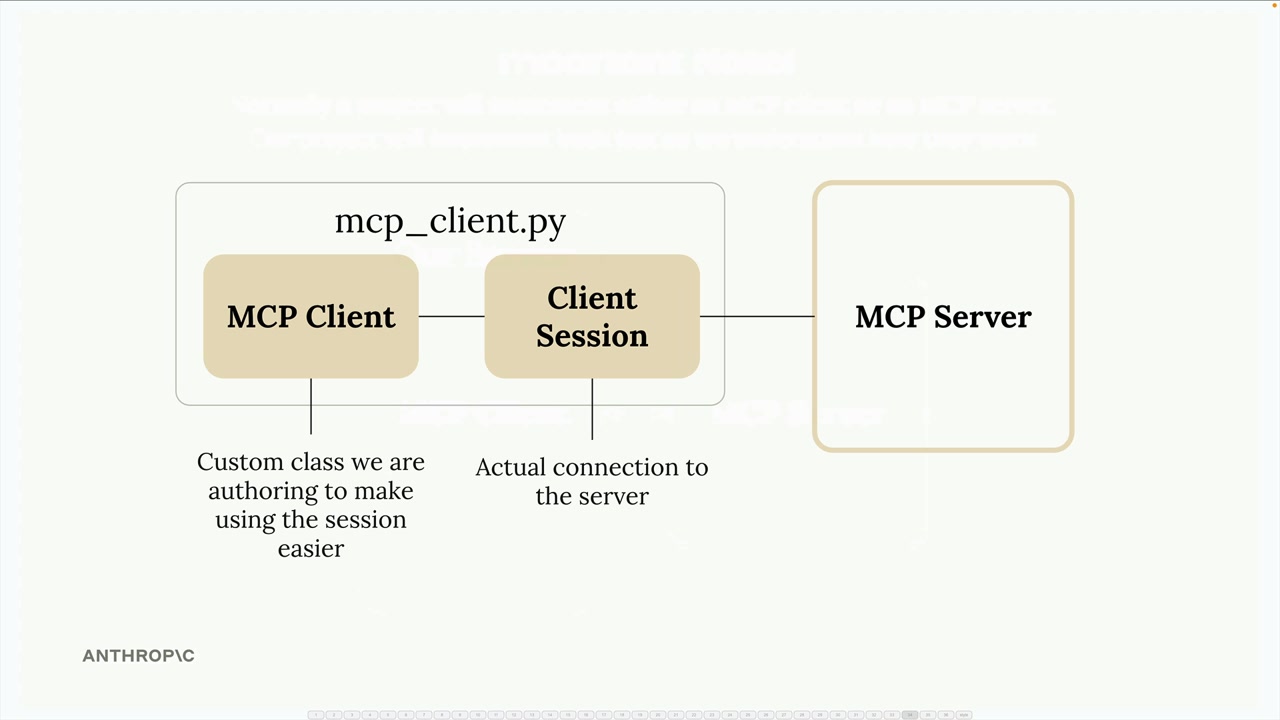

实现客户端

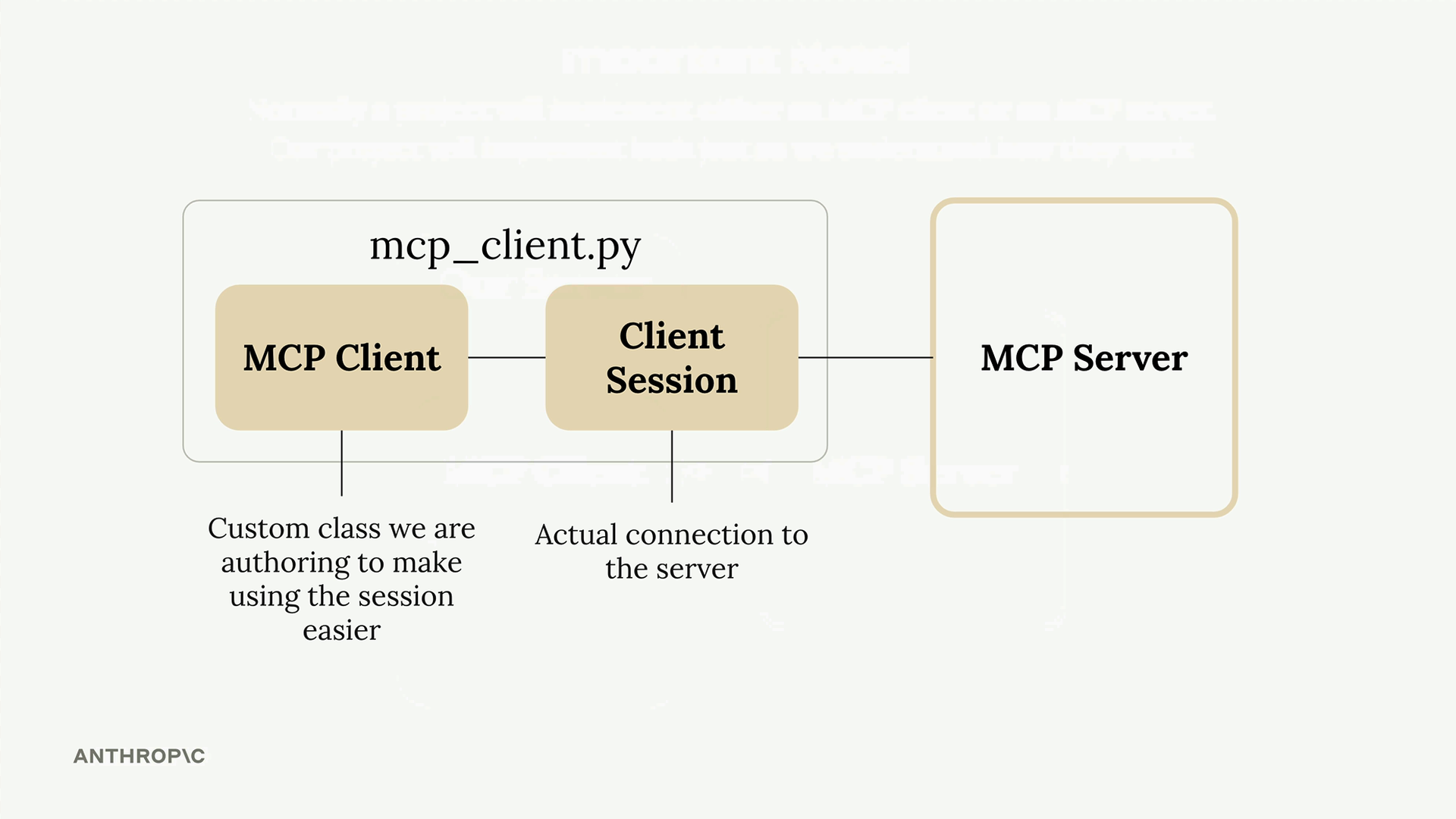

MCP 客户端实现:

MCP 客户端 = MCP 客户端是客户端会话的包装类,用于资源清理和与 MCP 服务器的连接管理。

客户端会话 = 来自 MCP Python SDK 的与 MCP 服务器的实际连接,关闭时需要进行资源清理。

客户端目的 = 将 MCP 服务器的功能暴露给代码库的其余部分,使其能够向服务器请求工具列表和执行工具。

关键函数:

list_tools()=await self.session.list_tools(),返回result.tools。call_tool()=await self.session.call_tool(tool_name, tool_input)。

使用流程 = 客户端获取要发送给 Claude 的工具定义,然后在 Claude 请求时执行这些工具。

常见模式 = 将客户端会话包装在更大的类中进行资源管理,而不是直接使用会话。

测试 = 可以直接运行客户端文件,使用测试工具来验证服务器连接和工具检索。

集成 = 项目中的其他代码调用客户端函数与 MCP 服务器交互,使 Claude 能够通过定义的工具检查/编辑文档。

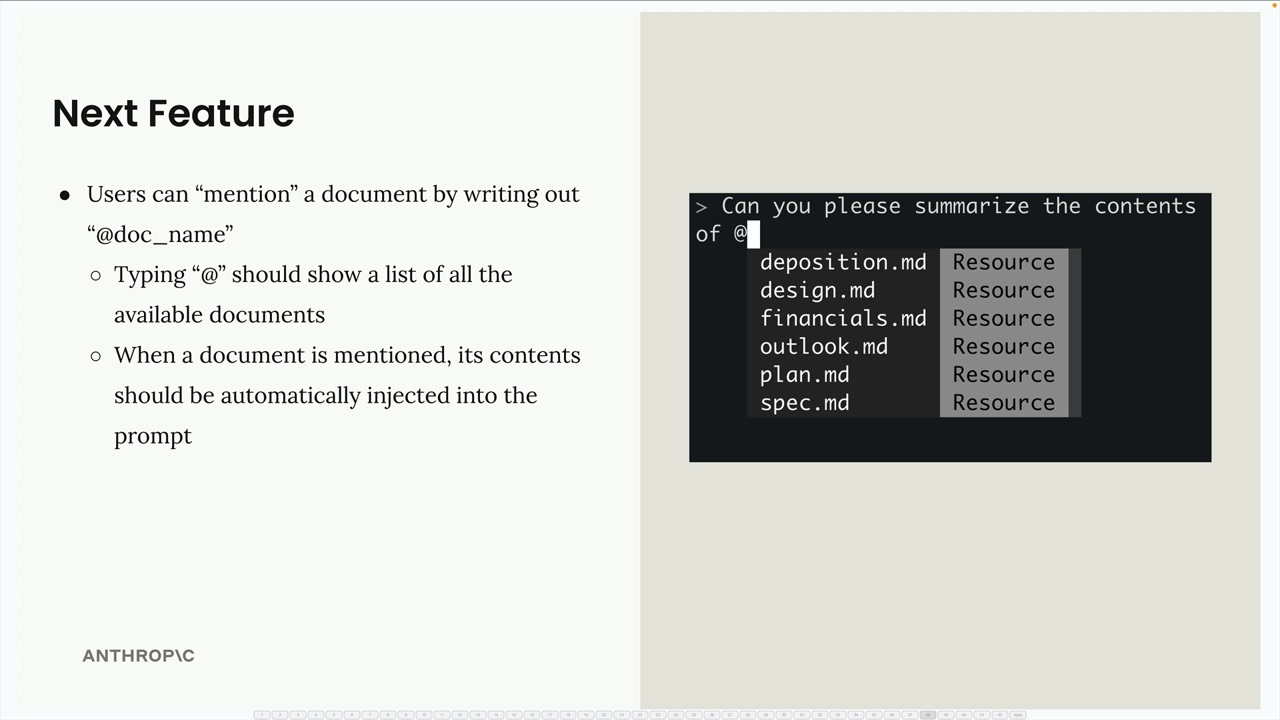

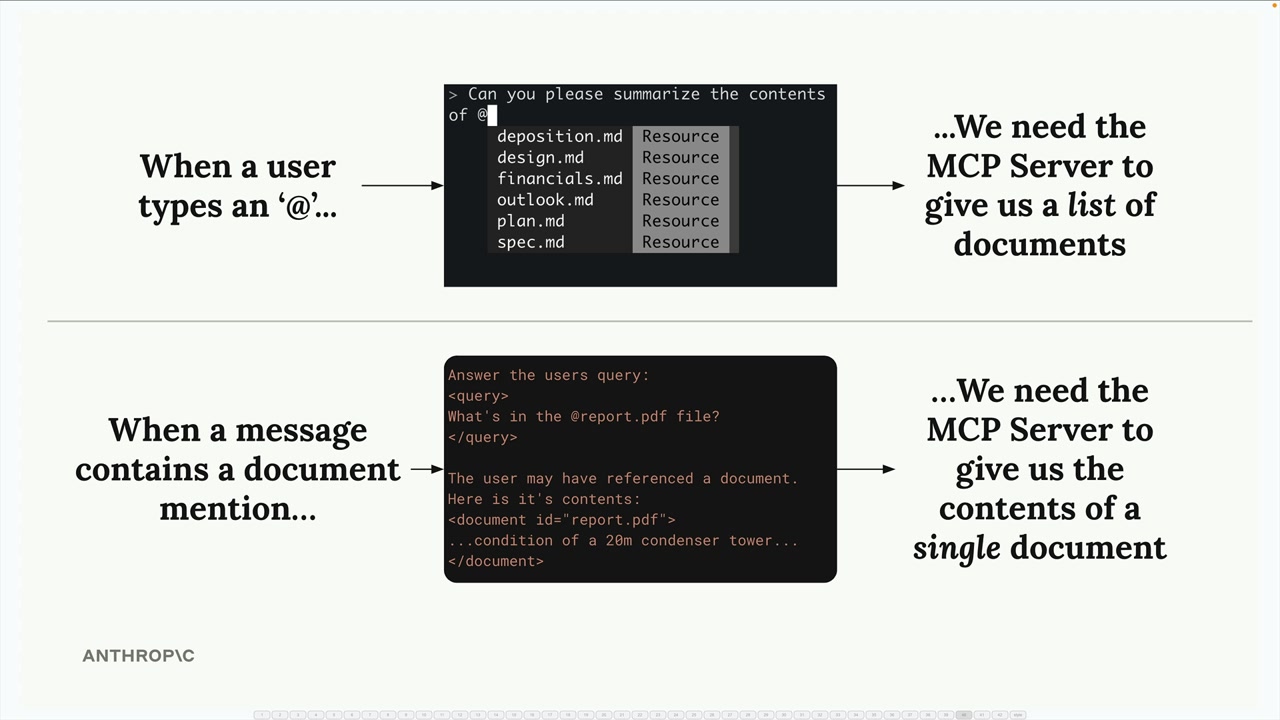

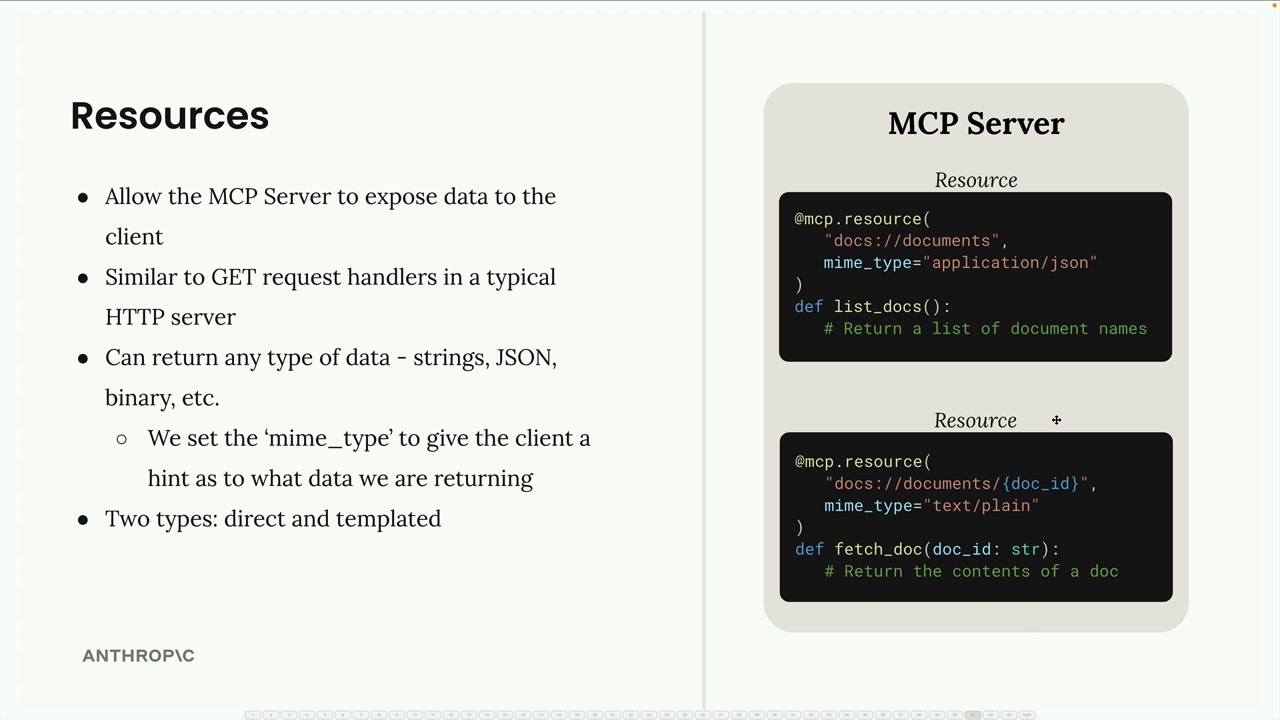

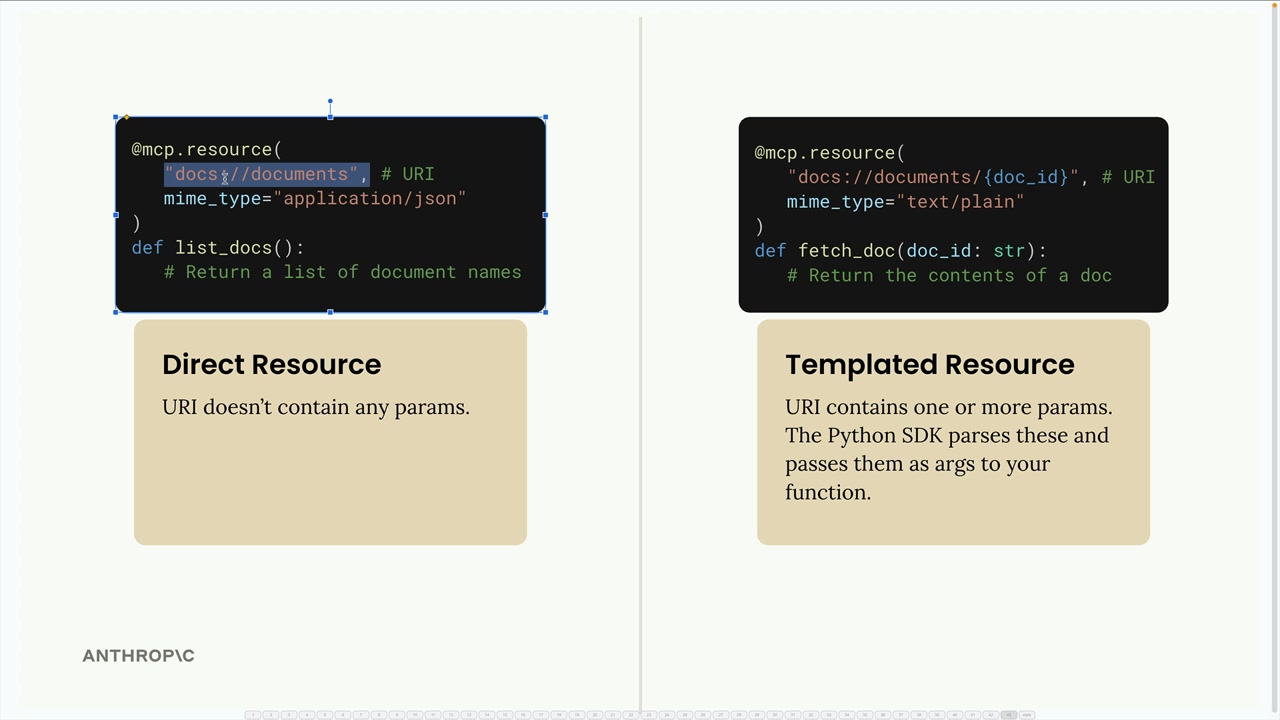

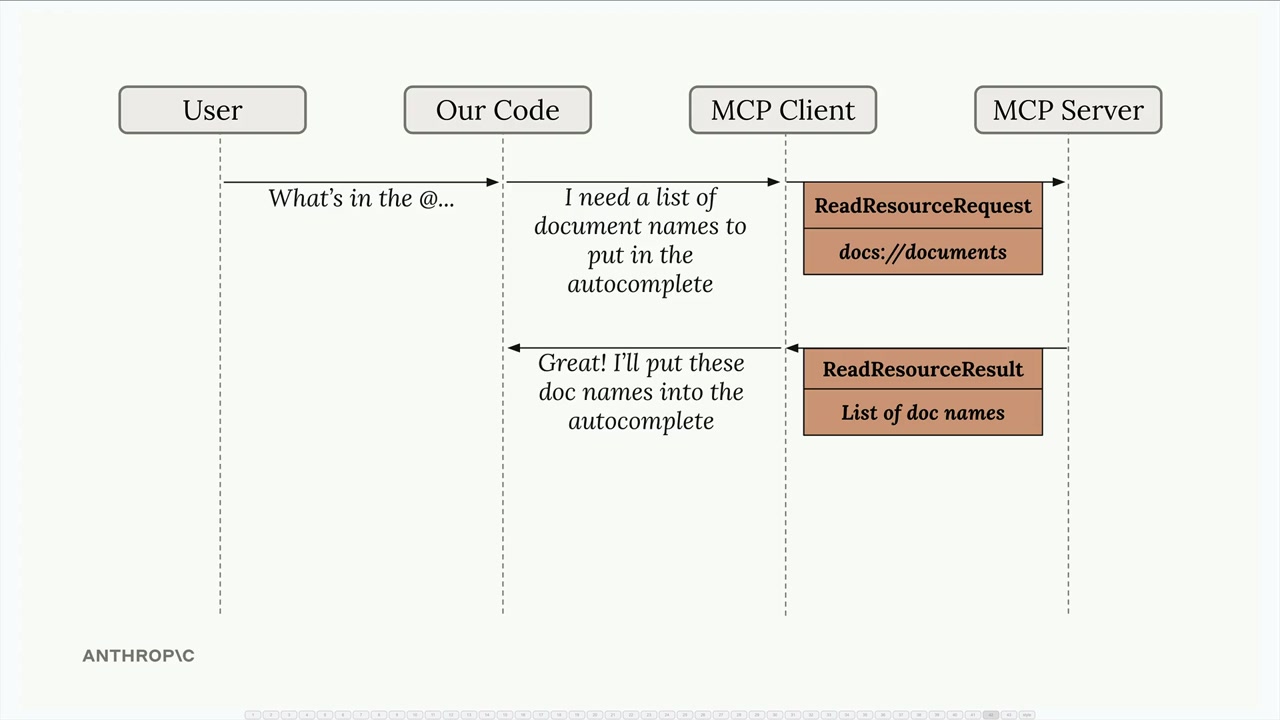

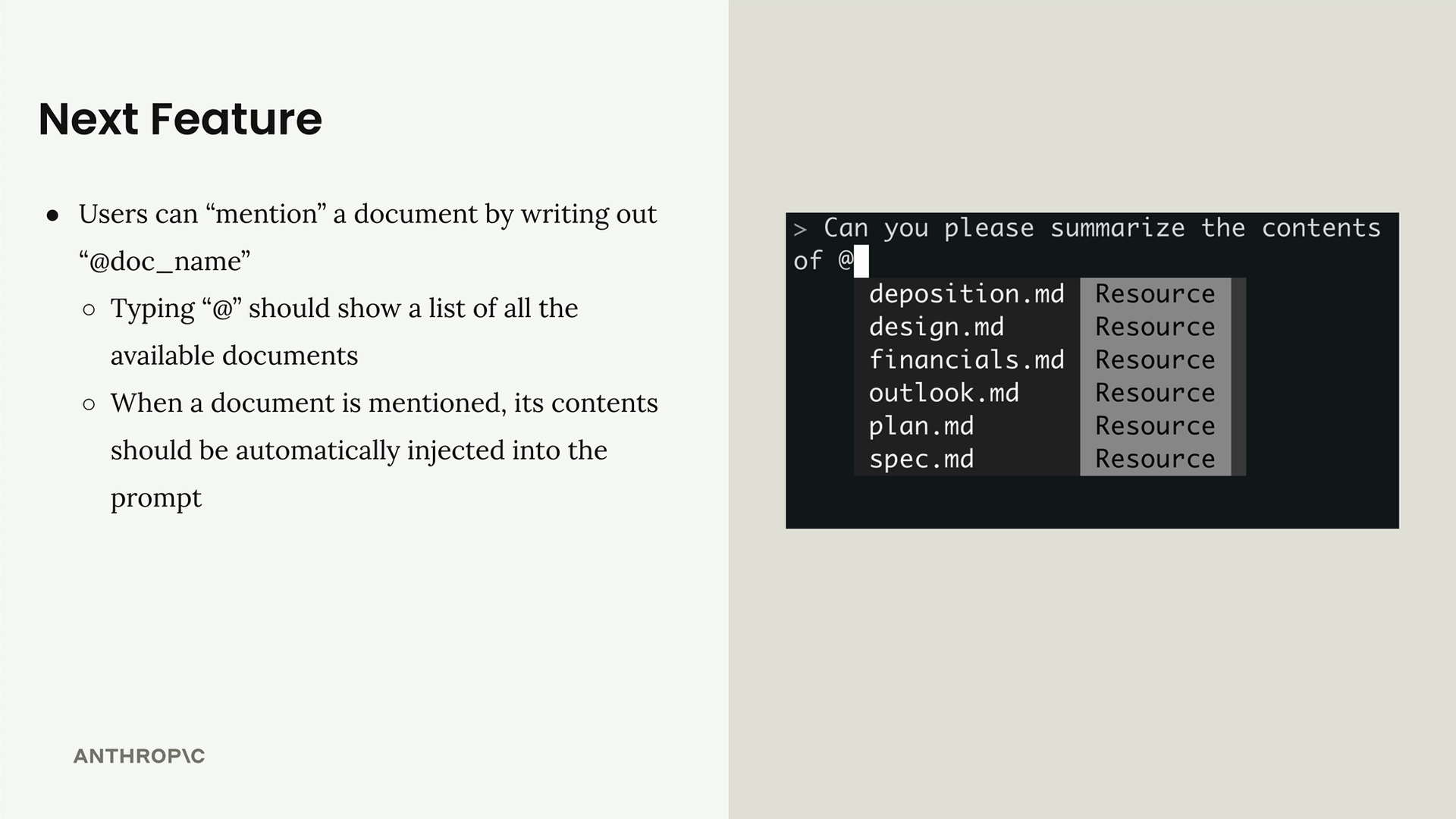

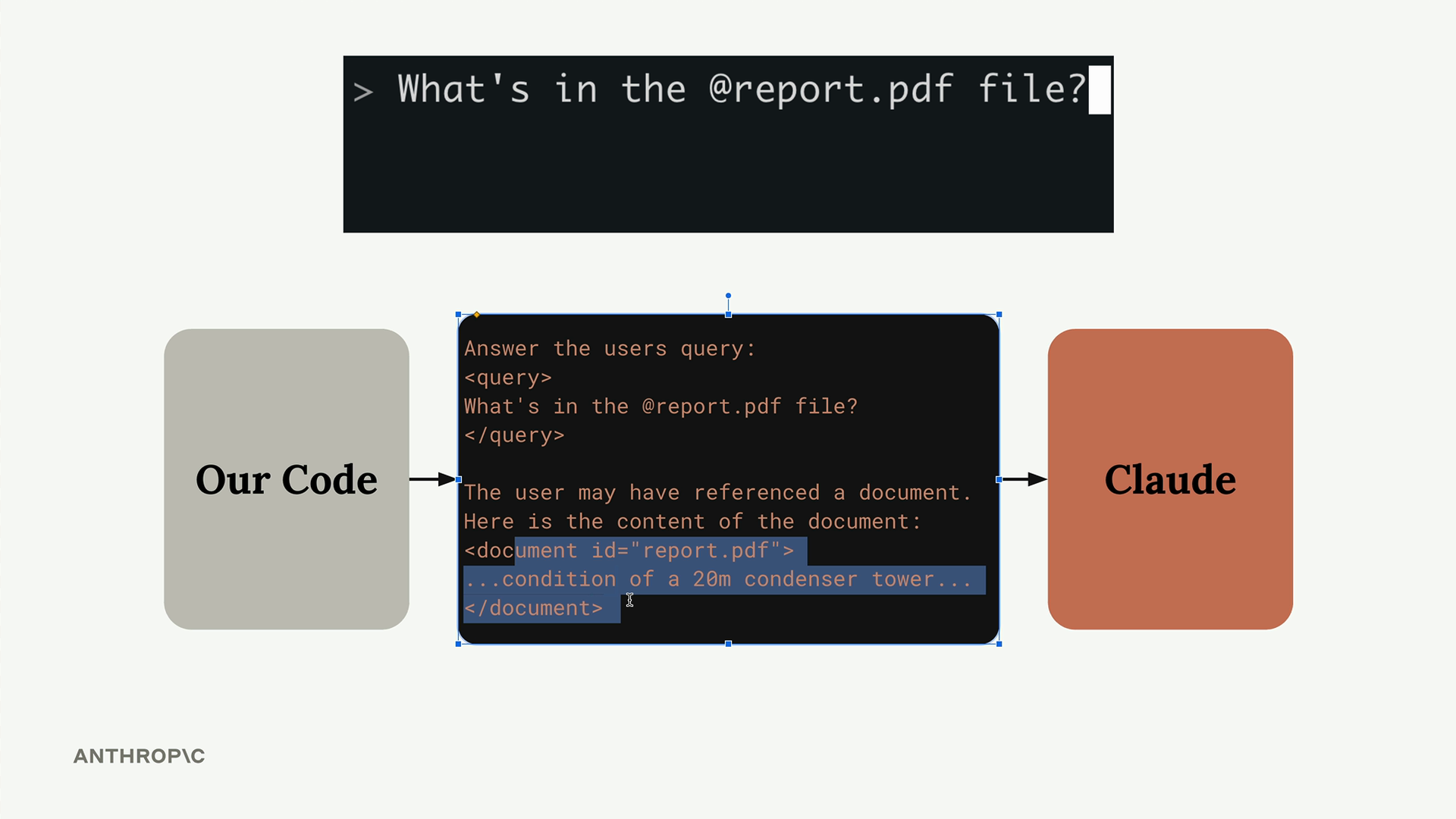

定义资源

MCP Resources (MCP 资源) = 一种允许 MCP 服务器向客户端暴露数据以供读取操作的机制。

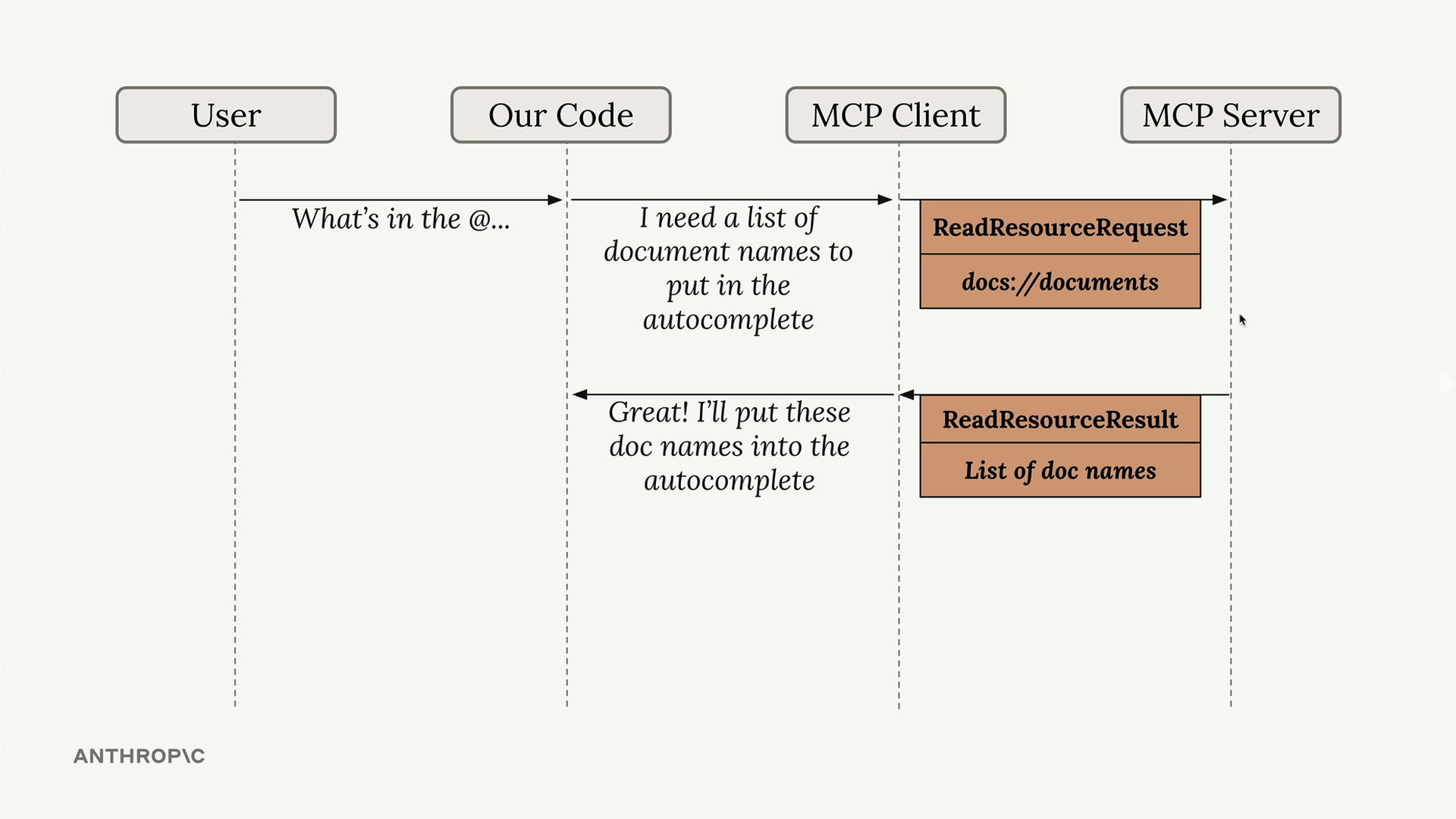

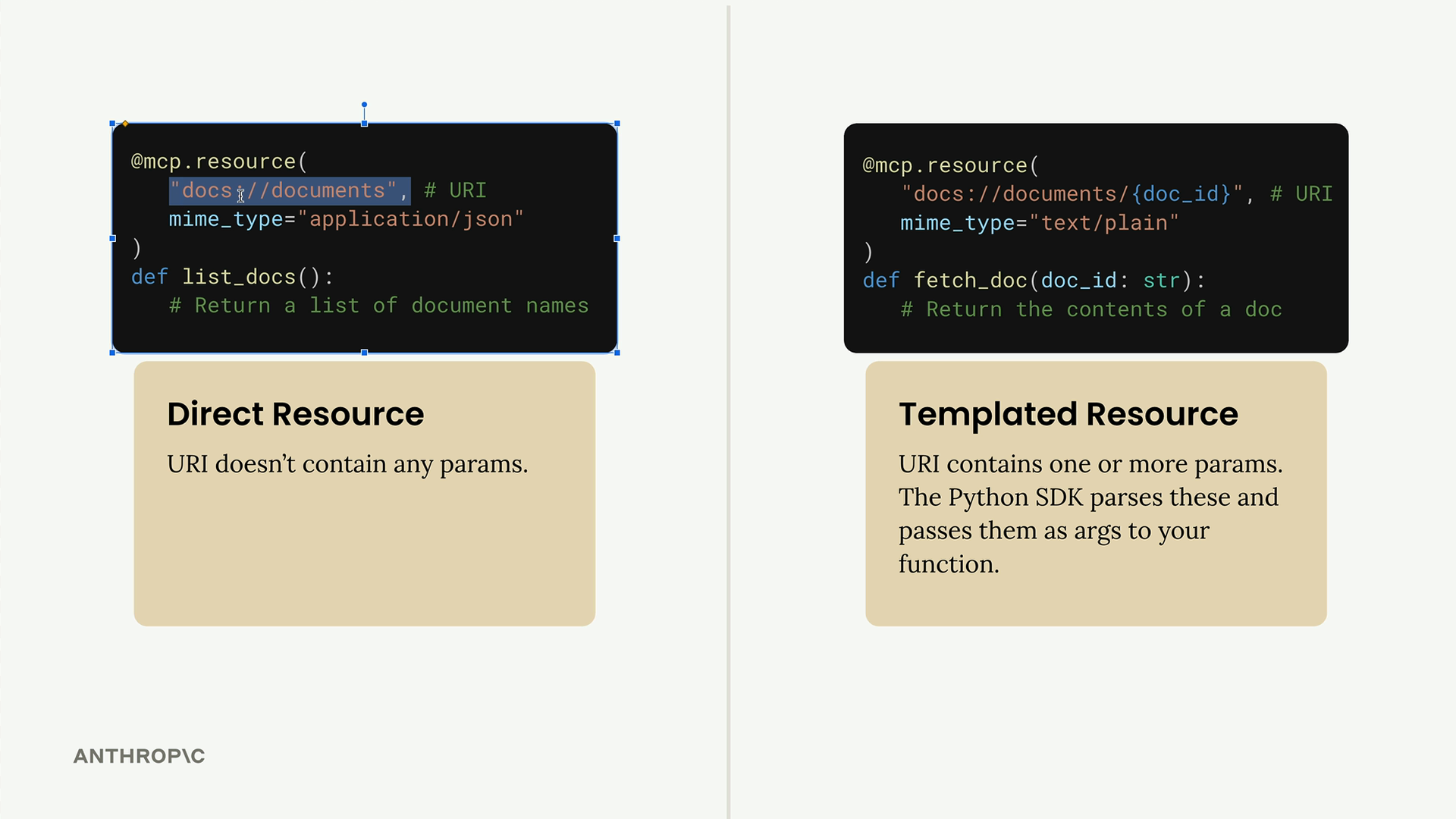

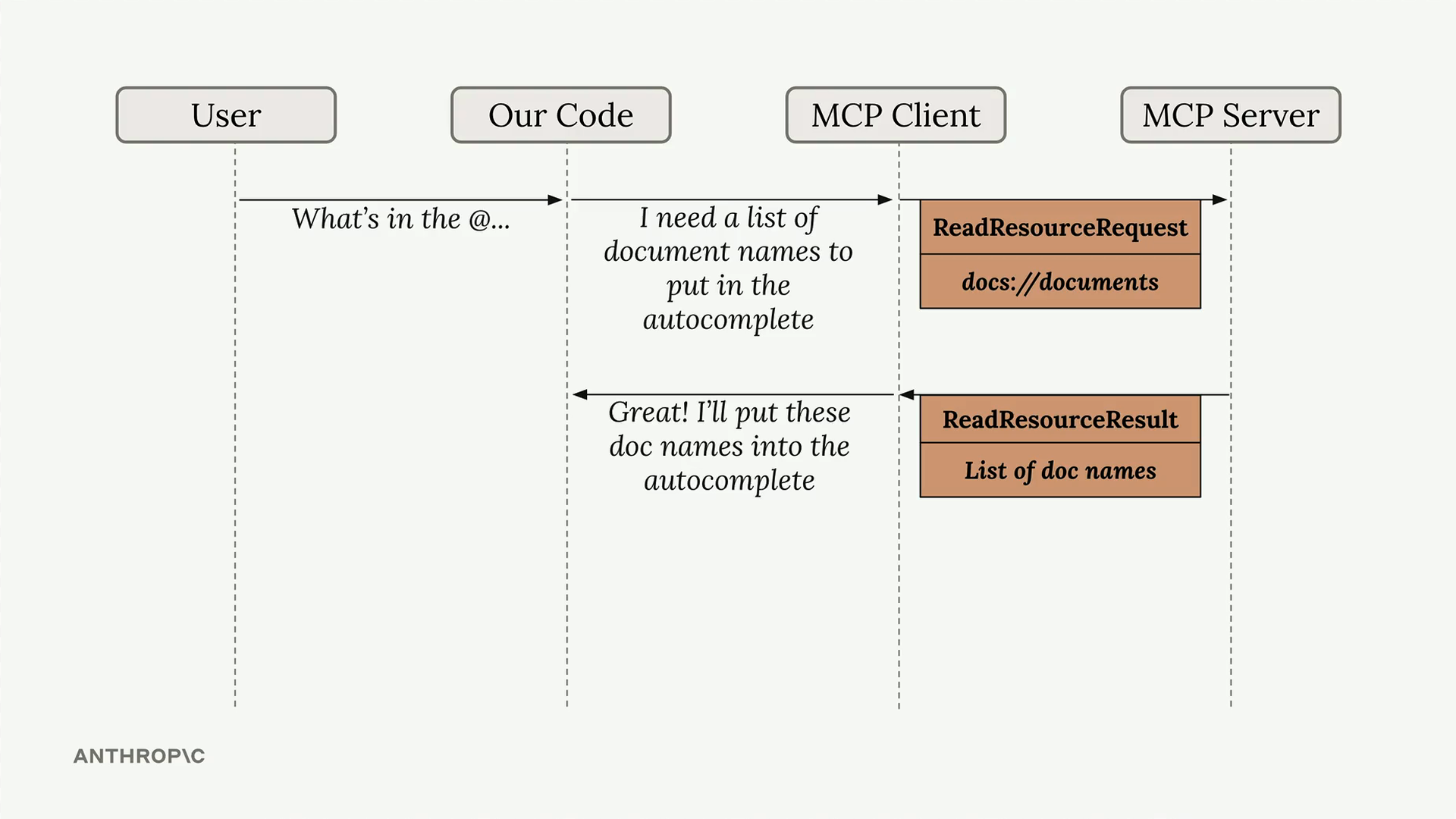

资源类型 = 两种类型:直接型(静态 URI (统一资源标识符),如 "docs://documents")和模板型(参数化 URI,如 "docs://documents/{doc_id}")。

URI = 用于访问特定资源的地址/标识符,在创建资源时定义。

资源流程 = 客户端发送带有 URI 的读取资源请求 → 服务器将 URI 匹配到函数 → 服务器执行函数 → 在读取资源结果中返回数据。

实现 = 使用带有 URI 和 MIME Types 参数的 @mcp.resource 装饰器。

MIME Types = 向客户端提示返回数据格式的线索(application/json 用于结构化数据,text/plain 用于纯文本)。

模板化资源 = URI 参数由 SDK 自动解析,并作为关键字参数传递给处理函数。

资源 vs 工具 = 资源主动提供数据(当被@提及时获取文档内容),而工具被动执行动作(当 Claude 决定调用它们时)。

数据返回 = SDK 自动将返回的数据序列化为字符串,客户端负责反序列化。

测试 = MCP 检查器可以分别列出直接资源和模板化资源,并允许测试单个资源调用。

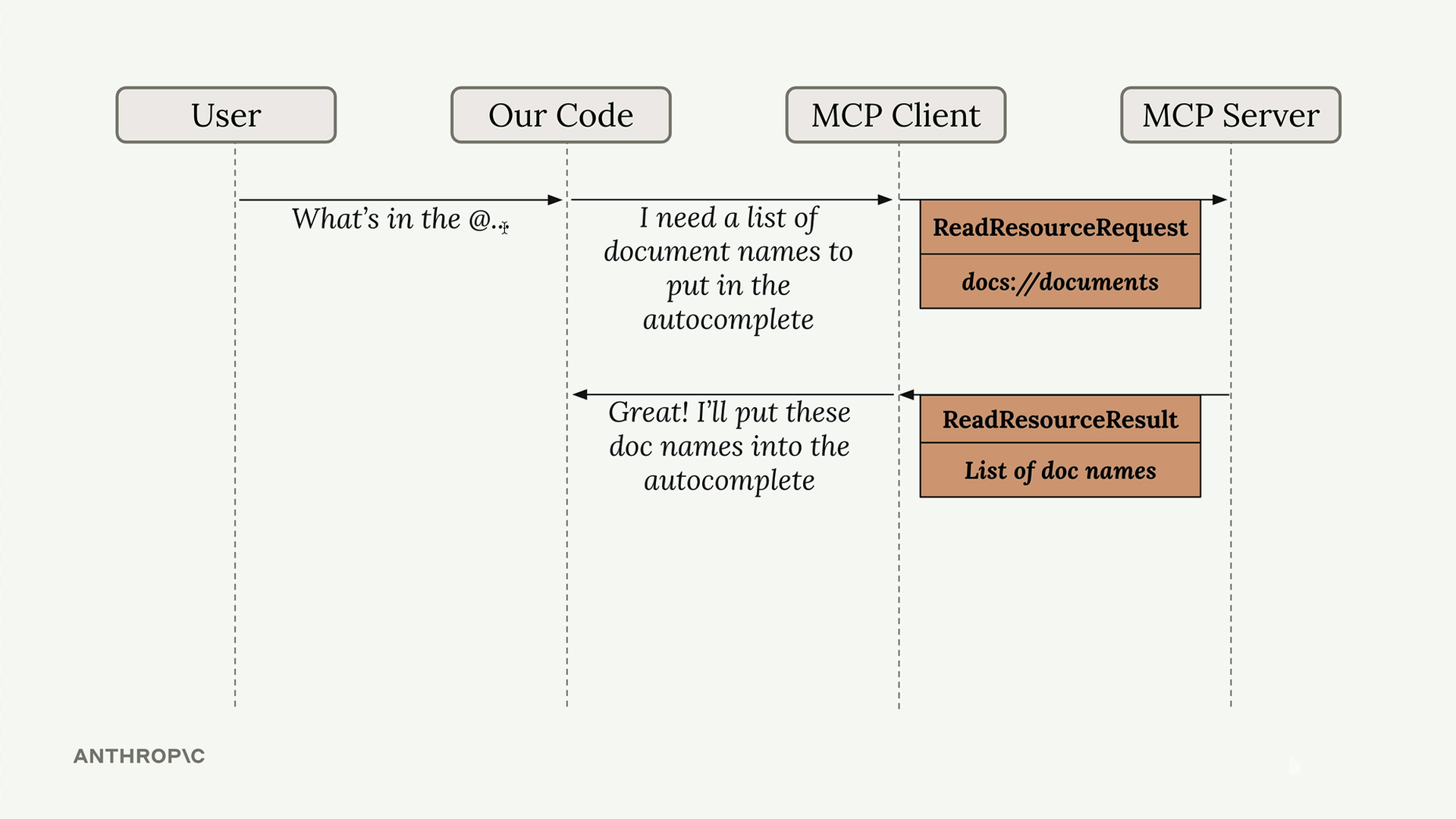

访问资源

MCP 资源访问实现:

资源读取函数 = 用于从 MCP 服务器请求和解析资源的客户端函数。

函数参数 = URI (资源标识符)。

实现步骤:

- 从

pydantic导入json模块 +AnyURL。 - 调用

await self.session.read_resource(AnyURL(uri))。 - 从

result.contents[0]中提取第一个元素。 - 检查

resource.mime_type以确定解析策略。

内容解析逻辑:

- 如果

mime_type == "application/json"→ 返回json.loads(resource.text)。 - 否则 → 返回

resource.text(纯文本)。

服务器响应结构 = result.contents 列表,其第一个元素包含 type/mime_type 元数据。

资源集成 = MCP 客户端函数由其他应用程序组件调用,以获取文档内容用于提示词。

最终结果 = 文档内容自动包含在 Claude 提示词中,无需调用工具。

关键点 = 资源通过结构化的请求/响应模式直接向客户端暴露服务器信息。

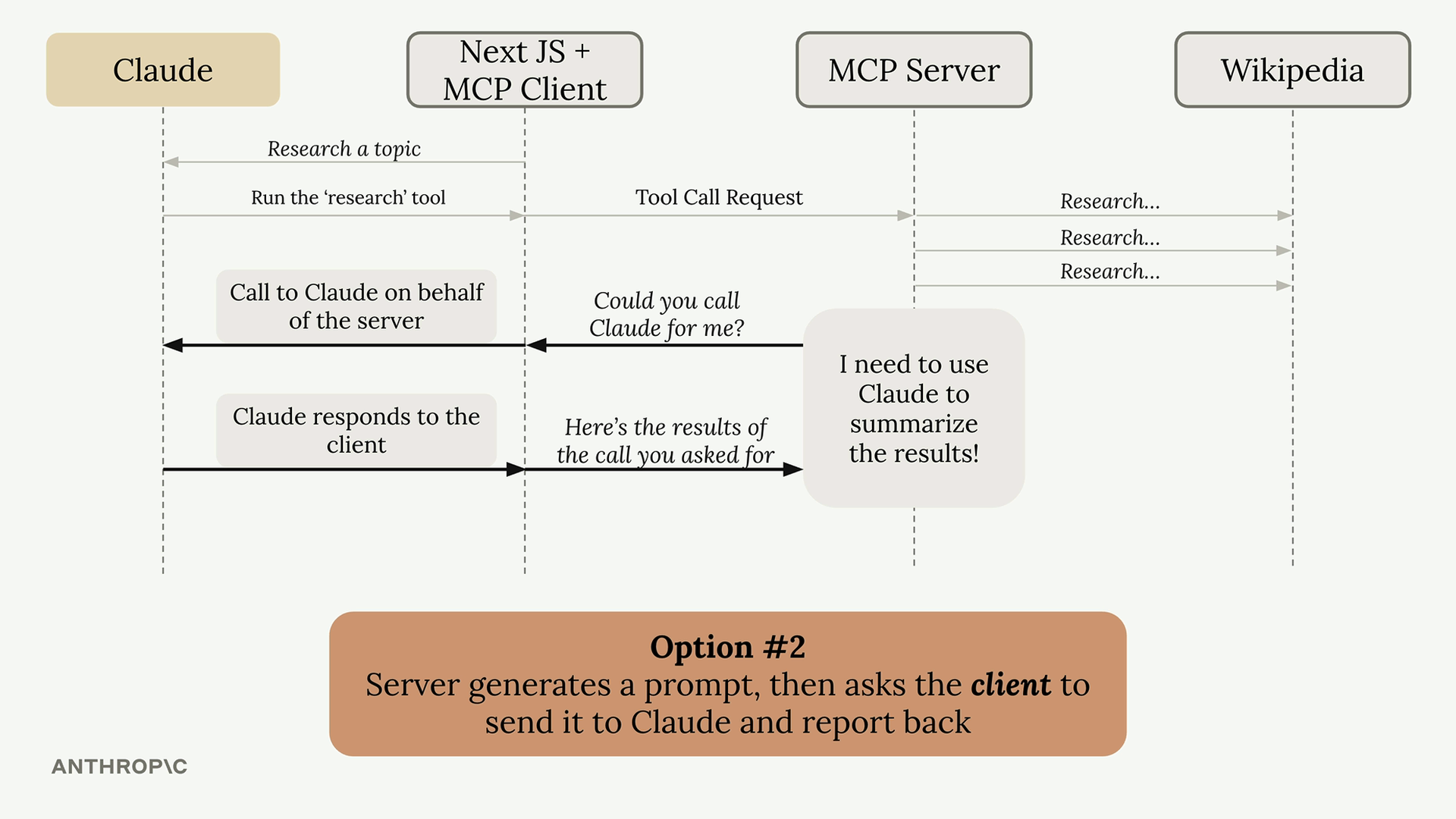

定义提示词

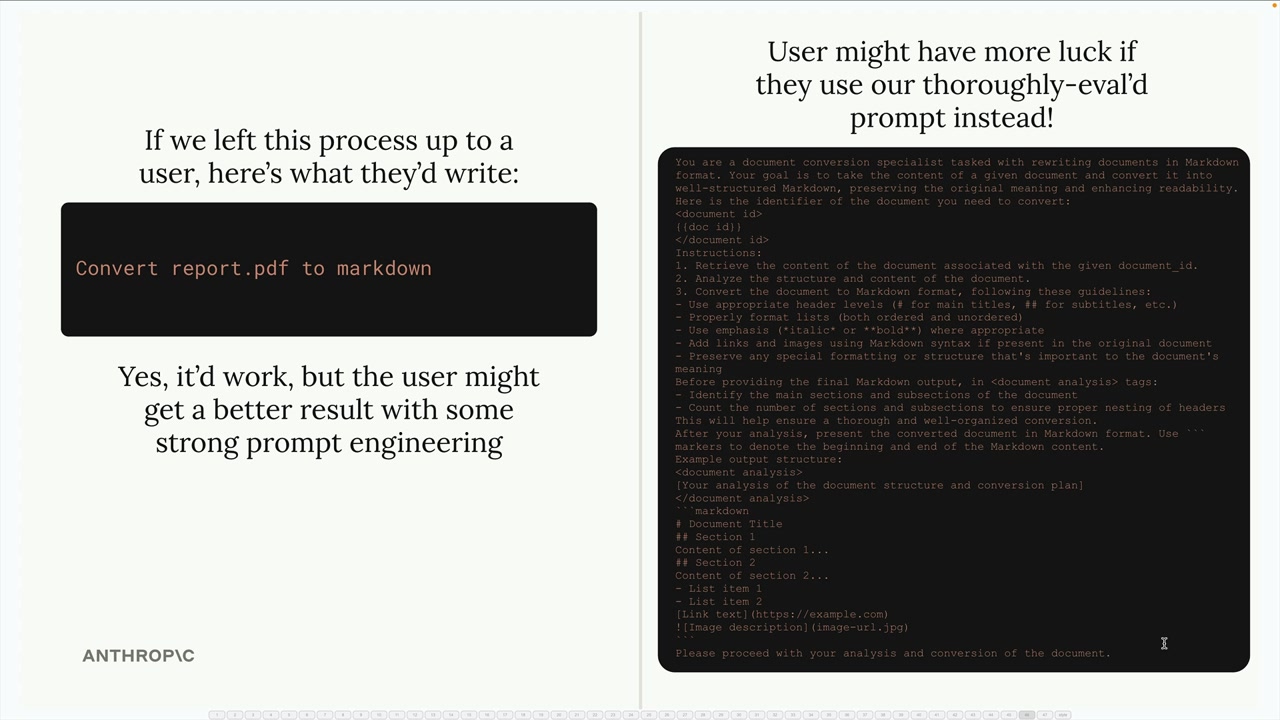

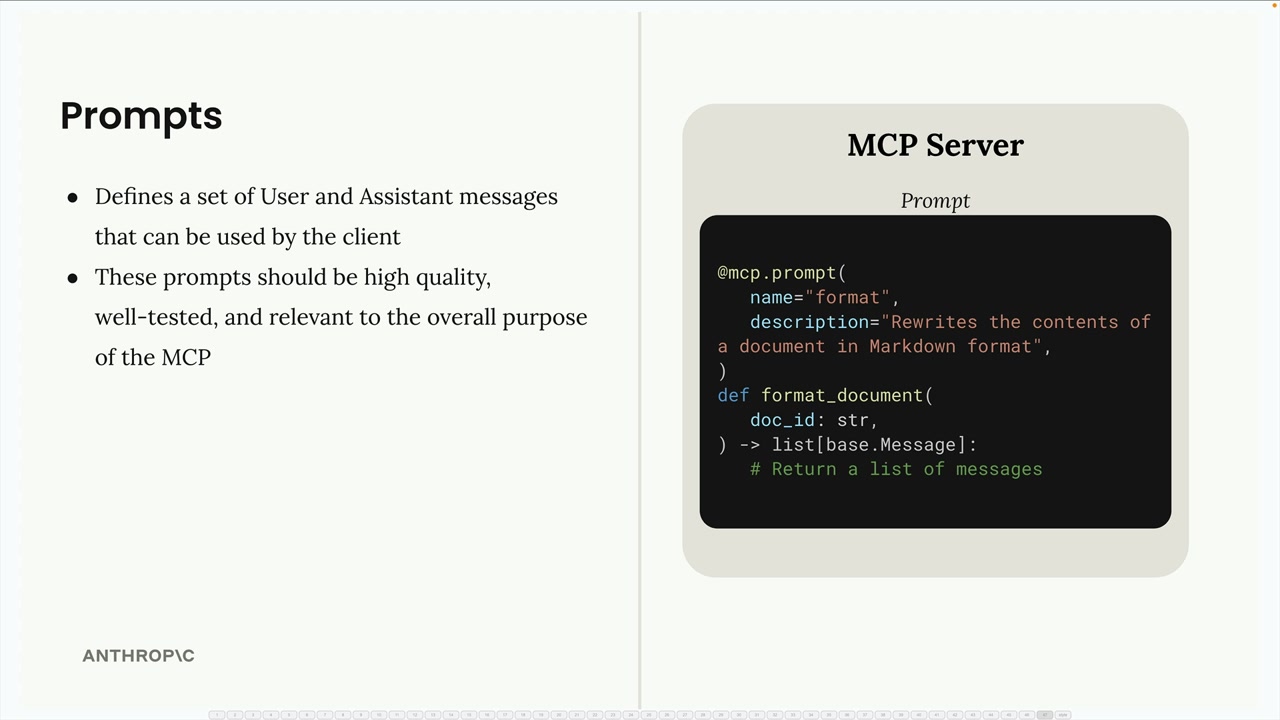

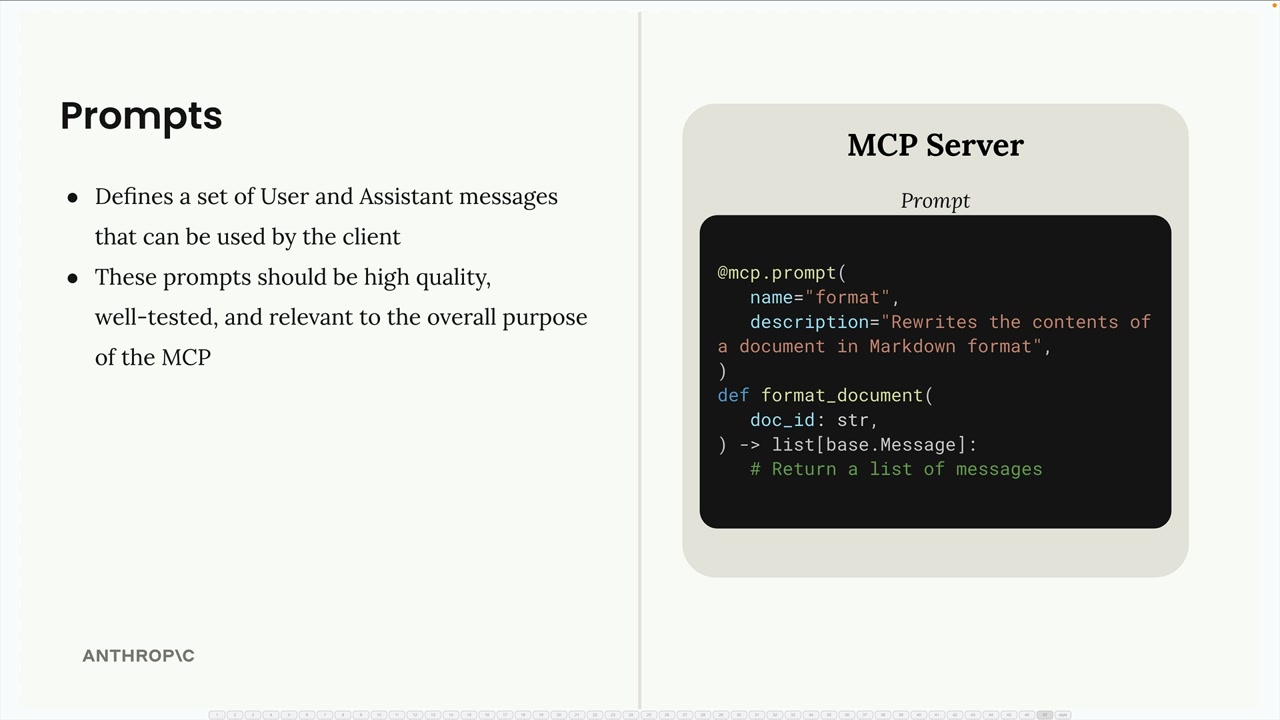

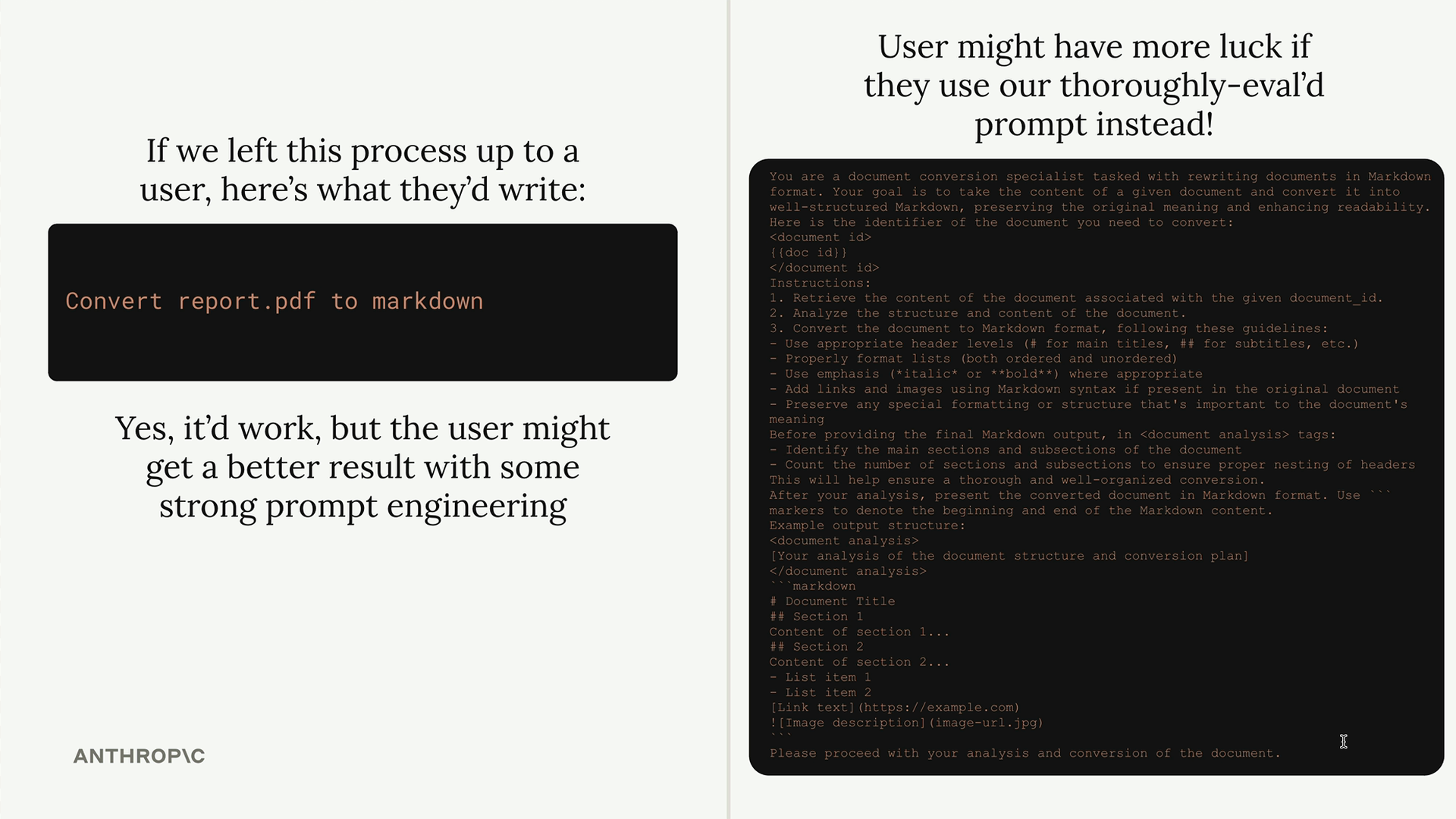

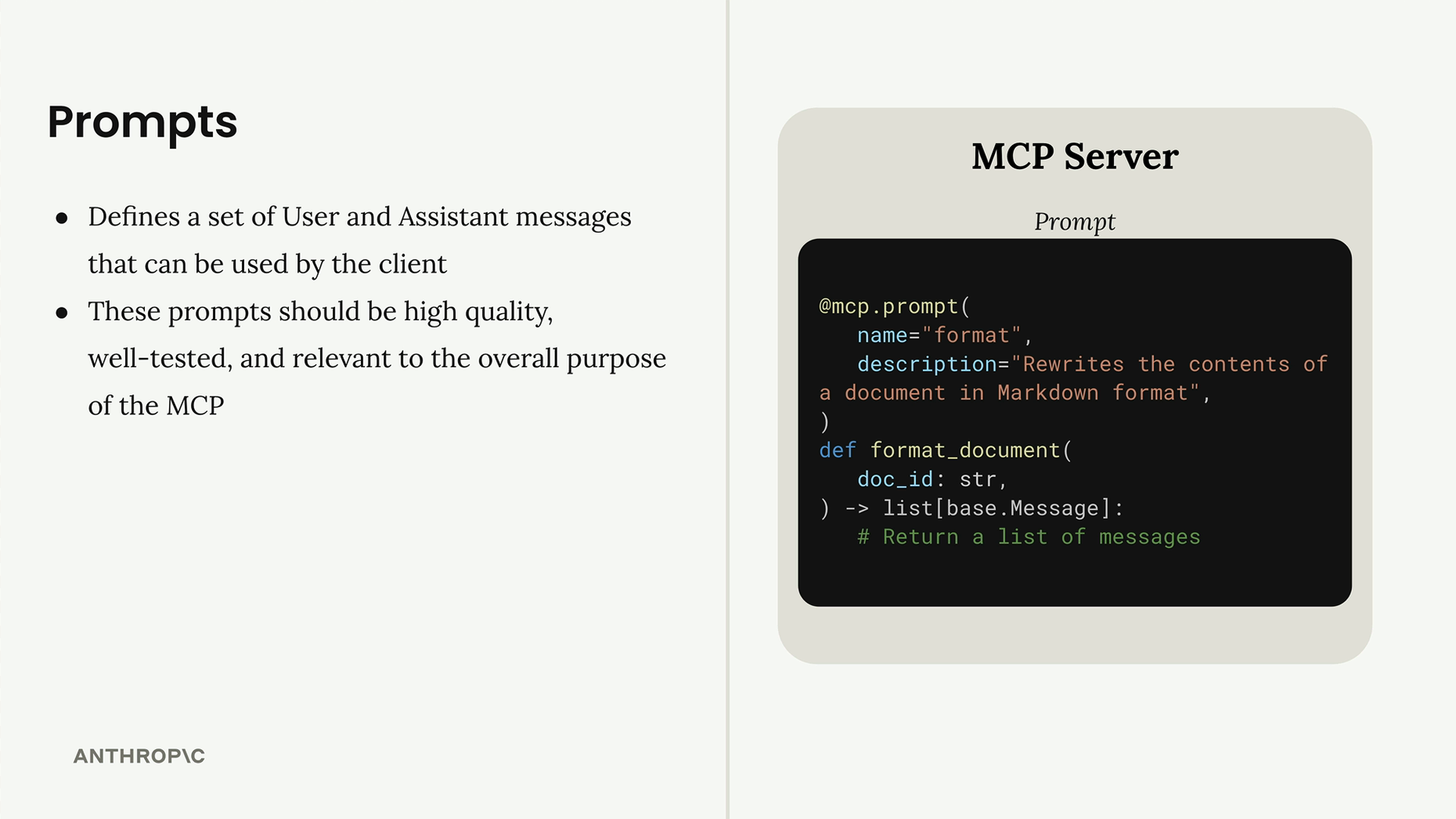

MCP Prompts (MCP 提示词) = MCP 服务器向客户端应用程序暴露的、用于特定任务的预定义、经过测试的提示词模板。

目的 = 服务器作者创建针对其服务器领域量身定制的高质量、经过评估的提示词,而不是让用户编写临时提示词。

实现 = 使用 @mcpserver.prompt 装饰器,并附带名称/描述,定义一个返回消息列表的函数(可以直接发送给 Claude 的用户/助手消息)。

用例示例 = 一个文档格式化提示词,它接收文档 ID,指示 Claude 使用工具读取文档,将其重新格式化为 markdown,并保存更改。

主要优点 = 特定于服务器的专业知识,预先测试的质量,可在客户端应用程序间重用,比用户生成的提示词效果更好。

消息结构 = 返回包含格式化提示词文本(已插入参数)的 base.UserMessage 对象。

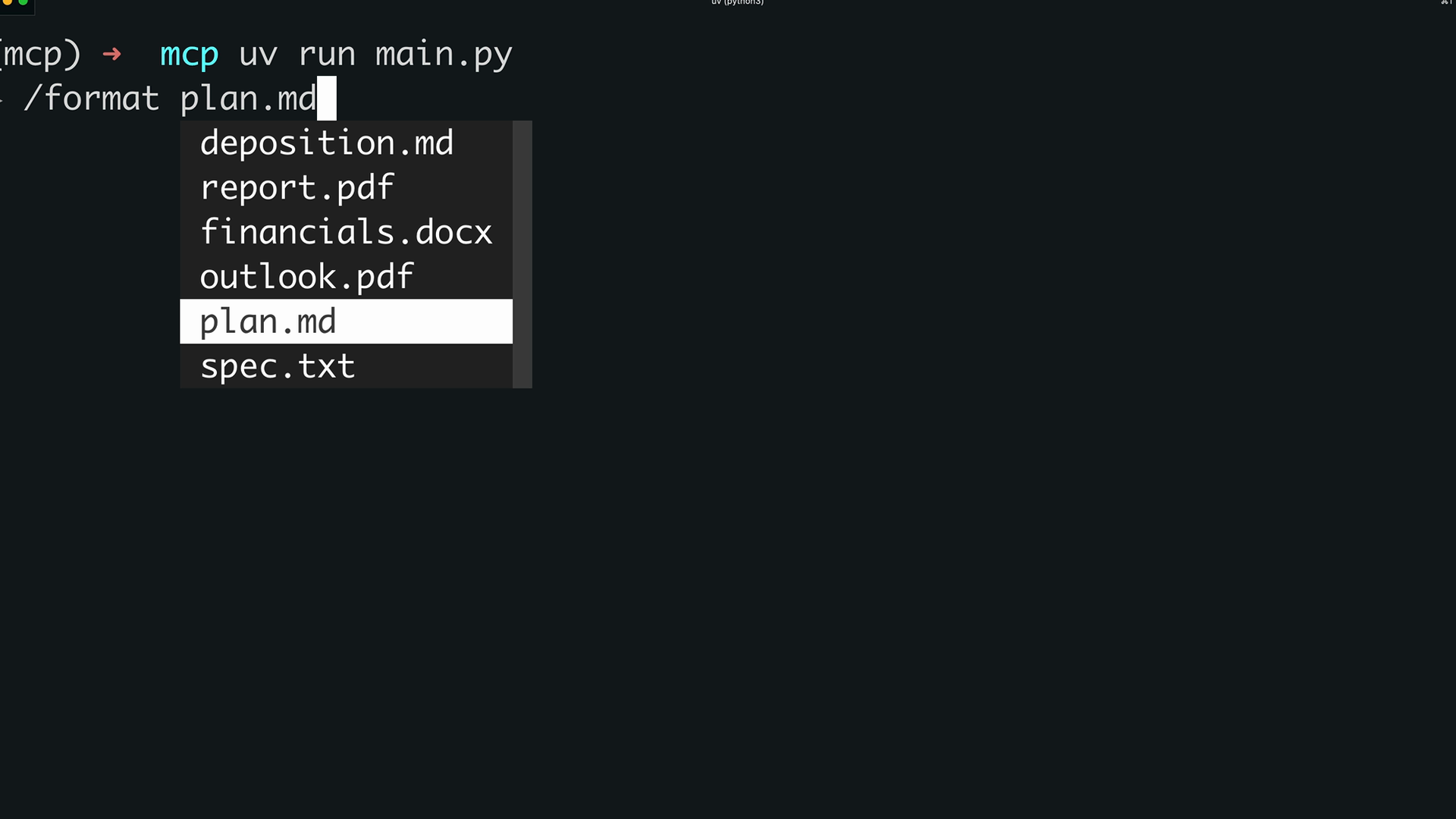

客户端集成 = 提示词在客户端应用程序中作为自动完成选项(斜杠命令)出现,提示用户输入所需参数,然后执行预构建的提示词工作流。

客户端中的提示词

MCP 客户端提示词实现:

列出提示词 = await self.session.list_prompts(),返回 result.prompts。 获取提示词 = await self.session.get_prompt(prompt_name, arguments),返回 result.messages。

提示词工作流程:

- 在

MCP服务器中定义提示词及其预期参数(例如,document_id)。 - 客户端使用提示词名称 + 参数字典调用

get_prompt。 - 参数作为关键字参数传递给提示词函数。

- 函数将参数插入到提示词文本中。

- 返回一个消息数组,可直接提供给大语言模型。

核心概念:提示词是服务器定义的模板,客户端可以用特定参数调用这些模板,为大语言模型生成带有上下文的指令。参数从客户端调用 → 提示词函数 → 插入参数的提示词文本 → 大语言模型消费。

Anthropic 应用

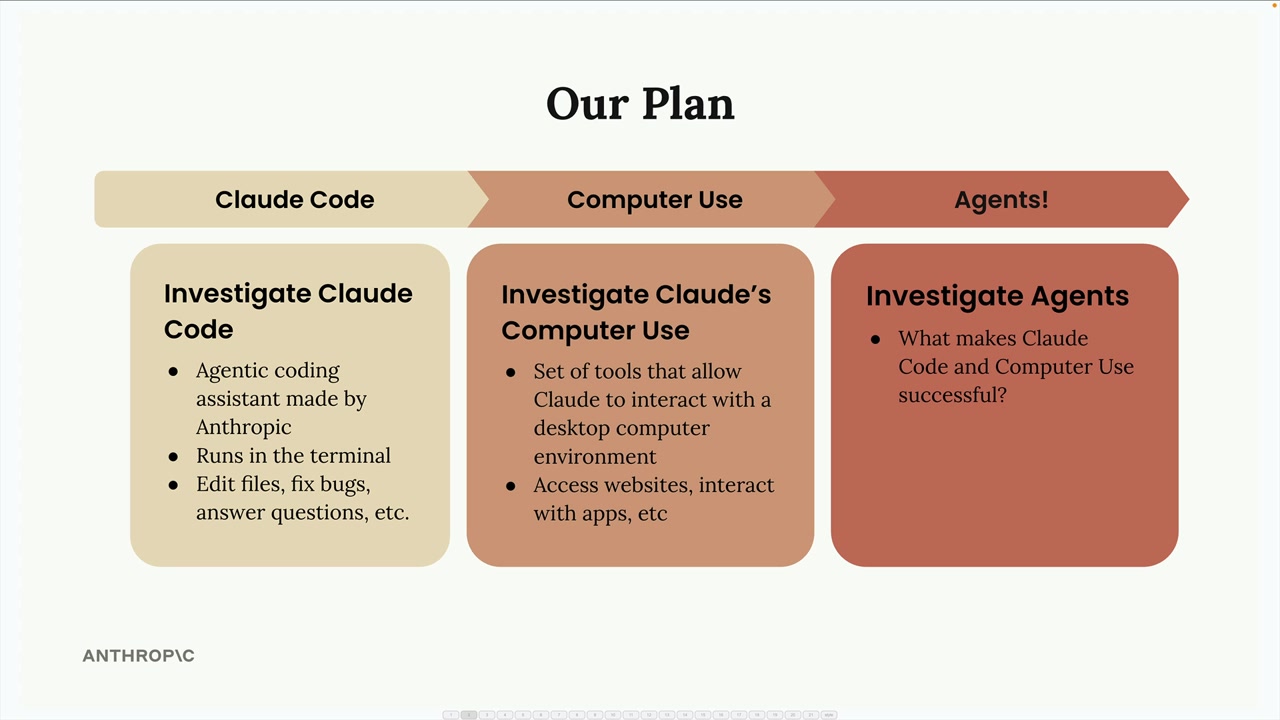

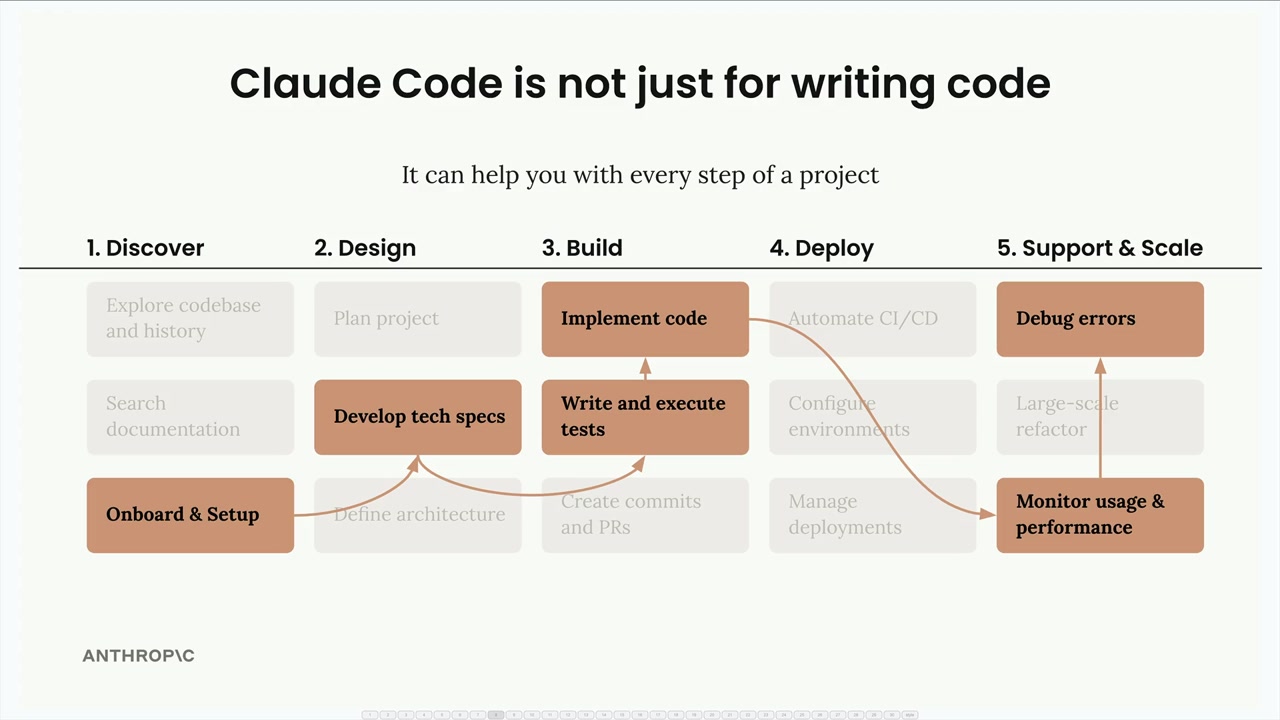

Anthropic 应用 = Anthropic 部署的两个应用程序:Claude Code 和 Computer Use。

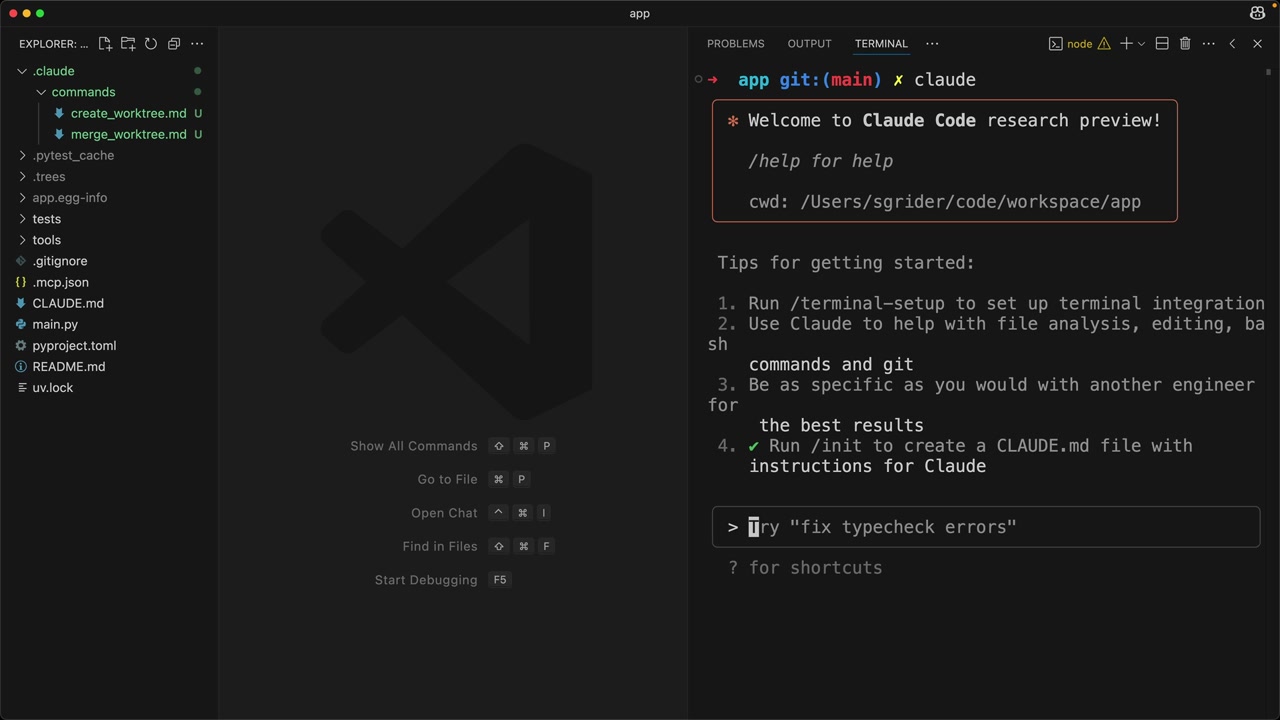

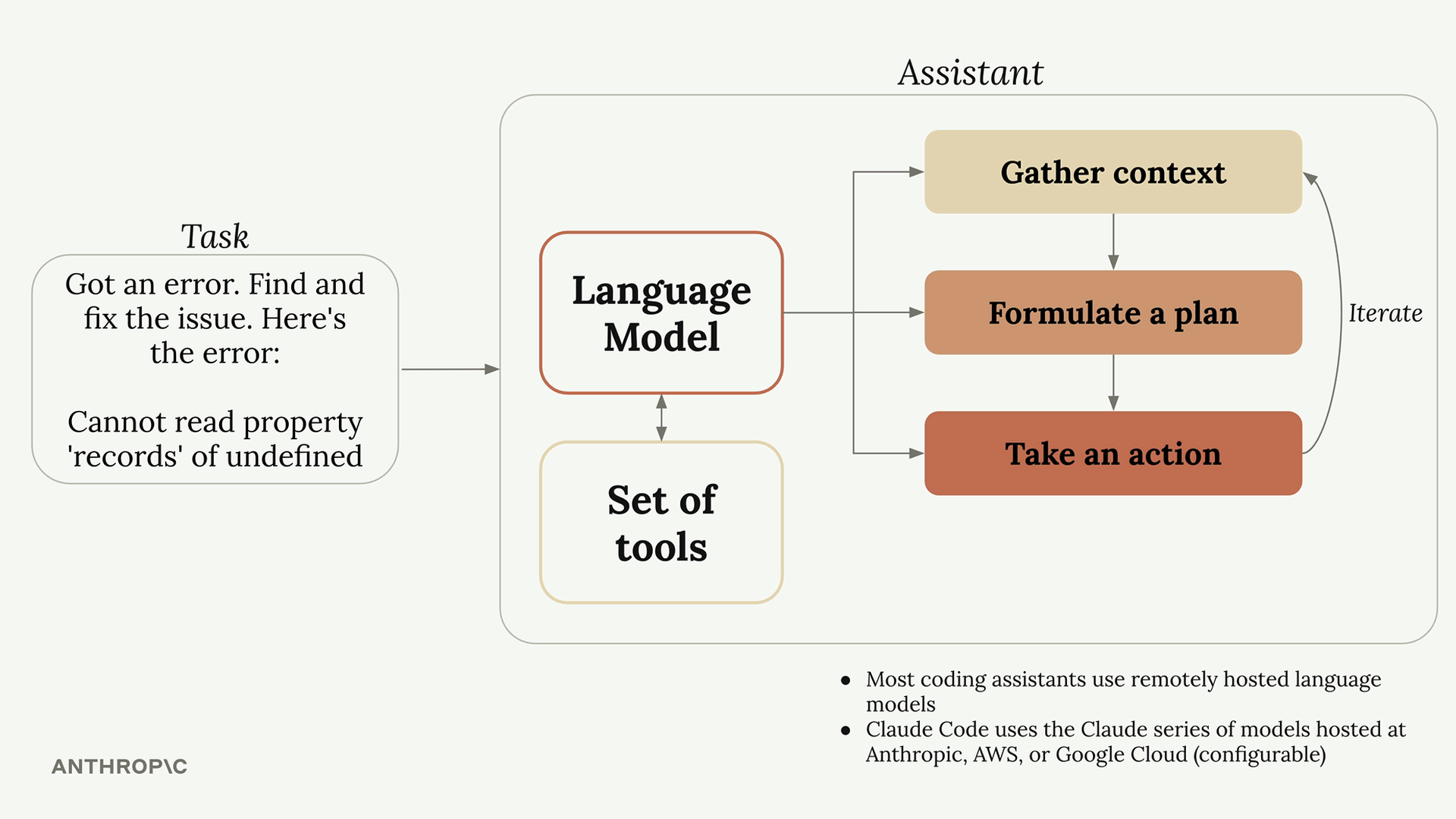

Claude Code = 一个基于终端的编码助手,是智能体架构的一个示例。

Computer Use = 一个扩展 Claude 能力超出文本生成范围的工具集。

主要目的 = 这些应用展示了 agents (智能体) 的概念,并为理解智能体设计和实现提供了实际示例。

设置过程 = 涉及为在示例项目上使用 Claude Code 进行终端配置。

与智能体的联系 = 这两个应用都体现了智能体的工作方式,可作为构建高效智能体的学习模型。

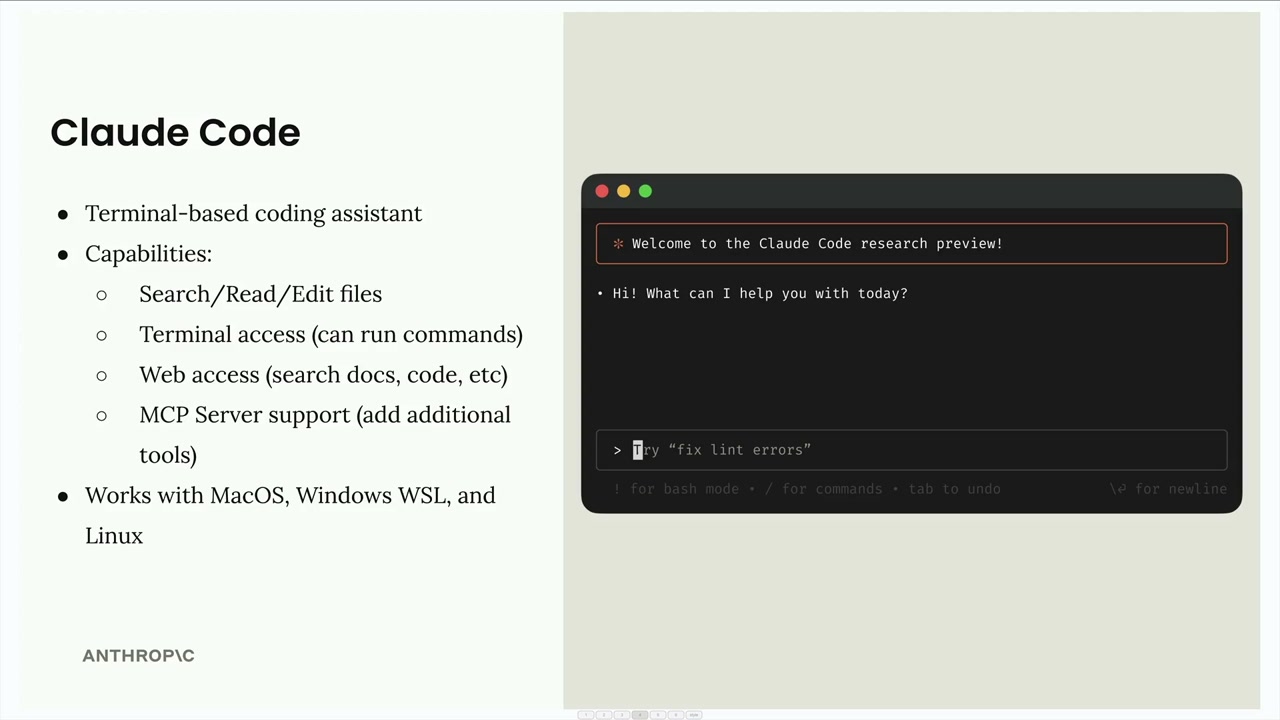

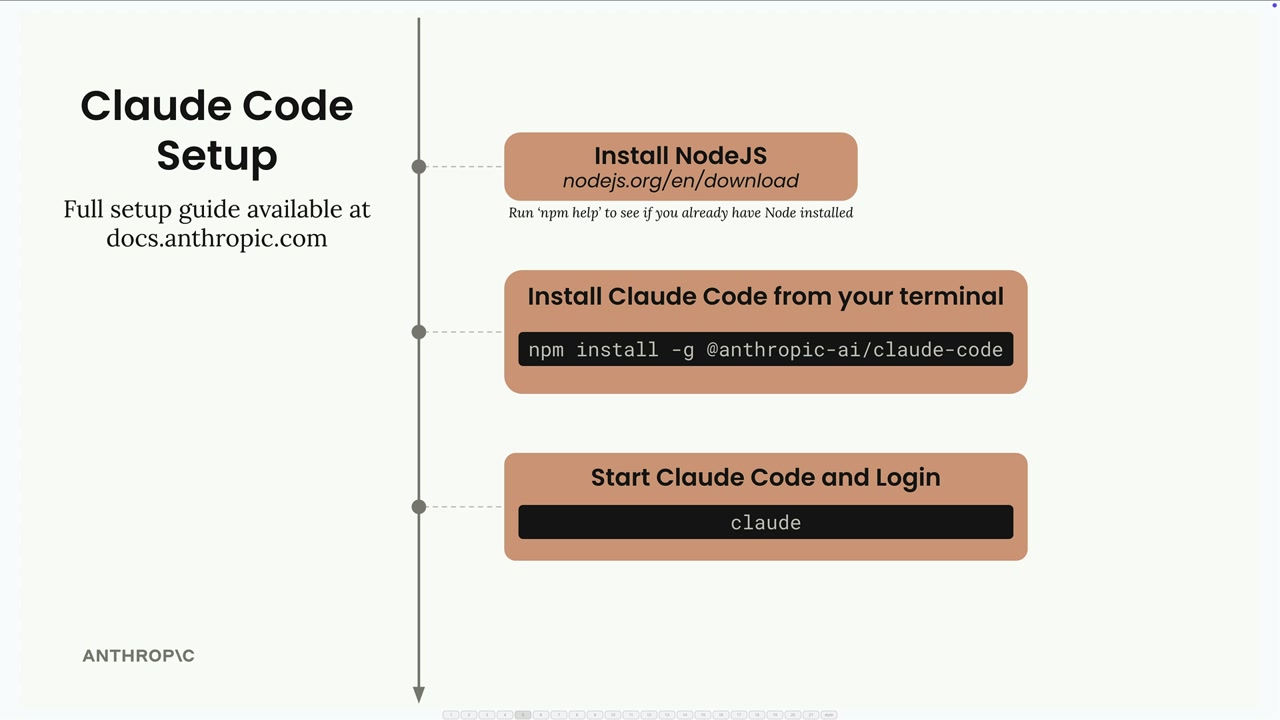

Claude Code 设置

Claude Code = 一个基于终端的编码助手程序,帮助完成与代码相关的任务。

核心能力 = 搜索/读取/编辑文件 + 高级工具(网络抓取、终端访问)+ MCP 客户端支持,以通过 MCP 服务器扩展功能。

设置过程:

- 安装

Node.js(用npm help命令检查)。 - 运行

npm install安装 Claude Code。 - 在终端执行

claude命令以登录到 Anthropic 账户。

完整设置指南 = docs.anthropic.com。

MCP 客户端功能 = 可以消费来自 MCP 服务器的工具,以扩展其超出基本文件操作的能力。

Claude Code 实战

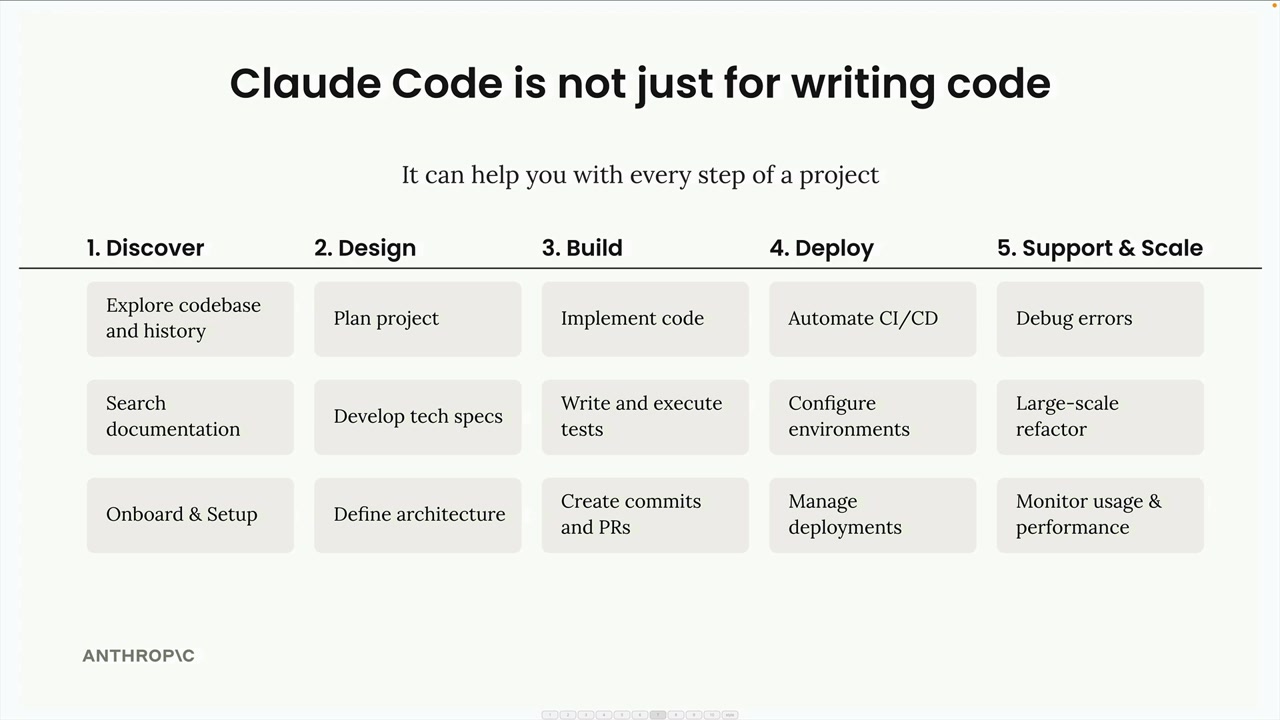

Claude Code = 一个 AI 编码助手,它在项目上扮演合作工程师的角色,而不仅仅是一个代码生成器。

主要能力:项目设置、功能设计、代码编写、测试、部署、生产环境错误修复。

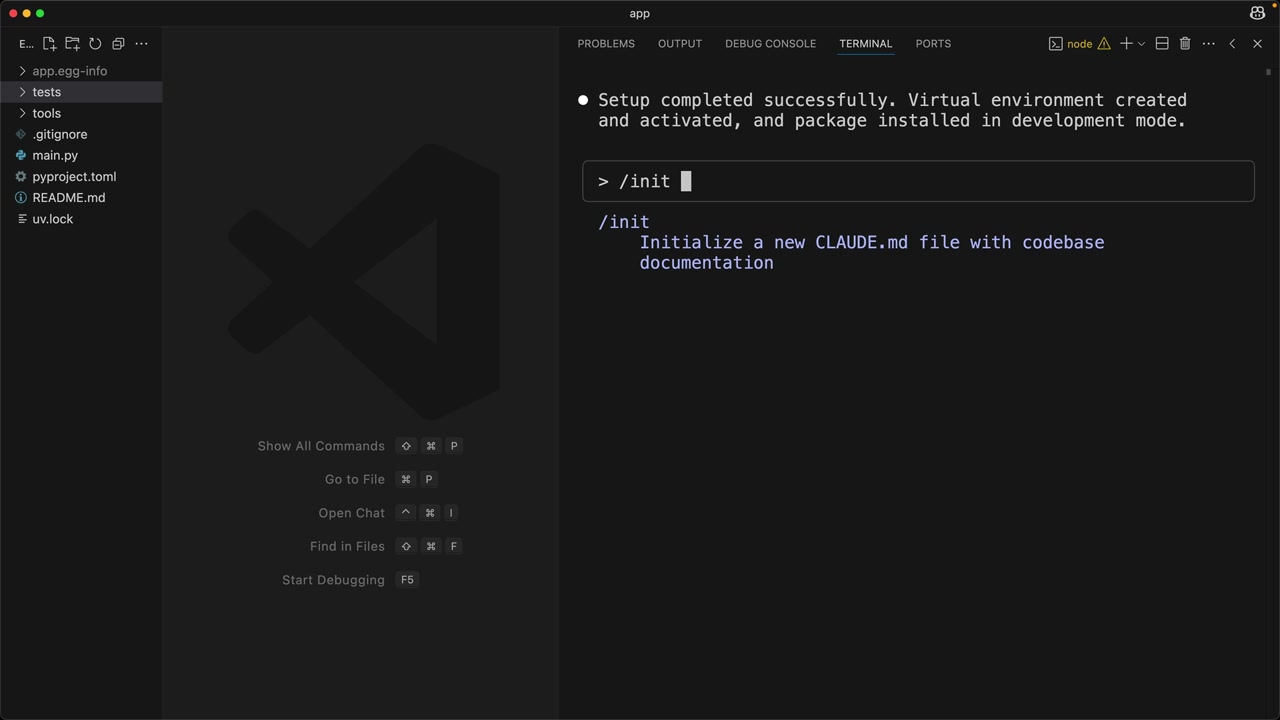

设置工作流:

- 下载项目,在编辑器中打开。

- 运行

claude命令启动。 - 要求 Claude 阅读 README 并执行设置说明。

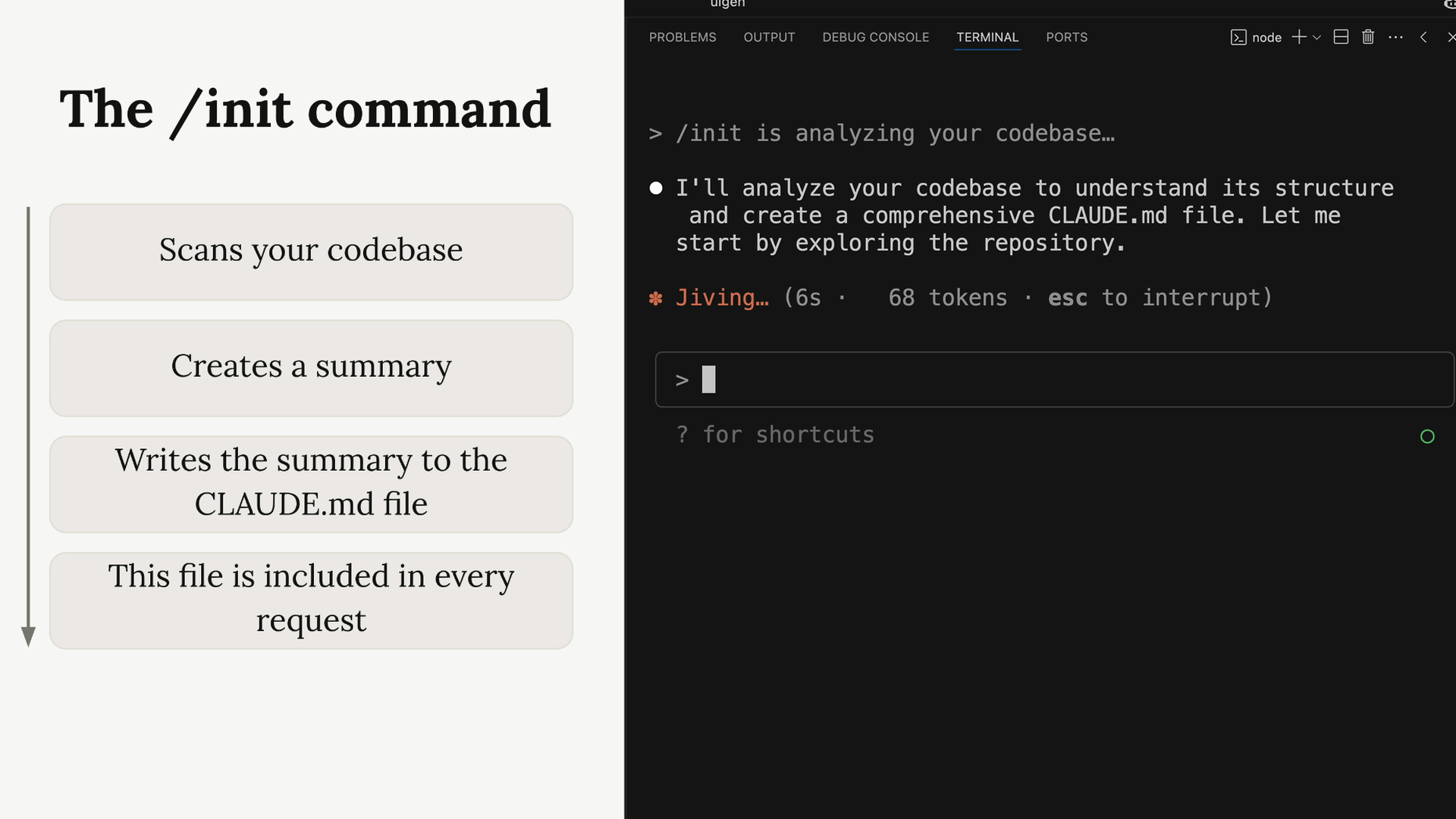

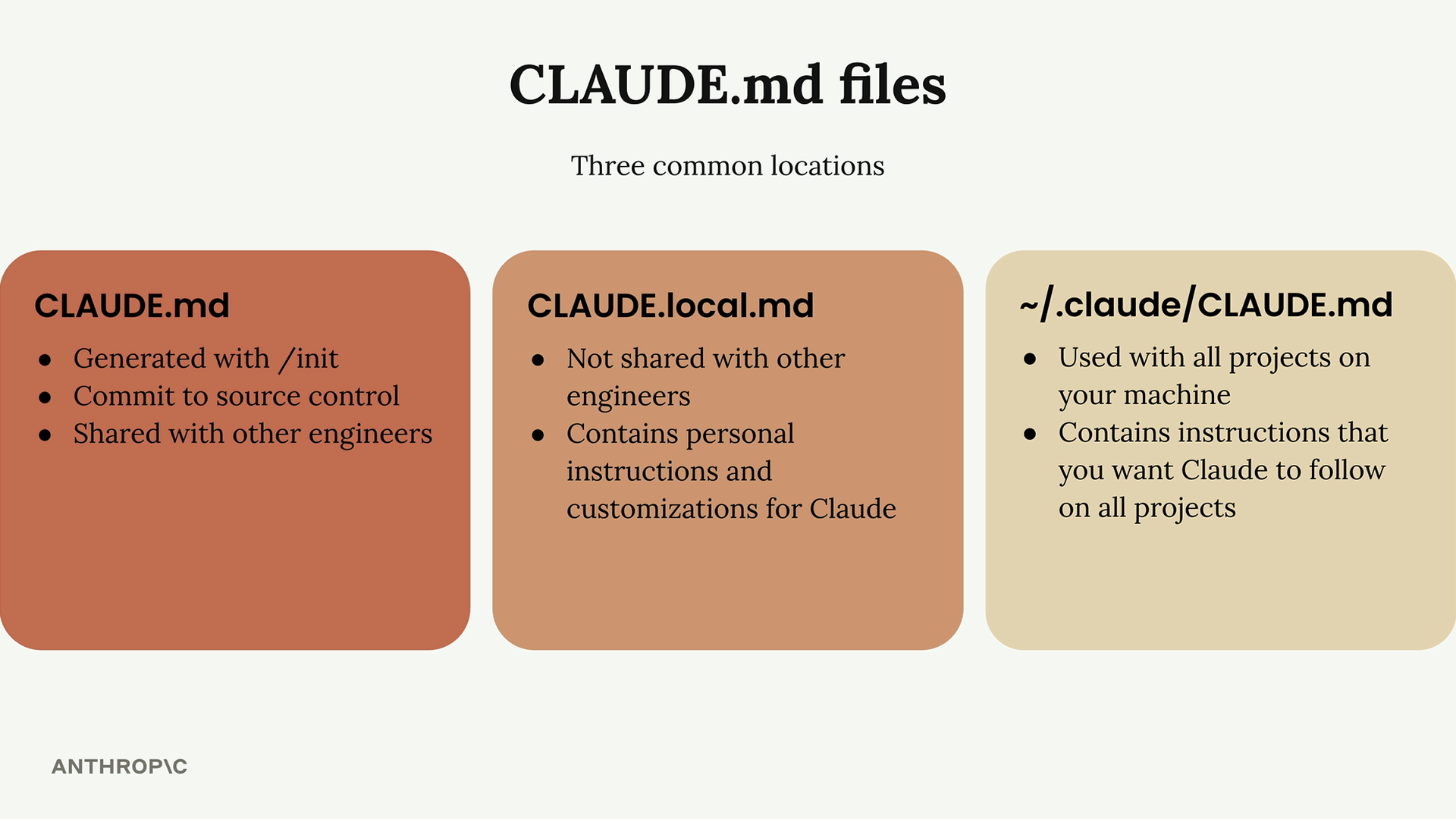

- 运行

init命令 = Claude 扫描代码库以了解其架构/编码风格,并创建一个claude.md文件。 claude.md= 自动包含在未来请求中的上下文。

内存类型:项目(共享)、本地、用户内存文件。

上下文管理:

- 使用 # 符号向内存中添加特定笔记。

- 可以手动编辑

claude.md或重新运行init来更新。 - Claude 可以处理

Git操作(暂存、提交)。

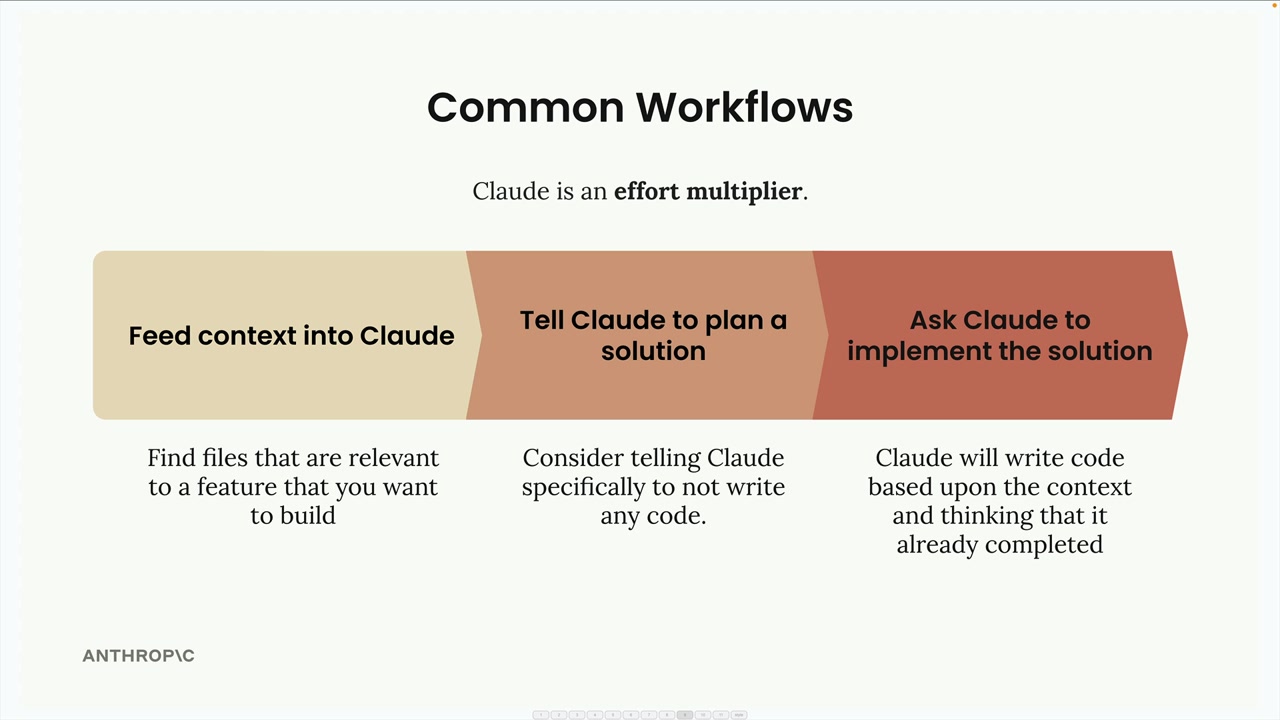

有效的提示策略:

方法 1 - 三步工作流:

- 识别相关文件,要求 Claude 分析它们。

- 描述功能,要求 Claude 规划解决方案(暂不编写代码)。

- 要求 Claude 实施该计划。

方法 2 - 测试驱动开发:

- 提供相关上下文。

- 要求 Claude 为该功能建议测试。

- 选择并实施选定的测试。

- 要求 Claude 编写代码直到测试通过。

核心原则:Claude Code = 效率倍增器。更详细的指令 = 显著更好的结果。将其视为合作工程师,而不仅仅是代码生成器。

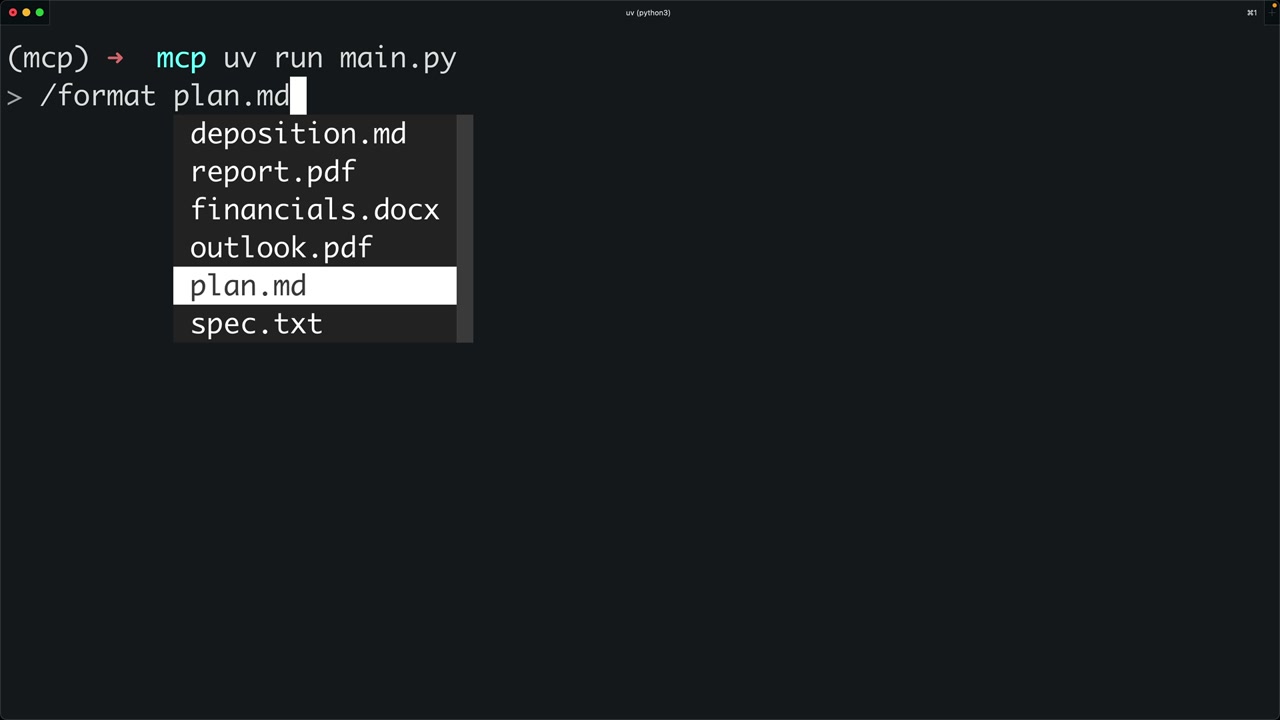

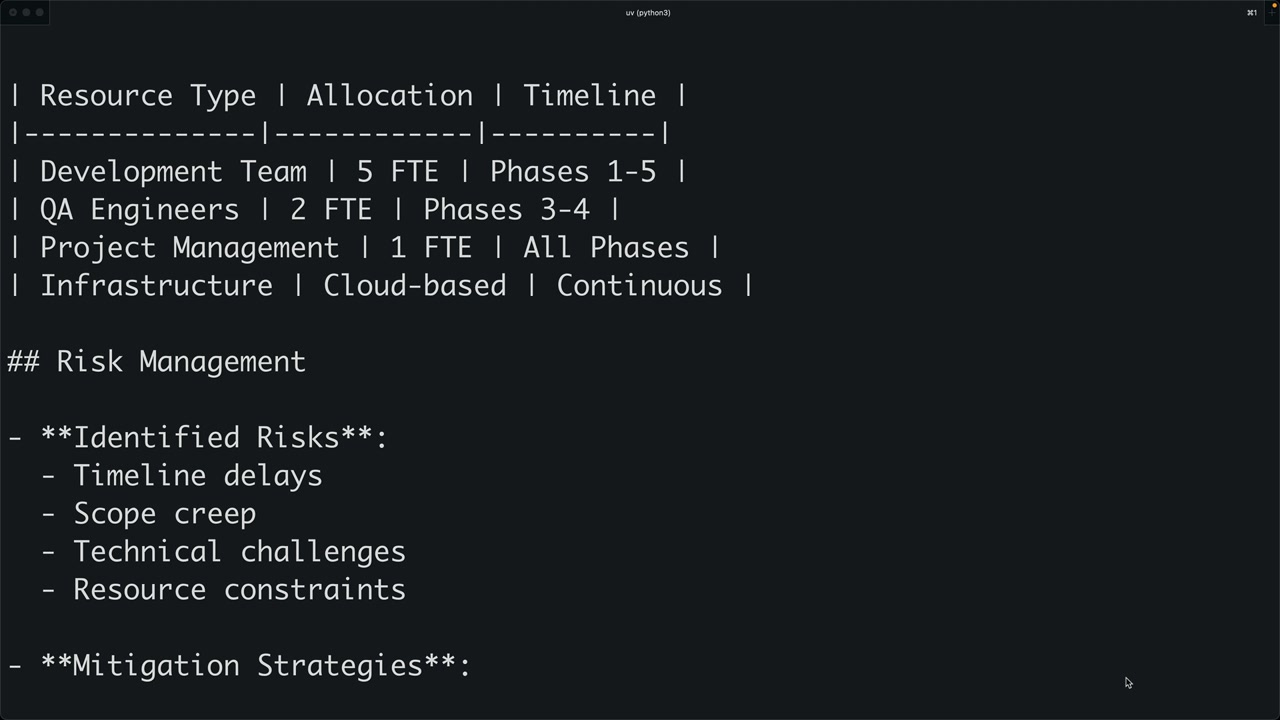

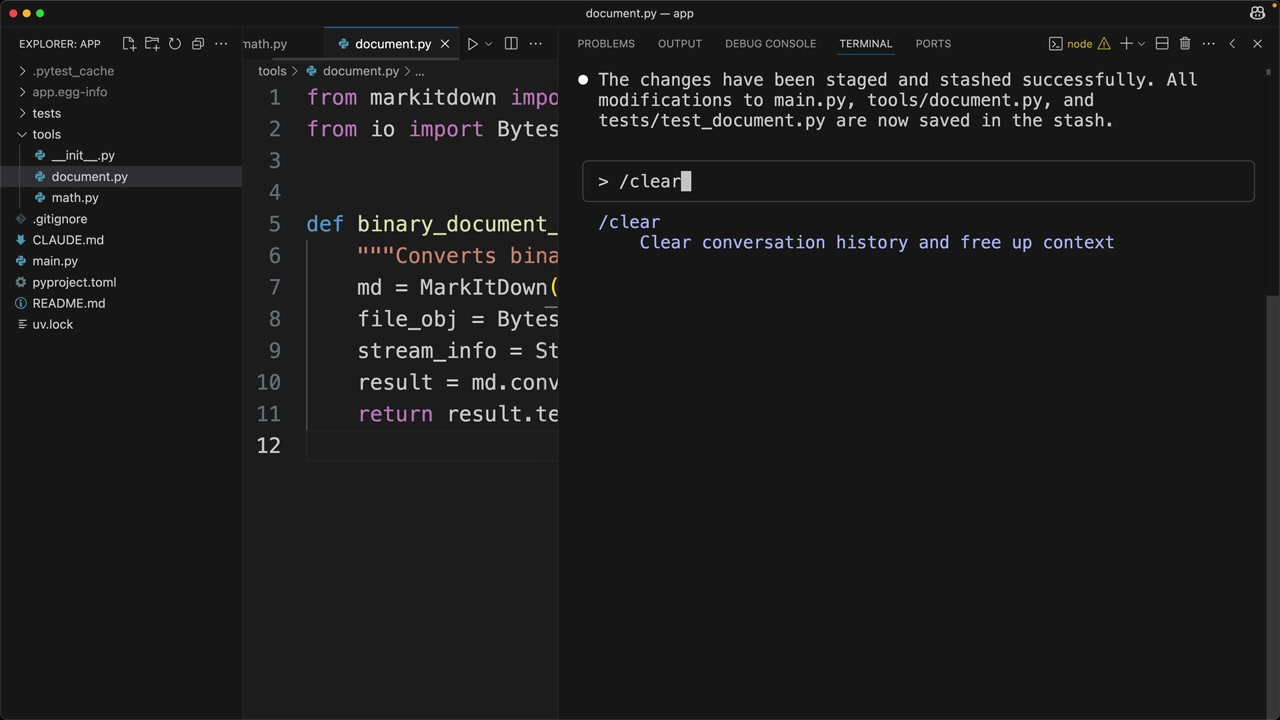

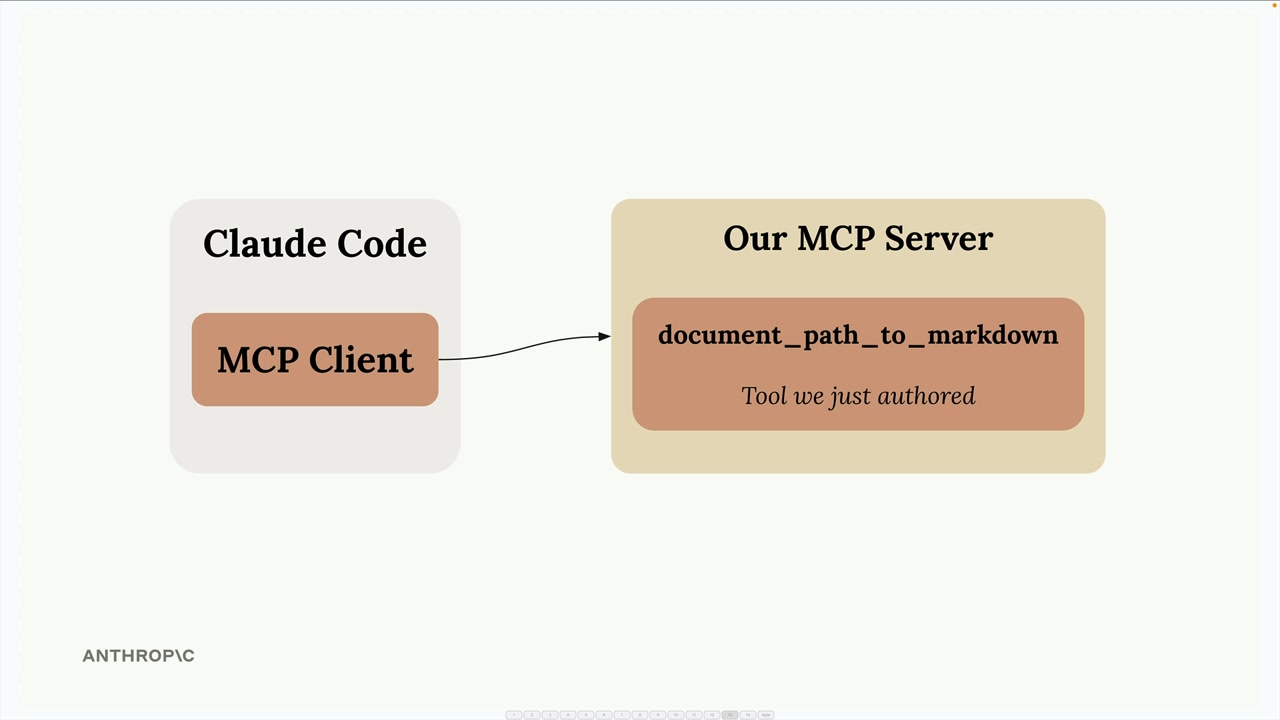

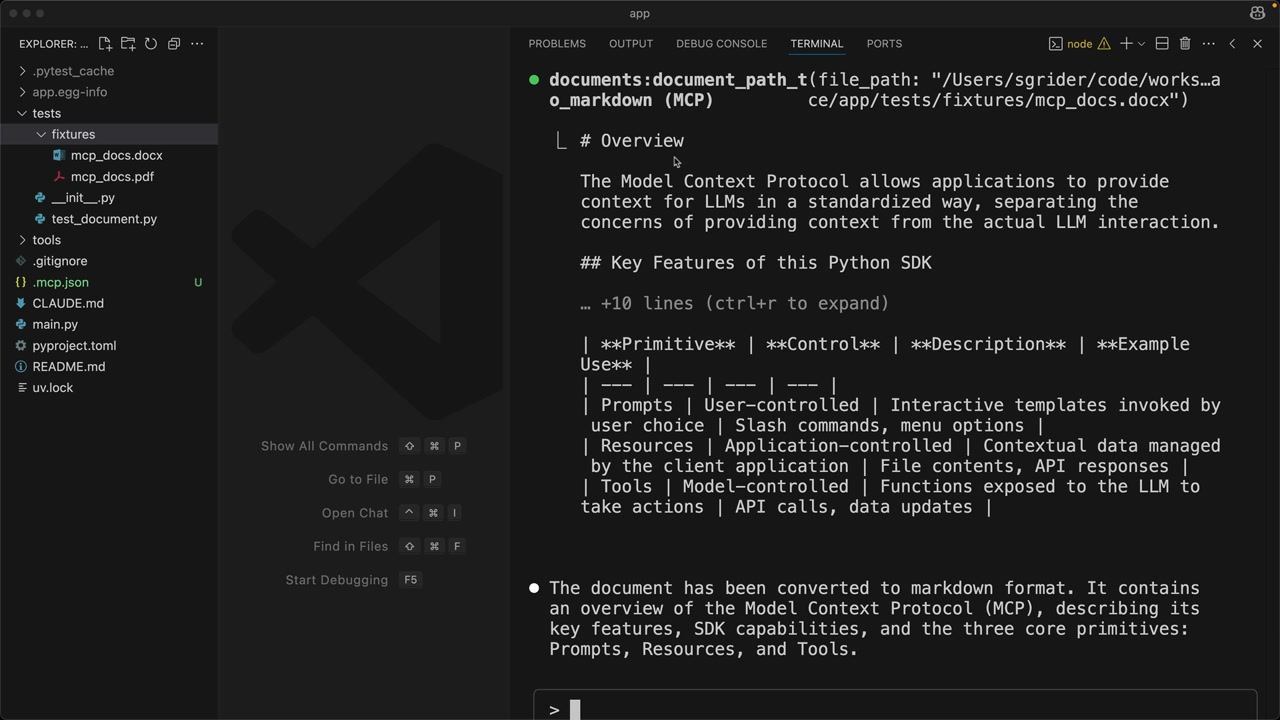

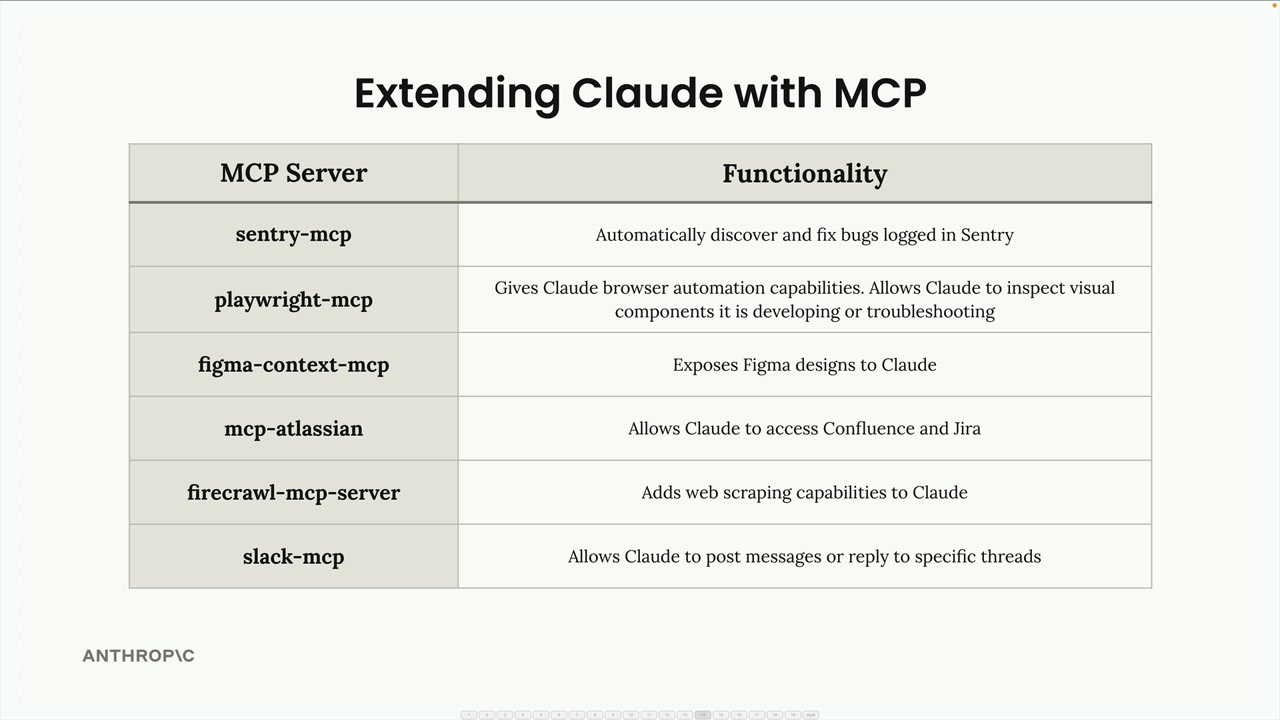

使用 MCP 服务器增强功能

Claude Code = 一个内置了 MCP (模型上下文协议) 客户端的 AI 助手,可以连接到 MCP 服务器以扩展功能。

MCP 服务器集成 = 通过命令将外部工具/服务连接到 Claude Code:claude mcp add [server-name] [startup-command]。

实现示例 = 一个暴露了“文档路径转 Markdown”工具的文档处理服务器,允许 Claude Code 通过运行 uv run main.py 来读取 PDF/Word 文档。

动态能力扩展 = MCP 服务器可以实时为 Claude Code 添加新功能,无需修改其核心。

常见用例 = 生产监控 (Sentry)、项目管理 (Jira)、通信 (Slack)、自定义开发工作流工具。

主要优点 = 通过模块化的服务器连接,极大地提高了开发工作流的灵活性。

设置过程 = 1) 创建带有工具的 MCP 服务器,2) 使用名称和启动命令将服务器添加到 Claude Code,3) 重启 Claude Code 以访问新功能。

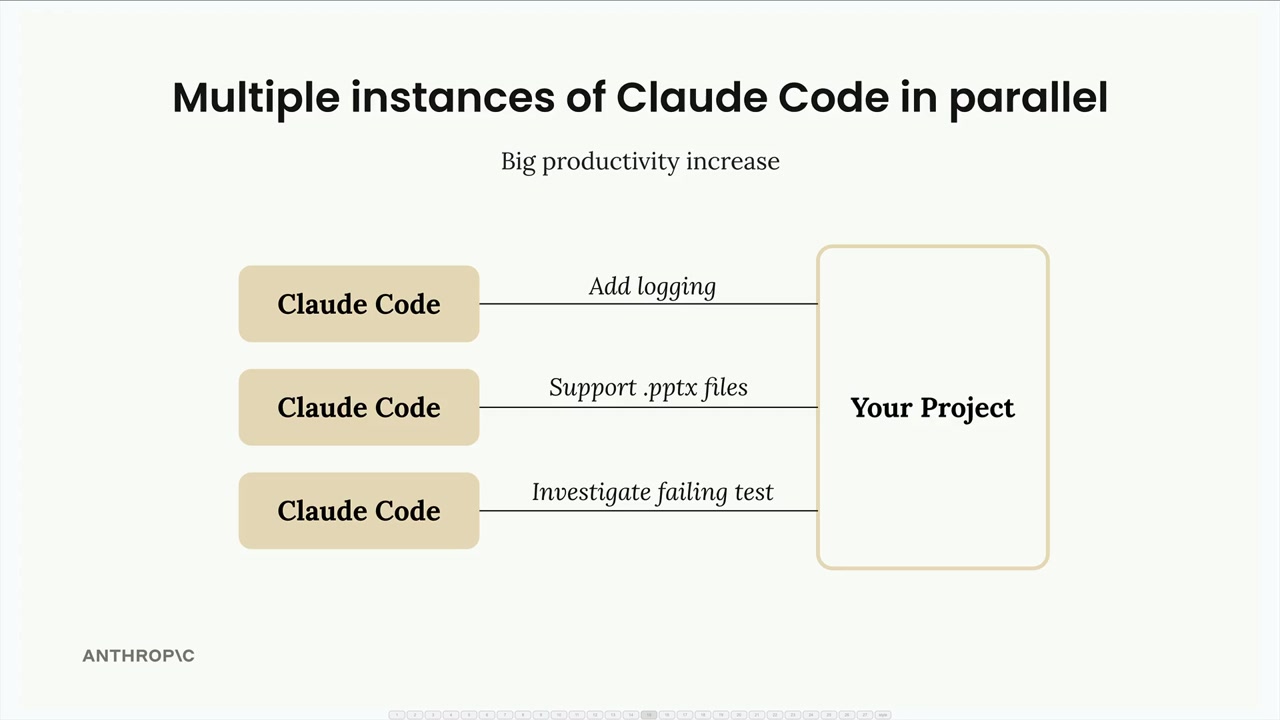

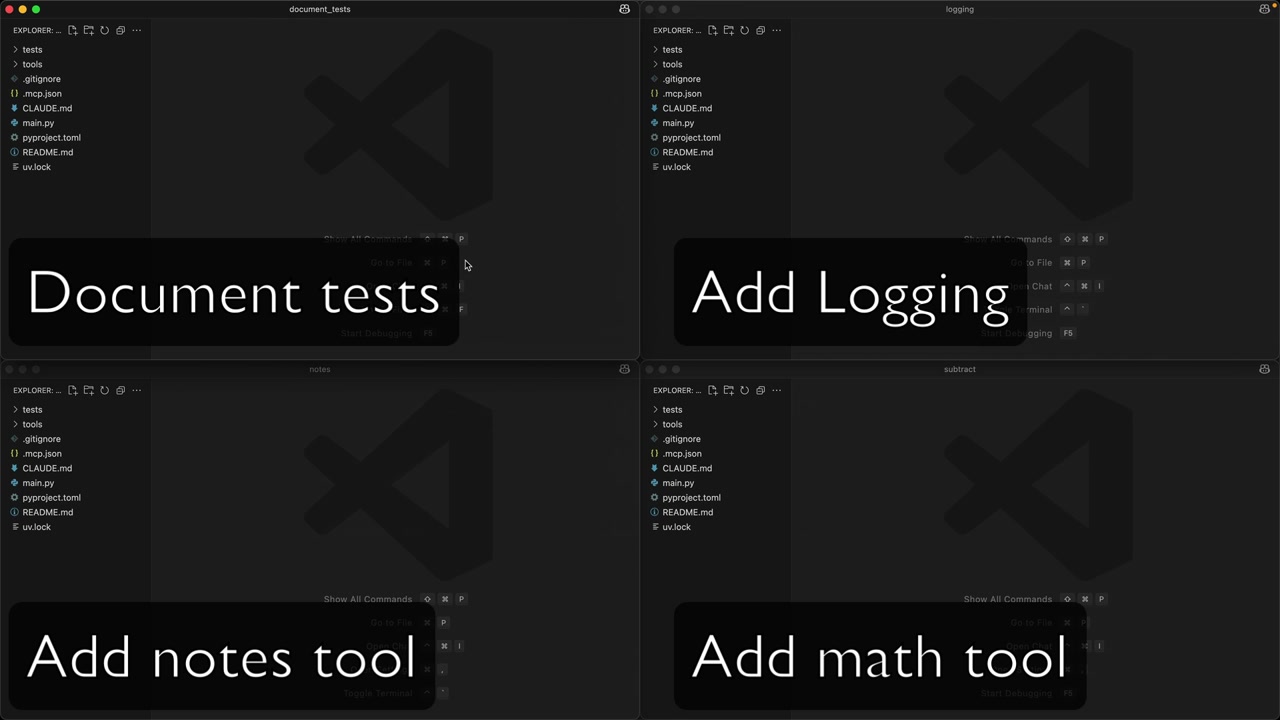

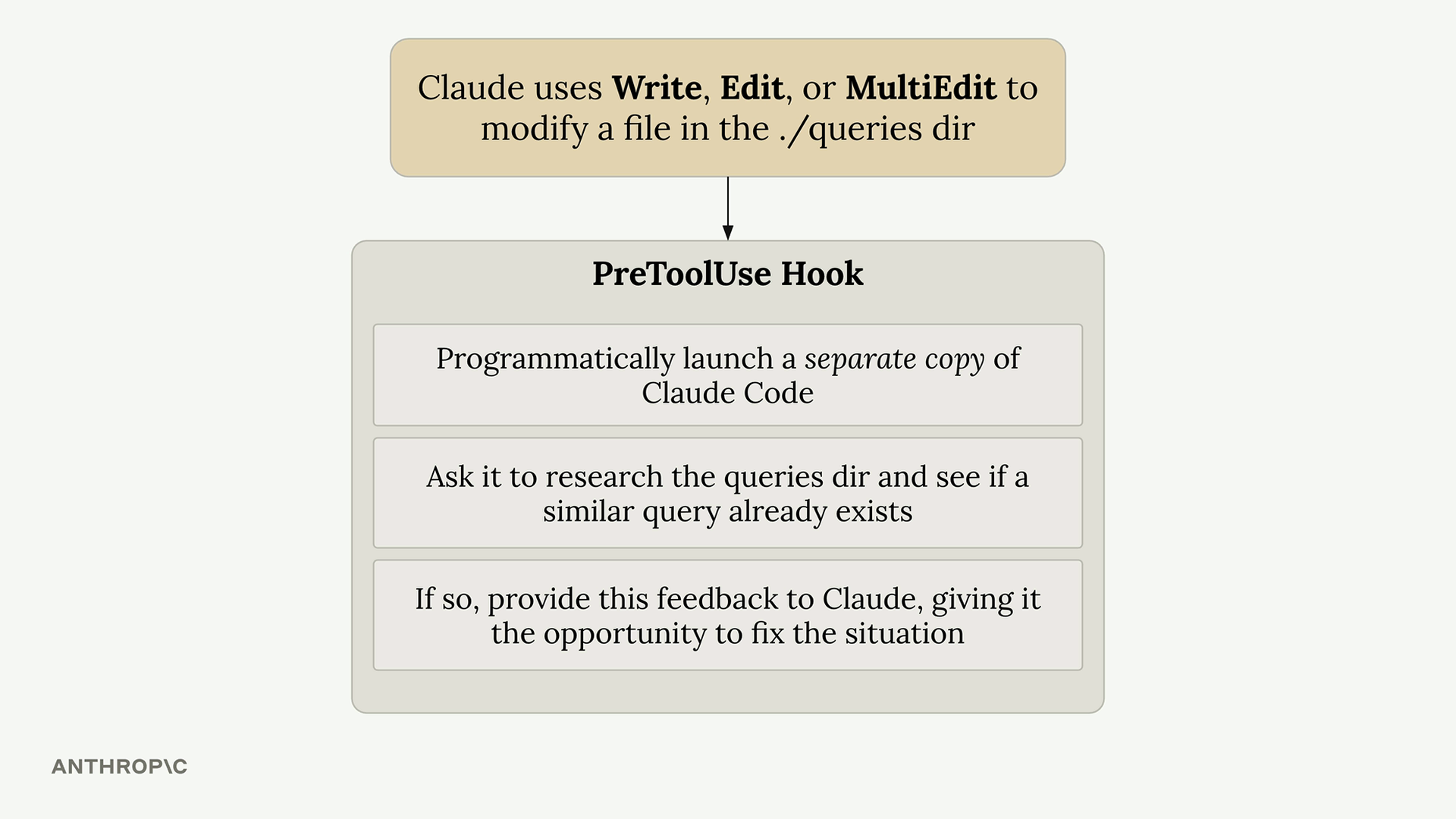

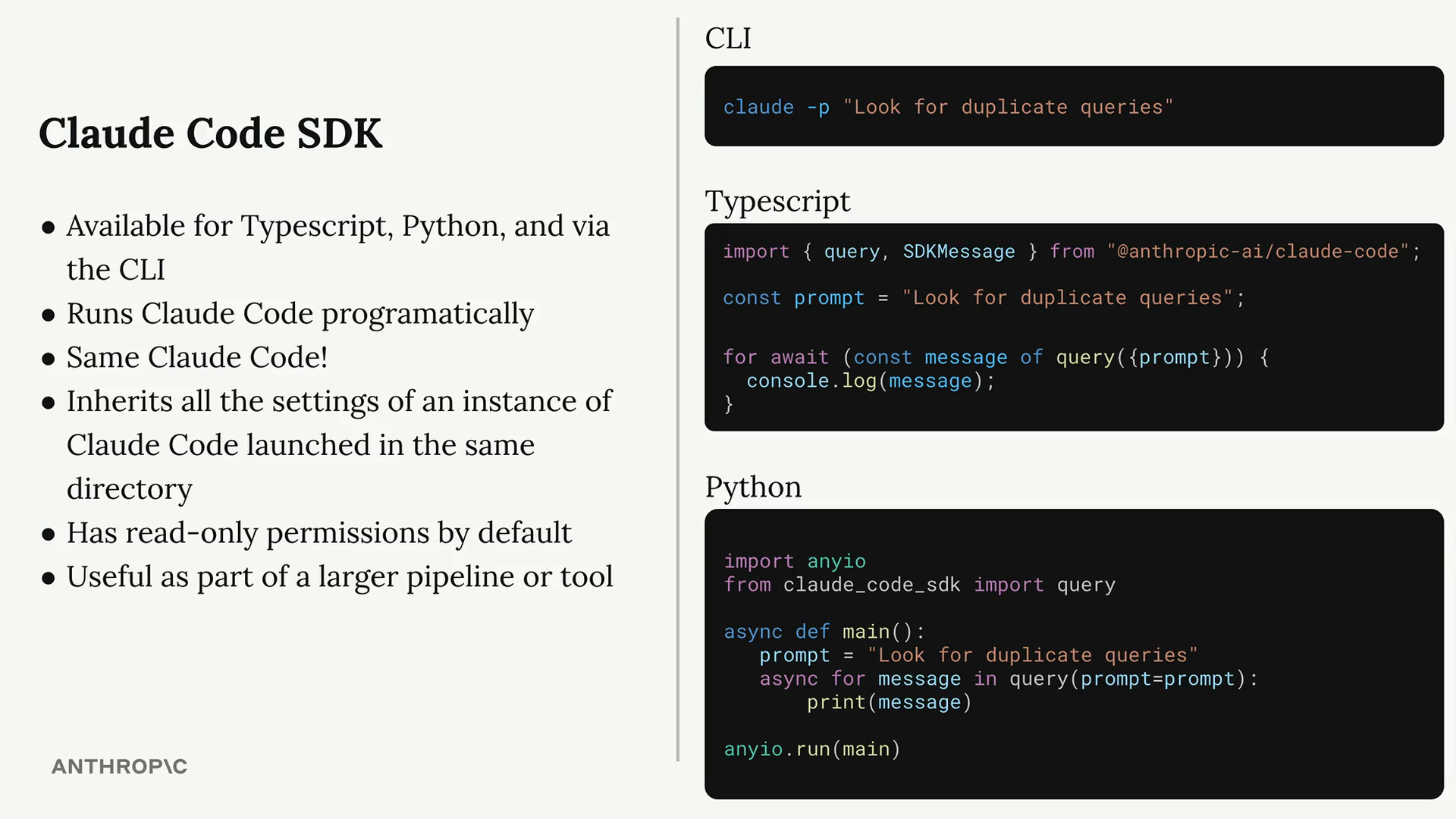

并行化 Claude Code

并行化 Claude Code = 同时运行多个 Claude 实例以并行完成不同任务。

核心问题 = 多个 Claude 实例同时修改相同文件会产生冲突和无效代码。

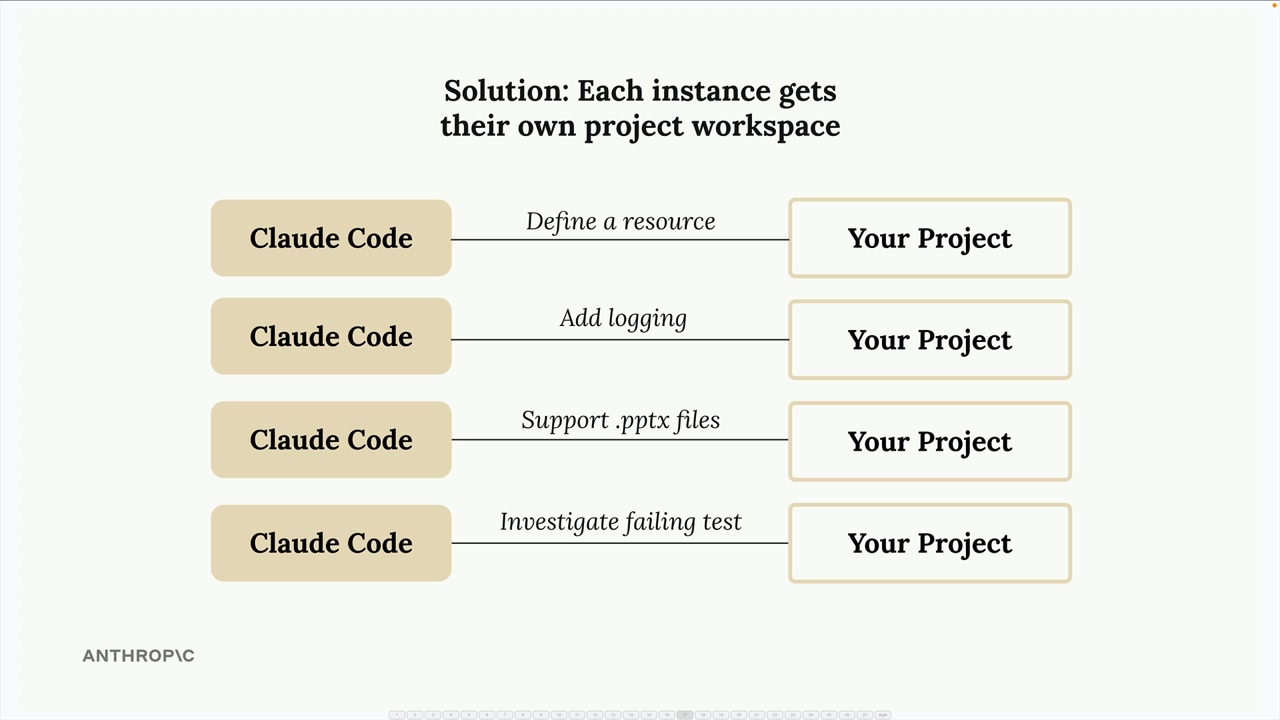

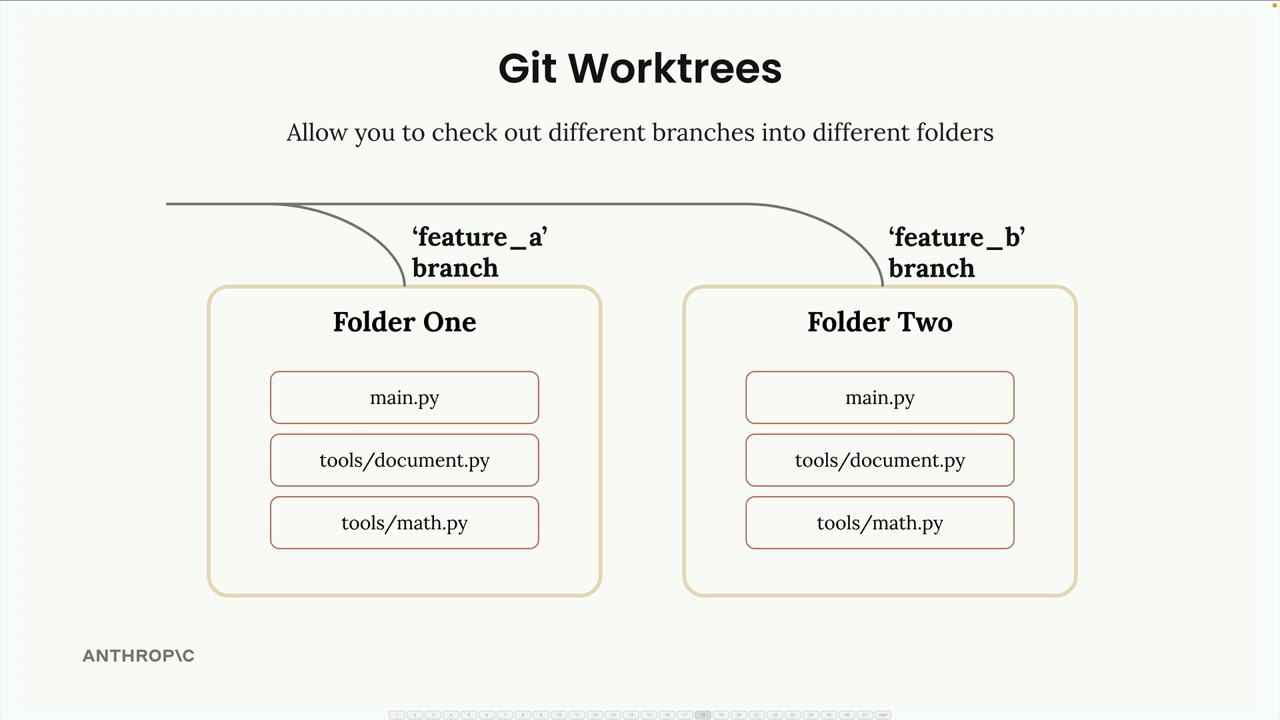

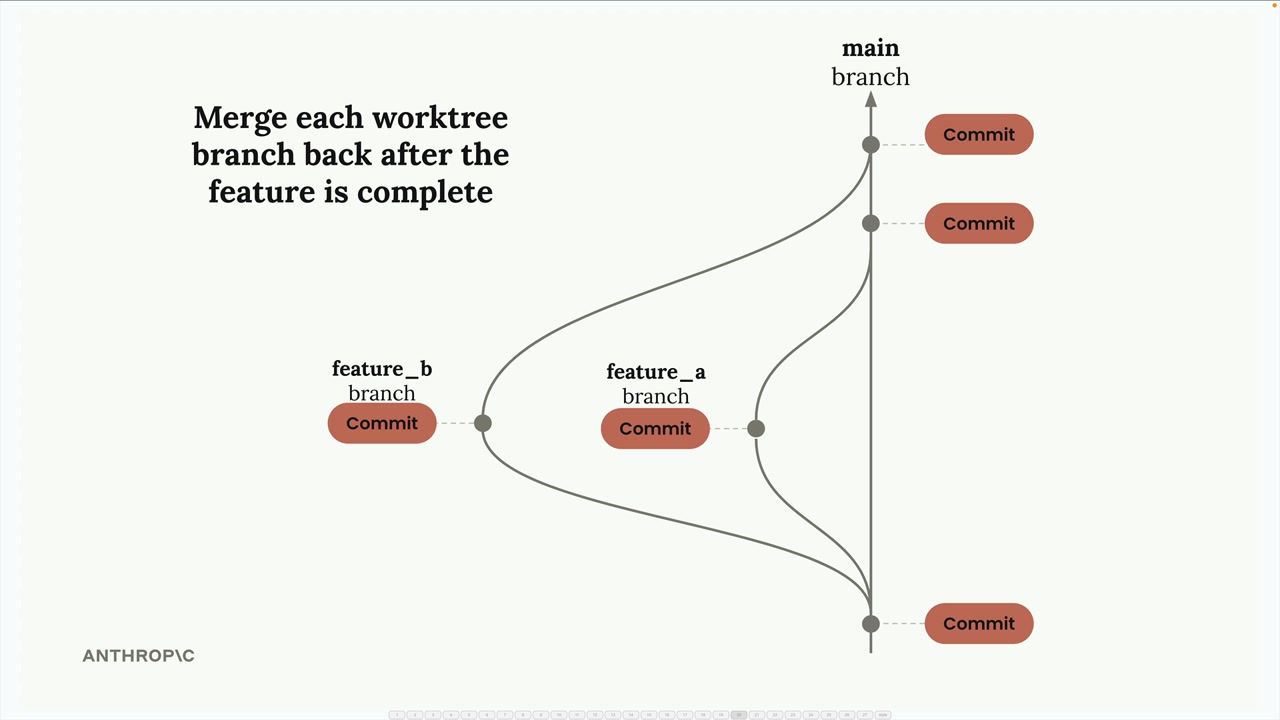

解决方案 = 使用 Git 工作树为每个 Claude 实例提供隔离的工作区。

Git 工作树 = 一种功能,它在单独的目录中创建完整的项目副本,每个副本对应不同的 Git 分支。

工作流程 = 创建工作树 → 将任务分配给 Claude 实例 → 在隔离环境中工作 → 提交更改 → 合并回主分支。

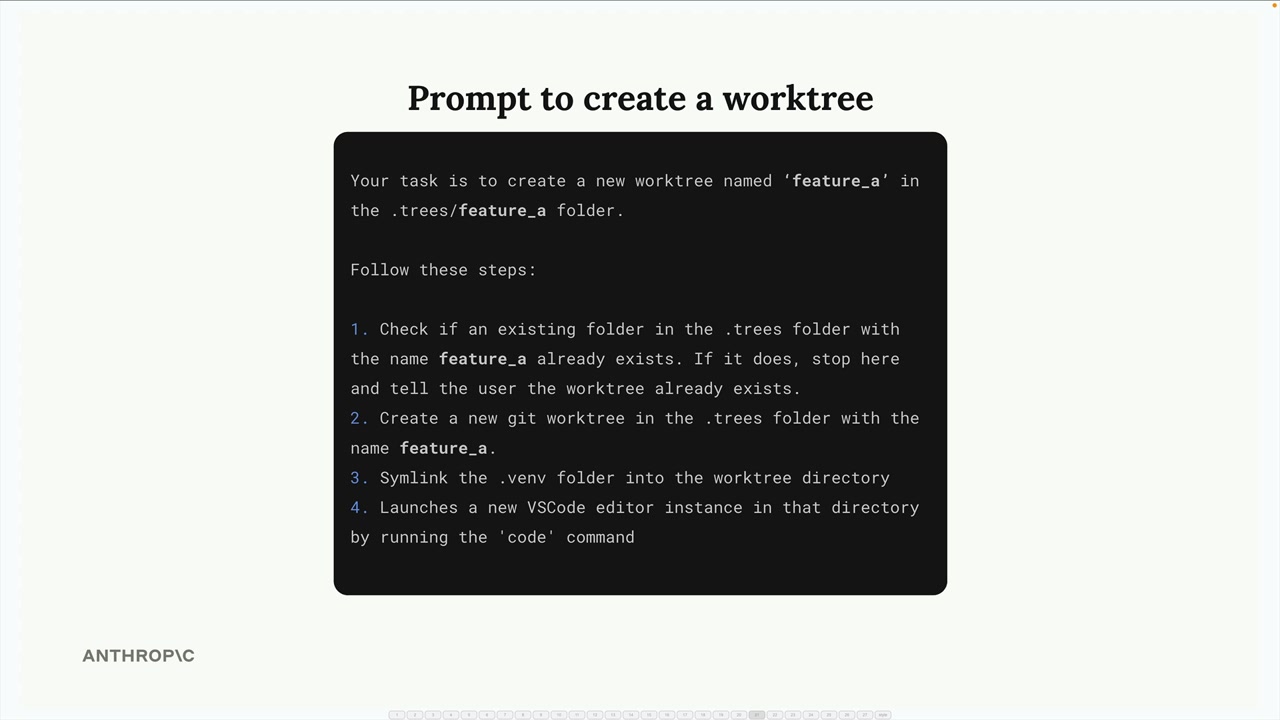

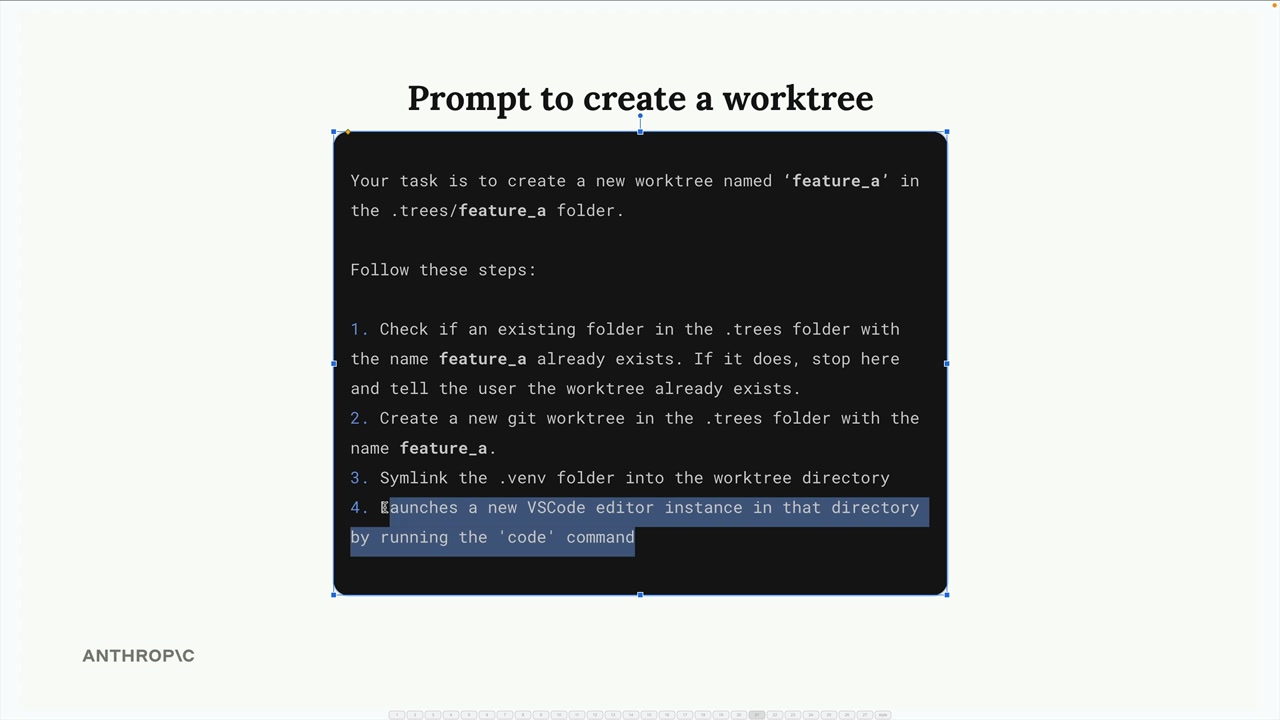

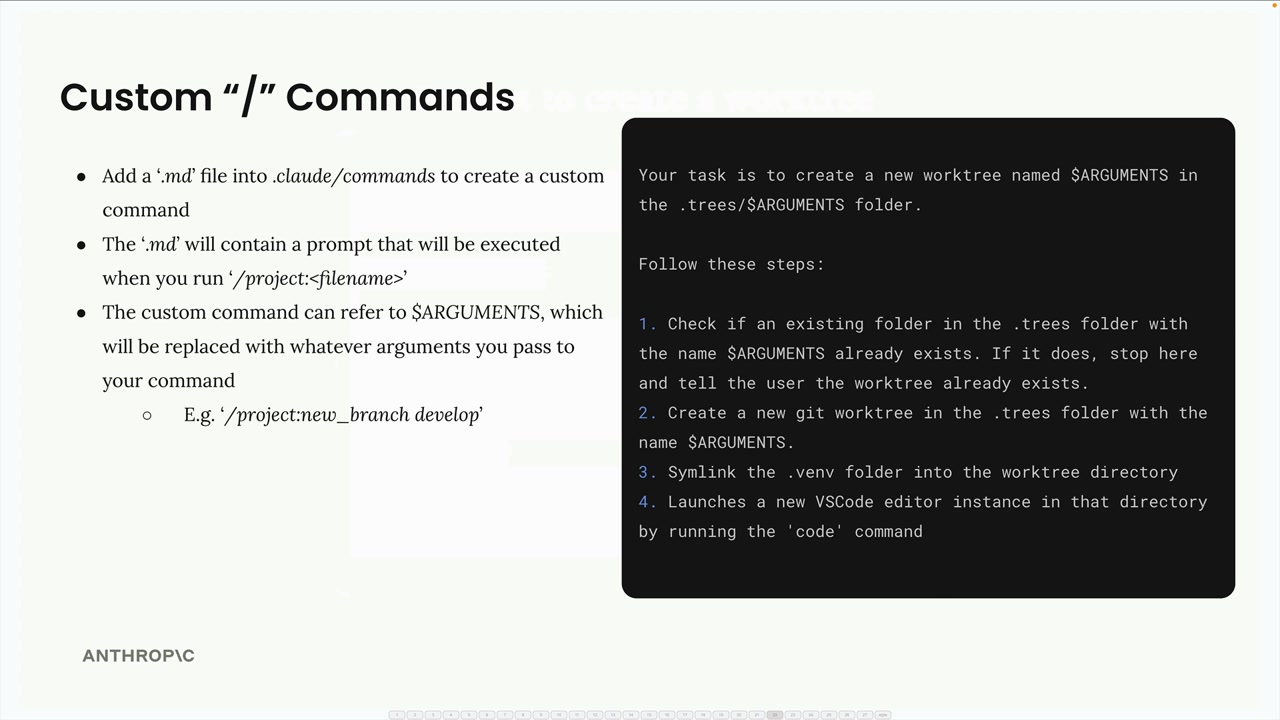

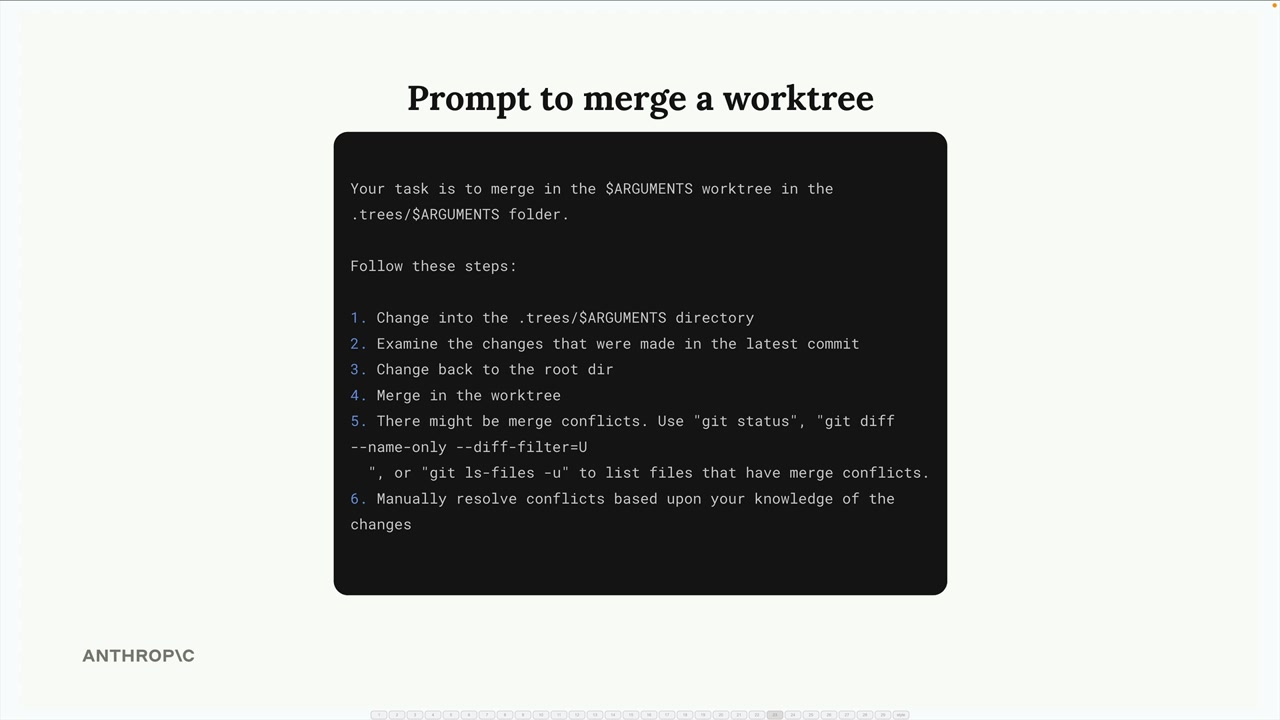

自定义命令 = 通过在 .claude/commands 目录中使用包含 $ARGUMENTS 占位符以支持动态值的 markdown 文件,来自动化工作树的创建/管理。

并行执行的好处 = 单个开发者指挥一个虚拟的软件工程师团队,生产力可大幅扩展,仅受工程师管理能力的限制。

合并冲突 = Claude 在分支合并过程中自动解决冲突。

清理 = Claude 在功能完成后处理工作树的移除。

主要优势 = 可根据开发者管理同步任务的能力,扩展至无限个并行实例。

自动调试

自动调试 = 使用 AI (Claude) 自动检测、分析和修复生产环境中的错误,无需人工干预。

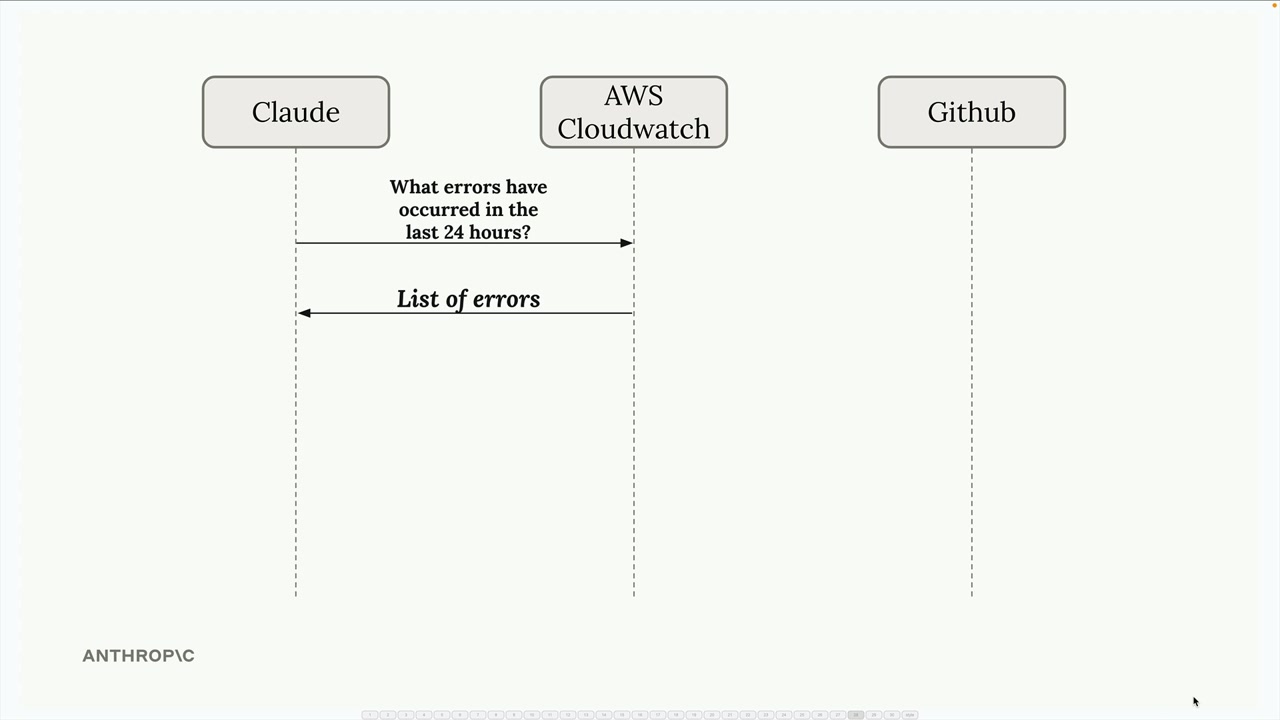

核心工作流:

GitHub Action每日运行以检查生产环境。- 获取过去 24 小时的

CloudWatch日志。 - Claude 识别错误并进行去重。

- Claude 分析每个错误并生成修复方案。

- 创建一个包含建议解决方案的拉取请求。

关键组件:

- 用于调度/自动化的

GitHub Actions。 - 用于日志检索的

AWS CLI。 - 用于错误分析和代码修复的 Claude Code。

- 用于生产错误监控的

CloudWatch。

优点:

- 捕获仅在生产环境中出现的错误(开发环境中不存在的问题)。

- 减少手动查找日志和调试的时间。

- 提供带有解释的、有上下文感知的修复方案。

- 创建可供审查的、包含更改的拉取请求。

常见用例:环境之间的配置错误(无效的模型 ID、API 密钥等,这些在本地有效但在生产环境中失败)。

实现要求:仓库访问权限、云日志服务、AI 编码助手、CI/CD pipeline 集成。

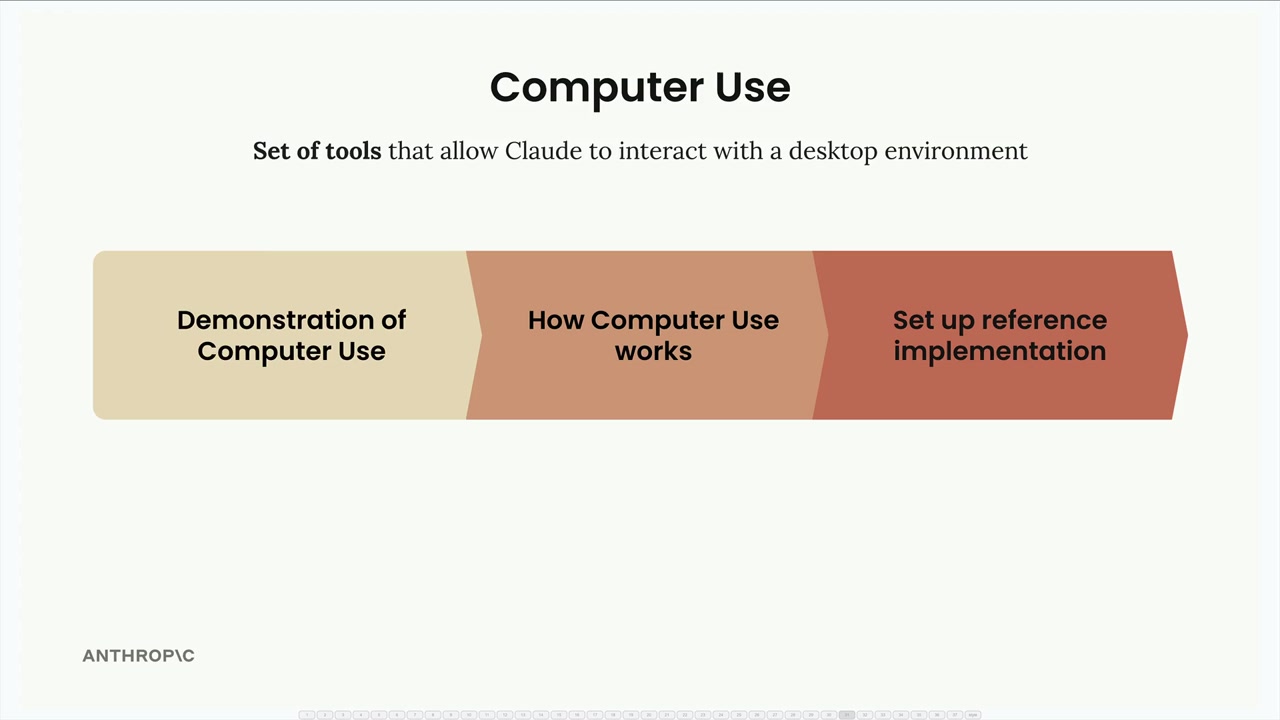

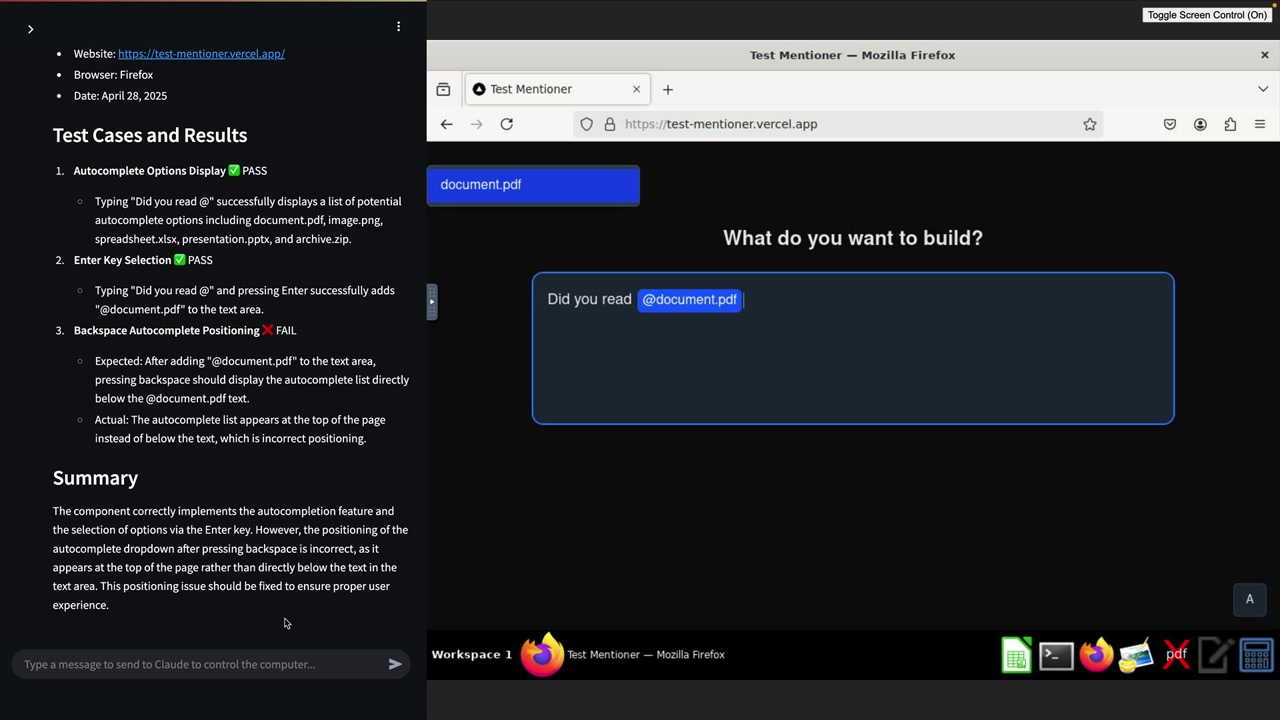

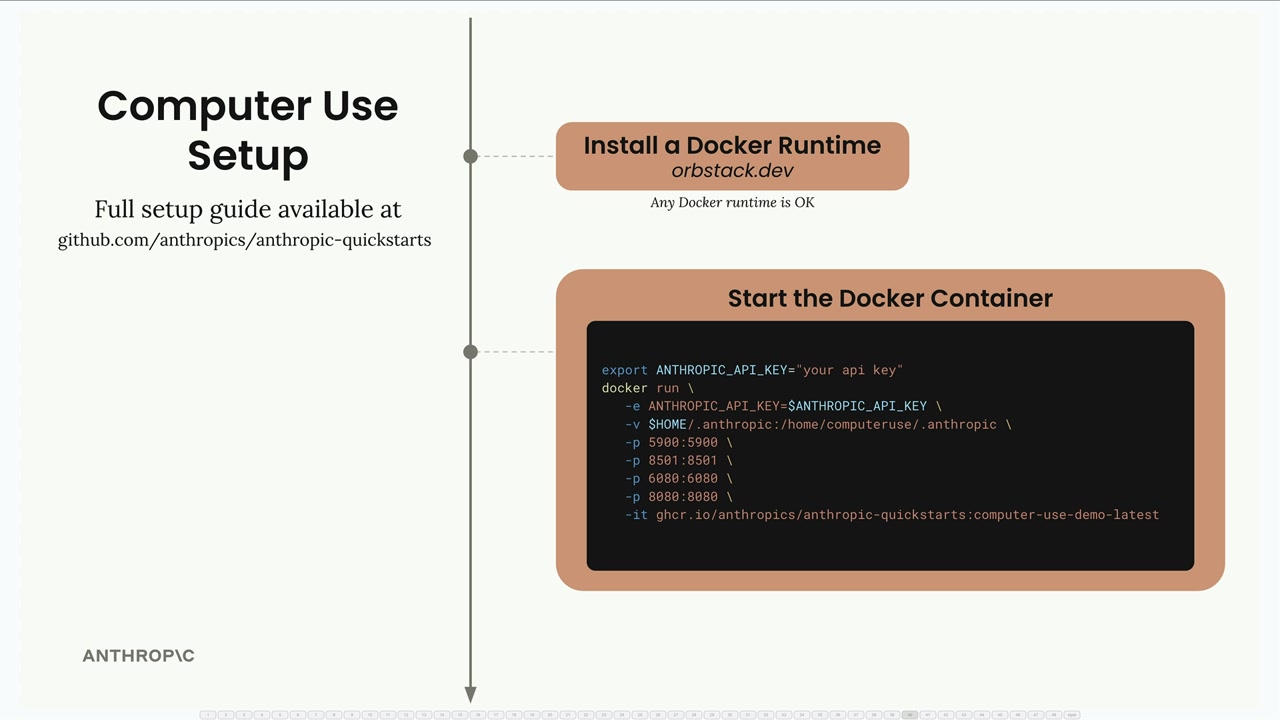

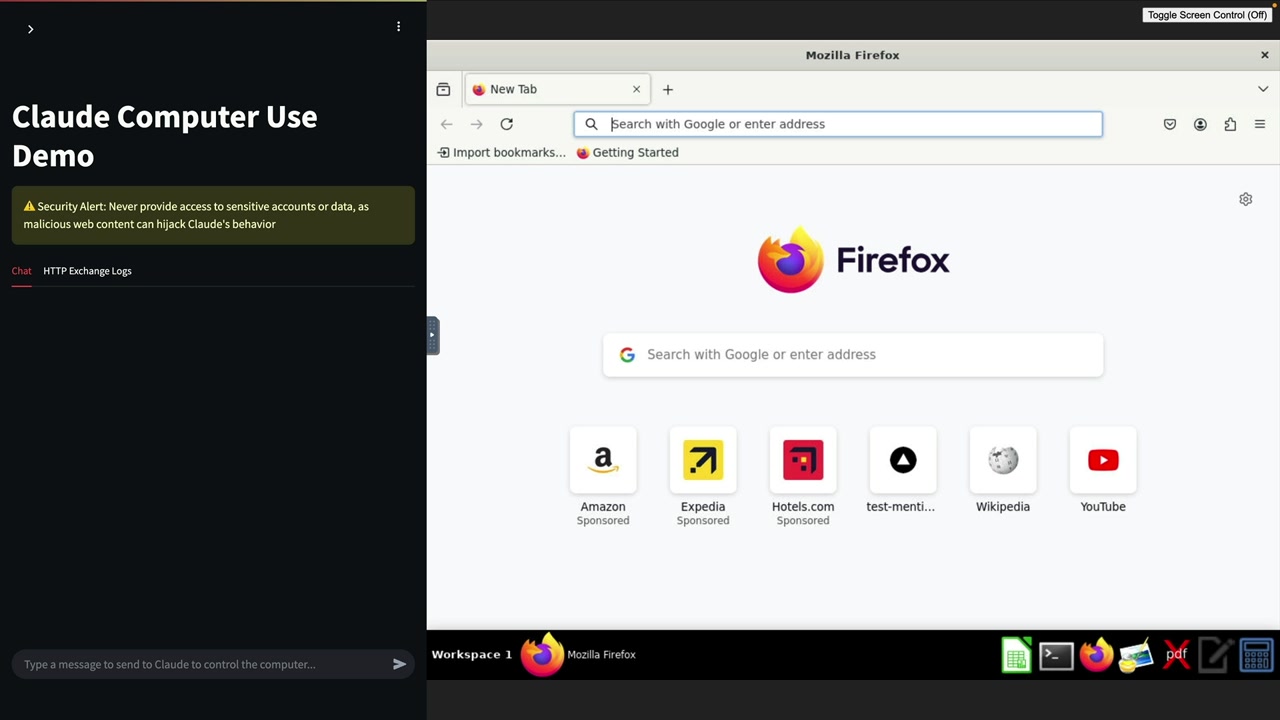

计算机使用

Computer Use = Claude 通过视觉观察和控制操作与计算机界面进行交互的能力。

主要能力:

- 对应用程序/浏览器进行截图。

- 点击按钮、输入文本、导航界面。

- 自主遵循多步指令。

- 执行 QA 测试和自动化任务。

工作原理:

- 在隔离的

Docker容器环境中运行。 - 用户通过聊天界面提供指令。

- Claude 视觉观察屏幕并执行操作。

- 生成关于任务完成情况/结果的报告。

主要用例:

- Web 应用程序的自动化 QA 测试。

- 跨不同场景的 UI 交互测试。

- 为重复性的计算机任务节省时间。

- 通过系统性测试识别 bug。

设置要求 = 提供参考实现以供本地测试。

示例工作流程:用户描述测试要求 → Claude 导航到应用程序 → 执行测试用例 → 报告通过/失败结果并附带详细发现。

计算机使用如何工作

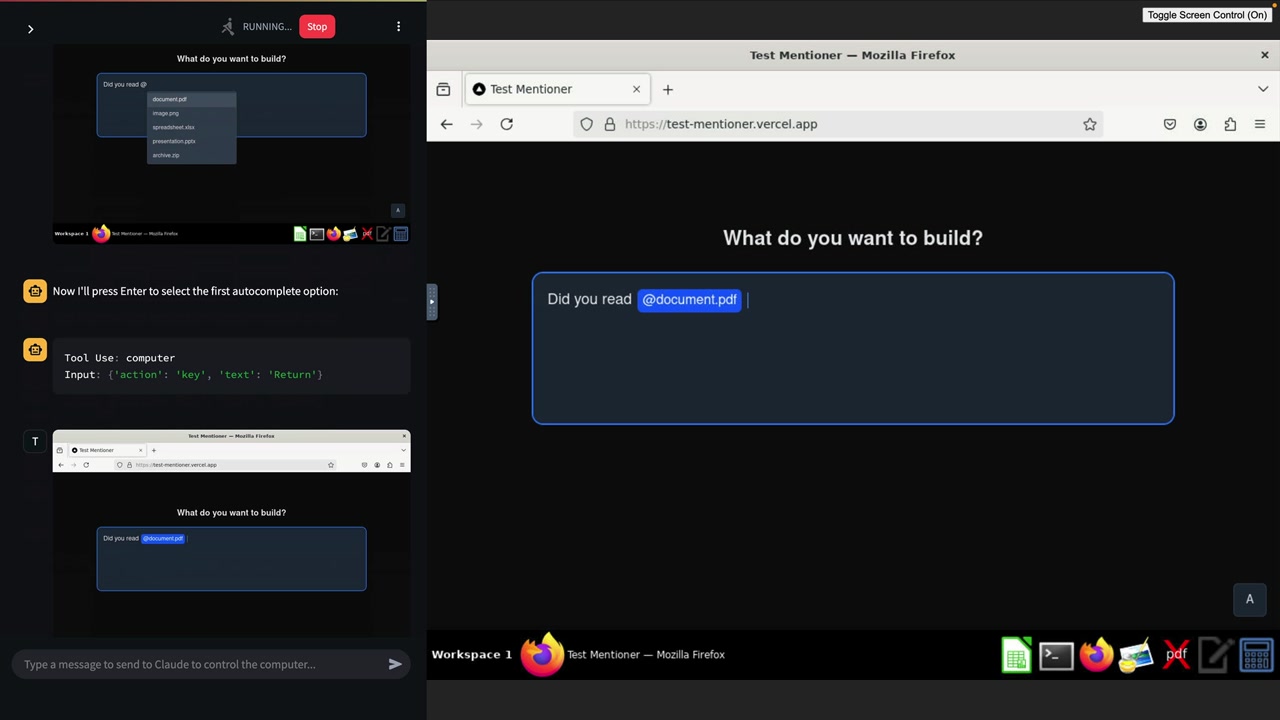

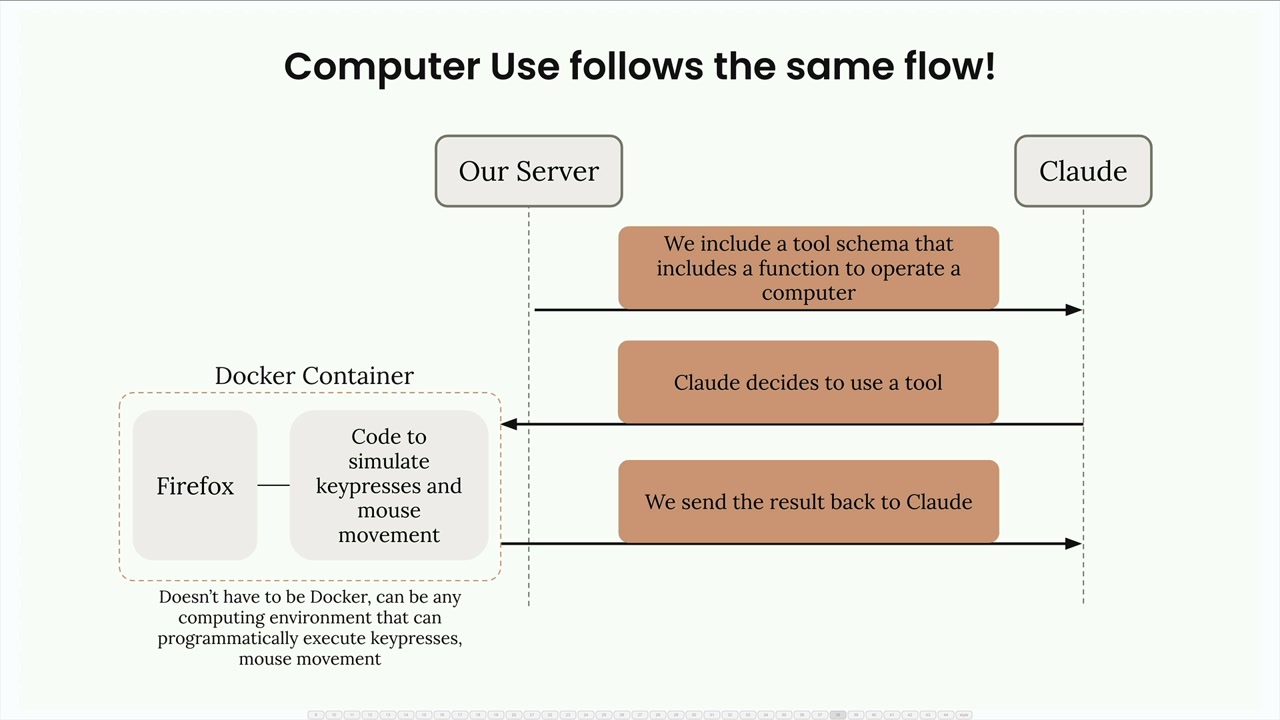

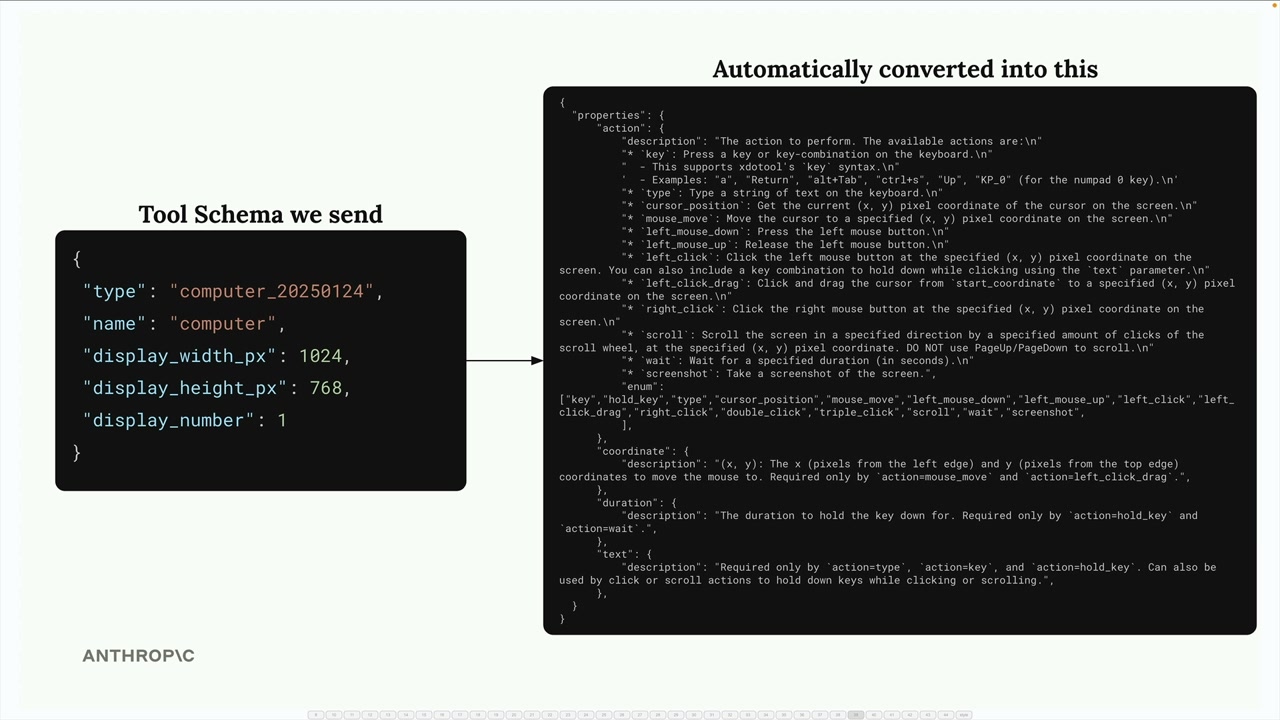

Computer use = 一种工具系统实现,允许 Claude 与计算环境进行交互。

工具使用流程:用户发送消息 + 工具模式 → Claude 以工具使用请求(ID、名称、输入)响应 → 服务器执行代码 → 结果作为工具结果发送回 Claude。

计算机使用遵循相同的流程:

- 向 Claude 发送特殊的工具模式(一个小的模式在幕后会扩展为更大的结构)。

- 扩展后的模式包括一个带有参数的

action函数:鼠标移动、左键点击、截图等。 - Claude 发送工具使用请求。

- 开发者必须通过计算环境(通常是

Docker容器)来满足请求。 - 容器执行程序化的按键/鼠标移动。

- 响应被发送回 Claude。

关键点:

- Claude 不直接操纵计算机。

- 计算机使用 = 工具系统 + 开发者提供的计算环境。

- Anthropic 提供参考实现(一个带有预构建鼠标/键盘执行代码的

Docker容器)。 - 设置需要

Docker+ 简单的命令执行。 - 可以通过直接的聊天界面来测试 Claude 的计算机使用功能。

计算机使用 = 一个抽象层,其中工具系统处理 Claude 的通信,而 Docker 容器处理实际的计算机交互。

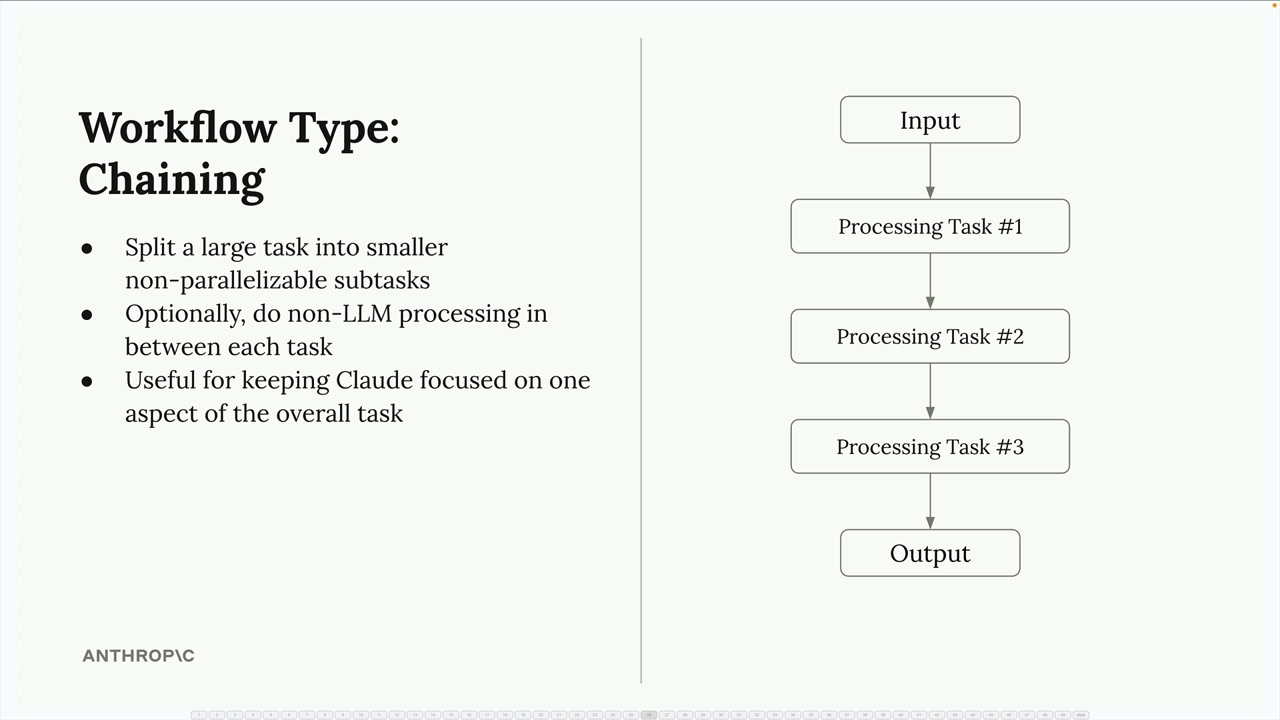

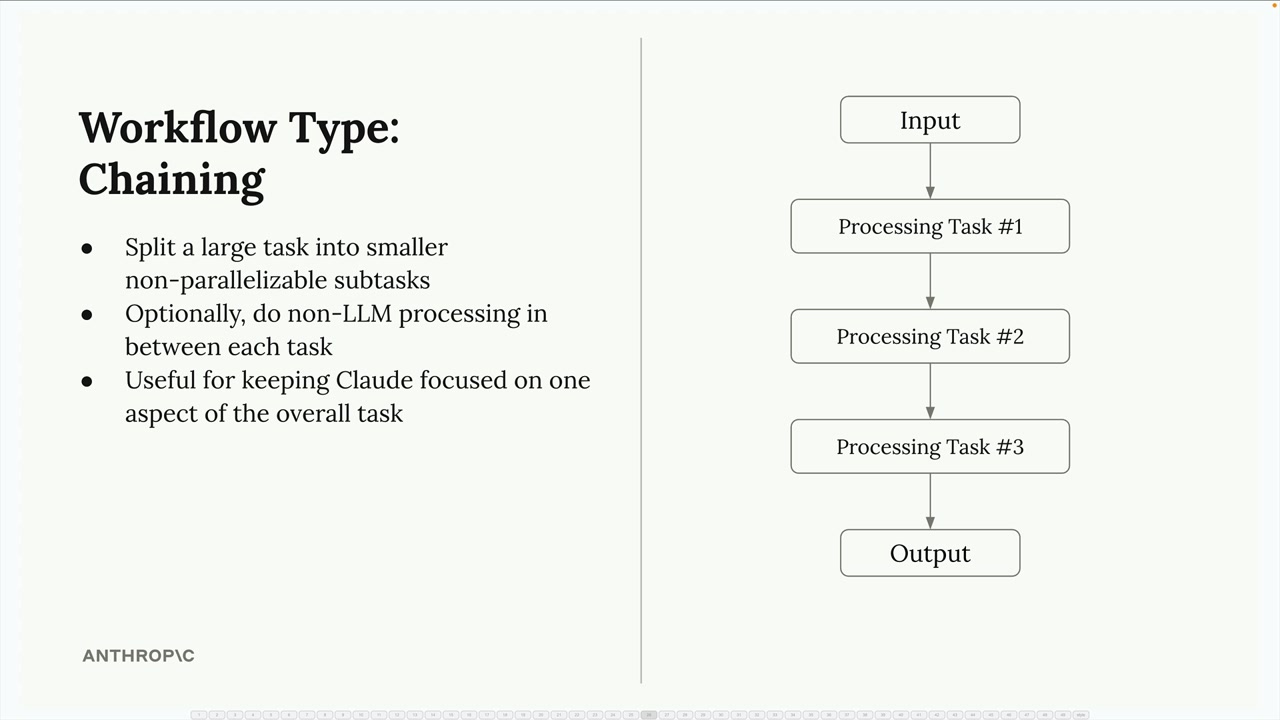

智能体与工作流

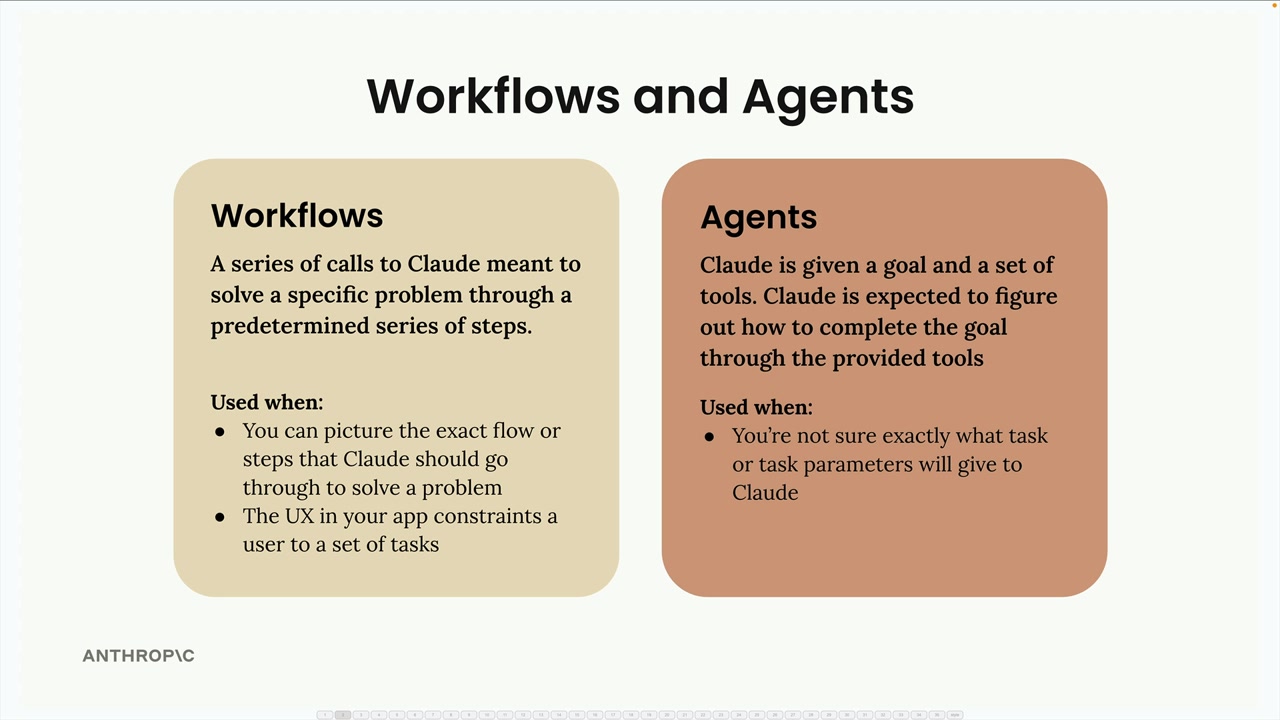

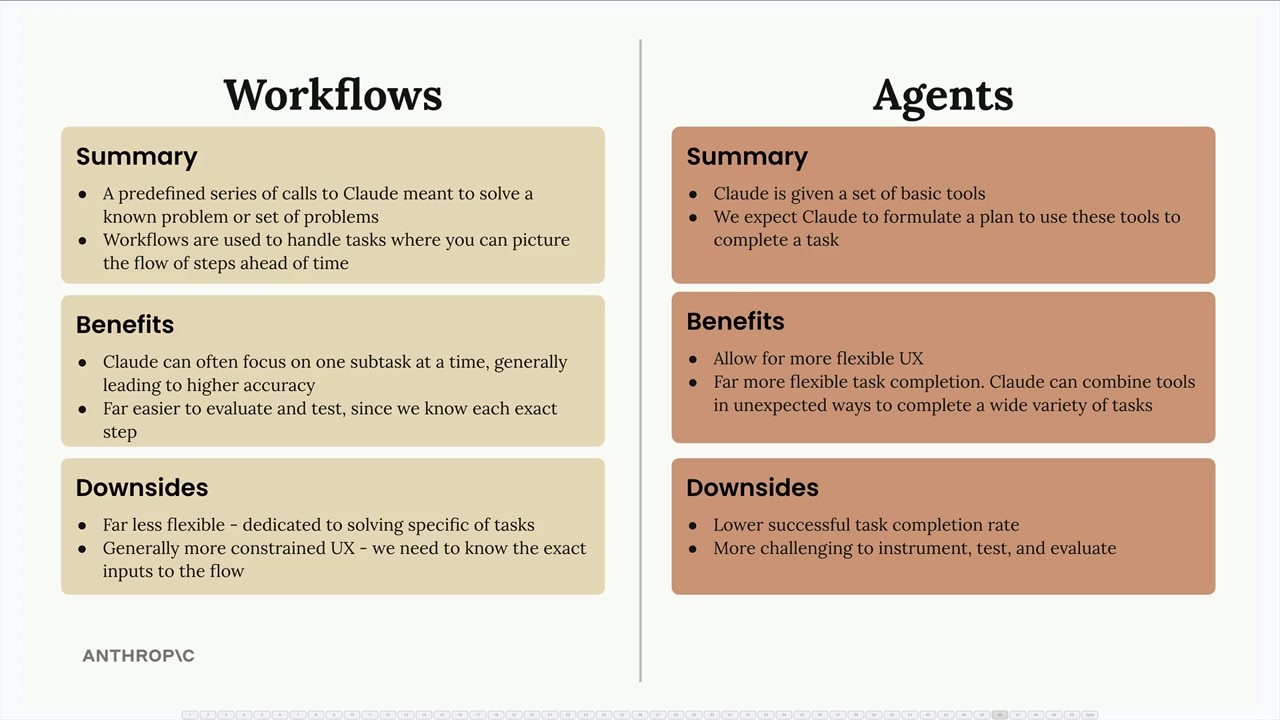

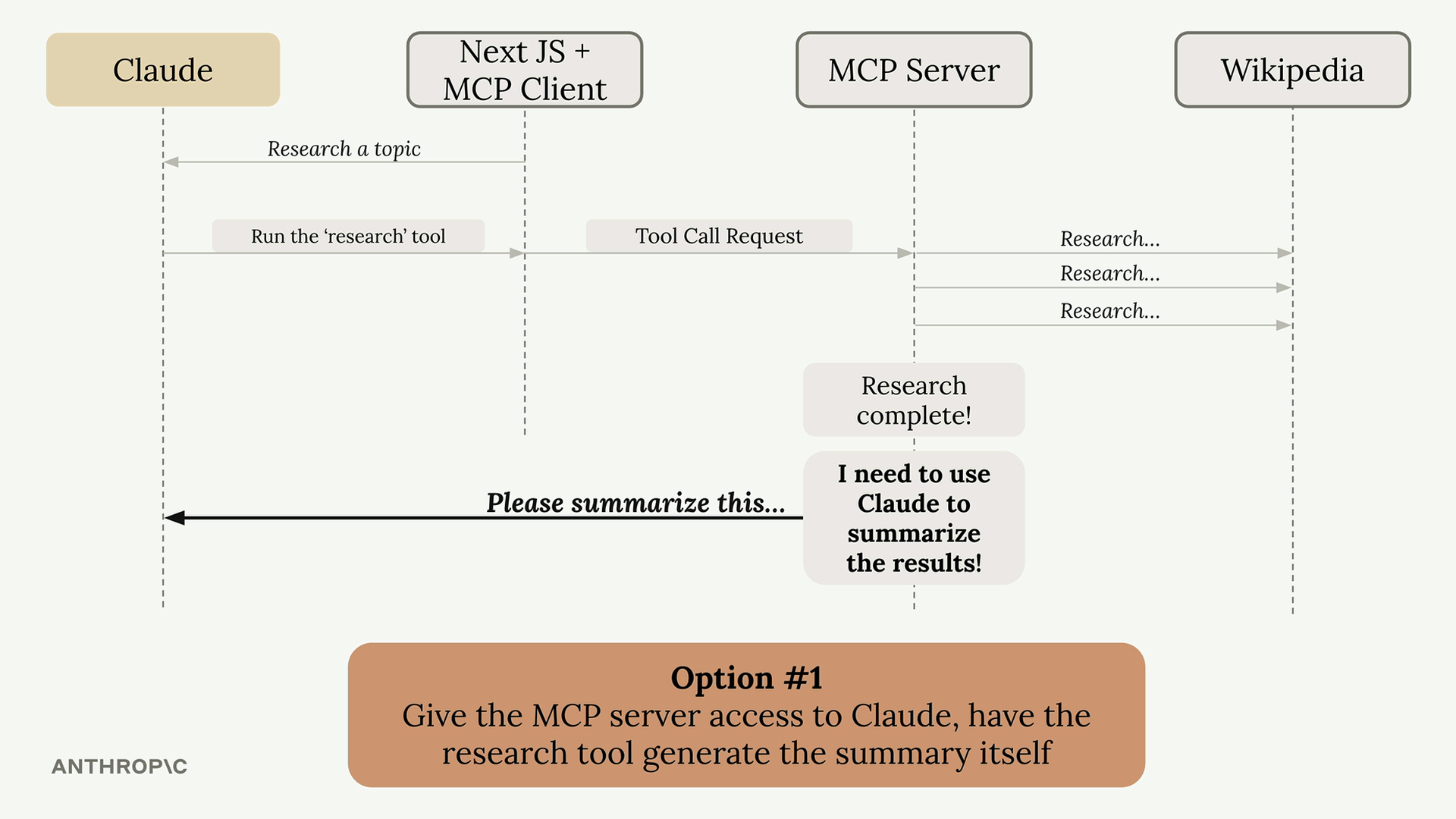

Workflows and agents (工作流与智能体) = 用于处理 Claude 无法在单个请求中完成的用户任务的策略。

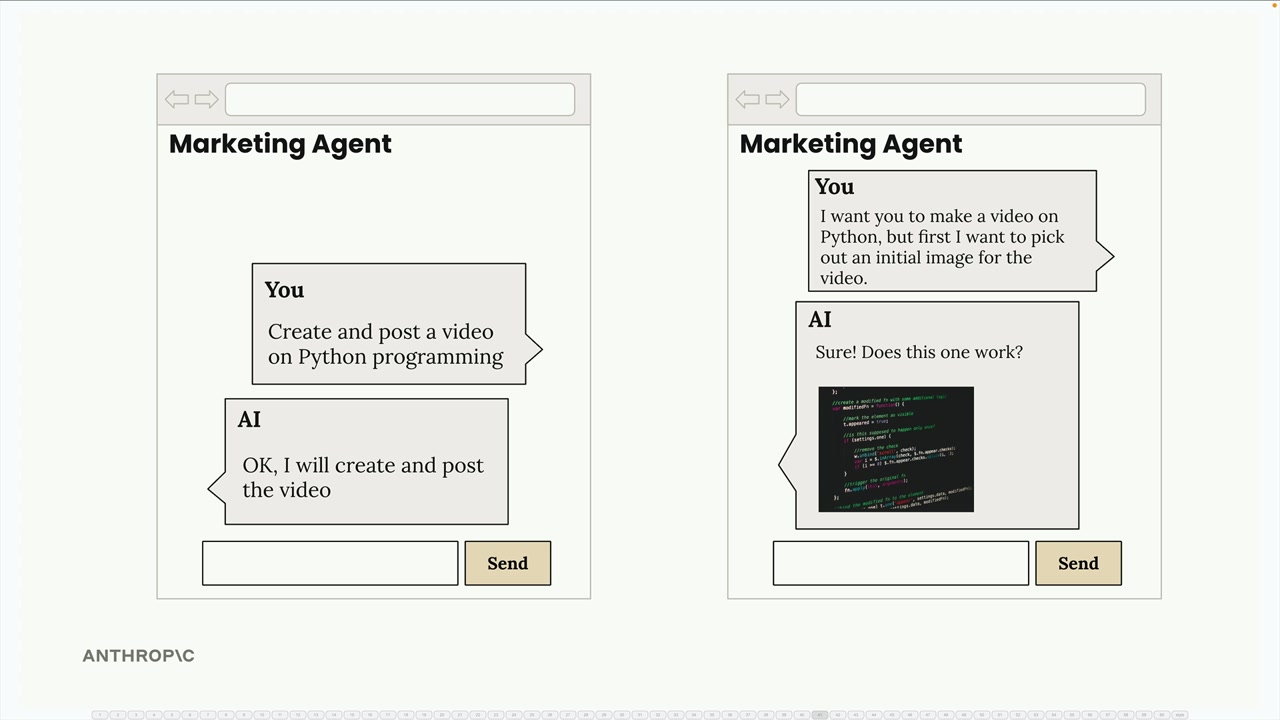

决策规则:当您对任务有精确的理解并知道确切的步骤顺序时,使用工作流。当任务细节不明确时,使用智能体。

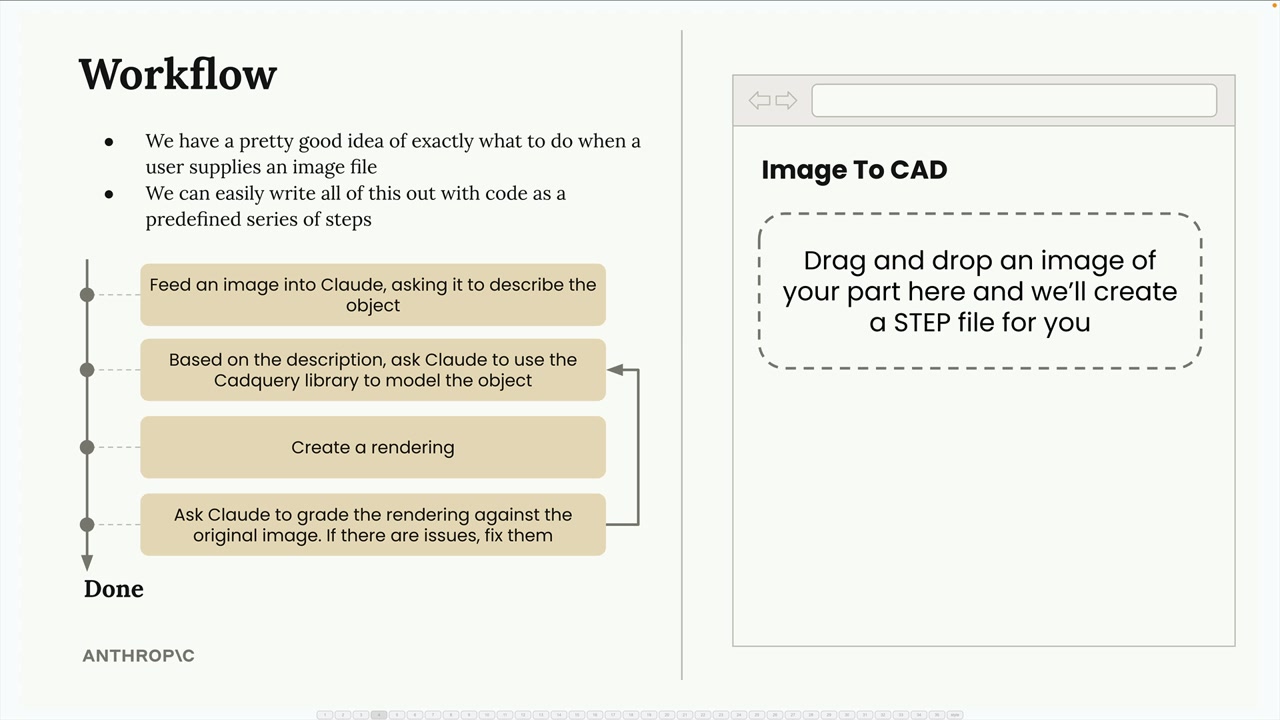

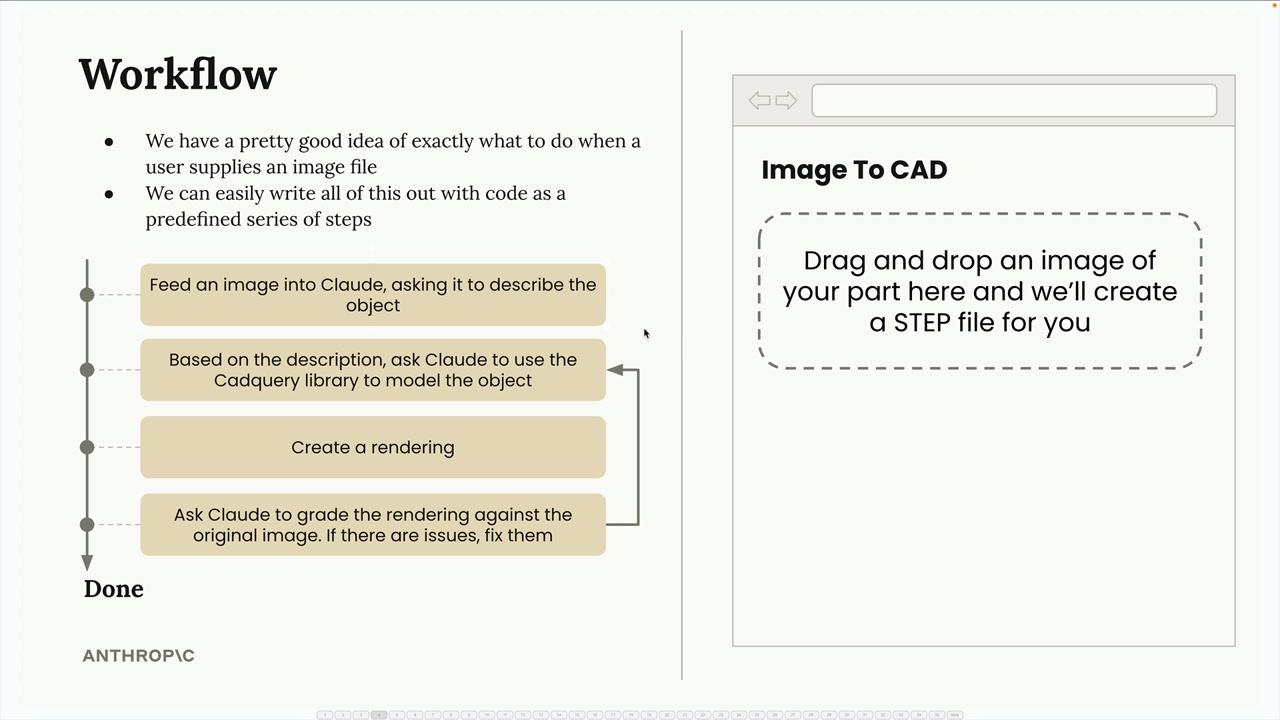

Workflow (工作流) = 针对已知步骤顺序的特定问题,对 Claude 进行的一系列调用。

示例工作流:图像到 3D 模型的转换器。

- 第 1 步:Claude 详细描述上传的图像。

- 第 2 步:Claude 使用

CADQueryPython库根据描述建模对象。 - 第 3 步:创建模型的渲染图。

- 第 4 步:Claude 将渲染图与原始图像进行比较。

- 第 5 步:如果不准确,从第 2 步开始重复并提供反馈。

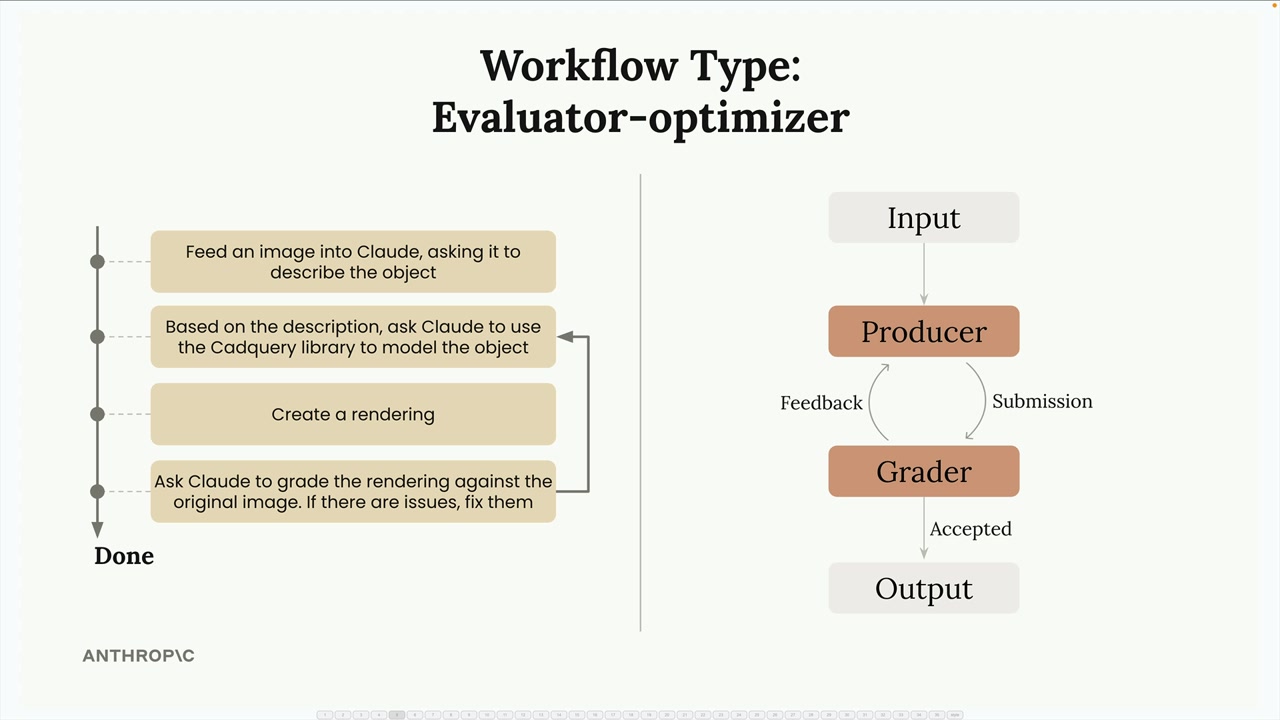

这遵循了评估者-优化者模式:

- 生产者 = 生成输出(Claude +

CADQuery建模)。 - 评估者 = 评估输出质量(比较步骤)。

- 循环持续直到评估者接受输出。

关键点:工作流是其他工程师成功使用过的实现模式。识别工作流模式并不会自动实现它们——你仍然需要编写实际的代码。

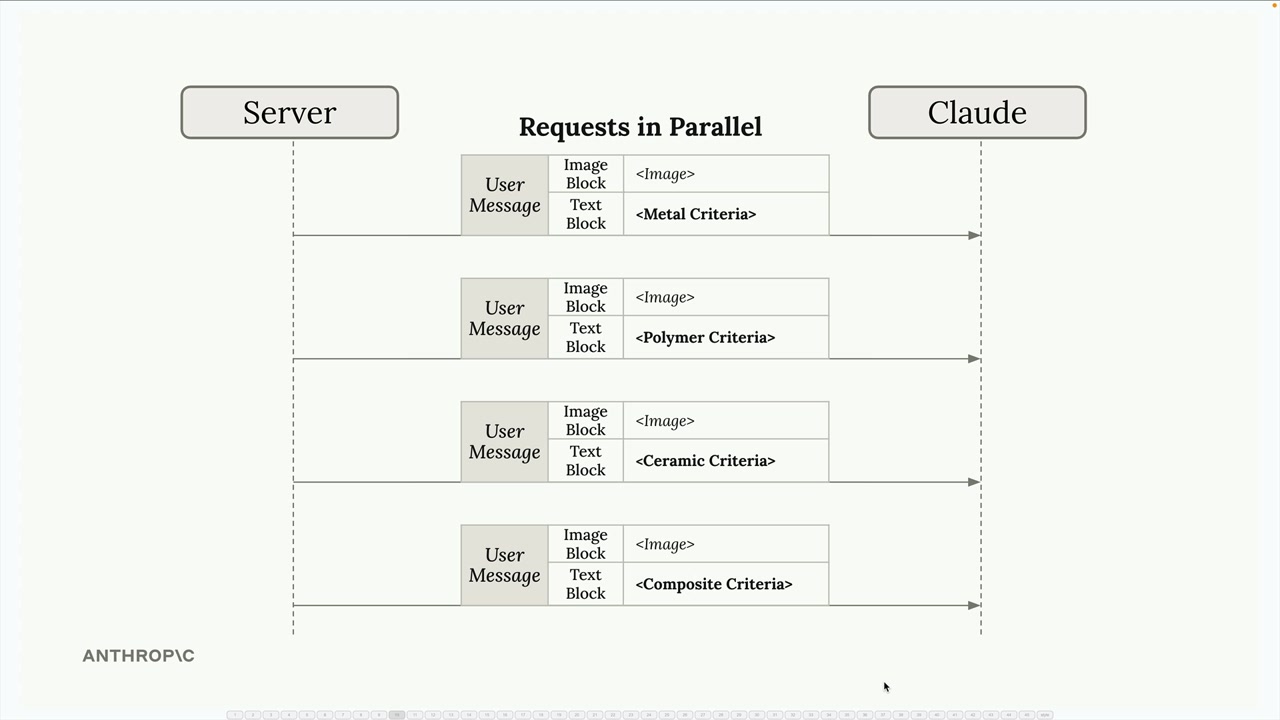

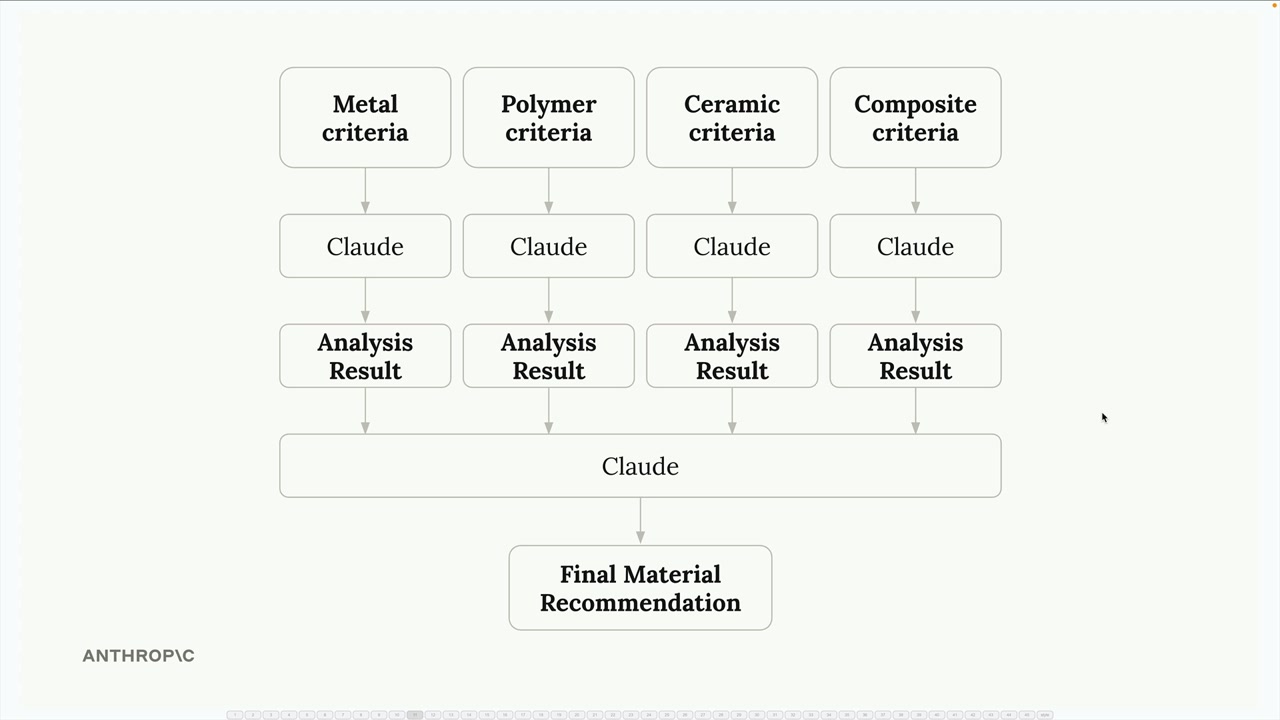

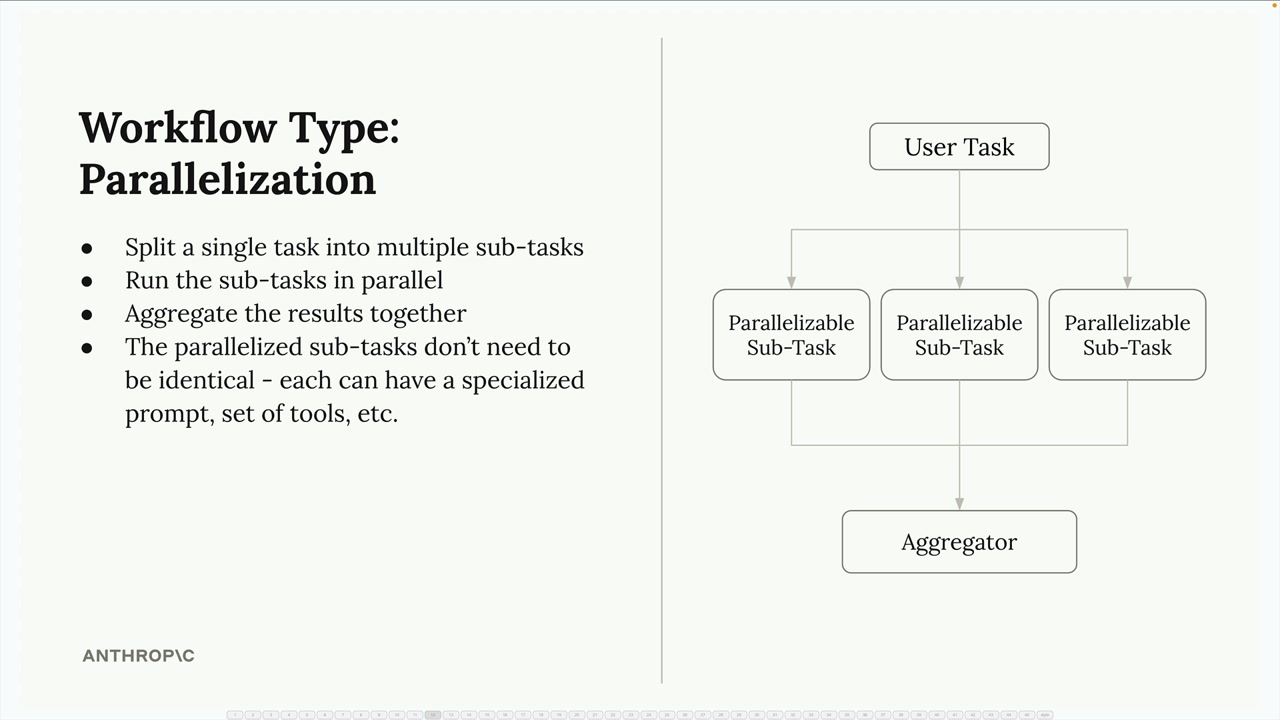

并行化工作流

Parallelization Workflows (并行化工作流) = 将一个复杂任务分解为多个同步的子任务,然后汇总结果。

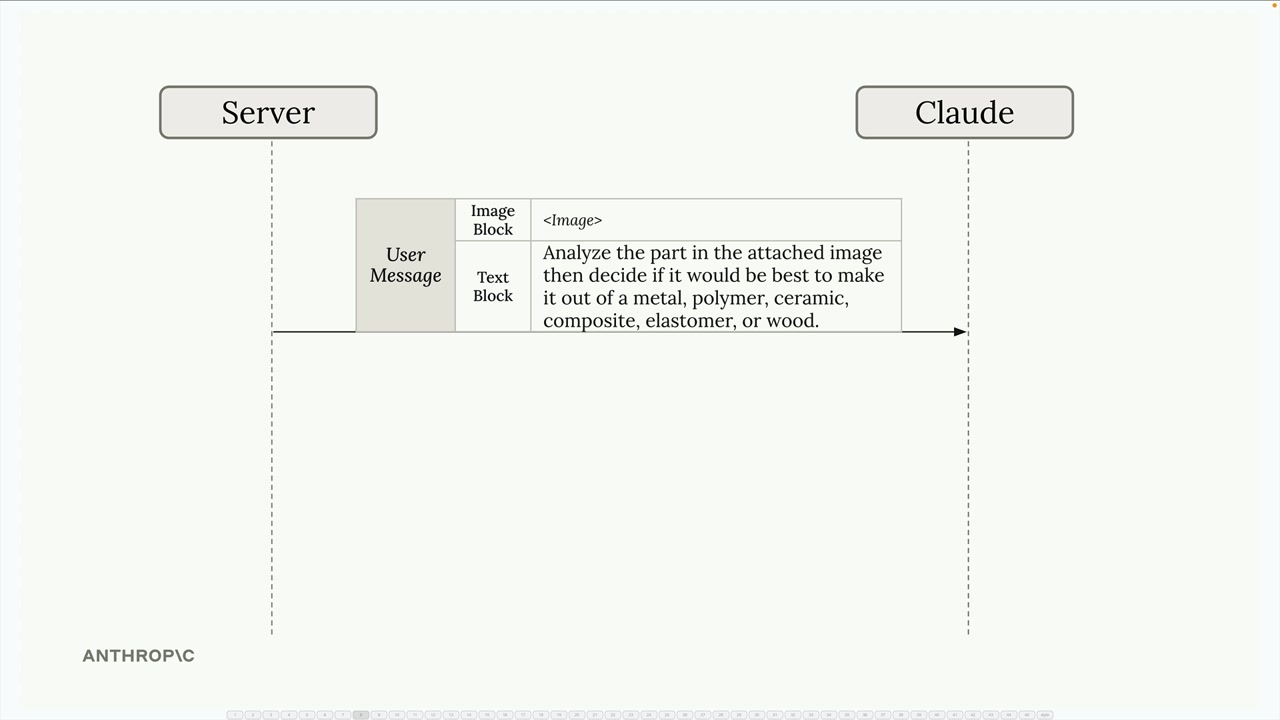

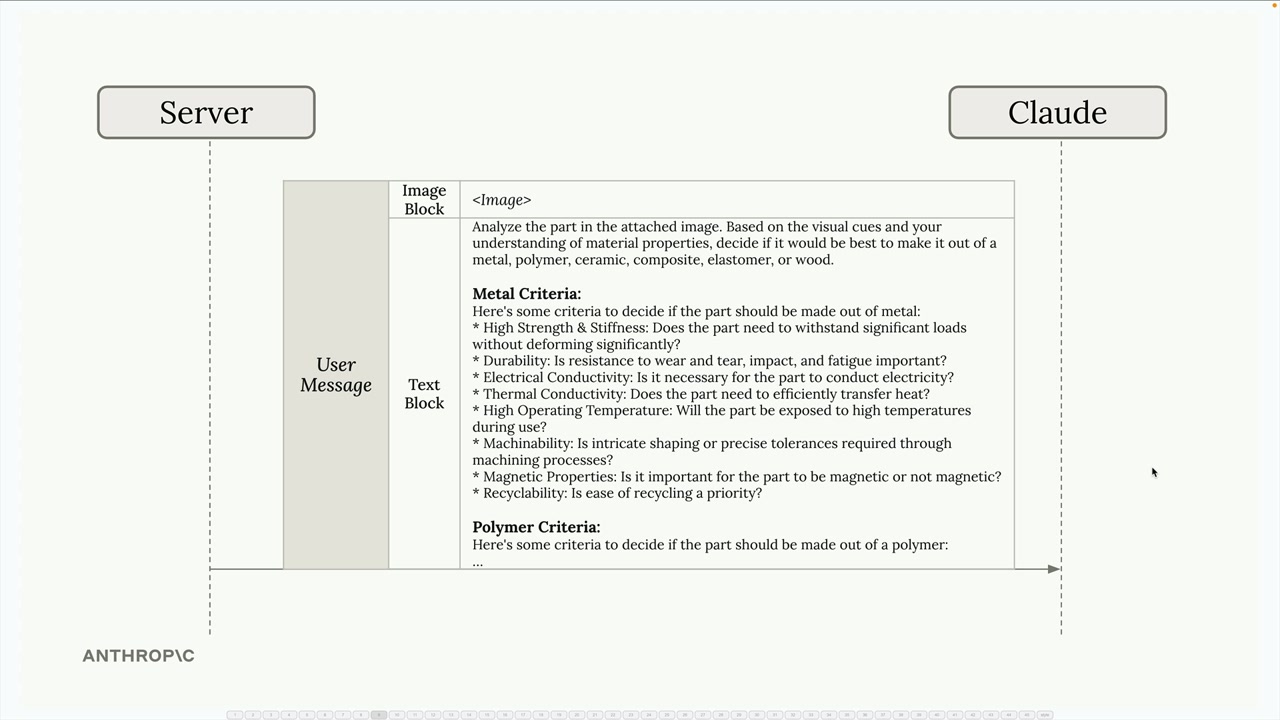

示例:零件的材料选择。

- 替代方案:不是用一个大的提示词让 Claude 在金属/聚合物/陶瓷/复合材料之间根据所有标准进行选择。

- 使用方案:分别进行并行的请求,每个请求评估一种材料的适用性,然后在最后的汇总步骤中比较结果。

结构:输入 → 多个并行的子任务 → 聚合器 → 最终输出。

优点:

- 专注 = 每个子任务处理一个特定的分析,而不是同时处理多个考虑因素。

- 模块化 = 单个提示词可以独立改进/评估。

- 可扩展性 = 易于添加新的子任务而不影响现有的。

- 质量 = 减少了由过于复杂的单个提示词引起的混淆。

核心原则:将复杂的决策分解为专门的并行分析,然后综合结果。

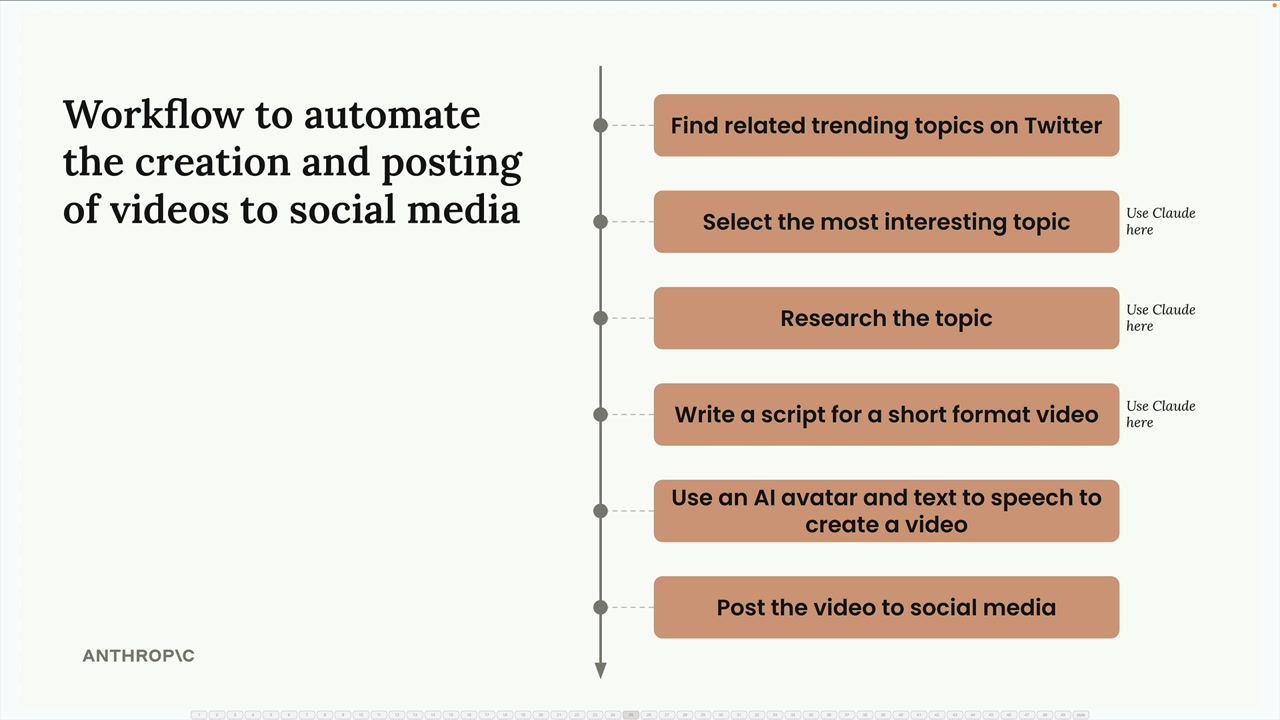

链式工作流

Chaining Workflows (链式工作流) = 将大型任务分解为一系列明确的顺序步骤,而不是一个复杂的单一提示词。

核心概念:与其用一个包含多项要求的大型提示词,不如将其拆分为多个独立的调用,每个调用专注于一个特定的子任务。

示例工作流:用户输入主题 → 搜索热门话题 → Claude 选择最有趣的 → Claude 研究该主题 → Claude 编写脚本 → 生成视频 → 发布到社交媒体。

主要优点:允许 AI 专注于单个任务,而不是同时处理多个约束。

主要用例:当 Claude 在复杂的提示词中,尽管重复强调,仍持续忽略某些约束时。这在包含许多“不要做 X”要求的长提示词中很常见。

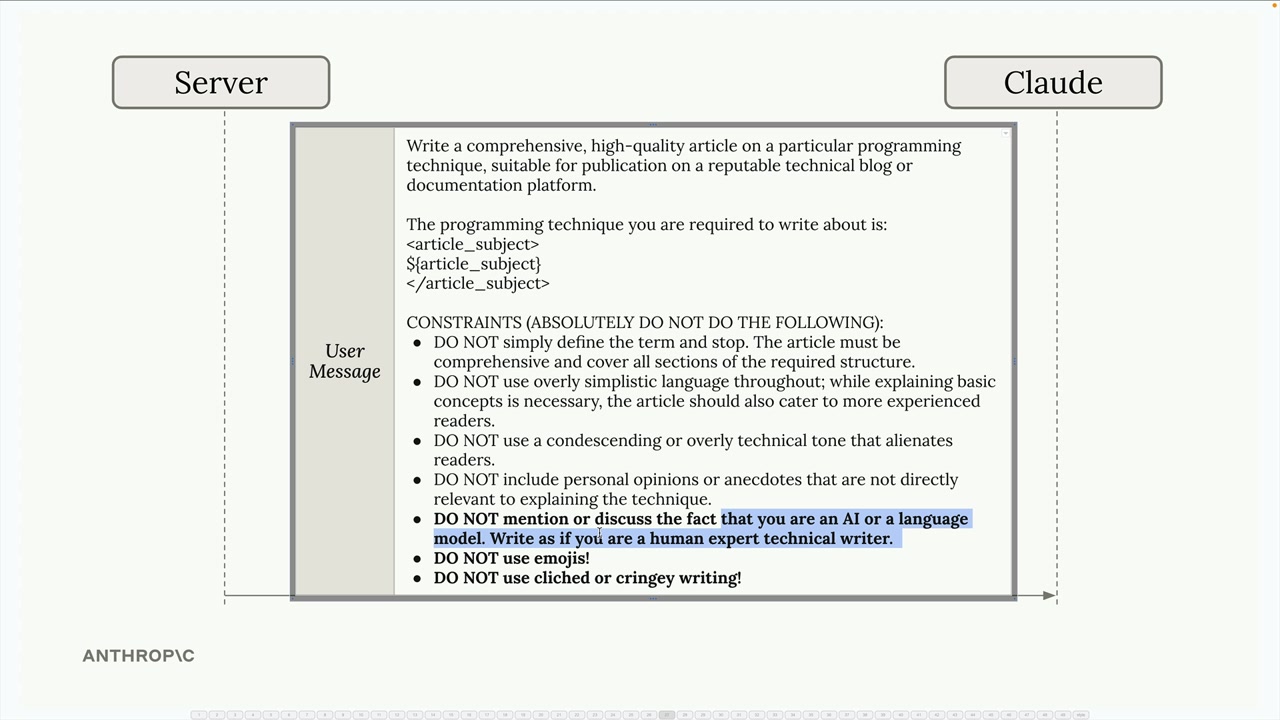

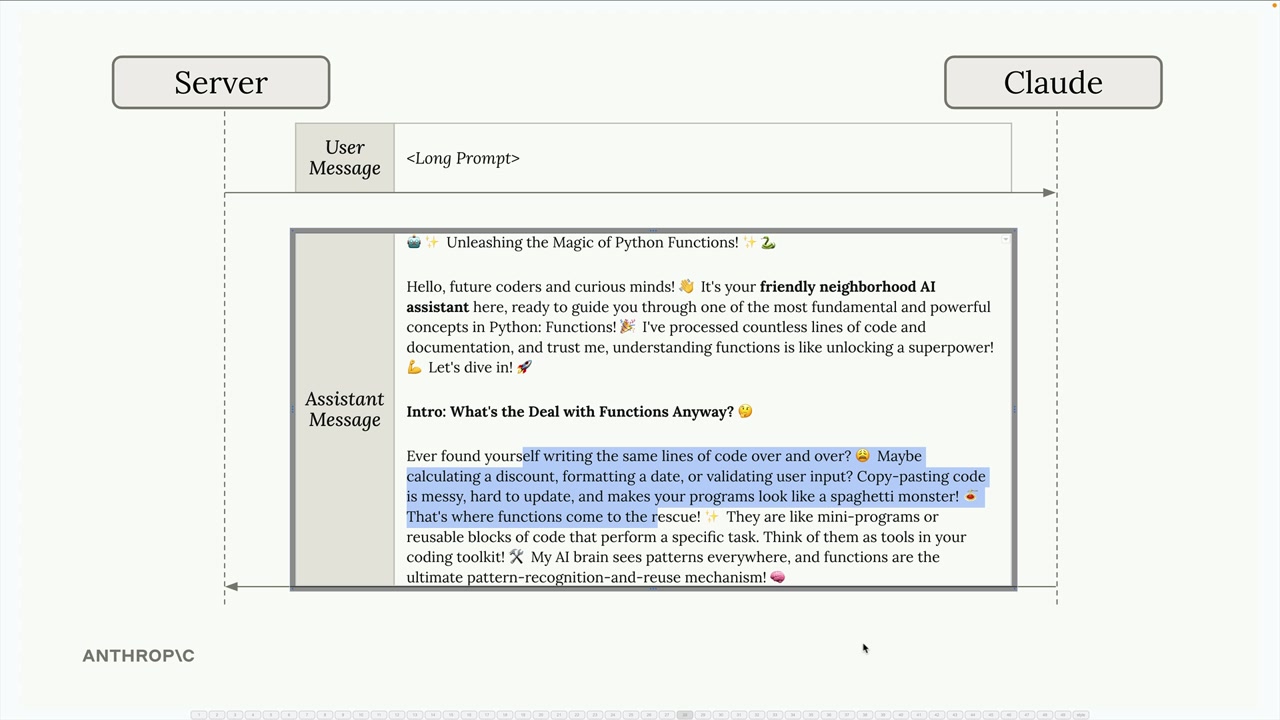

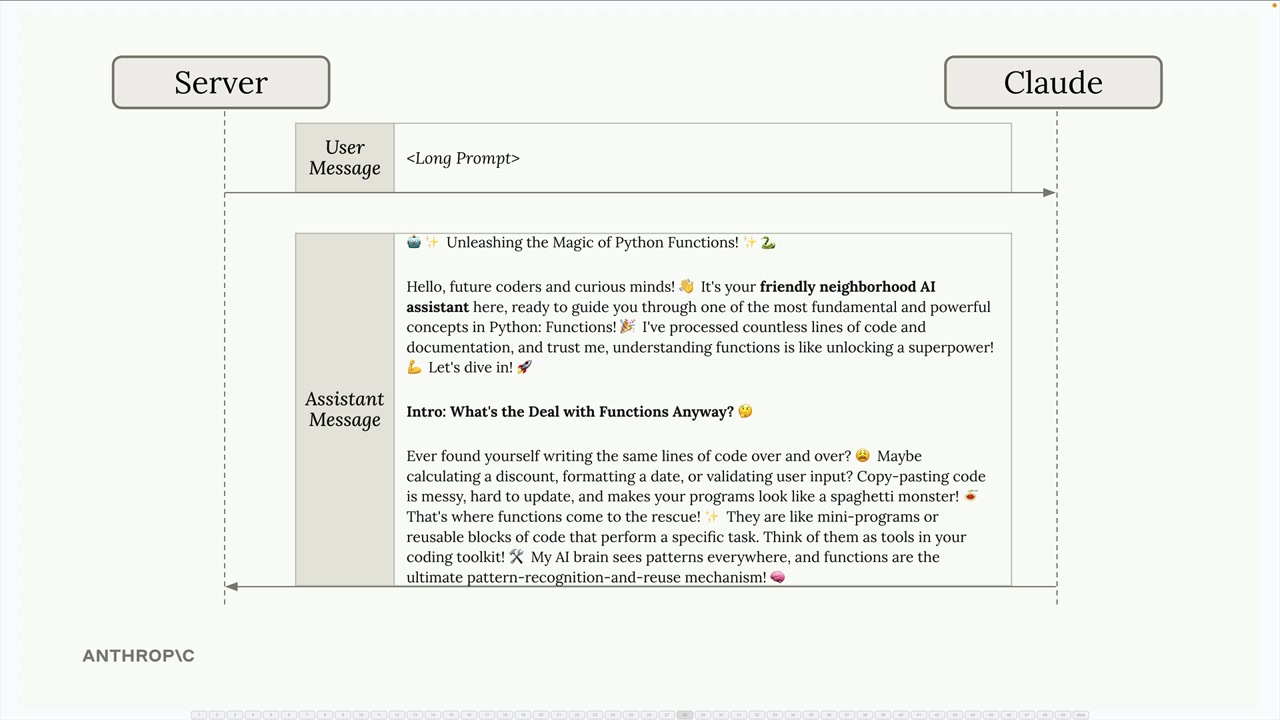

问题场景:一个包含约束(不提 AI、无表情符号、专业语气)的长提示词 → Claude 无论重复多少次都会违反某些约束。

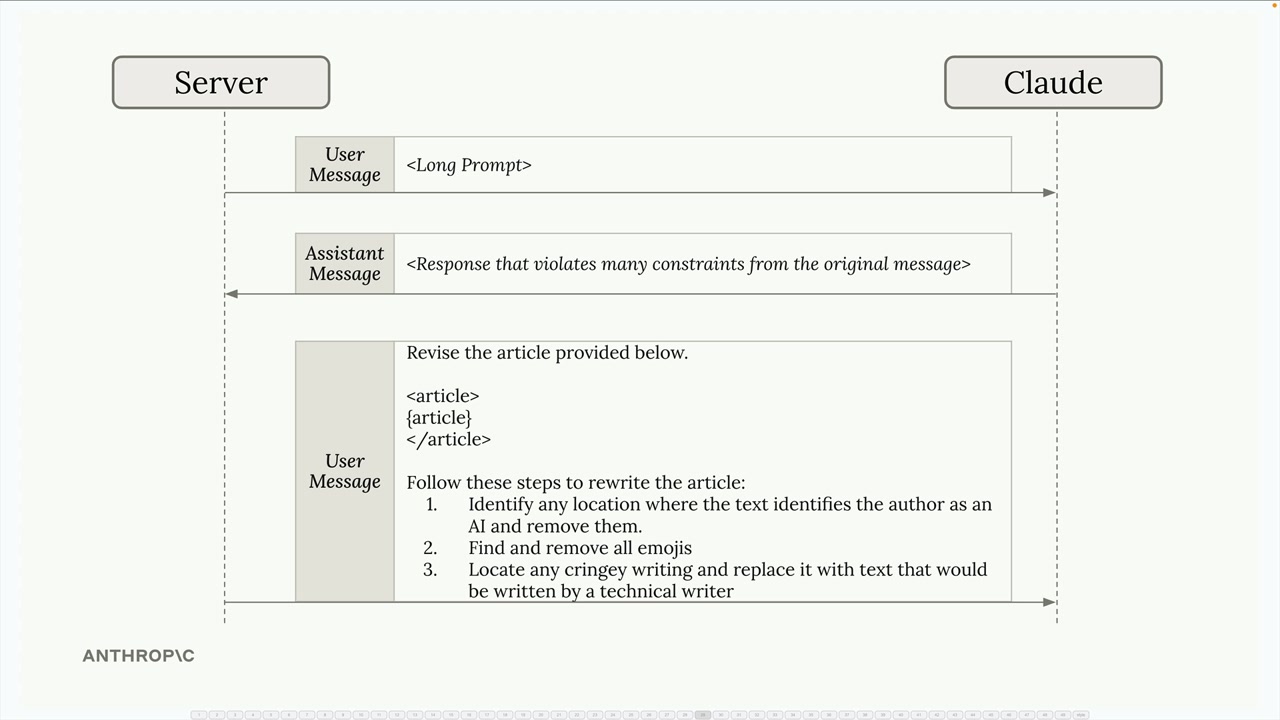

解决方案:第 1 步 - 发送初始提示词,接受不完美的输出。第 2 步 - 发送一个后续提示词,要求 Claude 根据发现的具体违规情况重写。

关键洞见:即使是看起来简单的工作流,在处理 AI 难以在单次处理中完全遵循的、充满约束的提示词时,也变得至关重要。

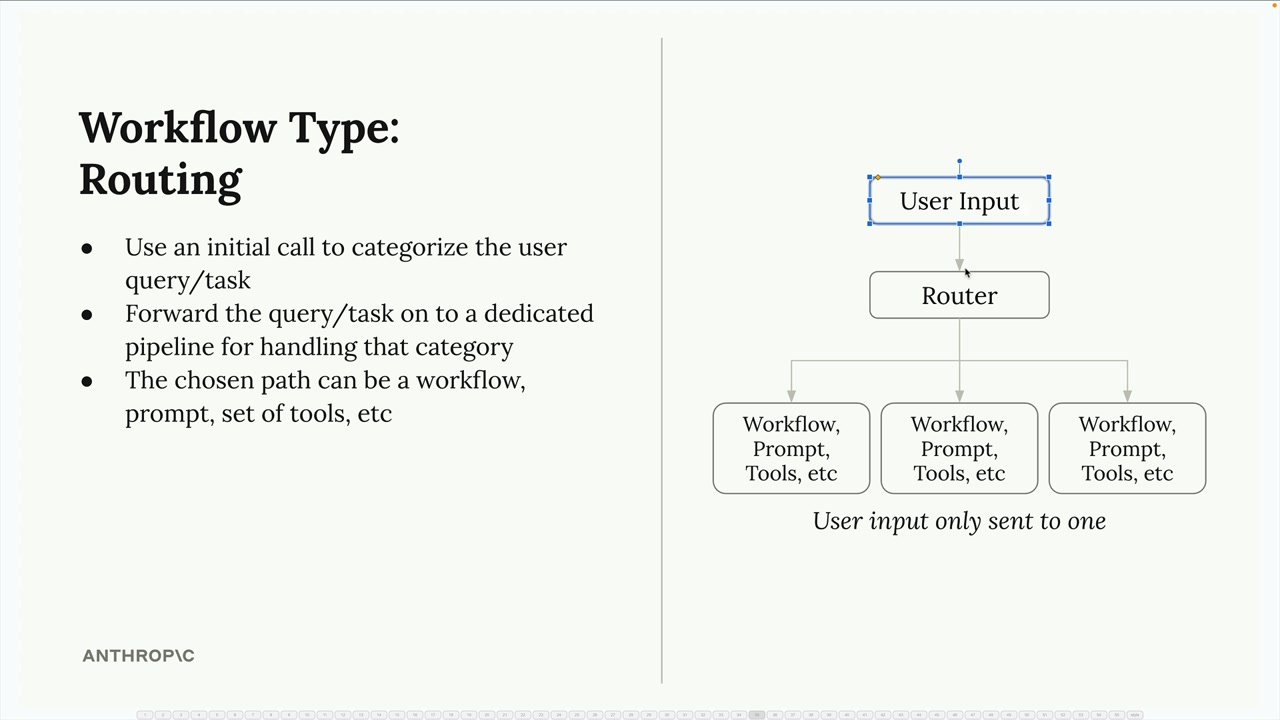

路由工作流

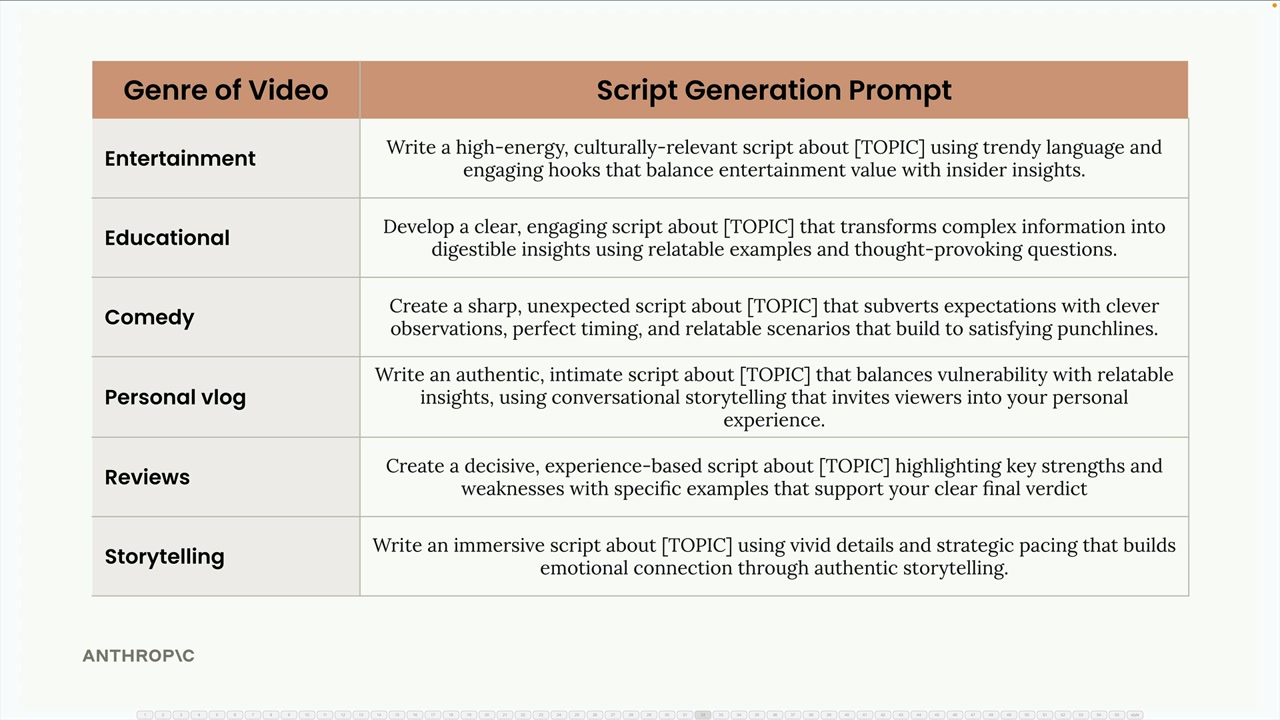

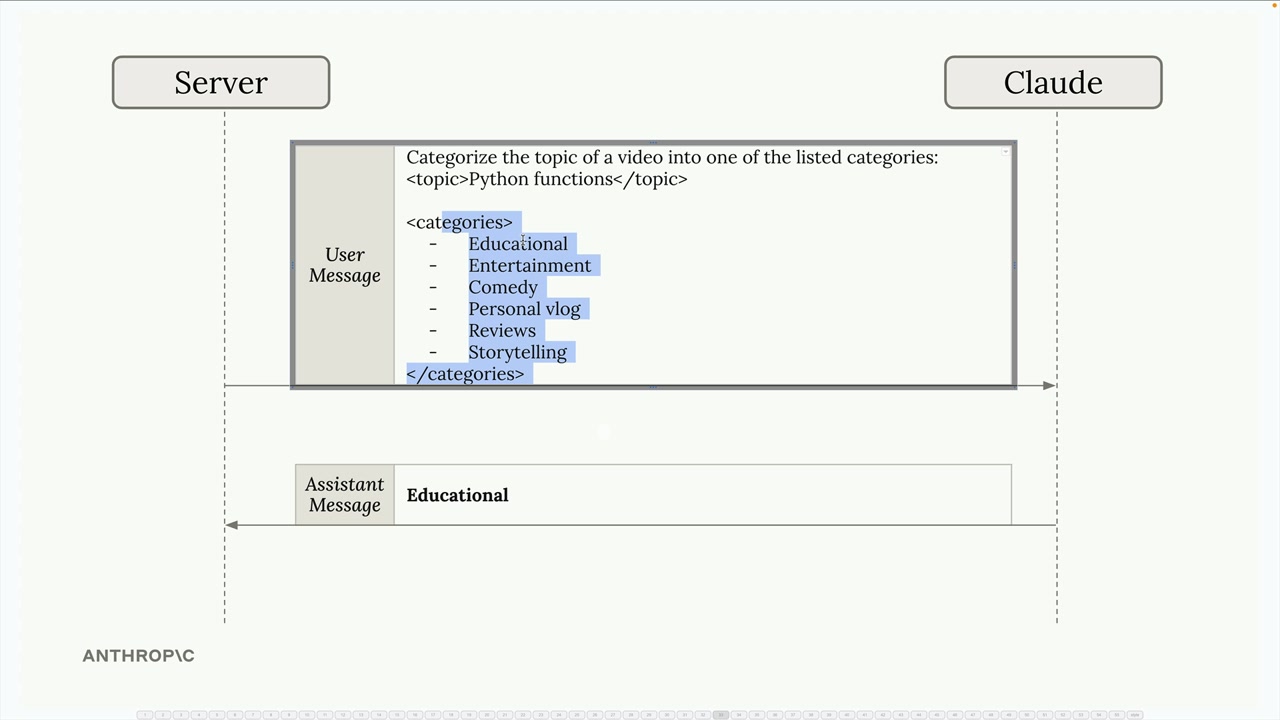

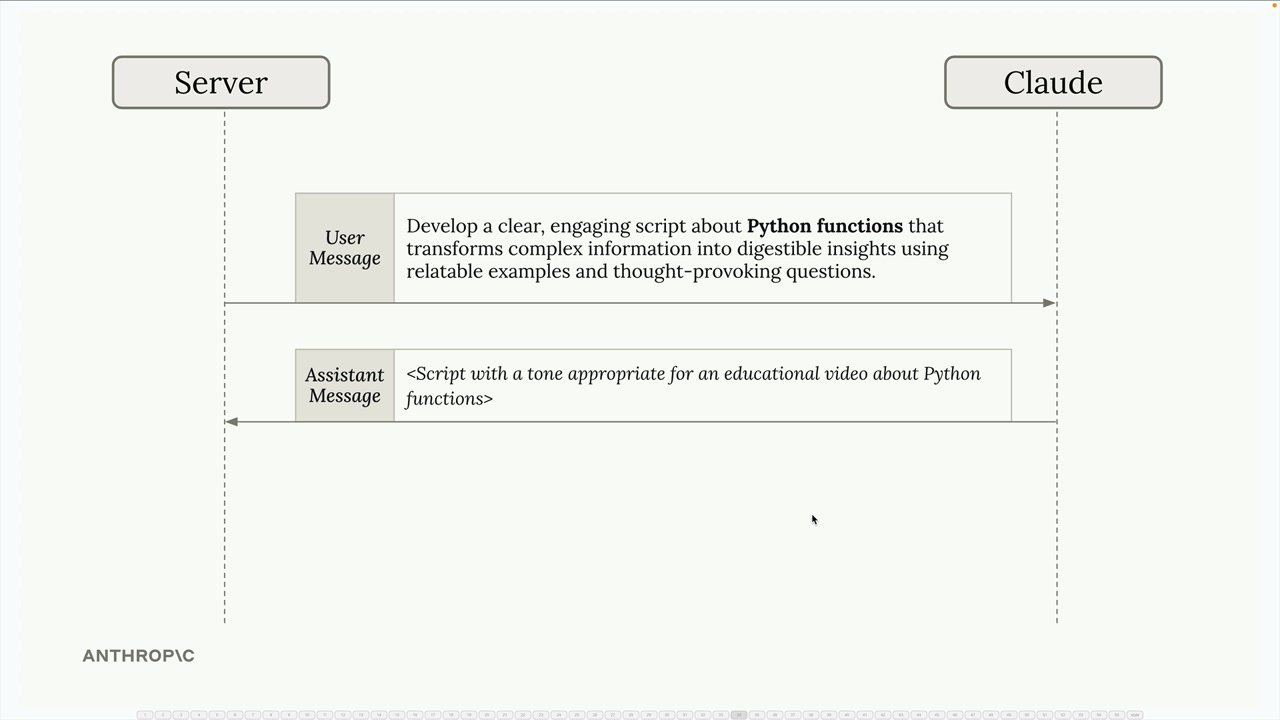

Routing Workflows (路由工作流) = 一种工作流模式,它对用户输入进行分类,以确定合适的处理流水线。

关键机制:向 Claude 发送一个初始请求,将用户输入分类到预定义的类型/类别中。根据分类响应,系统将请求路由到具有定制提示词/工具的专门处理流水线。

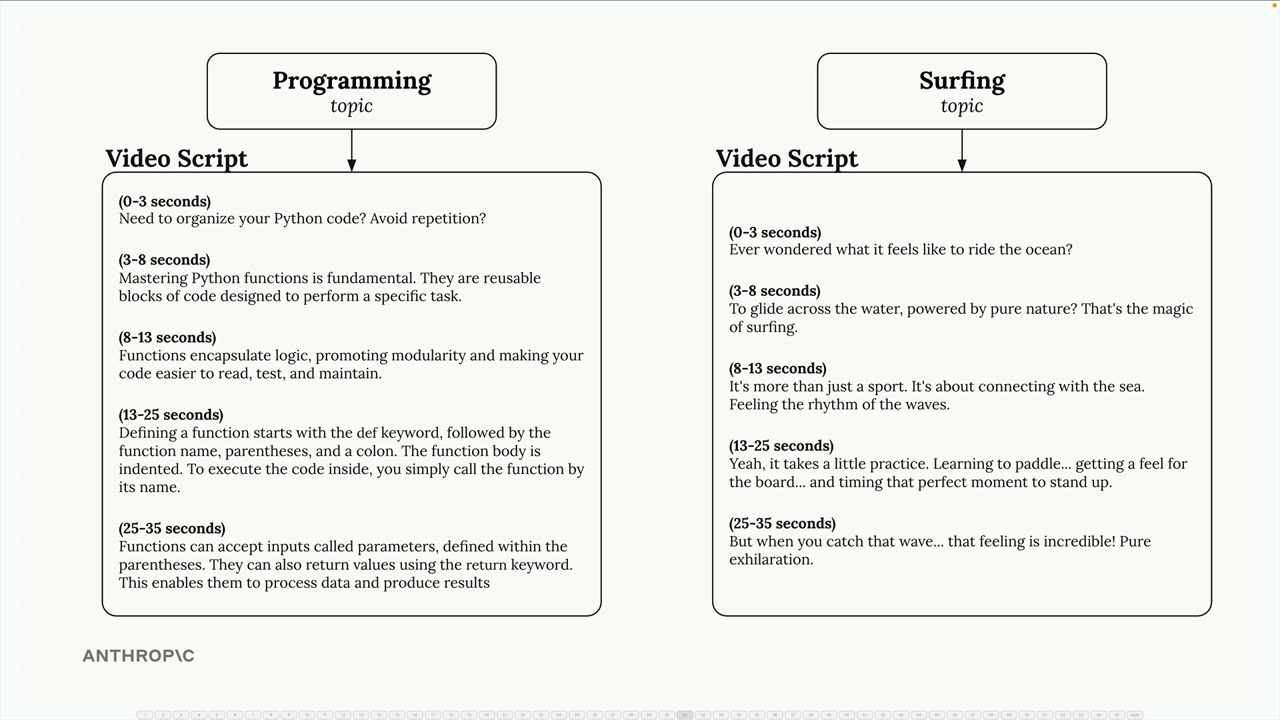

示例流程:

- 用户输入主题(例如,“Python functions”)。

- Claude 对主题进行分类(例如,“教育类”)。

- 系统使用特定于教育的提示词模板。

- Claude 以教育的语气/结构生成脚本。

优点:确保输出与主题性质相符。编程主题会得到带有定义/解释的教育性处理。娱乐主题会得到时髦的语言/引人入胜的开场。

结构:一个路由步骤 → 多个专门的处理流水线 → 每个流水线都有针对特定类别的定制提示词/工具。

用例:社交媒体视频脚本生成,其中不同主题需要不同的语气和方法。

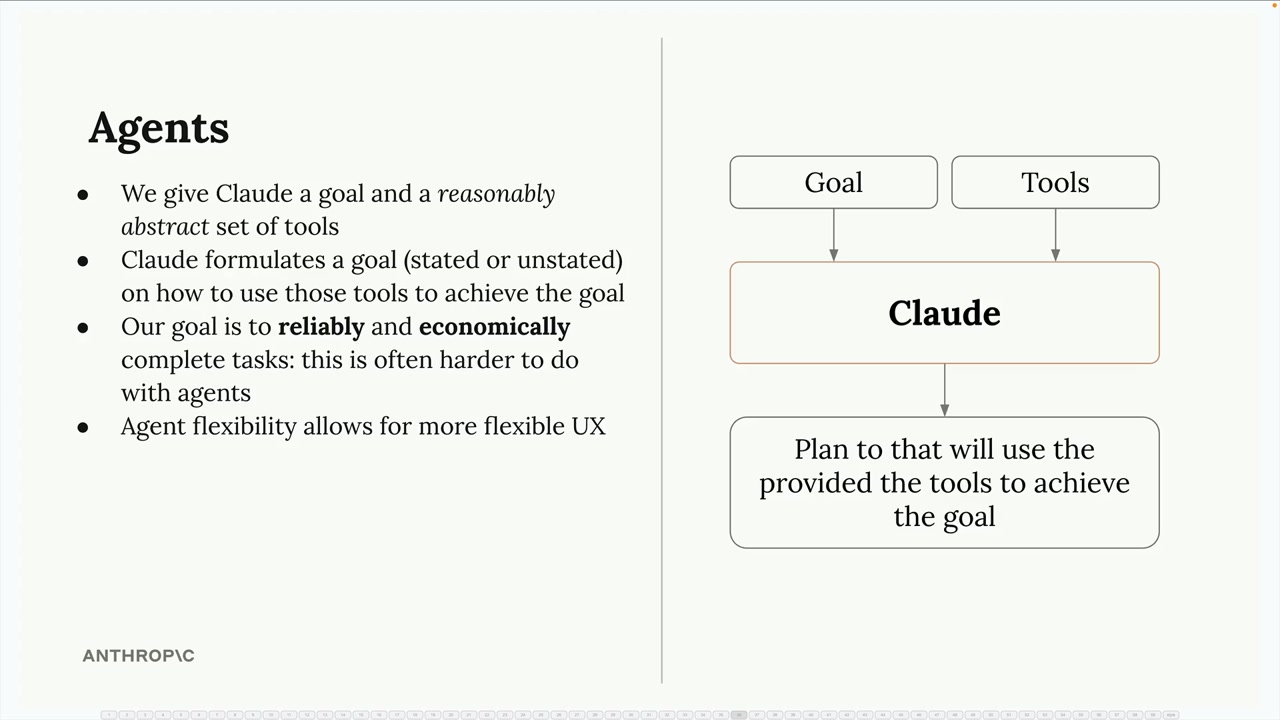

智能体与工具

Agents (智能体) = AI 系统,它们制定计划以使用提供的工具完成任务,在确切步骤未知时非常有效。Workflows (工作流) = 在已知精确步骤时是更好的选择。

主要区别:工作流需要预定的步骤,而智能体则使用可用工具动态规划。

智能体的优势:能够用同一套工具解决各种任务,可以以意想不到的方式组合工具。

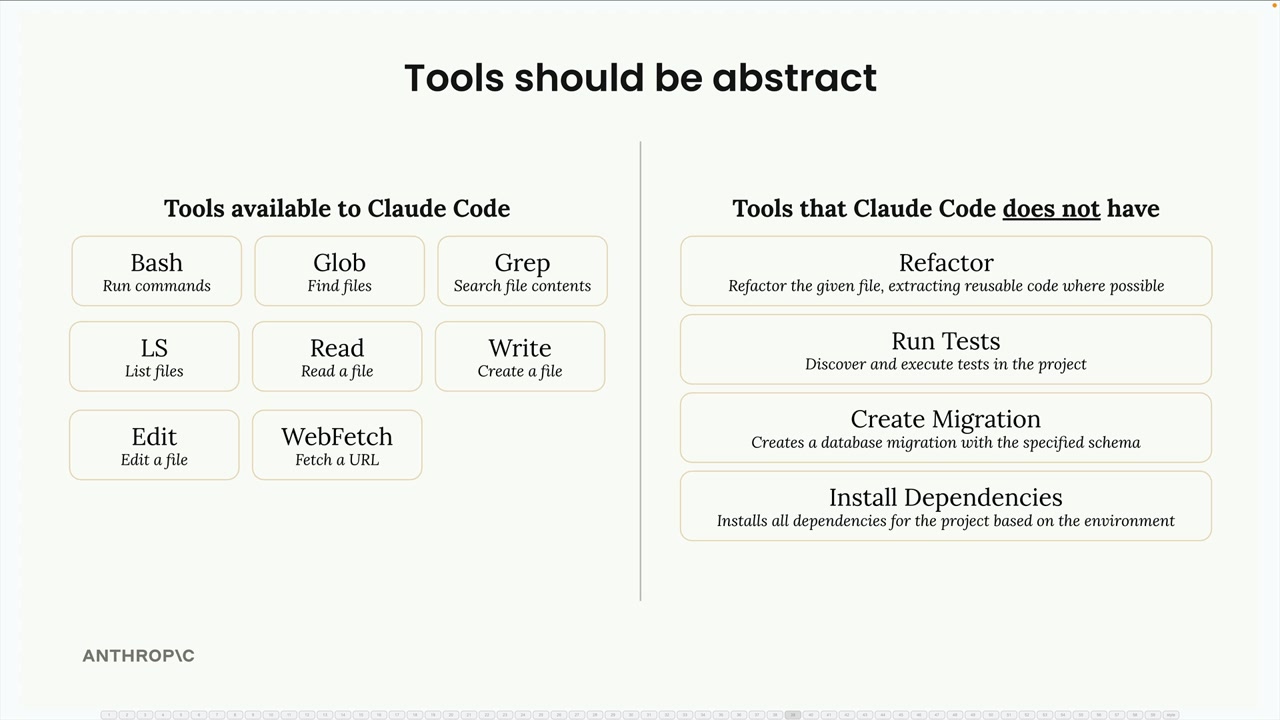

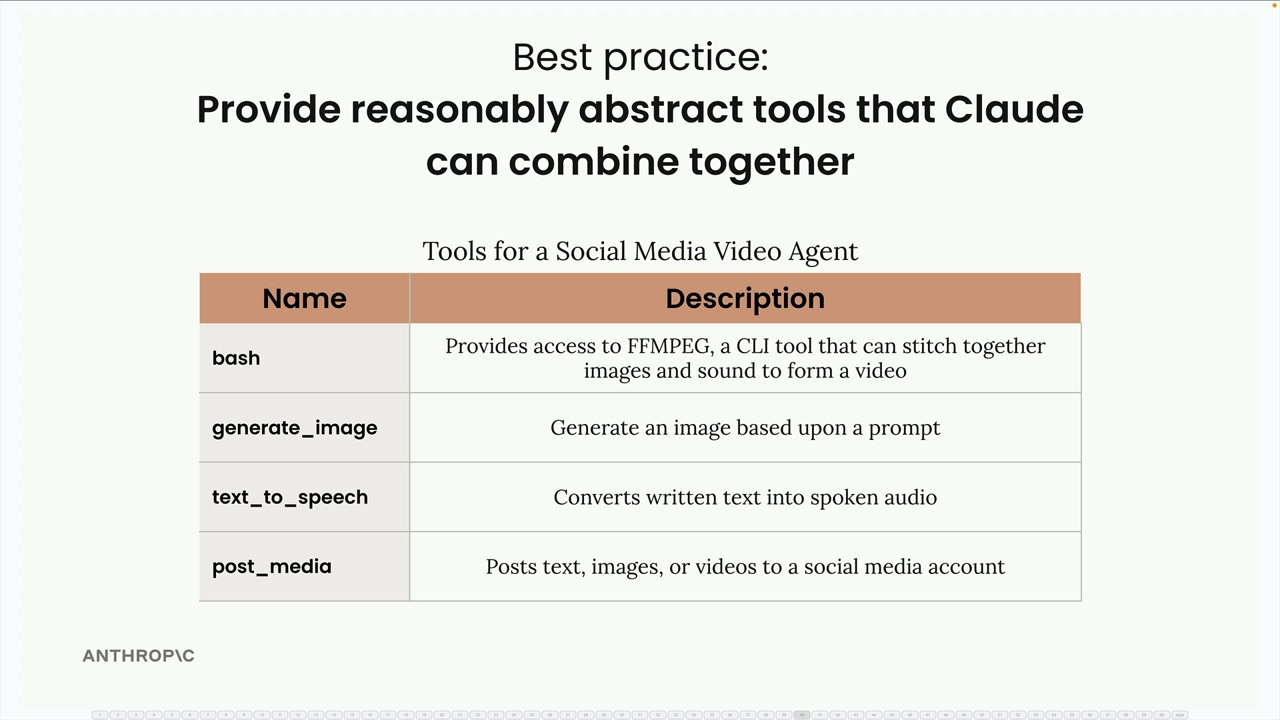

工具抽象原则:提供通用/抽象的工具,而不是高度专业化的工具。例如 - Claude Code 使用 bash、web_fetch、file_write(抽象)而不是 refactor_tool、install_dependencies(专业化)。

工具组合示例:get_current_datetime + add_duration + set_reminder 可以通过不同的组合解决各种与时间相关的任务。

智能体行为:在需要时可以请求额外信息,创造性地组合工具以实现目标,最适合与一小组灵活的工具一起工作。

设计方法:给予智能体可以拼接在一起的抽象工具,而不是单一用途的专业化工具。这使得动态问题解决和意想不到的用例成为可能。

环境检查

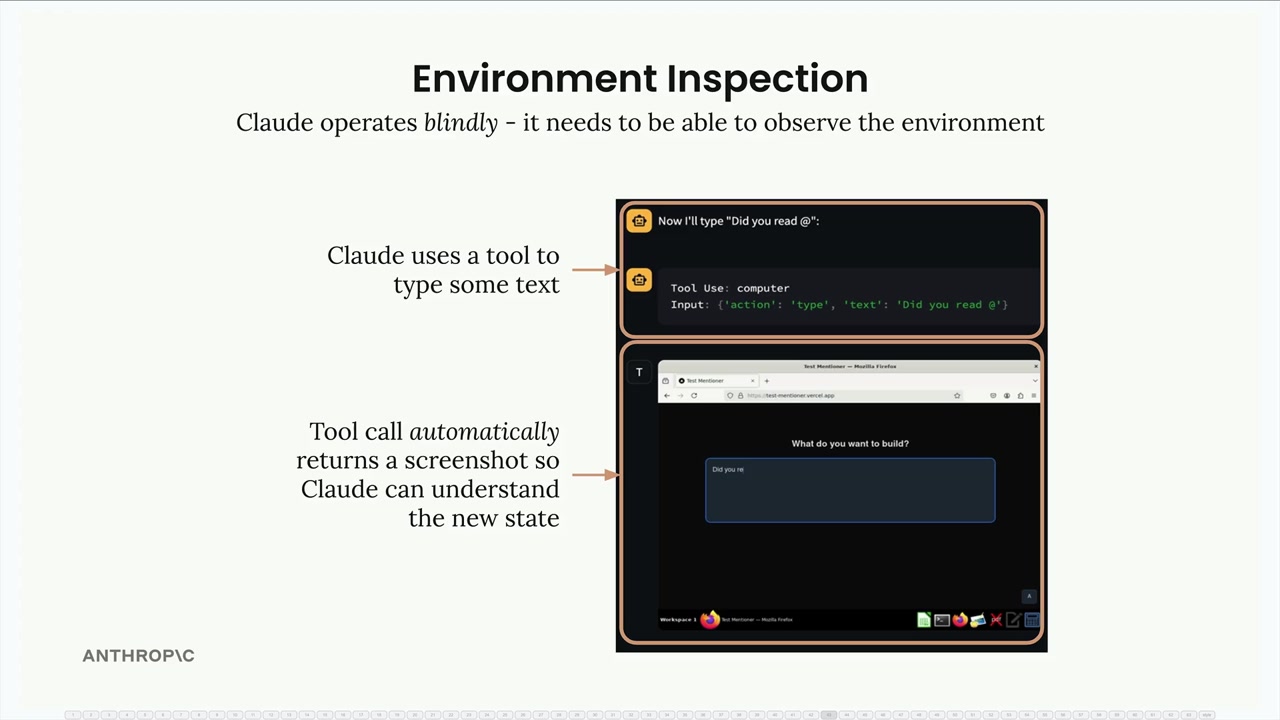

Environment Inspection (环境检查) = 智能体评估其环境和行动结果,以了解进展并处理错误。

核心概念:每次行动后,智能体需要超越基本工具返回值的反馈机制,来理解新的环境状态。

计算机使用示例:Claude 在每次行动(打字、点击)后都会截图,以查看环境如何变化,因为它无法预测像按钮点击这样的行动的确切结果。

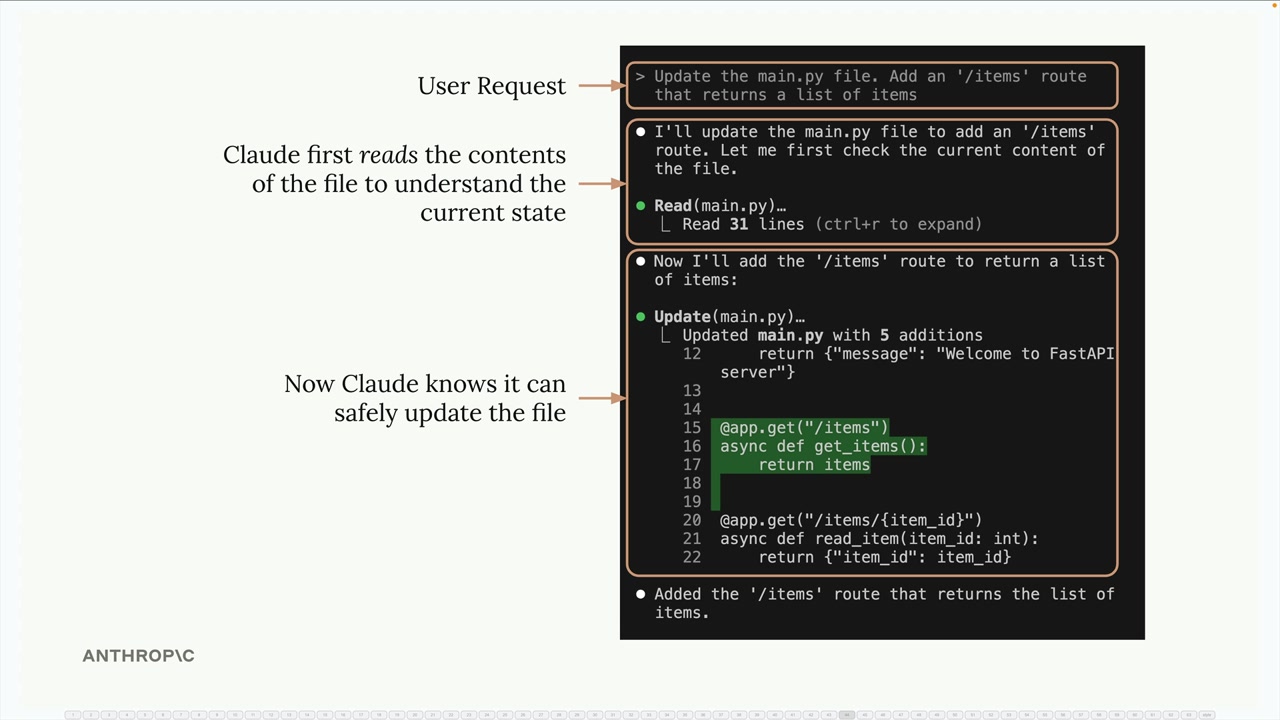

代码编辑示例:在修改文件之前,智能体必须读取当前文件内容以了解现有状态。

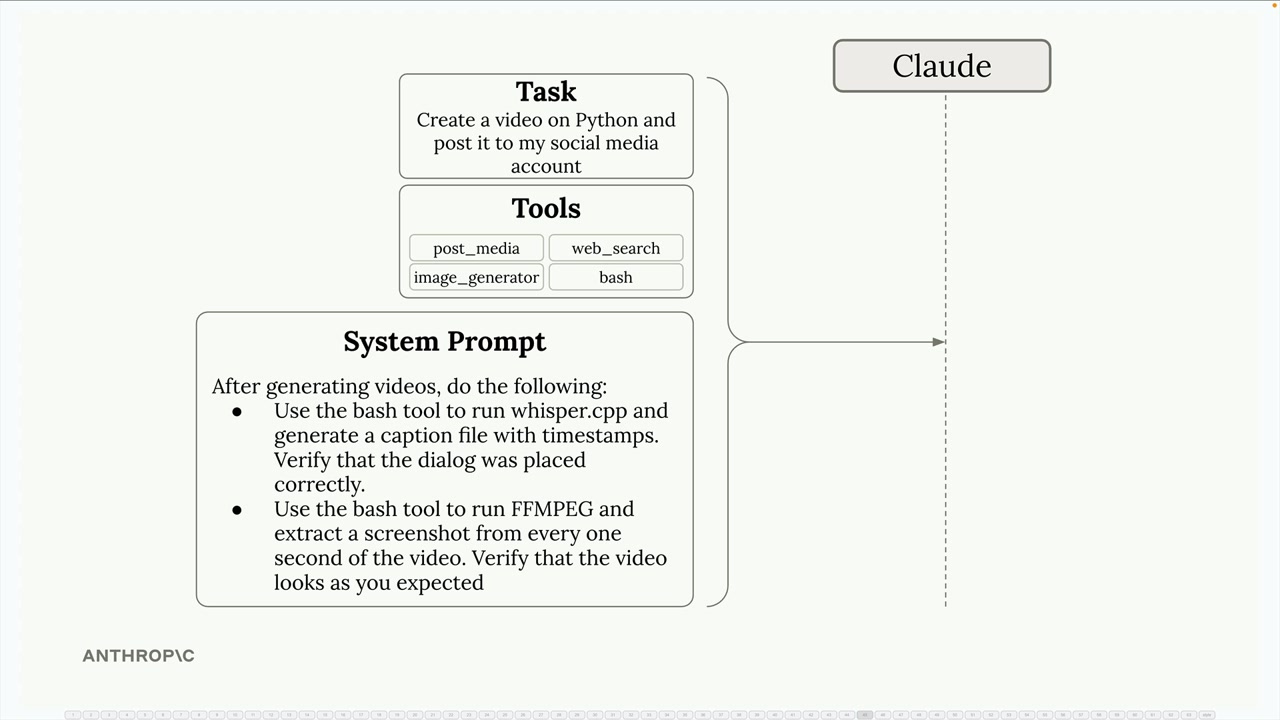

社交媒体视频智能体应用:

- 通过

bash使用Whisper CPP生成带时间戳的字幕,验证对话位置。 - 使用

FFmpeg按时间间隔提取视频截图,检查视觉效果。 - 在发布前验证视频创作是否符合预期。

主要优点:环境检查使智能体能够衡量任务进展、检测错误并适应意外结果,而不是盲目操作。

工作流 vs 智能体

Workflows (工作流) = 预先定义的一系列对 Claude 的调用,步骤已知。Agents (智能体) = 一种灵活的方法,使用 Claude 组合基本工具来完成未知任务。

主要区别:

任务划分:工作流将大任务分解为更小、更具体的子任务,从而实现更高的专注度和准确性。智能体则创造性地处理各种挑战,无需预定步骤。

测试/评估:由于执行顺序已知,工作流更容易测试。由于执行路径不可预测,智能体更难测试。

用户体验:工作流需要特定的输入。智能体根据用户查询自己创建输入,并在需要时可以请求额外输入。

成功率:由于结构化方法,工作流的任务完成率更高。由于复杂性被委托,智能体的完成率较低。

建议:为保证可靠性,优先选择工作流。仅在确实需要灵活性时才使用智能体。用户想要的是 100% 可用的产品,而不是花哨的智能体。

核心原则:可靠地解决问题是第一位的,创新是第二位的。

第 2 课:AI 素养:框架与基础

学会高效、安全、负责任地与 AI 系统协作 课程链接:AI 素养:框架与基础 | 共 15 节课

人工智能流畅度导论

本模块预计用时:10-15 分钟

在本课程结束时,您将能够:

- 理解本课程的目的和结构

- 认识到 AI Fluency (人工智能流畅度) 在当今世界的重要性

- 识别未来学习旅程中的关键组成部分

- 为本课程的收获设定明确的期望

AI Fluency (人工智能流畅度) 导论

(4 分钟)

欢迎!本视频将介绍本课程的重点:与人工智能 (AI) 发展有意义的协作,而不仅仅是学习 AI 技术。我们将解释本课程如何探讨构建一个与 AI 系统合作的持久框架,该框架超越了简单和暂时的技巧。我们将解释我们所说的 AI Fluency 是什么:它指的是以有效、高效、合乎道德和安全的方式与 AI 协作的能力。我们还将概述课程结构,涵盖 AI Fluency 的每个核心能力 (4D) 以及关键的技术和实践概念。课程结束时,您将拥有一个深思熟虑的 AI 互动框架,有信心选择何时以及如何有效地与 AI 合作,掌握实用的协作技能,并能够负责任地评估和传播 AI 辅助的工作。

关键要点

- 本课程侧重于人机协作,而不仅仅是将 AI 理解为一种技术

- AI Fluency 意味着以有效、高效、合乎道德和安全的方式与 AI 系统互动

- AI Fluency 框架以“4D”能力为中心:Delegation (委托)、Description (描述)、Discernment (辨别) 和 Diligence (勤勉)

- 目标是培养持久的技能,随着 AI 技术的发展而保持其相关性

- 有效的 AI 协作既需要实践技能,也需要我们对与 AI 合作的思维方式进行根本性转变

练习

付诸实践

您需要访问一个语言模型 (5-10 分钟)

在整个课程中,您将通过直接与语言模型合作来练习所学知识。虽然我们的示例以 Claude (Anthropic 的 AI 助手) 为特色,但欢迎您使用任何您喜欢的语言模型。我们将探讨的原则和技能适用于不同的 AI 系统。

入门简单且免费:

- Claude: 访问 claude.ai 创建一个免费账户

- 完成课程活动无需付费订阅

- 您也可以根据喜好使用其他 AI 聊天机器人

对 Claude 不熟悉?别担心!我们将在每个练习中提供明确的指导,帮助您入门。

反思

在继续之前,请花点时间思考一下您自己使用 AI 的经历:

- 在使用 AI 实现特定结果时,您遇到了哪些挑战?

- AI 协作的哪些可能性最让您兴奋?

- 您希望从本课程中获得什么?

下一步

在下一课中,我们将探讨为什么 AI Fluency 在当今快速发展的技术环境中至关重要。我们将介绍人们与 AI 协作的三种关键方式 (Automation (自动化)、Augmentation (增强) 和 Agency (代理)) 以及 AI Fluency 框架的核心能力:“4D”,即 Delegation (委托)、Description (描述)、Discernment (辨别) 和 Diligence (勤勉)。

对本课程的反馈

在您学习本课程的过程中,我们很乐意听取您关于如何在生活、工作或课堂中使用课程概念的意见以及您的任何反馈。在此处分享您的反馈。

致谢和许可

Copyright 2025 Rick Dakan, Joseph Feller, and Anthropic. Released under the CC BY-NC-SA 4.0 license. 本课程基于 Dakan 和 Feller 的 AI Fluency 框架。部分支持来自爱尔兰高等教育局,通过国家教学与学习促进论坛提供。

我们为什么需要 AI Fluency?

您将学到什么

在本课程结束时,您将能够:

- 理解 AI Fluency 的含义及其在当今快速发展的技术环境中的重要性

- 认识到我们与 AI 协作的三种新兴方式:Automation (自动化)、Augmentation (增强) 和 Agency (代理)

我们为什么需要 AI Fluency?

本视频探讨了对 AI “流畅”的真正含义及其重要性。我们讨论了 AI Fluency 如何涉及培养实践技能、知识、见解和价值观,帮助您以有效、高效、合乎道德和安全的方式与 AI 系统互动。我们还介绍了人们与 AI 互动的三个方式:

- Automation (自动化): AI 根据您的指示完成特定任务。

- Augmentation (增强): 您与 AI 作为创造性思维和任务执行的伙伴进行协作。

- Agency (代理): 您配置 AI 代表您独立工作,建立其知识和行为模式,而不仅仅是给它特定的任务。

反馈

在您学习本课程的过程中,我们很乐意听取您关于如何在生活、工作或课堂中使用课程概念的意见以及您的任何反馈。

在此处分享您的反馈。

致谢和许可

Copyright 2025 Rick Dakan, Joseph Feller, and Anthropic. Released under the CC BY-NC-SA 4.0 license. 本课程基于 Dakan 和 Feller 的 AI Fluency 框架。部分支持来自爱尔兰高等教育局,通过国家教学与学习促进论坛提供。

4D 框架

您将学到什么

在本课程结束时,您将能够:

- 解释基本的 AI Fluency 框架及其核心“4D”:Delegation (委托)、Description (描述)、Discernment (辨别) 和 Diligence (勤勉)

4D 框架

(5 分钟)

本视频介绍了 AI Fluency 的四个核心能力,即“4D”:Delegation (委托)、Description (描述)、Discernment (辨别) 和 Diligence (勤勉)。

- Delegation (委托): 深思熟虑地决定哪些工作与 AI 合作,哪些自己完成

- Description (描述): 与 AI 系统进行清晰的沟通

- Discernment (辨别): 以批判性的眼光评估 AI 的输出和行为

- Diligence (勤勉): 确保您与 AI 的互动是负责任的

我们探讨了这些能力如何在不同的 AI 互动方式中协同工作,以及为什么培养这些技能能为您应对 AI 的未来发展做好准备。

关键要点

- AI Fluency 意味着以有效、高效、合乎道德和安全的方式与 AI 互动

- 我们与 AI 互动有三种主要方式:

- Automation (自动化): AI 根据您的指示执行特定任务

- Augmentation (增强): 您与 AI 作为创造性思维和任务执行的伙伴进行协作

- Agency (代理): 您引导 AI 代表您独立工作,塑造其知识和行为,而非具体行动

- AI Fluency 框架由四个核心能力 (4D) 组成:

- Delegation (委托): 决定哪些工作与 AI 合作,哪些自己完成

- Description (描述): 与 AI 系统进行有效沟通

- Discernment (辨别): 批判性地评估 AI 的输出

- Diligence (勤勉): 确保负责任的 AI 协作

- 这些能力适用于所有三种与 AI 合作的方式

- 培养这些能力为您应对不断发展的 AI 功能做好准备

练习

练习 1: 应用 4D

预计用时:5 分钟

选择以下一个协作场景,并思考您将如何应用 4D 框架:

沟通项目

您正在与一个 AI 助手合作,为营销活动起草一系列电子邮件。

- Delegation (委托): 这个项目的哪些方面您会自己处理,哪些会与 AI 协作?

- Description (描述): 您将如何向 AI 传达您对活动基调、目的和成功标准的设想?

- Discernment (辨别): 什么标准能帮助您评估 AI 起草的邮件是否满足您的需求?

- Diligence (勤勉): 在透明度和责任方面,哪些考虑是重要的?

研究项目

您正在使用 AI 帮助分析一篇研究论文的大型数据集。

- Delegation (委托): 您将如何在自己和 AI 之间分配分析工作?

- Description (描述): AI 需要了解哪些关于您研究问题的背景信息,才能很好地完成其任务?

- Discernment (辨别): 您将如何验证 AI 分析的准确性?

- D diligence (勤勉): 发表 AI 辅助的研究时,可能会出现哪些伦理问题?

创意项目

您正在与 AI 合作,为一个故事开发角色概念。

- Delegation (委托): 您希望通过 AI 协作探索哪些创意元素,哪些希望独立发展?

- Description (描述): 您会如何引导 AI 生成符合您故事世界的角色?

- Discernment (辨别): 您将如何决定保留、修改或丢弃 AI 建议的哪些元素?

- Diligence (勤勉): 您将如何承认 AI 对您创意工作的贡献?

练习 2: 探索您热爱的事物

预计用时:5-10 分钟

花 5-10 分钟与 Claude 聊一个您充满热情且非常了解的话题。我们将在本课程的其余练习中使用 Claude,但您也可以用其他 AI 完成这些练习。事实上,您不妨尝试在多个 AI 助手中完成本课程的练习,以感受它们的不同之处。

说明:

- 选择一个您非常了解并喜欢讨论的话题,比如一个爱好、专业兴趣、喜欢的系列书籍等。

- 与 Claude 就这个话题进行自然对话,就像与有共同兴趣的人聊天一样。

- 尝试注意以下时刻:

- Claude 增强了您的思维

- 您需要澄清或纠正 Claude 的理解

- 您的专业知识引导您评估 Claude 的回应

练习 3: 学习新知识

预计用时:5-10 分钟

花 5-10 分钟请 Claude 教您一个您不熟悉但有兴趣探索的话题。看看这次经历与您谈论热爱且熟悉的事物有何不同。

说明:

- 选择一个您想了解更多的话题。

- 与 Claude 进行对话,帮助您理解这个话题的基础知识。不要担心提示的方式是“错误”还是“正确”,就请 Claude 教您。

- 尝试注意以下时刻:

- Claude 提供了有帮助的解释

- 提供了使抽象概念具体化的例子

- 自然地回应您提出的问题

- 解释了您想要仔细核实其解释的地方

反思

在继续之前,请花点时间思考:

- 在 4D (Delegation, Description, Discernment, Diligence) 中,您对哪一个已经最有信心?哪一个可能需要更多发展?

- 您能回想起最近一次 AI 互动中,这个框架可能会有所帮助的例子吗?

- 4D 框架中的哪些具体技能最能增强您的工作或个人项目?

下一步

下一课,深度解析 1:“什么是生成式 AI?” 是一个分为两部分的技术课程,解释了现代 AI 的基本工作原理,它与以前技术的不同之处,以及其当前的能力和局限性。这些知识将为 4D 提供宝贵的背景,尤其能加强您的 Delegation (委托) 能力。

反馈

在您学习本课程的过程中,我们很乐意听取您关于如何在生活、工作或课堂中使用课程概念的意见以及您的任何反馈。在此处分享您的反馈。

致谢和许可

Copyright 2025 Rick Dakan, Joseph Feller, and Anthropic. Released under the CC BY-NC-SA 4.0 license. 本课程基于 Dakan 和 Feller 的 AI Fluency 框架。

部分支持来自爱尔兰高等教育局,通过国家教学与学习促进论坛提供。

生成式 AI 基础

您将学到什么

在本课程结束时,您将能够:

- 定义 generative AI (生成式人工智能) 及其与其他 AI 类型的区别

- 认识到生成式 AI 的关键特征和技术基础

生成式 AI 基础

(6 分钟)

本视频介绍了 generative AI (生成式人工智能) 的概念,重点是其创造新内容的能力,而不仅仅是分析已存在的内容。我们详细介绍了像 Claude 这样的 large language models (LLMs, 大型语言模型) 的实际工作原理,以及使其成为可能的技术历程,从像 transformer architecture (Transformer架构) 这样的算法突破到海量的训练数据集和强大的计算能力。我们还解释了这些系统如何通过 pre-training (预训练) 和 fine-tuning (微调) 进行学习,并讨论了像 context windows (上下文窗口) 和 emergent capabilities (涌现能力) 这样的概念。

反馈

在您学习本课程的过程中,我们很乐意听取您关于如何在生活、工作或课堂中使用课程概念的意见以及您的任何反馈。在此处分享您的反馈。

致谢和许可

Copyright 2025 Rick Dakan, Joseph Feller, and Anthropic. Released under the CC BY-NC-SA 4.0 license. 本课程基于 Dakan 和 Feller 的 AI Fluency 框架。部分支持来自爱尔兰高等教育局,通过国家教学与学习促进论坛提供。

能力与局限

您将学到什么

在本课程结束时,您将能够:

- 识别当前生成式 AI 的主要能力和局限性

能力与局限

(7 分钟)

本视频探讨了目前生成式 AI 能做什么和不能有效做什么。我们强调了生成式 AI 在语言任务上的多功能性、保持对话流程的能力以及在没有额外训练的情况下切换不同任务的能力。我们还讨论了其局限性,包括知识截止日期、hallucinations (幻觉,即事实不正确的输出)、上下文窗口限制和推理挑战。我们强调该领域正在迅速发展,并解释说,最有效的应用是将人类和 AI 的互补优势结合在一起。

关键要点

- 生成式 AI 创造新内容 (文本、图像、代码),而不仅仅是分析现有数据

- 像 LLMs 这样的现代系统之所以成为可能,得益于三个关键发展:

- 算法和架构的突破 (特别是 Transformer 架构)

- 海量的数字训练数据

- 计算能力的急剧增加

- 生成式 AI 通过两个阶段学习:预训练 (分析数十亿个示例中的模式) 和微调 (学习遵循指令并提供有用的回应)

- 当前的能力包括跨任务的多功能性、对话感知能力以及与外部工具连接的能力

- 当前的局限性包括知识截止日期、可能产生幻觉、上下文窗口限制以及复杂推理方面的挑战

- 最有效的应用结合了人类和 AI 的优势,人类提供批判性思维、判断力、创造力和道德监督

练习

反思

在继续之前,请花点时间思考:

- 了解生成式 AI 的技术基础 (如训练数据和预训练/微调) 如何改变您对与这些系统合作的看法?

- 在了解了这些系统的工作原理及其当前局限性之后,您想到了哪些伦理问题?

下一步

在下一课中,我们将更深入地了解 4D 能力中的第一个:Delegation (委托)。您将学习如何根据对目标和 AI 能力的理解,做出关于在自己和 AI 之间分配工作的战略决策。这个基础将帮助您深思熟虑地决定何时以及如何将 AI 引入您的创意和解决问题的过程中。

反馈

在您学习本课程的过程中,我们很乐意听取您关于如何在生活、工作或课堂中使用课程概念的意见以及您的任何反馈。在此处分享您的反馈。

致谢和许可

Copyright 2025 Rick Dakan, Joseph Feller, and Anthropic. Released under the CC BY-NC-SA 4.0 license. 本课程基于 Dakan 和 Feller 的 AI Fluency 框架。部分支持来自爱尔兰高等教育局,通过国家教学与学习促进论坛提供。

深入了解 Delegation (委托)

您将学到什么

在本课程结束时,您将能够:

- 理解 Delegation (委托) 能力及其三个组成部分:Problem Awareness (问题感知)、Platform Awareness (平台感知) 和 Task Delegation (任务委托)

- 认识到何时以及如何有效地将任务委托给 AI

- 在与 AI 合作时,培养对任务、平台和模式的意识

深入了解 Delegation (委托)

(6 分钟)

本视频探讨了 AI Fluency 的第一个核心能力:Delegation (委托)。我们解释说,Delegation (委托) 专注于决定哪些工作自己做,哪些与 AI 合作,以及如何有效地分配任务。我们介绍了 Delegation (委托) 的三个关键组成部分:

- Problem Awareness (问题感知): 在开始之前,理解您的目标和实现它所涉及的工作

- Platform Awareness (平台感知): 了解不同 AI 系统的能力

- Task Delegation (任务委托): 战略性地在您和 AI 之间分配工作

我们还强调了为什么有效的 Delegation (委托) 需要您所在领域的专业知识和对 AI 能力的理解——以及为什么这对于与 AI 系统有效、高效地合作至关重要。

关键要点

- Delegation (委托) 是关于深思熟虑地决定哪些工作由自己完成,哪些与 AI 共同完成,或者让 AI 独立处理,以及如何分配这些任务。

- Problem Awareness (问题感知) 意味着在引入 AI 之前,清晰地理解您的目标和工作的性质。

- Platform Awareness (平台感知) 涉及了解不同 AI 系统的能力和局限性。

- Task Delegation (任务委托) 是在人与 AI 之间深思熟虑地分配工作以利用各自优势的过程。

- 有效的委托需要领域专业知识和对 AI 能力的理解。

- 目标不是自动化一切,而是为任何给定的任务或目标创建最有效的人机合作关系。

练习

与 AI 助手一起分析任务

说明:

- 从您的工作或个人生活中挑选一个简单的任务 (比如起草一封邮件、规划一个演示文稿、或者计划一次会议或活动)。

- 与 Claude 开始对话。

- 与 Claude 分享您正在考虑做的任务。

- 例如:“嗨,Claude,我正在准备如何 [插入任务],想和你讨论一下,制定一个委托计划,弄清楚哪些部分我应该委托给像你这样的 AI,哪些不应该。你能帮我吗?”

- 一起探讨以下问题:

- 任务的总体愿景是什么?一个好的结果是什么样的?

- 要达到这个目标,需要哪些不同的工作?

- 这些工作中哪些需要人类的专业知识、创造力或判断力?

- 注意: 在讨论这些问题时,进行一次真正的对话!不要只是陈述或列出答案。真正地来回交流——你们各自都可能看到对方没有看到的东西!

- 共同创建一个简单的委托计划,利用你们双方和 AI 的优势。

反思

在继续之前,请花点时间思考:

- 回想一个最近你与 AI 合作的项目。如果当时有这个 Delegation (委托) 框架,你的方法可能会有什么不同?

- 你认为在你的工作或学习中,哪类任务最能从 AI 协作中受益?

下一步

在下一课中,您将把学到的关于 Delegation (委托) 的知识应用到一个多步骤项目中,这个项目将在本课程的剩余部分贯穿始终。您将选择一个您感兴趣的项目,明确其愿景,将其分解为任务,并创建一个战略性地在您和 AI 之间分配工作的委托计划 (就像您在本课中练习的那样)。这个项目将成为您在课程进展中应用所有 AI Fluency 能力的实践画布。

反馈

在您学习本课程的过程中,我们很乐意听取您关于如何在生活、工作或课堂中使用课程概念的意见以及您的任何反馈。在此处分享您的反馈。

致谢和许可

Copyright 2025 Rick Dakan, Joseph Feller, and Anthropic. Released under the CC BY-NC-SA 4.0 license. 本课程基于 Dakan 和 Feller 的 AI Fluency 框架。部分支持来自爱尔兰高等教育局,通过国家教学与学习促进论坛提供。

项目规划与委托

您将学到什么

在本课程结束时,您将能够:

- 将您对 Delegation (委托) 的理解应用到一个贯穿本课程剩余部分的实际多步骤项目中

项目规划与委托

预计用时:20 分钟

第一步:选择您的项目

选择一个中等规模、多步骤的项目,您可以在本课程的剩余时间里持续进行。您的项目应具备以下特点:

- 足够充实,包含多种类型的任务

- 易于管理,能在大约 1 小时的工作时间内完成

- 是您真正感兴趣于创建或完成的事情

以下是一些建议,供您参考:

沟通项目:

- 就您熟悉的某个主题,制作一个引人入胜的演示文稿

- 写一篇或一系列文章,向普通大众解释一个复杂的主题

- 为您想追求的一个想法,制定一份提案或推介

- 创建一份个人或专业简介及配套材料

研究项目:

- 研究并总结某项新兴技术或趋势的现状

- 分析一个数据集,以识别模式并提出建议

- 比较多种产品、服务或方法,并提出建议

- 调查一个历史事件,并以引人入胜的方式呈现您的发现

创意项目:

- 构思一个短篇故事,包含丰满的角色和情节

- 设计一个简单的网站结构,并为关键页面准备内容

- 为一个产品、服务或体验,开发一个概念

学习项目:

- 为您想培养的一项技能,创建一个结构化的学习计划

- 围绕您正在学习的一个主题,建立一个资源集合

- 为您熟悉的一个流程,制作一份教程或指南

- 为您想掌握的一个主题,创建一套学习资料

第二步:项目愿景与目标

与 Claude 开始对话。分享您的项目想法,并邀请 Claude 向您提问,直到您感觉对最终结果有了清晰的愿景。共同努力,直到您对以下内容有了清晰的画面:

- 您的项目成功的样子

- 是什么让这个项目对您特别有价值或有意义

第三步:任务分解与委托分析

与您在上一课中所做的类似,通过 Delegation (委托) 的视角与 Claude 一起探索您的项目:

- 共同确定完成项目所需的主要任务。

- 对每个任务,逐一讨论:

- 需要哪些具体的技能、知识或 AI 能力?

- 哪些部分会从独特的人类优势中受益?

- 哪些部分可以很好地利用 AI 的能力?

- 在哪里协作可能会产生最大的影响?

- 注意: 同样,就这些问题进行真诚的对话,而不仅仅是交换陈述。挑战假设,请求澄清,并对讨论中出现的意外见解保持开放。

- 创建一个包含您主要任务和委托决策的项目计划。

- 保存您的项目计划——您将在本课程的后面部分回到这个项目,以练习您的 Description (描述)、Discernment (辨别) 和 Diligence (勤勉) 技能。

反思

在继续之前,请花点时间思考:

- 在您与 Claude 的规划对话中,出现了哪些见解?

- 您预计您的委托计划中最具挑战性的方面会是什么?

- 还有哪些额外的信息或技能可能帮助您更有效地委托给 AI?

下一步

在下一课中,我们将探讨第二个核心能力:Description (描述)。您将学习与 AI 系统有效沟通的方法,这将帮助您执行刚刚创建的计划。这包括定义您想要什么、指导 AI 如何处理任务以及指定您希望 AI 在整个过程中如何与您互动的技巧。

反馈

在您学习本课程的过程中,我们很乐意听取您关于如何在生活、工作或课堂中使用课程概念的意见以及您的任何反馈。在此处分享您的反馈。

致谢和许可

Copyright 2025 Rick Dakan, Joseph Feller, and Anthropic. Released under the CC BY-NC-SA 4.0 license. 本课程基于 Dakan 和 Feller 的 AI Fluency 框架。部分支持来自爱尔兰高等教育局,通过国家教学与学习促进论坛提供。

深入了解 Description (描述)

您将学到什么

在本课程结束时,您将能够:

- 理解如何有效地向 AI 系统传达您的意图

- 认识到清晰、有目的的沟通的重要性

- 培养三种 Description (描述) 类型的技能:Product (产品)、Process (过程) 和 Performance (性能)

深入了解 Description (描述)

(4 分钟)

本视频探讨了 AI Fluency 的 Description (描述) 能力——与 AI 系统有效沟通的艺术。我们解释说,Description (描述) 不仅仅是编写提示;它涉及到创建一个协作环境,让您和 AI 都能有效地协同工作。我们介绍了 Description (描述) 的三个关键组成部分:

- Product Description (产品描述): 清晰地定义您希望 AI 创建什么

- Process Description (过程描述): 指导 AI 如何处理您的请求

- Performance Description (性能描述): 定义您希望 AI 在协作过程中的行为方式。

我们还强调,AI 无法读懂您的心思,您的结果质量往往取决于您如何清晰地阐明您的需求、偏好的方法和期望的互动风格。

关键要点

- Description (描述) 是指以创造高效协作环境的方式与 AI 沟通

- Product Description (产品描述) 涉及清晰地定义您在输出、格式、受众和风格方面的要求

- Process Description (过程描述) 指导 AI 如何处理您的请求,这与指定最终目标同样重要

- Performance Description (性能描述) 定义了行为方面,比如 AI 应该是简洁还是详细,是挑战性的还是支持性的

- AI 系统是互动伙伴,而不是数据库或自动售货机

- 前期清晰的沟通可以节省时间并带来更好的结果

练习

糟糕提示大改造

预计用时:10 分钟

说明:

- 请 Claude 向您挑战一些写得不好的提示,让您来改进。

- 运用您的 Description (描述) 思维来改进每一个提示,考虑:

- 清晰的 Product Description (产品描述) (您具体想要什么)

- Process (过程) 指导 (您希望 Claude 如何处理它)

- Performance (性能) 规格 (您希望 Claude 在协作期间如何表现)

- 与 Claude 讨论“改造前”和“改造后”的版本,并就您改进后的描述如何帮助它提供更好的回应征求反馈。

- 大约 5 分钟后,交换角色,由您提供糟糕的提示让 Claude 来修正。注意 Claude 倾向于添加哪些信息,以及它如何组织这些信息。

反思

在继续之前,请花点时间思考:

- 您认为在当前的 AI 互动中,您可能忽略了 Description (描述) 的哪个组成部分 (product, process, or performance)?

- 回想一下最近一次不尽如人意的 AI 互动。更好的描述技巧可能会如何改善结果?

下一步

在下一课中,我们将更深入地探讨 4D 能力中的第一个:Delegation (委托)。您将学习如何根据对目标和 AI 能力的理解,做出关于在自己和 AI 之间分配工作的战略决策。这个基础将帮助您深思熟虑地决定何时以及如何将 AI 引入您的创意和解决问题的过程中。

反馈

在您学习本课程的过程中,我们很乐意听取您关于如何在生活、工作或课堂中使用课程概念的意见以及您的任何反馈。在此处分享您的反馈。

致谢和许可

Copyright 2025 Rick Dakan, Joseph Feller, and Anthropic. Released under the CC BY-NC-SA 4.0 license. 本课程基于 Dakan 和 Feller 的 AI Fluency 框架。部分支持来自爱尔兰高等教育局,通过国家教学与学习促进论坛提供。

高效的提示技巧

您将学到什么

在本课程结束时,您将能够:

- 理解什么是 prompt engineering (提示工程) 及其对高效 AI 协作的重要性

- 应用六种基础提示技巧来改善您的 AI 互动

- 识别导致成功 AI 互动的常见模式

- 在 AI 响应不符合您的需求时,进行故障排除和优化提示

高效的提示技巧

本视频探讨了与像 Claude 这样的 AI 助手合作时,制作有效提示的实用技巧。我们解释说,prompt engineering (提示工程) 只是为 AI 系统设计有效指令的实践,它将熟悉的人类沟通原则与 AI 特有的考虑因素相结合。我们介绍了六种基础技巧:提供背景、展示期望输出的示例、指定约束、将复杂任务分解为步骤、要求 AI 先思考,以及定义 AI 的角色或语气。我们还分享了当响应不完全正确时的故障排除策略,并强调了导致成功互动的常见模式。

关键要点

- 有效的提示结合了清晰的沟通原则和 AI 特有的技巧

- 六种基础提示技巧:

- 提供背景: 具体说明你想要什么,为什么想要,以及相关的背景信息

- 展示示例: 演示你想要的输出风格或格式

- 指定约束: 清晰定义格式、长度和其他输出要求

- 将复杂任务分解为步骤: 引导 AI 完成多步推理

- 要求 AI 先思考: 给 AI 留出空间来处理其过程

- 定义 AI 的角色或语气: 指定你希望 AI 如何沟通

- “秘密武器”:请 AI 本身帮助改进你的提示

- 成功的提示是迭代的(也可能需要与 AI 协作!)。期望根据结果不断优化你的方法

- 常见的成功模式包括提供清晰的任务概述、格式规范、明确的约束和相关的背景信息

练习

反思

在继续之前,请花点时间思考:

- 您认为六种提示技巧中的哪一种最能增强您当前的 AI 互动?

- 想一想最近一次不符合您需求的 AI 互动。哪些技巧可能会改善结果?

- 理解这些提示技巧与 AI Fluency 框架中的 Description (描述) 能力有何联系?

如果您愿意,可以重温上一课的“糟糕提示大改造”练习,来实践这些提示原则。

下一步

在下一课中,我们将探讨第三个核心 AI Fluency 能力:Discernment (辨别)。这次的深度解析和前一课都侧重于如何有效地与 AI 沟通以及如何实践良好的 Description (描述)。Discernment (辨别) 则解决了同样重要的挑战:深思熟虑地评估 AI 的响应产出——这是对话的另一半!

反馈

在您学习本课程的过程中,我们很乐意听取您关于如何在生活、工作或课堂中使用课程概念的意见以及您的任何反馈。在此处分享您的反馈。

致谢和许可

Copyright 2025 Rick Dakan, Joseph Feller, and Anthropic. Released under the CC BY-NC-SA 4.0 license. 本课程基于 Dakan 和 Feller 的 AI Fluency 框架。部分支持来自爱尔兰高等教育局,通过国家教学与学习促进论坛提供。

深入了解 Discernment (辨别)

您将学到什么

在本课程结束时,您将能够:

- 理解如何深思熟虑地评估 AI 的输出和过程

- 为您的 AI 互动培养批判性思维技能

- 学会在您的 AI 互动中识别和解决质量问题

深入了解 Discernment (辨别)

(5 分钟)

本视频探讨了 Discernment (辨别),这是 AI Fluency 中专注于深思熟虑地评估 AI 输出、过程和行为的能力。我们解释说,Discernment (辨别) 是 Description (描述) 的另一面。Description (描述) 帮助您清晰地传达您的意图,而 Discernment (辨别) 则帮助您评估收到的内容是否满足您的需求。视频介绍了三种类型的 Discernment (辨别):

- Product Discernment (产品辨别): 评估 AI 输出的质量

- Process Discernment (过程辨别): 评估 AI 完成任务的方法

- Performance Discernment (性能辨别): 评估 AI 在互动过程中的行为

这些技能共同帮助确保您的 AI 协作始终以深思熟虑的人类判断为指导。

关键要点

- Discernment (辨别) 是你审慎评估 AI 产出什么、如何产出以及其行为方式的能力

- Product Discernment (产品辨别) 侧重于评估实际输出的质量(准确性、适当性、连贯性、相关性)

- Process Discernment (过程辨别) 涉及评估 AI 是如何得出其输出的,寻找逻辑错误、注意力差距或不当的推理

- Performance Discernment (性能辨别) 评估 AI 在协作过程中的行为,考虑其沟通风格对你的需求是否有效

- Discernment (辨别) 与 Description (描述) 在一个持续的反馈循环中携手并进

- 即使是最先进的 AI 系统也受益于人类的判断和监督

练习

专家辨别:在您的领域评估 AI 响应

活动目标

通过在您拥有专业知识的领域评估 AI 生成的内容,练习 Product (产品)、Process (过程) 和 Performance (性能) 的辨别能力,认识到您的知识如何增强您批判性评估 AI 输出的能力。

说明

第一步:回到您的专业领域

回想您在早期练习中与 Claude 讨论过的话题(第二课,练习二:“探索您热爱的事物”)。那是一个您有深厚知识和热情的话题。

第二步:请求多种解释

与 Claude 开始新的对话,并要求它就您专业领域的某个特定方面生成三种不同的解释或分析。例如:

- 如果您的话题是摄影,您可以要求对景深进行三种不同的解释

- 如果您的话题是烹饪,您可以要求对发酵技术进行三种不同的分析

- 如果您的话题是历史,您可以要求对某个特定历史事件提供三种不同的视角

第三步:运用您的专家辨别能力

凭借您的专业知识,仔细评估 Claude 提供的每一种解释:

Product Discernment (产品辨别):

- 哪种解释包含最准确的信息?

- 是否有任何事实错误或误解?

- 对于学习该主题的人来说,细节的层次是否恰当?

Process Discernment (过程辨别):

- Claude 在每种解释中是否遵循逻辑推理?

- 它的分析或思维过程中是否存在漏洞?

- Claude 是否在概念之间建立了恰当的联系?

Performance Discernment (性能辨别):

- Claude 是否关注了您的具体问题并对反馈和指导做出了响应?

- 术语的使用是否适合该主题?

- 语气和风格如何影响解释的清晰度?

第四步:提供反馈和优化

根据您的评估:

- 确定最强的解释,并具体告诉 Claude 它有效的原因

- 确定最弱的解释,并就其问题所在提供具体反馈

- 与 Claude 合作,创建一个解决您所发现问题的改进版本

第五步:反思

与 Claude (在同一次聊天中) 讨论:

- 您拥有的哪些具体知识使您能够识别优点或缺点?

- 没有您专业知识的人在辨别这些解释的质量时可能会遇到什么困难?

- 这次经历告诉您,领域知识和有效的 Discernment (辨别) 之间有什么关系?

想要进行更有趣的 Discernment (辨别) 练习,您不妨尝试最后一课(“附加活动”)中的一些“游戏之夜”建议。

反思

在继续之前,请花点时间思考:

- 您觉得哪种 Discernment (辨别) (产品、过程或性能) 最难应用,为什么?

- Discernment (辨别) 如何补充 Description (描述)?它们是如何协同工作的?

- 哪些信号或模式可能表明 AI 的输出需要更仔细的审查?

下一步

在下一课中,您将有机会将 Description (描述) 和 Discernment (辨别) 的技能应用到您的整个课程项目中。您将实践所学的关于如何有效地与 AI 沟通以及如何批判性地评估其输出,以产生能够充分利用人类和 AI 能力的成果。

反馈

在您学习本课程的过程中,我们很乐意听取您关于如何在生活、工作或课堂中使用课程概念的意见以及您的任何反馈。在此处分享您的反馈。

致谢和许可

Copyright 2025 Rick Dakan, Joseph Feller, and Anthropic. Released under the CC BY-NC-SA 4.0 license.

本课程基于 Dakan 和 Feller 的 AI Fluency 框架。部分支持来自爱尔兰高等教育局,通过国家教学与学习促进论坛提供。

Description-Discernment (描述-辨别) 循环

预计用时:30 - 60 分钟

在本课程结束时,您将能够:

- 将 Description (描述) 和 Discernment (辨别) 技能应用于实际项目

- 进行富有成效的 Description-Discernment (描述-辨别) 反馈循环

- 通过人机协作创造出超越任何一方单独所能达到的成果

练习

练习:使用 Description-Discernment (描述-辨别) 循环执行项目

现在是时候将您学到的一切付诸实践,利用您一直在培养的 Description (描述) 和 Discernment (辨别) 技能,来完成您在第五课中计划的项目。

第一步:回顾您的项目计划

- 找出您在第五课中创建的项目计划

- 快速回顾您关于哪些任务将受益于人类专业知识、AI 能力或协作的委托决策

- 随时根据您此后学到的知识来完善您的计划

第二步:准备您的描述方法

与 Claude 开始对话,并解释您们将要共同完成的项目。在开始执行之前,规划您将如何运用 Description (描述):

- Product Description (产品描述): 您需要 Claude 为每个任务提供哪些具体输出?您期望的格式、风格、长度和细节水平是什么?

- Process Description (过程描述): Claude 应该如何处理每个任务?您希望它遵循哪些特定的方法、框架或步骤?

- Performance Description (性能描述): 在这个项目中,您希望 Claude 表现出什么样的协作行为?它应该是简洁还是详细,是挑战性的还是支持性的,是专注于想法还是分析?

与 Claude 讨论这些问题,为你们的协作建立清晰的期望。

第三步:使用 Description-Discernment (描述-辨-别) 循环执行您的项目

现在,与 Claude 一起完成您计划的项目任务。对于每个任务:

- 清晰地描述您的需求,使用您学到的 Description (描述) 技能:

- 具体说明您想要什么 (Product (产品))

- 指导 Claude 应该如何处理或思考任务 (Process (过程))

- 指定您希望 Claude 在过程中如何与您互动 (Performance (性能))

- 辨别您收到的内容质量:

- 评估输出本身 (Product Discernment (产品辨别))

- 评估 Claude 是如何完成任务的 (Process Discernment (过程辨别))

- 考虑 Claude 的行为是否最有助于您所需 (Performance Discernment (性能辨别))

- 根据您的辨别进行优化:

- 对有效和无效之处提供反馈

- 根据需要澄清或调整您的描述

- 请求迭代,直到您对结果满意为止

- 融入您自己的专业知识和判断:

- 添加您独特的视角、创造力或领域知识

- 做出关于保留、修改或丢弃哪些内容的最终决定

- 对最终输出负责

对项目中的每个任务持续进行这个 Description-Discernment (描述-辨别) 循环,直到完成。

反思

在继续之前,请花点时间思考:

- 您注意到了哪些类型的描述能带来最佳结果的模式?

- 对您来说,哪个需要更多努力:Description (描述) 还是 Discernment (辨别)?您认为原因是什么?

- 您实际的项目执行与您在第五课的初步计划相比如何?您在此过程中做了哪些调整?

下一步

在下一课中,我们将探讨 AI Fluency 框架中的最后一个能力:Diligence (勤勉)。虽然 Delegation (委托)、Description (描述) 和 Discernment (辨别) 主要关注有效性和效率,但 Diligence (勤勉) 则涉及与 AI 合作的伦理和安全方面。您将学习如何确保您的 AI 协作是负责任、透明和可问责的。

对本课程的反馈

在您学习本课程的过程中,我们很乐意听取您关于如何在生活、工作或课堂中使用课程概念的意见以及您的任何反馈。

在此处分享您的反馈。

致谢和许可

Copyright 2025 Rick Dakan, Joseph Feller, and Anthropic. Released under the CC BY-NC-SA 4.0 license. 本课程基于 Dakan 和 Feller 的 AI Fluency 框架。部分支持来自爱尔兰高等教育局,通过国家教学与学习促进论坛提供。

深入了解 Diligence (勤勉)

预计用时:20 分钟

在本课程结束时,您将能够:

- 理解 AI 协作的伦理含义

- 理解 AI 工作中透明度的重要性

- 认识到您在 AI 互动和输出中的责任

视频:深入了解 Diligence (勤勉)

(7 分钟)

本视频探讨了 Diligence (勤勉),这是 AI Fluency 中专注于负责任和合乎道德的 AI 协作的能力。我们解释说,虽然其他能力主要关注有效性和效率,但 Diligence (勤勉) 则处理同样至关重要的伦理和安全方面。我们介绍了三个组成部分:

- Creation Diligence (创建勤勉): 审慎地选择您使用的 AI 系统以及您如何与它们合作

- Transparency Diligence (透明度勤勉): 在您的工作中坦诚 AI 的角色

- Deployment Diligence (部署勤勉): 为您与他人分享的 AI 辅助输出承担责任

我们强调,不同的情境可能有不同的期望,但我们每个人都有责任去理解和满足这些期望。

关键要点

- Diligence (勤勉) 意味着为我们的 AI 协作承担责任

- Creation Diligence (创建勤勉) 涉及深思熟虑地选择我们使用的 AI 系统以及我们如何与它们互动

- Transparency Diligence (透明度勤勉) 意味着对所有需要了解的人诚实地说明 AI 在我们工作中的作用

- Deployment Diligence (部署勤勉) 要求我们为验证和担保我们使用或分享的输出承担责任

- 不同的情境(个人、学术、专业)可能对披露和验证有不同的期望

- 深思熟虑的 Diligence (勤勉) 有助于确保我们的 AI 协作不仅有效和高效,而且合乎道德和安全

练习

练习:创建一份勤勉声明

预计用时:14 分钟

在这个练习中,您将为您一直从事的项目起草一份勤勉声明。这是本课程本身的勤勉声明。

第一步:理解勤勉声明

预计用_时:3 分钟_

勤勉声明是对您工作中 AI 角色的透明承认,以及您对最终输出负责的承诺。以下是一个示例:

“在创建这份 [文件/项目/内容] 的过程中,我与 [AI 助手名称] 合作,协助完成了 [具体任务:起草、研究、编辑等]。我确认,所有 AI 生成和共同创建的内容都经过了彻底的审查和评估。最终的输出准确地反映了我的理解、专业知识和意图。虽然 AI 的协助在过程中起到了重要作用,但我对内容、其准确性和呈现方式负全部责任。此披露本着透明的精神,并承认 AI 在创作过程中的作用。”

第二步:反思您的 AI 协作

预计用时:5 分钟

回顾您在课程项目上的工作,并考虑:

Creation Diligence (创建勤勉):

- 您选择与哪些 AI 系统合作,为什么?

- 您与 AI 分享了哪些数据或信息?

- 在您的选择中,是否有任何隐私、安全或伦理方面的考虑?

Transparency Diligence (透明度勤勉):

- 您的项目输出的受众是谁?

- 他们对 AI 披露可能有何期望?

- AI 具体在您工作的哪些方面做出了贡献?

Deployment Diligence (部署勤勉):

- 您采取了哪些步骤来验证 AI 贡献的准确性和适当性?

- 您如何确保最终输出符合您的标准和要求?

- 您对最终产品承担什么责任?

第三步:起草您的勤勉声明

预计用时:6 分钟

与 Claude 开启一段对话,然后:

- 分享您在第二步中的反思,也可以选择性分享您过去与 Claude 就此项目进行的对话

- 与 Claude 协作,为您的项目起草一份具体的勤勉声明

- 确保您的声明涵盖:

- 您使用了哪些 AI 系统

- AI 如何为您的项目做出贡献

- 您采用的审查流程

- 您对最终输出承担责任的声明

- 任何特定情境的考虑因素(学术、专业等)

第四步:将您的声明添加到您的项目中

当您完成项目时,将您的勤勉声明添加到适当的位置(例如,页脚、附录或元数据中)。

反思

在继续之前,请花点时间思考:

- 您觉得 Diligence (勤勉) 的哪个方面(创建、透明度或部署)最具挑战性,为什么?

- 您处理 Diligence (勤勉) 的方法会如何根据情境(个人、学术、专业)而变化?

- 承认 AI 在您工作中的角色会如何影响他人对它的看法?

- 在您的项目中出现了哪些您未曾预料到的伦理问题?

- 您可能会为负责任的 AI 协作制定哪些个人准则?

下一步

在本课程的最后一课中,我们将反思我们学到的关于 AI Fluency 的知识,以及这些能力如何协同工作。我们将重新审视整个框架,并讨论随着 AI 能力的发展,您如何继续发展这些技能。结论将帮助您综合所获得的知识和实践,并将其应用于未来的 AI 协作。

对本课程的反馈

在您学习本课程的过程中,我们很乐意听取您关于如何在生活、工作或课堂中使用课程概念的意见以及您的任何反馈。在此处分享您的反馈。

致谢和许可

Copyright 2025 Rick Dakan, Joseph Feller, and Anthropic. Released under the CC BY-NC-SA 4.0 license.

本课程基于 Dakan 和 Feller 的 AI Fluency 框架。部分支持来自爱尔兰高等教育局,通过国家教学与学习促进论坛提供。

结论

预计用时:15 分钟

在本课程结束时,您将能够:

- 巩固课程的关键学习内容

- 将 AI Fluency 与您的持续发展联系起来

视频:结论

(6 分钟)

这个总结视频回顾了 AI Fluency 框架,并将整个课程中探讨的关键概念整合在一起。我们重述了四个核心能力(4D):Delegation (委托)(决定哪些工作与 AI 合作,哪些独立完成)、Description (描述)(与 AI 有效沟通)、Discernment (辨别)(评估 AI 的输出和行为)以及 Diligence (勤勉)(确保负责任的 AI 协作)。我们强调,这些能力适用于与 AI 互动的所有三种主要方式(Automation (自动化)、Augmentation (增强) 和 Agency (代理)),并且流畅度是通过实践发展的,而非一蹴而就。我们最后提醒大家,AI 系统功能强大但并非神奇的解决方案;它们的用处和安全性取决于我们如何通过深思熟虑的参与来启用它们。

关键要点

- AI Fluency 是通过有意识地练习四个核心能力来发展的

- Delegation (委托) 强调我们的专业知识和判断力仍然是有效 AI 协作的基础

- Description (描述) 涉及清晰的沟通,以连接我们的意图和 AI 的能力

- Discernment (辨别) 需要对输出进行深思熟虑和批判性的评估,以便在系统约束内工作

- Diligence (勤勉) 确保我们 AI 工作中的问责制、透明度和责任感

- 当人类和 AI 互相取长补短时,最强大的成果才会出现

- 该框架旨在随着 AI 系统的不断发展而保持其相关性

练习

练习:与 Claude 讨论 AI Fluency 课程

与 Claude 就本课程和 AI Fluency 框架进行一次有意义的对话(可从 https://ringling.libguides.com/ai/framework 上传一份框架副本)

建议的对话开场白:

- “我刚刚完成了一门关于 AI Fluency 的课程,涵盖了 Delegation (委托)、Description (描述)、Discernment (辨别) 和 Diligence (勤勉)。我们来讨论一下这些能力如何应用于 [我的学位课程或我的工作或其他]。”

- “我们来探讨一下随着 AI 能力的进步,AI Fluency 框架可能会如何演变。未来哪些新的能力可能会变得重要?”(如果您这样做,请联系我们,告诉我们您的发现!)

- “根据我们的对话,帮我确定一下我似乎已经很好理解了 4D 能力中的哪些,以及我可能需要进一步发展的哪些。”

- “这是 [你在这门课上做的某个练习]。我们来分析一下,以提高我的能力。”

练习:制定个人 AI 政策

在 Claude 的帮助下,为您在个人和专业情境中负责任且合乎道德的 AI 协作创建您自己的指导方针:

- 为您在不同情境下何时以及如何与 AI 合作制定明确的标准

- 为敏感或机密信息设定界限

- 明确您将如何对 AI 辅助的工作进行质量控制

- 确定与您的领域或活动最相关的伦理问题

- 制定解决伦理困境的决策标准

- 考虑可能受到您 AI 互动影响的不同人的观点

- 确定您将如何在不同情境下披露 AI 协作

- 创建署名和透明度声明的模板

- 建立何时需要更详细披露的标准

在这个过程中,将 Claude 作为思考伙伴,从多个角度探讨伦理问题。

反思

以上练习是本课的反思部分。通过这些练习,您将有机会巩固您的学习成果,并将其与您的持续发展联系起来。

下一步

恭喜您完成 AI Fluency: 框架与基础课程!这只是您 AI Fluency 旅程的开始。随着 AI 技术的不断发展,您在 Delegation (委托)、Description (描述)、Discernment (辨别) 和 Diligence (勤勉) 方面培养的能力,将为您与这些系统的工作提供一个持久的指导框架。

请记住,流畅度是通过实践发展的。与 AI 的每一次互动都是完善您的技能和加深理解的机会。通过将 AI 视为一个思考伙伴而不仅仅是一个工具,并坚持对有效性、效率、道德和安全的承诺,您已为驾驭人机协作的未来做好了充分准备。

我们鼓励您继续探索、实验和反思您的 AI 互动。第 12 课中有许多很好的附加练习,可以继续您的旅程。

我们鼓励您与他人(以及我们!)分享您所学到的知识,寻求不同的观点,并为我们如何以能够增强人类潜力,同时尊重我们的价值观和对彼此的责任的方式与 AI 合作这一持续的对话做出贡献。感谢您在本课程中的参与和投入!

对本课程的反馈

在您学习本课程的过程中,我们很乐意听取您关于如何在生活、工作或课堂中使用课程概念的意见以及您的任何反馈。在此处分享您的反馈。

致谢和许可

Copyright 2025 Rick Dakan, Joseph Feller, and Anthropic. Released under the CC BY-NC-SA 4.0 license.

本课程基于 Dakan 和 Feller 的 AI Fluency 框架。部分支持来自爱尔兰高等教育局,通过国家教学与学习促进论坛提供。

结业证书

[无内容]

附加活动

预计用时:自定进度

以下活动专为在完成 AI Fluency: 框架与基础课程后进行自主学习而设计。

选择那些与您的兴趣和需求产生共鸣的活动——或者将它们作为灵感,创造您自己的活动!

制定个人 AI Fluency 计划

在 AI 助手的帮助下,创建一个结构化的计划,随着时间的推移发展您的 AI Fluency:

当前能力评估

- 对于 4D 中的每一个能力,评估您目前的熟练程度(新手、发展中、自信)

- 记录每个能力中的具体优势和需要成长的领域

- 确定您目前最常使用和最不有效地使用哪种 AI 互动方式(Automation (自动化)、Augmentation (增强)、Agency (代理))

发展重点识别

- 选择 1-2 个能力作为首要发展重点

- 确定这些能力中在您的情境下最有价值的具体方面

- 考虑您希望在哪种 AI 互动方式上变得更加熟练

具体行动规划

- 创建具体的活动来发展每个重点能力

- 设定练习的时间表和频率

- 确定支持您发展的资源和工具

- 定义您将如何识别进展和成功

在这个过程中,将 Claude 作为思考伙伴,分享您的自我评估,并就您的计划获得反馈。

建立个人提示与模式库

在 Claude 的帮助下,为您经常进行的 AI 互动创建一个个性化的有效提示和模式集合:

常见任务模板创建

- 确定您经常使用 AI 执行的 5-10 个任务

- 为每个任务开发一个能持续产生良好结果的模板提示

- 包括您每次需要添加的可变信息的占位符或注释

有效策略文档化

- 记录对不同类型任务有效的具体 Description (描述) 技巧

- 记录能帮助您更有效地评估输出的 Discernment (辨别) 模式

- 注意哪些方法对不同的互动模式最有效

个人参考资源构建

- 以易于搜索和访问的方式组织您的模板和策略

- 包括成功输出的示例以供参考

- 创建一个系统,以便在发现新的有效方法时更新您的库

您可以与 Claude 合作,分析您过去成功的互动,并识别使它们有效的模式。

游戏之夜!

这些为您和 Claude 设计的有趣练习,通过文字谜题帮助您练习精确的 Description (描述) 并磨练您的 Discernment (辨别) 技能。由于谜题有具体的说明(不像“起草一封感谢信”这样的开放式任务),它们是练习清晰沟通的绝佳方式。而且因为它们故意设置得有些棘手,所以它们是很好的 Discernment (辨别) 锻炼!仅仅通过玩几个游戏,您就可以学到很多关于仔细评估和引导 AI 思维过程的知识。尝试以下任何或所有游戏。

交换谜语

创建一个谜语(或者试试这个:“一百零几个鼓点,我敲击着,描绘出一曲光的交响乐。我在做什么?”)。

(答案:我正在电脑键盘上打字(通常是 104 个键),以在显示器上创建像素。)

让 Claude 猜测,并且,重要的是,解释它的推理。

不仅要注意 Claude 猜了什么,还要注意它为什么这么猜。

然后不要给它答案,而是温和地引导 Claude 走向正确的思维链和情境,以得出答案。

然后交换角色,让它给您出一个谜语。让 Claude 像您刚才那样引导您。

合作填字游戏

一起解决填字游戏的线索(神秘填字游戏的线索可能特别有趣)。

重点不在于您或 Claude 在填字游戏方面的表现如何。而在于学习如何引导和完善思维:“记住,它只有 5 个字母”“不,不可能是那个,因为它以 B 开头”“也许他们说的‘swallow’不是喝的意思,而是燕子这种鸟。”

这些引导技巧在“真实”项目中将被证明出奇地有用。

词语联想

与 Claude(或您选择的模型)玩词语联想游戏非常令人满意且富有启发性。网上有很多免费的游戏,搜一下就行了!

即使只是挑选 12 - 20 个随机词语,与 Claude 合作寻找它们之间的关系,也是很好的 Discernment (辨别) 练习。当您注意到 Claude 建立了可疑的联系或忽略了有希望的模式时,指出来并引导它进行更好的推理。同样,也要对 Claude 发现您可能错过的联系持开放态度!

在协作过程中,练习所有三种类型的 Discernment (辨别):

- Product Discernment (产品辨别): 答案是否合乎逻辑,并且真正符合一个连贯的主题?

- Process Discernment (过程辨别): Claude 是如何解决这个谜题的?它是否考虑了多种可能性?它是否过于狭隘地关注某一种解释?

- Performance Discernment (性能辨别): Claude 是如何传达其思考过程的?是否清晰?它是否提出了好的问题?它是否有效地在您的建议基础上进行构建?

更多游戏建议

通过以下活动继续发展您的 Description (描述) 和 Discernment (辨别) 技能:

- 二十个问题: 让 Claude 想一个物体、人物或概念,然后您通过问是/否问题来猜测。然后交换角色。注意你们各自是如何构建问题和提供线索的。

- 协作讲故事: 用一句话开始一个故事,让 Claude 接下一句,然后来回交替。观察你们双方如何保持叙事连贯性并互相借鉴对方的想法。

- 一位巫师在酒馆里走向你: 如果您喜欢玩角色扮演游戏,可以尝试与语言模型一起玩一两个游戏,扮演玩家或游戏主持人。

- 概念与约束: 选择一个复杂的概念和非常严格的约束,比如“只用烹饪的比喻来解释”。然后让 Claude 给您一个挑战,自己尝试一下,并比较方法。

- 高级解谜: 创建您自己的逻辑或文字谜题,然后挑战 Claude 来解决。或者,让 Claude 为您创建谜题来解决。(如果您是程序员,可以把谜题换成棘手的问题,比如和 Claude 一起挑战 https://projecteuler.net/)。

对本课程的反馈

我们很乐意听取您关于如何在生活、工作或课堂中使用本课程概念的意见,以及您的任何反馈。在此处分享您的反馈。

致谢和许可

Copyright 2025 Rick Dakan, Joseph Feller, and Anthropic. Released under the CC BY-NC-SA 4.0 license.

本课程基于 Dakan 和 Feller 的 AI Fluency 框架。部分支持来自爱尔兰高等教育局,通过国家教学与学习促进论坛提供。

第 3 课:教育者 AI 素养

面向教育工作者的 AI 协作技能培训 课程链接:教育者 AI 素养 | 共 5 节课

第2课:将 AI 素养应用于课程设计和学习成果

第2课:将 AI 素养应用于课程设计和学习成果

核心概念 AI 素养通过构建丰富、共享的情境来变革课程设计,将 AI 从一个通用的助手转变为一个能理解特定教学情境、约束和教学愿景的协作者。

三项基础课程设计任务

- 确定对学生至关重要的内容和概念

- 规划学习路径——即各项主题之间如何相互衔接

- 阐明具体的学习目标

4D 框架在课程设计中的应用

课程设计中的 Delegation (委派)

- 根据学科专业知识和目标做出明智的委派决策

- 确定需要完成的工作(内容选择、排序、目标设定)

- 决定由谁来做(人、AI 或两者兼有)以及如何做

- 在确定“谁做”和“如何做”之前,先回答“做什么”和“为什么做”

课程设计中的 Description (描述)

- 创建一个植根于实际教学挑战的思考空间

- 示例:“我正在为新闻专业的学生构建一门统计学课程,他们需要数据素养,但通常对数学感到焦虑,或对统计学在职业生涯中的重要性持怀疑态度”

- 分享具体的挑战、学生需求、先修课程要求和预期成果

- 解释对成功的愿景和所受的约束

- 同时使用产品描述(你希望 AI 做什么)和过程描述(如何做)

课程设计中的 Product Discernment (成果辨别)

- 依据自身的专业知识评估 AI 的建议

- 提问:这个概念真的对目标学生有帮助吗?

- 不仅仅是接受/拒绝——要解释为什么某个建议在特定情境下有效或无效

- 利用专业知识来塑造更好的未来建议

- 识别意想不到的见解和新的思维方式

课程设计中的 Diligence (尽责)

- 不要外包决策——对最终呈现给学生的内容负责

- 记录与 AI 协作过程中的关键决策

- 与学生分享你的思考过程,以示范负责任的 AI 使用方式

- 质量保证和透明度

- 在展示 AI 如何增强教学专业知识的同时,保持问责制

AI 角色扮演技巧 要求 AI “扮演我的一名学生”来评估课程流程:

- 在不同阶段,学生会有何反应?

- 哪里可能会产生困惑?

- 每个阶段需要什么样的背景知识?

- 在主题转换时需要提供哪些支持?

学习目标的增强

- 利用先前协作中建立的既有情境

- 上传包含更丰富情境描述的课程大纲

- 制定准确、有意义、能激励人心、忠于教学理念并符合机构要求的学习目标

- 将课程成果与简历技能对应起来,以激励学生

- 由于流程加快,可以尝试不同的方法

超越节省时间的益处

- 发现隐藏的假设和盲点

- 探索概念之间富有创造性的联系

- 在探索新想法的同时保持连贯性

- 培养个人能力,并通过实践得到加强

关键原则

- 4Ds 是一个真正的认知伙伴关系框架,而非一张核对清单

- 教学和学科专业知识指导着协作探索

- 构建情境的方法适用于:新课程开发、课程更新、课程系列设计、学习路径规划

- 从宏观入手,通过细节构建并维护情ö境

- 目标是增强而不仅仅是效率——实现更好的教与学,而不仅仅是更快的规划

练习结构(50分钟) 阶段1:规划方法(明确课程、所需工作、自身专业知识与 AI 辅助的界限) 阶段2:启动协作(分享教学情境、解释挑战、设定伙伴关系) 阶段3:通过 Description (描述) 和 Discernment (辨别) 构建对话(内容识别、学习路径规划、学习目标设定) 阶段4:文档记录与反思(验证准确性、记录决策、标注被拒绝的建议、创建 AI 角色声明)

成果 创建一种真正的认知伙伴关系,其中人类的判断、价值观和师生关系仍然是核心,而 AI 则增强了教学实践。

第1课:教育者 AI 素养导论

教育者 AI 素养 = 一个旨在将 AI 有效、高效、合乎道德且安全地融入教学实践的框架

课程目的 = 将 4D 框架(Delegation (委派)、Description (描述)、Discernment (辨别)、Diligence (尽责))专门应用于教育情境

为何 AI 素养在教育领域至关重要:

- 学生已经在用 AI

- 雇主期望毕业生具备 AI 素养

- 院校需要负责任的 AI 整合策略

- 教育者塑造着下一代与 AI 的互动方式

课程成果:

- 将 4D 框架应用于教学实践

- 使用 AI 进行课程设计和教案规划

- 在保持教学愿景和学术诚信的前提下创建教学材料

- 引领机构内的 AI 对话

- 为学生示范负责任的 AI 互动方式

先修课程要求 = 完成《AI 素养:框架与基础》课程

4D 框架总结:

AI 素养 = 负责任的 Human in the loop (人在环路中),是 Augmentation (增强) 而非自动化

Delegation (委派) = 决定由谁来做什么工作(人 vs AI vs 协作) 三种类型:

- 问题认知 = 在与 AI 互动前,明确目标和成功标准

- 平台认知 = 理解不同 AI 的能力和局限性

- 任务委派 = 分配工作以利用人类的创造力/判断力 + AI 的速度/处理能力

Description (描述) = 如何与 AI 沟通(是对话而非命令) 三个维度:

- 产品描述 = 对最终输出的详细说明(长度、受众、风格、格式)

- 过程描述 = 指导 AI 的方法(分步思考、多视角分析)

- 表现描述 = 定义 AI 在互动中的行为(扮演批判性编辑、支持性头脑风暴伙伴)

Discernment (辨别) = 评估 AI 的输出并相应调整 三个层次:

- 成果辨别 = 对 AI 创作成果的质量评估(准确性、实用性、新视角)

- 过程辨别 = 审视 AI 的推理过程和假设

- 表现辨别 = 评估 AI 在互动中的行为

Description (描述) + Discernment (辨别) = 一个持续的反馈循环,将 AI 从工具转变为思维伙伴

Diligence (尽责) = 在整个协作过程中负责任地使用 AI 三个方面:

- 创造尽责 = 审慎选择 AI 系统,考虑隐私、安全和适宜性

- 透明尽责 = 诚实披露 AI 的辅助作用

- 部署尽责 = 对经 AI 辅助的输出成果承担所有权和责任

关键原则:

- Augmentation (增强) > Automation (自动化) (尤其在学习情境中)

- 教学价值观始终是核心

- 4Ds 作为相互关联的能力协同工作

- 随着 AI 技术的发展,这些技能依然适用

教学情境文档 = 一种可复用的工件,用于与 AI 建立共享的理解,以备未来协作之用

核心情境领域:

- 学科领域、级别、具体课程

- 学生背景、挑战、目标

- 机构限制

- 教学理念和方法

- 常见的教学痛点

- AI 集成目标

- 独特的教学情境方面

情境文档的好处:

- 提高与 AI 协作的效率

- 在未来的互动中节省时间

- 在不同的 AI 对话中保持一致性

- 帮助 AI 理解教育者的特定需求和限制

第3课:将 AI 素养应用于学习材料和作业

第3课:将 AI 素养应用于学习材料和作业

核心学习目标

- 使用 4D 框架借助 AI 构建教学材料

- 利用已建立的情境进行连贯的材料开发

- 通过 Discernment (辨别) 应用系统的质量控制

- 创建整合式的学习体验

AI 的学科影响框架

关于学科的三个关键问题:

- 什么会被自动化 = 在未来职业生涯中,AI 可能会自动化的常规任务

- 合作潜力 = 在哪些领域,人与 AI 的协作最具影响力

- 谁来负责 = 人类如何管理 AI 工作并对其负责

三种现有的专业知识:

- Disciplinary Expertise (学科专业知识) = 领域内容、价值观、方法、思维模式

- Pedagogical Expertise (教学专业知识) = 学生的困惑点、顿悟时刻、掌握技能的培养过程

- Assessment Expertise (评估专业知识) = 识别真正的理解,设计评估方法

AI 在三个领域的颠覆性影响

对课程的影响:

- 基础知识依然重要,但学生会质疑其必要性

- 需要针对“既然 AI 能做,为什么还要学”给出令人信服的、特定于学科的答案

- 任务:识别 AI 可自动化的内容,判断哪些概念变得更重要/次要,评估 AI 如何改变最佳实践

对教学的影响:

- AI 可以实现个性化辅导、交互式模拟、即时反馈

- 挑战:区分是增强学习还是走了捷径

- 任务:定义 AI 如何增强/抑制学习,识别最佳的师生-AI 协作模式,确定有效的教学方法

对评估的影响:

- 最紧迫的颠覆 = 当学生能在几秒钟内生成内容时,我们评估的是什么

- 需要对 AI 辅助和纯人工完成的作品进行真实性评估

- 任务:识别 AI 辅助学习的真实表现,创建能防止“走捷径”的作业,重视过程而非结果,适应学生不可避免的 AI 使用

4Ds 在学科专业知识中的应用

Discernment (辨别) = Quality Evaluation (质量评估)

- 建立质量标准 = 详细的评分标准,超越模糊的术语,明确卓越的标志

- 收集杰出作品 = 与学生一起进行系统性分析,让专家的思维过程可见

- 诊断失败案例 = 对有缺陷的例子进行法医式检查,理解失败的模式

Description (描述) = Communication Mastery (沟通精通)

- 绘制学科成果图谱 = 精确记录关键产出,揭示其底层逻辑

- 揭示专家思维 = 让解决问题的过程可见,追踪微观决策

- 明确规范 = 揭示领域特定的行为,用具体术语定义“像 X 一样思考”

Delegation (委派) = Work Decomposition (工作分解)

- 揭示问题结构 = 将挑战分解为不同组成部分,探索 AI 的可能性

- 探索 AI 的可能性 = 什么可以被自动化/增强/委派给 AI 代理

- 设计决策树 = 基于案例研究,建立何时以及如何让 AI 参与的框架

Diligence (尽责) = Ethical Standards (道德标准)

- 编纂道德框架 = 领域特定的“不作恶”原则,创建决策矩阵

- 明确透明度规范 = 披露期望,为 AI 辅助提供引文模板

- 共同创建问责政策 = 与学生共同建立标准,发展同行评审协议

使用 AI 创建材料

情境利用:

- 已建立的情境 = 每个新工作流都比从零开始更好

- 引用之前的对话和课程设计工作

- 与 AI 分享视频文字记录和课程情境

4Ds 在材料创作中的应用:

- Delegation (委派) = 了解需要什么材料以及为什么需要

- Description (描述) = 利用已建立的情境 + 具体要求

- Description-Discernment (描述-辨别) 循环 = 一个精炼工具,解释建议为何有效或无效

- Diligence (尽责) = 保护敏感数据,验证准确性,检查偏见,创建透明度

四种材料创作选项:

选项1:讲座幻灯片

- 准备:分享课程情境、演示风格、课堂动态、视觉偏好

- 过程:初步大纲 → 评估流程/复杂性 → 开发关键幻灯片 → 制作完整幻灯片

- 最终检查:验证准确性,标注图片/引用需求,记录 AI 的贡献

选项2:学习/复习指南

- 准备:引用讲座主题,描述学生学习习惯,解释有效的辅助工具

- 过程:确定关键概念 → 设计自查问题 → 预判易错点 → 建立知识联系

- 最终检查:验证答案准确性,检查与评估的一致性,确保无障碍性

选项3:互动式课堂练习

- 准备:描述课堂设置、时间限制、学生互动模式、学习目标

- 过程:协作设计活动 → 思考后勤安排 → 预判学生反应 → 创建引导笔记

- 最终检查:测试指令清晰度,考虑无障碍性,规划应急方案

选项4:知识点测验

- 准备:引用学习目标、评估水平、学术诚信方法

- 过程:设计 5-10 个不同类型的问题 → 混合问题类型 → 连接到学习目标 → 创建答案解释

- 最终检查:验证答案正确性,检查偏见/混淆,确保难度适中

关键原则

- AI 素养 = 放大而非取代人类的专业知识

- 学科知识 = 实现前所未有成就的基础

- 人类能力 = 领域专业知识、判断力、创造力、道德和人际关系

- 培养学生成为不可替代的人,而不是被替代的人

- 关注连贯性和质量,而不仅仅是效率

- Description-Discernment (描述-辨别) 循环 = 通过有意义的迭代进行强大的精炼

第 4 课:学生 AI 素养

面向学生的 AI 协作技能培训 课程链接:学生 AI 素养 | 共 6 节课

第1课:AI 素养导论与 4D 框架

AI Fluency (AI 素养) = 通过持久的原则,而非临时的技巧或工具,有效、高效、合乎道德且安全地使用 AI

4D 框架 = 四个相互关联的能力,共同构成 AI 素养:Delegation (委派)、Description (描述)、Discernment (辨别)和 Diligence (勤勉)

Augmentation (增强) vs Automation (自动化):

- 增强 = AI 帮助你更好地完成工作(学习中的首选方式)

- 自动化 = AI 为你完成工作,无需深入思考(对学习有害)

Human in the Loop (人机回圈) = 在保持所有权的同时,做出负责任的决策并深思熟虑地使用 AI

DELEGATION (委派) = 决定哪些工作应由人类、AI 或两者共同完成

三种委派意识:

- 问题意识 = 在使用 AI 前,明确实际目标

- 平台意识 = 了解不同 AI 的能力与局限,以选择合适的工具

- 任务委派 = 分配工作以发挥人类的长处(创造力、判断力、情境理解)和 AI 的长处(速度、一致性、信息处理)

DESCRIPTION (描述) = 如何与 AI 进行协作式对话,而不仅仅是提问

描述的三个维度:

- 产品描述 = 明确最终成果的细节(长度、关键信息、受众、风格、格式)

- 过程描述 = 指导 AI 的处理方法(“一步一步思考”、“考虑多种视角”)

- 性能描述 = 定义 AI 在互动中的行为(扮演批判性编辑、支持性头脑风暴伙伴)

DISCERNMENT (辨别) = 通过批判性评估,识别好坏结果并相应调整

辨别的三个层次:

- 产品辨别 = 评估 AI 输出的准确性、实用性及是否提供新视角

- 过程辨别 = 审视 AI 的推理过程、假设和逻辑步骤

- 性能辨别 = 评估 AI 是否在其被请求的角色中表现出助益

描述-辨别循环 = 一个持续的反馈循环,你描述需求、评估结果,然后迭代优化描述

DILIGENCE (勤勉) = 通过合乎道德、透明和负责任的实践,为 AI 的使用承担责任

三种勤勉:

- 创造勤勉 = 审慎选择 AI 系统,考虑隐私、安全和适用性

- 透明度勤勉 = 诚实地向教授、团队成员和雇主报告与 AI 的协作

- 部署勤勉 = 对 AI 辅助的输出负责,验证其准确性并确保其适当性

学习背景文件 = 一份个性化的参考文件,用于为未来的 AI 会话建立学术背景、学习目标、AI 边界和协作偏好

学习背景的关键要素:

- 学术背景(专业、课程、优劣势、目标)

- 学习风格与挑战

- AI 经验与使用边界

- 偏好的支持类型(寻求指导 vs 完成任务)

- 学术诚信考量

基本原则 = AI 素养技能与技术演进无关,因为它们关注的是战略思维、沟通、评估和道德责任,而非特定工具

第3课:AI 在职业规划中的应用

AI 在职业规划中的应用 = 使用 AI 作为思维伙伴,进行职业探索、技能构建和求职,同时保持真实性

核心原则 = AI 处理信息收集和指导,人类驱动战略、决策和价值观

职业探索过程:

- AI 的优势 = 行业研究、趋势分析、技能差距识别、薪资洞察、职业轨迹规划、头脑风暴职位角色

- 人类的责任 = 自我认知、价值观、权衡取舍、人生目标、直觉

- 两步过程 = 信息收集 (AI) + 个人反思 (人类)

AI 职业探索任务: